Ollama部署大模型 (完整版本、网速慢处理、聊天界面)

Ollama软件下载的模型一般都是别人好的,且模型文件与HuggingFace等平台不一样,使用为主,没有官方API可以对模型微调(教程都是cpp这类的,没必要这么麻烦去操作),所以你如果只是使用大模型,那就Ollama,如果需要微调去部署等操作,去HuggingFace等网站下载模型文件。

切记!切记!切记!

Ollama软件下载的模型一般都是别人微调好的,且模型文件与HuggingFace等平台不一样,使用为主,没有官方API可以对模型微调(教程都是cpp这类的,没必要这么麻烦去操作),所以你如果只是使用大模型,那就Ollama,如果需要微调去部署等操作,去HuggingFace等网站下载模型文件。

一、Ollma的安装

官网:Ollama

下载安装即可,跟其他软件没什么区别;

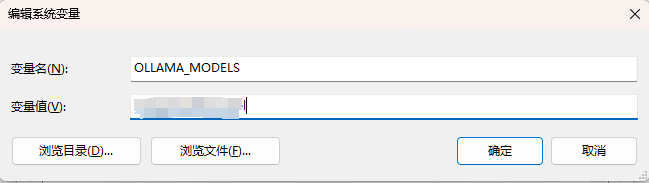

重点来了! 模型默认下载保存位置在c盘,一个模型动辄十来个g,这还得了,安装完成后,设置环境变量 OLLAMA_MODELS

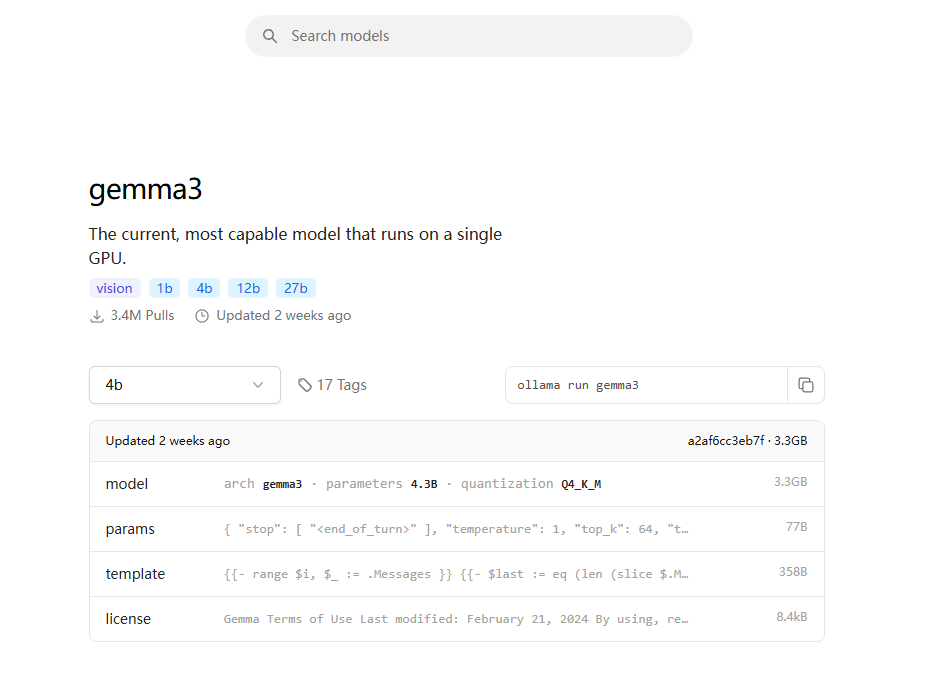

二、模型下载

搜到指定模型后,左边选择大小(1.5b\7b\8\等参数),右边命令自动跟着变化,直接复制到cmd运行(路径不重要),回车运行

![]()

图片只是展示,没对上名字

重点来了!使用的是国内的,无需梯子,所以下载速度很快;但是他跟某盘学了,在后面10%左右会出现降速(几十M变成几十K都有可能),这个时候直接 ctrl+c 中断,按 上键 获取上一个运行命令,回车运行,等待两三秒后,就会恢复下载速度(后面又降速就重复此类操作,网速嘎嘎快)。

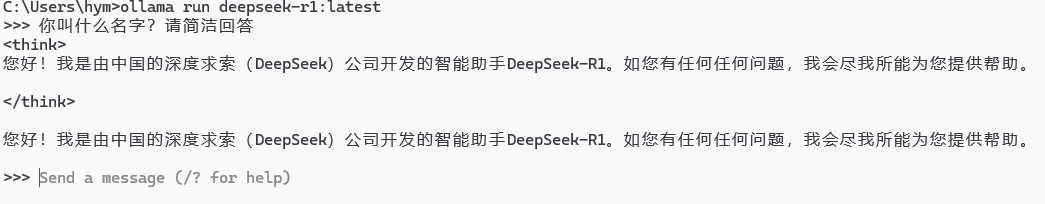

三、对话

默认下载完成打开对话、也可以再次运行下载命令(名字匹配则运行,未匹配则下载)

(deepseek 的缺点,默认自带思考,就算你在prompt或input里面要求了,都还是输出这个过程,用字符串查找或正则匹配去选择输出的最终结果)

四、应用

cmd 看着不直观,直接的聊天对话得借助其他工具(chatbox等)(图像随便找的一个);在设置里面选择ollama模型,一般自动检测地址、名称等。

当然如果在代码中需要使用的话,如下所示:

当然如果在代码中需要使用的话,如下所示:

from ollama import Client

ollama_client = Client(host='http://localhost:11434')

prompt = f"""

问题:{user_query}

回答:

"""

response = ollama_client.generate(

model="rajivmehtapy/natural-sql:latest",

prompt=prompt,

options={"temperature": 0.1}

)

result = response['response']host地址是ollama默认地址(11434),包括在地方地方支持使用ollama模型的时候,导入的地址也是这个。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)