简单吧,Agent优化就两种路径,有参数优化和无参数优化,你选哪种 | 最新综述

本文基于一项系统性研究《A Survey on the Optimization of Large Language Model-based Agents》,该研究由华东师大和东华大学多位人工智能领域的研究者共同完成。研究团队通过对大量相关文献的分析,构建了一个全面的LLM智能体优化框架,涵盖了从理论基础到实际应用的各个方面。您有兴趣可以找来读一下这篇综述。下图展示了本研究的整体框架结构,清晰地呈

本文基于一项系统性研究《A Survey on the Optimization of Large Language Model-based Agents》,该研究由华东师大和东华大学多位人工智能领域的研究者共同完成。研究团队通过对大量相关文献的分析,构建了一个全面的LLM智能体优化框架,涵盖了从理论基础到实际应用的各个方面。您有兴趣可以找来读一下这篇综述。

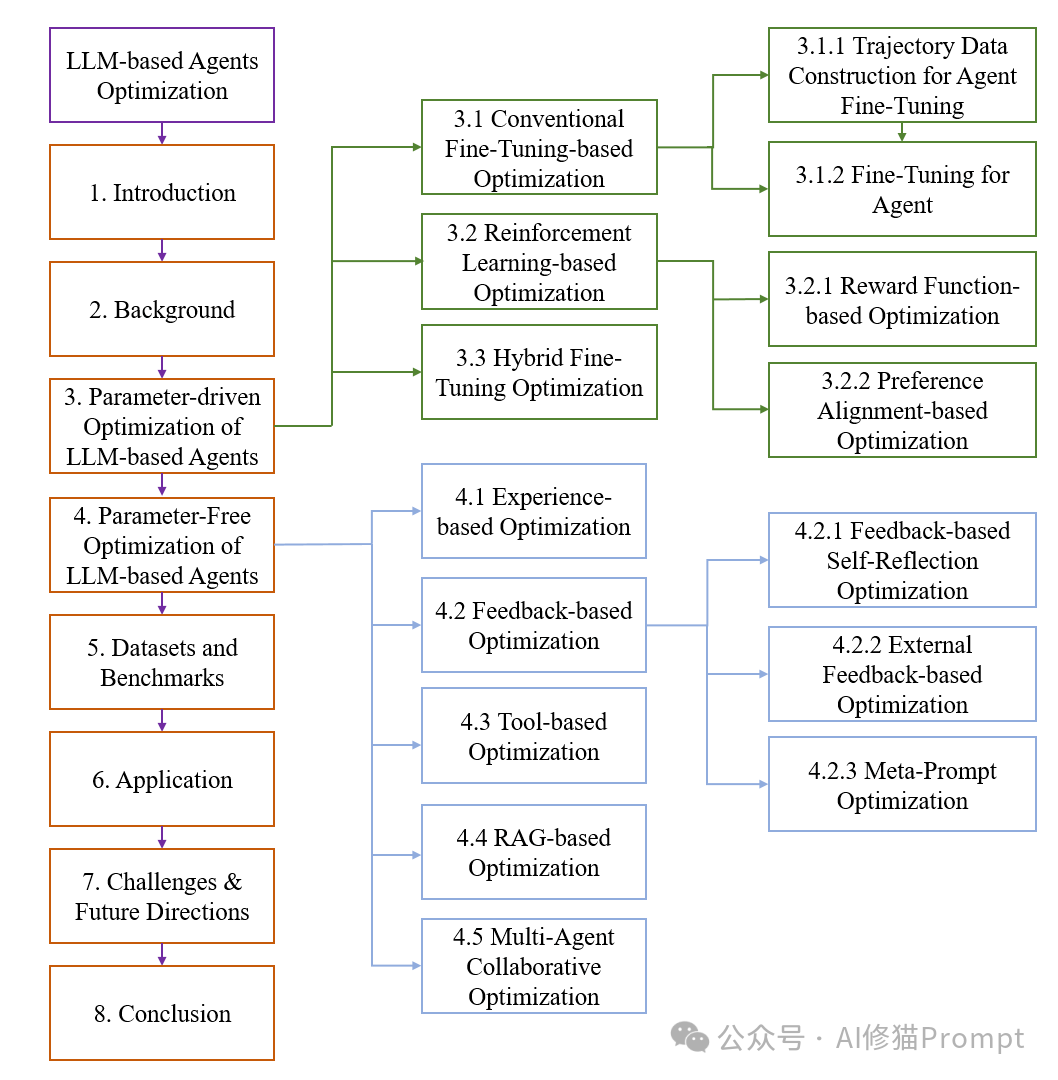

下图展示了本研究的整体框架结构,清晰地呈现了LLM智能体优化的主要研究方向和各个组成部分之间的关系:

论文组织概览

如图所示,整个研究框架分为八个主要部分:

-

1. 引言 - 介绍LLM智能体的基本概念和研究背景

-

2. 背景 - 探讨LLM智能体的理论基础和发展历程

-

3. 参数驱动优化 - 详细分析通过调整模型参数实现的优化方法

-

• 3.1 传统微调优化

-

• 3.2 强化学习优化

-

• 3.3 混合微调优化

-

-

4. 无参数优化 - 研究不改变模型参数的优化技术

-

• 4.1 基于经验的优化

-

• 4.2 基于反馈的优化

-

• 4.3 基于工具的优化

-

• 4.4 基于RAG的优化

-

• 4.5 多智能体协作优化

-

-

5. 数据集与基准测试 - 评估智能体性能的标准和资源

-

6. 应用 - LLM智能体在各领域的实际应用案例

-

7. 挑战与未来方向 - 当前面临的问题和发展趋势

-

8. 结论 - 总结研究发现和贡献

这一框架不仅系统地组织了现有研究成果,还为未来的研究方向提供了清晰的指引。通过这种结构化的方法,研究团队成功地将复杂的优化技术分类并进行了深入分析。

Agent优化的双重路径:参数驱动与无参数方法

当我们谈论LLM智能体优化时,实际上是在讨论两条截然不同却又相辅相成的技术路径。理解这一分类框架对于你选择合适的优化策略至关重要。

参数驱动优化:重塑模型内部表征

参数驱动优化方法直接调整LLM的参数权重,从根本上改变模型对信息的处理方式。这类方法包括监督微调(SFT)、强化学习(RL)和混合优化策略。

作为AI工程师,你需要了解参数驱动优化的核心优势在于能够从根本上增强模型的能力边界。例如,通过微调,你可以使模型更好地适应特定领域的任务;通过强化学习,你可以让模型学习长期规划和决策能力。

然而,参数驱动方法也面临着计算资源需求大、需要大量高质量数据等挑战。对于资源有限的团队,这可能是一个需要权衡的因素。

监督微调:智能体轨迹数据的构建与优化

监督微调(SFT)是优化LLM智能体最直接的方法,其核心在于构建高质量的智能体轨迹数据。这些数据记录了智能体与环境交互的完整过程,包括观察、思考、决策和行动。

轨迹数据构建主要有四种方法:

-

1. 基于强LLM的构建:利用GPT-4等强大模型生成高质量轨迹。例如,AgentTuning和FireAct使用ReAct和CoT方法引导智能体行为,同时整合Reflexion技术进行优化,提高生成数据的多样性。

-

2. 基于自我探索的构建:让智能体自主与环境交互,通过试错学习生成轨迹。ENVISIONS和Voyager等方法允许智能体在复杂环境中自主探索,积累经验并生成多样化的轨迹数据。

-

3. 基于人类反馈的构建:整合人类专家的知识和反馈来优化轨迹。这种方法能够确保生成的数据符合人类价值观和期望,但成本较高且效率较低。

-

4. 基于多智能体协作的构建:通过多个智能体之间的协作和竞争生成更丰富的交互数据。这种方法能够模拟更复杂的社会动态和决策过程。

对于轨迹数据的评估和过滤,你可以采用环境反馈、模型评估或人类评估等方法。例如,AgentTuning和ENVISIONS使用环境反馈来评估轨迹的成功与否,而有些方法则利用强大的LLM来评估轨迹质量。

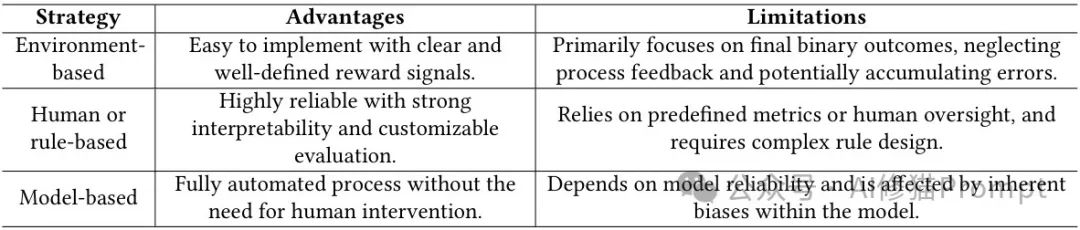

数据评估和过滤策略比较

值得注意的是,失败案例也是宝贵的学习资源。通过比较成功和失败轨迹的差异,智能体可以学习到更鲁棒的决策策略。例如,CRITIC方法使用对比学习来区分正确和错误的行动,而OPTIMA则利用蒙特卡洛树搜索(MCTS)生成的轨迹对进行比较学习。

强化学习优化:从奖励函数到偏好对齐

强化学习(RL)为LLM智能体提供了一种通过环境反馈持续改进的机制。在LLM智能体优化中,RL方法主要分为两类:基于奖励函数的优化和基于偏好对齐的优化。

基于奖励函数的优化利用传统RL技术(如PPO和Actor-Critic)通过明确定义的奖励信号指导迭代学习过程。奖励函数设计是这类方法的核心,主要包括:

-

1. 基于环境的奖励:直接从环境反馈中获取奖励信号。例如,WebGPT使用人类反馈作为奖励信号来优化网页导航能力,而RLHF则利用人类偏好构建奖励模型。

-

2. 基于模型的奖励:利用LLM或专门训练的模型评估智能体行为,提供隐式或显式反馈。StepAgent使用逆强化学习框架,通过判别器预测智能体轨迹与专家行为的一致性来生成奖励信号。

-

3. 基于任务的奖励:根据特定任务目标设计奖励函数。例如,在代码生成任务中,可以使用代码执行成功率作为奖励信号。

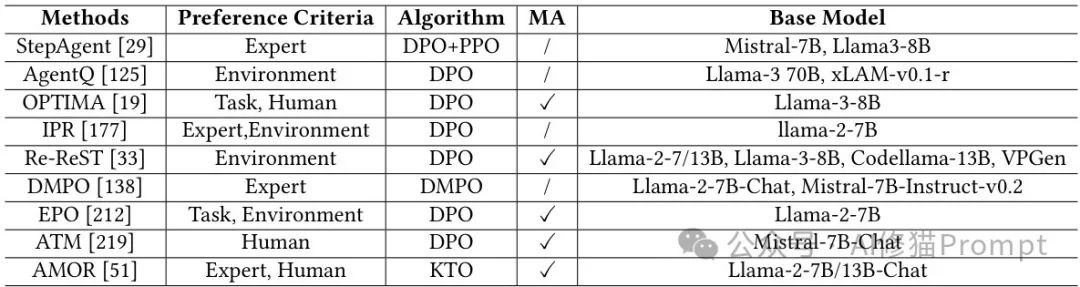

基于偏好对齐的优化则提供了一种替代传统RL的范式,直接将模型行为与人类或专家偏好对齐,无需依赖显式奖励信号。这类方法主要通过直接偏好优化(DPO)等技术实现,简化了优化过程。

偏好对齐优化方法总结

偏好数据构建可以基于人类反馈、任务或环境偏好、模型生成偏好等方式。例如,EPO使用环境反馈对输出进行排名,识别优胜和失败样本;AgentQ则利用MCTS探索各种行动轨迹,结合AI过程反馈和成功率生成偏好数据。

混合优化策略:结合SFT与RL的最佳实践

混合优化策略结合了SFT和RL的优势,通过多阶段训练提升智能体性能。这种方法通常先使用SFT学习基本能力,再通过RL优化特定行为。

一些研究采用迭代方法来优化混合范式,在SFT和RL阶段之间交替进行。例如,OPTIMA结合迭代SFT和迭代DPO,使LLM智能体通过SFT学习最优轨迹,同时利用基于比较偏好的DPO进一步优化理解能力。

对于资源有限的团队,混合优化提供了一种平衡性能和效率的方法,可以根据具体需求调整各阶段的权重和顺序。

无参数优化:提升智能体行为而不修改模型参数

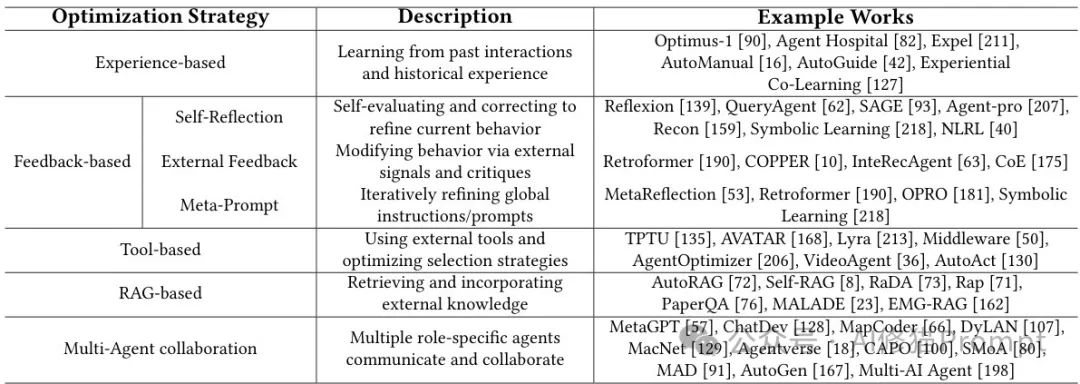

无参数优化方法专注于改进智能体行为,而无需修改模型参数。这些方法利用提示工程、上下文学习和检索增强生成(RAG)等技术,将各种信息整合到提示中以引导智能体行动。

无参数优化方法比较

基于经验的优化:从历史中学习

基于经验的优化利用过去的交互经验来改进智能体的决策能力。这种方法通过记忆和反思机制,使智能体能够从历史中学习并应用到新情境。

例如,Optimus-1利用多模态记忆模块将探索轨迹转换为层次化知识图,辅助任务规划和提示生成。Agent Hospital则整合医疗记录库和经验库,基于成功和失败案例优化决策指南。

对于需要处理复杂任务的智能体,经验优化提供了一种高效的学习机制,使其能够从过去的错误中学习并不断改进。

基于反馈的优化:自我反思与迭代改进

基于反馈的优化通过反馈机制实现自我反思、纠错和迭代改进。这种方法可以分为三类:

-

1. 基于反馈的自我反思优化:智能体通过分析自身行为生成反馈。例如,Reflexion使智能体在每次行动后进行反思,识别错误并调整策略。

-

2. 基于外部反馈的优化:利用外部来源(如其他智能体或环境)提供反馈。Retroformer使用经PPO训练的回顾模型分析失败并提供反馈,使主要智能体能够基于回顾性见解迭代调整其行动。

-

3. 元提示优化:优化全局指令或元提示,提升智能体的泛化能力。MetaReflection从失败尝试中提取信息创建优化提示,迭代整合以提升任务表现。

基于工具的优化:扩展智能体能力边界

基于工具的优化通过集成外部工具和API扩展智能体的能力边界。这种方法使智能体能够执行超出其内在能力的任务,如数学计算、代码执行和信息检索。

例如,ToolLLM通过工具使用数据集和多阶段训练提升工具使用能力,而ToolAlpaca则使用合成数据和指令微调增强工具交互能力。

对于需要处理多样化任务的智能体,工具优化提供了一种灵活的解决方案,使其能够根据需要调用适当的工具完成复杂任务。

检索增强优化:知识获取与整合

检索增强优化通过外部知识检索和整合提升智能体的知识获取能力。这种方法使智能体能够访问最新和专业的信息,超越预训练知识的限制。

一些方法专注于优化检索配置和增强语言模型输出。例如,AutoRAG自动选择RAG模块,系统评估检索技术、重排策略和扩展方法的组合,以识别最佳配置。Self-RAG则整合检索与自我反思,使智能体能够通过迭代反馈自适应地优化内容。

多智能体协作优化:集体智慧的力量

多智能体框架通过协作处理复杂、动态任务。通过分配责任给专业智能体,它们实现并行处理、信息共享和自适应角色分配,减轻认知和计算负担。

在基于LLM的多智能体优化中,提示定义智能体角色、协调交互并建立共享目标。通过迭代协作和反馈,这些框架增强决策能力,使集体表现超越个体能力。

例如,MetaGPT整合多智能体协作框架,使不同角色的智能体能够协同工作,共同解决复杂问题。CAMEL则通过自主协作学习使智能体能够自主学习和改进协作策略。

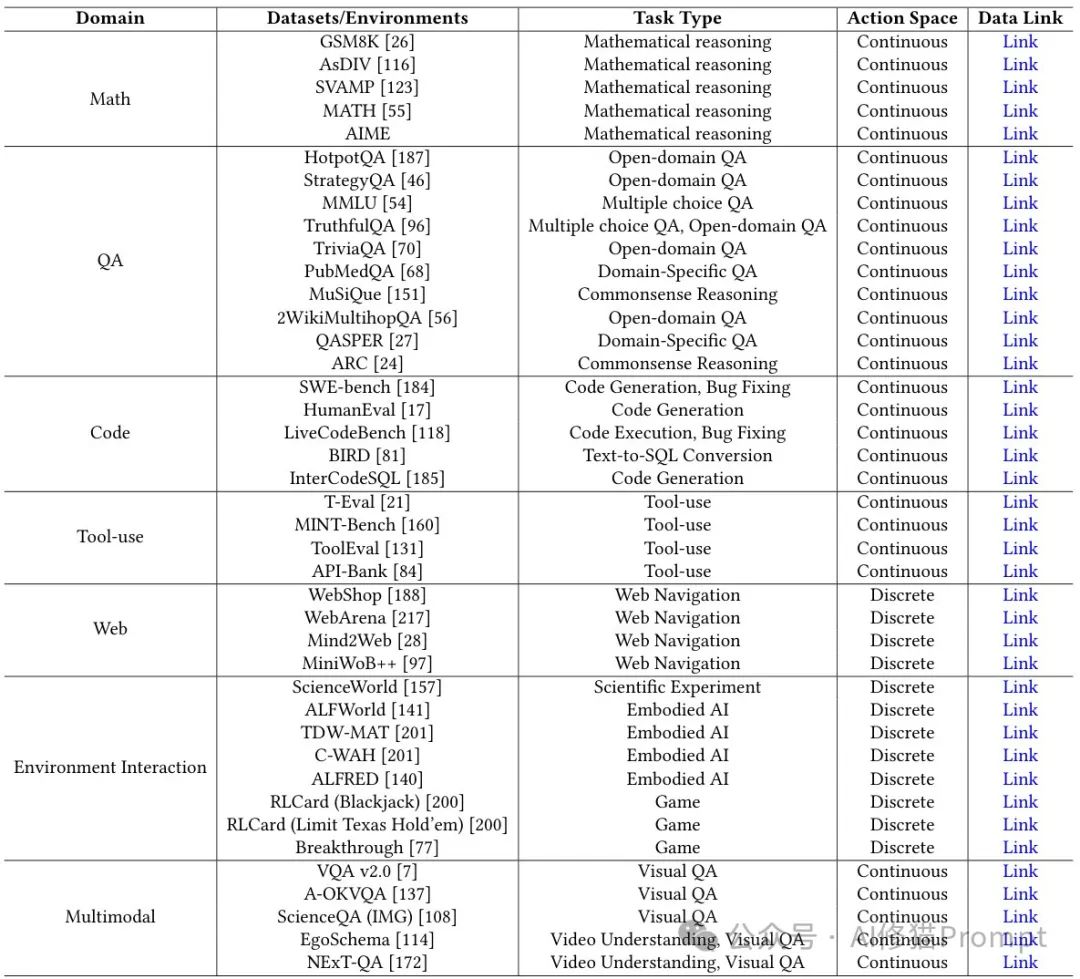

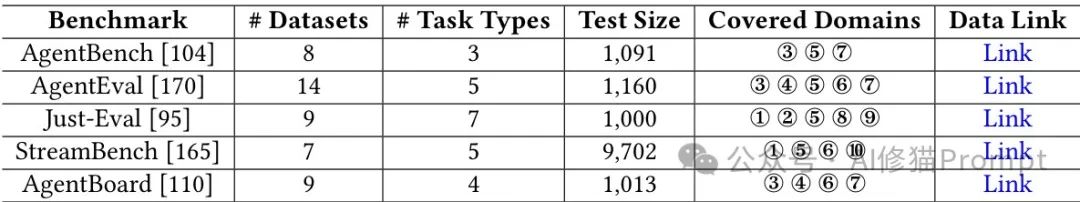

评估与调优:数据集与基准测试

数据集和基准测试对于评估和增强LLM智能体至关重要。这些资源可以分为两类:用于评估的数据集和基准测试,以及用于智能体调优的数据集。

评估数据集与基准测试

评估数据集和基准测试用于衡量智能体在各种任务中的表现。这些任务包括数学推理、问答、代码生成、工具使用、环境交互、网页导航和多模态任务等。

评估任务数据集和环境总结

数学推理数据集评估智能体执行多步推理和解决复杂问题的能力。例如,GSM8K提供小学水平的算术问题,测试模型的推理能力;MATH则包括代数、微积分和几何问题,挑战智能体的推理深度。

问答数据集评估智能体的理解、推理和提供准确答案的能力。例如,HotpotQA是一个大规模多跳问答数据集,要求智能体从多个文档中提取信息并进行逻辑推理;MMLU则评估57个学科的知识,测试模型在零样本和少样本任务中的表现。

代码数据集评估智能体在代码生成和编程任务中的能力。例如,SWE-bench专注于真实世界的软件工程任务,测试智能体利用自然语言问题描述和代码库上下文生成补丁代码的能力;HumanEval则评估智能体从文档字符串合成Python代码的能力。

多任务智能体评估基准提供了综合评估框架,涵盖多种任务类型。例如,AgentBench评估智能体在八个环境中的决策能力,包括操作系统、数据库、知识图谱和网页;AgentBoard则提供多轮评估框架,涉及九个任务类别,包括网页、工具使用、游戏和具身AI。

多任务智能体评估基准

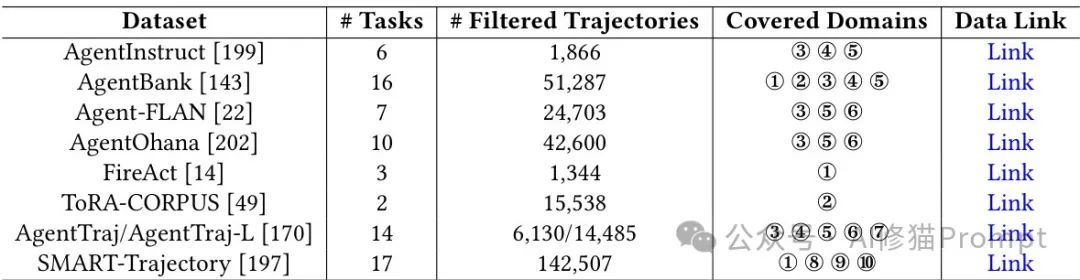

智能体调优数据集

微调数据集对于优化LLM智能体至关重要,它们提供高质量轨迹,使智能体能够获取任务特定能力并在目标场景中提升性能。

智能体调优数据集

常用的智能体调优数据集包括AgentInstruct、AgentTuning、AgentOhana、MINT和AgentBench等。这些数据集涵盖多种任务领域,如问答、数学、网页、具身AI、代码和工具使用等,为智能体优化提供了丰富的训练资源。

LLM智能体的应用前景

LLM智能体已在多个领域展示出其潜力,包括医疗、科学、具身智能、金融和编程等。这些应用展示了LLM智能体如何解决复杂任务并提升生产力。

医疗领域

在医疗领域,LLM智能体通过整合专业知识和推理能力,支持诊断、治疗规划和医学研究。例如,HuatuoGPT-01和BianQue等模型通过整合医学知识和推理能力,提供准确的诊断和治疗建议。

这些医疗智能体通常采用多智能体架构,模拟医疗团队的协作过程。例如,AI Hospital建立了一个多智能体医疗交互模拟器,涵盖医生、护士和患者等角色,实现更自然的医疗对话和决策支持。

金融领域

LLM智能体在金融领域广泛应用于市场预测、交易决策、风险管理和金融模拟等任务。通过高级推理能力和外部工具,这些智能体提高决策效率,自动化重复任务,并适应动态市场环境。

例如,TradingGPT、FinMem和FinAgent利用层次化记忆和反思机制分析历史交易数据,促进对市场波动的自适应决策。多智能体系统如FinCon、TradingAgents和Finvision通过整合结构化报告和自然语言辩论,模拟现实世界的团队动态,使分析师和风险管理者等不同角色能够协作。

具身智能领域

在具身智能领域,LLM智能体通过感知、规划和执行能力,实现与物理世界的交互。这些智能体整合视觉、语言和行动模态,执行导航、操作和协作等任务。

例如,SayCan结合LLM驱动的知识与RL,引导机器人助手完成现实世界任务,如厨房杂务;Voyager则利用长期记忆和推理在Minecraft中获取和优化技能。这些应用展示了LLM智能体如何桥接感知和规划,实现复杂任务的执行。

未来挑战与发展方向

尽管LLM智能体优化取得了显著进展,但仍面临多项挑战,包括数据质量与偏见、算法适应性与效率、评估标准、安全与对齐以及参数驱动多智能体优化等。

数据质量与偏见

LLM智能体依赖训练数据的质量和一致性,面临一般预训练数据与智能体特定调优数据之间的分布不匹配问题。此外,一些数据集包含由多智能体系统生成或由LLM优化的交互,可能引入LLM的认知偏见,基于先前模型行为放大或创造新的偏见。

未来研究应专注于开发构建数据集和减轻数据偏见的稳健技术,如对抗训练方法、偏见测试和探索LLM知识边界。此外,将训练数据分布与现实世界应用对齐对减少偏见至关重要。

算法适应性与效率

当前的优化算法在处理多样化任务和环境时面临适应性挑战。许多方法依赖特定奖励函数或预定义目标,限制了它们在新环境中的泛化能力。此外,计算效率问题使得在资源有限的环境中难以实施复杂优化技术。

未来方向包括开发自适应优化算法,能够根据任务特性和环境动态调整学习策略。此外,探索参数高效的优化技术,如LoRA和QLoRA,可以在保持性能的同时降低计算成本。

评估标准

LLM智能体评估面临标准化挑战,现有指标主要关注任务完成而非优化有效性。此外,评估环境的多样性和复杂性不足,难以全面评估智能体在现实世界场景中的表现。

建立标准化评估框架是促进LLM智能体任务公平比较的有希望方向。这包括开发超越任务完成的统一基准,纳入适应性、推理复杂性和迭代改进的指标。

安全与对齐

随着LLM智能体能力的增强,确保它们的行为与人类价值观和意图保持一致变得越来越重要。当前的优化方法可能导致意外行为或安全风险,特别是在复杂环境中。

未来研究应专注于开发更强大的对齐技术,确保智能体行为符合人类期望。这包括探索基于价值观的优化方法、多目标对齐技术和安全约束机制。

参数驱动多智能体优化

参数驱动多智能体优化仍是LLM智能体研究中一个未被充分探索的领域。大多数现有方法专注于优化单个智能体的性能,在为参数驱动多智能体协作量身定制的方法方面存在差距。

未来方向包括开发专门的多智能体优化框架,支持联合参数优化和协作学习。这包括探索多智能体强化学习技术、集体偏好对齐方法和协作知识共享机制。

智能体优化的未来展望

LLM智能体优化正处于快速发展阶段,为构建更智能、更自主的AI系统开辟了新的可能性。通过结合参数驱动和无参数优化方法,我们可以创建能够在复杂环境中有效学习、规划和决策的智能体。

作为AI工程师,了解这些优化技术的原理和应用对于构建下一代智能系统至关重要。无论是通过微调增强模型的基础能力,还是通过强化学习培养长期规划能力,或是利用无参数方法提升智能体的适应性,这些技术都将在未来的AI发展中发挥关键作用。

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献752条内容

已为社区贡献752条内容

所有评论(0)