AutoDL云部署ChatGLM4+lora微调

云端部署GLM4并且lora微调教程

一、创建实例

显卡推荐选择4090,镜像选择

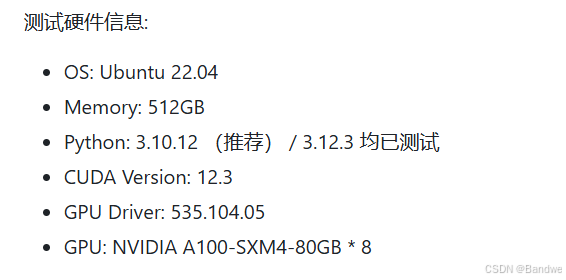

首先ChatGLM4所需配置如下:

重点是python3.10.12,ubuntu22.04

没找到CUDA为12.3的,

因此选择镜像如下

二、git项目

1.GLM-4

打开终端

git clone https://github.com/THUDM/GLM-4.git(可选)启动学术加速【如果下载速度太慢可以用这个】

source /etc/network_turbo

(unset http proxy && unset https proxy)【退出学术加速的命令】

学术加速用完记得退出

conda create --name myenv python=3.10.12

conda init退出终端重新进入

Root前面要有(base)才算成功

激活虚拟环境

conda activate myenv进到项目目录

cd GLM-4更新pip包,进入basic demo目录

pip install --upgrade pipcd basic_demo下载环境依赖:

pip install -r requirements.txt2.LLaMA-Factory(lora微调用)

先回到根目录

cd ~git clone https://github.com/hiyouga/LLaMA-Factory.git复制命令安装:

pip install -e ".[torch,metrics]"三、下载模型

切换目录

cd /root/autodl-tmp更新软件包

sudo apt update安装git-lfs

sudo apt-get install git-lfs下载

git clone https://www.modelscope.cn/ZhipuAI/glm-4-9b-chat.git进入项目目录

cd glm-4-9b-chat/修改文件:

文件路经:GLM-4/basic_demo/trans_cli_demo.py

修改内容:MODEL_PATH = "GLM-4-9B-Chat"

启动:python trans_cli_demo.py

至此,大模型可以直接在终端启动

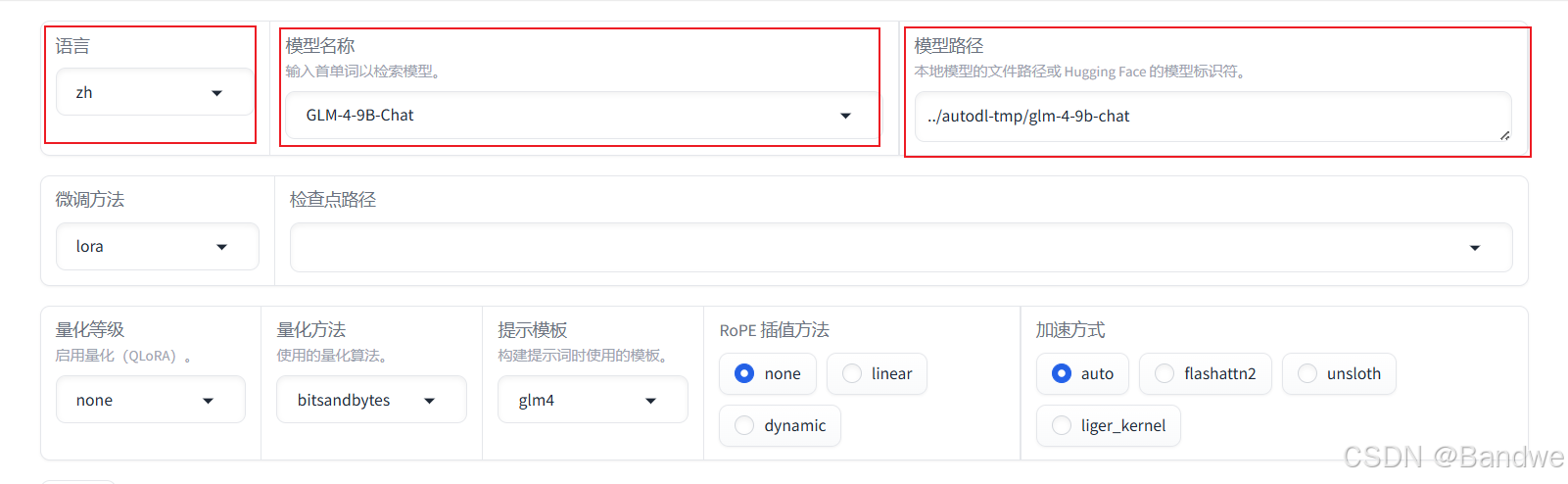

四、lora微调

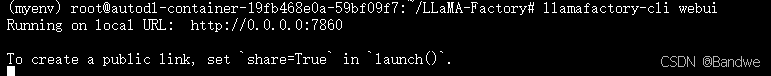

进入 LLaMA-Factory目录

llamafactory-cli webui

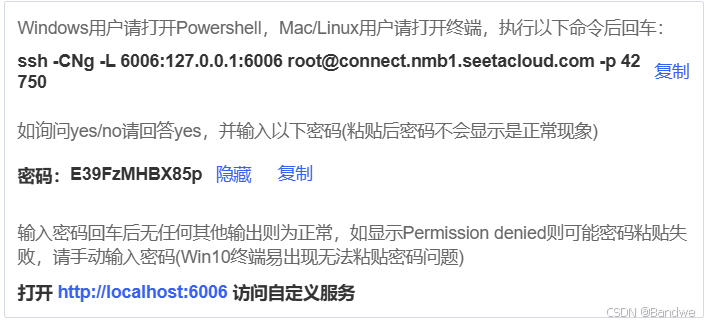

Powershell连接

打开powershell,

复制并且修改命令 127.0.0.1:6006改为127.0.0.1:7860

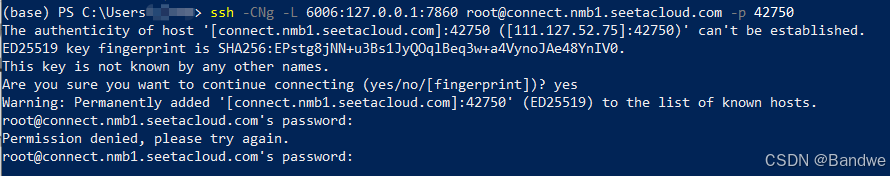

输入密码

打开http://localhost:6006

成功界面:

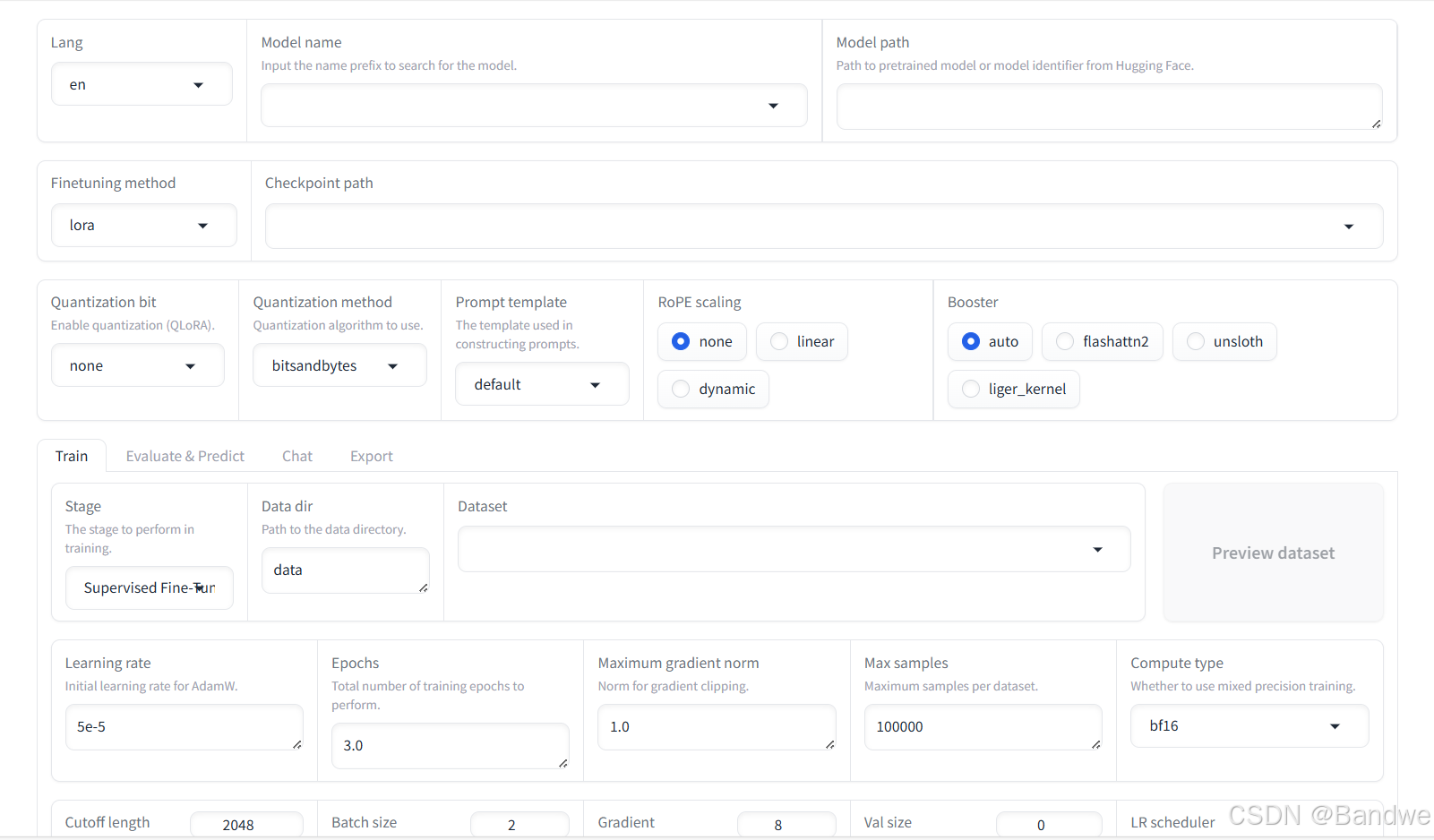

(lora相关)

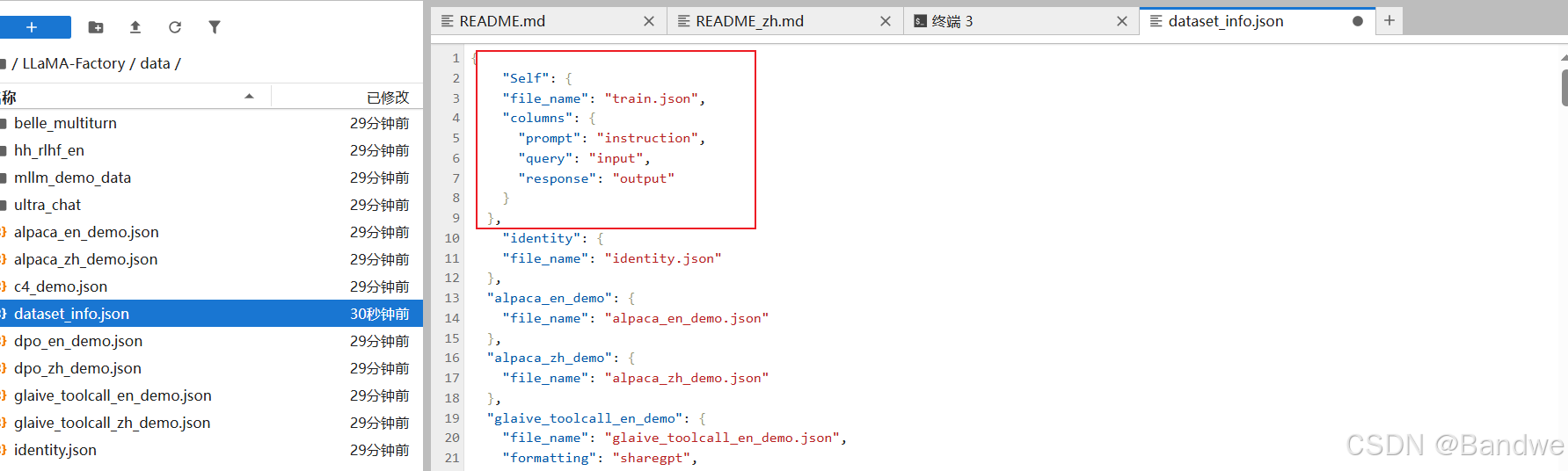

在该路径下加入这段代码:

具体格式可以在readme中找到,本文只是举了其中一个例子

上传训练文件(train.json)到data文件夹里

需要修改的地方:

选上Self用于lora训练

从左到右依次点击预览命令-保存训练参数-载入训练参数-开始

训练完成后进入chat选项检验成果

记得选上最近的路径检查点

没有问题就可以导出文件了

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)