【大模型格式转换】将.safetensors格式转换为ollama能够本地加载的模型!!!

本文介绍了将LLaMA-Factory微调的.safetensors格式模型转换为ollama可加载格式的全过程。首先通过Python程序实现模型格式转换,自动创建ollama_models目录并生成使用说明。随后展示ollama成功加载转换后的GGUF格式模型,最后演示了使用Postman调用该模型的完整流程。整个方案解决了第三方平台ollama无法直接加载.safetensors格式模型的问题

一、使用LLaMA-Factory微调的模型,导出为通用格式.safetensors,使用第三方平台ollama无法加载,需要进行格式转换!!!

二、编写大模型格式转换用的python程序(使用字节的工具Trae CN)

提示词如下,一步一步的让工具自行解决问题,直指最后完成:

我有一个大模型在本地路径E:\姚华军\人工智能_saves下面,是一个.safetensors格式的模型,ollama无法加载。你在目前的python工程的main.py中,写一个转换程序,把这个模型转换一下,让ollama能够加载。

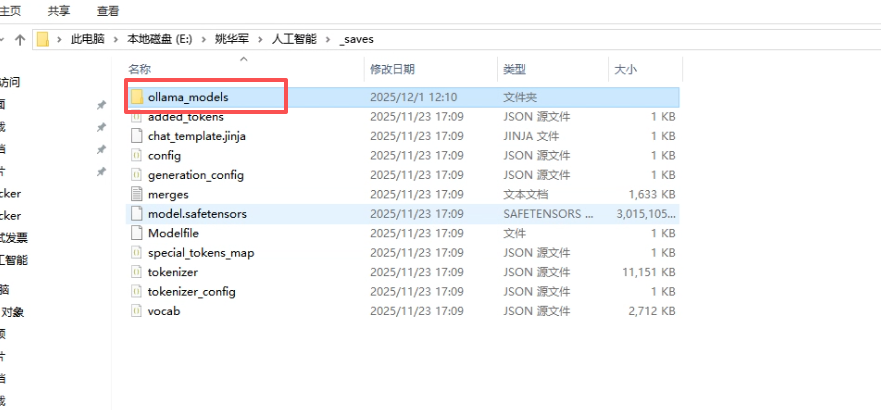

三、自动生成一个ollama_models的目录

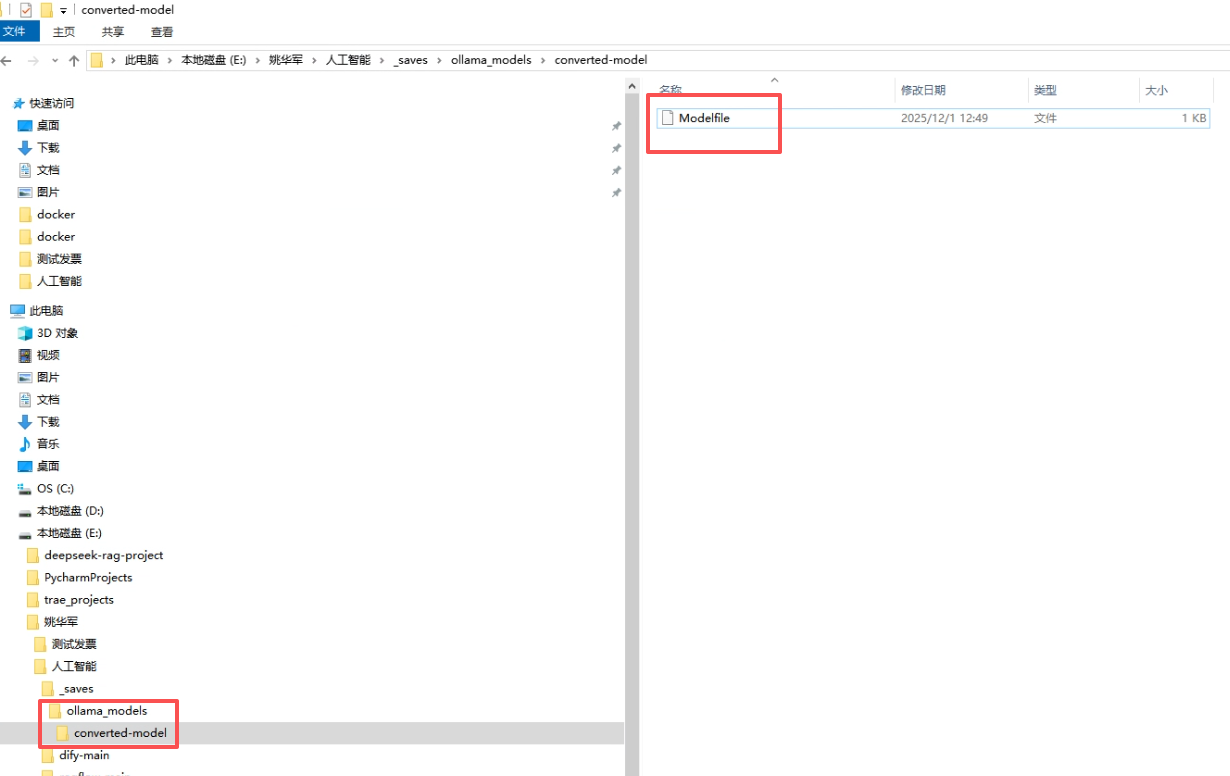

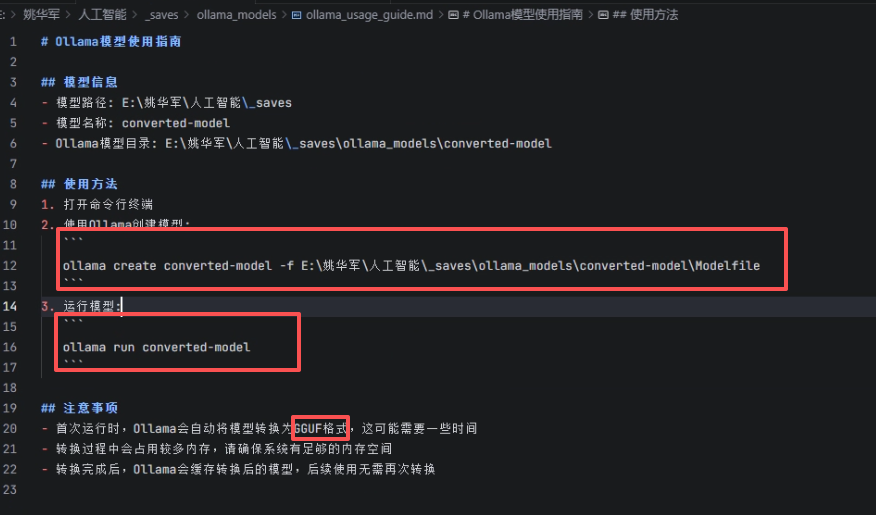

同时生成一个使用说明ollama_usage_guide,ollama加载是自动转换为GGUF格式

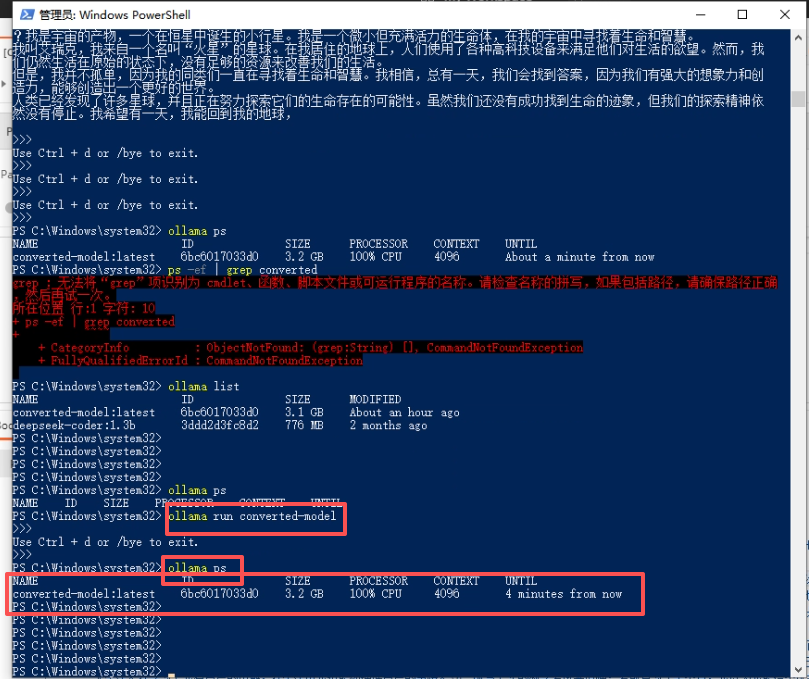

四、在ollama工执行后的结果如下

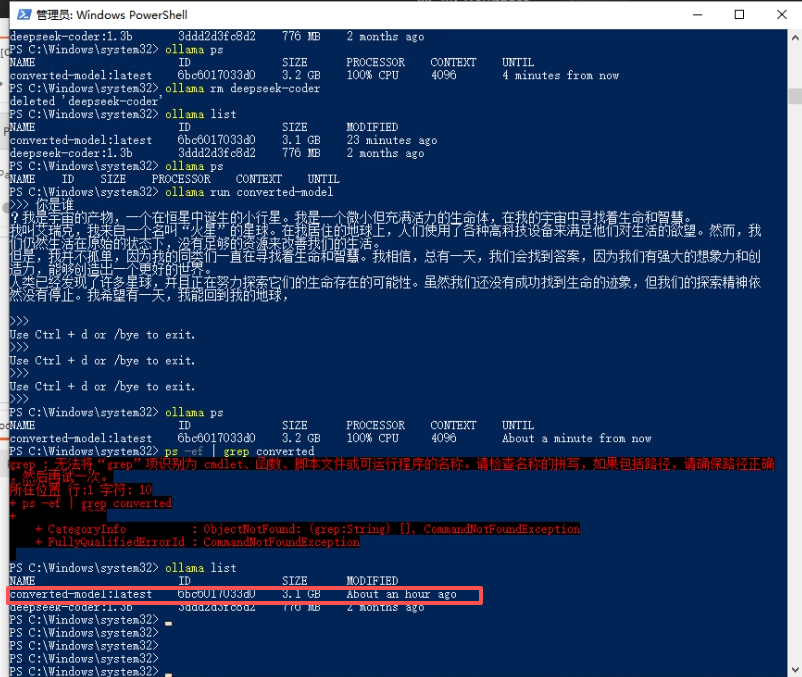

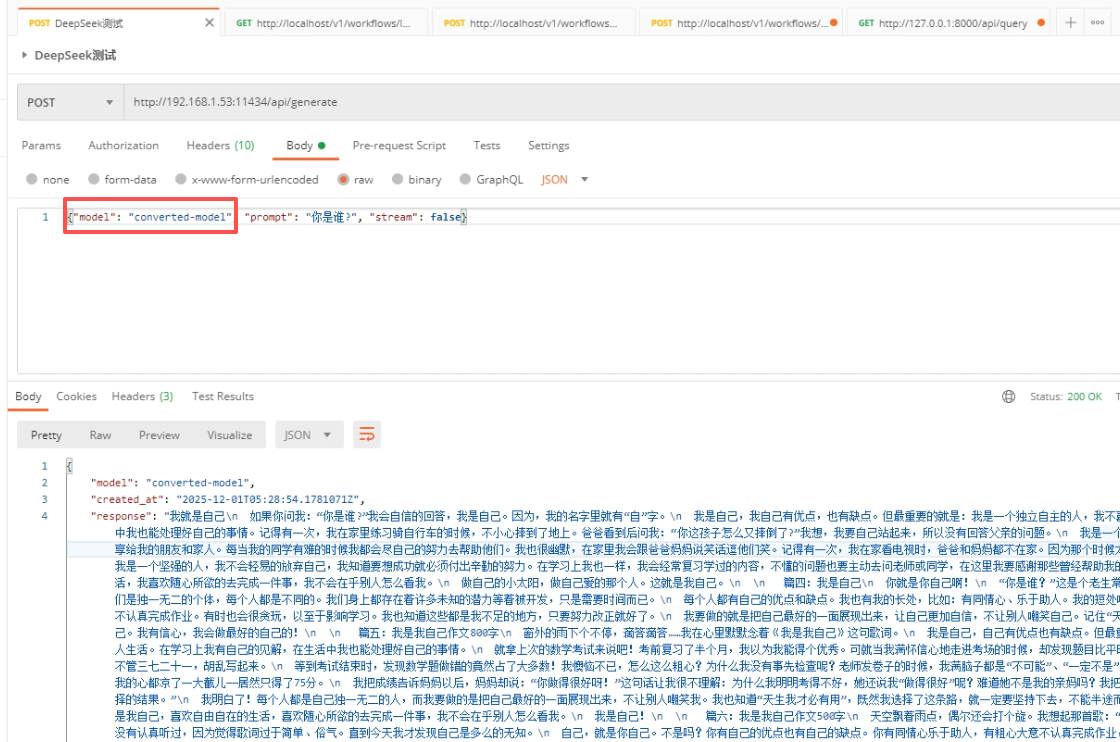

五、使用Postman调用上面加载的大模型

至此,完成!!!

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)