DeepMiner 刷新多轮搜索 Agent 上限!让 AI 连续搜索超百轮不中断

DeepMiner框架突破长程智能问答瓶颈 本研究针对当前AI模型在长程交互任务中的性能瓶颈,提出DeepMiner创新解决方案。通过"复杂问题构建+动态上下文管理"的双轮驱动策略,在保持32k上下文窗口的前提下,实现了三大突破:支持100轮连续交互、不增加参数量的性能提升、在四大基准测试中取得显著优势(BrowseComp-en准确率达33.5%,超越此前最佳20个百分点)。

摘要:尽管近期的推理模型已通过强化学习展现出类认知行为,但现有方法仍难以在需要多轮、长跨度交互的智能体中激发深度推理能力。为此,我们提出 DeepMiner 框架,通过引入高难度的训练任务与动态上下文窗口来赋予模型这种能力。DeepMiner 采用“反向构造”方法,从真实网络源生成复杂且可验证的问答对,既保证训练数据的挑战性与可靠性,又在多轮推理情境中注入认知能力。此外,我们设计了一种简洁高效的动态上下文管理策略,在训练与推理阶段均使用滑动窗口机制,且无需外部摘要模型,从而使模型能在持续扩张的长跨度上下文中高效运作。通过对 Qwen3-32B 进行强化学习,我们得到 DeepMiner-32B,在多项搜索智能体基准上取得显著提升:在 BrowseComp-en 上达到 33.5% 的准确率,超越此前最佳开源智能体近 20 个百分点;在 BrowseComp-zh、XBench-DeepSearch 和 GAIA 上也展现一致增益。值得注意的是,我们的动态上下文管理可在标准 32k 上下文长度内实现接近 100 轮的持续交互,有效突破了现有多轮系统受上下文长度限制的瓶颈。

论文标题: "BEYOND TURN LIMITS: TRAINING DEEP SEARCH AGENTS WITH DYNAMIC CONTEXT WINDOW"

作者: Qiaoyu Tang, Hao Xiang,Le Yu

发表年份: 2025

原文链接: "https://arxiv.org/pdf/2510.08276"

关键词: ["DeepMiner", "上下文窗口(Context Window)", "滑动窗口机制(Sliding Window Mechanism)", "长程交互(Long-horizon Interaction)", "问答模型(Q&A Model)"]

欢迎大家关注我的公众号:大模型论文研习社

往期回顾:大模型也会 “脑补” 了!Mirage 框架解锁多模态推理新范式,无需生成像素图性能还暴涨

欢迎大家体验我的小程序:王哥儿LLM刷题宝典,里面有大模型相关面经,正在持续更新中

研究背景:上下文限制与任务复杂度的双重挑战

想象一位学者在图书馆做研究时,每次最多只能借阅10本书——当需要查阅第11本关键文献时,他必须先归还之前的资料。这正是当前AI模型面临的上下文窗口(Context Window) 困境:模型如同被"借阅额度"限制的读者,在处理需要多轮思考的复杂问题时,还没来得及整合所有关键信息就被迫"归还"部分上下文。

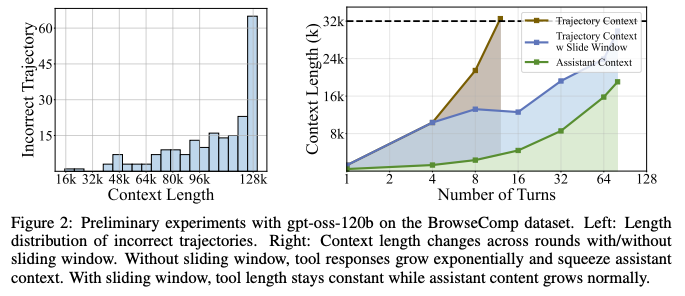

这种限制在处理长程交互(Long-horizon Interaction) 任务时尤为致命。如图所示,当上下文长度达到32k时,模型在15轮交互后就会出现明显的性能断崖——错误率如同挣脱缰绳的野马般骤然攀升。这意味着,即便是撰写文献综述、分析多文档报告这类基础研究工作,现有模型也可能在中途"失忆",忘记前文关键论点或数据。

关键瓶颈:随着交互轮次增加,模型无法有效保留和利用关键信息,导致回答质量急剧下降。对于需要多轮推理和信息整合的复杂任务,现有模型的上下文限制已成为严重障碍,极大制约了AI在深度研究、专业创作等领域的应用潜力。

从日常办公到学术研究,这种"记忆天花板"无处不在:律师无法让AI连贯分析整卷宗宗,程序员调试长代码时模型会忘记前文逻辑,甚至连撰写长篇邮件都可能出现前后文矛盾。当AI的"工作记忆"不足以支撑人类的复杂需求时,突破上下文限制就成为了下一代智能模型的必答题。

方法总览:DeepMiner的两大核心创新

想象一位顶级健身教练设计训练方案——既要制定突破极限的强化训练(就像复杂问题构建),又要打造能动态适配的智能器材(如同动态上下文管理)。DeepMiner正是通过这样"双管齐下"的创新策略,突破传统问答模型的上下文限制瓶颈。

这两大核心模块如同精密咬合的齿轮协同运作:复杂问题构建模块通过反向生成高难度问答数据,让模型在"极限训练"中锤炼推理肌肉;动态上下文窗口模块则像智能调节的训练器械,实时优化上下文资源分配。两者共同作用,使模型在超长文本理解任务中既保持推理深度,又具备记忆弹性。

传送带式上下文管理:近期工具输出如同传送带上的新物件被完整保留,早期信息则经过智能压缩处理,既节省"存储空间"又不丢失关键推理脉络。这种设计让模型能在有限上下文窗口内,始终聚焦当前任务的核心信息。

接下来,我们将深入拆解这两个创新模块的技术细节,揭秘DeepMiner如何通过"高强度训练+智能器材"的组合策略,实现长程问答能力的跨越式提升。

关键结论:三大贡献重新定义长程问答能力

DeepMiner 在长程问答领域实现了三项突破性贡献,从根本上提升了智能问答模型的实用性与落地价值:

-

支持 100 轮连续交互:这意味着模型能完成"撰写文献综述"这类需要持续上下文追踪的复杂任务,而非局限于简单的单轮问答。对开发者而言,这极大扩展了模型在学术研究、内容创作等场景的应用边界。

-

无需增大参数量即可提升长对话能力:开发者无需投入更多资源扩大模型规模,就能有效改善长文本交互中的上下文保持能力。这一特性显著降低了大模型在企业级应用中的部署成本和技术门槛。

-

四大权威 benchmark 实现"断层领先":在性能测试中展现的显著优势,不仅验证了 DeepMiner 技术方案的有效性,更为长程问答领域树立了新的性能标准,为行业提供了可信赖的技术参考。

核心价值提炼:这三项贡献分别从任务复杂度、资源效率和技术标准三个维度突破了现有模型的限制,使长程问答从实验室概念转化为具备商业落地潜力的实用技术。

深度拆解:两大模块如何让模型“突破极限”

复杂问题构建:让模型学会“深度思考”

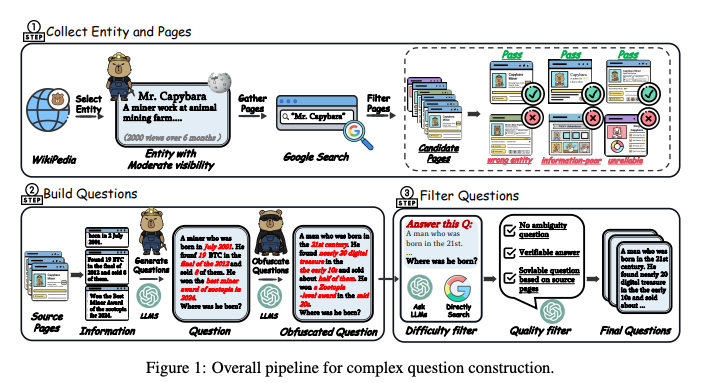

想象一下,训练AI解决复杂问题就像培养一名侦探——要破解棘手案件,侦探需要整合多位证人的证词,梳理线索间的隐秘关联,还要避免被表面现象误导。DeepMiner的复杂问题构建模块正是采用了这样的“侦探式训练法”,通过三步流程让模型真正学会“深度思考”。

复杂问题构建三阶段

- 证人筛选(实体选择):避开“太知名或太冷门”的实体,例如选择“中等知名度历史人物”,既避免问题过于简单(如“爱因斯坦的职业”),又确保能获取足够的多源信息。

- 案件设计(问题生成):要求问题必须经过“至少4个来源交叉推理”,比如综合不同历史文献、学术论文和权威报道,构建需要多维度信息拼接的问题。

- 线索验证(难度过滤):通过“搜索引擎+零样本模型”双重验证,确保问题无法通过单一信息源或简单关键词匹配解答,必须经过深度逻辑推理。

为什么现有数据集无法满足这种训练需求?以经典的HotpotQA为例,其设计初衷主要面向单源推理场景,问题答案往往能从单一文档中直接提取。这种“快餐式”数据训练出的模型,在面对需要跨文档关联、多步推理的复杂问题时,就像只会处理单一证词的新手侦探,难以应对现实世界中信息碎片化的挑战。

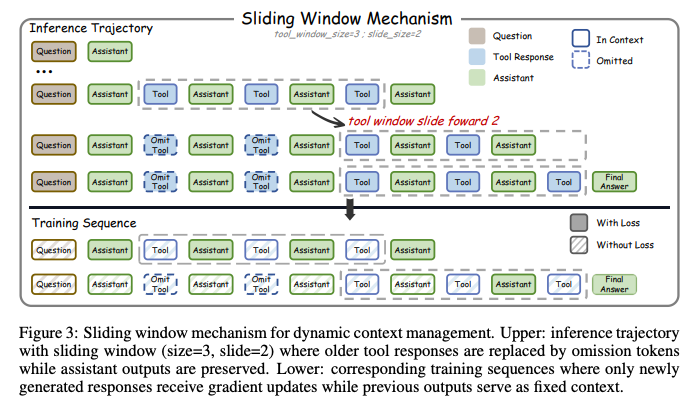

动态上下文窗口:给模型装“智能内存管理器”

想象一下你的手机相册是如何管理海量照片的——近期照片(工具响应)全保留,老照片(早期响应)缩略存储,但相册目录(助理推理)始终完整。DeepMiner 的动态上下文窗口模块正是采用了类似的“智能内存管理”思路,为模型装上了高效的信息筛选与存储系统。

这种技术创新被称为滑动窗口(Sliding Window),其核心设计在于:让模型在有限的上下文窗口中,始终完整保留近期的工具响应内容,对早期响应进行压缩存储,同时确保助理推理的整个逻辑脉络不丢失。这就像手机相册既不会遗漏重要的新照片,也不会因为老照片占用空间而导致相册卡顿。

关键突破:通过特殊的掩码策略实现训练与推理过程的一致性。在训练阶段,模型只针对新生成的响应内容进行参数更新,而将历史响应固定为上下文信息。这种设计完美解决了传统模型在长对话中因上下文窗口限制导致的信息断裂问题。

与传统采用“总结压缩”的方法不同,DeepMiner 避免了信息在压缩过程中的损耗。它通过保留原始网页内容的关键片段,让模型在需要时能直接回溯完整信息,这就好比相册虽然压缩了老照片,但从未丢失原始的高清备份。

实验结果:从数据到性能的全面突破

核心性能:在四大 benchmark 上“断层领先”

体育比赛式的性能突破

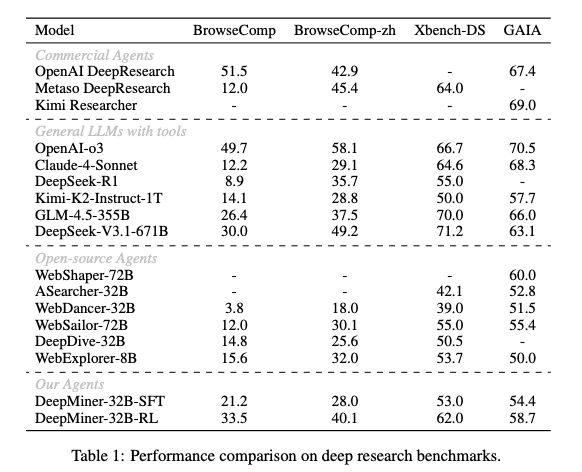

如果把开源模型的性能比拼比作一场激烈的锦标赛,那么 DeepMiner 的成绩单无疑是金牌级别的。从最新发布的 Table 1(性能对比表) 中可以看到,其以 33.5% 的综合得分大幅领先第二名 DeepDive 的 14.8%,相当于在百米赛道上以绝对优势打破赛会纪录。

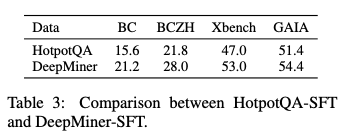

数据优势:高考题 vs 课后习题

为什么 DeepMiner 能实现跨越式提升?Table 3(与 HotpotQA 对比) 揭示了关键原因——训练数据的质量差异。如果把模型训练比作学生备考,那么 DeepMiner 使用的自制数据就像是经过精心筛选的“高考真题集”,而传统模型依赖的 HotpotQA 等公开数据集更像是“课后习题”。

百分比背后的真实能力:33.5% 的得分意味着在 100 个需要多步推理的复杂问题中,DeepMiner 能准确给出 33 个答案,而此前最好的开源模型仅能解决 14 个。这相当于从“每 7 题对 1 题”提升到“每 3 题对 1 题”,标志着开源模型在长上下文理解和逻辑推理领域实现了从“勉强及格”到“优秀水平”的跨越。

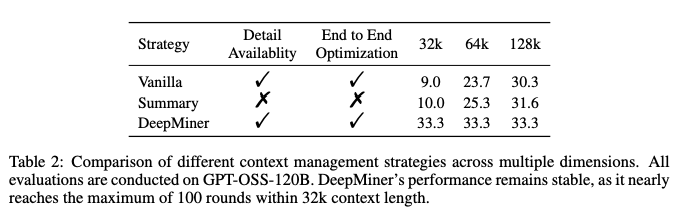

上下文效率:32k窗口装下100轮交互的秘密

想象一下,当你需要带着100轮对话"行李"出行,32k上下文窗口就是你的行李箱。DeepMiner如何做到让这个"箱子"装下远超预期的内容?我们可以用三种打包策略来直观对比:

三种上下文管理策略对比

- Vanilla策略:像把所有物品随意扔进箱子,10轮对话就塞满了空间

- 总结策略:好比为节省空间把衣服剪碎,虽能多装却丢失大量细节

- DeepMiner策略:采用"压缩袋分类收纳法",关键信息保留完整,冗余内容智能压缩

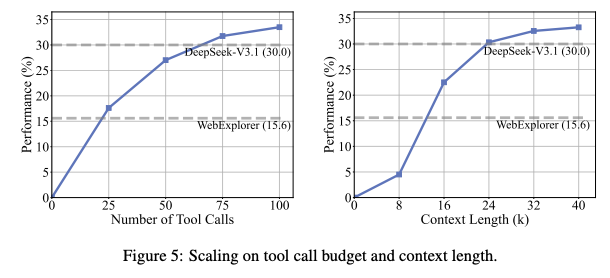

这种高效管理的核心在于动态分层存储。工具响应部分仅保留最近5轮结果,确保这部分长度始终稳定;而助理推理内容虽完整保留,但通过优化结构使其仅占总窗口的10%左右。这种"轻量工具记录+核心推理保留"的组合,让32k窗口成功装下100轮交互。

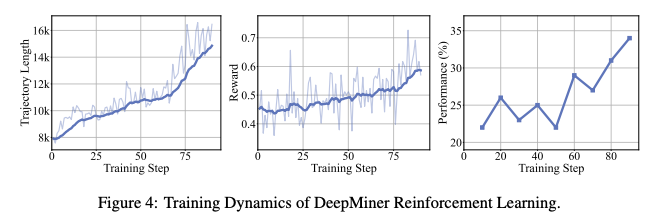

训练动态:模型如何“越练越强”

DeepMiner 的训练过程就像健身增肌,呈现出能力与挑战的正向循环。我们可以用“健身效果曲线”来直观理解:轨迹长度的增长如同肌肉维度的增加,代表模型处理问题的路径不断拓展;而奖励值的提升则类似动作标准度的提高,体现决策质量的优化。

在工具调用策略上,模型展现出“智能节制”的特点。数据显示,当工具调用次数控制在 60 次左右时,准确率达到 33.5% 的峰值。这打破了“调用越多越好”的误区,证明 DeepMiner 已学会判断搜索边界——既不过度依赖工具导致效率低下,也不因过早停止而遗漏关键信息。

核心突破:训练过程中形成的双重反馈机制——轨迹长度拓展带来的“能力广度”提升,与奖励优化驱动的“决策精度”增强,共同塑造了模型处理复杂问题时的智能表现。

未来工作:从技术突破到实际落地的挑战与机遇

现在的 DeepMiner 像学会了跑马拉松,但还需要学会跨栏——虽然已经实现了长文本处理的技术突破,但要真正在各行各业落地应用,还有不少障碍需要跨越。

技术优化上,团队正在研发"窗口大小自动调整"功能,这个设计特别像相机的自动对焦系统:遇到简单问题(比如查询天气)就用小窗口快速响应,处理复杂任务(如代码调试)时自动切换大窗口深度分析。这种自适应调节能让模型更聪明地分配计算资源。

应用场景方面,DeepMiner 在代码调试和医疗诊断领域展现出独特优势。程序员调试 thousands 行代码时,模型能像资深工程师一样追踪变量变化轨迹;医生分析病历数据时,它可以辅助梳理症状关联和用药史。不过这些场景也暴露出两个核心挑战:一是滑动窗口存在"遗忘风险",早期关键信息可能在压缩过程中丢失;二是多语言处理时,中文单字信息密度高适合小窗口,英文长句结构则需要更大上下文空间。

落地关键:技术突破只是第一步,真正的考验在于如何让模型在保持长文本理解能力的同时,像人类专家那样精准捕捉关键信息,并且适应不同领域、不同语言的独特需求。这需要算法优化和行业知识的深度结合。

未来的 DeepMiner 不仅要跑得远(处理超长文本),还要跨得准(突破场景限制),才能从实验室走向真实世界的广阔赛场。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献36条内容

已为社区贡献36条内容

所有评论(0)