让AI既会“看”又会“想”——「推理透明化+知识驱动」解码VQA推理新范式

视觉问答(Visual Question Answering, VQA)和多模态学习是实现跨模态智能理解的关键技术。针对复杂多跳推理、知识驱动解释性及多语言数据稀缺性等难题,本博文聚焦于构建高效、可解释的多模态语言模型,提出了问题引导的多跳推理图网络、多模态知识推理思维链、和基于机器翻译的多语言多模态学习三种创新框架。

作者:邱晨 武汉科技大学WEB与工业智能研究团队

引言

在人工智能领域,视觉问答(Visual Question Answering, VQA)和多模态学习是实现跨模态智能理解的关键技术。针对复杂多跳推理、知识驱动解释性及多语言数据稀缺性等难题,武汉科技大学的ONTOWEB研究团队聚焦于构建高效、可解释的多模态语言模型,提出了问题引导的多跳推理图网络(Question-Guided Multi-hop Reasoning Graph Network, QMRGT)、多模态知识推理思维链(Multimodal Knowledge Reasoning via Chain-of-Thought, MuKCoT)和基于机器翻译的多语言多模态学习(Translated Data for Multilingual Multimodal Learning , TD-MML)三种创新框架。这些成果分别发表于《Information Processing and Management》(IPM)2023年第60卷、2024年第61卷及EMNLP 2022会议,助力VQA和多模态学习领域的深入探索与发展。

VQA的推理困境与多跳突破:QMRGT

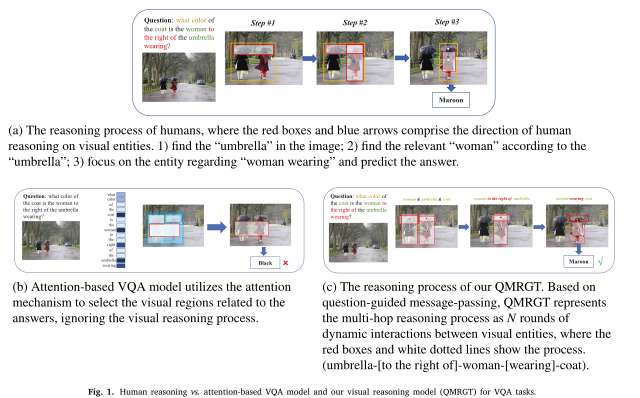

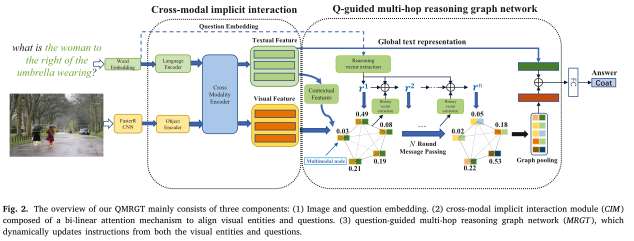

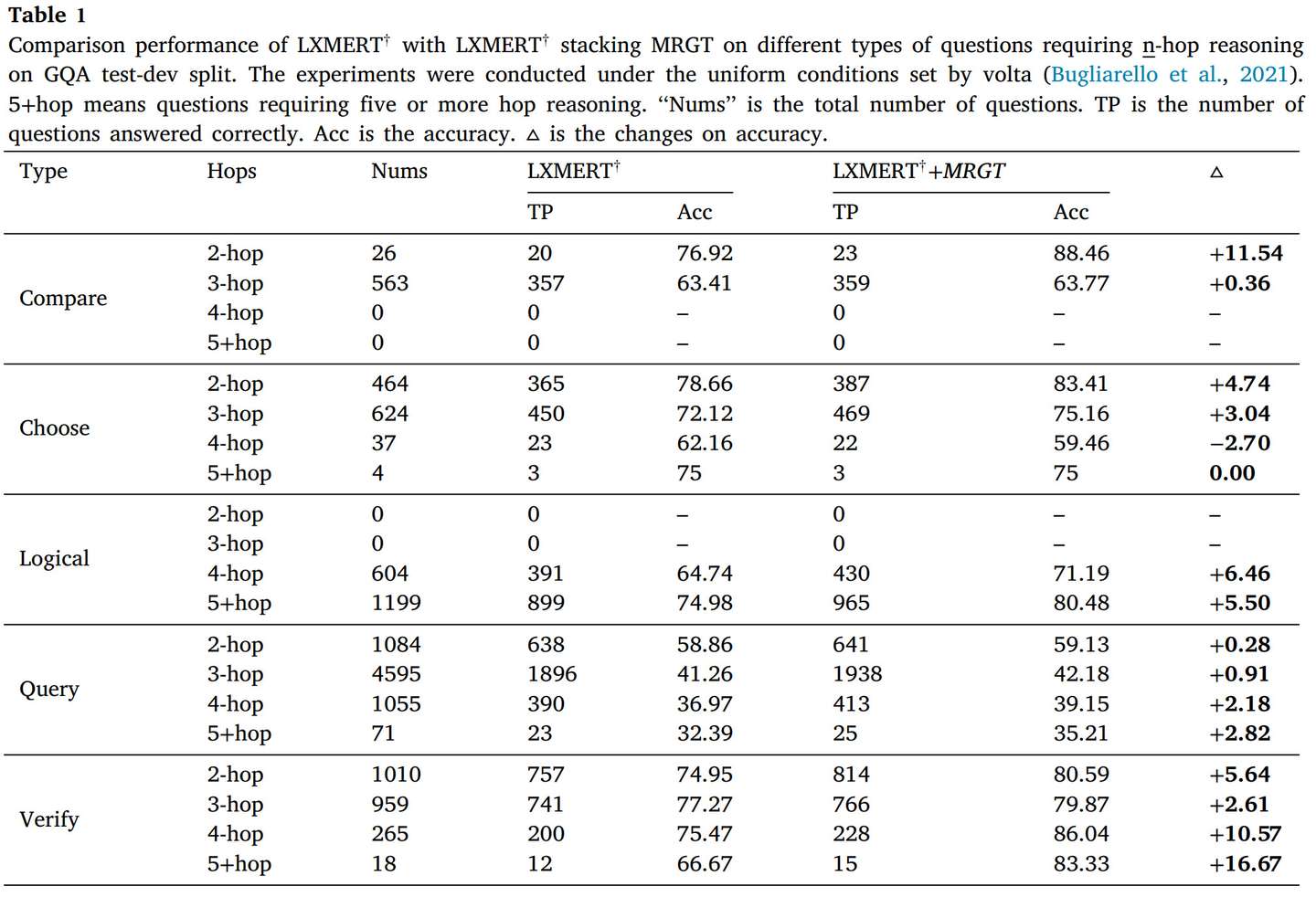

传统VQA模型依赖注意力机制直接预测答案,难以建模长程实体关系以应对多跳推理问题(如“伞右边的女士穿的外套是什么颜色?”),且缺乏可解释性。为此,我们提出了QMRGT(IPM 2023),一种问题引导的多跳推理图网络,通过动态视觉实体交互实现透明化的推理过程。该框架利用跨模态隐式交互模块(CIM)对齐视觉与文本特征,并通过多跳推理图网络(MRGT)实现跨模态隐式交互的多跳推理。其中历史视觉特征监督更新多跳推理问题指令,以增强模型的显式推理及可解释性;问题指令指导视觉实体的动态信息传递和表征更新,确保多跳推理的连贯性。实验表明,QMRGT在GQA数据集上显著提升多跳问题准确率(如5跳问题提高16.67%),并通过可视化推理路径增强模型透明性,为复杂VQA任务提供了可靠解决方案。

题目:A question-guided multi-hop reasoning graph network for visual question answering

作者:徐朝阳,顾进广,刘茂福,周光有,符海东,邱晨*

论文链接:https://www.sciencedirect.com/science/article/abs/pii/S0306457322003089

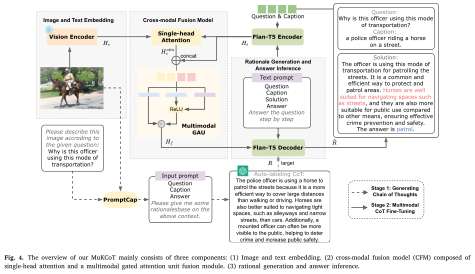

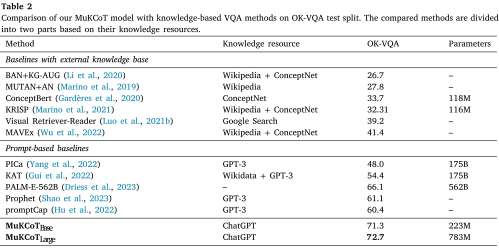

知识驱动的可解释推理:MuKCoT

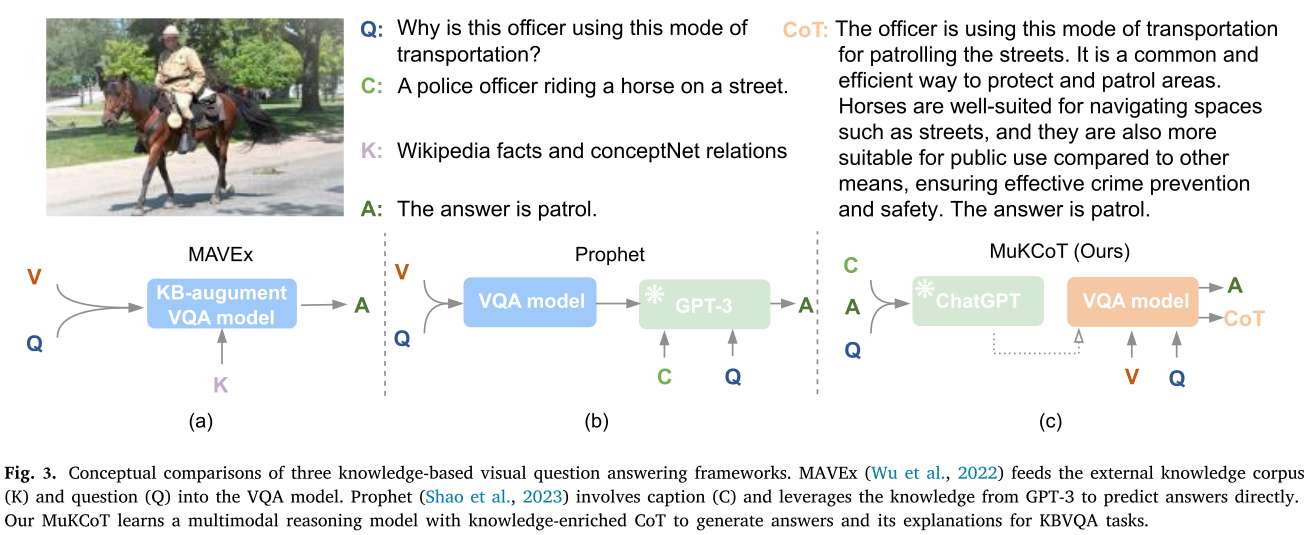

知识型视觉问答(KBVQA)需结合外部知识实现跨模态推理,如何激活语言模型的推理能力并生成一致性解释成为一大挑战。传统方法受限于知识覆盖不全、视觉信息丢失及推理黑箱化问题。我们提出了MuKCoT(IPM 2024),通过引入多模态知识推理思维链(Chain-of-Thought, CoT)激活大语言模型(LLMs)的推理能力,生成一致性解释。MuKCoT利用LLMs自动生成推理链(如“图像识别→知识检索→场景推理→结论”),并训练小型视觉-语言模型执行CoT推理,同时开放相关资源。实验表明,MuKCoT在OK-VQA数据集上性能提升6.6%,在A-OKBQA直接回答任务上提升1.9%,为知识驱动的可解释AI建立新标杆。

题目:Explainable Knowledge reasoning via thought chains for knowledge-based visual question answering

作者:邱晨,谢志强,刘茂福,胡慧君*

论文链接:https://www.sciencedirect.com/science/article/abs/pii/S0306457324000864

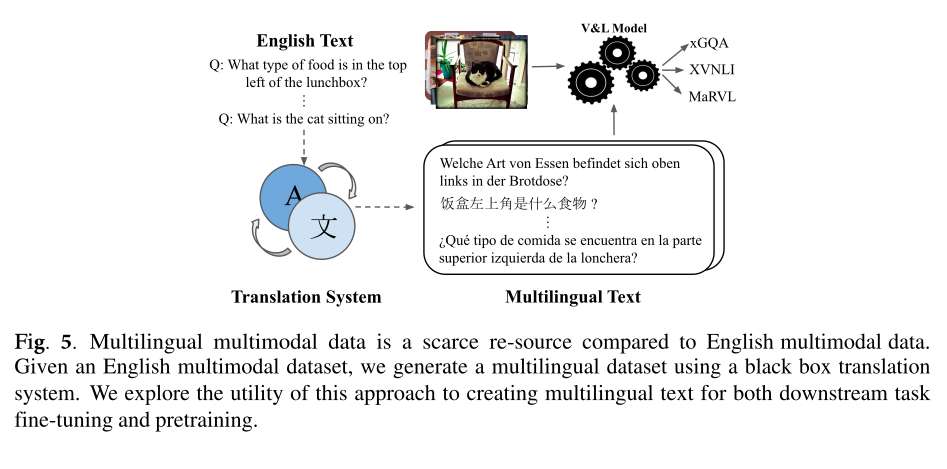

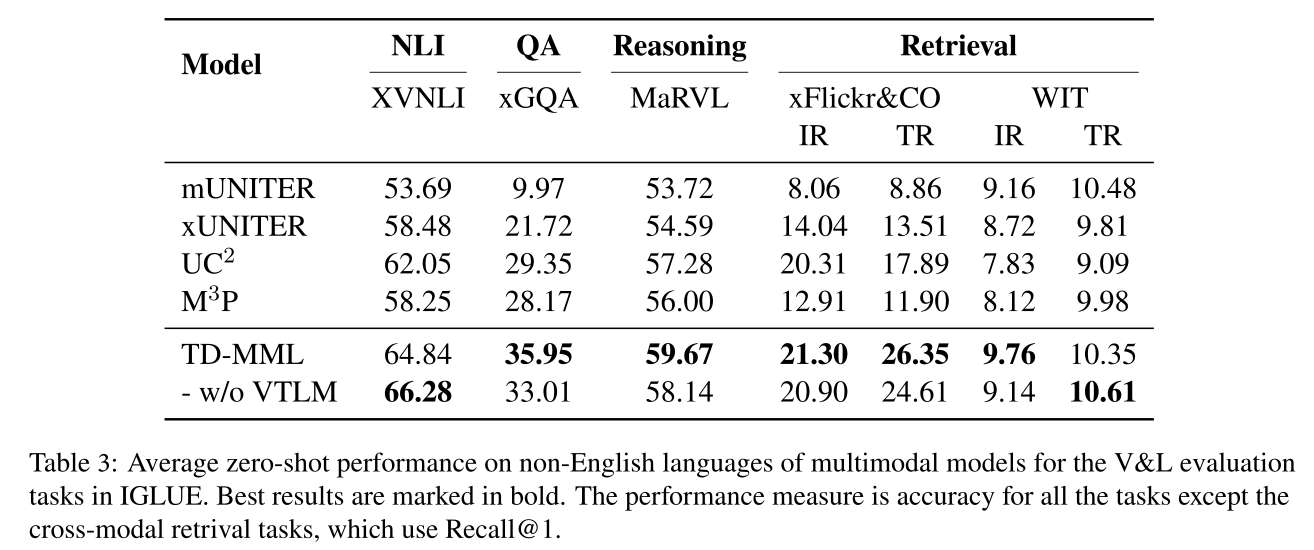

多语言多模态学习的突破:TD-MML

视觉-语言任务若局限于英语,将难以满足多语言场景需求。针对多语言多模态训练数据稀缺问题,我们提出了TD-MML(EMNLP 2022),通过机器翻译英语多模态数据(如Conceptual Captions),生成覆盖20种语言的5200万图像-文本对。该框架引入数据质量过滤(基于词型重复率和BLEU分数)和视觉翻译语言建模(VTLM)任务优化模型的跨语言对齐。实验显示,TD-MML在IGLUE基准上表现优异,如零样本xGQA提升6.6个百分点,多语言微调MaRVL达61.60%准确率,打破了语言壁垒。

题目:Multilingual Multimodal Learning with Machine Translated Text

作者:Chen Qiu, Dan Oneată, Emanuele Bugliarello, Stella Frank, Desmond Elliott

论文链接:Multilingual Multimodal Learning with Machine Translated Text - ACL Anthology

综合成果与展望

上述研究从多跳推理(QMRGT)、知识增强(MuKCoT)和多语言扩展(TD-MML)三个维度突破了视觉问答和多模态学习的瓶颈,在VQA 2.0、GQA、OK-VQA及IGLUE等多项基准中取得显著提升。QMRGT解决了复杂多跳推理与透明性问题,MuKCoT实现了知识驱动的可解释推理,TD-MML为低资源多语言场景提供可扩展的数据生成框架。未来,我们计划融合知识图谱增强推理鲁棒性、优化大语言模型的计算效率,并探索其在教育、医疗等领域的应用,进一步提升AI在“看”、“说”和“推理”上的智能化与普适性。

[1] Zhaoyang Xu, Jinguang Gu, Maofu Liu, Guangyou Zhou, Haidong Fu, Chen Qiu*. A Question-Guided Multi-hop Reasoning Graph Network for Visual Question Answering. Information Processing and Management. 60(2):103207, (2023).

[2] Chen Qiu, Dan Oneată, Emanuele Bugliarello, Stella Frank, Desmond Elliott. Multilingual Multimodal Learning with Machine Translated Text. In Findings of the Association for Computational Linguistics: EMNLP 2022. pp: 4207-4222, (2022).

[3] Chen Qiu,Zhiqiang Xie, Maofu Liu, Huijun Hu. Explainable Knowledge reasoning via thought chains for knowledge-based visual question answering.Information Processing and Management. 60(2):103726, (2024).

关于ONTOWEB

武汉科技大学计算机科学与技术学院WEB与工业智能研究团队成立于2012年,主要从事WEB与工业领域相关研究,包括但不限于语义网与知识图谱、自然语言处理与多模态大模型、移动计算、社会计算等。近几年,在复杂流程工业、工业互联网、金融、医疗与健康、社会治理及技术公益领域做出有益探索与实践。

欢迎关注团队微信公众号 (ONTOWEB-WUST)!

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)