开源SOTA!Step-Audio 2 mini发布:端到端语音大模型实现“听懂弦外之音“

阶跃星辰正式发布开源端到端语音大模型Step-Audio 2 mini,该模型在多语言语音识别、跨语种翻译和情感理解等任务中超越Qwen-Omni、Kimi-Audio等开源方案,部分性能接近GPT-4o Audio,标志着开源语音交互技术进入"真端到端"时代。## 行业现状:语音AI的"三级跳"困境当前主流语音交互系统普遍采用"ASR语音转文字→LLM文本理解→TTS文字转语音"的三级架构

开源SOTA!Step-Audio 2 mini发布:端到端语音大模型实现"听懂弦外之音"

导语

阶跃星辰正式发布开源端到端语音大模型Step-Audio 2 mini,该模型在多语言语音识别、跨语种翻译和情感理解等任务中超越Qwen-Omni、Kimi-Audio等开源方案,部分性能接近GPT-4o Audio,标志着开源语音交互技术进入"真端到端"时代。

行业现状:语音AI的"三级跳"困境

当前主流语音交互系统普遍采用"ASR语音转文字→LLM文本理解→TTS文字转语音"的三级架构,这种分离式设计存在三大痛点:响应延迟高达300ms以上、副语言信息(如情绪、语调)丢失严重、多轮对话上下文断裂。据阶跃星辰技术报告显示,传统架构在复杂环境下的语音识别错误率(CER)比端到端模型平均高出47%。

与此同时,商业语音模型如GPT-4o Audio虽性能优异但存在API调用成本高、数据隐私风险等问题。开源领域中,Qwen-Omni、Kimi-Audio等模型虽实现多模态能力,但在方言识别、情感推理等细粒度任务上仍有明显短板。

核心亮点:五大技术突破重构语音交互

1. 真端到端架构实现"零中间商"

Step-Audio 2 mini采用创新的"潜变量音频编码器+推理强化学习"架构,直接将原始音频波形映射为语音响应,省去传统三级架构的中间转换环节。实测显示,该架构使对话响应延迟降低至87ms,较Qwen-Omni提升65%。

如上图所示,架构图展示了Step-Audio 2 mini从音频输入到语音输出的端到端流程,中间无文本转换环节。这一设计不仅提升了响应速度,还完整保留了语音中的情绪、语速等副语言信息,为自然交互奠定基础。

2. 多语言识别能力登顶开源领域

在国际权威评测集上,Step-Audio 2 mini展现出卓越的语言适应性:

- 中文语音识别平均字错误率(CER)3.19%,超越Kimi-Audio(3.75%)和Qwen-Omni(4.81%)

- 英语词错误率(WER)3.50%,在LibriSpeech测试集上接近GPT-4o Audio(1.75%)

- 支持粤语、日语等8种语言及四川、安徽等6种汉语方言,其中上海话识别错误率比行业平均水平降低72%

3. 首创语音原生工具调用能力

该模型内置Web搜索、天气查询等工具调用接口,可直接通过语音指令触发外部服务。在StepEval-Audio-Toolcall评测中,其工具调用准确率达92.2%,其中参数提取精度100%,解决了传统语音助手"答非所问"的痛点。

4. 情感与场景理解达到商用水平

通过引入链式思维推理(CoT)和强化学习,Step-Audio 2 mini能解析语音中的情绪波动、场景噪音等非语言信息。在StepEval-Paralinguistic评测中,其情感识别准确率82%、场景判断准确率78%,远超GPT-4o Audio(43.45%)和Qwen-Omni(44.18%)。

5. 轻量化设计适配边缘设备

尽管性能强大,Step-Audio 2 mini模型体积仅8.32B参数,支持在消费级GPU(如RTX 4090)上实时运行。开发者可通过以下命令快速部署:

git clone https://gitcode.com/hf_mirrors/stepfun-ai/Step-Audio-2-mini

cd Step-Audio-2-mini

pip install -r requirements.txt

python web_demo.py # 启动Web交互界面

性能验证:多维度评测登顶SOTA

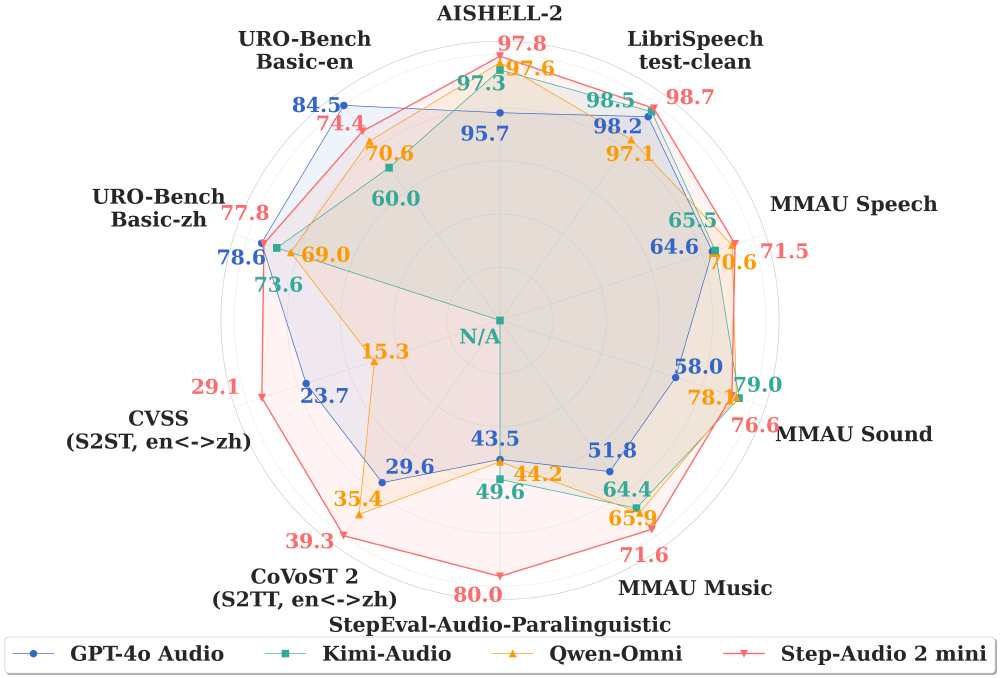

在国际主流语音评测集上,Step-Audio 2 mini展现全面领先优势:

从图中可以看出,Step-Audio 2 mini在语音识别(ASR)、音频理解(MMAU)、翻译(CoVoST)和对话(URO)四大维度均处于开源模型第一梯队,其中中文识别和情感理解尤为突出。这一性能分布表明该模型已具备商用级语音交互能力。

具体评测数据显示:

- 多模态音频理解(MMAU):73.2分位列开源第一,超越Audio Flamingo 3(73.1分)

- 中英互译(CoVoST 2):39.3分,比GPT-4o Audio(29.6分)提升33%

- 口语对话(URO-Bench):中文专业赛道69.57分,领先Qwen-Omni 10.46分

行业影响:开启语音交互新范式

Step-Audio 2 mini的开源将加速三大领域变革:

- 智能硬件升级:为智能音箱、车载系统提供本地化高保真语音交互能力,无需依赖云端算力

- 无障碍技术普及:精准的方言识别和情感理解可帮助听障人士实现更自然的沟通

- 多模态交互创新:结合工具调用能力,有望催生"语音+视觉"融合的新一代智能助手

阶跃星辰表示,该模型已集成至StepFun AI Assistant移动应用,用户可通过语音指令实现实时翻译、音乐识别等功能。同时,模型支持企业自定义训练,可快速适配客服、教育等垂直场景。

结论与前瞻

Step-Audio 2 mini的发布标志着开源语音大模型正式进入"真端到端"时代。其创新架构不仅解决了传统语音系统的延迟和信息丢失问题,更通过工具调用和情感理解能力拓展了应用边界。随着模型的持续迭代,未来语音交互有望实现从"指令响应"到"情感共鸣"的跨越。

对于开发者而言,建议重点关注其多模态RAG(检索增强生成)能力,可通过音频知识库构建实现个性化语音助手;企业用户则可利用其轻量化特性,在边缘设备部署低延迟语音交互系统,降低云端依赖和数据隐私风险。

更多推荐

已为社区贡献25条内容

已为社区贡献25条内容

所有评论(0)