【最全教程】本地部署DeepSeek+构建私有知识库+调用大模型API

本文详细介绍了DeepSeek大模型的本地部署方法及API调用指南。主要内容包括:1)通过LMStudio下载安装不同规格的DeepSeek模型(1.5B-70B),并说明各版本的硬件需求;2)配置本地模型和知识库的步骤;3)调用DeepSeek API的方法,包括申请API Key和使用Chatbox进行对话。文章还提供了隐私保护措施建议,如关闭软件联网等。适合需要在本地部署AI模型或使用API

本文写于2月,以实际为准

一、本地部署DeepSeek

1.下载安装LM Studio

LM Studio - Download and run LLMs on your computer

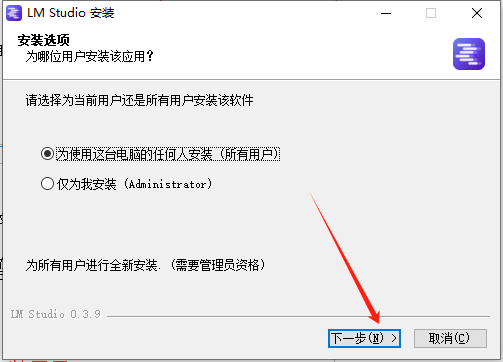

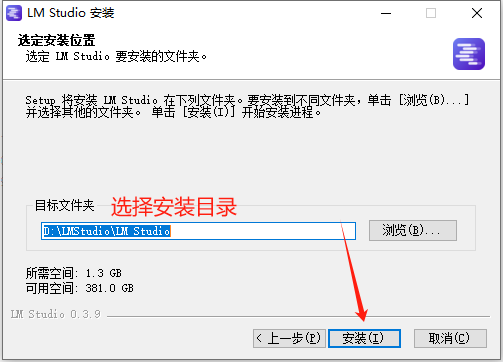

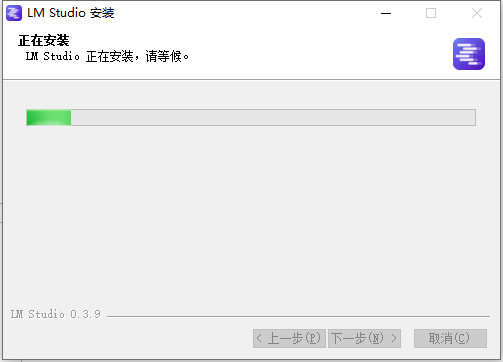

下载文件后双击exe文件,根据下图安装提示按步骤进行安装

2.下载大模型文件

|

参数模型硬件要求如下,请根据本机的配置选择合适的模型 ✅ DeepSeek-R1-1.5B

✅ DeepSeek-R1-7B

✅ DeepSeek-R1-8B

✅ DeepSeek-R1-14B

✅ DeepSeek-R1-32B

✅ DeepSeek-R1-70B

|

|

从百度网盘下载 链接: https://pan.baidu.com/s/1x_Hj2QiQcwENbuCx6ysL1w 提取码: gdku |

|

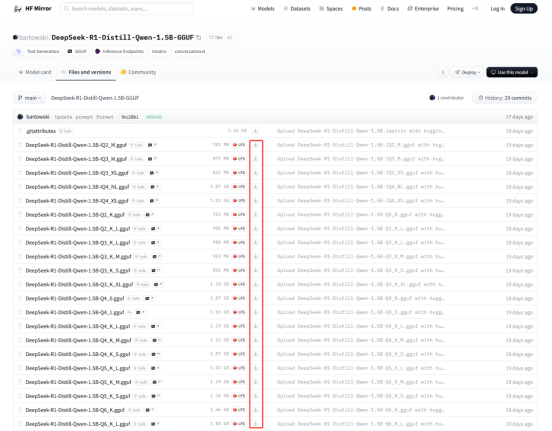

网页在线下载(也可以在该网站下载其他本地模型,下载文件的格式为gguf) 1.5B:https://hf-mirror.com/bartowski/DeepSeek-R1-Distill-Qwen-1.5B-GGUF/tree/main 7B:https://hf-mirror.com/unsloth/DeepSeek-R1-Distill-Qwen-7B-GGUF/tree/main 14B:https://hf-mirror.com/bartowski/DeepSeek-R1-Distill-Qwen-14B-GGUF/tree/main 32B:https://hf-mirror.com/bartowski/DeepSeek-R1-Distill-Qwen-32B-GGUF/tree/main 70B:https://hf-mirror.com/unsloth/DeepSeek-R1-Distill-Llama-70B-GGUF/tree/main 注:图中Q2、Q3、Q4等通常是指模型的量化级别,数字越大精度越高,一般选择Q4 |

3.配置本地模型

|

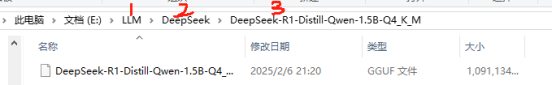

在磁盘下创建三级文件夹(如图所示,LLM→DeepSeek→1.5B),将gguf模型文件放置于第三层文件夹中注:这步很重要,如果没有按照要求设置,会导致读取不到本地模型 |

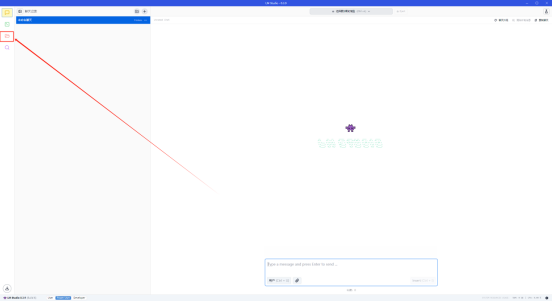

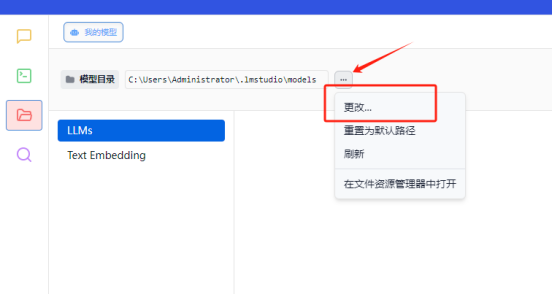

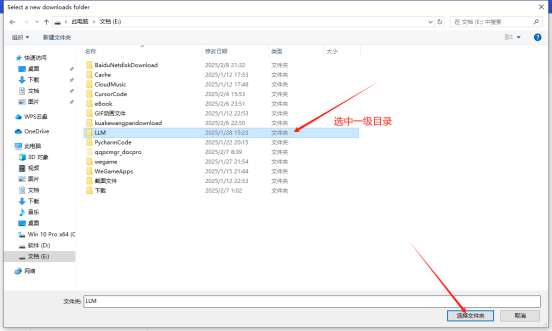

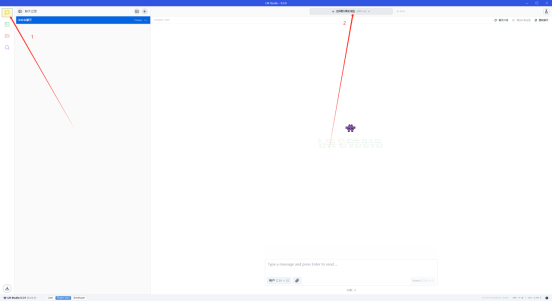

- 打开LM Studio,进入文件页面,更改模型目录

|

选择刚刚创建的三级文件夹中的第一级,即可看到本地模型,若仍没显示,可点击刷新按钮 |

4.加载本地模型

- 进入聊天页面,点击顶部加载模型会自动显示本地模型,选中一个模型

|

选择模型后需要配置模型的参数,前三个参数可根据自己的硬件调整,后面的参数按照默认设置即可,设置完成后点击“加载模型”按钮

|

- 加载成功后即可开始对话

5.关闭软件联网保护隐私

|

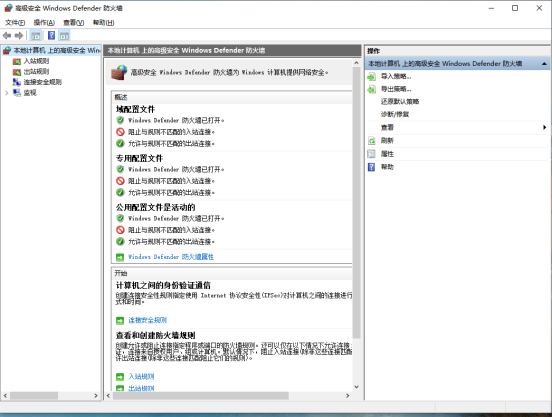

本步骤非必须,如果想更好的保护隐私不被泄露,可遵循下述步骤将软件断网 |

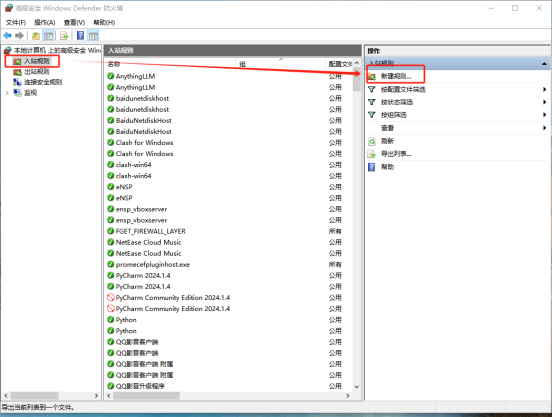

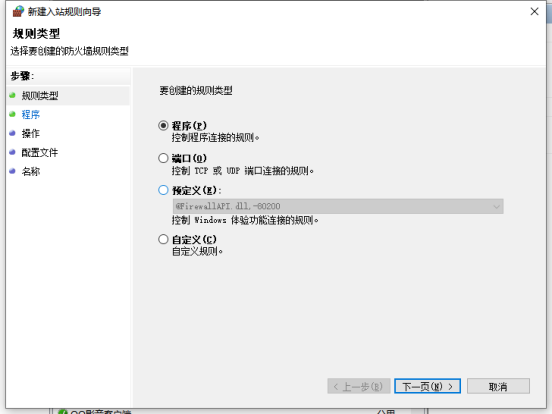

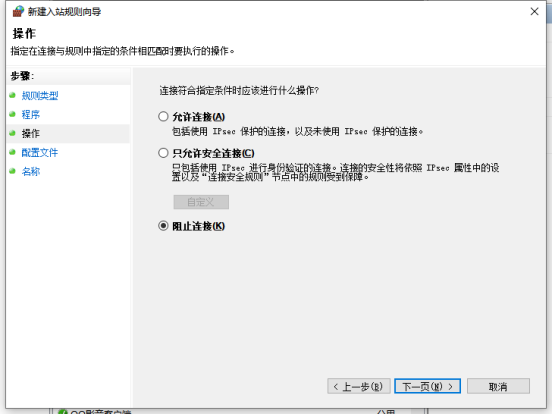

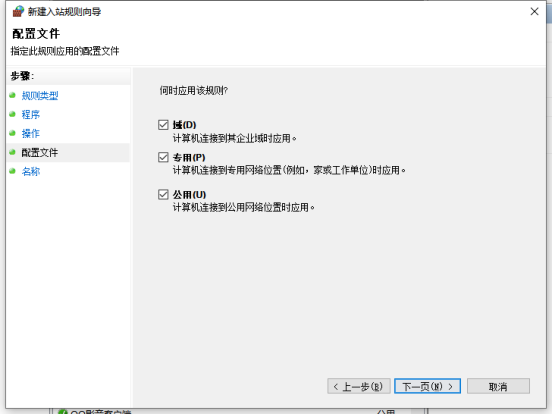

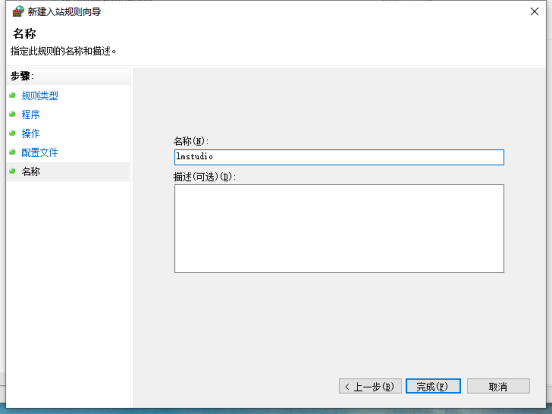

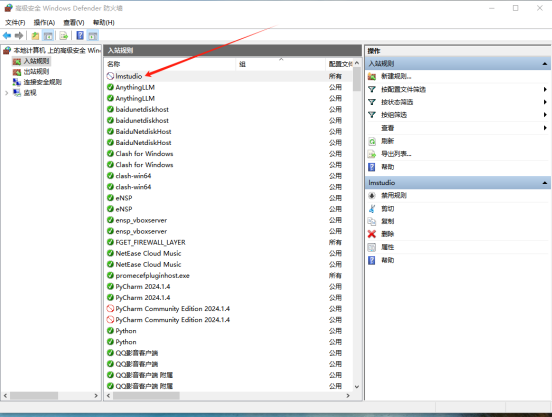

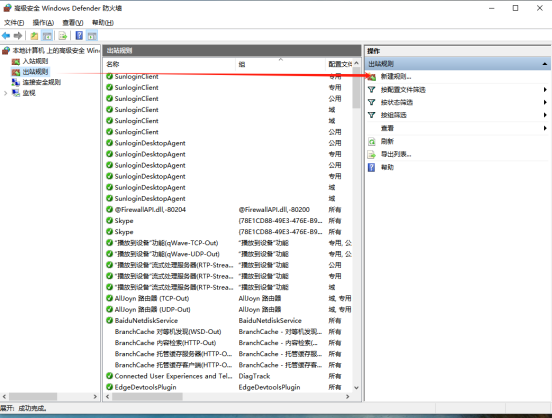

- 进入高级安全Windowsdefender防护墙

- 选择入站规则-新建规则

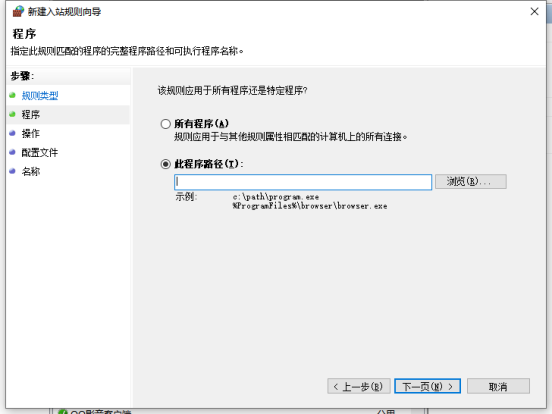

- 选择程序-下一步-选择路径

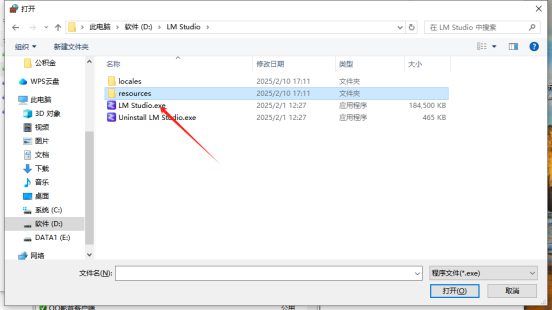

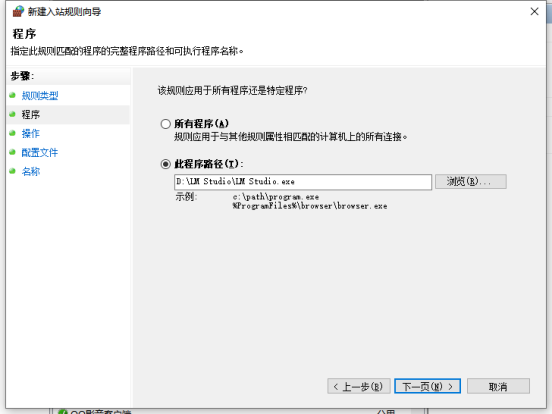

- 选择安装lmstudio的路径中名字叫LM Studio.exe文件

- 阻止连接

- 输入这条规则的名称,点击完成即可

- 再次新建禁止联网规则,分别添加另外两个文件

|

LM Studio所在目录\resources\elevate.exe C:\Users\Administrator\.lmstudio\bin\lms.exe |

- 在出站规则中也将以上三个文件设置禁止联网,步骤同上

二、构建私有知识库

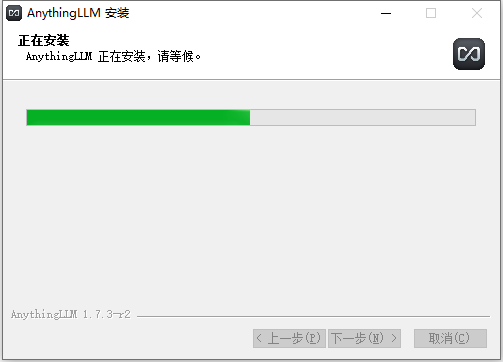

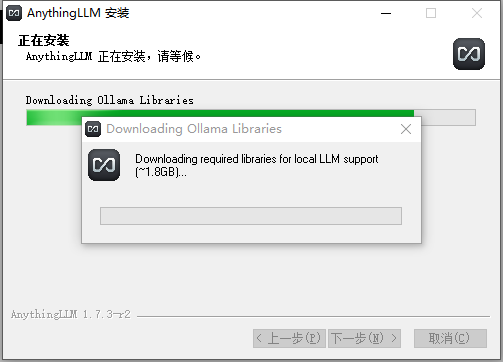

1.下载安装AnyThingLLM

AnythingLLM | The all-in-one AI application for everyone

- 按步骤安装

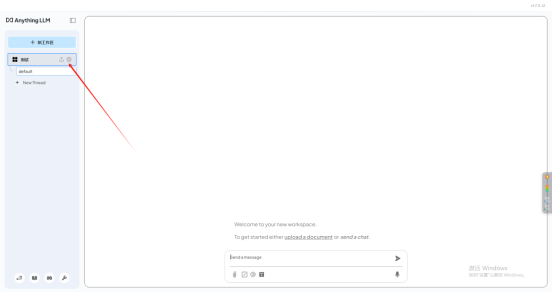

- 安装成功后打开软件,跳过前面的引导页,都按默认选择

- 创建一个工作区

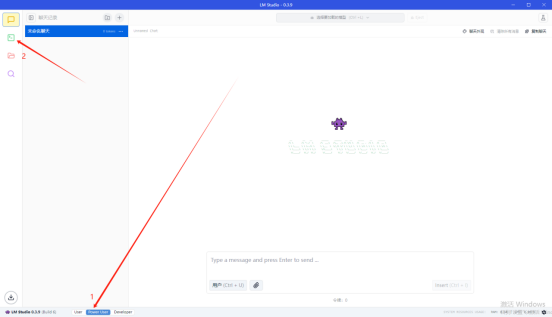

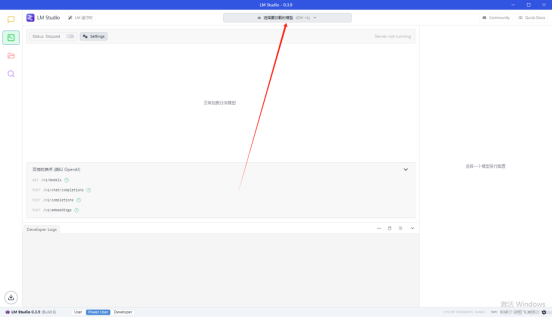

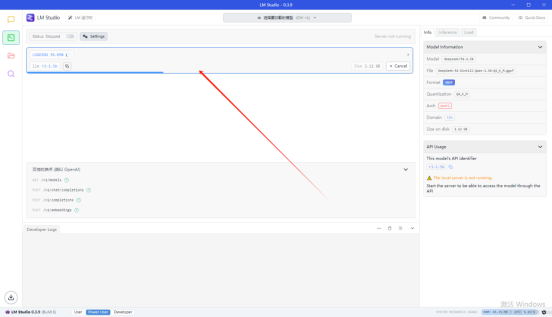

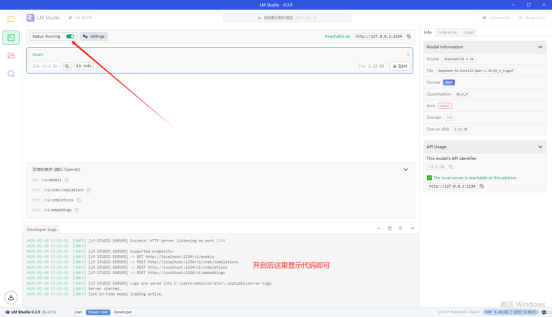

2.切换到LM Studio,打开本地服务

- 进入开发者页面

- 选择要加载的模型(见第一部分第4节)

- 开启本地服务

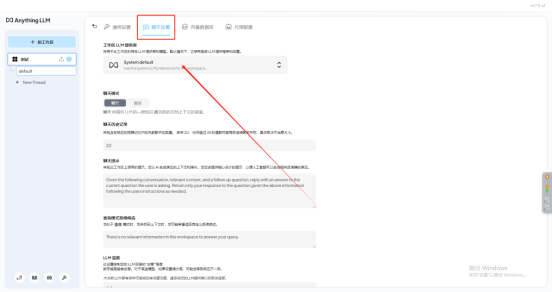

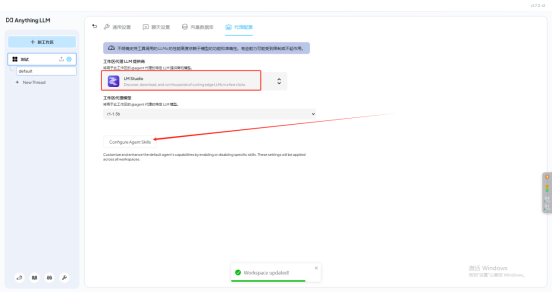

3.配置anythingllm

- 回到anythingllm软件,点击设置按钮

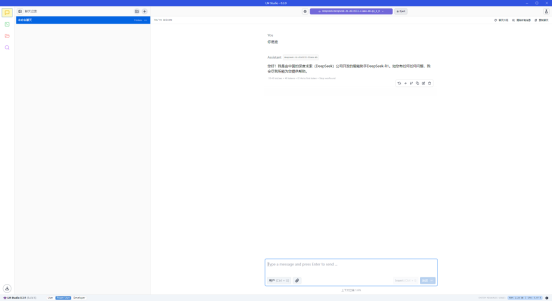

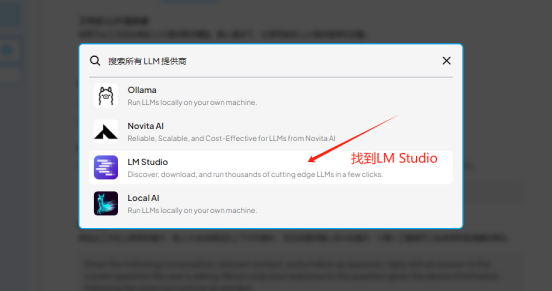

- 进入聊天设置,切换LLM供应商

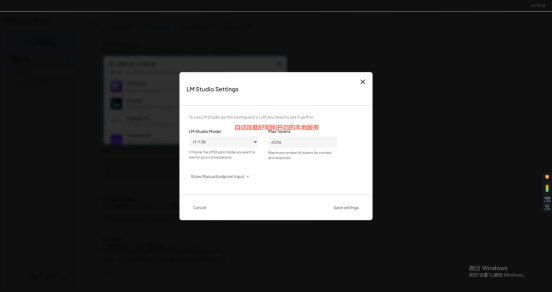

- 找到LMstudio

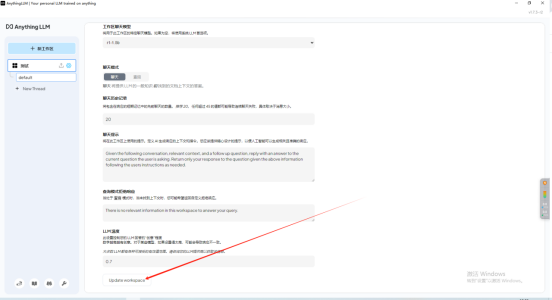

- 要记得点击update进行保存

- 在代理配置中也选上LM Studio(注意要点击configure进行保存)

- 返回对话页,这样就建立了与LMstudio的本地连接

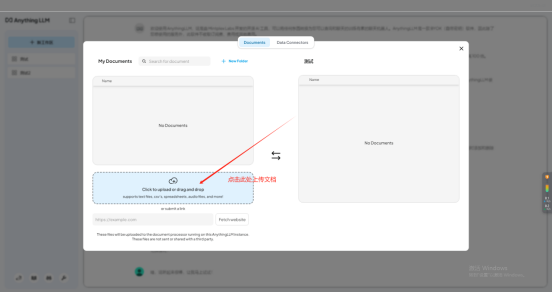

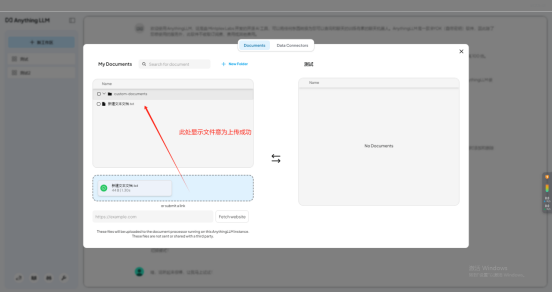

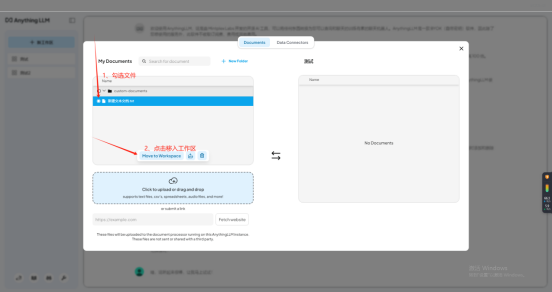

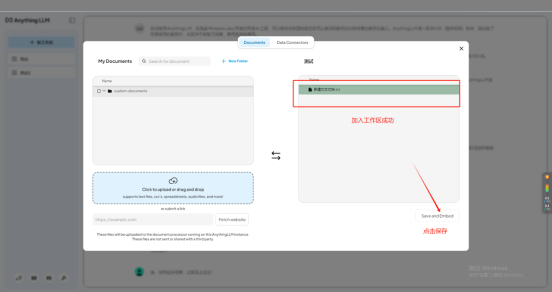

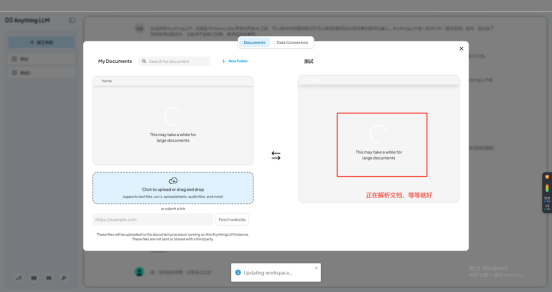

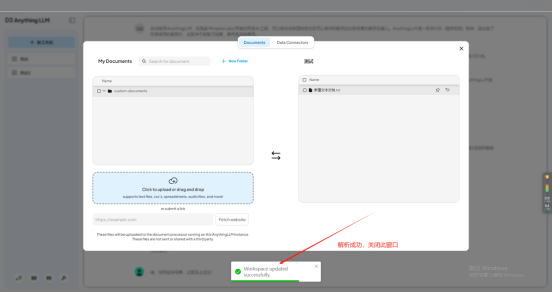

4.构建本地知识库

|

本地知识库:使用lmstudio上的本地模型创建的知识库 若不放心安全问题,在配置完成后,可参照一.5关闭anythingLLM联网 |

- 点击上传按钮

- 上传本地文件

- 将上传的文件移入工作区

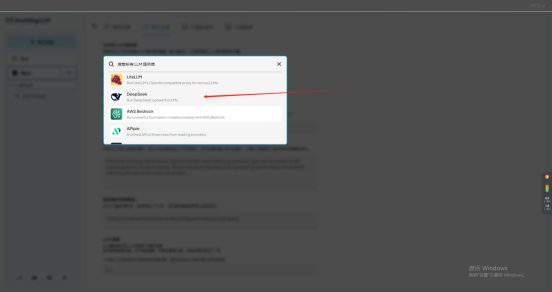

5.构建在线知识库

|

在线知识库:通过API调用在线大模型,再创建知识库 |

- 新建工作区,进入设置,选择其他LLM提供商,以deep seek为例

- 输入APIkey(如何获取APIkey可参考第三部分第一节)

- 设置apikey成功后,再根据构建本地知识库的步骤上传文件即可

三、调用大模型API(以DeepSeek为例)

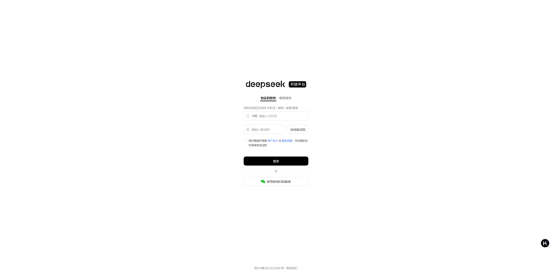

1.申请DeepSeekAPI

- 进入https://www.deepseek.com/,点击右上角“API开放平台”,开始注册登录

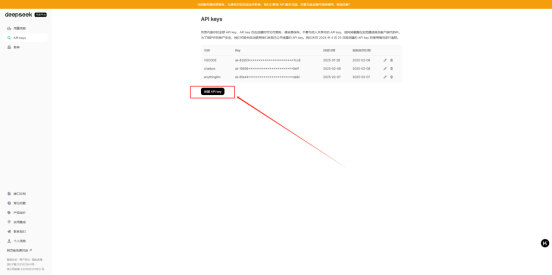

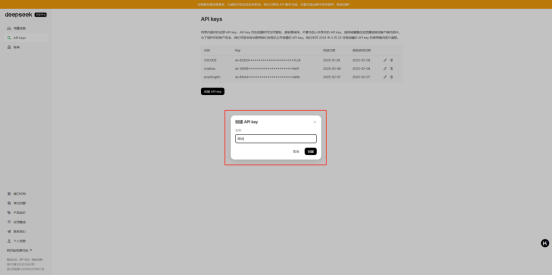

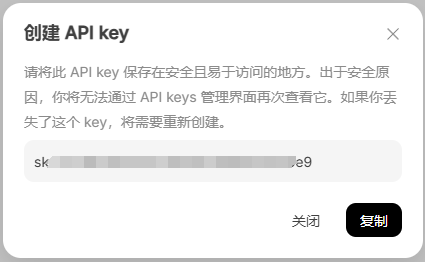

- 进入左侧“API keys”页面,点击“创建API key”,输入名称

|

创建后会自动生成key(它是一种用于身份验证的密钥,允许用户通过API访问特定的服务或数据。它就像一把钥匙,确保只有授权的用户才能使用服务,同时帮助控制访问频率和权限),请将这个key保存好,因为关闭后无法再次查看 |

2.聊天

2.1.安装Chatbox

Chatbox AI官网:办公学习的AI好助手,全平台AI客户端,官方免费下载

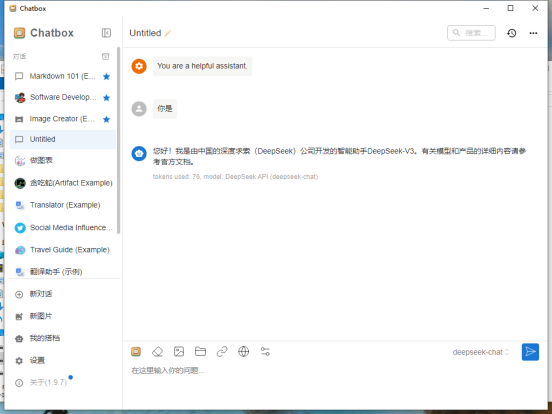

|

也可以用刚刚下载的AnythingLLM实现,但个人认为单纯用作聊天的话,Chatbox的体验更佳! |

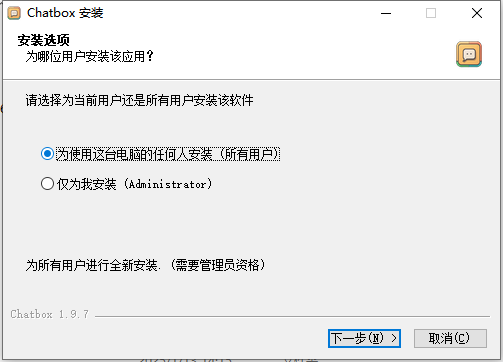

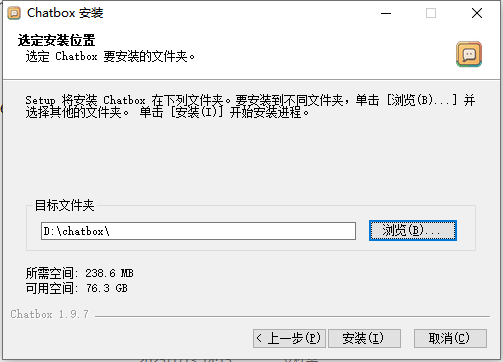

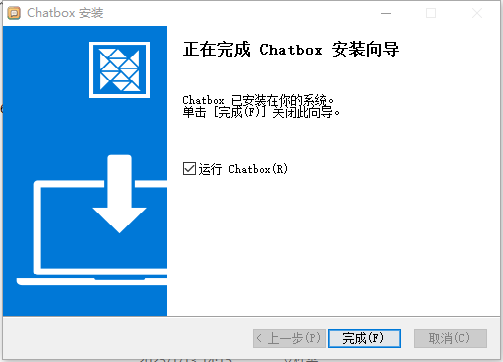

- 根据提示步骤安装chatbox

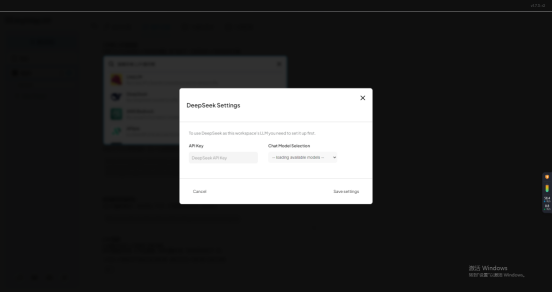

2.2.设置API

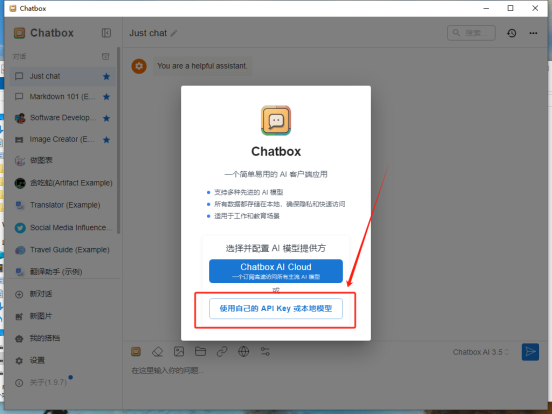

- 打开软件后,选择“使用自己的API Key”或本地模型

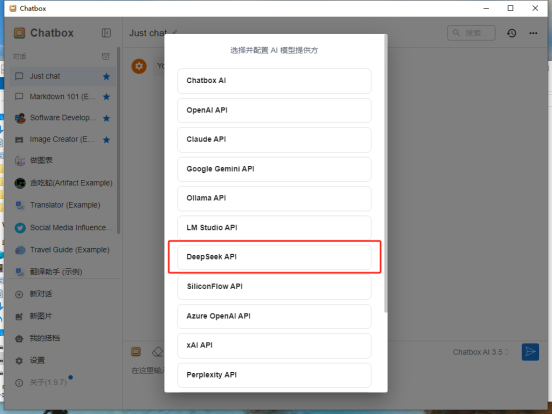

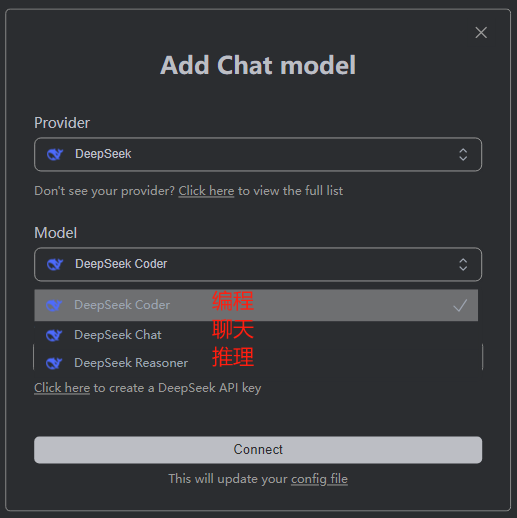

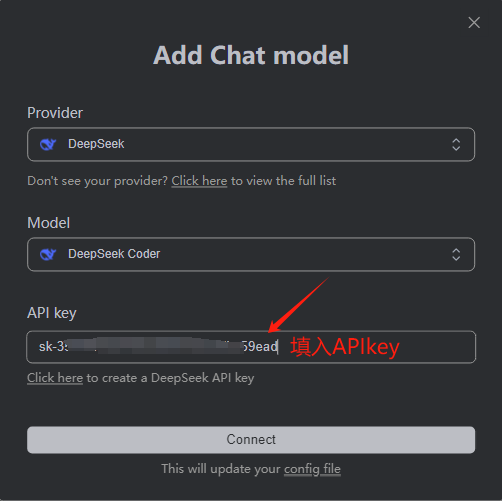

- 在选择AI模型提供方界面找到deep seekAPI

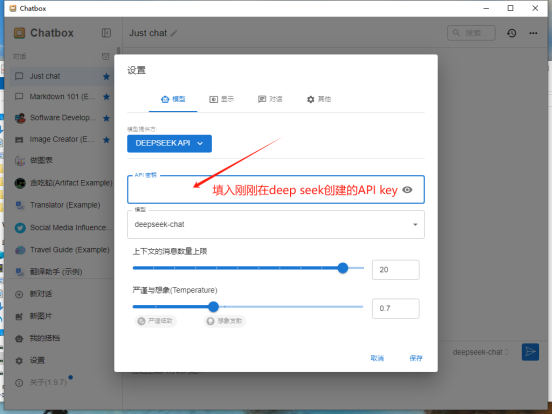

- 填入刚刚在deep seek创建的APIkey

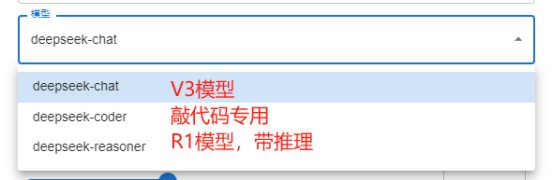

- 然后选择模型,默认的是普通的chat聊天模型,想要带推理的选择reasoner(但是这个模型最近太火爆了,经常无响应)

- 然后就可以在聊天界面对话了

3.编程

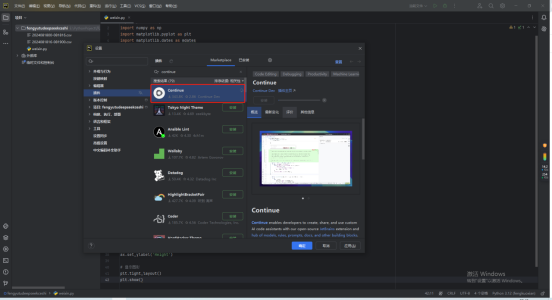

3.1.下载continue插件

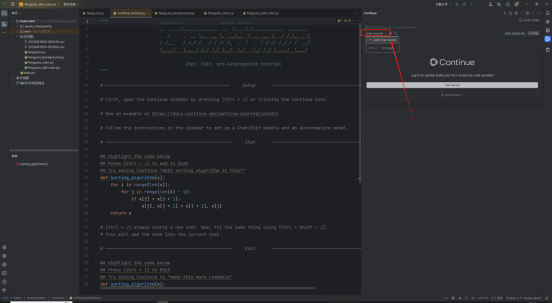

3.2.设置API

点击connect后还会出现一个小的输入框,再次输入APIkey即可。

全文完!

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)