科大讯飞Android语音识别解决方案详解

随着人工智能的快速发展,语音识别技术已经成为了智能设备和应用中不可或缺的一部分。它将人类的声音转化为机器可读的文本数据,使设备能够理解和执行语音指令。Android平台上的语音识别功能,为开发者提供了方便的接口,以实现各种语音交互式应用。科大讯飞的语音识别软件开发工具包(SDK)为开发者提供了一系列工具和接口,以便于快速集成高质量的语音识别功能。其核心优势体现在以下几个方面:准确性:集成了先进的深

简介:Android平台上的语音识别功能通过科大讯飞SDK实现,提供高度准确和稳定的语音到文本转换,支持语音唤醒、实时识别和离线识别,并特别强化了金额数字过滤。该技术允许开发者快速集成专业级的语音识别能力到各种应用场景,如金融、车载导航和智能家居,从而提升用户体验和交互便捷性。

1. Android语音识别概述

1.1 语音识别技术简介

随着人工智能的快速发展,语音识别技术已经成为了智能设备和应用中不可或缺的一部分。它将人类的声音转化为机器可读的文本数据,使设备能够理解和执行语音指令。Android平台上的语音识别功能,为开发者提供了方便的接口,以实现各种语音交互式应用。

1.2 语音识别在Android中的发展历程

Android系统自诞生起,就不断集成和优化语音识别功能。从早期的简单语音命令识别,到如今的上下文相关理解,Android语音识别技术已经实现了质的飞跃。开发者通过利用Google提供的API,即可轻松地在Android应用中集成语音识别功能。

1.3 Android语音识别的市场应用场景

语音识别技术在Android平台上的应用非常广泛,从简单的语音输入法,到智能家居控制、语音助手、车载系统等,都展示了语音识别技术的强大力量。这些应用不仅提高了用户的操作便捷性,也为开发者提供了丰富的交互方式,促进了产品的创新和智能化升级。

2. 科大讯飞SDK特点及核心技术

2.1 科大讯飞SDK的基本介绍

2.1.1 SDK的功能和优势

科大讯飞的语音识别软件开发工具包(SDK)为开发者提供了一系列工具和接口,以便于快速集成高质量的语音识别功能。其核心优势体现在以下几个方面:

- 准确性 :集成了先进的深度学习算法,能够提供高准确度的语音识别服务。

- 易用性 :具备简洁的API接口,可轻松嵌入到移动应用、桌面软件以及Web服务中。

- 稳定性 :经过大规模商用验证,能够确保服务的稳定可靠。

- 支持语言 :支持多种语言和方言,适应不同地区用户的需求。

- 定制化服务 :提供企业定制化解决方案,能够满足特定业务场景的需求。

2.1.2 SDK的架构和组成

科大讯飞SDK的架构设计使其具备高效处理和快速响应的特点。其主要组成包括:

- 音频处理模块 :负责采集和处理原始语音数据。

- 识别引擎 :核心的语音到文本转换部分,包括声学模型和语言模型。

- 自然语言理解(NLU)模块 :对识别出的文本进行语义解析。

- API接口 :开发者用来集成SDK并调用各种功能的接口。

- 云服务接入 :提供云资源,如高性能的计算能力和存储空间。

2.2 语音唤醒技术的实现原理

2.2.1 唤醒词的设计和优化

语音唤醒技术是一种让设备能够通过特定的语音命令激活的方式。唤醒词的设计和优化包括以下几个步骤:

- 唤醒词选择 :基于目标用户群体的语言习惯选择合适的唤醒词。

- 语音处理 :对唤醒词的发音进行优化,使其容易被识别。

- 算法调整 :持续调整识别算法,提高唤醒的准确率和速度。

2.2.2 唤醒机制的工作流程

语音唤醒机制的工作流程通常包括以下几个步骤:

- 持续监听 :设备始终处于监听状态,等待唤醒词。

- 语音检测 :检测到唤醒词后,设备会进入下一阶段处理。

- 唤醒词确认 :通过更高级别的算法确认是否为有效的唤醒词。

- 执行操作 :确认唤醒后执行预设的操作,如开启应用、启动语音识别等。

2.3 语音转文本过程的深入解析

2.3.1 语音信号的预处理

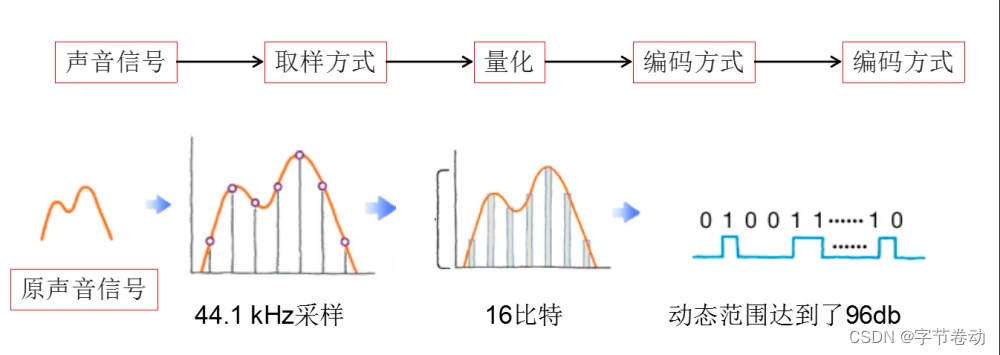

在语音信号转换为文本之前,需要进行一系列的预处理步骤,以提高识别的准确性:

- 噪声抑制 :从语音信号中滤除背景噪声。

- 回声消除 :去除录音中的回声效应。

- 端点检测 :识别语音信号的开始和结束点,以便于处理有效语音。

- 特征提取 :提取出有助于识别的声学特征,如MFCC(梅尔频率倒谱系数)。

2.3.2 识别引擎的关键技术

识别引擎是整个语音识别过程的核心,关键技术包括:

- 声学模型 :通过大量语音数据训练得到,用于识别声学特征对应的语音单元。

- 语言模型 :描述单词序列的概率分布,帮助判断哪种单词序列更为合理。

- 解码器 :利用声学模型和语言模型将语音特征转化为文本。

下面的代码块展示了声学模型的训练过程:

# 伪代码:声学模型训练示例

from speechkit import AcousticModel

# 创建声学模型对象

acoustic_model = AcousticModel.train(

training_data='path_to_training_data',

model_name='my_acoustic_model',

language='zh-CN',

acoustic_algorithm='DeepSpeech2' # 使用深度学习算法DeepSpeech2

)

# 训练声学模型

acoustic_model.train()

在这个例子中,训练数据用于训练声学模型,以便其能够识别语音。训练过程中,模型会逐步调整其参数,以最小化声学特征和对应的文本之间的差异。训练完成后,声学模型可以应用于实际的语音识别任务。

3. 实时语音识别与离线识别应用

3.1 实时语音识别的技术要点

实时语音识别技术是使设备能够实时处理并转译语音信号的关键技术,广泛应用于智能助手、车载系统、会议记录等领域。本小节将探讨实时语音识别在技术层面的核心要点,并结合实际应用进行分析。

3.1.1 网络通信的影响与优化

实时语音识别需要稳定的网络连接来传输语音数据到云端服务器进行处理。网络带宽、延迟和稳定性直接影响识别的实时性和准确性。因此,优化网络通信是提高实时语音识别质量的关键步骤。

- 自动回声消除(AEC) : 为减少网络回声对语音识别的干扰,可以利用AEC技术进行处理。

- 智能降噪处理 : 采用噪声抑制技术,改善信号在较差网络条件下的传输质量。

- 负载均衡 : 动态选择最优服务器,确保数据快速准确传输。

import socket

# 一个简单的网络通信优化示例 - 使用TCP进行稳定的数据传输

def send_data(ip, port, data):

with socket.socket(socket.AF_INET, socket.SOCK_STREAM) as s:

s.connect((ip, port)) # 建立到服务器的连接

s.sendall(data.encode()) # 发送数据

def receive_data(ip, port):

with socket.socket(socket.AF_INET, socket.SOCK_STREAM) as s:

s.bind((ip, port)) # 绑定监听地址和端口

s.listen()

conn, addr = s.accept()

with conn:

print('Connected by', addr)

while True:

data = conn.recv(1024)

if not data:

break

print('Received', repr(data))

# 调用函数发送和接收数据

send_data("192.168.1.1", 12345, "实时语音数据")

receive_data("192.168.1.1", 12345)

在上述代码中,我们演示了如何通过TCP协议创建稳定的数据传输过程。发送和接收函数分别处理数据的发送和接收逻辑。尽管这是一个简化的例子,它演示了实时语音数据传输的基本原理。

3.1.2 实时识别的场景应用分析

实时语音识别广泛应用于多种场景,其应用对技术的适应性提出不同要求。以下是两个具体的实时语音识别应用分析:

- 智能客服系统 : 在智能客服场景中,实时语音识别用于理解用户的咨询,并快速给出响应。系统的挑战在于准确理解多变的用户语言,并给出合适的解决方案。

- 实时翻译 : 在实时翻译的应用中,语音识别需要迅速准确地转译不同语言的语音,再通过机器翻译技术输出翻译结果。

3.2 离线语音识别技术的能力探究

相对于依赖云端服务器的实时语音识别,离线语音识别在没有网络连接的环境下依然能够运行,具有独特的优势。

3.2.1 离线识别的优势和局限

离线语音识别依赖预先下载的模型在本地设备上进行处理,其最大的优势在于不受网络条件限制,能够快速响应用户需求。然而,离线模型由于存储空间和计算能力的限制,往往在准确性上不如云端识别。

- 优势 : 快速响应时间,不受网络环境限制。

- 局限 : 识别模型更新速度慢,且资源消耗大。

3.2.2 离线模型的定制和训练

为实现高效准确的离线识别,需要对模型进行定制化设计,并在本地进行训练。这要求优化算法以减少模型体积和提高计算效率。

- 模型压缩 : 使用量化、剪枝等技术减小模型大小。

- 资源优化 : 确保模型在有限的计算资源下保持高效率。

3.3 多语言支持功能的实现与挑战

多语言支持是实时和离线语音识别系统的一个重要功能,它使系统能够处理多种语言的输入并给出正确的转写。

3.3.1 多语言模型的构建

构建多语言模型需要解决不同语言间的声学和语言学差异问题。多语言模型通常采用多种语言的数据进行训练,以提高模型的泛化能力。

graph TD

A[开始构建多语言模型] --> B[收集多语言数据]

B --> C[进行数据预处理]

C --> D[设计多语言声学模型]

D --> E[训练并优化模型]

E --> F[评估模型效果]

3.3.2 跨语言识别的难点与对策

跨语言识别中最难解决的问题之一是不同语言的词汇和语法结构差异。对策包括但不限于:

- 语言识别 : 首先识别输入语音属于哪种语言,以便采用相应的语言模型。

- 上下文建模 : 利用深度学习模型来理解句子结构和上下文,提高跨语言识别准确度。

跨语言识别是语音识别领域中的一个复杂挑战,其发展需要大量多语言数据、先进的算法和不断优化的模型。

本章的三个小节从实时语音识别的技术要点开始,逐步深入探讨了实时识别和离线识别的技术优势与局限性,以及多语言支持功能的实现与挑战。通过实际案例和理论分析相结合,为IT专业人士提供了一个全面的技术视野。

4. 语音识别的高级功能与实践应用

4.1 语义理解及应用的深度剖析

语义理解在语音识别中扮演着至关重要的角色。它不仅仅关注于用户说的是什么,更加关注于用户的意图是什么。语义理解框架的构建和深度语义理解的案例研究是实现这一目标的关键步骤。

4.1.1 语义理解框架的构建

语义理解框架通常包括几个关键组成部分:意图识别、实体抽取、对话管理和自然语言生成。意图识别是为了确定用户的语言意图,而实体抽取则是从用户的语言中提取关键信息,例如时间、地点、人物等。对话管理确保用户与系统的交流可以持续进行,自然语言生成则是将系统想要表达的信息转换为自然语言。

构建这样的框架需要对自然语言处理有深刻的理解。深度学习技术在这里发挥着关键作用,例如,使用循环神经网络(RNN)或者更先进的变体如长短时记忆网络(LSTM)和门控循环单元(GRU)来处理序列数据,捕捉语言中的时间依赖性。Transformer架构的引入更是为自然语言理解领域带来了变革,其自注意力机制(Self-Attention)为模型理解句子中各部分之间的关系提供了新的可能。

import torch

from transformers import BertModel, BertTokenizer

# 加载预训练好的BERT模型和分词器

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

model = BertModel.from_pretrained('bert-base-uncased')

# 准备输入文本

text = "Replace me by any text you'd like."

encoded_input = tokenizer(text, return_tensors='pt')

# 获取BERT模型的输出

with torch.no_grad():

output = model(**encoded_input)

在上述代码中,我们使用了 transformers 库来加载并使用BERT模型,这是构建语义理解框架的基础步骤。BERT模型通过其双向编码器表示,为意图识别和实体抽取提供了强大的支持。

4.1.2 深度语义理解的案例研究

深度语义理解在多个领域有着广泛的应用,其中问答系统是一个典型的例子。例如,在法律咨询中,系统需要理解用户提出的问题,并从法律法规的文本库中检索答案。这要求系统不仅要有强大的语言理解能力,还需具备复杂的逻辑推理能力。

另一个案例是电商领域的智能客服。它能够处理用户的咨询,如:“我购买的手机什么时候发货?”系统需要能够识别出用户的意图是询问发货时间,并且能够从订单信息中抽取相应的数据回答用户。

4.2 金额数字过滤技术的原理与应用

在处理涉及金融的语音数据时,金额数字过滤技术显得尤为重要。这不仅关系到数据的安全性,也是用户隐私保护的重要手段。

4.2.1 过滤技术的必要性与实现原理

过滤技术的必要性在于保护敏感信息不被泄露。在语音识别过程中,数字和金额往往是敏感信息。为了防止这些信息被未经授权的第三方获取,我们需要在语音识别过程中实施过滤技术。

实现过滤技术通常有两种方法:一种是在语音识别后进行文本过滤,通过匹配和替换的方式识别出金额数字并进行过滤;另一种是在声学模型中进行处理,通过自定义声学单元来直接在识别阶段避免产生敏感信息。

graph LR

A[开始语音识别] --> B[检测敏感信息]

B --> |有敏感信息| C[实施过滤]

B --> |无敏感信息| D[继续识别]

C --> E[输出过滤后的文本]

D --> E[输出识别后的文本]

在上述流程图中,我们可以看到数字过滤技术在语音识别流程中的位置和作用。这种技术能够确保即使在复杂的对话环境中,敏感信息也不会被泄露。

4.2.2 过滤技术在金融领域的应用实例

在金融领域,金额数字过滤技术的应用实例数不胜数。例如,当用户通过语音服务进行转账操作时,系统能够自动检测到转账金额,并将其屏蔽,防止信息泄露。这类技术通常在银行和支付平台中得到广泛应用。

在实现这类技术时,金融公司需要考虑多种场景和用户行为模式,构建一套复杂的规则库来指导过滤操作。此外,为了提高准确性,深度学习技术也在这一领域得到了应用。通过训练深度神经网络,系统能够更好地理解用户的意图,并准确过滤掉敏感信息。

过滤技术不仅保护了用户的财务信息,还增强了用户对金融平台的信任。随着技术的不断进步,未来的金额数字过滤技术将更加智能、高效,为金融行业的安全与隐私保护做出更大的贡献。

5. 科大讯飞技术应用实例与展望

随着人工智能技术的飞速发展,科大讯飞作为行业的领军企业,其技术应用案例已经渗透到我们生活的方方面面。本章将着重分析科大讯飞技术的实际应用案例,并展望语音识别技术的未来趋势和挑战。

5.1 科大讯飞技术应用的实例分析

5.1.1 智能助手的应用案例

智能助手已经成为智能手机和智能家居不可或缺的一部分。科大讯飞提供的智能助手通过其高准确率的语音识别技术,使得人机交互更加自然流畅。以科大讯飞AI智能助手为例,其应用了以下技术要点:

- 个性化语音识别 :为用户提供个性化的语音模型,提升识别准确度。

- 上下文理解 :通过深度学习技术,智能助手能够理解用户的连续指令,进行上下文记忆。

- 多轮对话能力 :支持复杂对话逻辑,可以进行多轮对话交互,不丢失上下文信息。

代码块示例 :

// 示例代码:初始化科大讯飞智能语音服务

XfyunService xfyunService = new XfyunService.Builder()

.setAppId("你的应用ID")

.setAppKey("你的应用KEY")

.setSecretKey("你的应用Secret")

.setEngineType(EngineType.IAT)

.setListener(new RecognitionListener() {

@Override

public void onResult(IAudio認識Result result) {

// 处理识别结果

String text = result.getResultString();

Log.i(TAG, "识别结果:" + text);

}

// 其他回调方法的实现...

})

.build();

5.1.2 语音识别在车载系统中的应用

在车载系统中,语音识别技术让驾驶员可以解放双手,专注于驾驶。科大讯飞在车载语音识别技术的应用主要体现在:

- 噪音抑制技术 :利用先进的降噪算法,减少车辆行驶中的背景噪音干扰。

- 远场识别 :通过声源定位和波束成形技术,实现在车内远距离有效识别。

- 免唤醒词功能 :使得用户在特定的场景下无需唤醒词即可直接发出指令。

表格示例 :

| 功能项 | 技术要求 | 应用场景示例 |

|---|---|---|

| 噪音抑制技术 | 高级降噪算法 | 高速行驶中的车内对话 |

| 远场识别 | 声源定位和波束成形技术 | 在车内任何位置说出语音指令 |

| 免唤醒词功能 | 语义理解和场景识别算法 | 不使用唤醒词,直接说出导航、播放音乐等指令 |

5.2 语音识别技术的未来趋势与挑战

5.2.1 技术进步对行业的推动作用

随着深度学习和大数据技术的不断突破,语音识别技术的准确度和效率正不断提升。未来的趋势包括:

- 跨模态交互 :语音、图像、文本等多种交互方式融合,提供更丰富的用户体验。

- 个性化服务 :通过分析用户数据,提供更加定制化的语音交互体验。

- 边缘计算 :利用设备端的计算能力,减少对服务器的依赖,提高响应速度。

5.2.2 面临的挑战与发展方向

尽管技术进步显著,但语音识别仍然面临着以下挑战:

- 多语言、方言识别 :处理不同地区用户的语言多样性。

- 实时性要求 :尤其是在需要即时反馈的场合,如紧急救援指挥系统。

- 隐私保护 :随着语音数据的大量使用,如何保证用户隐私不被侵犯成为必须解决的问题。

mermaid流程图示例 :

graph LR

A[语音识别技术应用] -->|技术进步| B[跨模态交互]

A -->|个性化服务| C[设备端处理]

A -->|边缘计算| D[实时性提升]

B --> E[多语言、方言识别]

C --> E

D --> E

E -->|挑战| F[隐私保护]

技术进步带来的是语音识别技术应用的多样化和便利化,同时也对安全性、准确性和可用性提出了更高要求。因此,未来的研发方向需要同时考虑到技术发展的前沿性以及实际应用场景的复杂性。

简介:Android平台上的语音识别功能通过科大讯飞SDK实现,提供高度准确和稳定的语音到文本转换,支持语音唤醒、实时识别和离线识别,并特别强化了金额数字过滤。该技术允许开发者快速集成专业级的语音识别能力到各种应用场景,如金融、车载导航和智能家居,从而提升用户体验和交互便捷性。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)