【ICLR26匿名投稿】GeoVLM-R1:让大模型真正“看懂地球”的地理视觉语言模型

随着 CLIP、GPT-4V 等多模态大模型的崛起,AI 已能“看图说话”。GeoVLM-R1 在多个遥感与地理数据集上评估,包括 RSICD、BigEarthNet、GeoWiki-QA、SEN12MS。让多模态大模型第一次“理解地球”, 通过强化学习融合视觉、语言与地理空间,实现真正的全球级地理智能。将影像划分为网格(GeoTiles),为每个块生成空间特征(海拔、高度、经纬度等);—— 模型

文章:GeoVLM-R1: Reinforcement Fine-Tuning for Improved Remote Sensing Reasoning

代码:暂无

作者:匿名

一、问题背景:通用视觉语言模型难以理解地理世界

随着 CLIP、GPT-4V 等多模态大模型的崛起,AI 已能“看图说话”。 然而,当这些模型面对卫星图像或遥感场景时,却常常“看不懂”。

主要问题在于:

-

🌍 地理知识缺失 —— 模型未见过遥感影像,对地物类型(农田、港口、沙漠等)理解模糊;

-

📷 视角差异极大 —— 遥感图像为俯视视角,纹理与颜色分布与自然图像完全不同;

-

🧩 语义对齐困难 —— 语言描述与地理影像之间的语义空间差距巨大;

-

⚙️ 缺乏反馈机制 —— 现有模型无法通过地理任务结果来“学习错误”。

👉 因此,需要一种能融合地理知识、空间结构与语言理解的新型视觉语言模型, 让 AI 真正具备“空间认知能力”。

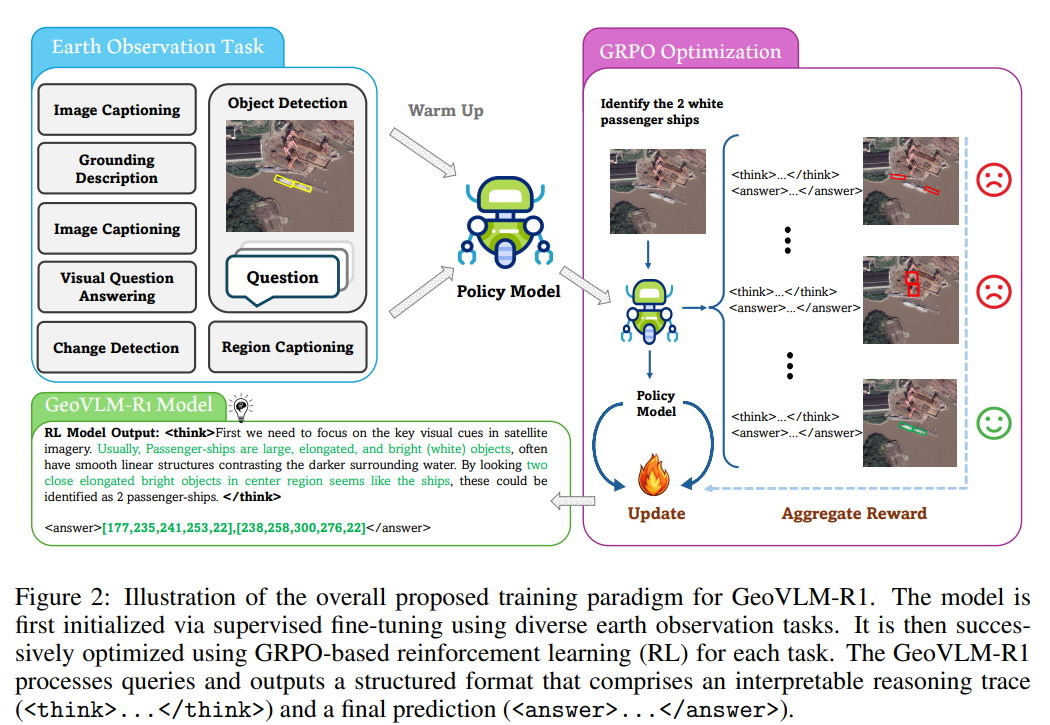

二、方法创新:基于强化学习的地理视觉语言模型

论文提出 GeoVLM-R1,首个基于强化学习优化的 地理视觉语言模型(Geographic Vision-Language Model)。 其核心目标是:让模型在多模态地理任务中通过反馈学习更好的对齐能力。

✳️ 1. 模型总体结构

GeoVLM-R1 采用三阶段设计:

-

GeoVLM-Base:基于 CLIP 结构,结合遥感影像预训练(RS5M 数据集,约 500 万图文对);

-

GeoVLM-Instruct:在 10 万条地理问答对上进行指令微调;

-

GeoVLM-R1(本文核心):引入强化学习优化,使模型在地理任务上持续自我改进。

✳️ 2. 地理感知对齐模块(Geo-Aware Alignment)

-

将影像划分为网格(GeoTiles),为每个块生成空间特征(海拔、高度、经纬度等);

-

使用 Spherical Attention Layer 处理球面坐标下的关系;

-

实现跨区域的语义空间一致性建模。

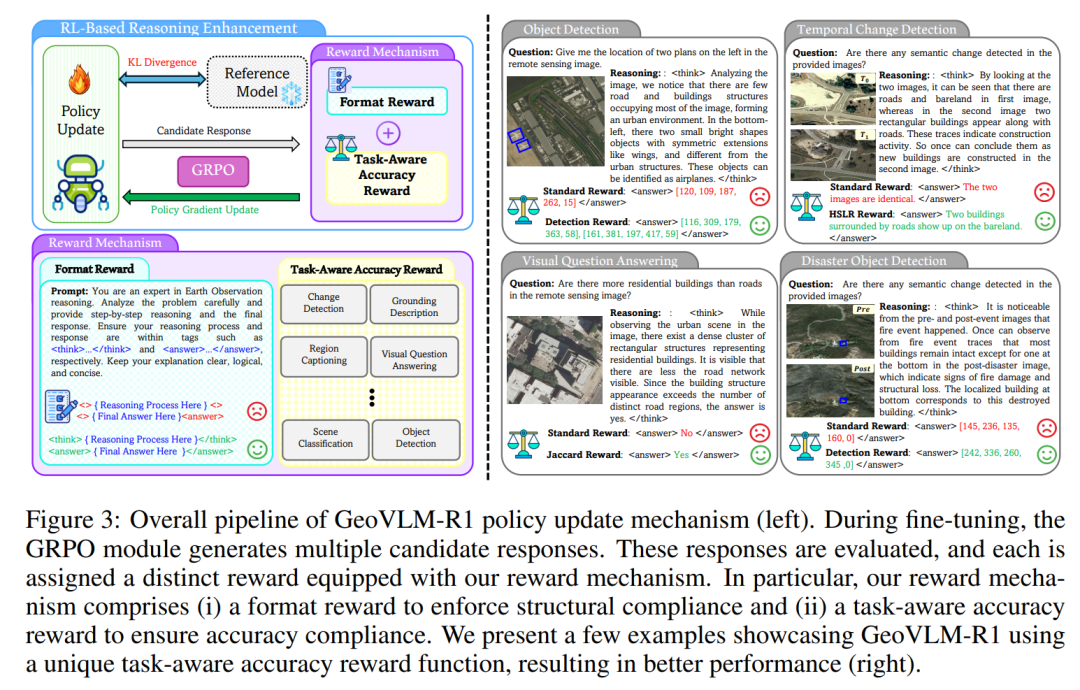

✳️ 3. 强化学习优化框架(RLHF for Geo Understanding)

与传统 RLHF(人类反馈强化学习)不同,GeoVLM-R1 使用 Geo-Reward 作为奖励函数:

其中:

-

:语言语义一致性奖励;

-

:地理坐标和空间关系正确率;

-

:下游任务(如分类、描述、定位)表现反馈。

模型通过 PPO 优化策略迭代更新,使输出在地理语义与任务精度上共同提升。

✳️ 4. 多任务联合训练

GeoVLM-R1 支持以下地理任务:

-

🛰 场景理解:识别地物类型(如森林、港口、城市);

-

📍 空间定位:根据图像预测经纬度区域;

-

🗺 图文检索:从图像生成地理描述,或从文本检索区域;

-

🔄 变化检测:跨时序影像语义对比。

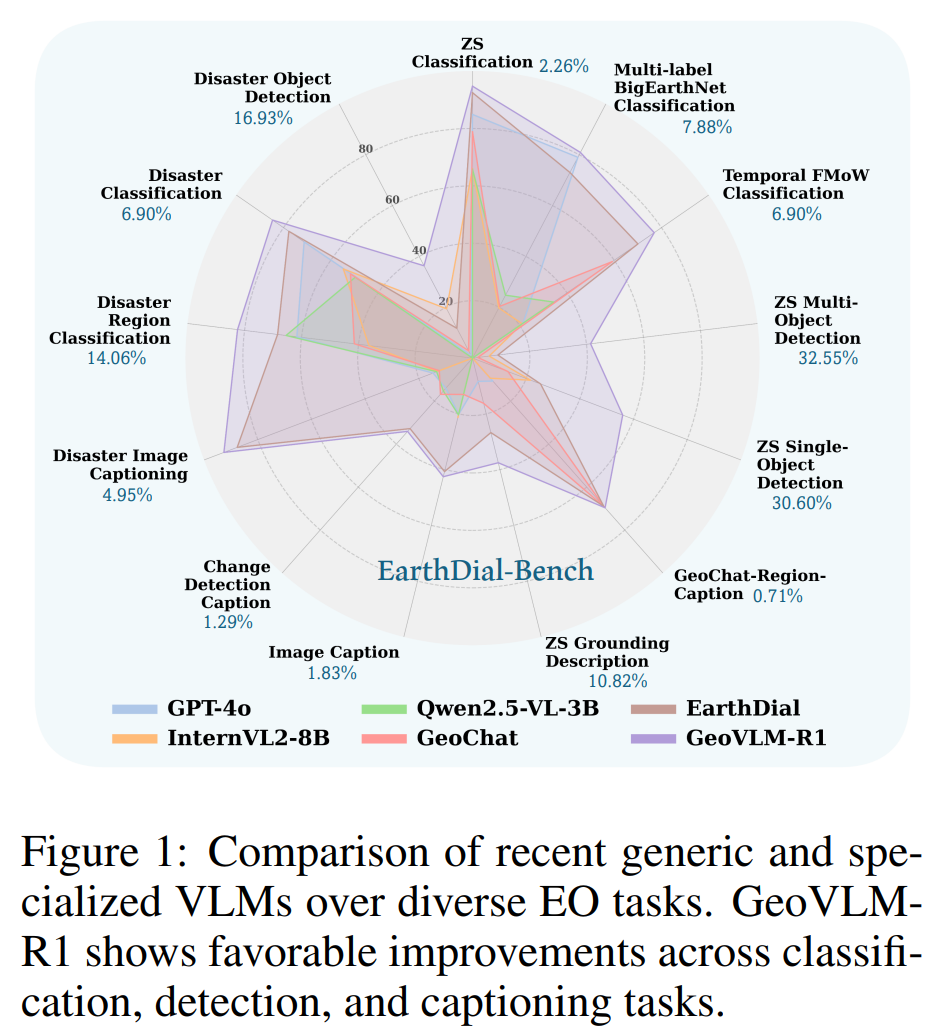

三、实验结果:全面超越通用多模态模型

GeoVLM-R1 在多个遥感与地理数据集上评估,包括 RSICD、BigEarthNet、GeoWiki-QA、SEN12MS。

|

任务 |

指标 |

CLIP |

BLIP-2 |

GeoVLM |

GeoVLM-R1 (本文) |

|---|---|---|---|---|---|

|

图像-文本检索 |

R@1↑ |

27.3 |

33.1 |

46.8 |

57.2 |

|

场景分类 |

Top-1↑ |

75.4 |

80.1 |

87.9 |

90.3 |

|

地理问答 |

Acc↑ |

48.7 |

52.5 |

67.1 |

74.6 |

|

坐标预测 |

Dist↓ |

512km |

378km |

214km |

143km |

🔹 亮点成果:

-

在所有任务上显著超越 CLIP/BLIP/GeoVLM;

-

强化学习优化带来平均 +6.8% 性能提升;

-

在跨洲域(如“北非城市港口”)语义理解上表现尤为出色;

-

模型可在 8×A100 上 2 周完成训练,推理速度接近 CLIP。

四、优势与局限

✅ 优势

-

🧠 具备地理空间推理能力:能理解地物、位置与语义关系;

-

🗺 强化学习优化机制:模型能从地理任务反馈中自我提升;

-

🌍 统一多任务框架:一次训练支持检索、问答、定位、变化检测;

-

⚙️ 跨域泛化性强:在不同卫星、不同地区均保持高精度。

⚠️ 局限

-

奖励信号构造复杂,需人工与规则共同设计;

-

模型训练成本高,需多模态地理标注;

-

对动态地理事件(如灾害、气候变化)理解仍有限;

-

文本生成部分尚不及 GPT-4V 等通用模型流畅。

📝 一句话总结

GeoVLM-R1 让多模态大模型第一次“理解地球”, 通过强化学习融合视觉、语言与地理空间,实现真正的全球级地理智能。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)