Intel oneAPI Deep Neural Network Library (oneDNN) 完整指南

Intel oneDNN是面向深度学习的跨平台性能优化库,提供卷积、矩阵乘法等核心操作的硬件加速。该指南介绍了oneDNN 2025.3版本的新特性,包括CPU/GPU优化、自动调优功能和丰富的原语集合。文章详细讲解了安装配置、快速入门示例以及性能优化策略,如数据类型选择、内存格式优化和操作融合等。此外还展示了在计算机视觉、NLP等场景的应用案例,以及如何与TensorFlow、PyTorch等框

Intel oneAPI Deep Neural Network Library (oneDNN) 完整指南

Date: November 11, 2025

Author: AITechLab 技术团队

Tags: Intel, oneAPI, oneDNN, 深度学习,性能优化,AI 加速

目录

引言

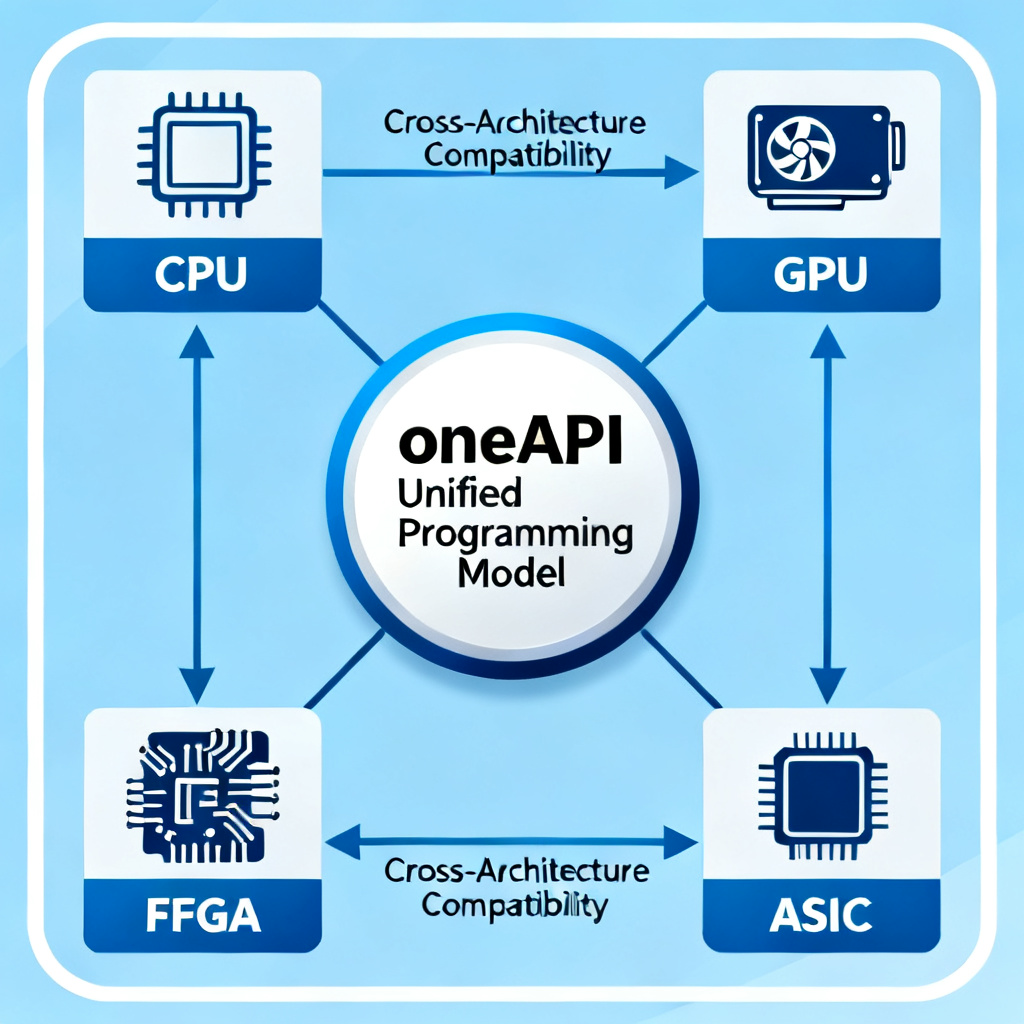

在人工智能和深度学习快速发展的今天,性能优化成为了关键挑战。Intel oneAPI Deep Neural Network Library (oneDNN) 作为一款开源的跨平台性能库,为深度学习应用提供了高度优化的构建块,帮助开发者充分利用 Intel 架构的计算能力。

oneDNN 不仅仅是一个普通的深度学习库,它代表了 Intel 在 AI 加速领域的技术积累和创新方向。通过统一的编程模型和硬件抽象,oneDNN 让开发者能够轻松地在不同的 Intel 处理器上实现最佳性能。

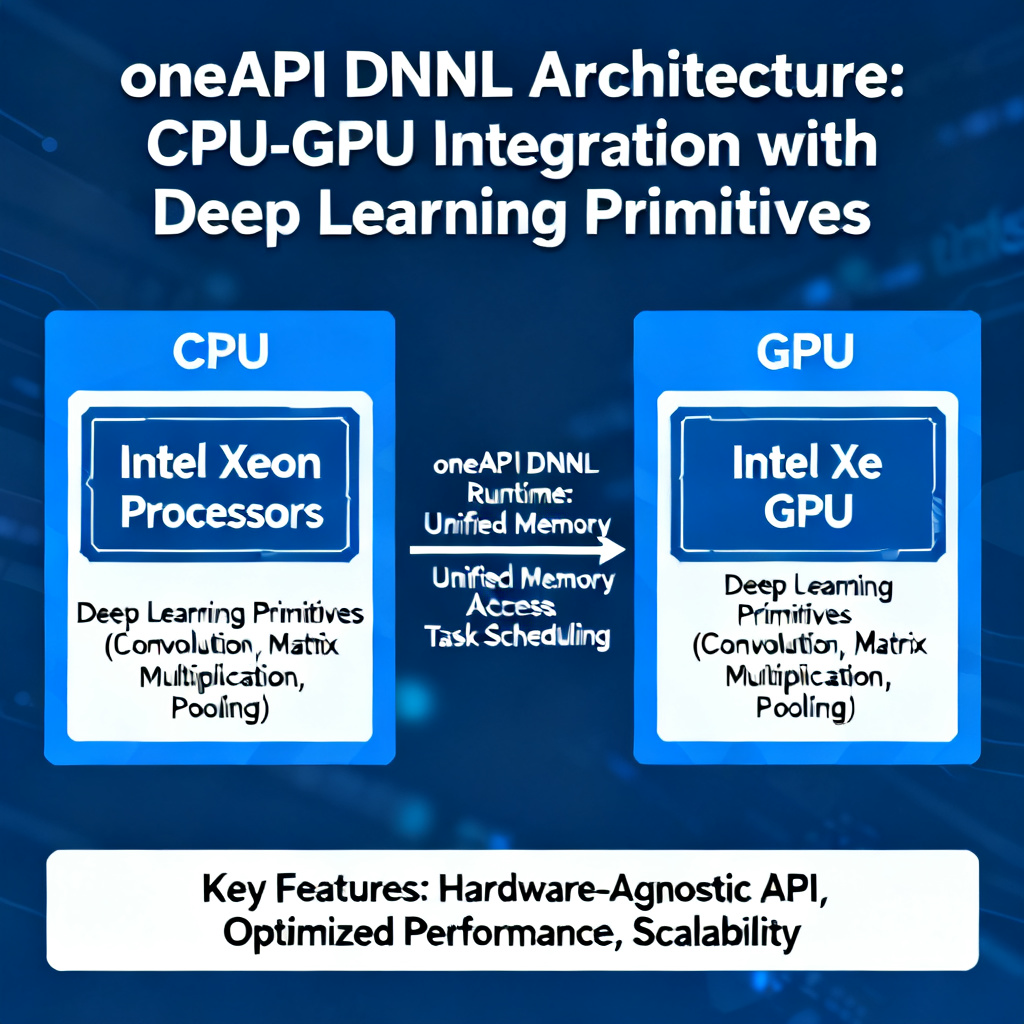

oneDNN 概述

什么是 oneDNN?

Intel oneAPI Deep Neural Network Library (oneDNN) 是一个开源的、基于标准的性能库,专门为深度学习应用设计。它提供了一套完整的深度学习构建块,包括卷积、矩阵乘法、池化、归一化等核心操作。

主要优势

- 跨平台兼容性:支持 Linux、Windows 等主流操作系统

- 硬件抽象:统一的 API 接口,支持 CPU 和 GPU 加速

- 性能优化:针对 Intel 架构进行深度优化

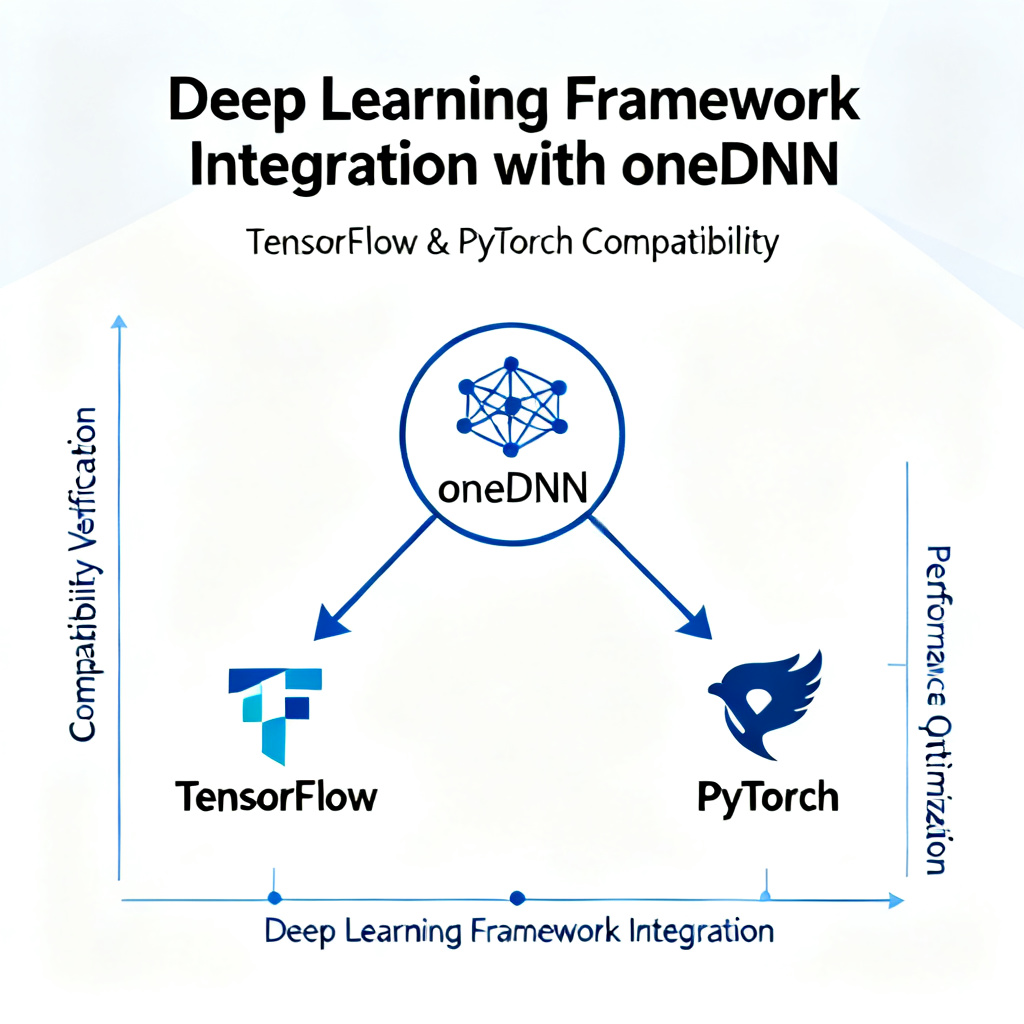

- 框架集成:与 TensorFlow、PyTorch 等主流深度学习框架无缝集成

- 开源生态:活跃的社区支持和持续的更新迭代

最新版本特性(2025.3)

oneDNN 2025.3 版本带来了多项重要更新:

CPU 优化:

- 初始支持 Intel Xeon 处理器的 AVX 10.2 和 AMX 指令集

- 改进卷积原语的初始化时间

- 提升 FP8 卷积性能

- 优化 AMX 支持的矩阵乘法性能

GPU 优化:

- 提升 Intel Xe 架构 GPU 性能

- 优化 Intel Arc 显卡的矩阵乘法

- 改进 RNN 原语性能

核心特性

1. 自动优化

oneDNN 能够自动检测硬件架构并选择最佳的优化策略。它支持多种数据类型,包括 FP32、FP16、BF16 和 INT8,能够根据硬件特性自动选择最优的数据格式和计算路径。

2. 丰富的原语集合

oneDNN 提供了完整的深度学习构建块:

卷积神经网络原语:

- 卷积操作(支持多种卷积类型)

- 内积(全连接层)

- 池化操作(最大池化、平均池化等)

递归神经网络原语:

- LSTM 单元

- GRU 单元

- 标准 RNN 单元

归一化操作:

- 批量归一化

- 层归一化

- 局部响应归一化

激活函数:

- ReLU、Leaky ReLU

- ELU、SELU

- sigmoid、tanh

- GELU(支持 tanh 近似)

3. 内存格式优化

oneDNN 支持多种内存格式,包括 NCHW、NHWC 等,并能够自动选择最优的内存布局。这种灵活性使得 oneDNN 能够在不同的硬件架构上实现最佳性能。

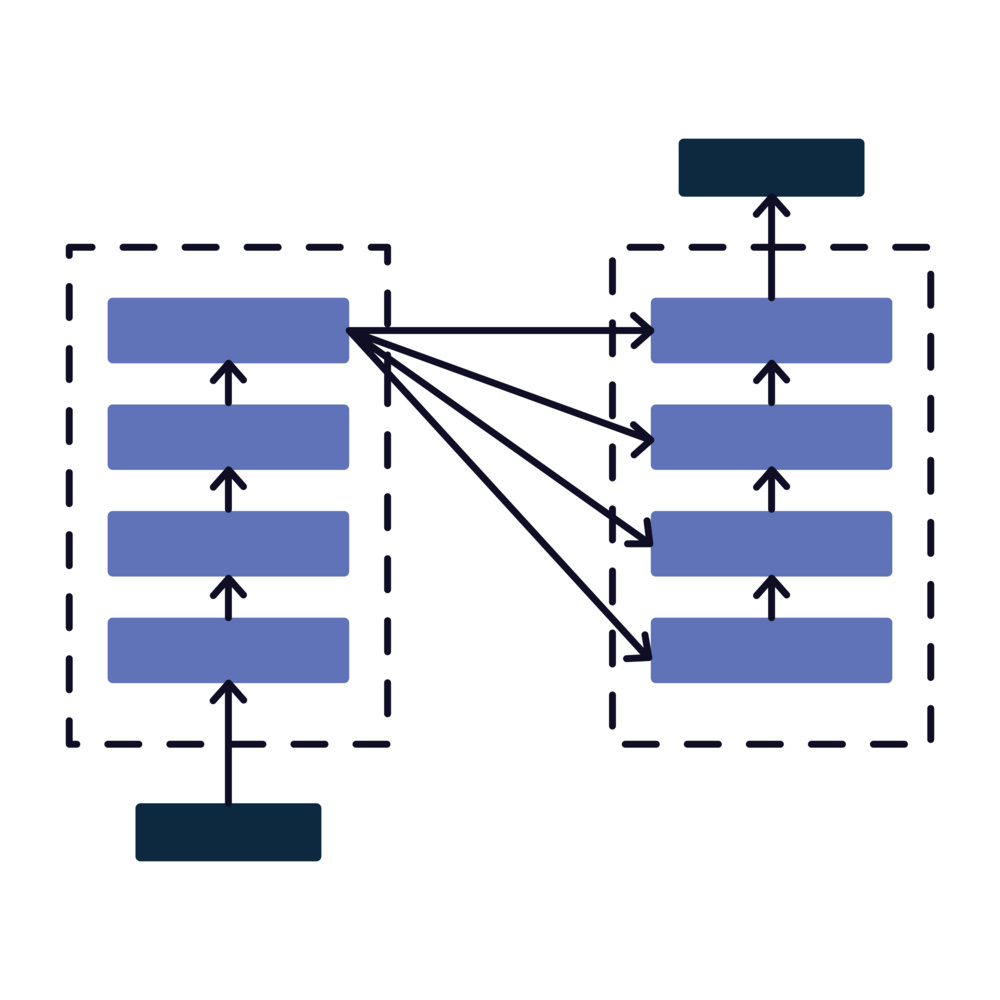

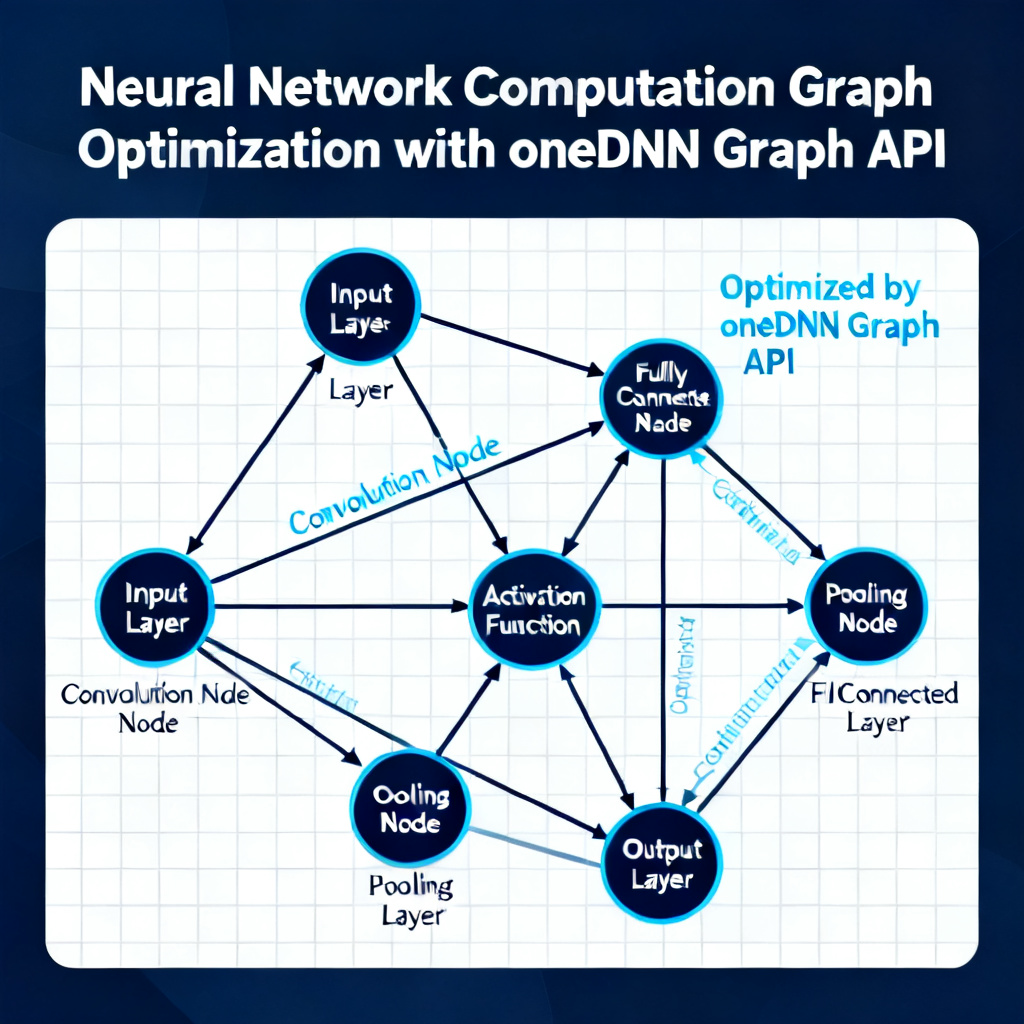

4. 图 API 支持

oneDNN 图 API 提供了高级别的神经网络图优化能力,能够自动识别和优化计算图中的关键路径,实现操作融合和性能提升。

架构设计

整体架构

oneDNN 采用了模块化的架构设计,主要包括以下几个核心组件:

1. 原语层(Primitive Layer)

- 提供基础的深度学习操作

- 支持多种数据类型和计算精度

- 针对不同硬件进行优化实现

2. 引擎层(Engine Layer)

- 管理硬件设备

- 负责内存分配和释放

- 提供执行环境

3. 内存管理层(Memory Management)

- 支持多种内存格式

- 提供数据重排功能

- 优化数据访问模式

4. 图优化层(Graph Optimization)

- 计算图分析和优化

- 操作融合

- 性能调优

跨架构支持

oneDNN 的架构设计充分考虑了跨平台和跨架构的需求。通过统一的 API 接口,开发者可以在不同的 Intel 处理器上运行相同的代码,而无需进行大量的修改。

系统要求

硬件要求

CPU 支持:

- Intel Atom 处理器

- Intel Core 处理器家族

- Intel Core Ultra 处理器

- Intel Xeon 处理器家族

- Intel Xeon 可扩展处理器家族

GPU 支持:

- Intel UHD Graphics(第 11 代及更新)

- Intel Iris Graphics 系列

- Intel Iris Xe Graphics

- Intel Arc A 系列显卡

- Intel 数据中心 GPU 系列

软件要求

操作系统:

- Linux:Ubuntu 22.04/24.04、RHEL 8/9、SUSE 15 SP4+

- Windows:Windows 10/11、Windows Server 2019/2022/2025

- WSL 2:通过 Ubuntu 或 SUSE Linux Enterprise Server

编译器支持:

- Intel oneAPI DPC++/C++ 编译器

- GCC 编译器

- Clang 编译器

安装配置

安装方式

oneDNN 提供了多种安装方式,满足不同用户的需求:

1. 在线安装

# Ubuntu/Debian

sudo apt update

sudo apt install intel-oneapi-dnnl-devel

# RHEL/CentOS

sudo dnf install intel-oneapi-dnnl-devel2. 离线安装

下载离线安装包并运行安装程序:

# Linux

chmod +x l_oneapi_dnnl_p_2025.3.0.43493_offline.sh

sudo ./l_oneapi_dnnl_p_2025.3.0.43493_offline.sh3. Conda 安装

# 创建conda环境

conda create -n onednn-env

conda activate onednn-env

# 安装oneDNN

conda install -c https://software.repos.intel.com/python/conda/ onednn-devel4. pip 安装

pip install onednn环境配置

安装完成后,需要配置环境变量:

# Linux

source /opt/intel/oneapi/setvars.sh

# Windows

call "C:\Program Files (x86)\Intel\oneAPI\setvars.bat"验证安装:

# 检查环境变量

echo $DNNLROOT

echo $PATH | grep dnnl快速开始

C++ API 示例

下面是一个简单的 oneDNN C++ API 示例,展示如何创建一个基本的神经网络计算:

#include <iostream>

#include <dnnl.hpp>

using namespace dnnl;

int main() {

try {

std::cout << "=== Intel oneDNN 快速开始示例 ===" << std::endl;

std::cout << "oneDNN版本: " << dnnl::version::string() << std::endl;

std::cout << std::endl;

// 1. 创建CPU引擎

engine eng(engine::kind::cpu, 0);

std::cout << "✅ CPU引擎创建成功" << std::endl;

// 2. 创建计算流

stream strm(eng);

std::cout << "✅ 计算流创建成功" << std::endl;

// 3. 定义张量尺寸

memory::dims conv_src_dims = {1, 3, 224, 224}; // NCHW格式

memory::dims conv_weights_dims = {64, 3, 7, 7};

memory::dims conv_dst_dims = {1, 64, 112, 112};

memory::dims conv_strides = {2, 2};

memory::dims conv_padding = {3, 3};

// 4. 创建内存描述符

auto conv_src_md = memory::desc(conv_src_dims, memory::data_type::f32, memory::format_tag::nchw);

auto conv_weights_md = memory::desc(conv_weights_dims, memory::data_type::f32, memory::format_tag::oihw);

auto conv_dst_md = memory::desc(conv_dst_dims, memory::data_type::f32, memory::format_tag::nchw);

// 5. 创建卷积原语描述符

auto conv_desc = convolution_forward::desc(prop_kind::forward_inference,

algorithm::convolution_direct,

conv_src_md, conv_weights_md, conv_dst_md,

conv_strides, conv_padding, conv_padding);

// 6. 创建卷积原语

auto conv_pd = convolution_forward::primitive_desc(conv_desc, eng);

auto conv_prim = convolution_forward(conv_pd);

std::cout << "✅ 卷积原语创建成功" << std::endl;

std::cout << std::endl;

// 7. 分配内存并初始化数据

auto src_mem = memory(conv_pd.src_desc(), eng);

auto weights_mem = memory(conv_pd.weights_desc(), eng);

auto dst_mem = memory(conv_pd.dst_desc(), eng);

// 8. 执行卷积计算

conv_prim.execute(strm, {{DNNL_ARG_SRC, src_mem},

{DNNL_ARG_WEIGHTS, weights_mem},

{DNNL_ARG_DST, dst_mem}});

// 9. 等待计算完成

strm.wait();

std::cout << "🎉 卷积计算执行成功!" << std::endl;

std::cout << "输入尺寸: " << conv_src_dims[0] << "x" << conv_src_dims[1] << "x"

<< conv_src_dims[2] << "x" << conv_src_dims[3] << std::endl;

std::cout << "输出尺寸: " << conv_dst_dims[0] << "x" << conv_dst_dims[1] << "x"

<< conv_dst_dims[2] << "x" << conv_dst_dims[3] << std::endl;

return 0;

} catch (const dnnl::error &e) {

std::cerr << "\n❌ oneDNN错误: " << e.what() << std::endl;

std::cerr << "错误代码: " << e.status << std::endl;

return 1;

} catch (const std::exception &e) {

std::cerr << "\n❌ 异常: " << e.what() << std::endl;

return 1;

}

}C API 示例

oneDNN 也提供了 C 语言 API:

#include <stdio.h>

#include <dnnl.h>

int main() {

printf("=== Intel oneDNN C API 示例 ===\n");

dnnl_engine_t engine;

dnnl_status_t status = dnnl_engine_create(&engine, dnnl_cpu, 0);

if (status == dnnl_success) {

printf("✅ CPU引擎创建成功\n");

dnnl_stream_t stream;

status = dnnl_stream_create(&stream, engine, dnnl_stream_default_flags);

if (status == dnnl_success) {

printf("✅ 计算流创建成功\n");

// 获取oneDNN版本信息

const char *version = dnnl_version_string();

printf("oneDNN版本: %s\n", version);

dnnl_stream_destroy(stream);

}

dnnl_engine_destroy(engine);

printf("\n🎉 oneDNN C API 测试成功!\n");

return 0;

} else {

printf("❌ CPU引擎创建失败,错误代码: %d\n", status);

return 1;

}

}编译和运行

# 编译C++示例

g++ -std=c++17 onednn_example.cpp -o onednn_example -ldnnl

# 编译C示例

gcc onednn_c_example.c -o onednn_c_example -ldnnl

# 运行示例

./onednn_example

./onednn_c_example性能优化

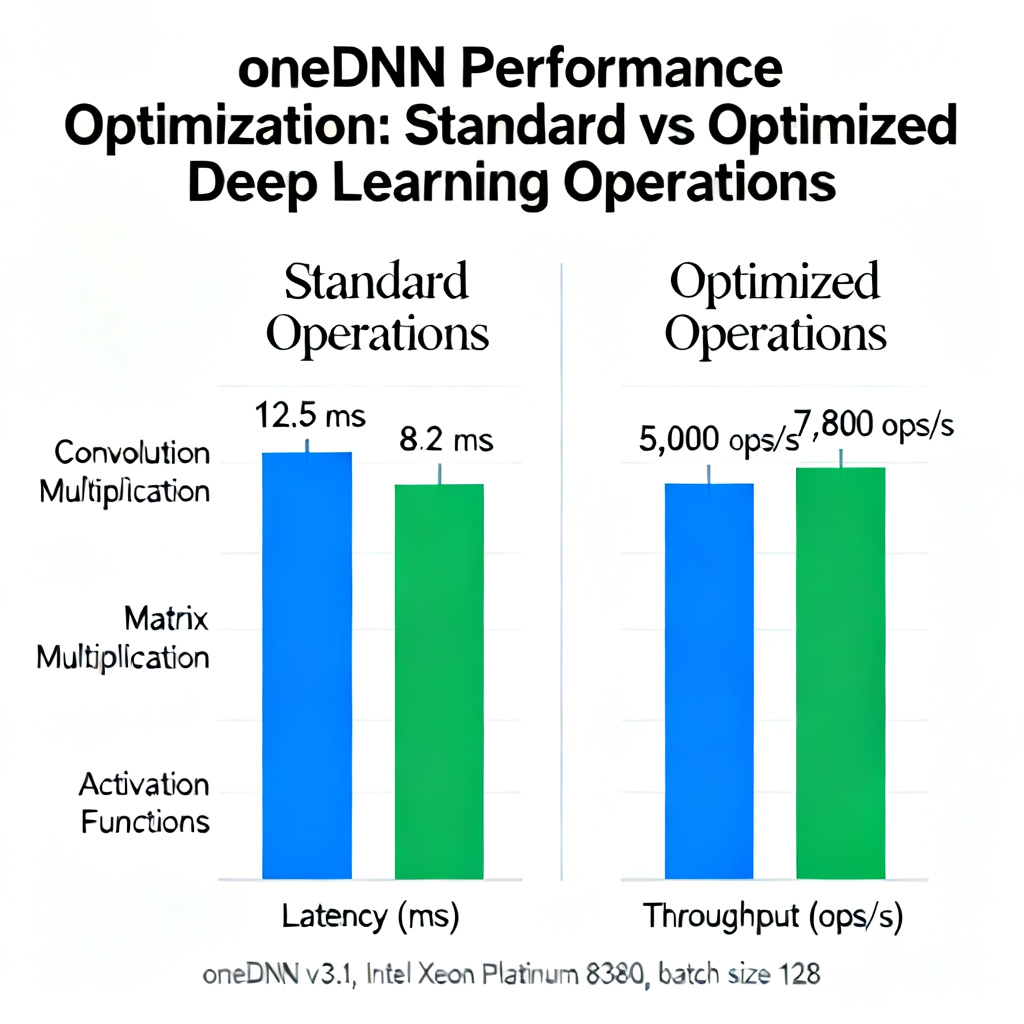

性能优化策略

oneDNN 提供了多种性能优化策略,帮助开发者充分利用硬件资源:

1. 数据类型优化

oneDNN 支持多种数据类型,包括:

- FP32:单精度浮点数,适用于训练

- FP16:半精度浮点数,内存占用小,计算速度快

- BF16:Intel Brain Float 16,专为 AI 计算优化

- INT8:整数计算,速度最快,内存占用最小

使用示例:

// 使用BF16数据类型

auto src_md = memory::desc(dims, memory::data_type::bf16, memory::format_tag::nchw);2. 内存格式优化

oneDNN 支持多种内存格式,选择合适的格式可以显著提升性能:

// 自动选择最优格式

auto conv_pd = convolution_forward::primitive_desc(conv_desc, eng);

auto optimized_src_md = conv_pd.src_desc();3. 原语融合

oneDNN 支持操作融合,将多个操作合并为一个原语,减少数据传输和内存访问:

// 创建融合操作(卷积 + ReLU)

post_ops po;

po.append_eltwise(algorithm::eltwise_relu, 0.0f, 0.0f);

primitive_attr attr;

attr.set_post_ops(po);

auto conv_pd = convolution_forward::primitive_desc(conv_desc, attr, eng);4. 多线程优化

oneDNN 支持多线程计算,可以通过环境变量或 API 设置线程数:

# 设置线程数

export OMP_NUM_THREADS=8

// 通过API设置线程数

dnnl_set_max_threads(8);5. 性能分析

使用 Intel VTune Profiler 可以分析 oneDNN 应用的性能瓶颈:

vtune -collect hotspots ./onednn_application框架集成

oneDNN 与主流深度学习框架深度集成,无需修改代码即可享受性能提升。

TensorFlow 集成

TensorFlow 默认启用 oneDNN 优化:

import tensorflow as tf

# 检查是否启用oneDNN

print(tf.config.list_physical_devices('CPU'))

print(tf.config.optimizer.get_experimental_options())启用 oneDNN:

# Linux

export TF_ENABLE_ONEDNN_OPTS=1

# Windows

set TF_ENABLE_ONEDNN_OPTS=1PyTorch 集成

PyTorch 通过 Intel Extension for PyTorch (IPEX) 集成 oneDNN:

# 安装IPEX

pip install intel-extension-for-pytorch

import torch

import intel_extension_for_pytorch as ipex

# 启用oneDNN优化

model = model.to('cpu')

model = ipex.optimize(model, dtype=torch.bfloat16)OpenVINO 集成

OpenVINO 广泛使用 oneDNN 进行推理优化:

from openvino.runtime import Core

ie = Core()

model = ie.read_model(model='model.xml')

compiled_model = ie.compile_model(model=model, device_name='CPU')实际应用

计算机视觉应用

oneDNN 在计算机视觉领域表现出色,特别是在图像分类、目标检测和图像分割任务中:

// 图像分类网络示例

void image_classification() {

// 1. 创建网络输入

memory::dims input_dims = {1, 3, 224, 224};

auto input_md = memory::desc(input_dims, memory::data_type::f32, memory::format_tag::nchw);

// 2. 卷积层

memory::dims conv1_weights_dims = {64, 3, 7, 7};

auto conv1_desc = convolution_forward::desc(prop_kind::forward_inference,

algorithm::convolution_direct,

input_md,

memory::desc(conv1_weights_dims, memory::data_type::f32, memory::format_tag::oihw),

memory::desc({1, 64, 112, 112}, memory::data_type::f32, memory::format_tag::nchw),

{2, 2}, {3, 3}, {3, 3});

// 3. 池化层

auto pool1_desc = pooling_forward::desc(prop_kind::forward_inference,

algorithm::pooling_max,

memory::desc({1, 64, 112, 112}, memory::data_type::f32, memory::format_tag::nchw),

memory::desc({1, 64, 56, 56}, memory::data_type::f32, memory::format_tag::nchw),

{2, 2}, {0, 0}, {2, 2});

// 4. 全连接层

auto fc_desc = inner_product_forward::desc(prop_kind::forward_inference,

memory::desc({1, 4096}, memory::data_type::f32, memory::format_tag::nc),

memory::desc({1000, 4096}, memory::data_type::f32, memory::format_tag::oi),

memory::desc({1, 1000}, memory::data_type::f32, memory::format_tag::nc));

std::cout << "✅ 图像分类网络创建成功" << std::endl;

}自然语言处理

在 NLP 任务中,oneDNN 能够加速 Transformer 模型的训练和推理:

// Transformer注意力机制示例

void transformer_attention() {

// 缩放点积注意力

memory::dims qkv_dims = {1, 12, 512}; // [batch, heads, hidden_size]

// Q, K, V投影

auto q_proj_desc = inner_product_forward::desc(prop_kind::forward_inference,

memory::desc({1, 768}, memory::data_type::f32, memory::format_tag::nc),

memory::desc({512, 768}, memory::data_type::f32, memory::format_tag::oi),

memory::desc(qkv_dims, memory::data_type::f32, memory::format_tag::nhw));

// 矩阵乘法(Q * K^T)

auto matmul_desc = matmul::desc(memory::desc(qkv_dims, memory::data_type::f32, memory::format_tag::nhw),

memory::desc(qkv_dims, memory::data_type::f32, memory::format_tag::nhw),

memory::desc({1, 12, 12}, memory::data_type::f32, memory::format_tag::nhw));

std::cout << "✅ Transformer注意力机制创建成功" << std::endl;

}推荐系统

oneDNN 在推荐系统中也有广泛应用:

// 深度推荐模型示例

void deep_recommendation() {

// 嵌入层

memory::dims embedding_dims = {1, 128};

auto embedding_desc = inner_product_forward::desc(prop_kind::forward_inference,

memory::desc({1, 1}, memory::data_type::s32, memory::format_tag::nc),

memory::desc(embedding_dims, memory::data_type::f32, memory::format_tag::oi),

memory::desc(embedding_dims, memory::data_type::f32, memory::format_tag::nc));

// 多层感知机

auto mlp1_desc = inner_product_forward::desc(prop_kind::forward_inference,

memory::desc(embedding_dims, memory::data_type::f32, memory::format_tag::nc),

memory::desc({1, 256}, memory::data_type::f32, memory::format_tag::oi),

memory::desc({1, 256}, memory::data_type::f32, memory::format_tag::nc));

std::cout << "✅ 深度推荐模型创建成功" << std::endl;

}计算图优化

oneDNN 图 API 提供了高级别的神经网络图优化能力,能够自动分析和优化计算图。

图 API 示例

#include <dnnl_graph.hpp>

using namespace dnnl::graph;

void graph_optimization_example() {

// 创建图

graph g;

// 添加输入张量

logical_tensor input_lt {0, data_type::f32, {1, 3, 224, 224}, layout_type::undef};

g.add_input(input_lt);

// 添加卷积操作

logical_tensor conv_weights_lt {1, data_type::f32, {64, 3, 7, 7}, layout_type::undef};

logical_tensor conv_lt {2, data_type::f32, layout_type::undef};

op conv_op(0, op::kind::Convolution, {input_lt, conv_weights_lt}, {conv_lt});

conv_op.set_attr<std::vector<int64_t>>("strides", {2, 2});

conv_op.set_attr<std::vector<int64_t>>("pads_begin", {3, 3});

conv_op.set_attr<std::vector<int64_t>>("pads_end", {3, 3});

g.add_op(conv_op);

// 添加ReLU激活

logical_tensor relu_lt {3, data_type::f32, layout_type::undef};

op relu_op(1, op::kind::ReLU, {conv_lt}, {relu_lt});

g.add_op(relu_op);

// 添加输出

g.add_output(relu_lt);

// 编译图

engine eng(engine::kind::cpu, 0);

compiled_partition cp = g.compile({eng});

std::cout << "✅ 计算图编译成功" << std::endl;

}图优化特性

1. 操作融合:自动识别可融合的操作序列

2. 内存优化:优化张量布局和数据访问

3. 并行化:自动并行化计算任务

4. 常数折叠:优化常数计算

大规模部署

数据中心部署

在大规模数据中心环境中,oneDNN 能够充分利用 Intel Xeon 处理器的性能:

# 多节点训练配置

export MPI_NUM_PROCESSES=32

export OMP_NUM_THREADS=16

export ONEDNN_MAX_CPU_ISA=avx512_core_amx

# 启动分布式训练

mpiexec -n $MPI_NUM_PROCESSES ./distributed_training边缘计算部署

在边缘设备上,oneDNN 能够在保证性能的同时优化功耗:

// 边缘设备优化配置

void edge_device_optimization() {

// 使用INT8量化

auto src_md = memory::desc(dims, memory::data_type::s8, memory::format_tag::nchw);

// 启用低功耗模式

dnnl::primitive_attr attr;

attr.set_cpu_isa(cpu_isa::avx2); // 选择适合边缘设备的指令集

// 优化内存使用

memory::desc optimized_md = memory::desc(dims, memory::data_type::s8,

memory::format_tag::nhwc); // NHWC格式更适合缓存

std::cout << "✅ 边缘设备优化配置完成" << std::endl;

}总结与展望

主要成就

Intel oneAPI Deep Neural Network Library (oneDNN) 作为一款优秀的深度学习性能库,已经在多个领域取得了显著成就:

- 性能突破:在 Intel 架构上实现了深度学习计算的性能突破

- 生态完善:与主流深度学习框架深度集成

- 标准化:推动了深度学习性能优化的标准化进程

- 开源社区:建立了活跃的开源社区和生态系统

技术发展趋势

1. 硬件加速技术

- AMX 指令集的深度优化

- AVX 10.2 的全面支持

- 专用 AI 加速器的集成

2. 软件架构演进

- 更智能的自动优化

- 更强大的图 API

- 更好的跨平台支持

3. 应用场景扩展

- 大语言模型优化

- 计算机视觉加速

- 推荐系统优化

未来展望

oneDNN 的未来发展将聚焦于以下几个方向:

- 更智能的优化:基于机器学习的自动性能调优

- 更广泛的硬件支持:支持更多类型的 AI 加速器

- 更深入的框架集成:与更多深度学习框架深度集成

- 更好的开发者体验:提供更友好的 API 和工具链

结语

Intel oneAPI Deep Neural Network Library (oneDNN) 代表了深度学习性能优化的发展方向。通过统一的编程模型和硬件抽象,oneDNN 让开发者能够轻松地在不同的 Intel 处理器上实现最佳性能。

无论是在数据中心的大规模训练,还是在边缘设备的实时推理,oneDNN 都能够提供卓越的性能表现。随着 AI 技术的不断发展,oneDNN 将继续发挥重要作用,推动深度学习技术的普及和应用。

作为开发者,掌握 oneDNN 技术将为你的 AI 项目带来显著的性能提升。让我们一起探索 oneDNN 的无限可能,构建更加强大的 AI 应用!

参考资源:

本文基于 Intel oneDNN 2025.3 版本编写,更多最新信息请参考官方文档。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献92条内容

已为社区贡献92条内容

所有评论(0)