从笔记到第二大脑:Flowith 2.0 知识库实测与反思

(注:本文为小报童精选文章。已订阅小报童或加入知识星球「玉树芝兰」用户请勿重复付费)知识流动本就该如此轻松。不是吗?痛点在日常的知识工作中,我一直希望让记录和输出都变得更加简单。简要来说,我的目标是不肯花大功夫整理笔记,却希望获得卡片笔记写作法带来的收益。所以,这些年,你看到了,我没少折腾各种笔记应用。正如我之前所说:作为一个懒人,我一直希望知识的处理与输出能变得更加容易一些。这些年,我尝试了各种

(注:本文为小报童精选文章。已订阅小报童或加入知识星球「玉树芝兰」用户请勿重复付费)

知识流动本就该如此轻松。不是吗?

痛点

在日常的知识工作中,我一直希望让记录和输出都变得更加简单。简要来说,我的目标是不肯花大功夫整理笔记,却希望获得卡片笔记写作法带来的收益。所以,这些年,你看到了,我没少折腾各种笔记应用。正如我之前所说:

作为一个懒人,我一直希望知识的处理与输出能变得更加容易一些。这些年,我尝试了各种笔记工具,包括 Evernote, Notion, Obsidian, Logseq, Roam Research, Heptabase 等,就是希望能够无压记录,精准回顾,流畅输出。

然而,这些工具对我来说依然不够轻松。在使用 AI 之前,我必须人为地给信息打标签或建立链接,才能后期检索到它们。这种额外负担在实际使用中并没有真正减轻我的工作量。我也曾在文章中表达过自己真切的期待:

…… 随时去记录,而不必操心加工整理的事儿。当我真正想要调用之前的知识储备时,只需要一个自然语言简单查询,AI 就能遍历我的笔记库,自己根据语义找寻相关记录,然后总结输出,给我一个满意的答案。

有了 AI 以后,我也试用多种基于 RAG 技术的工具,例如 Notion AI, Quivr, Elephas, GPTs, Obsidian Copilot, Cursor 等等,却发现它们对懒人仍不够友好。尤其是设置过程复杂,更新不便,对新手来说有门槛。如很多人在配置 Obsidian Copilot 时,会被各种设置问题和不匹配的选项弄得手忙脚乱。

不少工具在用户输入了大量文件后,找寻的准确率和回答的精准度还有很大提升空间,这一点也让 我在使用过程中深有体会。我曾经尝试通过更好的 embedding 模型和排序方法来解决,但这显然不符合「懒人法则」,不够「开箱即用」。

因此,当我得知 Flowith 2.0 增加了知识库功能,而且很多小伙伴试用后反馈效果很好时,便想测试一下它是否能解决我在知识管理和利用上的痛点。我期待通过这种方式,不用再面对繁琐的设置步骤,就能准确提取出相关笔记,并实现更顺畅的创作过程,也希望它能够成为真正意义上的 「第二大脑」。

这篇文章,就是我的实践过程和反思总结,希望对你的知识工作有帮助。

构建

Flowith 这东西,半年多以前,我就给你推荐过。最近它邀请用户参与 2.0 Beta 版本内测,我立即就填写了表格,很快被工作人员拉入群里,且给了 Premium 兑换码。

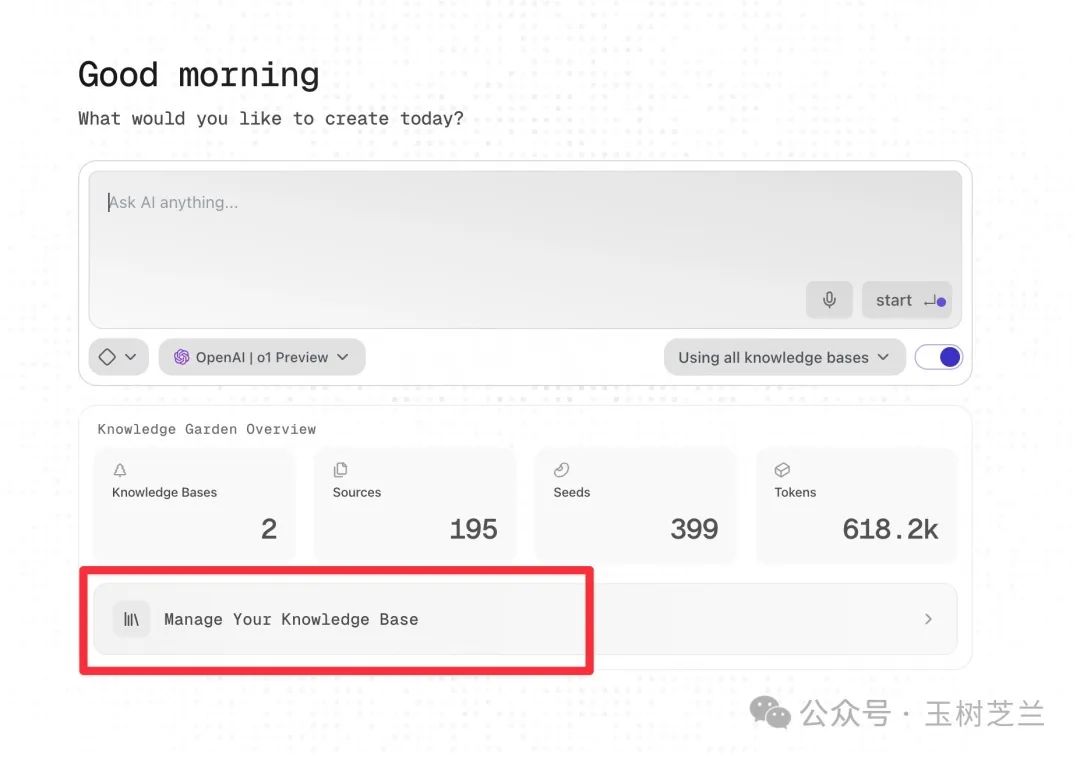

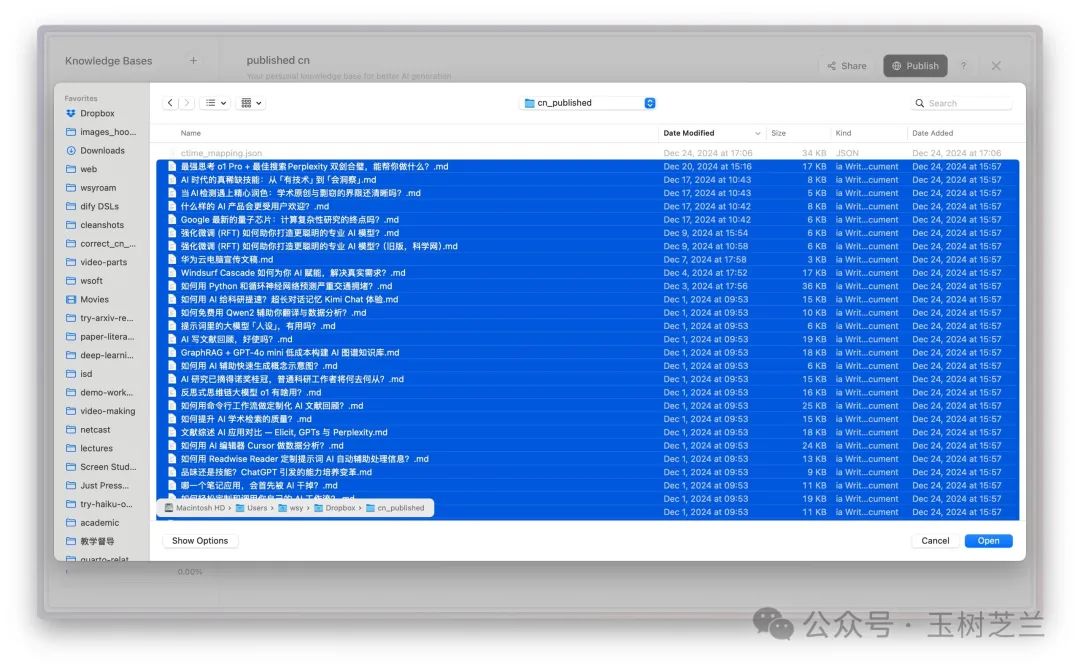

我于是立即开始尝试构建知识库。方法是选择 "Manage Your Knowledge Base",进入知识库管理页面。

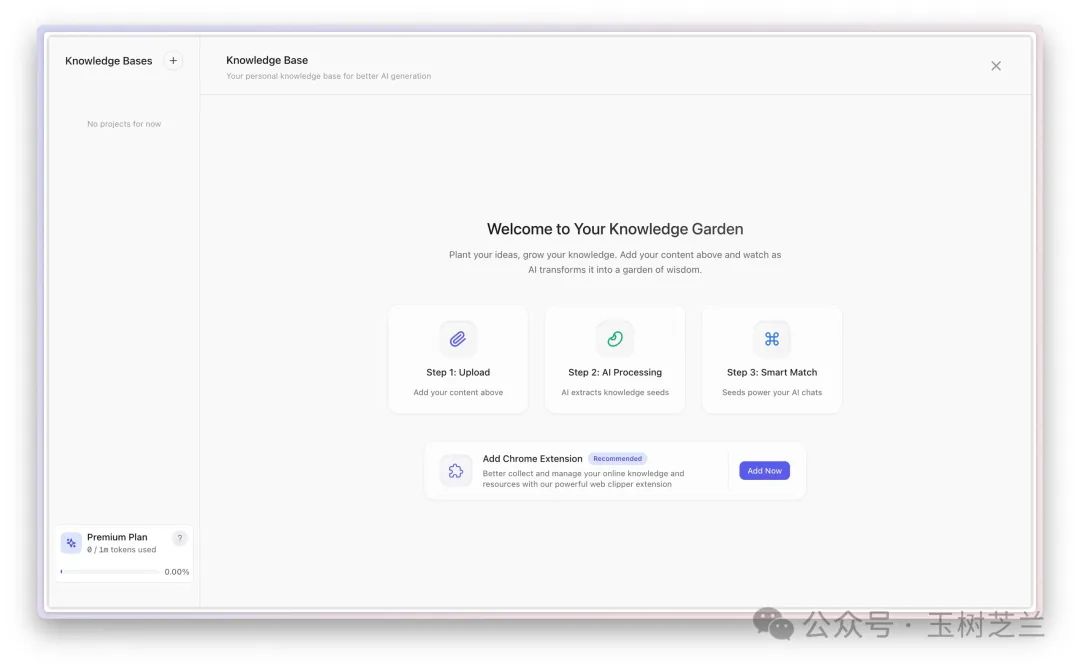

然后选择左上角的加号,添加新的知识库。

你可以随意给知识库起个名。但是我强烈建议你起个自己后来能分辨的名字,不然使用的时候会不方便找寻。

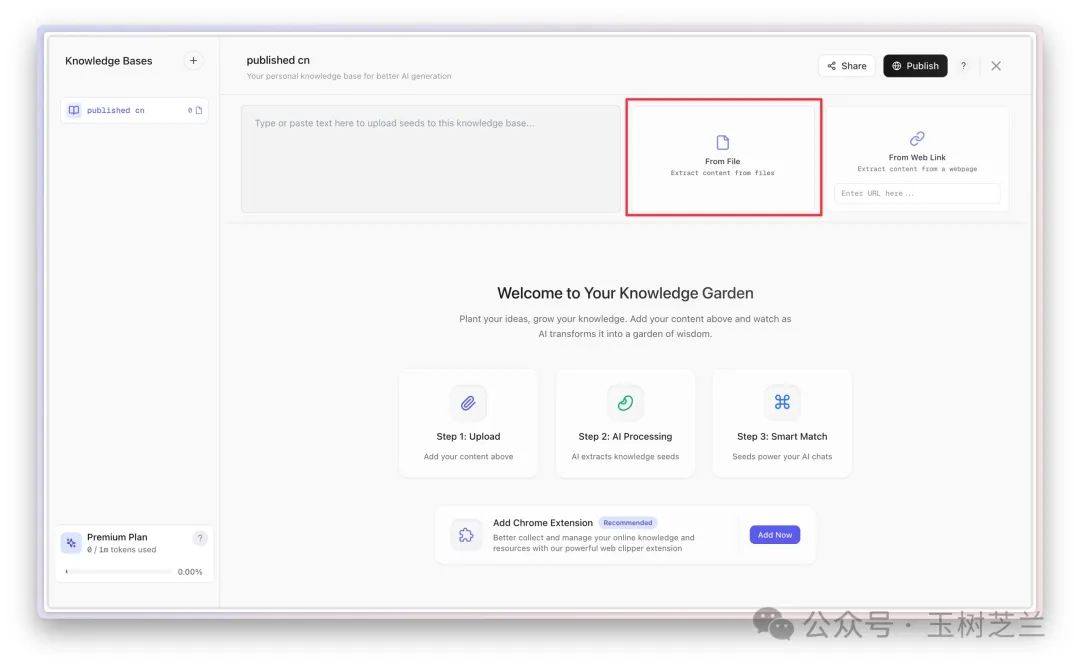

下面,你就可以点击添加文件。

我建议你使用 Markdown 格式的文件。我平时发布的文章,存储的都是这种格式。它其实就是带标记的纯文本,比较符合大语言模型的偏好。

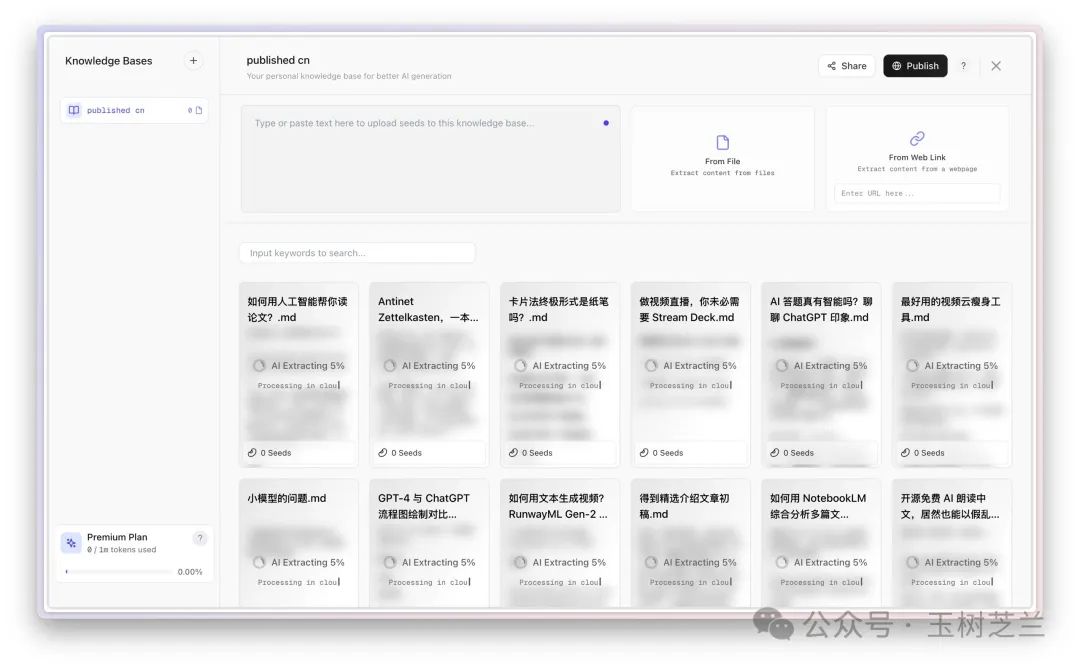

接着,你会看到 Flowith 开始忙活,逐个文件进行抽取(Extraction)等处理。

你根本无需操心它是怎么做的。关上页面,等处理好了再说。

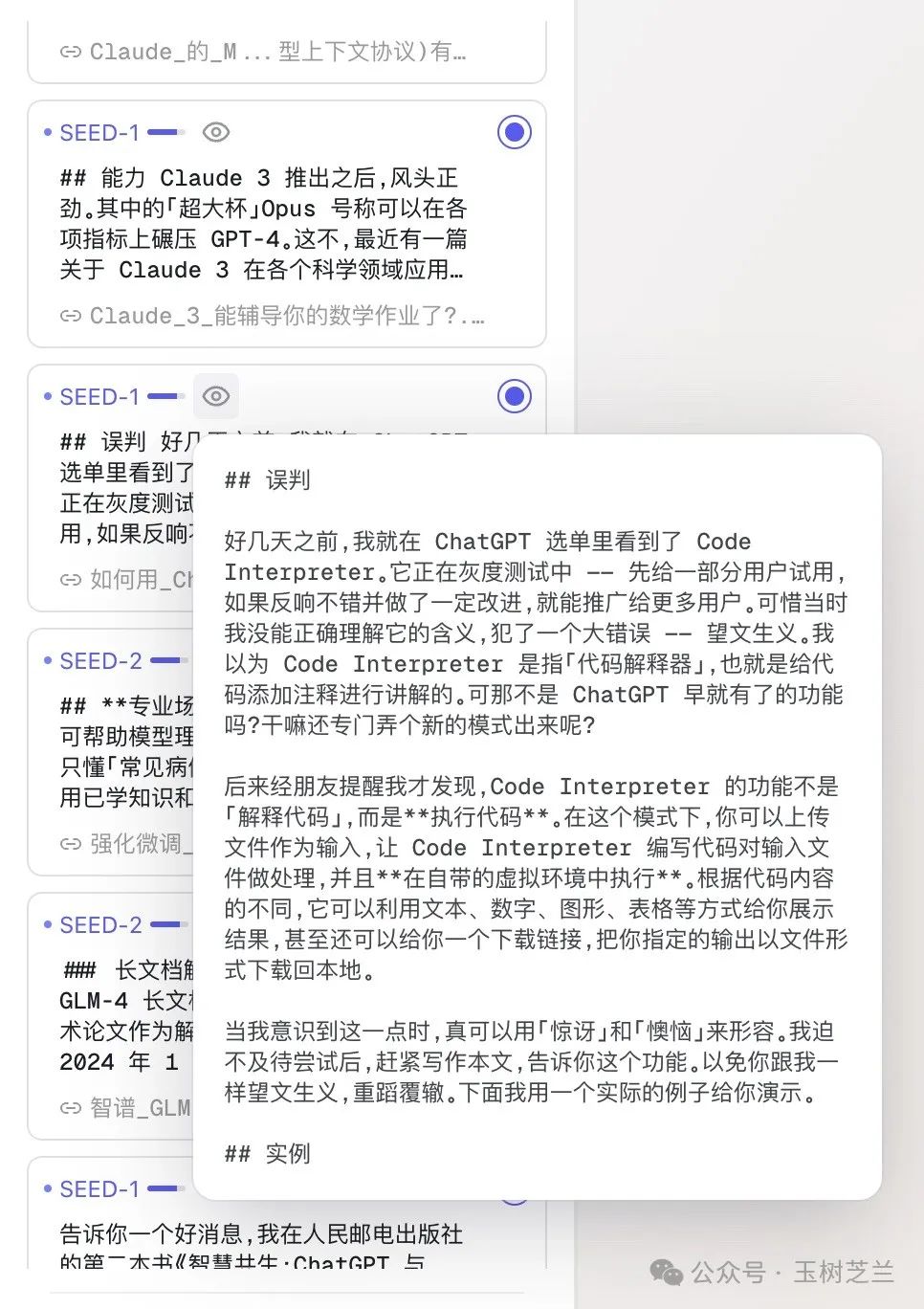

过了一会儿,处理完毕。我点开其中某一个文件看看。处理过后它包含 3 个 seeds,也就是因为长度关系,切分成了 3 个部分。

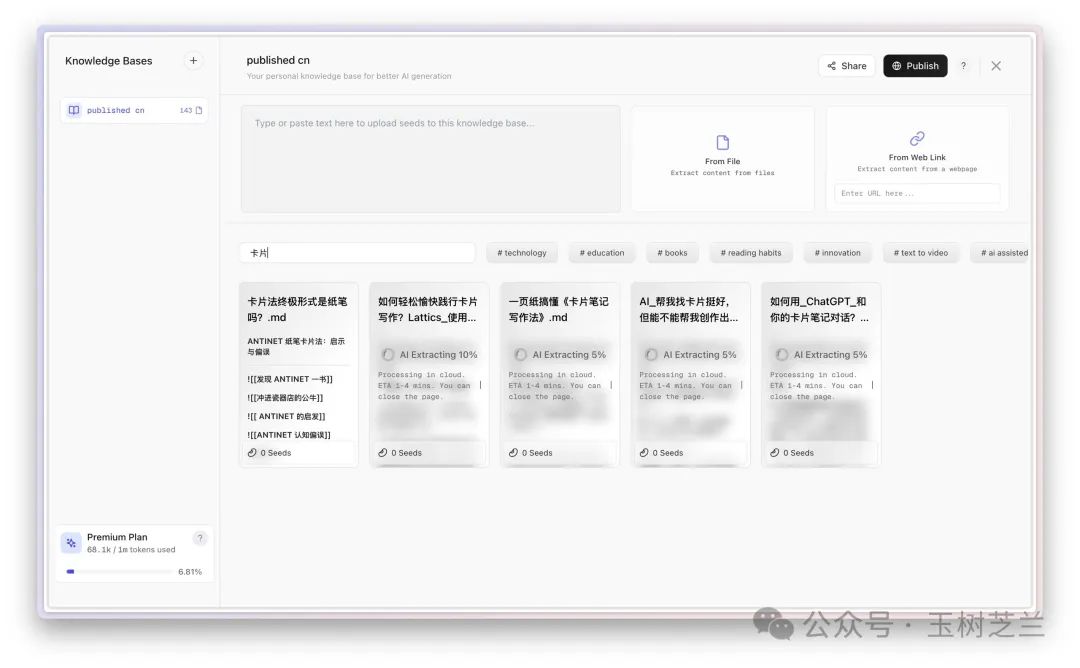

你可以在知识库管理页面测试检索。例如我这里输入「卡片」,就可以过滤出与「卡片」直接相关的发布文章内容。

这就是知识库的构建方法 —— 新建、拖拽、等待、搞定。

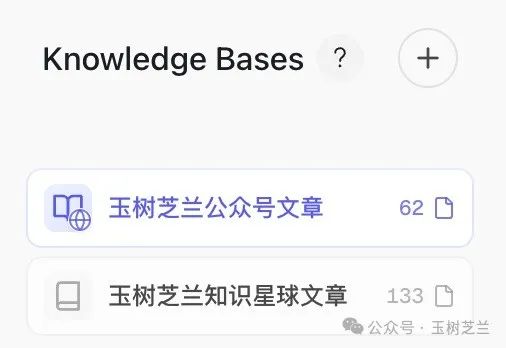

按照类似的逻辑,我分别构建了「《玉树芝兰》公众号文章」和「《玉树芝兰》知识星球文章」两个知识库。

知识库构建好了,咱们尝试一下问答吧。

尝试

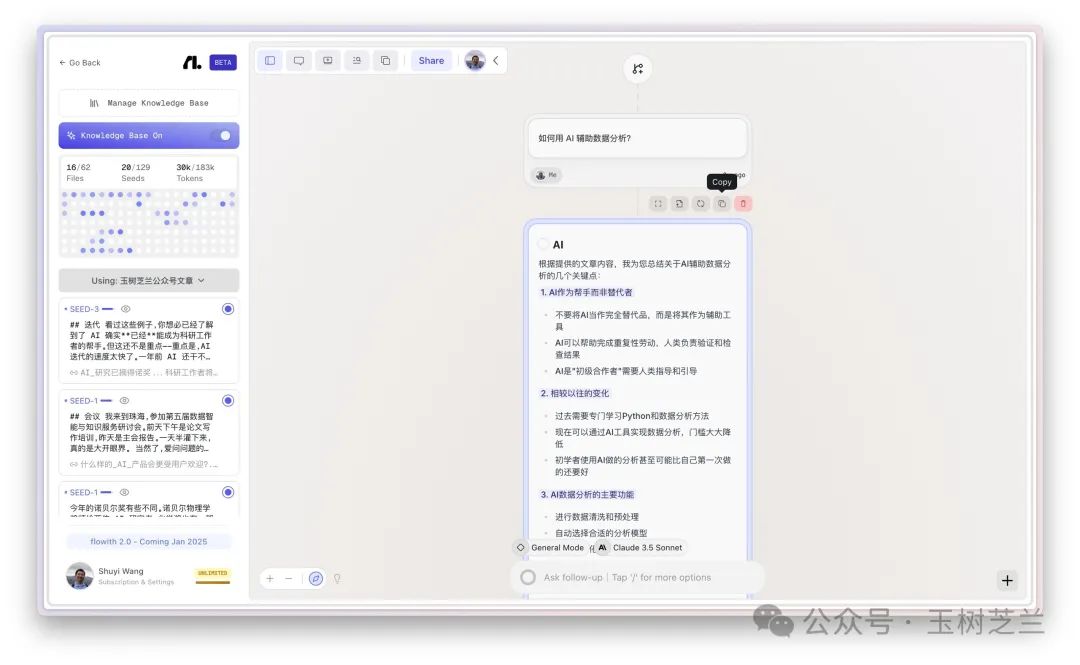

我们先来尝试一下利用「《玉树芝兰》公众号文章」来回答问题。

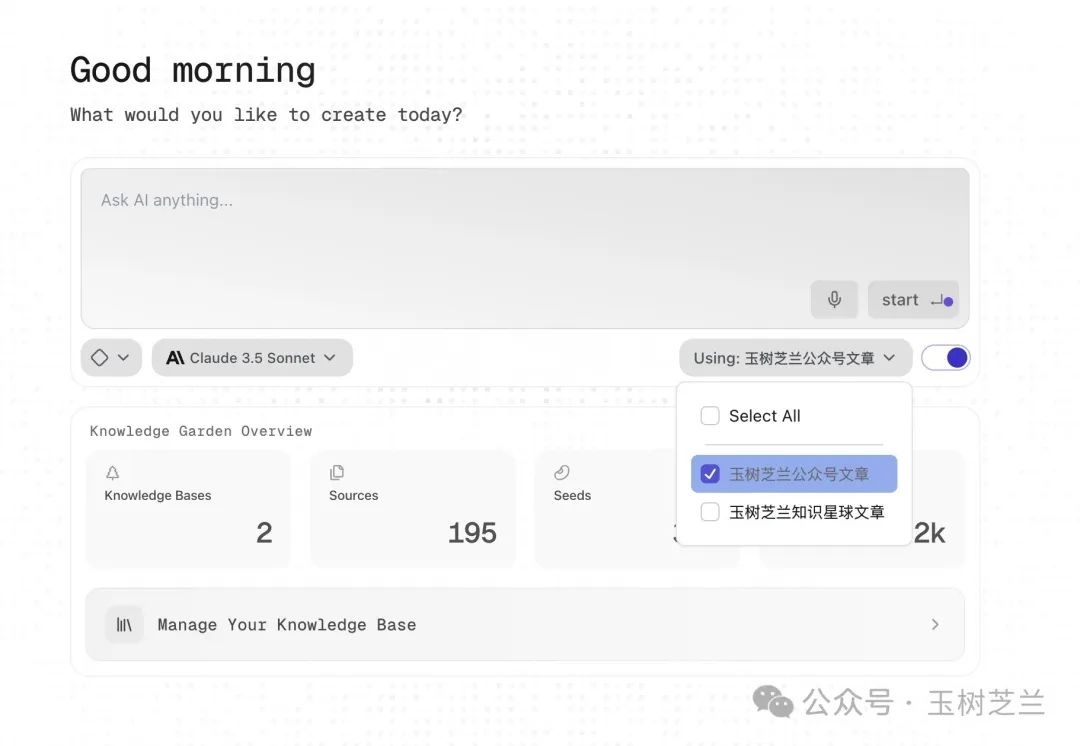

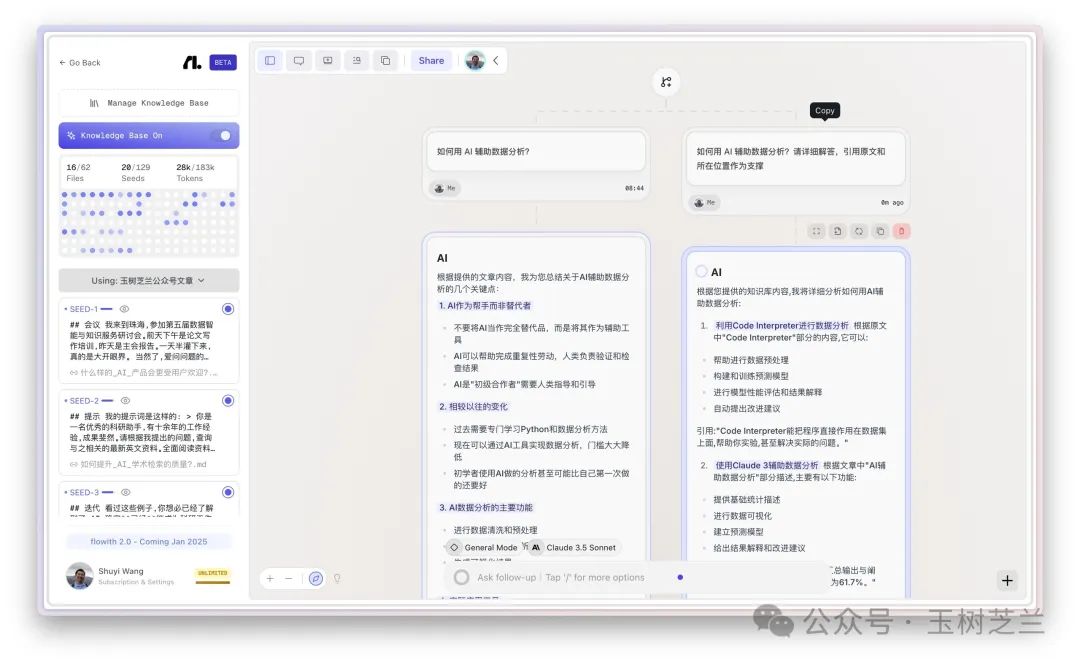

我这里的设定是使用普通模式(其他模式包括绘图、视频制作、在线检索、提示词优化……)。选择用 Claude 3.5 Sonnet 作为大模型,然后注意只选择「《玉树芝兰》公众号文章」这一个知识库。

我提出的问题为:

如何用 AI 辅助数据分析?

这是 Flowith 给出的答案:

根据提供的文章内容,我为您总结关于 AI 辅助数据分析的几个关键点:

AI 作为帮手而非替代者

・ 不要将 AI 当作完全替代品,而是将其作为辅助工具

・ AI 可以帮助完成重复性劳动,人类负责验证和检查结果

・ AI 是 “初级合作者” 需要人类指导和引导

相较以往的变化

・ 过去需要专门学习 Python 和数据分析方法

・ 现在可以通过 AI 工具实现数据分析,门槛大大降低

・ 初学者使用 AI 做的分析甚至可能比自己第一次做的还要好

AI 数据分析的主要功能

・ 进行数据清洗和预处理

・ 自动选择合适的分析模型

・ 生成可视化结果

・ 自动检查错误并修正代码

实际应用工具

・ GPT-4 可以帮助建立和评估机器学习模型

・ Claude 等大语言模型可以进行数据分析和可视化

・ Open Interpreter 等工具可以辅助编程和数据处理

使用建议

・ 对 AI 结果要进行严格验证

・ 不要完全依赖 AI, 要保持独立思考

・ 要对 AI 的能力边界有清晰认识

・ 合理使用 AI 提高工作效率

文章指出,AI 带来的变革使得非专业人士也可以进行基础的数据分析工作,但同时也强调了人类在整个过程中的主导作用和判断力的重要性。

在页面左侧,你可以看到检索资料的来源。并且可以点击上面的显示按钮,把所有的原始信息展现出来。

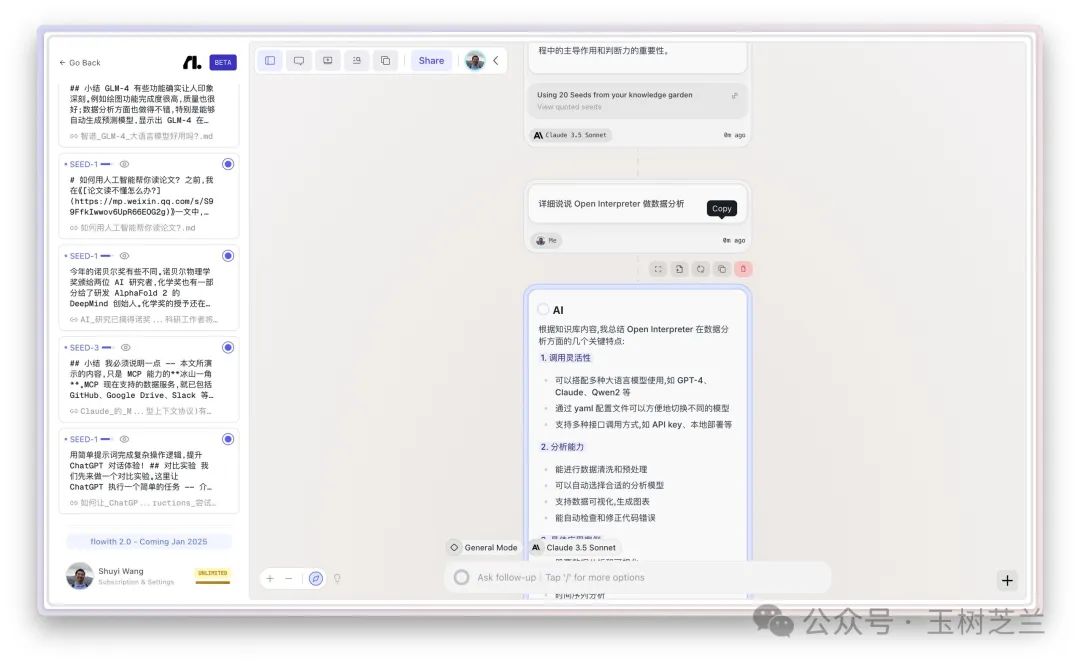

Flowith 最具特色的一个地方,是它可以进行「可视化」的追问,在画布上你可以明确看到问答之间的序列关系。

在上图中,你可以看到它延续着上面的问题进一步追问:

详细说说 Open Interpreter 做数据分析

此时 Flowith 接收到的上下文,不仅包括你的知识库,还包括上一个问题的答案。所以当你提到 Open Interpreter 的事儿的时候,它自动会把这个问题和前面所问的问题 —— 也就是数据分析 —— 结合,给你一个更为精准的答案。

这是执行的过程录像,我用 Screen Studio 的在线分享功能共享给你,点击链接即可直达:

https://screen.studio/share/I4yTequS

这是你最终获得的结果:

根据知识库内容,我总结 Open Interpreter 在数据分析方面的几个关键特点:

调用灵活性

・ 可以搭配多种大语言模型使用,如 GPT-4、Claude、Qwen2 等

・ 通过 yaml 配置文件可以方便地切换不同的模型

・ 支持多种接口调用方式,如 API key、本地部署等

分析能力

・ 能进行数据清洗和预处理

・ 可以自动选择合适的分析模型

・ 支持数据可视化,生成图表

・ 能自动检查和修正代码错误

具体应用案例

・ 股票数据分析和可视化

・ 词云图制作

・ 时间序列分析

・ 机器学习建模

优点

・ 交互性强,可以通过自然语言对话完成分析

・ 执行速度快,特别是搭配 Groq 等快速推理平台

・ 成本较低,尤其是使用开源模型如 Qwen2

局限性

・ 有时会过度分析,不知道在完成任务后及时停止

・ 某些复杂分析可能需要人工引导

・ 结果的准确性需要人工验证

总的来说,Open Interpreter 作为 AI 辅助数据分析工具,能大大降低数据分析的门槛,提高分析效率,但仍需要人类的指导和验证。

你可能会觉得,现在 Flowith 只能给你大纲式的回答,简洁但不够详细。但其实不是这样。这首先和我们调用的模型有关,Claude 3.5 Sonnet 就是喜欢简洁,这一点 在我们之前的文章中也介绍过。另一个重要原因是,我也没有给它更多的详细要求。

作为对比,我们现在就对着同样的知识库,以刚才的问题为基础,但在上面加上一些对细节的要求,看看会有什么不同。

在 Flowith 里面,除了序列追问,你还可以在画布上平行地提问。默认情况下,它会继续前面的问题,但如果你把鼠标点击画布的其他部分,它就会默认在那里新开一个问题。

这是我新的提示词:

如何用 AI 辅助数据分析?请详细解答,引用原文和所在位置作为支撑

这种左右分列的对比可以更为清晰地向我们展现:不同的提示词面对同样的上下文,会有什么样的结果上的区别。

这是新的执行结果:

根据您提供的知识库内容,我将详细分析如何用 AI 辅助数据分析:

利用 Code Interpreter 进行数据分析

根据原文中 “Code Interpreter” 部分的内容,它可以:

・ 帮助进行数据预处理

・ 构建和训练预测模型

・ 进行模型性能评估和结果解释

・ 自动提出改进建议

引用:“Code Interpreter 能把程序直接作用在数据集上面,帮助你实验,甚至解决实际的问题。”

使用 Claude 3 辅助数据分析

根据文章中 “AI 辅助数据分析” 部分描述,主要有以下功能:

・ 提供基础统计描述

・ 进行数据可视化

・ 建立预测模型

・ 给出结果解释和改进建议

引用:“ChatGPT 自动进行了结果的汇总输出与阐释。该模型在测试数据集上的准确率为61.7%。”

多模型结合使用

原文提到可以结合不同模型的优势:

・ GPT-4 进行基础分析

・ Claude 3 进行高级分析和解释

・ Code Interpreter 执行具体代码

引用:“我们使用的是 Code Interpreter 加上 GPT-4, 它中规中矩地进行了数据预处理。”

自动化数据分析流程

根据原文,AI 可以:

・ 自动识别数据类型和结构

・ 进行探索性数据分析

・ 生成分析报告

・ 提供改进建议

引用:“它会自动进行模型选择,以便与具体的数据相匹配,遇到问题甚至还能自己来根据 log 检查错误并且改正源代码。”

注意事项

原文强调:

・ 要对 AI 结果进行验证

・ 人类要保持最终决策权

・ 避免过度依赖 AI

引用:“AI 开始认真干起来了不是?… 准确率高吗?我觉得谈不上。但是这是一个非常有意思的开端”

这些方法需要根据具体场景和需求灵活运用,AI 更多是作为辅助工具而不是完全替代人工分析。

这是执行过程的完整录像:

https://screen.studio/share/zQNiP1Nr

可以看到,基础提示词相同的情况下,这次强化后提示词的结果感觉比第一次的可用性更强,因为它更加聚焦在我们实际感兴趣的问题上。尤其是因为我们要求引用原文,所以感觉答案更加聚焦、更加详细。

下面我们进一步就 Open Interpreter 来继续提问,依然是把刚才要求详细说明原文及位置的提示词增补进去。

提示词为:

详细说说 Open Interpreter 做数据分析。请详细解答,引用原文和所在位置作为支撑

下面是 Flowith 的答案:

基于您提供的知识库内容,我将详细分析 Open Interpreter 如何进行数据分析:

基本功能和优势

・ 可以进行全流程数据分析:从数据预处理到建模、可视化

・ 支持多种模型调用:GPT-4, Haiku, Llama 3 等

・ 执行环境灵活:支持本地运行和云端调用

引用:“Open Interpreter 可以结合 GPT-4, Haiku,以及 Groq 下面的 Llama 3 70B 帮助我们进行数据分析与可视化。”

数据分析实例

・ 股票数据分析

能够自动完成数据获取、处理和可视化:

引用:“我让它展示 2024 年 1 月 1 日到 4 月 19 日特斯拉和苹果股票的价格变化,它思考片刻后开始执行。”

・ 文本分析与可视化

能进行词云分析等:

引用:“下面我们来看看如何绘制词云。我在这里使用了一篇简短的分季介绍老友记(Friends)的文章。”

模型选择与成本优化

・ 可以根据需求选择不同规模的模型

・ 本地小模型 (如 Llama 3 8B) 适合简单任务

・ 大模型 (如 Llama 3 70B) 适合复杂分析

引用:“那么这个本地的小模型 Llama 3 8B 行不行呢?测试一下呗。”

自我优化能力

当分析出现问题时,可以自我改进:

引用:“虽然一开始就出错了,但它很快自我更新,之后的输出就显得靠谱了。没有人工干预,它自己就完成了编程输出。”

存在的局限性

主要问题包括:

・ 有时会过度执行

・ 稳定性需要提升

・ 输出质量依赖模型大小

引用:“只不过在利用 Llama 3 8B + Open Interpreter 执行数据分析过程中,你仍然会遇到一些障碍。例如有时候明明它已经完成了任务,却依然还在执着地尝试着重新编程执行。”

这些分析表明,Open Interpreter 是一个强大的数据分析工具,尤其适合非专业人士进行数据分析工作,但在使用时需要注意其局限性,选择合适的模型来完成特定任务。

执行过程完整录像地址为:

https://screen.studio/share/g4d9wZba

可见,添加来源引用,要求详细输出后,内容确实更加翔实。

不过,公众号毕竟只是我文章总集的一部分。下面咱们来尝试添加另外的知识库,进行综合检索。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)