不只是DeepSeek-V3和Kimi K2!八大LLM架构同台竞技,这场PK太硬核!

本文深度剖析2025年八大主流LLM架构的技术演进,重点关注DeepSeek-V3/R1、OLMo2、Gemma3等模型的核心创新。文章对比了多头潜在注意力(MLA)与分组查询注意力(GQA)的优劣,解析了专家混合机制(MoE)的高效实现,并探讨了滑动窗口注意力、QK-Norm等关键技术对模型性能的影响。通过架构对比图呈现各模型在归一化层设计、参数量级和推理效率等方面的差异,揭示LLM发展正呈现两

🔥八大主流LLM 架构深度剖析:技术演进背后的核心逻辑

自从最初的 GPT 架构被开发出来以来,已经过去七年了。乍一看,从 GPT-2(2019)回顾到 DeepSeek-V3 和 Llama 4(2024-2025),你可能会惊讶于这些模型在结构上仍然是如此相似。

当然,位置嵌入已经从绝对式演化为旋转式(RoPE),多头注意力(Multi-Head Attention)大多被分组查询注意力(Grouped-Query Attention)所取代,而更高效的 SwiGLU 激活函数也替代了像 GELU 这样的函数。但在这些小的改进之下,我们是否真的看到了突破性的变化?还是仅仅在对同样的架构基础进行“打磨”?

比较 LLM 以确定其性能优劣的关键因素是出了名的困难:数据集、训练技术以及超参数的差异巨大,并且通常记录不详。

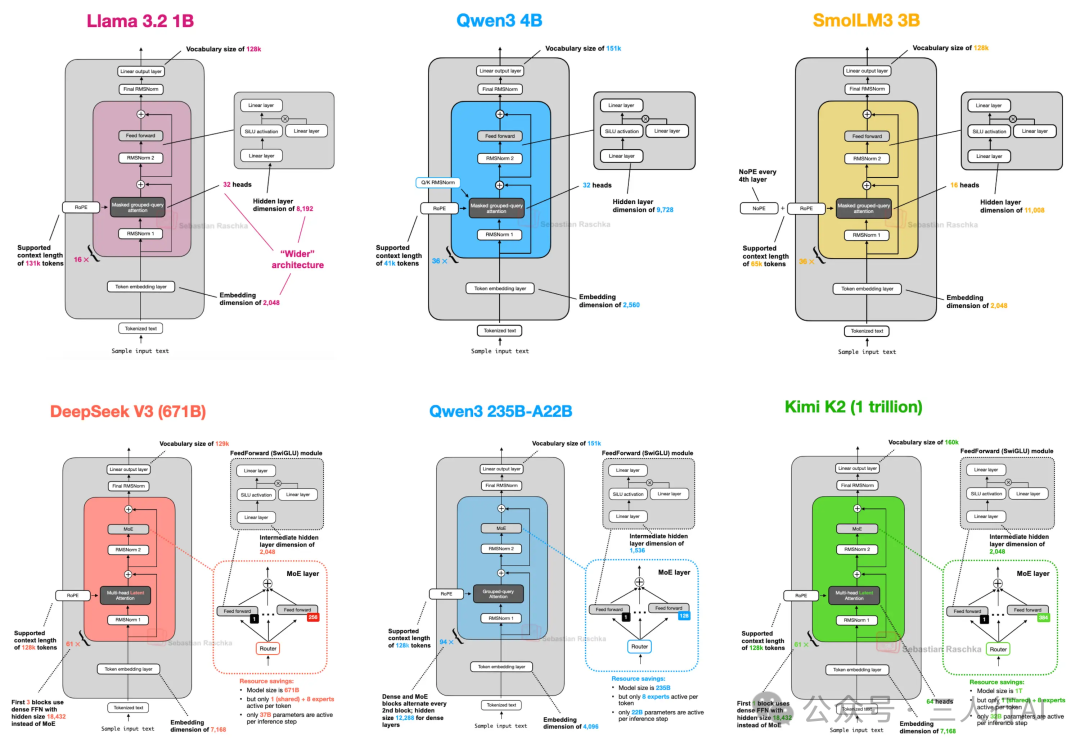

不过,我认为仅仅研究这些模型在架构上的结构性变化,依然很有价值——特别是观察 2025 年的 LLM 开发者到底在做什么。(下图中的部分架构就是本文所涵盖的内容。)

图1:本文涵盖的一部分架构示意图。

因此,在这篇文章中,我不会讨论基准测试性能或训练算法,而是将重点放在定义当今旗舰开源模型的架构演进上。

目录

1.DeepSeek V3/R1 - 理解推理型大模型[1]

1.1 多头潜在注意力(MLA)[2]

1.2 专家混合机制(MoE)[3]

1.3 DeepSeek 总结[4]2.OLMo 2[5]

2.1 归一化层的位置设计[6]

2.2 QK-Norm 技术[7]

2.3 OLMo 2 总结[8]3.Gemma 3[9]

3.1 滑动窗口注意力(Sliding Window Attention)[10]

3.2 归一化层设计在 Gemma 3 中的应用[11]

3.3 Gemma 3 总结[12]

3.4 特别版本:Gemma 3n[13]4.Mistral Small 3.1[14]5.Llama 4[15]6.Qwen3[16]

6.1 Qwen3 稠密模型(Dense)[17]

6.2 Qwen3 稀疏模型(MoE)[18]7.SmolLM3[19]

7.1 无位置编码(NoPE)[20]8.Kimi 2[21]

💡提示:这是一篇内容相当全面的文章,建议使用导航栏访问目录。

1. DeepSeek V3/R1

正如你可能已经多次听说的那样,DeepSeek R1 自 2025 年 1 月发布以来就产生了重大影响。DeepSeek R1 是一个构建在 DeepSeek V3 架构 之上的推理模型,而 DeepSeek V3 最初是在 2024 年 12 月发布的。

尽管本文主要关注的是 2025 年发布的架构,但我认为将 DeepSeek V3 纳入讨论也是合理的,因为它真正获得广泛关注和应用是在 2025 年 DeepSeek R1 推出之后。

在本节中,我将重点介绍 DeepSeek V3 引入的两个关键架构技术,这些技术提升了其计算效率,并使其与许多其他 LLM 区分开来:

•多头潜在注意力(Multi-Head Latent Attention, MLA)•专家混合机制(Mixture-of-Experts, MoE)

1.1 多头潜在注意力(MLA)

在深入讨论 MLA 之前,让我们简要回顾一下背景,以了解为何要使用这一机制。为此,我们从近年来被广泛采用、取代传统多头注意力(MHA)的 分组查询注意力(Grouped-Query Attention, GQA) 说起。

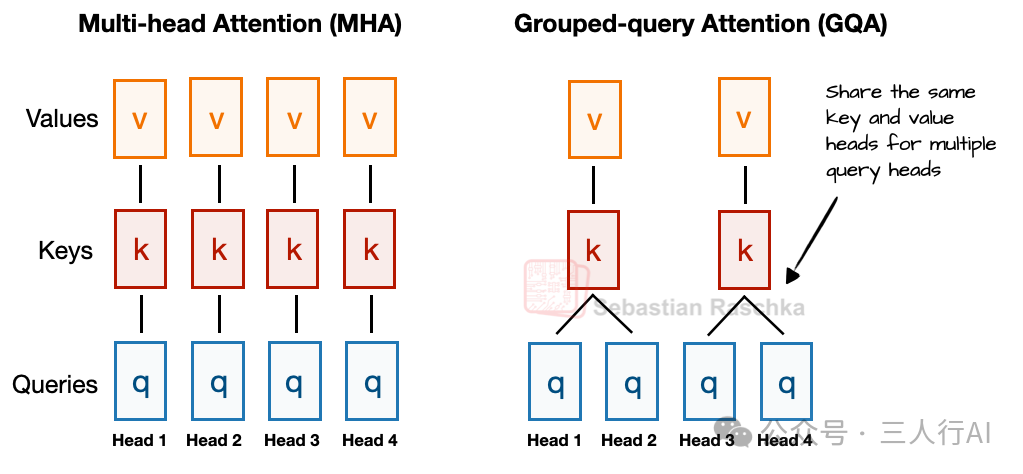

以下是关于 GQA 的简要说明:与 MHA 不同,MHA 中每个注意力头都有自己的一组键(Key)和值(Value),而 GQA 为了减少内存使用,将多个头分组,共享相同的键和值投影。

例如,正如下图 图2 所示,如果存在 2 个键值组和 4 个注意力头,那么第 1 和第 2 个头可能共享一组键和值,第 3 和第 4 个头共享另一组。这种方式减少了键和值的总计算量,从而降低了内存使用,并提升了计算效率(根据消融实验,这并不会明显影响模型性能)。

图2:MHA 与 GQA 的对比图

此处,分组大小为 2,即每两个查询头共享一组键值对。

因此,GQA 的核心思想 是通过多个查询头共享同一组键(Key)和值(Value)来减少键值头的数量。这样做有两个主要好处:

1.降低了模型的参数数量;2.在推理过程中减少了键和值张量在内存中的带宽使用,因为需要存储和读取的 KV 缓存更少。

(如果你对 GQA 在代码中的实现感兴趣,可以参考我的 GPT-2 到 Llama 3 的转换指南[22],其中包括不使用 KV 缓存的版本,以及带 KV 缓存的变体。)

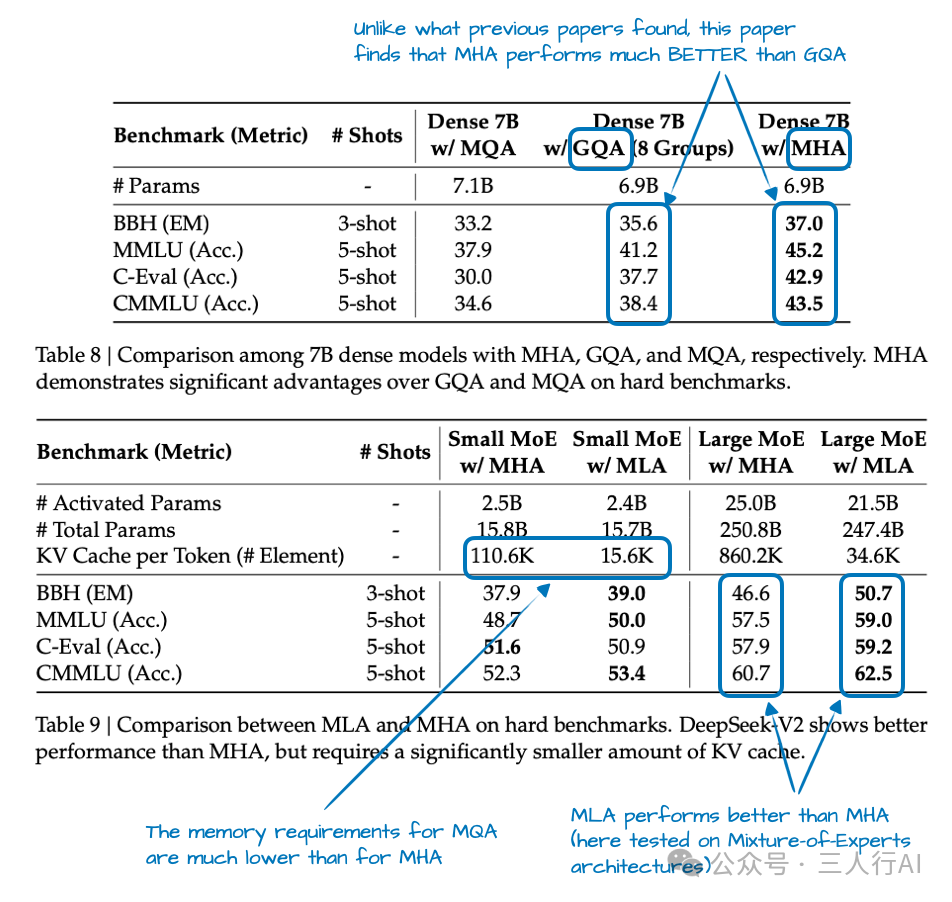

虽然 GQA 主要是一种提高计算效率的策略,用来替代 MHA,但多项消融实验(包括原始 GQA 论文[23]和 Llama 2 论文[24]中的实验)表明,在 LLM 建模性能方面,GQA 与标准 MHA 的表现相当。

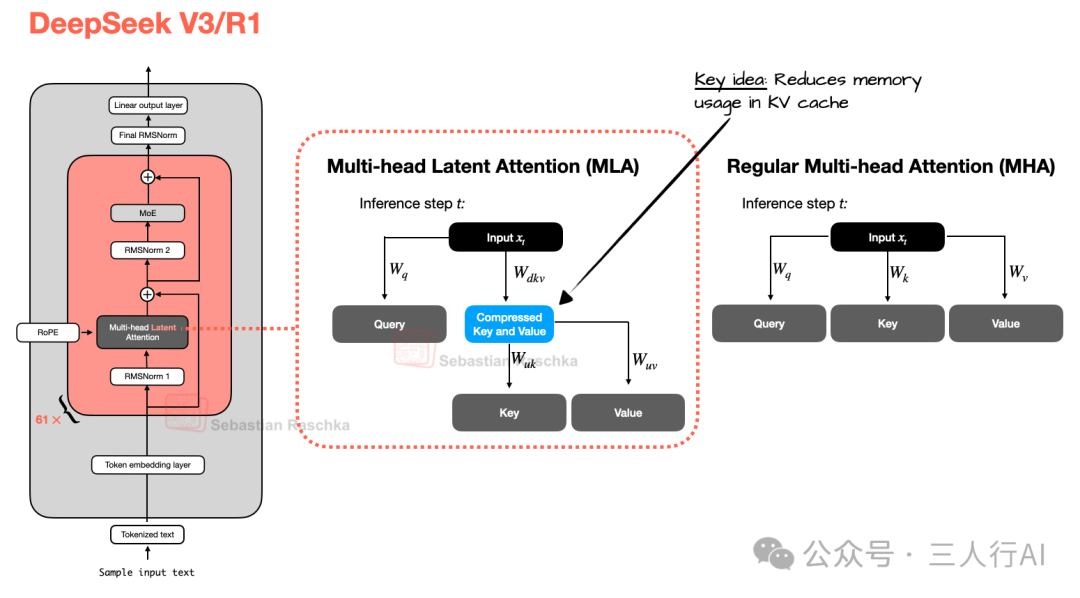

现在,多头潜在注意力(MLA) 提供了一种不同的内存节省策略,尤其适合与 KV 缓存搭配使用。与 GQA 不同的是,MLA 并不是共享键值头,而是先将键值张量压缩到一个更低维度的空间,再存入 KV 缓存。

在推理时,这些压缩后的张量会被再投影回原始维度后再参与计算,如下图 图3 所示。这虽然增加了一次矩阵乘法操作,但显著降低了内存使用。

图3:MLA(用于 DeepSeek V3 和 R1)与常规 MHA 的对比图 (顺带一提,查询张量在训练时也会被压缩,但在推理时不会。)

值得一提的是,MLA 并不是 DeepSeek V3 首创的,在其前代 DeepSeek V2 中也已经被使用(甚至首次提出)。此外,V2 的论文中包含一些有趣的消融实验,也许能解释为什么 DeepSeek 团队在 GQA 和 MLA 之间选择了后者(见下方图4)。

图4:来自 DeepSeek-V2 论文的标注实验表格, 论文地址:https://arxiv.org/abs/2405.04434

如图4所示,GQA 的性能似乎不如 MHA,而 MLA 则在建模性能上优于 MHA,这很可能就是 DeepSeek 团队最终选择 MLA 而非 GQA 的原因。(如果能看到 MLA 与 GQA 在“每个 Token 的 KV 缓存占用”方面的对比就更好了!)

小结:在进入下一个架构组件之前,回顾一下本节内容,MLA 是一种聪明的技巧,在节省 KV 缓存内存的同时,模型性能甚至还略微优于 MHA。

1.2 专家混合机制(Mixture-of-Experts, MoE)

DeepSeek 架构中另一个值得重点介绍的主要组件是其对 专家混合机制(MoE) 层的使用。虽然 MoE 并非由 DeepSeek 首创,但在今年(2025年)再次引起了广泛关注,接下来我们将要介绍的许多架构也都采用了这一机制。

你可能已经对 MoE 有所了解,但这里还是简要回顾一下它的核心思想。

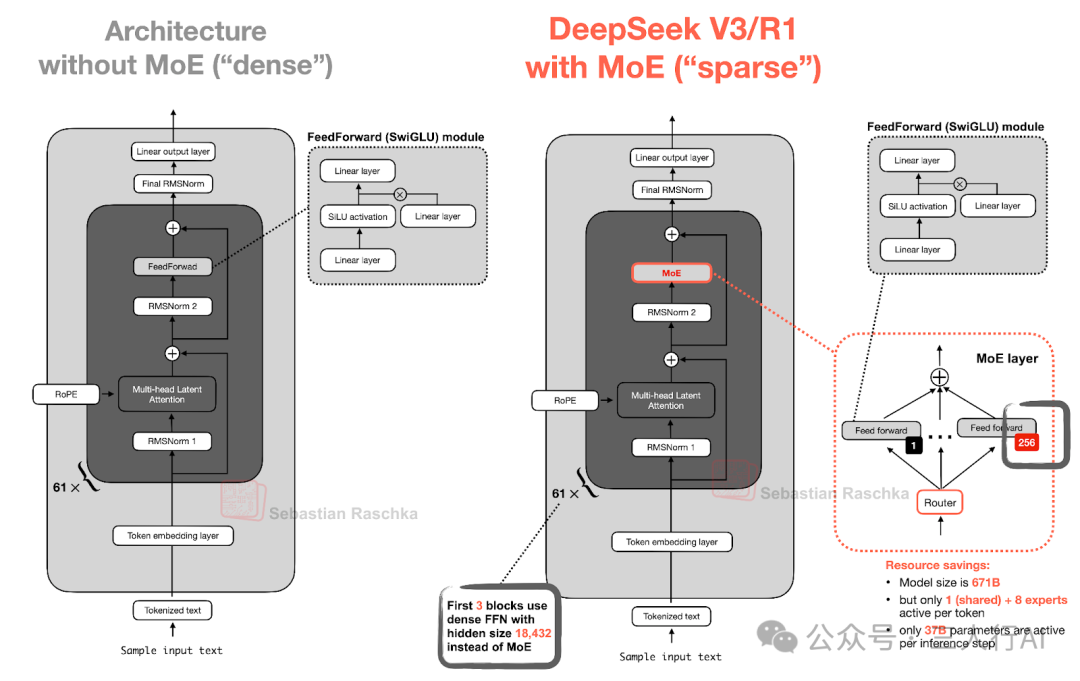

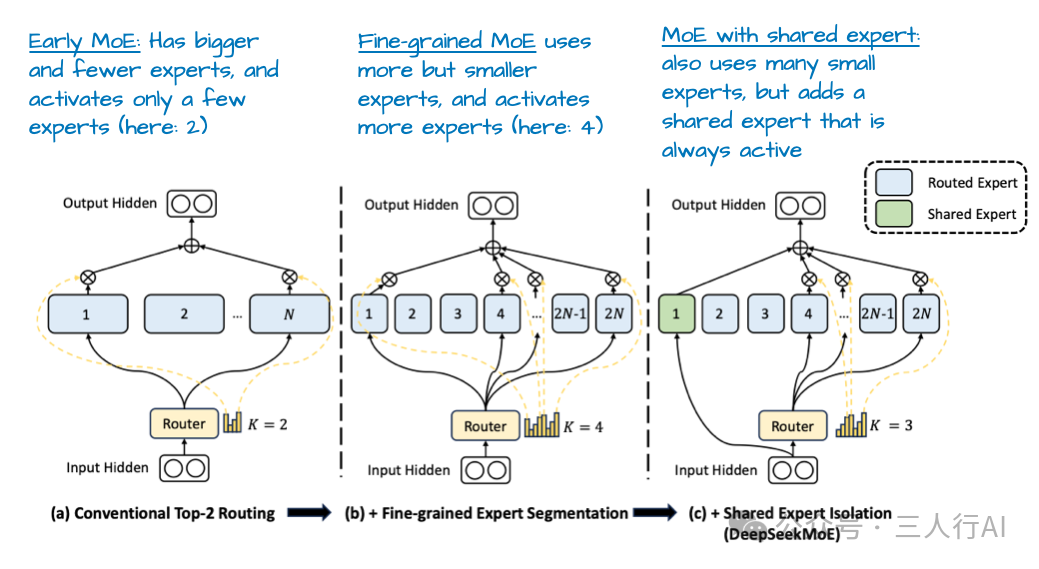

MoE 的关键在于:将 Transformer 块中的每个前馈神经网络(FeedForward)模块,替换为多个专家层(每个专家层本质上也是一个前馈模块)。也就是说,我们将原本的单个前馈模块换成了多个前馈模块,如下图 图5 所示。

图5:MoE 模块(右)与标准前馈模块(左)的结构对比图,来自 DeepSeek V3/R1

Transformer 块中的前馈模块(图中深灰色区域)通常占据模型总参数量中的很大一部分。(请注意,Transformer 块及其中的前馈模块会在整个模型中重复多次;以 DeepSeek-V3 为例,共重复 61 层。)

因此,用多个前馈模块替代单个模块(如 MoE 架构所做)会显著增加模型的总参数数量。但这里的关键是:我们不会对每个 token 激活所有专家层,而是由一个路由器(router)为每个 token 选择一个小子集的专家进行计算。(关于路由器的细节将在后续文章中详述。)

因为每次仅激活少量专家层,MoE 模块常被称为“稀疏”的(sparse),与总是使用所有参数的“致密”(dense)模块相对。尽管 MoE 的总参数量很大,但其稀疏性使得推理过程依旧高效——毕竟我们并不是每次都用到全部参数。

例如,DeepSeek-V3 每个 MoE 模块中包含 256 个专家,总参数量为 6710 亿。但在推理过程中,仅有 9 个专家被激活(其中 1 个是共享专家,另外 8 个由路由器选择)。这意味着每次推理仅使用约 370 亿参数,而不是全部 6710 亿。

DeepSeek-V3 的 MoE 架构有一个值得注意的设计:使用了一个共享专家(shared expert)。这个共享专家在每个 token 上始终被激活。这个思想并非首次提出,早在 2024 年的 DeepSeek MoE 论文以及 2022 年的 DeepSpeedMoE 论文中就已经引入。

图6:来自论文《DeepSeekMoE: Towards Ultimate Expert Specialization in Mixture-of-Experts Language Models》的图示(论文地址:https://arxiv.org/abs/2401.06066)

在 DeepSpeedMoE 论文中首次指出,共享专家的引入能有效提升建模性能。这可能是因为:常见或重复的模式不再需要由多个专家分别学习,从而释放出更多专家去专注学习更具专业性的模式。

1.3 DeepSeek 总结

总结一下,DeepSeek-V3 是一个拥有 6710 亿参数的超大规模模型,在发布时,其性能超越了其他开源权重模型,包括拥有 4050 亿参数的 Llama 3。尽管参数量更大,但得益于 Mixture-of-Experts(MoE)架构,它在推理阶段的效率却更高——每个 token 实际仅激活大约 370 亿参数。

另一个关键特征是:DeepSeek-V3 采用 Multi-Head Latent Attention(MLA)而非 Grouped-Query Attention(GQA)。MLA 和 GQA 都是比传统 Multi-Head Attention(MHA)更高效的推理机制,尤其是在使用 KV 缓存时。虽然 MLA 的实现更复杂,但根据 DeepSeek-V2 论文中的研究表明,其建模性能优于 GQA。

2. OLMo 2

由非营利组织 Allen Institute for AI 开发的 OLMo 模型系列因其训练数据与代码的透明性以及相对详尽的技术报告而受到关注。

虽然你可能不会在任何基准排行榜上看到 OLMo 模型的名字,但它们结构干净,而且更重要的是,由于其开放透明性,OLMo 是一个极佳的 LLM 开发范本。

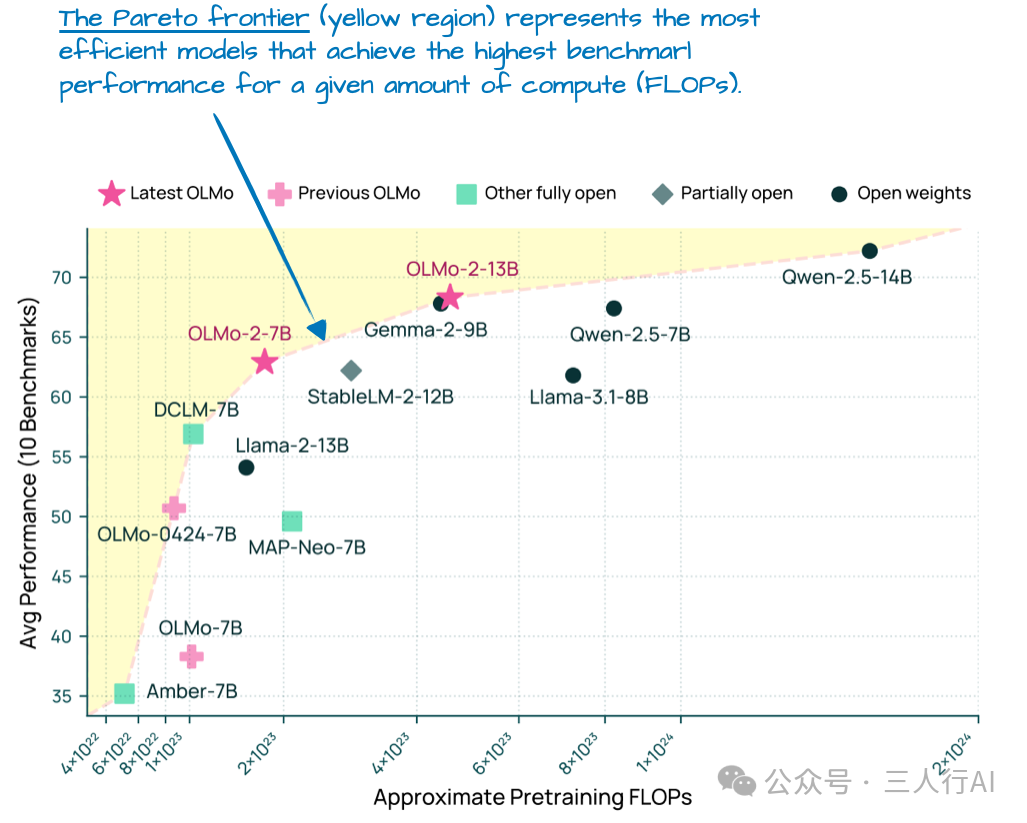

尽管 OLMo 主要因透明而受欢迎,但它本身的性能也不差。实际上,在 1 月发布时(即 Llama 4、Gemma 3 和 Qwen 3 发布之前),OLMo 2 处于性能与计算资源之间的帕累托前沿(Pareto frontier),如下图 图7 所示:

图7:不同 LLM 在建模性能(越高越好)与预训练计算成本(FLOPs,越低越好)之间的对比图 来源:OLMo 2 论文,https://arxiv.org/abs/2501.00656

正如本文前面提到的,我将专注于 LLM 的架构设计,不涉及训练或数据细节,以保持文章长度可控。那么,OLMo 2 在架构设计上有哪些有趣之处呢?主要体现在归一化层的设计与放置,包括 RMSNorm 的位置和引入 QK-Norm(将在下文详述)。

另一个值得注意的是:OLMo 2 仍然使用传统的 Multi-Head Attention(MHA),而非 MLA 或 GQA。

2.1 归一化层的放置(Normalization Layer Placement)

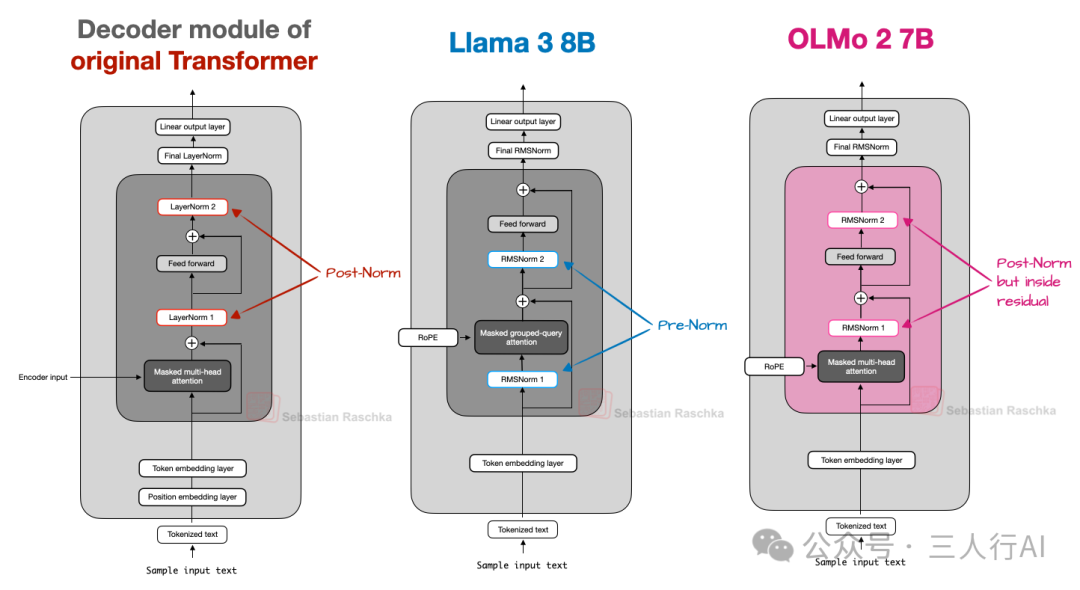

整体来看,OLMo 2 在架构上大体继承了原始 GPT 模型的结构,类似于其他主流 LLM。但它在某些方面做出了一些显著调整,我们从归一化层说起。

和 Llama、Gemma 以及大多数 LLM 一样,OLMo 2 将 LayerNorm 替换为 RMSNorm。

由于 RMSNorm 本质上是 LayerNorm 的简化版,且可训练参数更少,因此本文不再赘述两者差异。(感兴趣的读者可在我编写的 GPT-2 到 Llama 转换指南中找到 RMSNorm 的代码实现。)

不过,值得深入探讨的是 RMSNorm 的放置位置。在最初的 Transformer 论文《Attention is All You Need》中,两个归一化层分别被放在注意力模块和前馈模块之后,这种方式称为 Post-LN 或 Post-Norm。

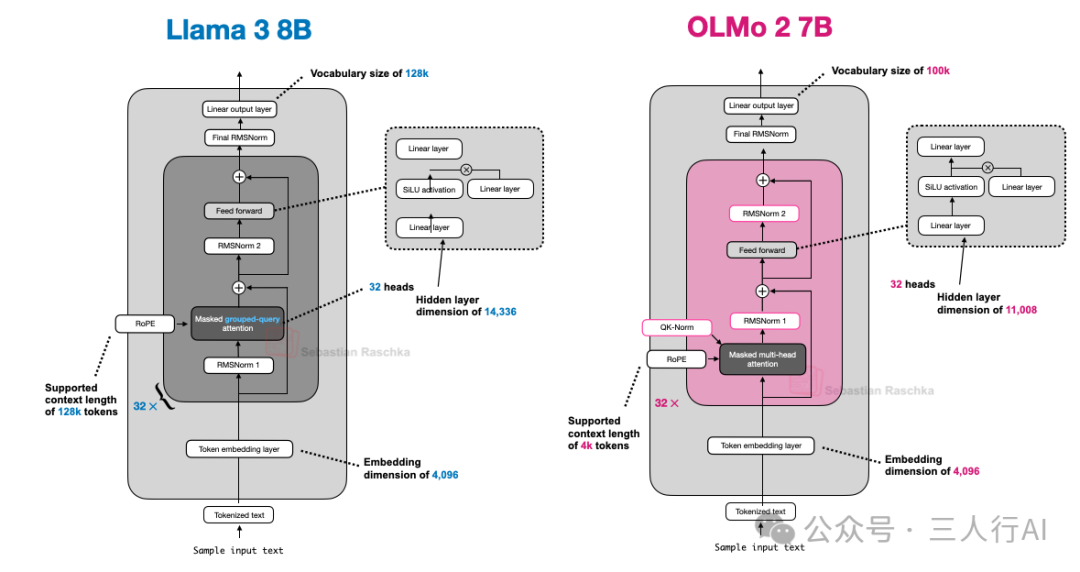

而 GPT 及其后的大多数 LLM 则将归一化层放在注意力模块和前馈模块之前,称为 Pre-LN 或 Pre-Norm。如下图 图8 所示:

图8:Post-Norm、Pre-Norm 以及 OLMo 2 的 Post-Norm 变体的对比图

在 2020 年,Xiong 等人发现:Pre-LN 可在模型初始化时产生更稳定的梯度,并指出 Pre-LN 即使在缺乏学习率预热(对 Post-LN 至关重要)的情况下也能很好工作。

这也正是我提到这个问题的原因 —— OLMo 2 采用了 Post-Norm 形式(使用 RMSNorm 而非 LayerNorm)。

在 OLMo 2 中,归一化层不是放在注意力和前馈模块之前,而是放在之后,如上图所示。但要注意,与原始 Transformer 架构不同的是,这些归一化层仍然被包含在残差连接(skip connection)中。

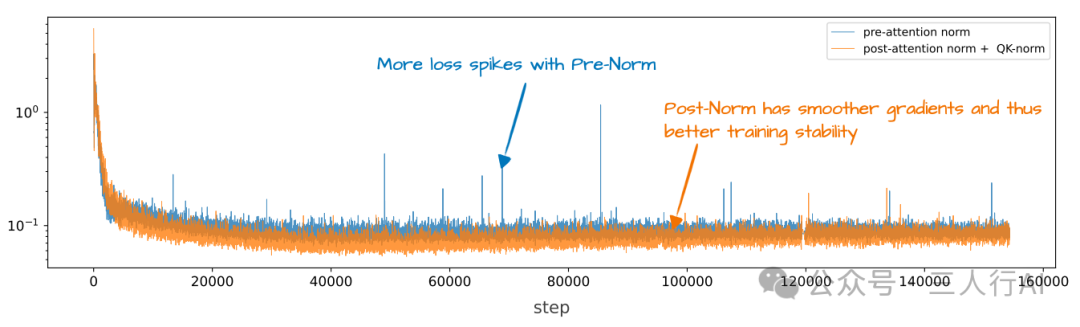

那为什么 OLMo 2 要调整归一化层的位置?主要是因为这样的放置方式在实验中表现出更好的训练稳定性,如下图 图9 所示:

图9:Pre-Norm(如 GPT-2、Llama 3)与 OLMo 2 Post-Norm 变体在训练稳定性上的对比

不幸的是,这张图同时包括了归一化层顺序调整和 QK-Norm 的效果,因此我们很难单独判断归一化层调整本身贡献了多少性能。

2.2 QK-Norm

由于上一节已经提到 QK-Norm,而我们稍后将要讨论的其他模型(如 Gemma 2 和 Gemma 3)也使用了 QK-Norm,这里我们就简要说明一下它的含义和作用。

QK-Norm 本质上是另一种 RMSNorm 层。它被放置在 Multi-Head Attention(MHA)模块内部,用于在应用 RoPE 之前,对查询(q)和键(k)进行归一化。为了说明这一点,下面是我在从零实现 Qwen3 时编写的一个 Grouped-Query Attention(GQA)层的片段(其中 QK-Norm 的应用方式与 OLMo 中的 MHA 类似):

classGroupedQueryAttention(nn.Module):def __init__(self, d_in, num_heads, num_kv_groups,head_dim=None, qk_norm=False, dtype=None):# ...if qk_norm:self.q_norm =RMSNorm(head_dim, eps=1e-6)self.k_norm =RMSNorm(head_dim, eps=1e-6)else:self.q_norm =self.k_norm =Nonedef forward(self, x, mask, cos, sin):b, num_tokens, _ = x.shape# Apply projectionsqueries =self.W_query(x)keys =self.W_key(x)values =self.W_value(x)# ...# Optional normalizationifself.q_norm:queries =self.q_norm(queries)ifself.k_norm:keys =self.k_norm(keys)# Apply RoPEqueries = apply_rope(queries, cos, sin)keys = apply_rope(keys, cos, sin)# Expand K and V to match number of headskeys = keys.repeat_interleave(self.group_size, dim=1)values = values.repeat_interleave(self.group_size, dim=1)# Attentionattn_scores = queries @ keys.transpose(2,3)# ...

如前所述,QK-Norm 与 Post-Norm 结合使用,有助于训练过程中的稳定性。需要指出的是,QK-Norm 并非 OLMo 2 首创,其最早可追溯到 2023 年的《Scaling Vision Transformers》论文。

🔍 总结:QK-Norm 是一种插入于注意力模块内部、针对 q 和 k 的归一化技术,尤其适用于带有 RoPE 的模型,有助于提升训练稳定性,且已被多个现代 LLM 架构采纳。

2.3 OLMo 2 总结

简而言之,OLMo 2 架构中最值得注意的设计决策主要体现在 RMSNorm 的放置:

•将 RMSNorm 放在注意力和前馈模块之后(即 Post-Norm 变体);•在注意力机制内部,为查询(Query)和键(Key)添加 RMSNorm(即 QK-Norm);

这两者结合使用,有助于稳定训练过程中的 loss 波动。

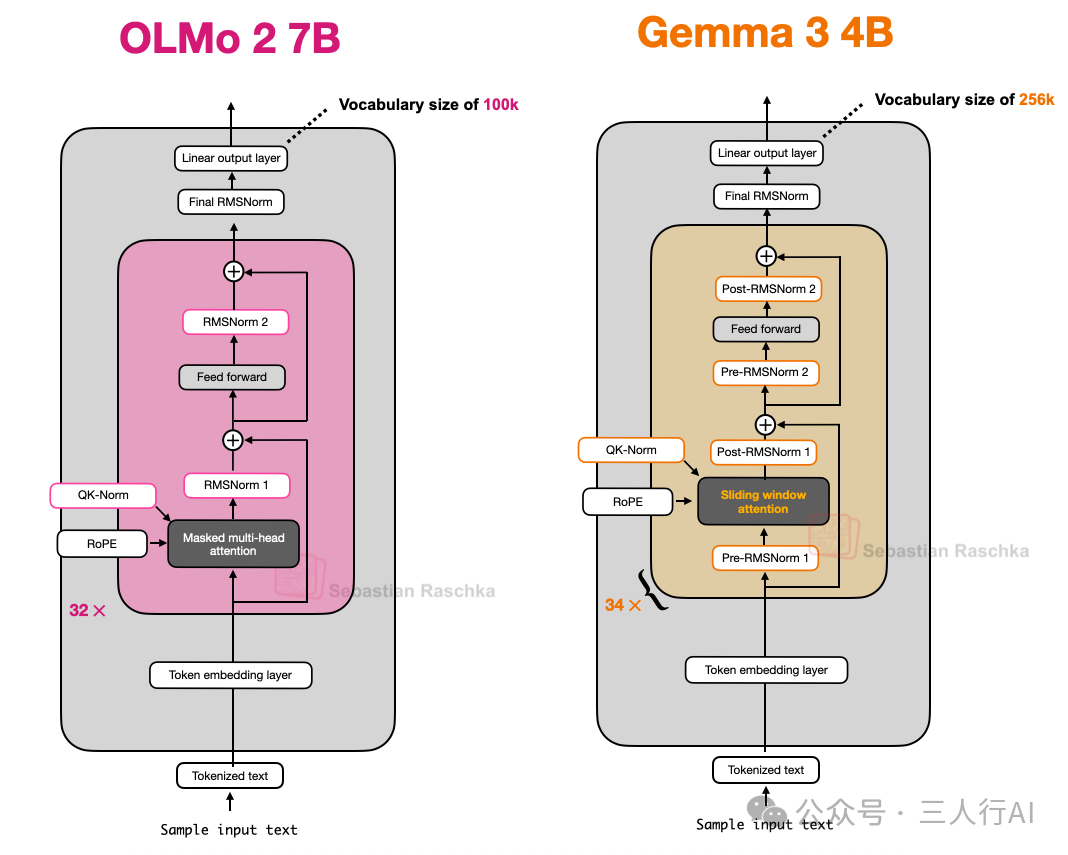

下面的图表对 OLMo 2 与 Llama 3 的架构进行了并列对比;如图所示,两者在架构上的差别其实并不大,唯一主要不同是 OLMo 2 仍然使用传统的 MHA,而非 GQA。 (不过,OLMo 2 团队在三个月后发布了一个使用 GQA 的 32B 版本。)

图10:Llama 3 与 OLMo 2 架构的对比图

3. Gemma 3

Google 推出的 Gemma 系列模型一直表现出色,但我认为它们在热度上总是略逊于如 Llama 系列等更火的模型。

Gemma 的一大特色是其相对较大的词汇表规模(更好地支持多语言),以及重点优化的 27B 模型规模(相比之下,其他模型常见于 8B 或 70B 规模)。当然,Gemma 2 也提供更小的版本:1B、4B 和 12B。

其中 27B 是一个很好的平衡点:它比 8B 更强大,但又不像 70B 那样资源密集,我甚至可以在 Mac Mini 上本地运行它。

那 Gemma 3 架构还有哪些亮点呢?

前面提到,像 DeepSeek-V3/R1 等模型使用 Mixture-of-Experts(MoE)架构来在保持模型规模不变的同时降低推理时的显存和计算成本(这一 MoE 方法在之后介绍的模型中也会出现)。

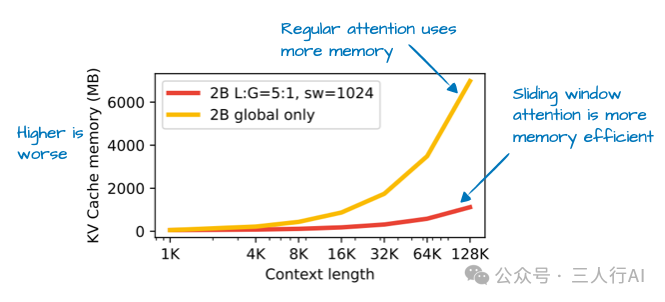

而 Gemma 3 使用的是另一种“技巧”来降低计算开销:滑动窗口注意力(Sliding Window Attention)。

3.1 滑动窗口注意力(Sliding Window Attention)

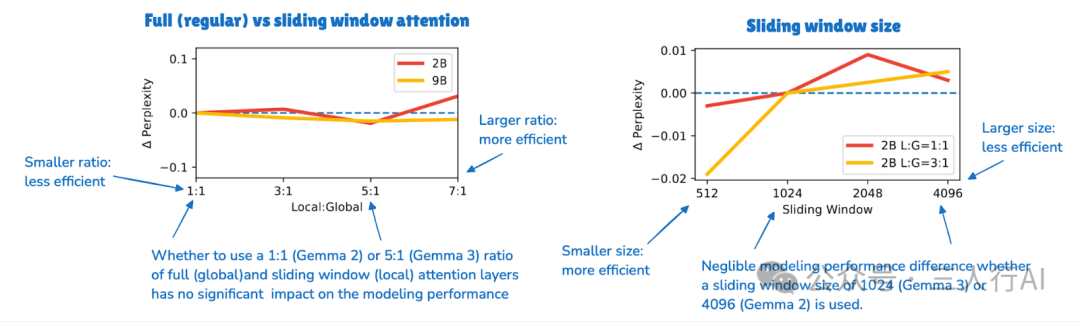

滑动窗口注意力最初由 2020 年的 LongFormer 论文提出,Gemma 2 中也曾使用。Gemma 3 团队通过滑动窗口注意力显著减少了 KV 缓存中的内存需求,如下图所示:

图11:来自 Gemma 3 论文(https://arxiv.org/abs/2503.19786)展示的滑动窗口注意力带来的 KV 缓存内存节省效果

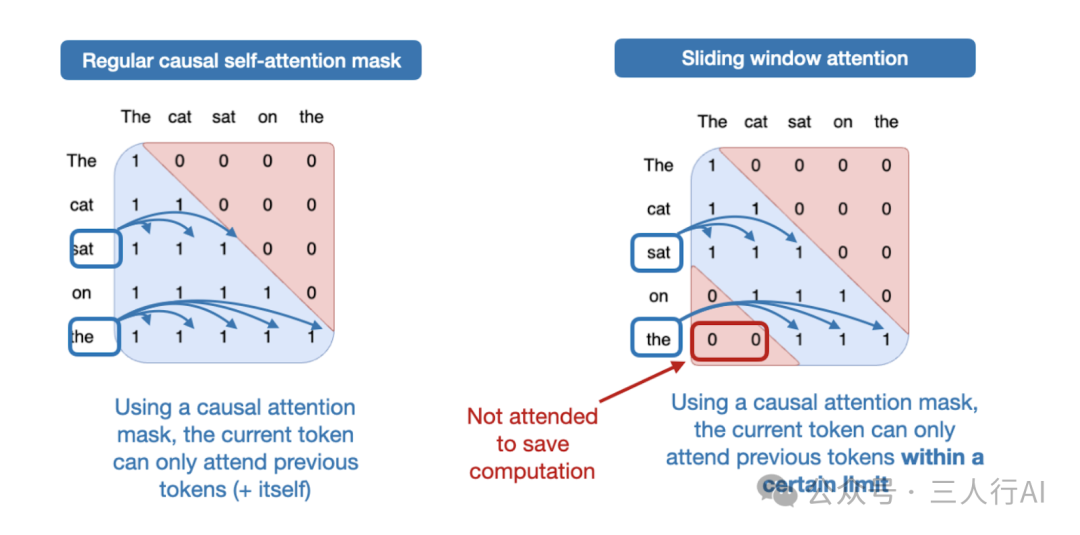

那么什么是滑动窗口注意力?

如果说标准自注意力是一种“全局注意力”(每个序列元素都可以关注任意其他元素),那么滑动窗口注意力就是一种局部注意力: 它限制了当前查询位置所能看到的上下文范围。如下图所示:

图12:标准注意力(左)与滑动窗口注意力(右)的对比图

请注意:滑动窗口注意力既可与 Multi-Head Attention(MHA)结合使用,也可与 Grouped-Query Attention(GQA)配合使用。Gemma 3 使用的是 GQA。

如上所述,滑动窗口注意力也被称为“局部注意力”,因为其注意力窗口围绕当前查询位置滑动。而标准注意力则是全局的,任何 token 都可以访问其他所有 token。

事实上,Gemma 2 架构也使用过滑动窗口注意力。但 Gemma 3 的不同之处在于调整了“全局注意力”和“局部注意力”的比例。

例如:

•Gemma 2 采用的是 1:1 的混合机制:每个 token 可以关注一个 4k-token 的滑动窗口,且每层交替使用全局和局部注意力;•而 Gemma 3 将比例调整为 5:1:即每 5 层滑动窗口注意力(局部),才会插入 1 层全局注意力;•此外,滑动窗口的大小也从 Gemma 2 的 4096 缩小到了 Gemma 3 的 1024。

这意味着模型更倾向于执行高效的局部计算。

根据团队的消融实验研究,滑动窗口注意力对建模性能影响非常小,如下图所示:

图13:来自 Gemma 3 论文的注释图(链接[25]),显示滑动窗口注意力对模型生成的困惑度(perplexity)几乎没有影响。

虽然滑动窗口注意力是 Gemma 3 最显著的架构亮点,但我也想简要介绍一下归一化层的位置设计,作为前面 OLMo 2 部分的补充说明。

3.2 Gemma 3 中的归一化层设计

一个细微但有趣的点是:Gemma 3 在其 Grouped-Query Attention 模块前后都使用了 RMSNorm,即同时采用了 Pre-Norm 和 Post-Norm。

这种设计类似于 Gemma 2,但依然值得特别指出,因为它与以下几种常见归一化策略不同:

1.原始 Transformer 架构("Attention is All You Need")中的 Post-Norm;2.GPT-2 及之后许多模型中流行的 Pre-Norm;3.我们之前介绍的 OLMo 2 中的 Post-Norm 变体。

图14:OLMo 2 与 Gemma 3 架构对比图,注意 Gemma 3 中新增的归一化层。

我认为 Gemma 3 这种 Pre + Post 的归一化层设计是一个相对直观、折中的方式,兼顾了两者的优点。多一点归一化通常没有坏处;最糟糕的情况也只是增加了一点冗余计算。但从实际来看,由于 RMSNorm 本身计算代价很小,这对模型推理效率几乎没有显著影响。

3.3 Gemma 3 总结

Gemma 3 是一款性能优异的开源权重 LLM,但在开源圈中似乎还未获得应有的关注。其最大亮点是采用滑动窗口注意力以提升效率(未来若能与 MoE 结合,效果可能更佳)。

此外,Gemma 3 还采用了一种独特的归一化层布置方式——在注意力和前馈模块前后都加上 RMSNorm。

3.4 加餐:Gemma 3n

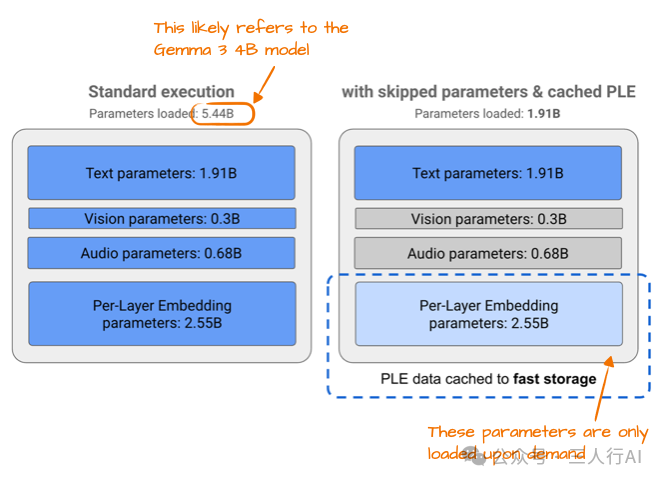

在 Gemma 3 发布几个月后,Google 推出了 Gemma 3n,这是专为移动设备优化的小模型版本,目标是能在手机上运行。

为了实现更高效率,Gemma 3n 引入了一项名为 逐层嵌入(Per-Layer Embedding, PLE) 的机制。核心思路是:仅将部分模型参数保留在 GPU 中,而与 token 类型相关的嵌入(如文本、音频、视觉等)则按需从 CPU 或 SSD 中流式加载。

如下图所示,PLE 能带来显著的显存节省。图中列出的是一个标准 Gemma 3 模型的 54.4 亿参数,可能对应的是 Gemma 3 的 4B 版本。

图15:来自 Google 官方博客(链接[26])的注释图,展示了 PLE 带来的显存节省。

值得注意的是,Google 在参数统计上有时会排除嵌入参数以“显得模型更小”,但在需要展示节省效果时又会包含它们。这种做法在行业内已较为常见,不仅限于 Google。

另一个有趣的设计是 MatFormer(Matryoshka Transformer)概念。Gemma 3n 使用的是一个可裁切的共享 LLM 架构,每一段都能独立训练与运行,推理时只需加载所需部分,而不是整个大模型。

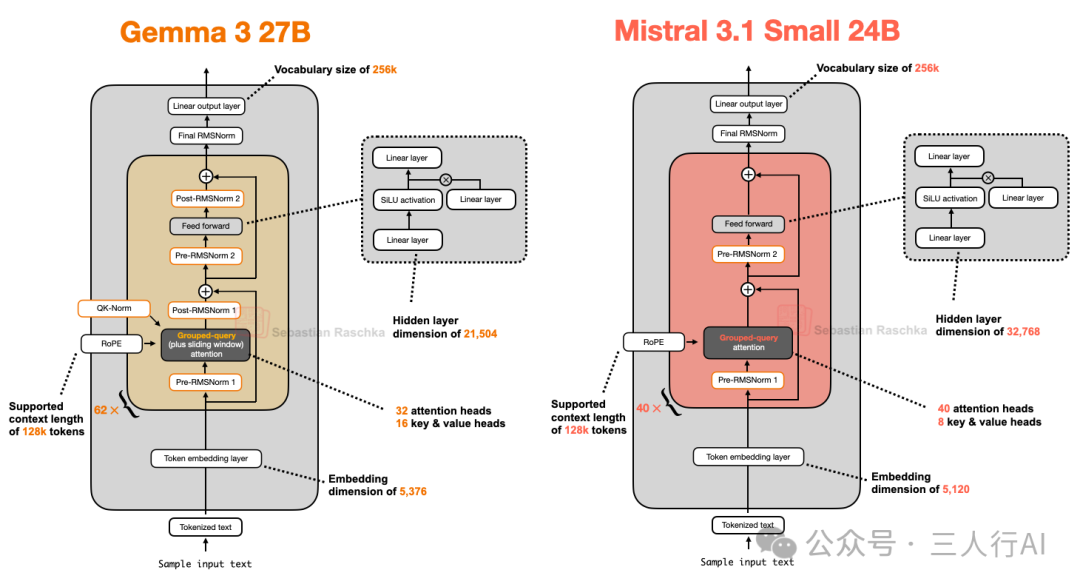

4. Mistral Small 3.1

Mistral Small 3.1(24B)于 2025 年 3 月发布,紧随 Gemma 3 之后,以其在多个基准测试中优于 Gemma 3(27B)而闻名(数学任务除外),且推理速度更快。

相比 Gemma 3,Mistral Small 3.1 拥有更低的推理延迟,这主要得益于以下两点:

•使用了自定义 tokenizer;•缩小了 KV 缓存大小 和 网络层数。

除此之外,其架构仍是较为标准的 Transformer 结构,如下图所示。

图16:Gemma 3(27B)与 Mistral Small 3.1(24B)架构对比图

有趣的是,早期的 Mistral 模型其实也曾使用 滑动窗口注意力(Sliding Window Attention),但在 Mistral Small 3.1 中似乎已经放弃了这种机制。

因此,Mistral Small 3.1 使用的是常规的 Grouped-Query Attention(GQA),而不像 Gemma 3 那样结合滑动窗口机制。这一变化可能意味着它能够利用更加高效的底层实现,例如 FlashAttention,从而在推理时节省更多计算资源。

比如我推测,滑动窗口注意力虽然可以降低内存占用,但它未必能减少推理延迟,而这正是 Mistral Small 3.1 所追求的优化目标。

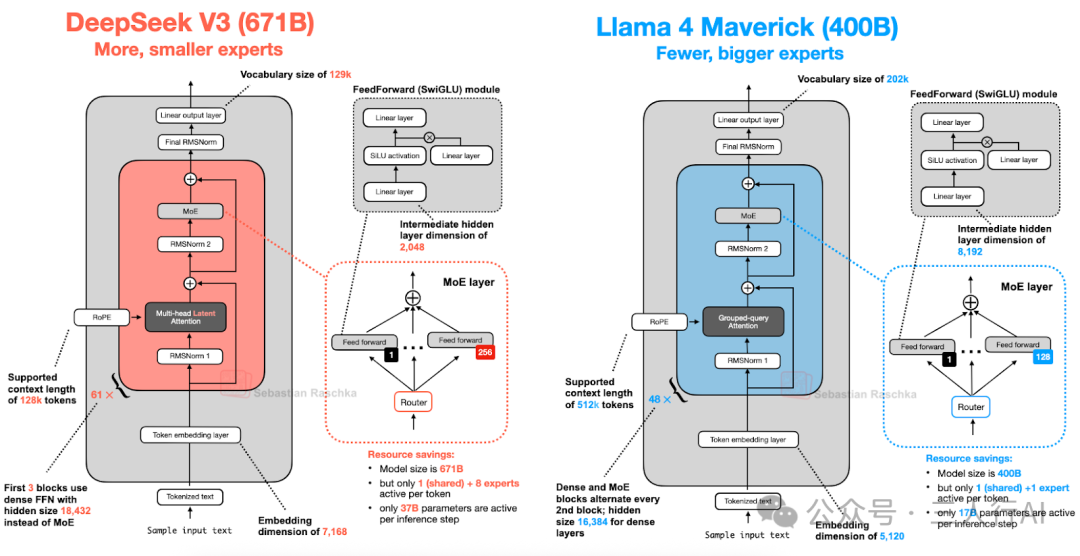

5. Llama 4

本篇文章前面花了不少篇幅介绍 Mixture-of-Experts(MoE),现在终于再次派上用场了 —— 因为 Llama 4 也采用了 MoE 架构,其余部分大体仍沿用了类似 DeepSeek-V3 的标准设计。如下图所示:

图17:DeepSeek V3(6710 亿参数)与 Llama 4 Maverick(4000 亿参数)架构对比图

(注:Llama 4 具备原生多模态支持,与 Gemma 和 Mistral 类似。但本文聚焦语言建模,因此仅讨论文本模型部分。)

虽然 Llama 4 Maverick 架构整体上看起来和 DeepSeek-V3 非常相似,但也存在一些值得注意的差异:

1.注意力机制不同•Llama 4 延续了前代模型,使用 Grouped-Query Attention(GQA);•而 DeepSeek-V3 使用的是我们在本文开头讲过的 Multi-Head Latent Attention(MLA)。2.模型规模对比•DeepSeek-V3 参数总量比 Llama 4 大约多 68%;•但更重要的是,DeepSeek-V3 每步推理使用的激活参数为 370 亿,而 Llama 4 Maverick 仅为 170 亿 —— 后者大约只用了前者的一半不到。3.MoE 架构方式不同•Llama 4 Maverick 使用的是更“传统”的 MoE 设置:2 个激活专家,每个隐藏层大小为 8192;•DeepSeek-V3 则采用 9 个激活专家,每个隐藏层大小为 2048;•此外,DeepSeek-V3 在除了前 3 层外的所有 Transformer 层都使用了 MoE;•而 Llama 4 则是 MoE 与 Dense 模块交替出现,即每隔一层才用一次 MoE。

🔍 总结要点: 尽管 Llama 4 和 DeepSeek-V3 架构类似,但在注意力机制、MoE 配置和激活参数量等方面均存在差异。

但最重要的结论是:2025 年,MoE 架构在 LLM 中的采用率大幅上升,成为主流趋势之一。

6. Qwen3

Qwen 团队一直以来都发布了高质量的开源权重 LLM 模型。 当我参与协助 NeurIPS 2023 的 LLM 效率挑战时,我记得当时所有的获胜解决方案都是基于 Qwen2 构建的。

如今,Qwen3 系列又一次成为多个模型尺寸类别的榜单常客,表现出色。

它包括 7 个稠密(Dense)模型:0.6B、1.7B、4B、8B、14B 和 32B;

以及 2 个 MoE(稀疏)模型:30B-A3B 和 235B-A22B。

💡 顺带一提,名字中 “Qwen3” 的拼写没有空格并非笔误,这是我在尊重 Qwen 官方开发者的命名方式。

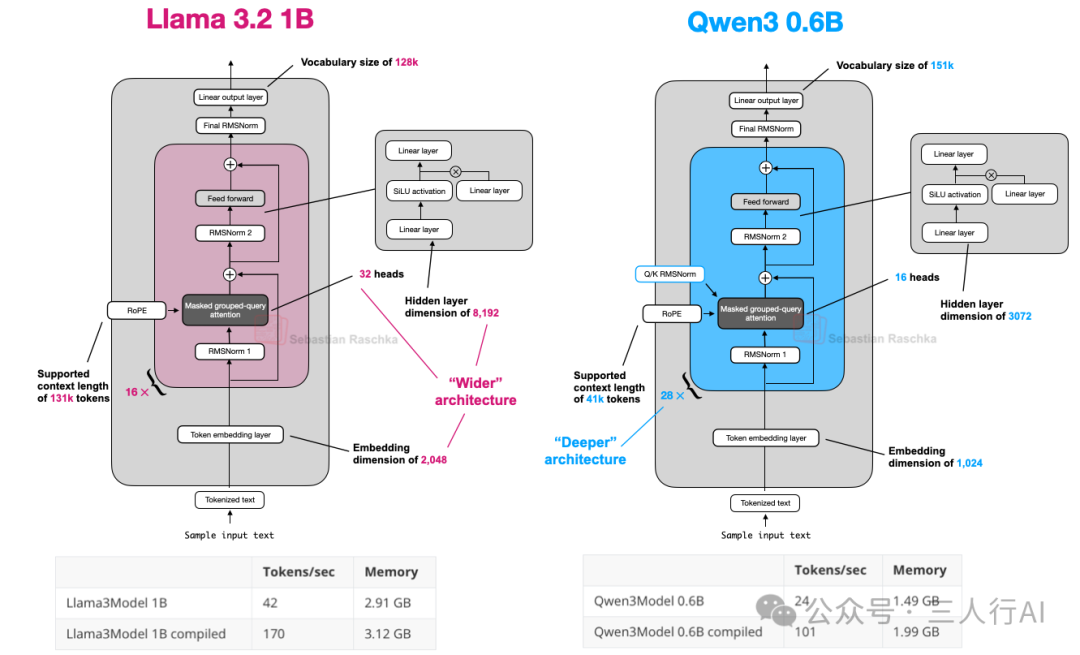

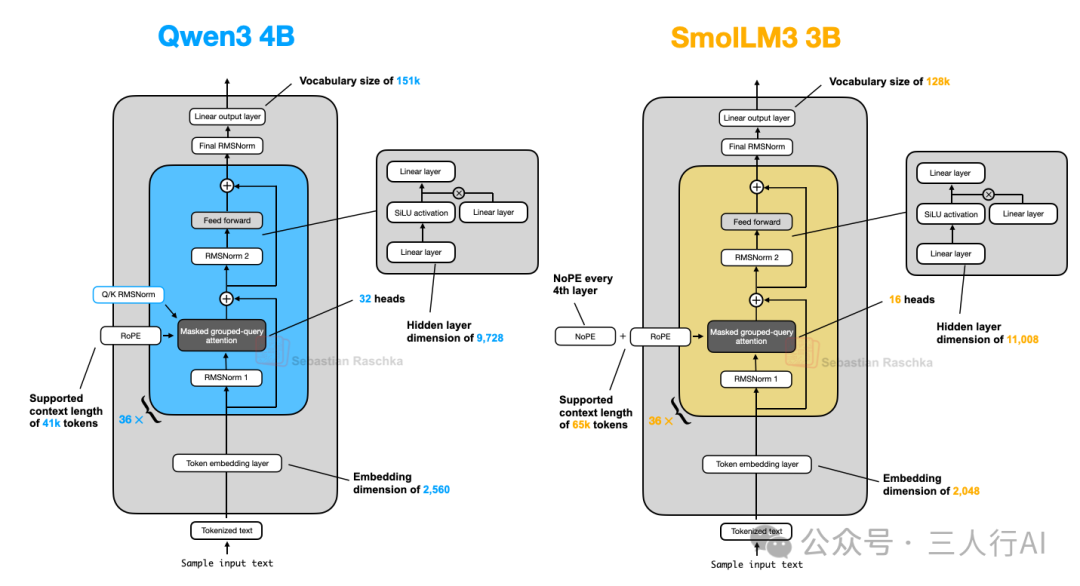

6.1 Qwen3(稠密版 Dense)

我们先来讨论 Qwen3 的稠密模型架构。

截至本文撰写时,Qwen3 0.6B 可能是当前世代中最小的开源权重模型之一。 根据我的亲身测试,它在小体积下依然表现优秀。

•在 Token/sec 吞吐量 上非常高效;•占用 内存极低,适合本地运行;•另外,因为模型小巧,也很适合作为本地训练实验模型(用于教学目的)。

实际上,Qwen3 0.6B 已经在多数应用场景中取代了我原本使用的 Llama 3 1B。 两者的架构对比如下图所示:

图18:Qwen3 0.6B 与 Llama 3 1B 架构对比图

注意:Qwen3 架构更深,层数更多;而 Llama 3 更宽,注意力头更多。

如果你对易读的、无任何第三方 LLM 框架依赖的 Qwen3 实现感兴趣,我最近刚用纯 PyTorch 从零实现了 Qwen3。

图中的计算性能数据来源于该 PyTorch 实现在 A100 GPU 上的测试。

可以看到:

•Qwen3 占用显存更少,因为其总体架构更小;•同时,它使用 更小的隐藏层 和 更少的注意力头;•但它拥有更多的 Transformer 层,导致运行时速度较慢(即 Token/sec 较低)。

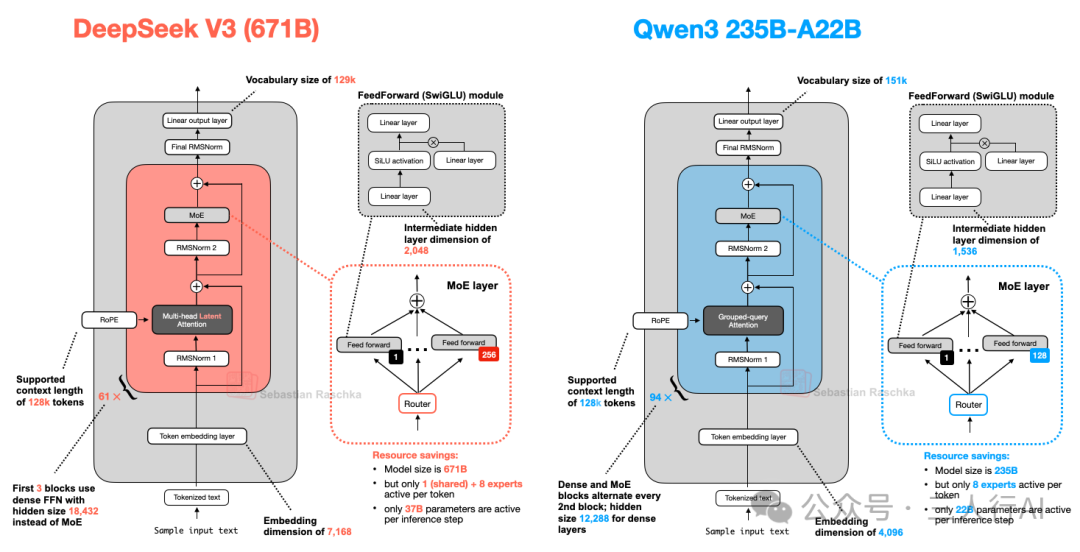

6.2 Qwen3(MoE 版本)

正如前面提到的,Qwen3 同时推出了两个 MoE(专家混合)模型:30B-A3B 与 235B-A22B。

那么为什么有些模型会同时提供 Dense 与 MoE 两种架构呢?

如文章开头所述,MoE 架构能帮助大型模型降低推理成本。 提供 Dense 和 MoE 两个版本,可以让用户根据不同场景和约束进行选择。

•Dense 模型 更易于:•微调(fine-tune);•部署;•在不同硬件平台上优化。•MoE 模型 则更适合大规模部署下的推理场景:

在固定推理预算下,可以通过更大的整体模型容量(更多参数)来提高训练时的知识吸收能力,但不会线性增加推理成本。

通过同时发布这两类模型,Qwen3 系列可以覆盖更广泛的应用需求:

•Dense:稳定性强、易微调、使用门槛低;•MoE:适用于推理资源敏感的大规模在线服务场景。

最后,我们来看看 Qwen3 235B-A22B 与 DeepSeek-V3 的对比:

•Qwen3 235B-A22B 的 “A22B” 指的是 激活参数为 220 亿;•而 DeepSeek-V3 的激活参数约为 370 亿,是 Qwen3 的近两倍。

图19:DeepSeek-V3 与 Qwen3 235B-A22B 的架构对比图

如上图所示,DeepSeek-V3 与 Qwen3 235B-A22B 的整体架构极其相似。 但值得注意的一点是:Qwen3 MoE 架构中取消了“共享专家(Shared Expert)”的设计,而早期的 Qwen 模型(例如 Qwen2.5-MoE)中还保留了该机制。

Qwen 团队并未说明为何移除共享专家。如果让我猜,可能是因为:

•在 Qwen3 中,将专家数量从 Qwen2.5 的 2 个增加到 8 个后,模型训练的稳定性已经足够;•所以他们就无需再启用额外的“+1”共享专家,从而节省了推理时的额外计算与显存开销。

不过这也无法解释为何 DeepSeek-V3 至今仍保留共享专家。

更新:Qwen3 的开发者 林俊阳(Junyang Lin) 回复如下:

“当时我们并未发现共享专家带来显著的提升,同时我们也担心其对推理优化造成影响。老实说,这个问题没有绝对的答案。”

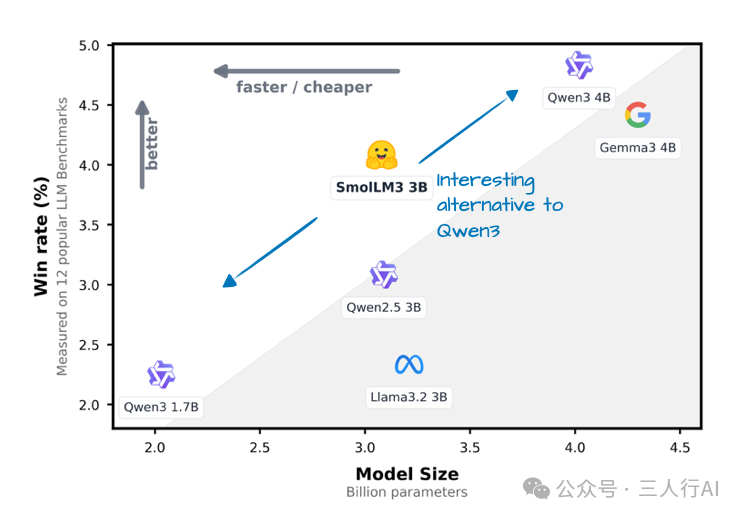

7. SmolLM3

SmolLM3 虽然不如前文提到的其他 LLM 那样热门,但我认为它依然值得介绍。

原因是:它在仅 30 亿参数规模下提供了相当出色的建模性能,处于 Qwen3 系列中 1.7B 与 4B 之间的“黄金位置”。

此外,SmolLM3 像 OLMo 一样共享了大量训练细节 —— 这是非常稀有且值得称赞的!

图20:来自 Hugging Face 官方 SmolLM3 发布文章的图表(链接[27]),比较了 SmolLM3 相对于 Qwen3 1.7B、Qwen3 4B、Llama 3 3B 及 Gemma 3 4B 的胜率(win rate)。

从架构角度来看,SmolLM3 整体结构偏向标准 Transformer。 但其中最有趣的地方是:它采用了 NoPE(No Positional Embeddings,无位置编码)机制。

图21:Qwen3 4B 与 SmolLM3 3B 架构并排对比图

7.1 无位置编码(NoPE)

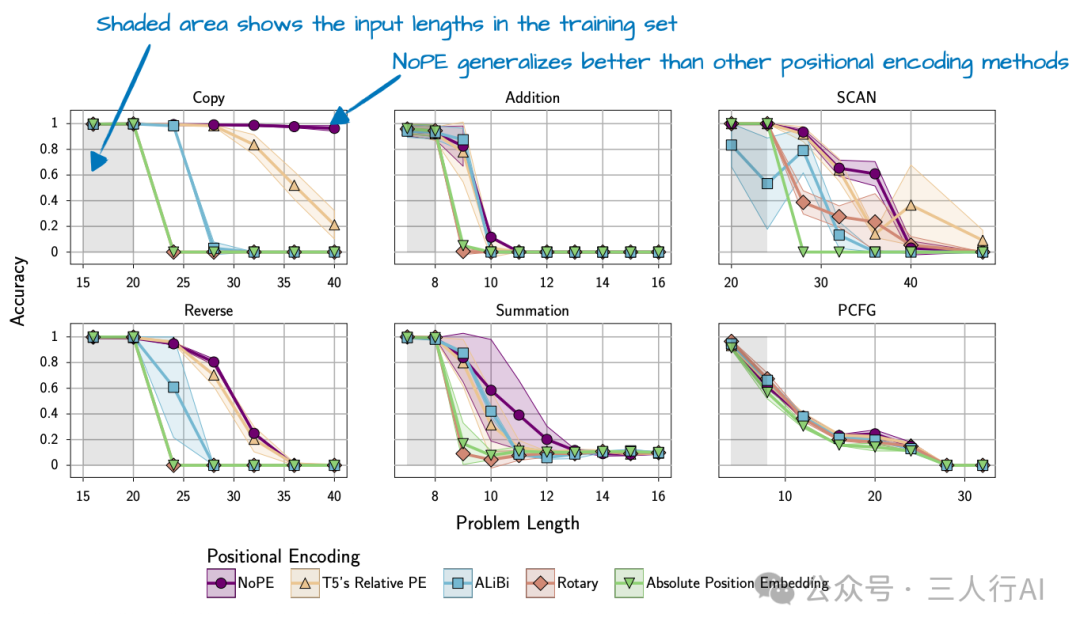

在 LLM 领域,NoPE(No Positional Embeddings) 并不是一个全新概念,它可以追溯到 2023 年的一篇论文: 《The Impact of Positional Encoding on Length Generalization in Transformers》[28],研究如何在 Transformer 架构中移除显式的位置信息注入机制。

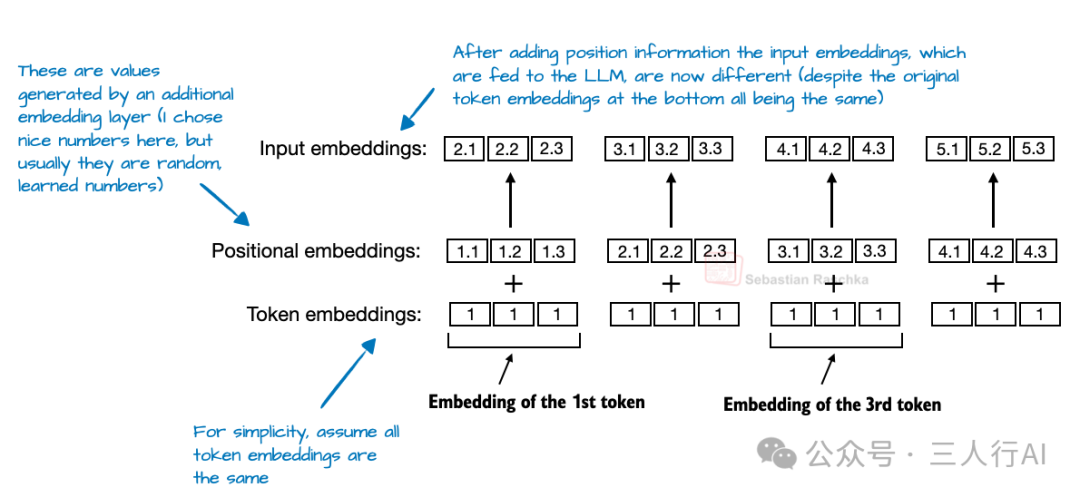

在基于 Transformer 的语言模型中,位置编码(Positional Encoding)通常是必要的,因为:

•自注意力机制并不考虑 token 的顺序;•早期 GPT 架构使用的是绝对位置编码(Absolute Positional Embeddings),通过额外的 embedding 层为 token 注入位置信息。

图22:来自作者著作《Build A Large Language Model (From Scratch)》中的修改图示,展示了绝对位置编码的工作方式。

图书链接[28]

RoPE(Rotary Position Embedding) 是近年来主流模型常用的一种方式,通过在 query 和 key 上根据位置做旋转操作注入位置信息。

而 NoPE 完全不同:

在 NoPE 层中, 不添加任何形式的位置信息 —— 既没有固定的位置编码,也没有可学习的,也没有相对位置偏移。

那模型怎么知道前后顺序呢?

•答案是:依赖 因果注意力掩码(Causal Attention Mask);•它会阻止当前 token 关注未来 token;•因此,位置 t 的 token 只能访问位置 ≤ t 的内容,保持了语言生成的因果顺序。

虽然模型中不再显式注入位置信息,但其结构中仍隐含方向感;

在基于梯度下降的训练中,模型依然可以学会如何“利用”这些顺序结构来优化目标。

想深入理解 NoPE,可查阅原论文中的定理部分。

📌 NoPE 的论文发现不仅是:不需要位置编码,模型依然能正常工作;更重要的是 —— NoPE 还能带来更好的长度泛化能力(length generalization): 当输入序列变长时,模型性能下降幅度更小,如下图所示:

图23:来自 NoPE 原论文的注释图(链接[29]),展示了 NoPE 在长度泛化(length generalization)方面的优势。

请注意,上述实验是在一个相对较小的 GPT 风格模型上完成的,模型参数约为 1 亿,且使用了较小的上下文窗口。

因此,目前尚不清楚这些结果是否可以推广至更大规模的现代 LLM 模型。

也正因为如此,SmolLM3 团队很可能只是“部分采用”了 NoPE —— 更准确地说,是每隔 4 层不使用 RoPE(即部分层省略了位置编码)。

8. Kimi 2

Kimi 2 最近在 AI 社区引起了巨大轰动,因为它作为一个开源权重模型,展现出了极其优异的性能。 根据多个基准测试,其表现与目前最强的一些闭源模型不相上下,比如:

•Google 的 Gemini•Anthropic 的 Claude•OpenAI 的 ChatGPT 系列

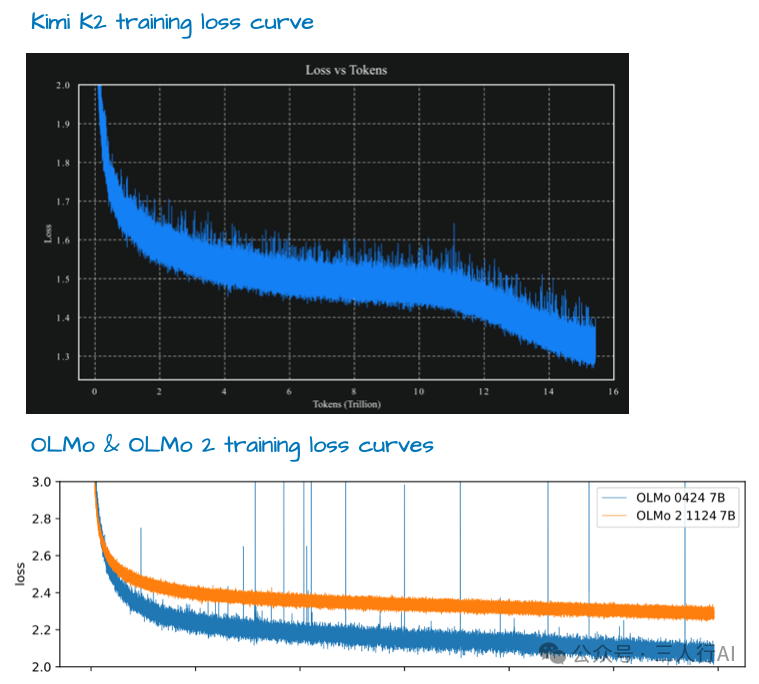

一个引人注目的特征是:Kimi 2 使用了 Muon 优化器的一个变体来替代传统的 AdamW。 据我所知,这是第一次在如此大规模的生产级模型中将 Muon 用于训练(此前的实验最多扩展到 160 亿参数)。

这一变动带来了非常优秀的训练 loss 曲线,很可能是 Kimi 2 能跻身于各大排行榜前列的重要原因之一。

虽然很多人评论说它的 loss 曲线非常平滑(没有突刺),但我认为它也并没有特别“光滑”(比如你可以看看下面图中 OLMo 2 的 loss 曲线也很平稳)。

如果要评估训练稳定性,或许 L2 范数等指标更能说明问题。

不过,值得称赞的是:Kimi 2 的 loss 曲线下降趋势非常理想。

☝️ 正如本文开头提到的那样,关于训练方法本身的探讨属于另一个话题,本文不做深入讨论。

图24:来自 Kimi K2 官方博客[30] 与 OLMo 2 论文[31] 的注释图,对比了训练 loss 曲线。

Kimi 2 的参数规模达 1 万亿(1 trillion),这无疑令人惊叹。

截至目前(写作时),它可能是本世代中最大的 LLM 模型:

•Llama 4 Behemoth 尚未公开;•商业闭源模型(如 GPT-4)不计入;•Google 早先的 1.6 万亿参数 Switch Transformer 属于上一代编码器-解码器架构。

有趣的是,Kimi 2 实际上采用的正是我们在本文开头介绍的 DeepSeek-V3 架构,只是将其大幅扩展了规模,如下图所示。

图25:DeepSeek V3 与 Kimi K2 架构对比图

如上图所示,Kimi 2.5 的架构基本与 DeepSeek V3 保持一致,唯一的主要区别在于:

•MoE(专家混合)模块中使用了更多的专家;•Multi-head Latent Attention(MLA)模块中使用了更少的注意力头。

值得一提的是,Kimi 2 并不是突然冒出来的模型。早在此前,Kimi 1.5 就在论文 《Kimi k1.5: Scaling Reinforcement Learning with LLMs》[33] 中被提到,表现也很令人印象深刻。

但可惜的是,Kimi 1.5 与 DeepSeek R1 的论文恰好在同一天(2025 年 1 月 22 日)发布,两者“撞车”,导致 Kimi 没有获得太多关注;

更关键的是,据我所知,Kimi 1.5 的模型权重并未公开发布。

或许正是吸取了这个教训,Kimi K2 团队提前将模型权重开源,抢在 DeepSeek R2 发布之前。

截至本文撰写时,Kimi K2 是我认为最令人惊艳的开源权重大模型。

经历了这么多年,每一次 LLM 的发布依然让人激动不已。 我非常期待接下来还会有哪些突破性的大模型出现!

AI大模型从0到精通全套学习大礼包

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

只要你是真心想学AI大模型,我这份资料就可以无偿共享给你学习。大模型行业确实也需要更多的有志之士加入进来,我也真心希望帮助大家学好这门技术,如果日后有什么学习上的问题,欢迎找我交流,有技术上面的问题,我是很愿意去帮助大家的!

如果你也想通过学大模型技术去帮助就业和转行,可以点扫描下方👇👇

大模型重磅福利:入门进阶全套104G学习资源包免费分享!

01.从入门到精通的全套视频教程

包含提示词工程、RAG、Agent等技术点

02.AI大模型学习路线图(还有视频解说)

全过程AI大模型学习路线

03.学习电子书籍和技术文档

市面上的大模型书籍确实太多了,这些是我精选出来的

04.大模型面试题目详解

05.这些资料真的有用吗?

这份资料由我和鲁为民博士共同整理,鲁为民博士先后获得了北京清华大学学士和美国加州理工学院博士学位,在包括IEEE Transactions等学术期刊和诸多国际会议上发表了超过50篇学术论文、取得了多项美国和中国发明专利,同时还斩获了吴文俊人工智能科学技术奖。目前我正在和鲁博士共同进行人工智能的研究。

所有的视频由智泊AI老师录制,且资料与智泊AI共享,相互补充。这份学习大礼包应该算是现在最全面的大模型学习资料了。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

智泊AI始终秉持着“让每个人平等享受到优质教育资源”的育人理念,通过动态追踪大模型开发、数据标注伦理等前沿技术趋势,构建起"前沿课程+智能实训+精准就业"的高效培养体系。

课堂上不光教理论,还带着学员做了十多个真实项目。学员要亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

如果说你是以下人群中的其中一类,都可以来智泊AI学习人工智能,找到高薪工作,一次小小的“投资”换来的是终身受益!

应届毕业生:无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型:非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能 突破瓶颈:传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献385条内容

已为社区贡献385条内容

所有评论(0)