字节开源一致性主体视频生成模型:Phantom

Phantom 是字节跳动推出的一种统一视频生成框架,能够处理单主体和多主体参考的视频生成任务。:2025 年 4 月 20 日,Phantom 框架被适配到 Wan2.1 视频生成模型中,发布了 Phantom-Wan 的推理代码和检查点,包括 Phantom-Wan 1.3B 的推理代码和检查点、Phantom-Wan 14B 的检查点以及 Phantom-Wan 的训练代码。在单参考主体到视

一、引言

Phantom 是字节跳动推出的一种统一视频生成框架,能够处理单主体和多主体参考的视频生成任务。该框架建立在现有的文生视频和图生视频架构基础上,通过重新设计联合文本 - 图像注入模型,利用文本 - 图像 - 视频三元组数据实现跨模态对齐。同时,Phantom 框架强调在人类生成中保持主体一致性,并增强身份保持的视频生成能力。

二、更新内容

-

论文更新 :2025 年 4 月 10 日,Phantom 论文的完整版本更新,包含了对模型架构和数据集管道更详细的描述。

-

模型发布 :2025 年 4 月 20 日,Phantom 框架被适配到 Wan2.1 视频生成模型中,发布了 Phantom-Wan 的推理代码和检查点,包括 Phantom-Wan 1.3B 的推理代码和检查点、Phantom-Wan 14B 的检查点以及 Phantom-Wan 的训练代码。

三、环境搭建

-

克隆仓库 :使用命令

git clone https://github.com/Phantom-video/Phantom.git克隆代码仓库。 -

安装依赖 :进入 Phantom 文件夹,确保 PyTorch 版本不低于 2.4.0,然后执行

pip install -r requirements.txt安装项目所需依赖。

四、模型下载与推理

-

模型下载 :先使用 huggingface-cli 下载 Wan2.1-1.3B 模型,命令为

huggingface-cli download Wan-AI/Wan2.1-T2V-1.3B --local-dir ./Wan2.1-T2V-1.3B,再下载 Phantom-Wan-1.3B 模型。 -

推理方法 :

-

单 GPU 推理 :运行

python generate.py --task s2v-1.3B --size 832*480 --ckpt_dir ./Wan2.1-T2V-1.3B --phantom_c。 -

多 GPU 推理 :安装 xfuser(版本需 >= 0.4.1),然后执行

torchrun --nproc_per_node=8 generate.py --task s2v-1.3B --size 832*480 --ckpt_dir ./Wan2.1,使用 FSDP + xDiT USP 实现多 GPU 推理。

-

五、使用技巧与注意事项

-

参考图片设置 :通过改变

--ref_image参数可以实现单参考主体到视频生成或多参考主体到视频生成,但参考图片数量应控制在 4 张以内。 -

提示词撰写 :为了获得最佳生成效果,建议在撰写

--prompt时,尽可能准确地描述参考图片的视觉内容。例如,若参考图片为 “examples/ref1.png”,则可以描述为 “a toy camera in yellow and red with blue buttons”。 -

结果优化 :如果生成的视频不理想,最直接的解决办法是尝试更改

--base_seed并修改--prompt中的描述。

六、实验结果

Phantom 框架在身份保持视频生成方面表现出色。在单参考主体到视频生成和多参考主体到视频生成任务中,均能较好地保持主体身份特征,同时生成具有较高质量和连贯性的视频内容。

七、致谢

论文作者对 SEED 团队表示感谢,特别感谢 Lu Jiang、Haoyuan Guo、Zhibei Ma 和 Sen Wang 在模型和数据方面的帮助,同时也对 Siying Chen、Qingyang Li 和 Wei Han 在评估过程中的协助表示感激。

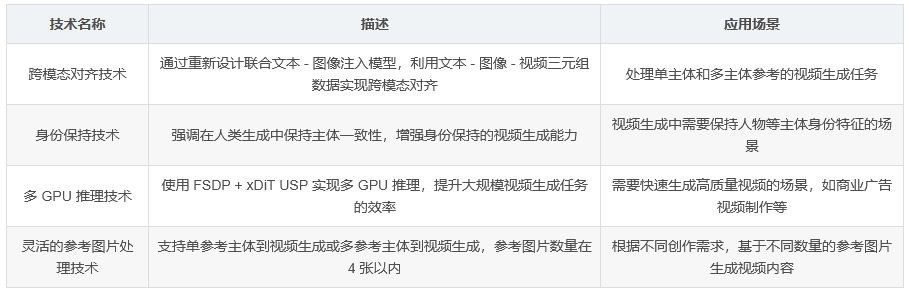

八、核心技术汇总

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献145条内容

已为社区贡献145条内容

所有评论(0)