wsl2+docker+dify 部署本地大模型

出现上面两个截图,说明windows已经能连接上wsl里面的ollama。同样在命令行输入:ollama run qwen:0.5b。(1)在docker终端中,进入dify所在的本地目录。最后,在dify的ollma中添加模型地址,配置模型。命令行输入:wsl,默认进入带星标的ubuntu。命令行输入以下指令,查看wsl下已经安装的系统。现在,你有什么问题,可以直接在窗口和它对话。设置->模型供

一、安装WSL2以及下载本地模型

1、wsl2安装

(1)更新wsl

命令行直接输入:

wsl --install wsl --update

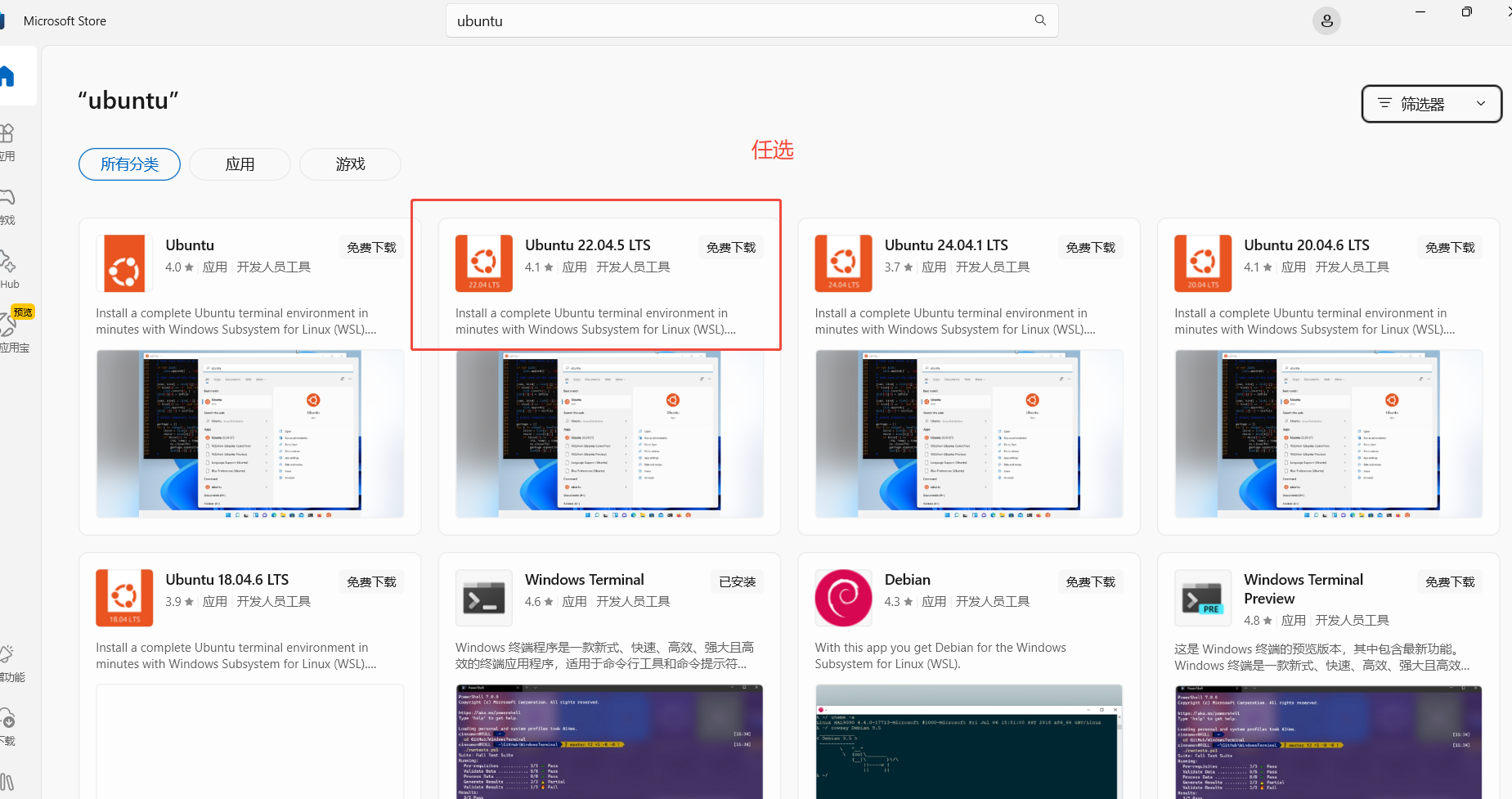

(2)安装ubuntu

在应用商店,搜索并安装ubuntu

命令行输入以下指令,查看wsl下已经安装的系统

wsl --list --verbose

注意看星标所在位置,如果星标不在新安装的ubuntu上,则运行以下指令修改:

wsl --set-default-version Ubuntu-22.04

2、安装ollma

(1)进入ubuntu

命令行输入:wsl,默认进入带星标的ubuntu

(2)输入安装ollma的指令

curl https://ollama.ai/install.sh | sh

3、下载模型

(1)下载qwen:0.5b模型 (想下哪个就输入 ollama run 模型名称,可以到library挑选)

输入以下指令下载

ollama run qwen:0.5b

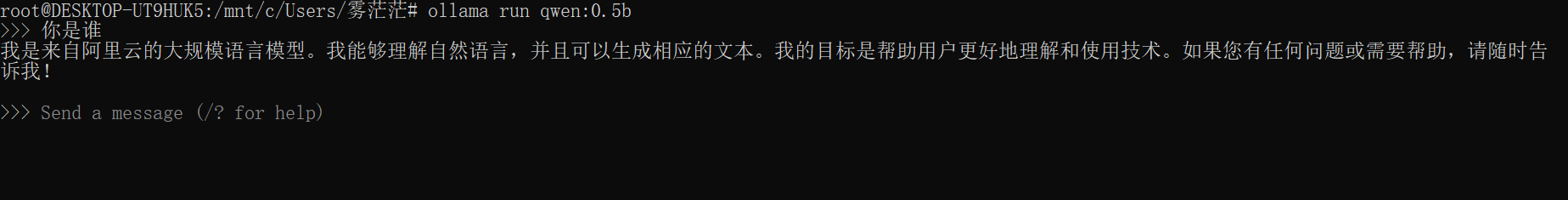

(2)使用模型!

同样在命令行输入:ollama run qwen:0.5b

现在,你有什么问题,可以直接在窗口和它对话

二、安装docker

二、安装docker

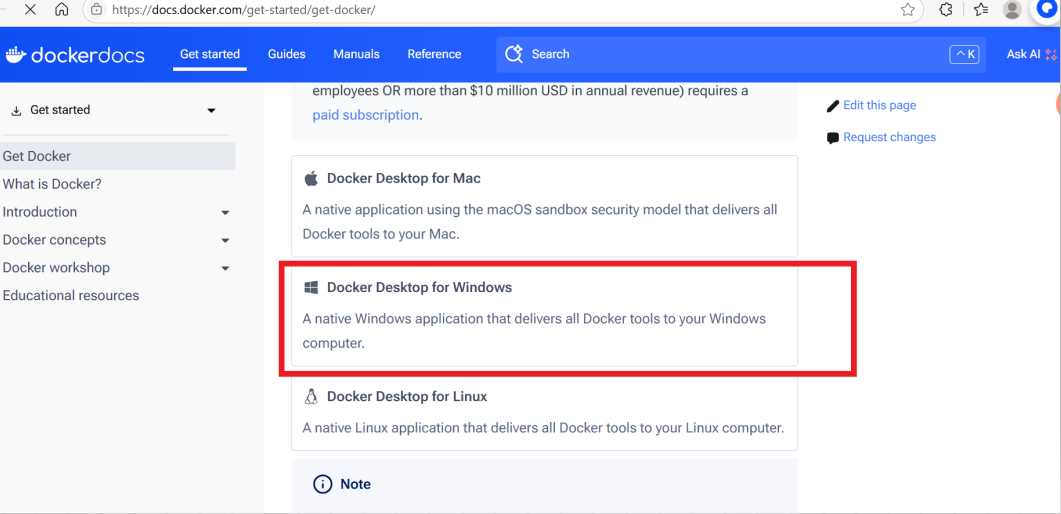

1、docker下载

2、docker安装

安装后打开docker

三、安装dify

1、下载dify

地址:https://github.com/langgenius/dify

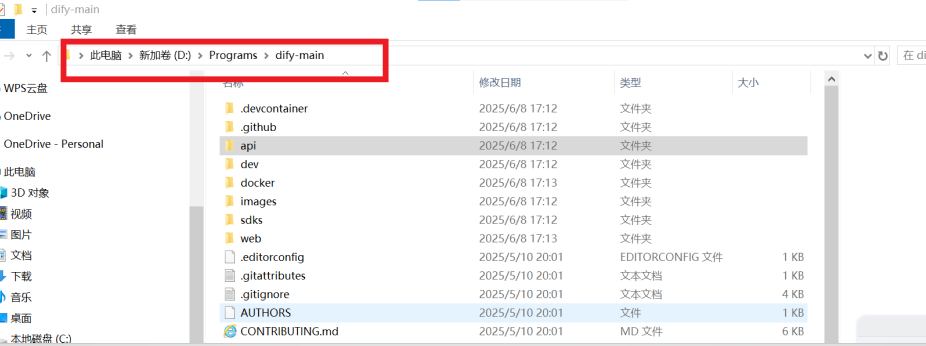

2、在docker中安装dify

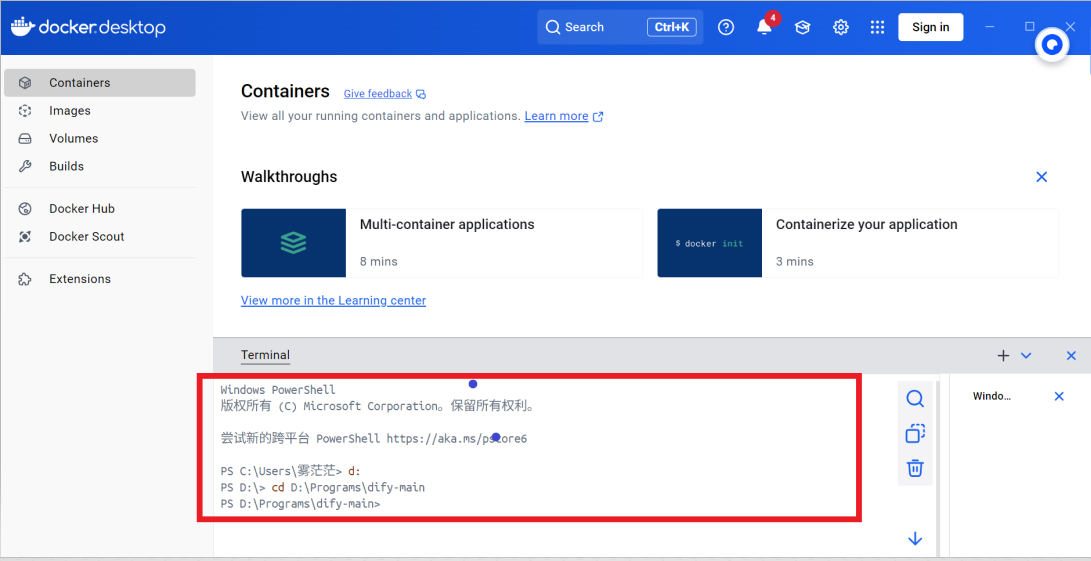

(1)在docker终端中,进入dify所在的本地目录

(2) 复制一个配置示例作为可用配置,输入:

copy .env.example .env

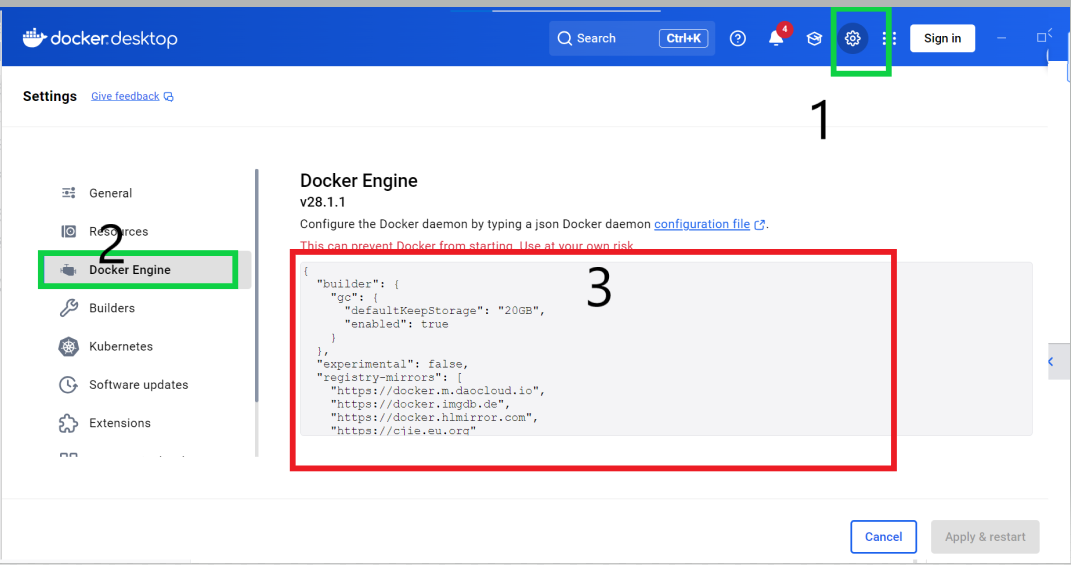

(3) docker镜像源配置(必做)

红框的内容替换成如下内容:

红框的内容替换成如下内容:

{ "builder": { "gc": { "defaultKeepStorage": "20GB", "enabled": true } }, "experimental": false, "registry-mirrors": [ "https://docker.m.daocloud.io", "https://docker.imgdb.de", "https://docker.hlmirror.com", "https://cjie.eu.org" ] }]}

(4)启动容器

在终端输入:

docker compose up -d

等待……

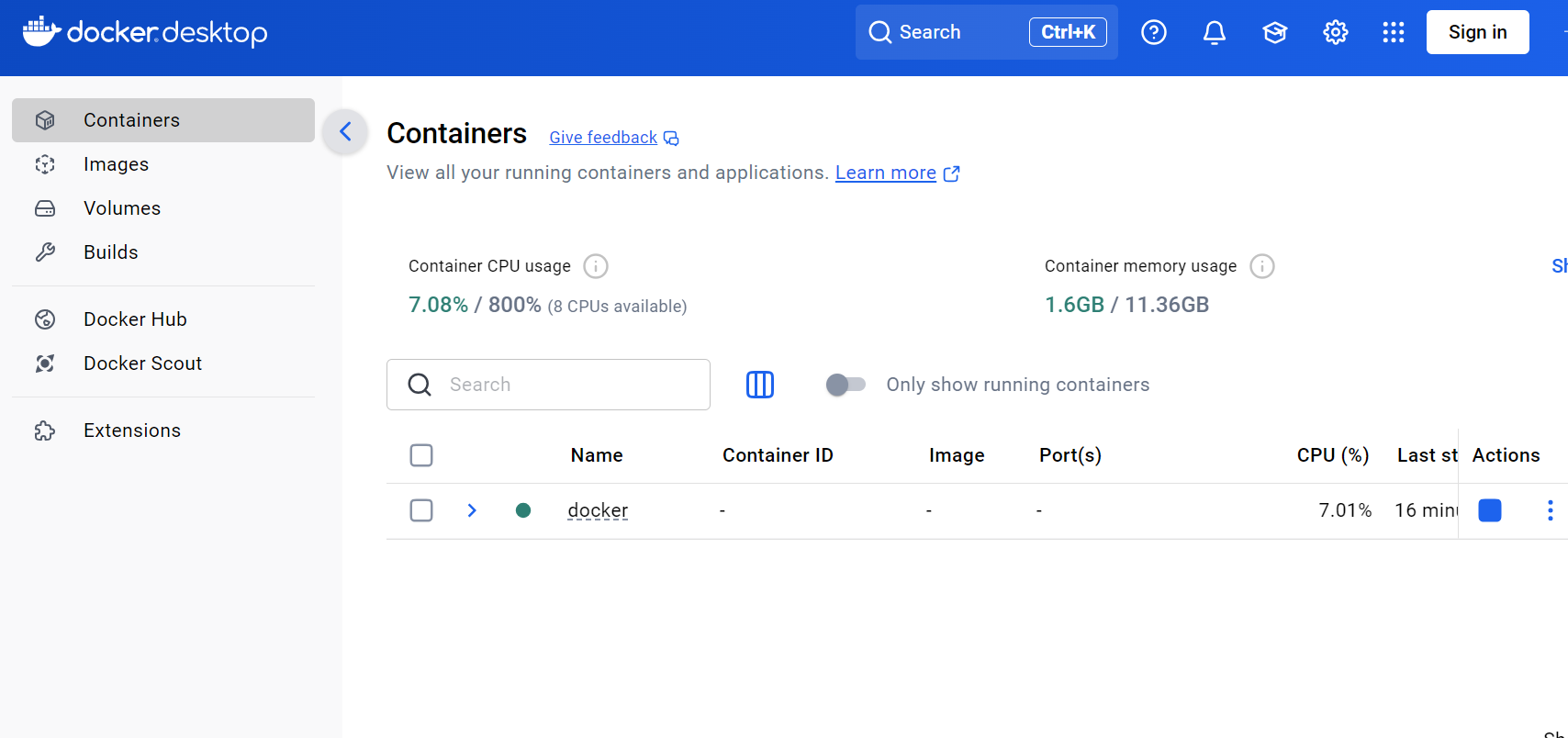

完成安装效果:

3、使用dify

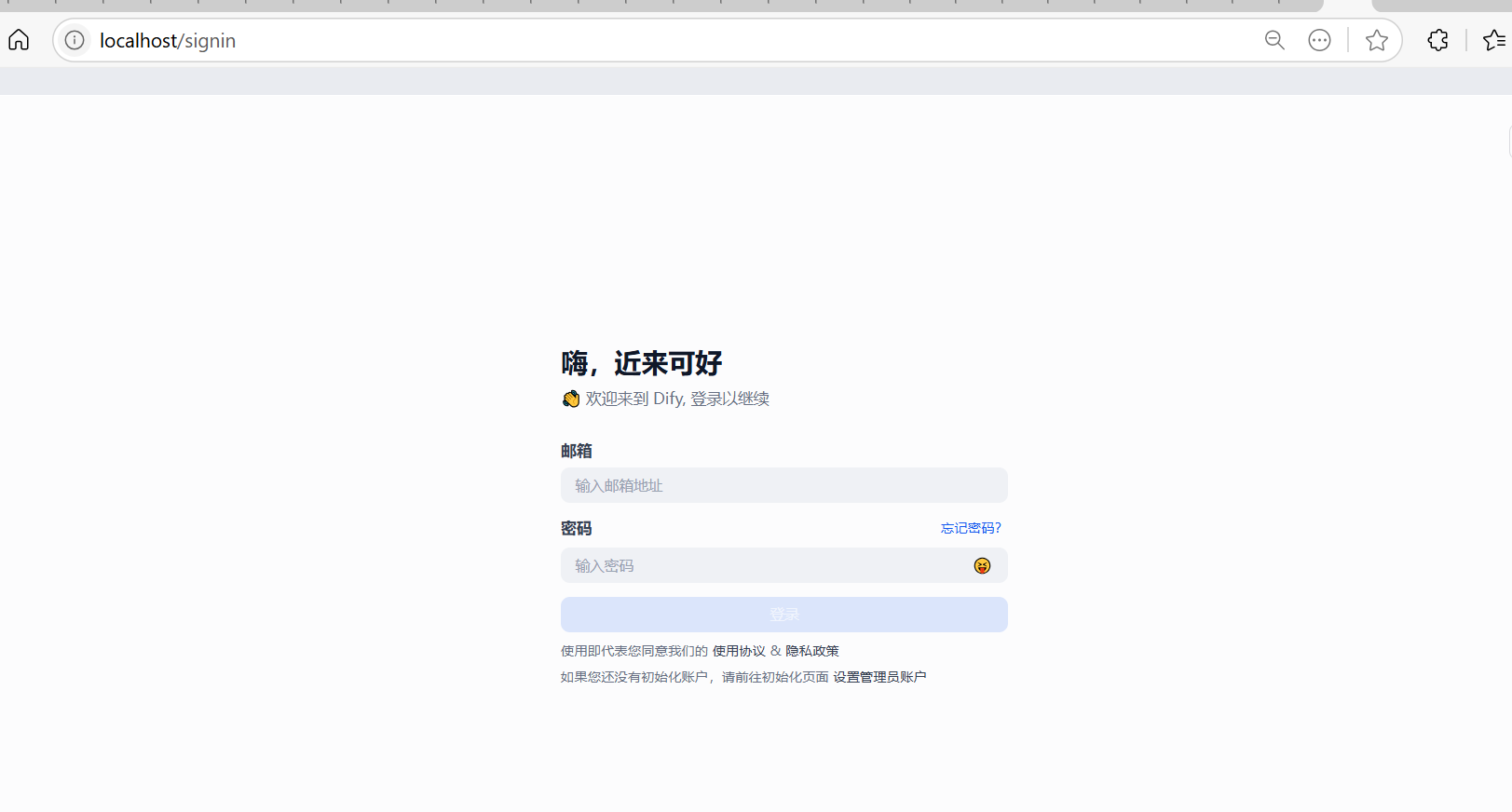

(1)登录dify

浏览器输入:http://localhost/install

(2)连接本地模型

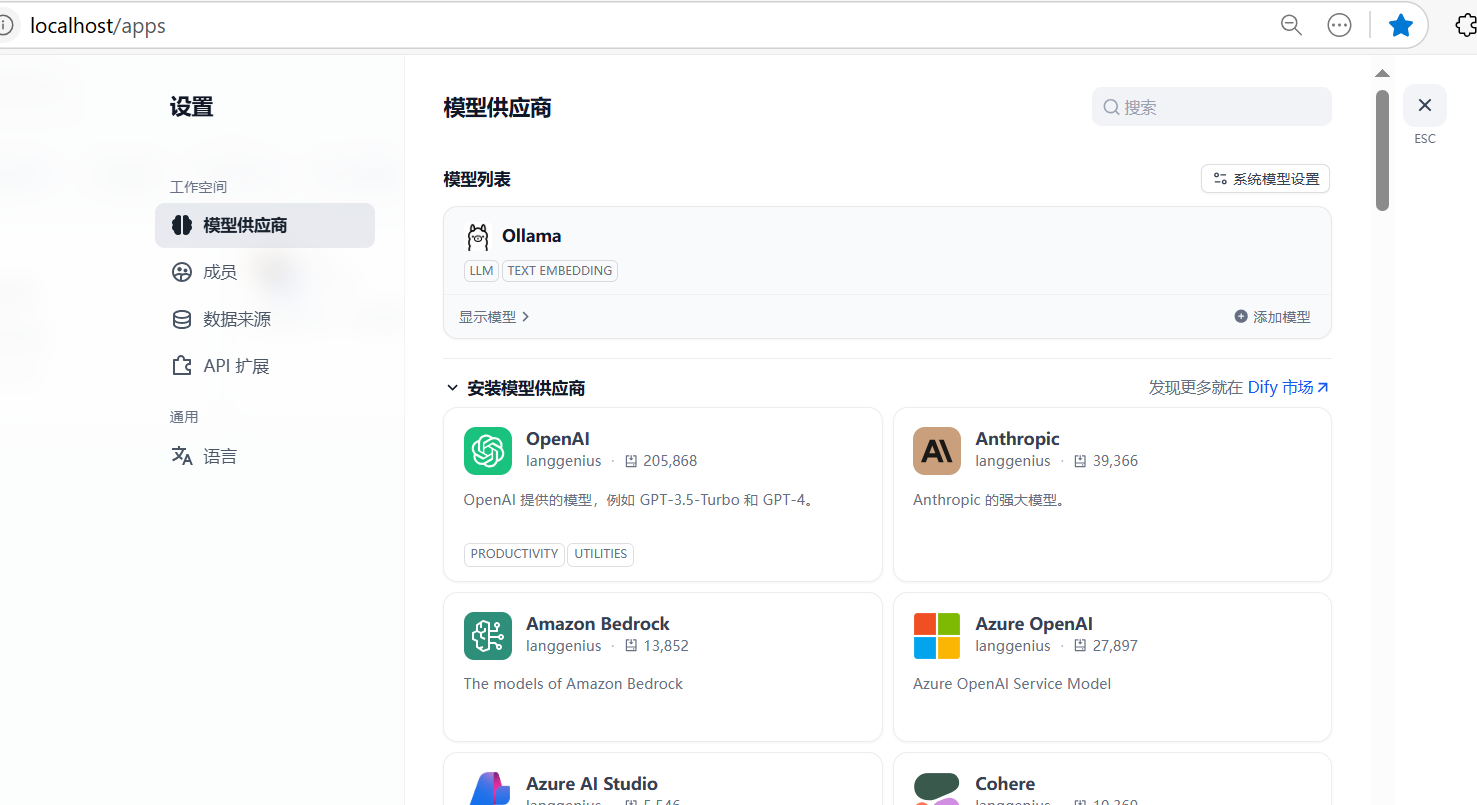

设置->模型供应商->添加ollma

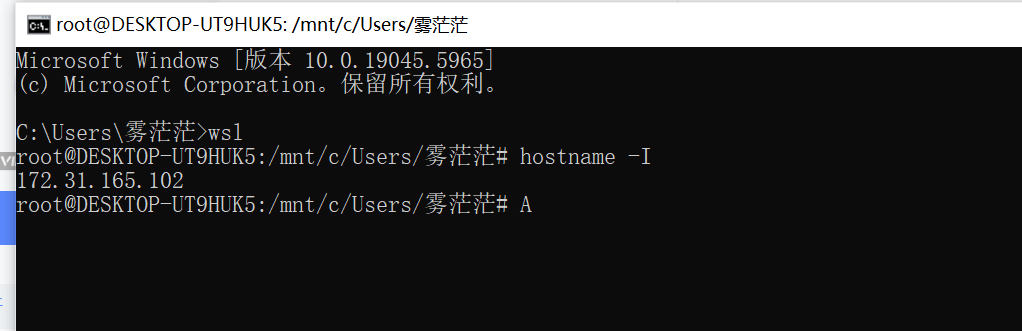

获取wsl的地址:

hostname -I

记住这个地址:172.31.165.102

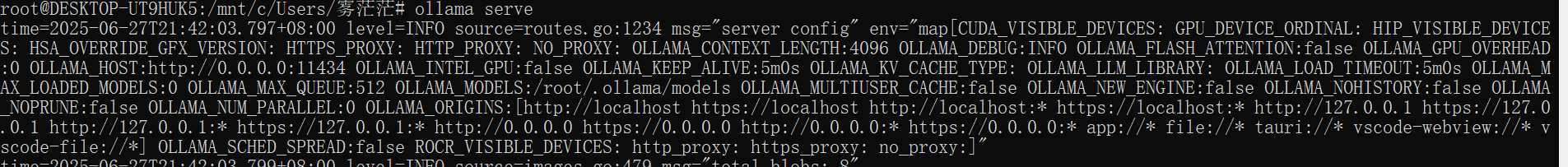

在wsl中启动ollama

ollama sever

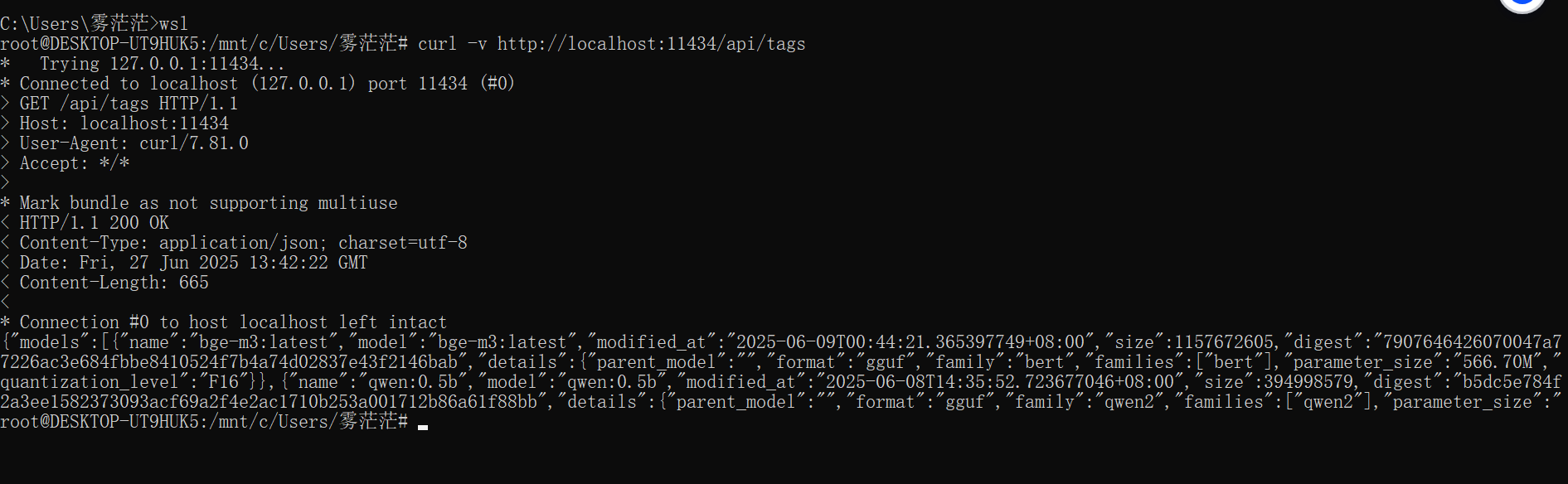

这个窗口不要关闭(一定不能关,关闭后就连接不上了),打开一个新的wsl命令行,输入:

curl -v http://localhost:11434/api/tags

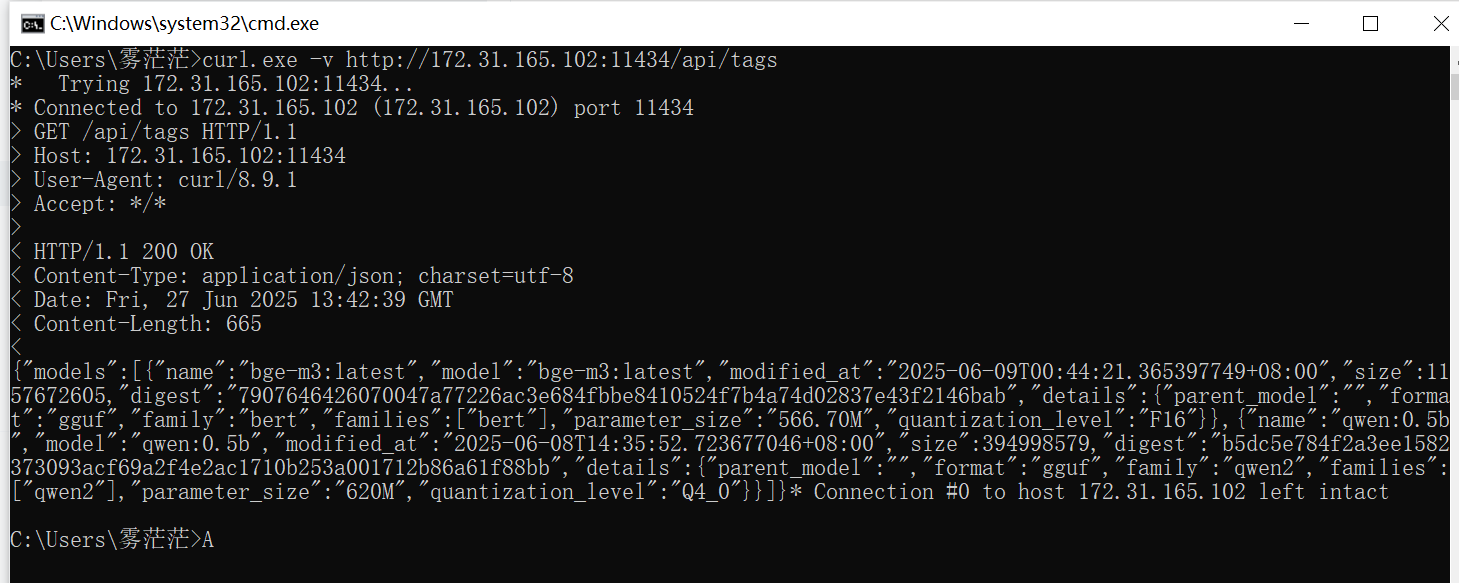

再打开一个windows命令行,输入:

curl.exe -v http://172.31.165.102:11434/api/tags

出现上面两个截图,说明windows已经能连接上wsl里面的ollama

最后,在dify的ollma中添加模型地址,配置模型

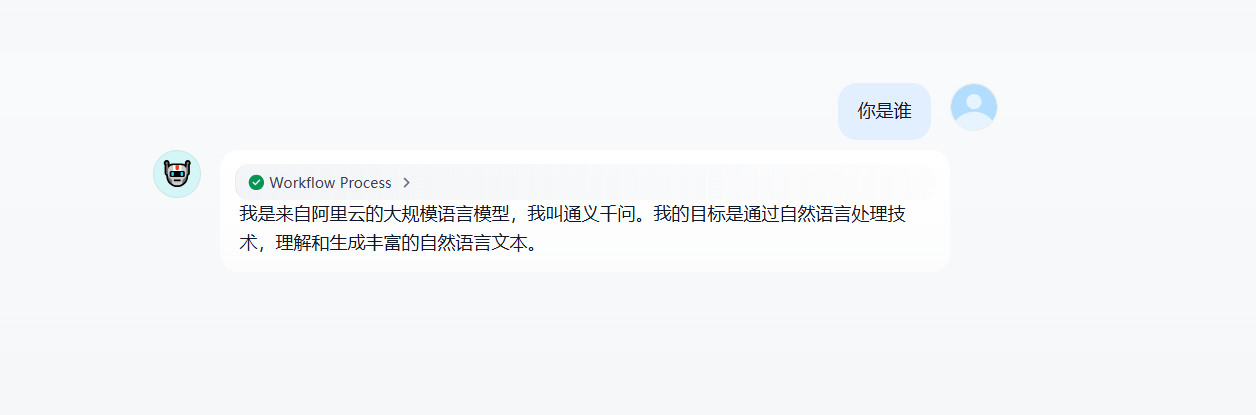

(3)测试

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)