OPENHELIX: A Short Survey, Empirical Analysis, and Open-Source Dual-System VLA Model for Robotic..

要实现和Helix 一样的能力还是比较困难的。目前这个版本也是作者的初步版本,后续还会持续更新。

|

序号 |

属性 | 值 |

|---|---|---|

| 1 | 论文名称 | OPENHELIX:A Short Survey and open source dual-system VLA |

| 2 | 发表时间/位置 | 2025.第一版,作者说明还要继续更新。 |

| 3 | Code | https://openhelix-robot.github.io/ |

| 4 | 创新点 |

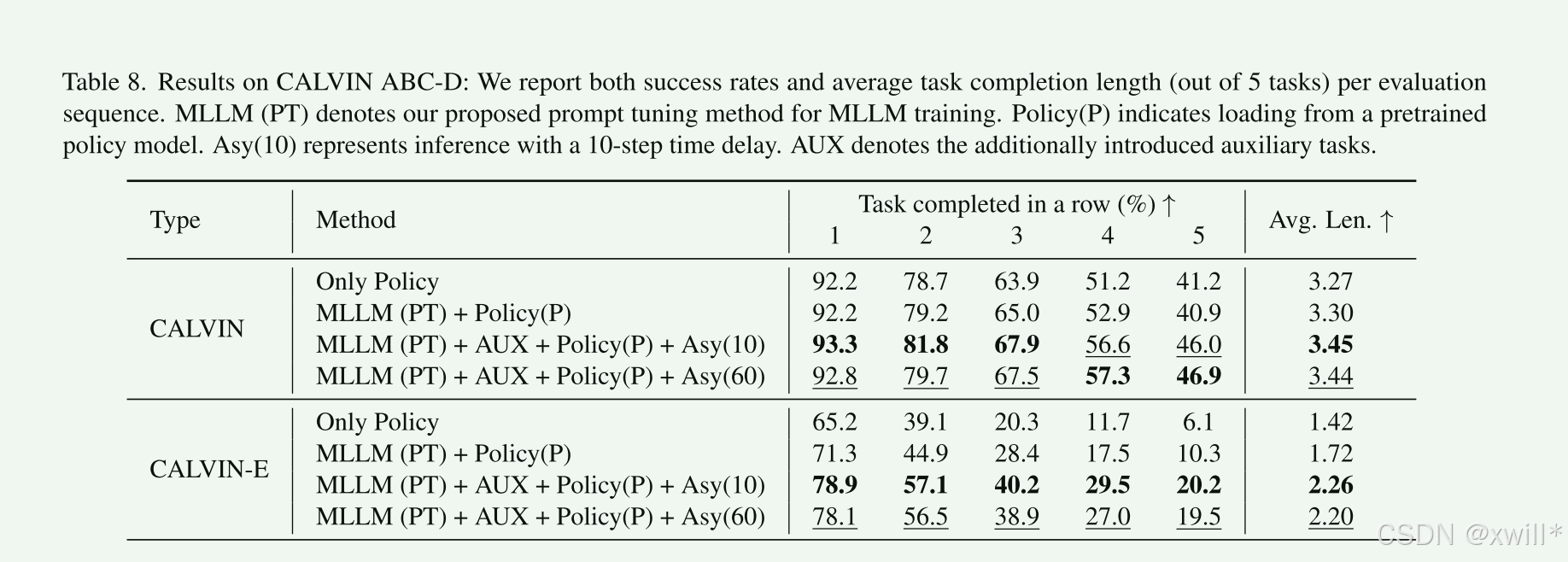

通过一系列的探究实验,提出了一套较为完整的高低层双系统训练与连接方法。 1.双系统架构设计 强调双系统在动态场景和语言泛化任务中的优势,解决单系统在动态环境下失败的问题。 2.上下层连接与训练策略创新 Prompt Tuning:只微调新加入的 两阶段训练: 第一阶段:冻结 MLLM 和低层策略,仅训练 prompt token 和投影层,实现上下层初步对齐。 第二阶段:冻结 MLLM,解冻低层策略,与 prompt 及投影层一起微调,提高动作精度。 MLP 投影器预对齐:在上下层连接前,先训练投影器确保 latent embedding 与低层输入匹配,避免训练直接失败。 3.多模态推理能力增强 引入辅助任务,强制 MLLM 使用视觉信息而非仅依赖语言指令。 通过辅助任务和 latent embedding,使低层策略能够获取更加丰富的视觉-语言特征,提高动态场景任务成功率。 4.异步推理与鲁棒性分析 实验显示异步步长变化对标准任务性能影响不大。。 分析 latent embedding 发现其主要编码语言指令语义,而视觉变化对其影响较小,说明模型仍需优化视觉推理能力。 5.系统实验方法与评估创新 对比单系统和双系统性能,验证双系统在动态与语言泛化任务上的优势。 使用 预训练低层策略 + prompt tuning MLLM + 辅助任务 的组合,实现标准任务和泛化任务的平衡。 |

| 5 | 引用量 | 探究一下到底那些部分,那些策略在起作用,然后根据实验结果设计一个目前“完美的”的VLA。 |

一:提出问题

Dual-system VLA 架构已经称为具身智能的研究热点,但是缺乏足够多的开源工作用于进一步的性能分析和优化。对此,本文对现阶段的双系统结构设计进行总结与比较,并对核心设计要素进行系统的验证与评估,并且提供一个低成本的开源模型。

Hz:指的是模型的运行速率,即每秒能够处理多少帧或者执行多少次推理。1 Hz = 每秒 1 次模型推理,也就是说

1 Hz → 模型每秒输出一次决策(动作)

50 Hz → 模型每秒输出 50 次决策

这种“频率”通常对应 控制回路的刷新率或 感知—决策—行动周期的执行频率。

1 Definition of VLAs

传统的策略学习主要依靠轻量级模型从零开始训练新的行为。这类模型通常对环境扰动(包括视觉和语言上的变化)高度敏感,且泛化能力有限。而大型语言模型LLMs和视觉语言模型MLLMs的兴起,改变了这一研究格局,其庞大的参数量,卓越的文本生成与视觉理解能力,为机器人领域应用带来了新的可能。在此背景下,RT-2 首次提出了 视觉-语言-动作模型(VLA) 的概念。RT-2在机器人轨迹数据和互联网规模的视觉语言任务上进行联合微调,从而使视觉语言模型能够适应具身任务。

VLA 模型在面对新物体、语义多样的指令时表现出显著的泛化能力和多种涌现能力。此外,VLA 作为强大的基础模型,可以直接针对具体领域任务进行微调,有望革新机器人的技能学习方式,为解决机器人部署中的关键问题提供了一种极具潜力的路径。

这里传统的策略学习方式指的是那种单系统,端到端的强化学习式训练方法。是在强化学习框架下,通过“试错”或“监督”训练得到一个从状态到动作的映射函数,让模型学会如何根据视觉输入(图像/视频)和语言指令,输出合适的动作序列。

2 Limitation of VLAs

VLA虽然很好,但是也有很多局限性:

-

模型庞大、实时性差。 VLA 模型体量庞大,实时推理效率低。例如,RT-2 的 550 亿参数模型在实验中仅能以 1–3 Hz 的速率运行,5B 模型约为 5 Hz。 相比之下,传统轻量级模型(如 BC-Transformer)可以达到约 50 Hz。

-

预训练与微调代价高昂。 VLA 的预训练需要大量资源,而在具身数据上进行端到端微调又容易受到领域迁移与灾难性遗忘的影响。

如何在保持多模态理解、推理与生成能力的同时,保证动作输出的实时性与一致性,是当前需要解决的核心问题。

3 Definition of Dual-System VLAs

针对上边的问题,出现了双系统架构的VLA,LCB 模型首次采用了该结构,而 DP-VLA 则引入了双加工理论**为其提供心理学解释。

双加工理论认为,人类认知包含两个系统:

-

系统1(System 1):快速、自动、直觉、无意识地运作。它依赖启发式规则做出决策,能迅速反应但容易产生偏差。 在机器人领域中,这类似于轻量级策略网络,执行效率高但泛化性差。

-

系统2(System 2):缓慢、理性、需要注意力与推理。它在处理复杂任务时更准确,但代价高且在认知负荷大时容易出错。 在机器人中,这类比于大型模型(如 MLLMs 和 VLAs),计算量大但具有出色的泛化能力。

这两个系统并行工作,但更新频率不同。系统2更新较慢,负责基于高层语义的决策;系统1更新较快,用于实时生成底层动作控制。系统2的信息通常存在时间延迟。这种设计能在保持大型模型多模态推理能力的同时,兼顾实时性与控制效率。

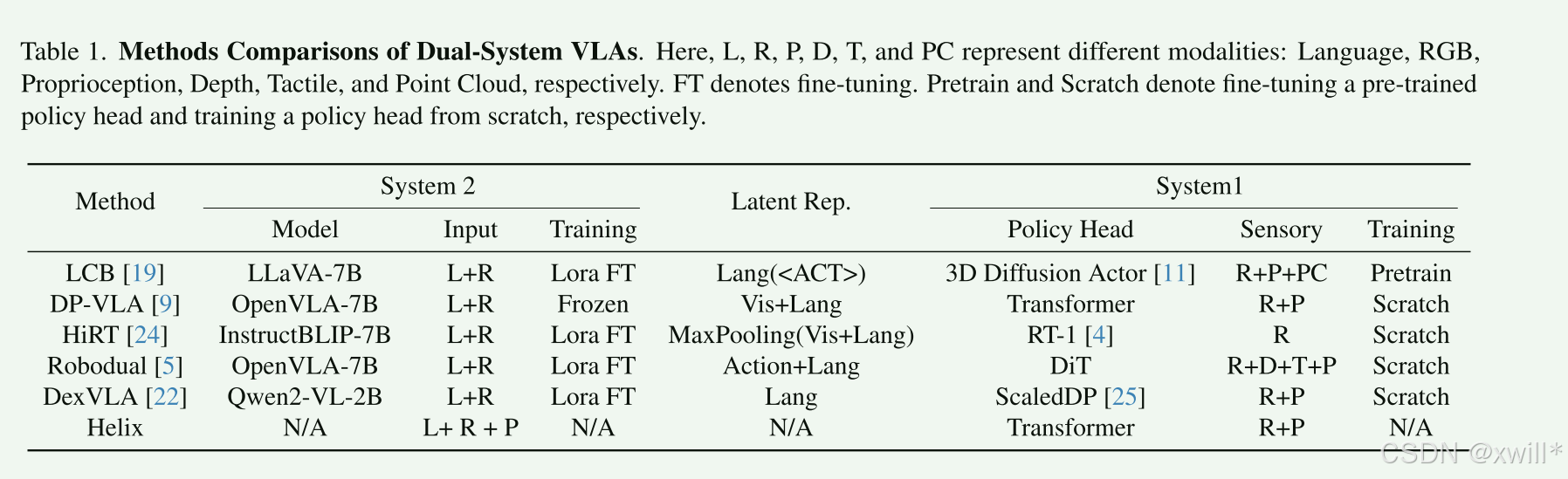

4 Current Dual-System VLAs

目前典型的双系统模型包括 LCB、DP-VLA、HiRT、Robodual 等,其核心区别在于:系统1如何生成动作,系统2如何提供高层语义指导。

-

LCB:以 LLaVA 为系统2,根据任务描述与RGB图像生成文本动作描述及

<ACT>token,后者作为高层潜在目标供3D Diffusion Actor(系统1)生成动作。系统2通过LoRA微调,系统1使用标准微调。 -

DP-VLA:提出了双系统理论支撑,系统2采用OpenVLA,提取语言与视觉潜在表示指导系统1(Transformer结构)。系统2冻结,系统1从零训练。

-

HiRT:采用InstructBLIP为系统2,利用语言与视觉编码的最终层特征通过MAP pooling生成潜在表示指导系统1。系统1采用EfficientNet-B3 作为骨干网络。

-

Robodual:采用OpenVLA为系统2,提取语言与RGB潜在特征,用任务潜在表示和动作潜在表示共同指导系统1。系统1采用ViT(vision transformer)结构,并使用Perceiver Resampler提取关键特征。动作由DiT结构生成。

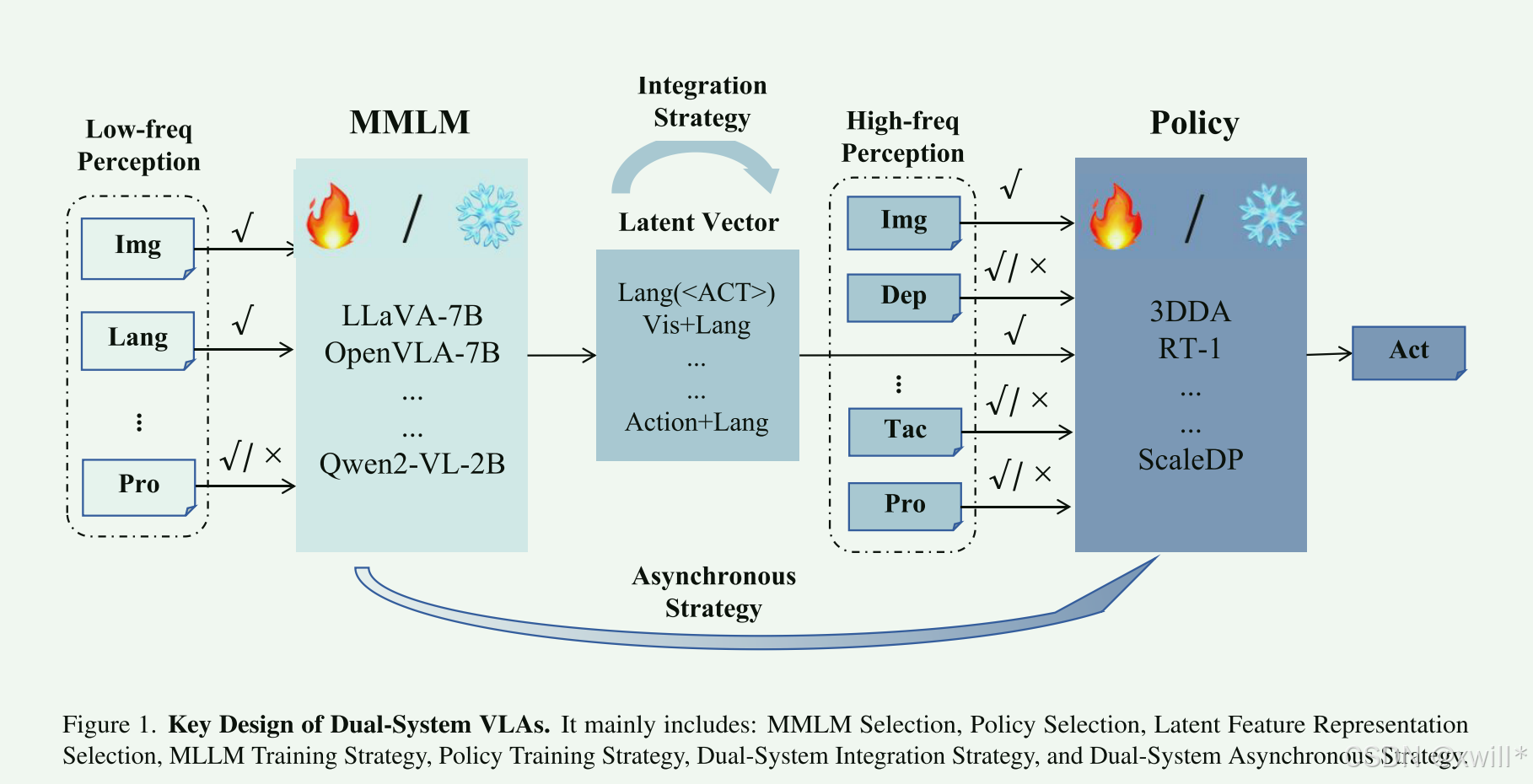

5 Key Design of Dual-System VLAs

设计双系统VLA的核心在于如何让高层的系统2有效地指导低层的系统1,从而兼顾泛化与实时性。为实现这一目标,需要解决以下关键问题:

-

MLLM选择:不同VLA任务对MLLM要求不同。应权衡轻量与能力。例如,Flower模型空间感知强、MiniVLA使用Qwen-VL 0.25B以降低推理成本。是否需要在机器人数据上预训练MLLM仍是未解问题。

-

Policy选择:轻量策略模型一般采用DiT或Flow Matching结构,但随着CARP、Dense Policy等新架构出现,未来设计空间更广。是否应引入更多模态(如触觉)仍需研究。

DIT是是一种把扩散模型和Transformer结合的架构。最早用于图像生成(如 Stable Diffusion),后来被用于动作或轨迹建模。

Flow Matching:是一种生成式建模方法,与扩散模型相似,但计算更快。它学习一个“连续流函数”,直接从随机噪声“流动”到目标样本,而不需要扩散模型那种“多步去噪”。

-

潜在特征表示选择:这是双系统研究中最复杂的部分。不同模型选择不同层的隐藏特征,如DP-VLA使用最后一层,GR00T-N1使用中间层以减少延迟,HiRT使用视觉与语言特征池化。LCB引入特殊的

<ACT>token,Robodual扩展为多个<ACT>token。如何选择最合适的潜在表示仍是研究重点。 -

MLLM训练策略:主要考虑如何在保持泛化能力的同时兼顾任务适配。常见策略包括冻结与LoRA微调,但新的微调方法仍待探索。

-

Policy训练策略:是否可微调已有策略模型以降低成本?从零训练可能导致优化目标不一致、收敛困难。

-

系统集成策略:如何将上游潜在表示输入下游模型?LCB使用CLIP loss约束上游特征与原始文本相似,但可能限制泛化。常需引入投影器连接两系统,若两端同时训练,模型可能坍塌。

在 Dual-System VLA 中:

-

System 2(大模型):通常是一个大型视觉语言模型(比如 LLaVA、OpenVLA、InstructBLIP);

-

输入:语言指令 + 视觉图像;

-

输出:高层的“潜在表征”(latent features),比如任务目标、动作语义。

-

-

System 1(小模型):是一个轻量级的策略模型(比如 DiT、Flow Matching、Transformer);

-

输入:感知信息 + System 2 提供的 latent;

-

输出:具体的动作(如机械臂坐标、控制信号等)。

-

但问题是:System 2 输出的 latent 表征维度、结构、语义分布和 System 1 需要的输入 完全不匹配。

例如:

-

System 2 输出一个 4096 维的语言图像 embedding;

-

System 1 只接受 512 维的动作条件向量。

所以必须插入一个 “投影器(projector)” 来进行中间映射。projector主要的作用就是连接两套不同认知系统的一个翻译器。功能上:

-

对齐高维语义空间(大模型输出)与低维控制空间(小模型输入);

-

保留语义信息,同时压缩冗余维度;

-

让 System 1 能“理解”System 2 提供的任务意图。

但是,由于System 2 的输出特征空间在不断变化;Projector 的映射规则也在同时变化;System 1 依赖于前两者的输入特征进行学习。于是三者之间出现“追着彼此变化”的现象:

System 2 改了输出 → Projector 重新学 → System 1 又要适应新的输入 → 整个系统无稳定信号。

这就像三个人同时改语言、改翻译规则、改理解方式——最终谁也听不懂谁。

结果表现为:loss 不收敛;生成的动作毫无逻辑;特征分布塌缩成常数(feature collapse)。

如果大模型和小模型同时训练,二者的特征空间会不断漂移,导致训练不稳定、特征塌缩(collapse)。因此,通常做法是冻结大模型,只训练投影器和小模型,保持稳定的信息对齐。

-

-

异步策略:不同模型采用不同的异步推理方式。理论上,上下游推理频率差异影响性能,但若上游特征本身无效,异步推理意义有限,仍需更多实验验证。

二:解决方案

上边的问题,凸显了本文进一步探究实验的重要性,针对这些差异开展系统且公平的比较研究的迫切需求,以便评估不同设计选择背后的理论依据,并为未来模型的设计与发展建立统一的参考框架。

在本研究中,对实验条件 1、2、3 和 7 进行了标准化处理,以确保实验的一致性,并将主要评估重点放在 条件 4、5 和 6 上。这些条件涉及的技术方法具有较强的通用性,且在很大程度上独立于条件 1、2、3 和 7 的具体实现选择。

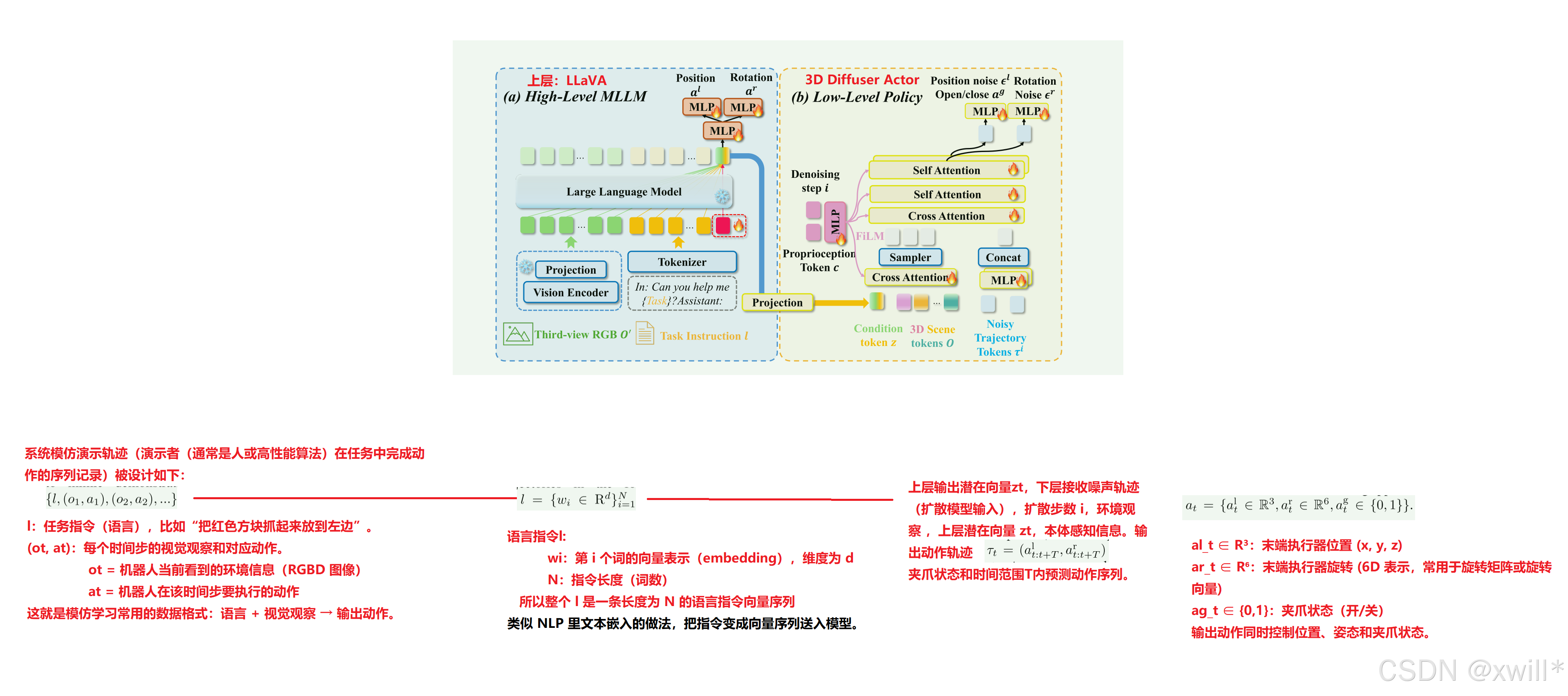

模型选择:本文保持与LCB一致的LLaVA1.0(视觉+语言基础模型)作为视觉语言模型,以保持一致。为消除下游策略架构不同带来的差异,所有后续实验统一使用 3DDA 作为下游策略模型。潜在特征融合方法沿用 LCB,训练方式为“同步训练 + 异步测试”。

数据集处理:LCB 做了聊天式处理(在 <ACT> token 前加 chat-response),但本文暂未实现,只是直接拼接 <ACT> token。实验发现,这种简化方法并不影响性能。

说明:实验的目标是对比系统性能,而不是研究数据处理方式,所以可以暂时简化。

实验环境:核心模拟环境:CALVIN,对比实验保持与已有公开结果一致,后续将补充真实环境实验

目的:保证公平比较,并兼顾未来的真实场景验证

标准评测:主要验证 ABC-D 场景,消融实验只用前 100 次评测,加快速度,最终实验扩展到完整 1000 次评测,保证统计可靠性

这是典型的“先快速筛选,再全面评估”策略。

ABC-D 其实是一个标准化测试集或任务集的代号,用来验证模型在核心能力上的表现,“ABC-D 场景”就是 作者为了标准评测而设定的一组固定任务集合。

更困难的评测 :CALVIN-E:语言泛化能力测试(增强指令),CALVIN-D:动态场景测试(物体移动),考察模型鲁棒性

核心思想:双系统模型不仅要在静态场景表现好,还要在动态、复杂、泛化性强的场景中依然可靠。

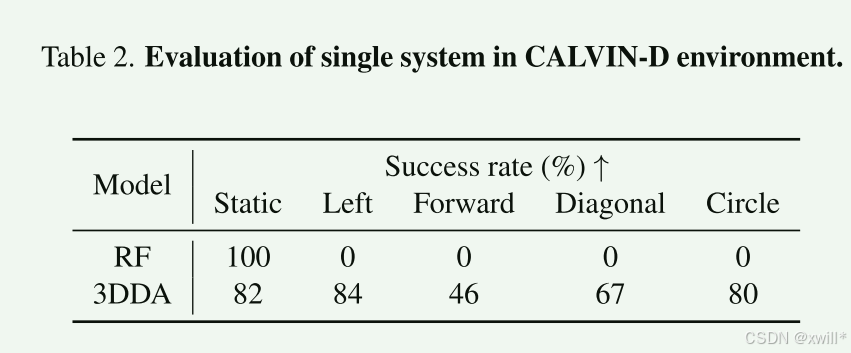

1 Why not single system?

目前双系统的定义具有一定的模糊性,不同论文对双系统的理解和实现方式有所不同,不同的研究者可能有所不同。

而在动态场景 CALVIN-D 下,单系统模型(如 Roboflamingo / RF)直接失败,成功率几乎为零,明单系统模型在动态、复杂场景下鲁棒性不足。因此本文作者侧重评测双系统模型。

训练使用 ABC 数据集,测试使用 CALVIN-D 动态场景,进行100次实验。

RF 模型在动态场景下 成功率为 0。

-

原因:RF 依赖 前 6 帧图像生成 LSTM latent feature 进行动作推理。

-

训练阶段:latent features(潜在特征:指的是 模型内部提取的、高维的抽象表示。) 稳定

-

测试阶段:动态物体导致 latent features 变化 → LSTM 推理失败

-

-

MLLM 引入效果:

-

RF + MLLM 在简单任务下表现良好,比轻量级 3DDA 模型更鲁棒。

-

说明 大模型特征可增强鲁棒性,在双系统架构中可作为“脑”。

-

但是整个实验仅仅针对RF模型,比较局限,感觉不是很有代表性。

2 Training strategy of dual system

双系统模型训练主要分为 三个部分:低层策略(Policy) 的训练方法,高层 MLLM(大型视觉-语言模型) 的训练方法和两系统的连接方法(Integration)。

2.1 Policy Training Strategy

LCB的下游低层策略使用 预训练 3DDA,HiRT使用 RT-1 结构,从零训练,RoboDual使用的是自研下游策略包括:从零训练和在预训练模型上微调

其中,针对大模型的的配置为:LLaVA1.0 + <ACT> token,使用 CLIP Loss 将 <ACT> token 与下游指令对齐。下游策略则分别尝试 预训练 3DDA 或 从零训练策略。

<ACT> token是一种 特殊标记(special token),类似于自然语言模型里的<BOS>、<EOS>或<SEP>。 它的作用是:提示(trigger)大模型输出“动作(Action)”相关的语义或特征。传统的的MLLM输入的是图像和文本,输出的是文本描述或问题答案等,但是在VLA场景下,我们希望模型可以输入图像和指令,输出动作向量。这就需要一个提示信号告诉模型,现在不是继续说话,而是要输出动作相关的信息,于是就引入了

<ACT>token。<span style="background-color:#333333"><span style="color:#b8bfc6">Instruction</span>: <span style="color:#d26b6b">"Pick up the red cube and place it on the shelf."</span> <span style="color:#b8bfc6">→</span> <span style="color:#b8bfc6">模型输入</span>: [<span style="color:#b8bfc6">Image</span>, <span style="color:#d26b6b">"Pick up the red cube and place it on the shelf."</span>, <span style="color:#b8bfc6"><</span><span style="color:#b8bfc6">ACT</span><span style="color:#b8bfc6">></span>]</span>模型通过训练学习到, 当出现

<ACT>时,输出对应的动作嵌入。使用 CLIP Loss 将

<ACT>token 与下游指令对齐:<ACT>token 的输出 embedding,要和下游控制策略的输入空间匹配。CLIP Loss 的目标是让两者的特征空间对齐。

得到的结论:使用 预训练策略 → 性能更高,同时训练时间更短,后续实验都采用在预训练策略上微调

2.2 MLLM Training Strategy

LCB、HiRT、RoboDual的高层大模型都采用 微调,GR00TN1 虽然不是双系统,但采用 冻结(frozen) 训练也表现不错,因此,实验同时比较 冻结 vs 微调 两种方法。

针对大模型的的配置为:LLaVA1.0 + <ACT> token,使用 CLIP Loss 将 <ACT> token 与下游指令对齐。下游策略采用微调方式。同时引入变量状态:在 MLLM 与下游策略连接时是否加入

CLIP Loss*冻结 MLLM:加入或不加入 CLIP Loss 差别不大。微调 MLLM:CLIP Loss 影响明显,不加 CLIP Loss → 下游策略已有注意力机制容易被破坏 → 性能下降。

Prompt Tuning (提示调优)方法:在大模型词汇表中增加新 <ACT> token、仅训练 lm-head 层,其余参数保持冻结。这样做不改变 MLLM 原有的泛化能力并且只学习与下游任务相关的新 token。

经过实验可以得到:

-

标准 CALVIN 测试环境下,Prompt Tuning 性能与其他训练方式相当

-

语言泛化测试中,Prompt Tuning + CLIP Loss 表现显著更好

-

无 CLIP Loss 时,泛化能力甚至略有提升

-

说明 Prompt Tuning 最大程度保持了大模型原有能力

2.3 Dual-System Integration Strategy

由上边的实验可以知道,预训练策略 + Prompt Tuning 微调 MLLM是目前的最佳组合,但是上游(MLLM)与下游策略间存在 语义差距,需要合理连接。

因此采用 MLP Projector 连接上游与下游,并通过直接解冻两端 + 联合训练和先冻结上游,训练 Projector + 下游策略,再解冻上游联合训练两种方式进行实验。(主要区别是,是否单独进行 Projector 预训练)

实验可知:

-

没有预对齐(pre-alignment),直接连接失败 → 说明 Projector 预对齐非常重要

-

从零训练下游策略:两阶段过程可省略,但效果不如使用预训练策略

| 训练组件 | 方法 | 结论 / 优势 |

|---|---|---|

| 下游策略(Policy) | 微调预训练策略 | 提高性能 + 节省训练时间 |

| 上游 MLLM | Prompt Tuning(冻结大部分参数,仅训练新 token) | 保持原模型泛化能力,同时适配下游任务 |

| 系统连接(Integration) | MLP Projector + 预对齐训练 | 解决上游下游语义差距,避免训练失败 |

2.4 Testing strategy of dual system

现阶段的两系统分别负责语义推理和动作控制,那么两个系统之间是同步交互还是异步交互是一个比较关键的问题。

| 模型 | 异步处理方式 |

|---|---|

| LCB | 训练时同步,推理时异步(即训练时两层一起更新,推理时上层慢下层快) |

| HiRT | 训练阶段引入一个 buffer,实现真正的异步训练(即高层和低层频率不同) |

| Robodual | 实时替换高层粗动作为低层推理的动作,实现实时异步 |

本文针对LCB的训练同步 + 推理异步”的方式进行验证。使用 CALVIN-D 动态场景测试。变量:Asynchronous step(即高层MLLM一次推理,对应下层动作多少步)。

-

范围:1 ~ 60 步。

-

对应 3DDA 的最大环境步长 60。

实验发现,不论异步步数是 1 还是 60,性能几乎没有变化。在动态场景下(如物体会移动)也同样。当前的 MLLM(上层大模型)对环境变化不敏感(insensitive),换句话说,它似乎没有真正利用视觉信息,而只是传递语义。

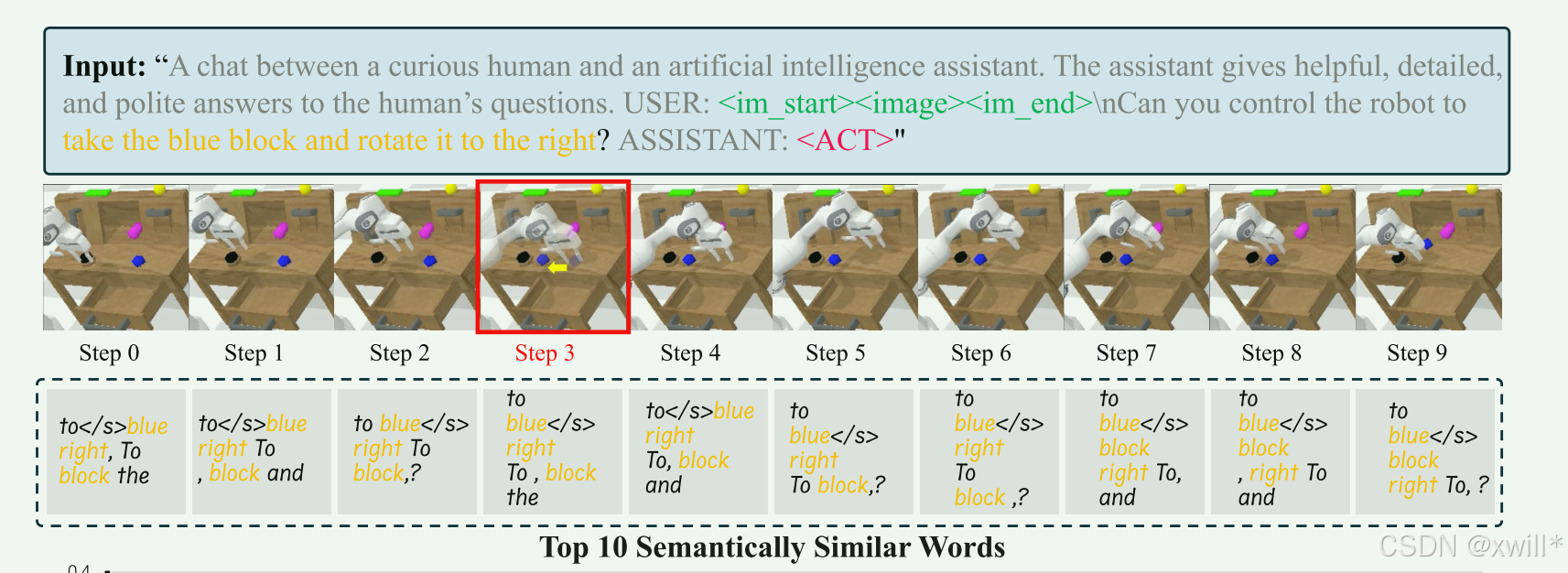

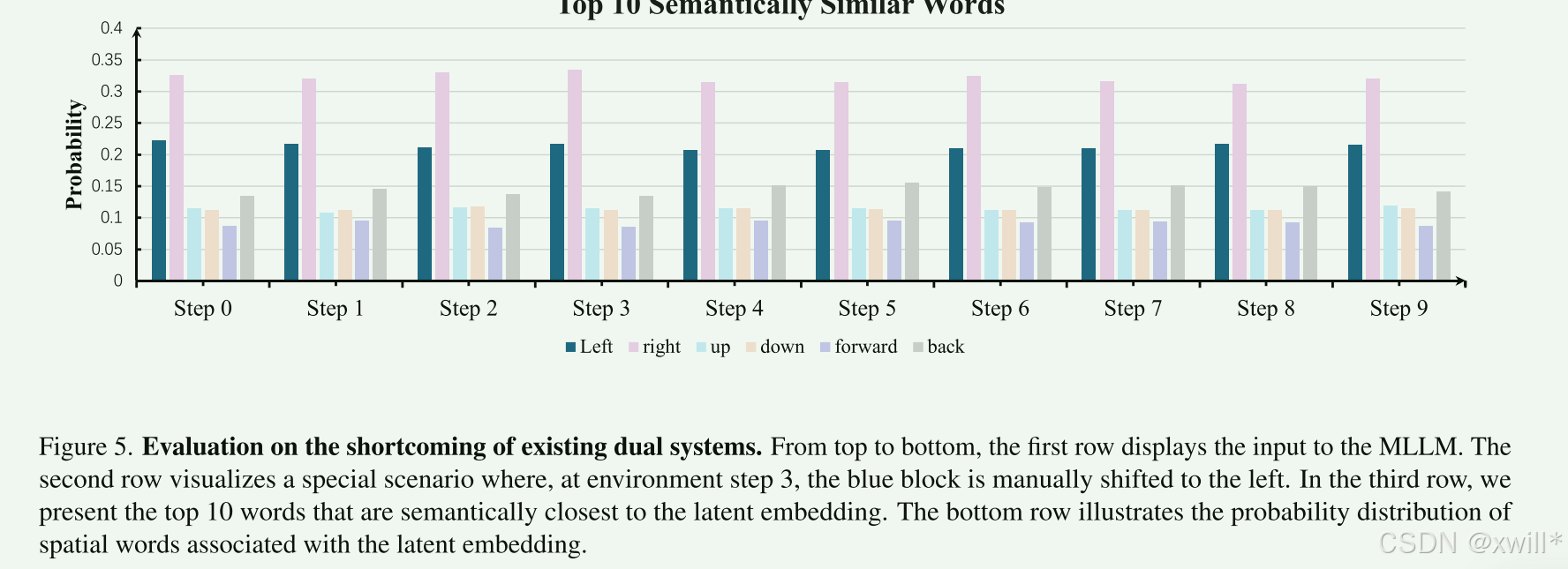

为了进一步探究“为什么大模型对环境变化不敏感”,设计了一个可视化的实验:

-

将 MLLM 输出的

<ACT>动作 token 的潜在向量(latent embedding)映射到语义空间(semantic space); -

分析这些向量与不同“空间方向词”(如 left、right、up、down)的相似度;

-

场景:蓝色方块持续向左移动(left-moving dynamic scene)。

与空间词的相似度:

-

不论机械臂往左还是往右动,

-

“right” 的相似度始终高于 “left”;

-

不同空间介词(up、down、left、right)的概率几乎不变;

-

-

说明: 动作 token 学到的语义特征是固定的,不随环境变化;

-

原因推测: “right” 在语义上还可代表“正确”等抽象含义 → 导致其频率更高。

MLLM 输出的潜在特征(latent embedding)是语义稳定的,与视觉输入(环境变化)无关。

Top 10 相似词分析:

-

MLLM 的 latent embedding 主要包含:

-

指令中提到的 目标对象、

-

空间关系(spatial relation)、

-

动作语义(action semantics),

-

以及一些噪声;

-

-

这些特征基本来源于文本指令本身,而非视觉输入。

当前训练方式下,MLLM 并没有真正进行「视觉推理(visual reasoning)」,它只是把“语言指令语义”传递给下游小模型执行。

2.5 Whether the MLLM of dual system is enough?

主要是探索有没有更好的方式利用上层(MLLM)的信息,让它更有效地帮助下层执行策略。

配置基于之前探究的最优配置:

| 模块 | 配置 |

|---|---|

| 下层(Policy) | 微调(fine-tuning) |

| 上下层连接 | 两阶段投影器(two-stage projector training) |

| 上层(MLLM) | Prompt Tuning 训练范式 |

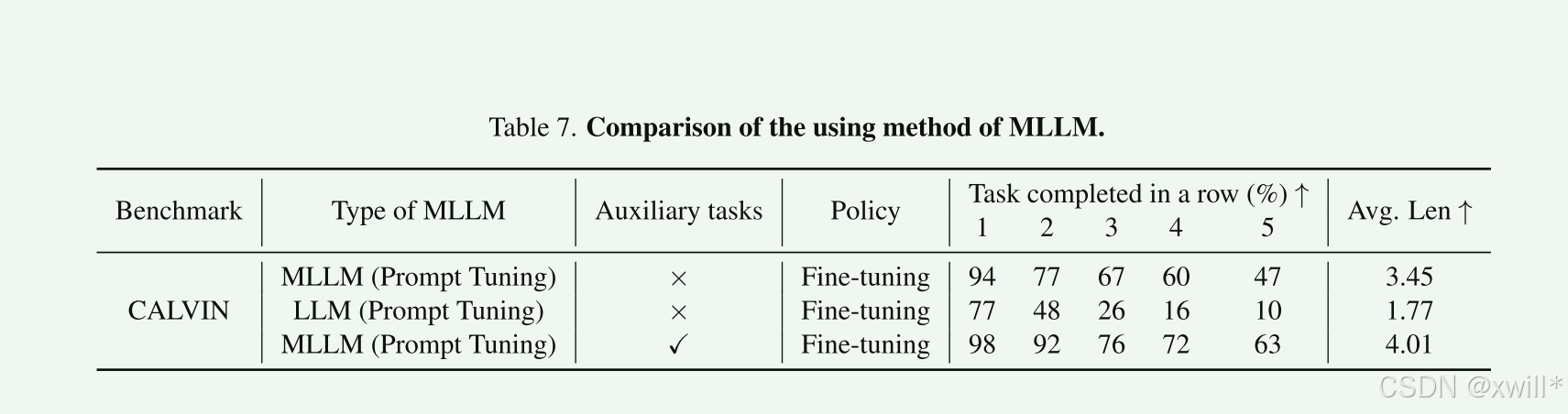

然后设计了三种不同的变体来测试MLLM的作用方式:所有实验都在相同的 CALVIN 测试环境中进行。

| 变体编号 | 配置说明 | 含义 |

|---|---|---|

| ① 标准 MLLM | 正常视觉-语言输入 | 即原始视觉+文本联合输入的多模态模型 |

| ② LLM 模式(无视觉) | 去除视觉输入,只保留语言 | 相当于“只靠语言理解”的模型 |

| ③ 辅助任务 MLLM | 增加辅助损失,让 latent token 连接一个额外的头层(head)去预测动作相关信息(如位置、旋转) | 让模型在训练时“被迫”学习更多视觉-动作关联 |

对比标准 MLLM 与纯 LLM:MLLM 的视觉通道仍在工作,虽然信息传递不够充分。

-

只用语言(LLM) → 表现显著下降;

-

说明:MLLM 并没有退化成“仅靠语言”的模型,它仍具备多模态感知能力;也就是说,视觉输入是有价值的,不能去掉。

增加辅助任务(auxiliary task)后:增加动作相关的辅助损失(auxiliary loss)能显著提高模型在复杂任务中的成功率。这是因为模型被迫学习视觉语义与动作的关联。

-

成功率显著提升;

-

原因:辅助任务强制模型在训练时学习更多与动作相关的视觉信息(如位置或旋转),使得 MLLM 不再只关注语言语义,而真正关注视觉变化。

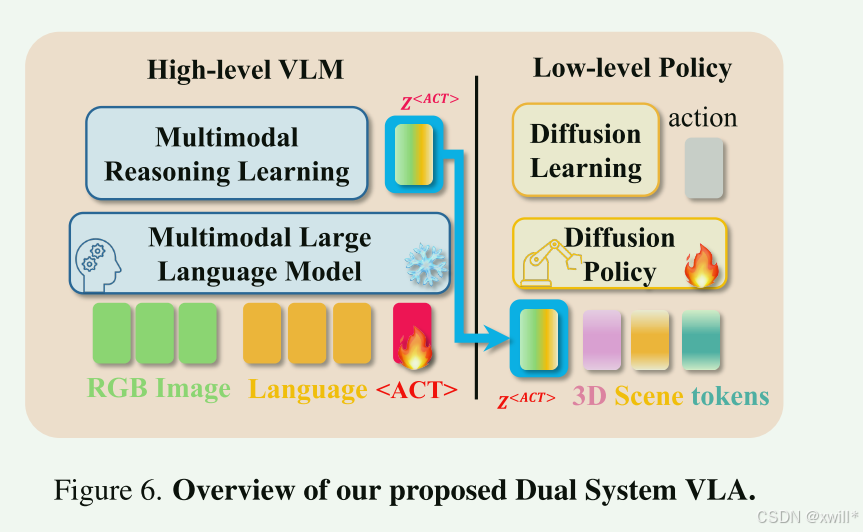

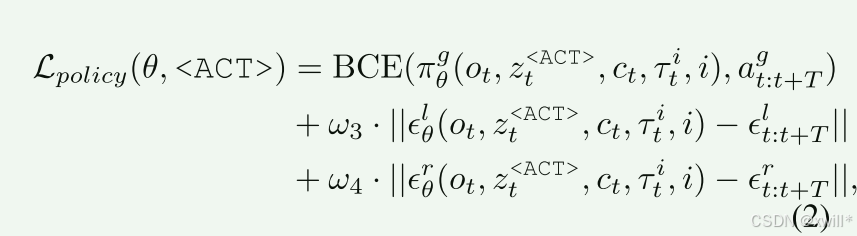

3 A Simple yet Effective Dual System VLA

设计一个简单但有效的双系统 VLA 框架,强化视觉语言动作一体化学习,采用Prompt Tuning 调整大模型输出 + 辅助任务增强视觉推理能力。

3.1 Training

1 Prompt Tuning

避免对大模型(MLLM)本身参数进行微调而导致其泛化能力下降。在语言指令末尾加入一个可学习的 token:

新指令记为:

<ACT> 起到桥梁作用,将高层 MLLM 的输出映射到下游低层策略的输入空间。保留大模型的原始能力,同时针对任务增加适配性。

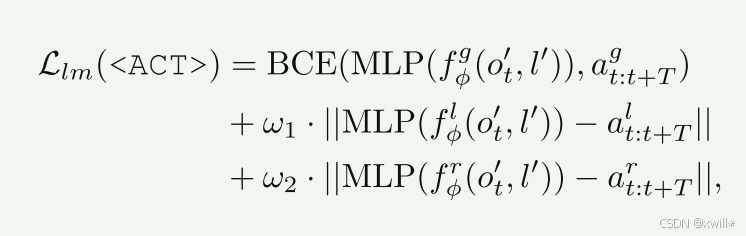

2 Multimodal Reasoning Learning

传统方法只使用文本监督(如 CLIP 文本嵌入),会降低 MLLM 的视觉推理能力。使用 <ACT> 的输出 embedding:

损失函数采用L1 loss:用于 3D 位置和旋转,BCE:用于夹爪开闭二分类监督。迫使 MLLM 充分利用视觉信息,让潜在向量包含多模态信息(视觉+文本)。

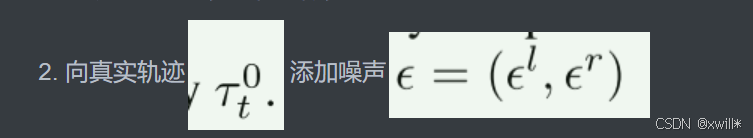

3 Diffusion Learning

采用之前的扩散策略方法,训练过程如下:

-

随机选择时间步 t 和扩散步 i

-

-

模型的目标是 去噪恢复原始轨迹

目标定义如下:

学习从随机噪声轨迹生成高质量动作,增加动作多样性和鲁棒性。

4 Two-Stage Training

-

第一阶段:预对齐(Pre-alignment)

-

冻结大模型和低层策略

-

只训练:

-

Prompt token (

<ACT>) -

投影层(Projection layer)

-

-

目的:对齐 MLLM 输出 embedding 与下层策略输入空间

-

-

第二阶段

-

冻结大模型

-

解冻低层策略,与 prompt 和投影层一起微调

-

目标保持一致:强化低层策略对高层 embedding 的利用

-

5 Implementation Details

-

高层固定 + 可学习 token + 投影层 → 对齐

-

低层微调 → 利用高层 embedding 完成动作生成

-

两阶段策略保证 高层泛化能力不受破坏,同时低层能学会动作生成

三:实验

-

上下层整合的重要性

-

上层 MLLM 与下层策略结合,尤其对 语言泛化场景(language generalization)非常关键

-

整合可以提升模型理解不同语言指令的能力,并生成有效动作

-

-

辅助任务(Auxiliary Tasks)的作用

-

增加辅助任务显著提升:

-

标准任务性能

-

泛化能力

-

-

原因:辅助任务迫使模型学会更多动作相关信息,从而增强执行能力

-

-

异步推理(Asynchronous Inference)影响小

-

即使只执行一次异步推理(Asy(60)),整体性能变化不大

-

说明模型对异步推理步长不敏感,核心信息已经被高层 embedding 捕捉

-

四:总结

要实现和Helix 一样的能力还是比较困难的。目前这个版本也是作者的初步版本,后续还会持续更新。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)