从 Tool Calling 到 MCP

大模型技术正向生产力工具转型,Tool Calling技术解决了模型联动外部能力的问题,而MCP协议则进一步统一了工具调用生态。本文系统梳理了两者的技术逻辑:Tool Calling通过结构化指令实现模型与外部工具的协同工作,MCP则构建了标准化的模型-工具-应用协同体系。重点解析了MCP的C/S架构实践,包括协议网关、元数据中心等核心组件,实现了工具热插拔、全链路管控等优势。两者的结合推动大模型

在大模型(LLM)从 “对话助手” 向 “生产力工具” 转型的过程中,“突破知识边界、实现复杂任务协作” 成为核心需求。Tool Calling(工具调用)技术率先解决了 “模型如何联动外部能力” 的问题,而 MCP(Model Context Protocol,模型上下文协议)则进一步打破了工具调用生态的碎片化困境,构建起 “模型 - 工具 - 应用” 的标准化协同体系。本文将系统梳理两者的技术逻辑,并深入解析 MCP 的 C/S 架构实践。

一、基础:Tool Calling—— 让大模型 “手脚并用”

1. 核心定义:突破模型固有边界

Tool Calling 是大模型在处理用户请求时,通过结构化指令(如 JSON)调用外部工具(API、数据库、本地函数等)的机制。其本质是构建 “模型推理 - 工具执行 - 结果整合” 的闭环:模型负责判断 “是否需要工具”“调用哪个工具”,外部工具负责执行具体操作(如查天气、算数据),最终由模型将工具结果转化为自然语言回答。

例如,当用户询问 “上海今天热吗?”,模型会生成{"tool":"getWeather","params":{"city":"上海"}}的调用指令,客户端执行天气 API 后返回温度数据,模型再输出 “上海当前气温 32℃,请注意防暑”。

2. 标准工作流程(以 Spring AI 为例)

Tool Calling 的落地需经过 4 个关键步骤,确保流程连贯可控:

-

工具定义与注册:通过注解(如

@Tool)或接口声明工具能力,明确输入参数(如城市名)与输出格式(如温度),并注册到模型的 “能力库”; -

请求推理:用户输入自然语言需求,模型分析后判断需调用工具,生成符合格式的调用指令;

-

工具执行:客户端捕获指令,调用对应工具(如 HTTP 请求天气 API),并将结果封装为模型可解析的格式;

-

多轮整合:若工具结果不完整(如缺少日期),模型会发起多轮调用补充信息,最终整合数据生成回答。

3. 典型应用案例

Tool Calling 已在多场景落地,核心价值是 “让模型做擅长的推理,让工具做专业的操作”:

-

智能天气助手(Spring AI):通过

@Tool注解绑定天气查询方法,用户提问后模型调用工具获取数据,生成自然回答; -

数学计算代理(LangChain):定义加法工具并验证参数,用户输入 “5 加 3” 后,模型调用工具返回结果 8.0;

-

企业 OA 集成:结合天气查询与请假申请工具,用户询问天气并申请请假时,模型先查天气再提交申请,同步返回结果。

4. 关键挑战与解决方案

-

调用准确性:通过清晰的工具描述、参数示例引导模型,结合 JSON Schema 验证参数,避免无效调用;

-

多轮交互控制:设定最大调用次数,用提示模板明确终止条件(如 “获取数据后直接回答”);

-

安全性:实施 RBAC 权限控制,限制用户可调用工具范围,在沙箱环境执行危险操作。

二、升级:MCP—— 解决工具调用生态的 “碎片化痛点”

1. MCP 出现的核心原因

Tool Calling 虽扩展了模型能力,但跨框架、跨模型的协作问题凸显,推动 MCP 应运而生:

-

兼容性差:Spring AI 的

@Tool与 LangChain 的StructuredTool格式不互通,切换框架需重构适配代码; -

上下文断层:多轮调用中(如 “查天气→订车票”),模型、工具、应用的状态无法统一管理,易重复传递参数;

-

扩展成本高:新增工具需为每个模型 / 框架单独适配,无法 “一次开发,多端复用”;

-

管控缺失:日志、权限校验需在各组件单独实现,缺乏全链路管控能力。

2. MCP 的核心理论:标准化与上下文协同

MCP 并非工具或框架,而是一套 “模型 - 工具 - 应用” 的交互协议,核心理论支撑有三大支柱:

-

标准化接口层:定义统一的能力注册、调用请求、响应反馈接口。例如,工具注册需提供 ID、参数 Schema,调用请求需包含

context_id(上下文唯一标识),确保所有组件 “说同一种语言”; -

上下文生命周期管理:将上下文(用户需求、工具结果)的生命周期分为 “创建 - 更新 - 复用 - 销毁”,通过

context_id关联全流程数据,避免状态断层; -

元数据驱动发现:建立元数据中心,存储工具 / 模型的能力信息(参数、权限、地址)。模型需调用工具时,可通过 MCP 查询元数据,无需硬编码工具信息。

3. MCP 的应用理念:解耦、扩展、管控

MCP 的落地围绕三大理念,最大化生态协同效率:

-

三层解耦:将 “模型→工具” 的直接绑定,拆分为 “模型→MCP→工具”,模型无需关心工具实现,工具无需适配模型格式,切换组件仅需调整 MCP 配置;

-

动态扩展:支持工具 “热插拔”,新增工具只需在 MCP 元数据中心注册,所有组件即可自动发现并调用,还能串联多工具形成工具链;

-

全链路管控:将权限校验、日志记录、流量控制内置到协议层。例如,元数据中心记录工具权限,MCP 调用前自动校验;全链路日志统一存储,方便问题追溯。

三、实践:MCP 的 C/S 架构 —— 协议中枢驱动协同

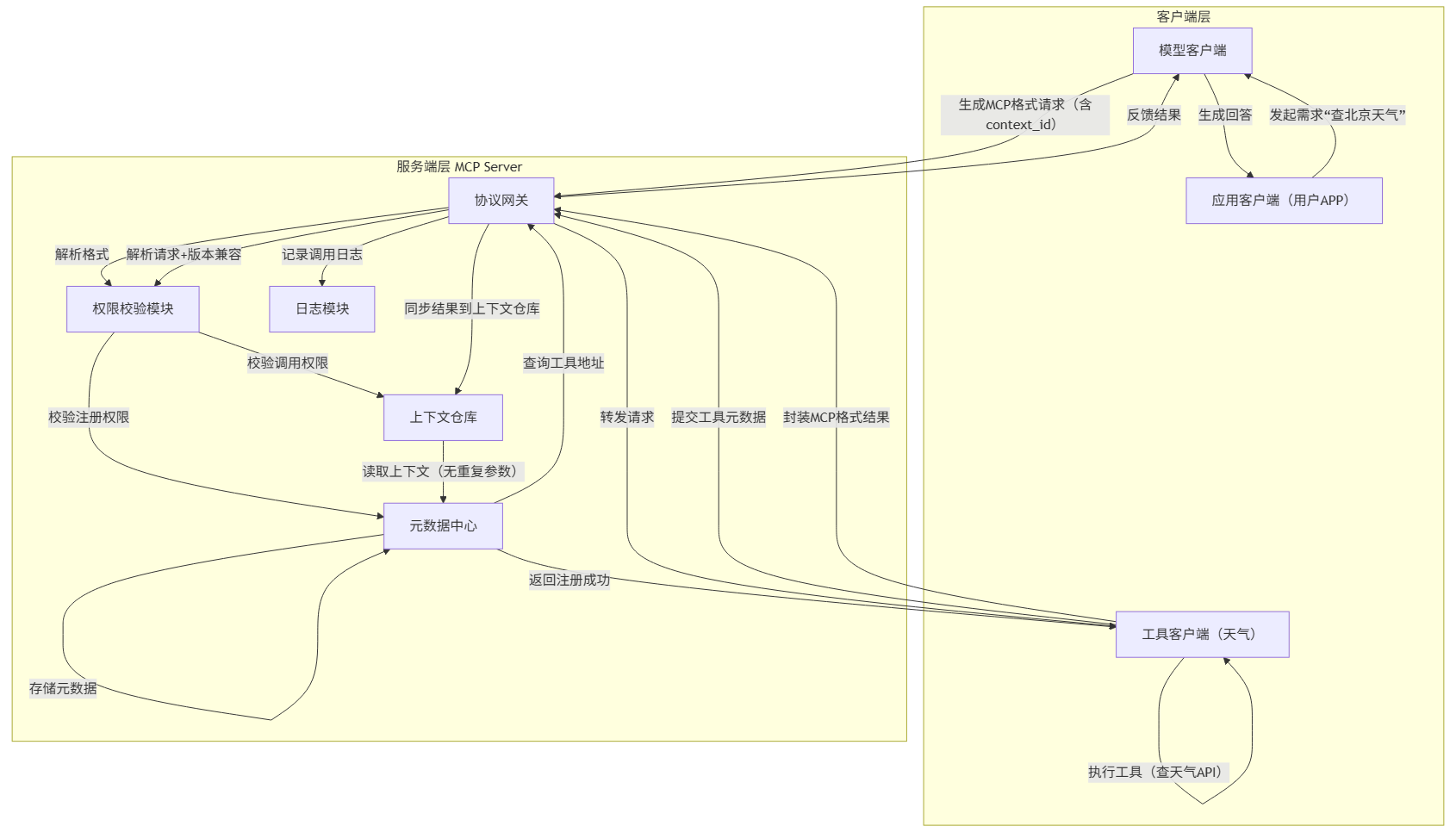

MCP 采用经典 C/S 架构,以 “服务端为协议中枢,客户端为能力节点”,组件职责与流程清晰可控。

1. 架构核心角色与组件

| 层级 | 角色 | 包含组件 | 核心职责 |

|---|---|---|---|

| 客户端层 | 客户端 | 模型客户端、工具客户端、应用客户端 | 发起请求(如模型调用工具)、处理响应(如接收工具结果)、暂存局部上下文; |

| 服务端层 | MCP Server | 协议网关、元数据中心、上下文仓库、权限模块、日志模块 | 解析请求、管理元数据、存储全局上下文、校验权限、记录日志、路由请求; |

-

协议网关:客户端与服务端的入口,负责请求格式解析、协议版本兼容、加密传输;

-

元数据中心:存储工具 / 模型的能力信息,相当于 “能力字典”;

-

上下文仓库:用 Redis 等分布式缓存存储全局上下文,通过

context_id快速查询; -

日志模块:记录所有调用请求、响应、上下文更新,支持全链路追溯。

2. 架构可视化流程(以 “模型调用天气工具” 为例)

3. 架构核心优势

-

协同高效:通过标准化接口与元数据中心,实现 “一次注册,多端复用”,降低扩展成本;

-

状态统一:全局上下文通过

context_id关联,避免多轮调用中的状态断层; -

管控可控:权限、日志、流量控制集中在服务端,无需各组件单独实现,提升安全性与可运维性。

四、总结:从工具调用到生态协同的技术价值

Tool Calling 让大模型从 “只会思考” 变为 “能动手做事”,而 MCP 则让 “做事的过程” 更高效、更可控。两者的结合,不仅解决了大模型的能力边界问题,更构建了 “模型 - 工具 - 应用” 的协同生态:

-

对开发者:降低工具适配成本,无需为不同模型 / 框架重复开发;

-

对企业:提升业务流程自动化效率,通过全链路管控保障安全;

-

对生态:推动大模型应用从 “单点工具调用” 向 “复杂场景协同” 升级。

未来,随着 MCP 等协议的标准化普及,大模型工具调用将在企业 OA、智能终端、自动化运维等领域释放更大潜力,成为连接 AI 能力与实际业务的核心桥梁。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)