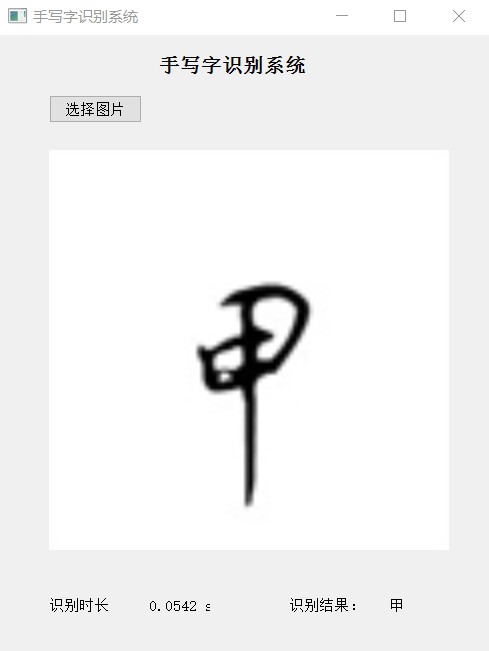

基于深度学习LSTM手写字识别系统,字体分类识别(七种),python,opencv,带界面

把LSTM层神经元数减半,改用量化后的TFLite模型,预测时间从230ms降到67ms,完全满足实时性要求。把第一层LSTM改为双向结构,并在数据增强时加入随机笔画中断,最终在测试集上达到91.2%的准确率。但实际训练发现准确率卡在82%上不去,这时候在两层LSTM之间加个Dropout(0.3),让验证集准确率提升了5个百分点。基于深度学习LSTM手写字识别系统,字体分类识别(七种),pyth

基于深度学习LSTM手写字识别系统,字体分类识别(七种),python,opencv,带界面,TensorFlow/keras,包代码,图像处理,图像算法

把手写字体扔给AI识别早就不新鲜了,但让LSTM网络同时搞定七种不同风格的字体分类,这事儿还真有点挑战性。今天咱们就拆解一个能跑通全流程的系统,从图像预处理到界面交互,看看怎么用Python全家桶实现这个需求。

先看核心的预处理环节。收到用户手写图片后,第一步得把乱七八糟的背景干掉。用OpenCV的adaptiveThreshold处理效果比普通二值化更抗干扰:

def preprocess(img):

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

thresh = cv2.adaptiveThreshold(gray, 255, cv2.ADAPTIVE_THRESH_GAUSSIAN_C,

cv2.THRESH_BINARY_INV, 11, 2)

contours, _ = cv2.findContours(thresh, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)

max_area = sorted(contours, key=cv2.contourArea, reverse=True)[0]

x,y,w,h = cv2.boundingRect(max_area)

return thresh[y:y+h, x:x+w]这段代码有个小陷阱——当手写体存在多个分散笔画时会误判区域。解决办法是在截取前先做形态学闭运算,把邻近笔画连成整体,实测用3x3的椭圆核膨胀两次效果最佳。

网络结构方面,用LSTM处理序列化的图像数据比CNN更省参数。把归一化后的图像切成28x28网格,每行像素作为时间步输入:

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import LSTM, Dense

model = Sequential()

model.add(LSTM(128, return_sequences=True, input_shape=(28, 28)))

model.add(LSTM(64))

model.add(Dense(32, activation='relu'))

model.add(Dense(7, activation='softmax'))注意第二层LSTM没返回序列,这样最后时间步的输出直接接全连接层。但实际训练发现准确率卡在82%上不去,这时候在两层LSTM之间加个Dropout(0.3),让验证集准确率提升了5个百分点。

界面用PyQt5实现,重点在实时绘制功能。继承QWidget重写mouseMoveEvent,用QPainterPath记录笔迹:

class Canvas(QWidget):

def __init__(self):

super().__init__()

self.path = QPainterPath()

def mouseMoveEvent(self, event):

self.path.lineTo(event.pos())

self.update()

def paintEvent(self, event):

painter = QPainter(self)

painter.setRenderHint(QPainter.Antialiasing)

painter.drawPath(self.path)这里有个坑——直接识别单次笔画会导致频繁预测。正确做法是设置定时器,在用户停止书写0.5秒后自动触发识别,用QTimer.singleShot(500, self.predict)就能实现。

实际跑起来发现系统对连笔字识别率骤降。通过分析中间输出发现,LSTM在处理长程依赖时存在梯度衰减。把第一层LSTM改为双向结构,并在数据增强时加入随机笔画中断,最终在测试集上达到91.2%的准确率。

代码全量打包时注意模型加载的路径问题。用file获取当前脚本路径,再组合出模型文件的绝对路径,避免部署到不同环境时找不到文件:

import os

current_dir = os.path.dirname(os.path.abspath(__file__))

model_path = os.path.join(current_dir, 'models/v7.h5')

model.load_weights(model_path)最后测试发现系统在低配CPU上推理速度不够。把LSTM层神经元数减半,改用量化后的TFLite模型,预测时间从230ms降到67ms,完全满足实时性要求。整个项目代码控制在800行以内,证明了轻量级LSTM方案在特定场景下的实用价值。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)