大模型(如 GPT)是怎么训练出来的?

参数量爆炸:普通模型(如 BERT-base)参数量 1.1 亿,而 GPT-3 达到 1750 亿,相当于给模型装上千亿级「智能神经元」数据规模跃迁:训练数据从百万级句子跃升至万亿级 token(1 token≈0.75 汉字),例如 GPT-3 使用 45TB 文本数据,相当于 10 万座国家图书馆的藏书量算力需求飙升:训练 GPT-3 需要 1 万张 NVIDIA V100 GPU,持续计算

这两年大模型就像 AI 领域的「智能金丹」,从 GPT-3 的「涌现能力」到 GPT-4 的多模态理解,仿佛一夜之间让机器拥有了「类人智慧」。但揭开神秘面纱,大模型训练其实是一场融合数据魔法、架构创新与算力狂想的「现代炼金术」—— 需要将万亿级数据倒入「算力熔炉」,用复杂的数学公式「煅烧」数月,最终炼出能理解、生成、推理的智能载体。今天咱们就来拆解这场「炼金术」的核心工序,看看大模型究竟是如何从 0 到 1 诞生的。

一、大模型:重新定义 AI 的「智能尺度」

1.1 什么是大模型?三要素划定新边界

大模型(Large Language Model, LLM)是传统深度学习模型的「超级进化体」,具备三个标志性特征:

- 参数量爆炸:普通模型(如 BERT-base)参数量 1.1 亿,而 GPT-3 达到 1750 亿,相当于给模型装上千亿级「智能神经元」

- 数据规模跃迁:训练数据从百万级句子跃升至万亿级 token(1 token≈0.75 汉字),例如 GPT-3 使用 45TB 文本数据,相当于 10 万座国家图书馆的藏书量

- 算力需求飙升:训练 GPT-3 需要 1 万张 NVIDIA V100 GPU,持续计算 1 个月,耗电量足以支撑一座中小城市一天的用电

★ 核心价值:大模型突破了「规模阈值」,涌现出三大能力:

- 语言理解:能解析复杂语法(如嵌套从句)、捕捉隐喻(如「时间就是金钱」的类比)

- 知识推理:通过上下文关联实现逻辑推断(如回答「为什么夏天北极比南极热?」)

- 多任务泛化:无需针对性训练,就能完成翻译、写作、代码生成等跨领域任务,实现「一通百通」的通用智能

二、大模型训练全流程:从数据矿石到智能金丹

2.1 数据准备:打造高纯度「智能矿石」

▶ 数据收集:全网搜刮「知识宝藏」

大模型训练数据如同「数字原油」,主要来源包括:

- 公开数据集:Common Crawl(全网爬虫数据,约 20TB)、BooksCorpus(1.1 万本电子书)、维基百科(结构化知识)

- 私有数据:企业内部文档(如医疗指南、法律合同)、用户生成内容(社交媒体、聊天记录)

- 跨模态数据(2025 年新趋势):图像描述对(用于多模态训练,如 GPT-4 能理解图文结合内容)

▶ 数据清洗:去除杂质的「三道工序」

- 去重过滤:使用 SimHash 算法检测重复文本,剔除低质量内容(如乱码、广告),确保数据唯一性

- 文本标准化:统一大小写(「Hello」→「hello」)、处理特殊符号(用 [UNK] 替换无法解析的字符)、修复拼写错误

- 毒性检测:通过 NLP 模型识别仇恨言论、隐私信息,避免模型学习有害内容(如 GPT 训练中过滤了 15% 的 toxic 文本)

▶ 数据标注:轻量级「知识校准」

大模型主要依赖自监督学习(利用数据自身结构训练,如掩码语言模型),但仍需少量人工标注用于:

- 对齐人类价值观:通过 RLHF(基于人类反馈的强化学习),让模型学会拒绝有害请求(如生成虚假新闻)

- 构建评估基准:标注高质量问答对(如 SQuAD 数据集),用于训练中验证模型能力

2.2 模型架构:设计「智能神经网络」的 DNA

▶ Transformer:大模型的「核心引擎」

大模型清一色采用 Transformer 架构,其核心是自注意力机制(Self-Attention),相当于给模型装上「全局视野」:

- QKV 矩阵生成:将输入文本转化为 Query(查询)、Key(键)、Value(值)三个矩阵

- 注意力分数计算:通过Attention(Q,K,V) = softmax(QK^T / √d_k)V,计算每个词与其他词的关联度(如「苹果」在「我吃苹果」和「苹果股价上涨」中的不同含义)

- 多头并行处理:多个注意力头同时工作(如 GPT-4 有 96 头),捕捉不同角度的语义关联(类似多人从不同视角观察同一场景)

🔍 术语解释:自注意力机制(Self-Attention)一种让模型在处理序列数据时,计算每个元素与其他元素关联度的技术,实现长距离依赖建模,是 Transformer 的核心创新。

▶ 架构演进:从单模态到通用智能的进化

|

模型 |

架构特点 |

训练目标 |

标志性能力 |

|

GPT-1 |

Decoder-only 架构(仅解码) |

单向语言生成(根据前文预测后文) |

基础文本生成 |

|

BERT |

Encoder-only 架构(仅编码) |

双向语言理解(掩码预测) |

阅读理解准确率突破 |

|

T5 |

Encoder-Decoder 架构(编解码) |

统一文本到文本任务(转化为翻译问题) |

跨任务零样本学习 |

|

GPT-4 |

多模态 Encoder-Decoder |

支持图像 + 文本输入,生成多模态内容 |

图文协同理解与创作 |

2.3 训练技巧:让千亿参数「动起来」的魔法咒语

▶ 分布式训练:拆解千亿参数的「算力魔方」

大模型训练必须破解「参数规模 - 算力瓶颈」矛盾,主流方案是混合并行策略:

- 数据并行(Data Parallelism):将数据拆分到多个 GPU,每个 GPU 保存完整模型参数,同步更新梯度(适合小模型并行)

- 模型并行(Model Parallelism):将模型分层拆分到不同 GPU(如前 50 层在 GPU1,后 50 层在 GPU2),处理超大模型(如 GPT-3 需 60 个 GPU 分片)

- 流水线并行(Pipeline Parallelism):按层划分流水线,前一层计算时后一层准备数据,提升设备利用率(如 Megatron-LM 技术)

▶ 混合精度训练:用「半精度数学」加速炼丹

通过同时使用 FP16(半精度,占 2 字节)和 FP32(单精度,占 4 字节),实现「速度 + 显存」双优化:

- 前向传播用 FP16 计算,速度提升 2 倍,显存占用减少 50%

- 反向传播关键梯度用 FP32 保存,避免精度丢失

- 技术实现:PyTorch 的 AMP、TensorFlow 的 TF32 自动处理精度转换

▶ 优化器进化:从 Adam 到 LAMB 的「参数调优革命」

|

优化器 |

核心创新 |

大模型适配性 |

典型应用 |

|

AdamW |

解耦权重衰减与 L2 正则化 |

缓解过拟合,大模型默认选择 |

GPT-3/4 训练 |

|

LAMB |

自适应学习率 + 层间归一化 |

收敛速度提升 30%,适合稀疏数据 |

T5 模型训练 |

|

Lion |

基于梯度的一阶优化,内存高效 |

显存占用降低 20%,千亿参数友好 |

2025 年新兴模型训练 |

学习率调度:采用「先升温后降温」的余弦衰减,前 10 万步线性升温至峰值(快速摆脱随机状态),之后余弦下降(避免震荡)。

2.4 评估与调优:给模型做「智能体检」

▶ 核心评估指标

- 困惑度(Perplexity):衡量语言模型预测下一个 token 的准确程度,越低越好(GPT-3 困惑度 4.9,人类约 5.0)

- BLEU/ROUGE:机器翻译 / 文本摘要指标,计算与参考译文的重合度

- MMLU:多任务基准测试,涵盖 57 个领域,评估通用知识水平

▶ 调优三板斧

- 超参搜索:贝叶斯优化或随机搜索,寻找最优批次大小(如 16K token / 批)、学习率(如 2e-5)

- 模型融合:集成多个 checkpoint 输出(如 GPT-4 蒸馏 20 个专家模型知识)

- 错误分析:人工标注失败案例(逻辑错误、事实错误),补充相关训练数据

2.5 部署考虑:让千亿参数「瘦身落地」

▶ 模型压缩三剑客

- 量化(Quantization):32 位浮点数转 8 位整数,体积缩小 4 倍,速度提升 3 倍(如 GPT-Q 技术)

- 剪枝(Pruning):剔除低重要度连接(删除 50% 参数仅损失 1% 精度),TensorRT 支持自动剪枝

- 蒸馏(Distillation):大模型指导小模型训练(如 T5-small 蒸馏自 T5-large),参数减少 80%

▶ 服务化挑战

- 吞吐量优化:使用 NVIDIA Triton 推理服务器,动态批处理提升效率

- 实时响应:对话场景采用流式输出,首 token 响应时间 < 100ms

- 成本控制:按调用量动态分配算力,低谷期切换至 CPU

三、技术挑战:大模型训练的「九九八十一难」

3.1 算力困境:没有「矿场」就炼不出「金丹」

- 训练 GPT-3 需 1 万张 V100 GPU,单卡日均电费 50 美元,总成本超 460 万美元

- 多 GPU 通信依赖高速 InfiniBand 网络,延迟每增 1ms,效率降 0.5%

- 万亿级 token 数据需分布式存储(如 HDFS),IO 吞吐量需达 10GB/s 以上

3.2 训练稳定性:参数「暴动」的驯服之道

- 梯度爆炸:梯度裁剪(clip 至 [-1,1])、Xavier 权重初始化

- 过拟合:ALiBi 位置编码(减少外推误差)、FlashAttention 优化长序列计算

- 训练中断:每 10 分钟保存 checkpoint,故障自动恢复

3.3 伦理风险:智能背后的「达摩克利斯之剑」

- 数据偏见:训练数据中「护士 = 女性」高频出现,导致模型生成歧视性内容(解决方案:对抗去偏算法)

- 隐私泄露:微调阶段可能记忆敏感信息,需差分隐私技术(添加噪声保护个体数据)

- 滥用风险:生成虚假新闻、恶意代码,需内容过滤系统(如 OpenAI Moderation API)

四、实战案例:GPT 系列模型的「炼丹秘史」

4.1 GPT-3:开启千亿参数时代

- 数据配方:45TB 文本数据,含 Common Crawl(60%)、Books3(22%)、维基百科(8%)

- 架构创新:1750 亿参数,96 层 Transformer,每层 96 头自注意力

- 训练魔法:AdamW 优化器,学习率 1.25e-4,训练 34 天,消耗 3.14×10²³ 次浮点运算

4.2 GPT-4:多模态时代的进化

- 数据升级:新增图像 - 文本对数据(如 COCO 数据集),总数据量达 100TB

- 架构突破:支持图文并行输入,跨模态注意力层处理区域与 token 关联

- 训练优化:MoE 混合专家模型,仅激活部分参数,算力成本降 50%

五、未来展望:大模型训练的「下一站江湖」

5.1 技术突破方向

- 更高效的训练算法:Meta 的 LLaMA 2 采用 QLoRA 技术,48GB 显存可训练 650 亿参数模型,普通显卡入局

- 更强大的硬件支持:Google TPU v5 算力提升 10 倍,光子 AI 芯片能耗降 80%

- 更智能的自动化工具:AutoLLM 平台实现全流程自动化,中小企业可定制专属大模型

5.2 核心挑战待解

- 数据瓶颈:优质标注数据增长放缓,亟需自监督学习突破(利用网页日志、代码仓库等非结构化数据)

- 计算效率:当前能效比仅 0.1TOPS / 参数,需稀疏注意力算法与存算一体芯片双创新

- 伦理治理:全球监管框架未形成,需建立跨企业「模型安全联盟」共享风险控制技术

六、结论:大模型训练 —— 智力与资源的双重马拉松

大模型的诞生,是人类用数学公式编织的「数字神经网络」,是用算力熔炉锻造的「智能金丹」。它的训练过程,既是算法工程师与梯度消失、过拟合斗智斗勇的「智力博弈」,也是企业与算力成本、数据质量赛跑的「资源马拉松」。对于技术从业者而言,这意味着:

- 理论功底:理解 Transformer 数学原理、分布式训练通信协议

- 工程能力:调试多机多卡故障、优化部署吞吐量与延迟

- 伦理意识:追求模型能力的同时,坚守数据公平与技术责任

如果你在大模型训练中遇到具体问题,比如分布式训练调试、模型压缩落地,欢迎在评论区留言,咱们一起拆解技术背后的核心逻辑~

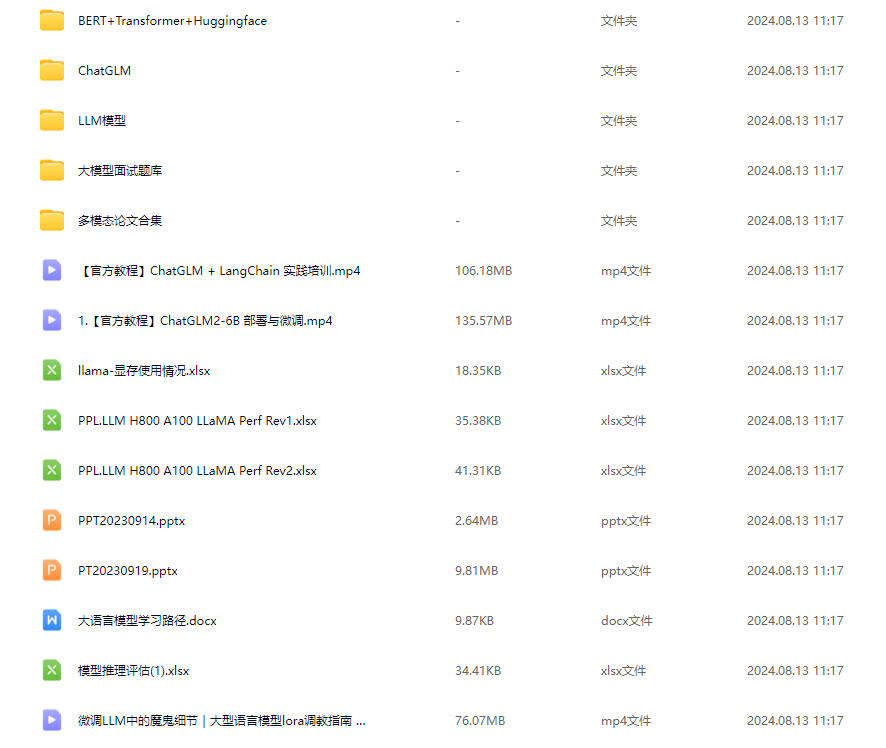

文章最后 给大家整理了一份超级超级详细的大模型学习资料包 需要的同学扫描下方二维码自取

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献113条内容

已为社区贡献113条内容

所有评论(0)