AI Agent:智能体的任务拆解奥秘

本文探讨了AI Agent(智能代理)的核心概念及其与大模型的协同关系。Agent是一种具备感知、思考、执行能力的任务处理系统,通过"感知-思考-动作"的闭环流程完成复杂任务。其核心优势在于能够主动拆解任务并逐步执行,与大模型的被动响应形成互补。Agent依赖大模型进行信息处理和决策,而自身负责任务规划和流程控制。然而,当前Agent面临成本过高(频繁调用大模型API)、自主性

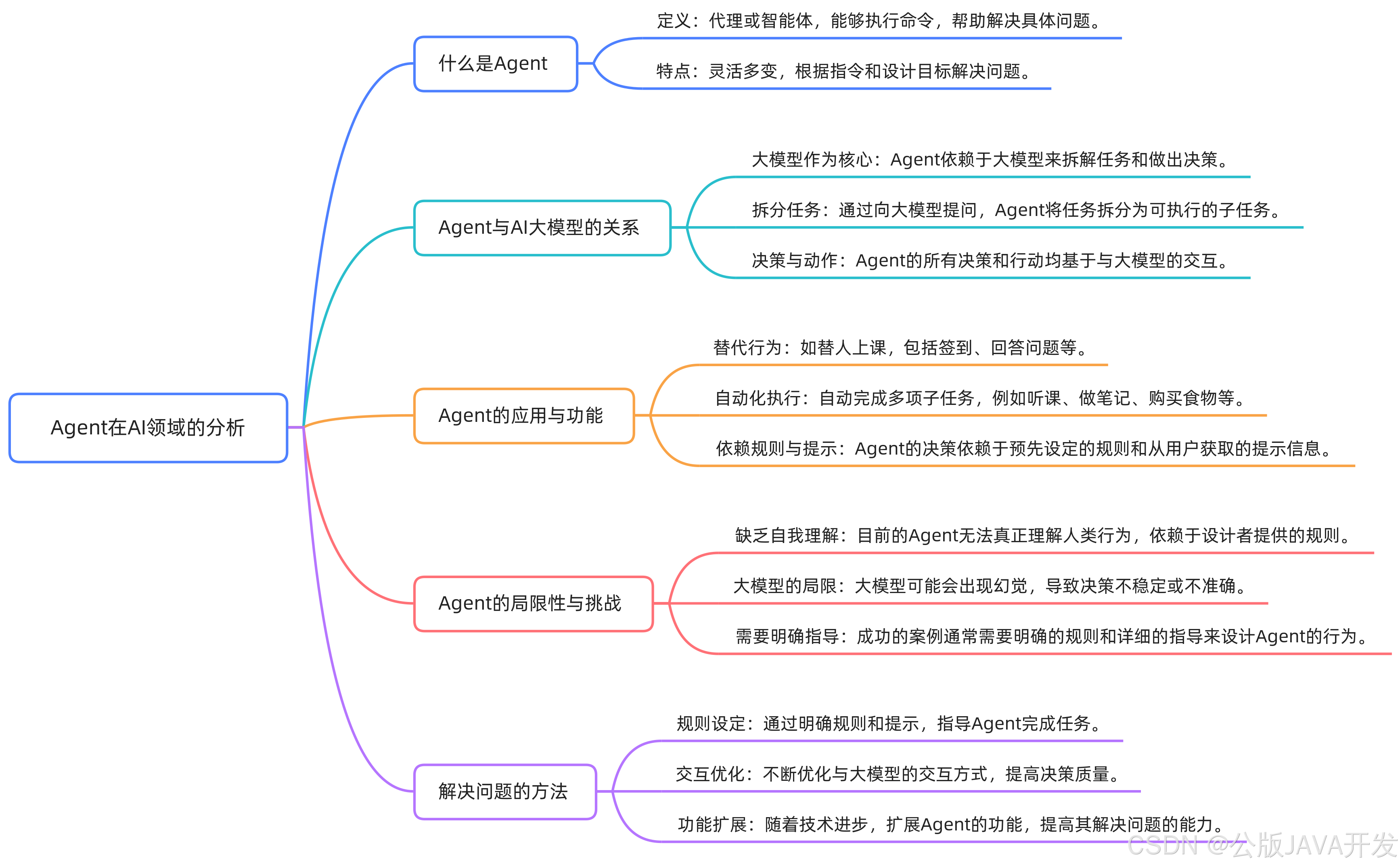

一、什么是Agent?

一、什么是Agent?

1.

定义与翻译:

○

Agent通常翻译为“代理”或“智能体”,是一个灵活、非标准化的概念,可根据设计者意图定制化设计,没有统一的定义或算法流程。

2.

核心功能:

○

接收命令、拆解任务、执行操作。例如,让室友代替自己上课,室友作为Agent需要完成签到、交作业、记笔记、买饭等多个子任务,体现了Agent的任务拆解与执行能力。

二、Agent与大模型的关系与区别

1.

区别:

○

大模型:被动响应,用户提问后直接给出答案,缺乏主动性和任务拆解能力。

○

Agent:主动行为体,理解命令后主动拆解任务并逐步执行,具备更强的自主性和目标导向性。

2.

协作关系:

○

Agent依赖大模型的能力(如理解、生成)来辅助任务拆解和步骤生成。大模型为Agent提供底层的技术支持,而Agent则负责整体的任务规划和执行流程。

三、Agent的任务拆解与执行机制

1.

步骤流程:

○

步骤1:理解用户命令:解析用户的需求和意图。

○

步骤2:任务拆解:将复杂任务分解为多个子任务(如上课任务拆分为签到、交作业、记笔记等)。拆解过程依赖大模型的理解能力,通过设计提示词(Prompt)输入给大模型,生成具体的任务步骤。

2.

关键要素:

○

提示词(Prompt):包含用户需求、背景信息、当前目标等。例如,告知Agent“唐宇迪不想上课但需要复习笔记”,这些信息作为提示词帮助Agent更精准地理解任务重点。

○

规则设定:Agent的执行高度依赖人为预设的规则。例如,替人上课的任务被明确写死为必须完成签到、交作业、记笔记等具体动作,确保执行路径的可控性。

四、Agent的自主性与局限性

1.

自主性辨析:

○

并非真正自主:Agent的决策完全基于大模型的输出结果,本身不具备自我意识或独立思维能力。大模型存在的“幻觉”问题(即生成不准确或错误的信息)也会影响Agent的决策质量。

2.

局限性:

○

依赖规则:若不设置明确规则,Agent的执行效果会显著下降。缺乏结构化引导时,即使大模型能进行思考,结果也可能变得不可控。

○

现实应用现状:当前成功案例多依赖于人工设计的完整流程和明确规则,而非Agent完全自主推理。宣传中可能夸大其智能化程度,实际落地仍需人为干预。

五、Agent的工作机制总结

1.

流程概括:

○

接收命令 → 任务拆解(依赖规则+大模型生成子任务) → 调用大模型生成具体操作 → 串联操作完成整体任务。

2.

核心逻辑:通过规则约束和提示词引导,将大模型的能力嵌入到任务执行的每个环节,实现复杂任务的自动化与流程化。

六、关键启示

1.

设计重点:开发Agent时需注重规则体系的构建和提示词的设计,以弥补大模型的不确定性和幻觉问题。

2.

应用场景:适合需要多步骤协作、流程明确的复杂任务场景,但需避免过度依赖其“自主性”。

3.

未来方向:随着技术进步,可能通过更强大的模型和更完善的规则引擎提升Agent的灵活性和可靠性。

总结:Agent作为AI领域中的“任务执行者”,其价值在于通过规则和提示词将大模型的能力转化为可操作的流程,实现复杂任务的拆解与执行。尽管当前存在自主性不足和依赖规则的局限性,但在结构化场景中仍展现出显著的应用潜力。

<!DOCTYPE html>

<html lang="zh-CN">

<head>

<meta charset="UTF-8"> <!-- 设置文档字符编码为UTF-8 -->

<meta name="viewport" content="width=device-width, initial-scale=1.0"> <!-- 设置视口,使页面适应不同设备 -->

<title>AI Agent与大模型关系</title> <!-- 设置页面标题 -->

<style>

body {

font-family: Arial, sans-serif; /* 设置全局字体 */

margin: 20px; /* 设置页面外边距 */

padding: 20px; /* 设置页面内边距 */

background-color: #f4f4f9; /* 设置背景颜色 */

}

h1, h2 {

color: #333; /* 设置标题颜色 */

}

p {

line-height: 1.6; /* 设置段落行高 */

}

.section {

margin-bottom: 40px; /* 设置每个章节的底部外边距 */

padding: 20px; /* 设置每个章节的内边距 */

border-radius: 5px; /* 设置每个章节的圆角 */

background-color: #fff; /* 设置每个章节的背景颜色 */

box-shadow: 0 2px 4px rgba(0, 0, 0, 0.1); /* 设置每个章节的阴影效果 */

}

.highlight {

background-color: #e7f3fe; /* 设置高亮部分的背景颜色 */

padding: 10px; /* 设置高亮部分的内边距 */

border-radius: 5px; /* 设置高亮部分的圆角 */

}

</style>

</head>

<body>

<h1>AI领域中的Agent:概念、与大模型的关系及任务拆解执行机制</h1> <!-- 页面主标题 -->

<div class="section">

<h2>一、什么是Agent?</h2> <!-- 第一部分标题 -->

<p><strong>定义与翻译:</strong> Agent通常翻译为“代理”或“智能体”,是一个灵活、非标准化的概念,可根据设计者意图定制化设计,没有统一的定义或算法流程。</p> <!-- 定义与翻译内容 -->

<p><strong>核心功能:</strong> 接收命令、拆解任务、执行操作。例如,让室友代替自己上课,室友作为Agent需要完成签到、交作业、记笔记、买饭等多个子任务,体现了Agent的任务拆解与执行能力。</p> <!-- 核心功能内容 -->

</div>

<div class="section">

<h2>二、Agent与大模型的关系与区别</h2> <!-- 第二部分标题 -->

<p><strong>区别:</strong></p> <!-- 子标题 -->

<ul>

<li><strong>大模型:</strong> 被动响应,用户提问后直接给出答案,缺乏主动性和任务拆解能力。</li> <!-- 大模型描述 -->

<li><strong>Agent:</strong> 主动行为体,理解命令后主动拆解任务并逐步执行,具备更强的自主性和目标导向性。</li> <!-- Agent描述 -->

</ul>

<p><strong>协作关系:</strong> Agent依赖大模型的能力(如理解、生成)来辅助任务拆解和步骤生成。大模型为Agent提供底层的技术支持,而Agent则负责整体的任务规划和执行流程。</p> <!-- 协作关系描述 -->

</div>

<div class="section">

<h2>三、Agent的任务拆解与执行机制</h2> <!-- 第三部分标题 -->

<p><strong>步骤流程:</strong></p> <!-- 子标题 -->

<ol>

<li><strong>步骤1:理解用户命令:</strong> 解析用户的需求和意图。</li> <!-- 步骤1描述 -->

<li><strong>步骤2:任务拆解:</strong> 将复杂任务分解为多个子任务(如上课任务拆分为签到、交作业、记笔记等)。拆解过程依赖大模型的理解能力,通过设计提示词(Prompt)输入给大模型,生成具体的任务步骤。</li> <!-- 步骤2描述 -->

</ol>

<p><strong>关键要素:</strong></p> <!-- 关键要素标题 -->

<ul>

<li><strong>提示词(Prompt):</strong> 包含用户需求、背景信息、当前目标等。例如,告知Agent“唐宇迪不想上课但需要复习笔记”,这些信息作为提示词帮助Agent更精准地理解任务重点。</li> <!-- 提示词描述 -->

<li><strong>规则设定:</strong> Agent的执行高度依赖人为预设的规则。例如,替人上课的任务被明确写死为必须完成签到、交作业、记笔记等具体动作,确保执行路径的可控性。</li> <!-- 规则设定描述 -->

</ul>

</div>

<div class="section">

<h2>四、Agent的自主性与局限性</h2> <!-- 第四部分标题 -->

<p><strong>自主性辨析:</strong></p> <!-- 自主性辨析标题 -->

<ul>

<li><strong>并非真正自主:</strong> Agent的决策完全基于大模型的输出结果,本身不具备自我意识或独立思维能力。大模型存在的“幻觉”问题(即生成不准确或错误的信息)也会影响Agent的决策质量。</li> <!-- 自主性描述 -->

</ul>

<p><strong>局限性:</strong></p> <!-- 局限性标题 -->

<ul>

<li><strong>依赖规则:</strong> 若不设置明确规则,Agent的执行效果会显著下降。缺乏结构化引导时,即使大模型能进行思考,结果也可能变得不可控。</li> <!-- 依赖规则描述 -->

<li><strong>现实应用现状:</strong> 当前成功案例多依赖于人工设计的完整流程和明确规则,而非Agent完全自主推理。宣传中可能夸大其智能化程度,实际落地仍需人为干预。</li> <!-- 现实应用描述 -->

</ul>

</div>

<div class="section">

<h2>五、Agent的工作机制总结</h2> <!-- 第五部分标题 -->

<p><strong>流程概括:</strong> 接收命令 → 任务拆解(依赖规则+大模型生成子任务) → 调用大模型生成具体操作 → 串联操作完成整体任务。</p> <!-- 流程概括描述 -->

<p><strong>核心逻辑:</strong> 通过规则约束和提示词引导,将大模型的能力嵌入到任务执行的每个环节,实现复杂任务的自动化与流程化。</p> <!-- 核心逻辑描述 -->

</div>

<div class="section">

<h2>六、关键启示</h2> <!-- 第六部分标题 -->

<p><strong>设计重点:</strong> 开发Agent时需注重规则体系的构建和提示词的设计,以弥补大模型的不确定性和幻觉问题。</p> <!-- 设计重点描述 -->

<p><strong>应用场景:</strong> 适合需要多步骤协作、流程明确的复杂任务场景,但需避免过度依赖其“自主性”。</p> <!-- 应用场景描述 -->

<p><strong>未来方向:</strong> 随着技术进步,可能通过更强大的模型和更完善的规则引擎提升Agent的灵活性和可靠性。</p> <!-- 未来方向描述 -->

</div>

<div class="section highlight">

<h2>总结</h2> <!-- 总结部分标题 -->

<p>Agent作为AI领域中的“任务执行者”,其价值在于通过规则和提示词将大模型的能力转化为可操作的流程,实现复杂任务的拆解与执行。尽管当前存在自主性不足和依赖规则的局限性,但在结构化场景中仍展现出显著的应用潜力。</p> <!-- 总结描述 -->

</div>

</body>

</html>

《AI领域中的Agent:概念、与大模型的关系及任务拆解执行机制》

一、智能体的核心能力

1.

感知能力

○

定义:智能体需具备实时获取环境反馈的能力,包括文本、语音、图像等多模态信息。

○

实际应用案例:

■

在教室场景中,智能体观察到人数稀少,需判断是否执行“代点名”任务。

○

意义:

■

感知是将外部信息转化为**提示(Prompt)**的基础,为后续决策提供依据。

2.

思考能力

○

感知与记忆的关系:

■

智能体从环境中获取的信息会形成记忆,作为后续处理的参考依据。

○

核心挑战:

■

仅记录表面信息可能杂乱无章,无法直接产生价值。

○

关键能力:

■

总结与提炼:需通过大模型对感知信息进行归纳,结合任务目标生成有意义的结论。

○

实际应用案例:

■

帮助他人上课时,智能体观察课堂内容后,建议用户记笔记或总结关键知识点。

3.

动作能力

○

定义:基于思考结果执行的具体操作,是智能体对外部环境的影响手段。

○

具体动作类型:

■

API调用:如查询天气、日期、新闻等。

■

交互操作:发短信、发邮件等。

○

重要性:

■

智能体的“智能程度”主要取决于动作的丰富性和灵活性。

○

协作机制:

■

当不确定如何行动时,智能体可向其他智能体咨询意见,并将反馈整合到自身决策中。

二、任务执行的关键流程

1.

步骤1:感知——获取环境信息

○

实时采集多模态数据(文本、语音、图像等)。

2.

步骤2:思考——分析信息并得出结论

○

结合记忆与任务目标,通过大模型提炼关键信息,生成行动策略。

○

决定调用哪个API、执行何种操作及具体内容。

3.

步骤3:动作——执行具体操作

○

基于思考结果,执行API调用、交互操作或协作咨询。

○

动作结果可能影响环境,触发新一轮感知循环。

三、大模型的核心作用

●

思考阶段的主导者:

○

负责信息总结、策略制定、API选择及内容生成。

●

连接感知与动作的桥梁:

○

将感知数据转化为可执行的动作指令,确保智能体行为连贯且目标导向。

总结: 智能体的高效运作依赖于感知-思考-动作的闭环流程,三者缺一不可。大模型作为思考能力的核心,通过信息处理与策略生成,驱动智能体完成复杂任务。动作设计的灵活性和协作能力进一步提升了智能体的适应性与智能水平。

《Agent与大模型关系及落地难点分析》

一、核心观点阐述

●

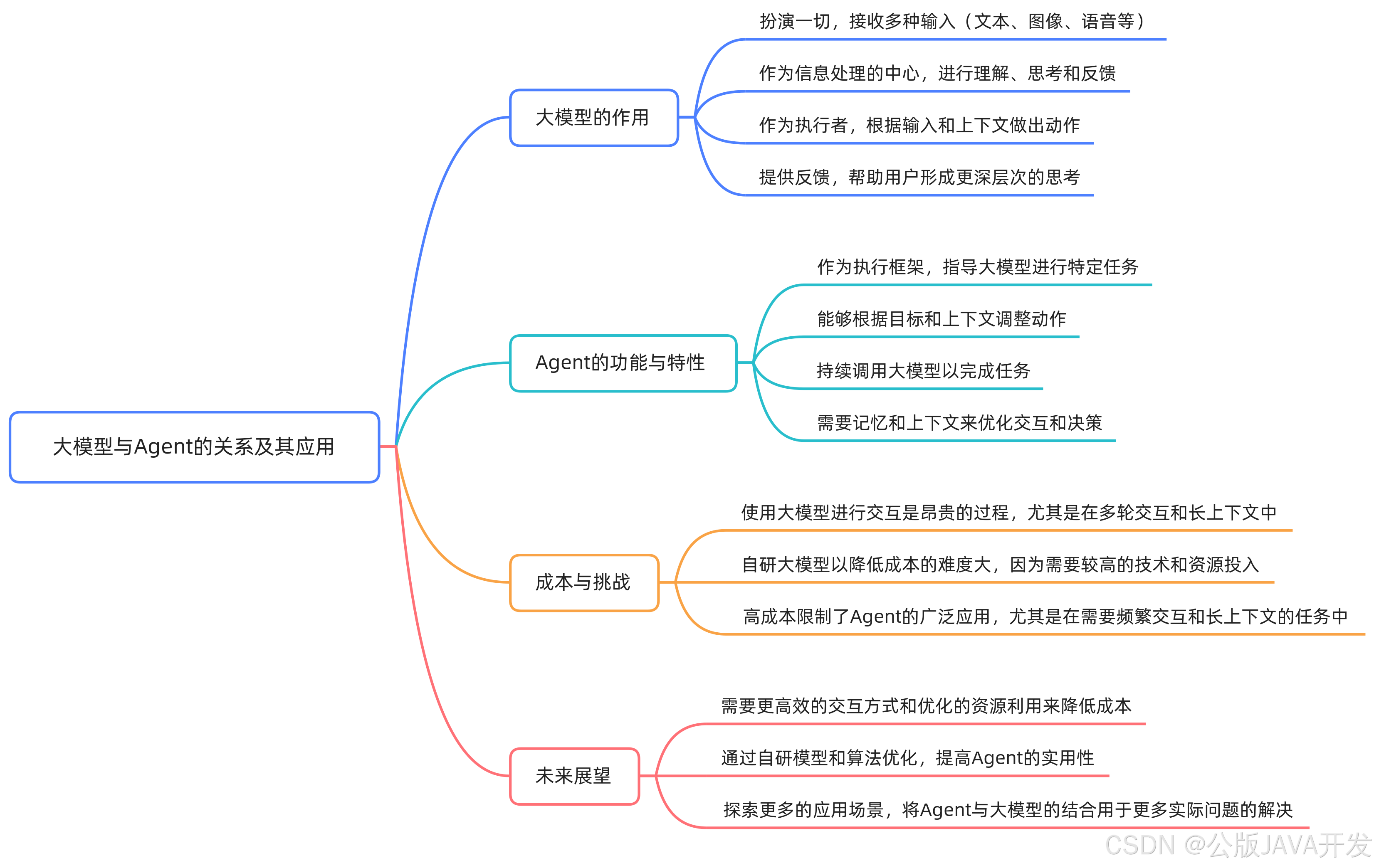

核心概念引入:“Agent”概念的提出,及其与大模型之间关系的探讨。

●

大模型的定位:大模型是“一切”,承担着多模态输入理解、信息处理与输出执行的核心功能,是Agent智能实现的核心支撑。

二、Agent的基本结构与运行机制

1.

基本原则设定:

○

Agent是事先定义好的逻辑框架,遵循“感知-思考-动作”三步闭环流程。

2.

感知阶段:

○

针对任务和目标筛选关键信息,选择性感知,避免全量数据采集。

3.

思考阶段:

○

将感知信息总结为上下文,作为提示词输入大模型,进行推理与决策。

4.

动作阶段:

○

基于思考结果,询问大模型应采取的具体动作并执行。

三、Agent与大 grinding模型的关系

●

调用机制:Agent在感知、思考、动作及记忆更新的每一步均需调用大模型。

●

角色定位:

○

Agent:逻辑框架和任务流程设计者;

○

大模型:细节实际执行者,负责推理、内容生成与决策支撑。

●

协同机制:通过不断调用大模型实现完整智能闭环。

四、Agent落地难点分析

●

主要问题:成本高昂

○

GPT-4等大模型API调用费用极高,单次执行涉及数千次交互,花费巨大。

○

本地自研/部署模型能力不足,难以胜任复杂智能任务。

●

具体场景举例

○

单智能体场景:如代替室友上课,每分钟持续循环三大步骤,成本随时间线性增长。

○

多智能体场景:课堂多角色互动,各Agent独立运行且相互影响,资源需求和成本剧增。

●

记忆机制对成本的影响

○

每步感知需形成记忆,历史记忆用于风险判断与后续认知,但记忆积累导致思考负担加重。

○

上下文变长,token数上升,进一步推高API调用费用。

五、当前Agent应用现状总结

●

缺乏低成本解决方案:尚无平台或服务能低价或免费提供所有Agent功能。

●

根本原因归纳:成本过高是制约Agent广泛应用的核心障碍。

六、最终总结与关系归纳

●

角色分工明确:

○

Agent:负责流程设计、任务管理;

○

大模型:负责细节执行、智能推理。

●

两者协同:

○

Agent通过高频调用大模型,完成感知、思考、动作及记忆更新的智能闭环,实现复杂任务自动化。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)