拆解!Docker如何“降维打击”Ollama?本地LLM部署的权力游戏正在上演!

当 Docker 在今年 4 月首次推出 **Docker Model Runner (DMR)** 时,外界普遍将其视为 Ollama 的“容器化模仿者”——仅支持 GGUF 格式,局限于本地开发。

一、背景:从实验特性到生产组件

当 Docker 在今年 4 月首次推出 Docker Model Runner (DMR) 时,外界普遍将其视为 Ollama 的“容器化模仿者”——仅支持 GGUF 格式,局限于本地开发。

但 11月19日原生集成 vLLM 后端及 .safetensors 支持 的更新,让其定位发生了本质跃迁。DMR 从此摆脱了“玩具”标签,直接具备了生产级的高吞吐能力。对于习惯了 k8s 的工程师来说,这意味着终于可以用管理 Redis 的方式来管理 LLM——告别割裂的工具链,大幅降低异构负载的运维认知负担。

1. DMR 的架构演进:双轨路由机制

DMR 目前的核心逻辑在于根据模型权重的格式,自动路由到底层不同的推理引擎。这种设计试图兼顾本地开发的低资源需求与生产环境的高性能需求。

1.1 开发侧:GGUF 与 llama.cpp

当 DMR 识别到 OCI Artifact 为 .gguf 格式时,它会调用 llama.cpp 后端。

- 场景:本地调试、Apple Silicon 设备、显存受限环境。

- 特性:低冷启动时间,对硬件兼容性极好。

1.2 生产侧:Safetensors 与 vLLM

这是本次更新的核心。当拉取模型权重是 .safetensors 的模型时,DMR 会调用 vLLM 引擎。

- 技术红利:原生获得了 PagedAttention、Continuous Batching(连续批处理)以及 Tensor Parallelism(张量并行)的能力。

- 运维视角:这一层抽象使得基础设施工程师无需深入钻研 vLLM 复杂的 Python 依赖环境配置,直接获得了一个经过厂商验证的、支持高并发的标准推理单元,减少了因环境依赖冲突导致的“生产环境无法启动”事故。

2. 工程视角的差异:显式定义 vs. 隐式便利

在实际落地中,Ollama 和 DMR 代表了两种截然不同的工程哲学。Ollama 倾向于“Convention over Configuration”(约定优于配置),而 DMR 则严格遵循“Explicit is better than Implicit”(显式优于隐式)。

2.1 量化与资源管理的确定性

- Ollama 的动态策略: Ollama 的优势在于极致的易用性。例如,拉取一个模型时,它通常会根据硬件情况默认选择 4-bit 量化版本;运行时会根据 VRAM 负载动态调整 KV Cache 的量化级别。这种“黑盒”优化对个人开发者极其友好,但在生产环境中,“动态”往往意味着“不可复现”。性能波动或精度漂移可能仅仅是因为重启后显存碎片率不同导致的。

- DMR 的静态契约: DMR 沿用了 Docker 镜像的不可变基础设施理念。

- 模型精度被固化在 Tag 中(如

qwen3:4B-F16或gemma3:4B-Q4_K_M)。 - 一旦选定 Tag,无论是在开发笔记本还是生产服务器上,加载的权重二进制流是完全一致的。

- 参数透传(Runtime Flags)必须在 Compose 文件中显式声明(如

--max-model-len),没有隐含的自动调整。 - 这点对于 SRE 至关重要: 它消除了因环境差异导致的“幻觉”概率波动,让故障排查回归到确定的配置版本上。

2.2 基础设施即代码 (IaC) 的集成度

DMR 最显著的变革在于它修改了 Docker Compose 的语法规范。它将 models 提升为与 services、networks、volumes 平级的顶层元素。

这意味着在 Docker 的定义中,AI 模型不再是某个服务内部的附属依赖,而是成为了基础设施中的\“一等公民” (First-class Citizen)。

DMR Compose 示例:

# docker-compose.ymlservices:rag-api: image:my-org/api:v1 # 通过服务名引用,自动注入 LLM_ENDPOINT 环境变量 models: -llm-service# models 现在是顶层配置项models:llm-service: model:ai/llama-3.2:3b-safetensors# 明确指定生产级格式 driver:vllm # 明确指定后端 gpus:all runtime_flags: # 显式控制推理参数 -"--gpu-memory-utilization 0.9"

这种架构上的升维,使得模型服务可以像 Redis 、 PostgreSQL 一样被版本控制、审查和回滚。对于已经建立起 GitOps 流程(如使用 ArgoCD)的团队,DMR 几乎是零成本接入,无需编写额外的 Operator 或复杂的初始化脚本。

3. 技术规格对比

下表从工程落地的维度对 Ollama 与 Docker Model Runner 二者进行对比(2025.11):

| 维度 | Ollama | DMR |

|---|---|---|

| 核心定位 | 极致的本地/边缘推理工具 (Tool) | 标准化的容器化推理组件 (Component) |

| 推理后端 | 定制版 llama.cpp (主力) + 实验性扩展 | vLLM (生产) + llama.cpp (兼容) |

| 硬件兼容 | 高适配性 。自动兼容 AMD ROCm、Intel NPU 及旧版 GPU。 | 有门槛 。Windows/Linux 严格依赖特定 NVIDIA 驱动版本。 |

| 精度控制 | 隐式/动态 。默认优选 Q4,运行时自动优化 KV Cache。 | 显式/静态 。通过 Image Tag 严格锁定模型版本与精度。 |

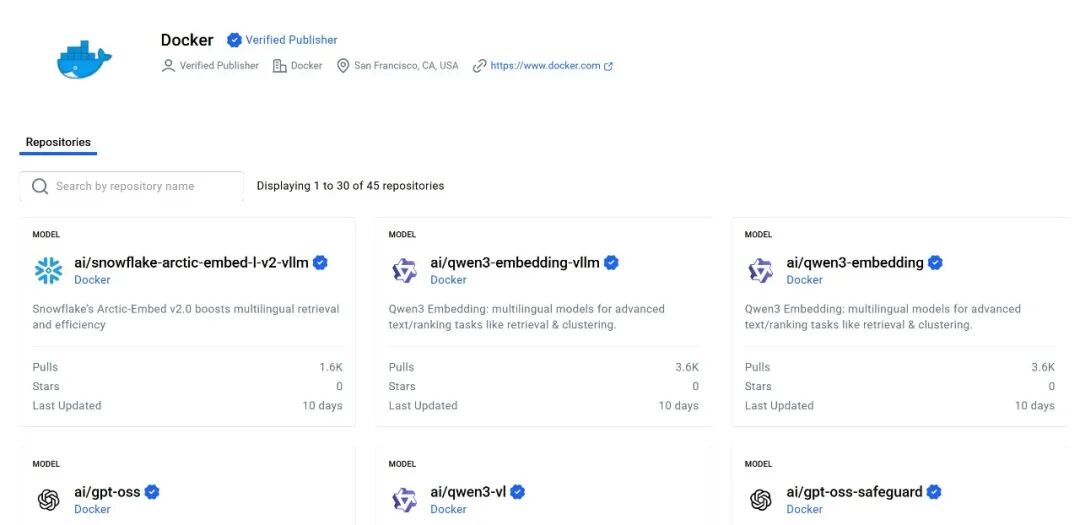

| 权重管理 | 自有 Registry + Modelfile。 | OCI 标准 。复用 Docker Hub/Harbor,支持镜像签名与扫描。 |

| 网络拓扑 | 默认监听 localhost,需配置 host 绑定。 | 天然集成 Docker Network,服务间隔离通信。 |

4. 生态影响与选型思考

本次 vLLM 的加入,补齐了 Docker 在 LLM 基础设施版图中最关键的一块拼图。

供应链的统一

对于企业 IT 部门而言,DMR 的吸引力在于供应链管理的复用。

- 无需新增白名单:无需为 LLM 模型单独维护一套鉴权、存储和传输机制,直接复用现有的 Harbor、Artifactory 以及 RBAC 策略。

- 安全合规更轻松:模型作为 OCI Artifacts,天然支持 Docker Content Trust 签名和漏洞扫描流程。对于那些对数据出境和二进制文件来源极其敏感的 InfoSec 团队来说,DMR 提供了一个更容易通过安全审计的方案。

Ollama 虽然支持私有库,但在企业级安全合规的集成深度上,Docker 生态的既有惯性构成了强大的护城河。下期,我们详细介绍如何使用 DMR 进行本地模型部署。

如何高效转型Al大模型领域?

作为一名在一线互联网行业奋斗多年的老兵,我深知持续学习和进步的重要性,尤其是在复杂且深入的Al大模型开发领域。为什么精准学习如此关键?

- 系统的技术路线图:帮助你从入门到精通,明确所需掌握的知识点。

- 高效有序的学习路径:避免无效学习,节省时间,提升效率。

- 完整的知识体系:建立系统的知识框架,为职业发展打下坚实基础。

AI大模型从业者的核心竞争力

- 持续学习能力:Al技术日新月异,保持学习是关键。

- 跨领域思维:Al大模型需要结合业务场景,具备跨领域思考能力的从业者更受欢迎。

- 解决问题的能力:AI大模型的应用需要解决实际问题,你的编程经验将大放异彩。

以前总有人问我说:老师能不能帮我预测预测将来的风口在哪里?

现在没什么可说了,一定是Al;我们国家已经提出来:算力即国力!

未来已来,大模型在未来必然走向人类的生活中,无论你是前端,后端还是数据分析,都可以在这个领域上来,我还是那句话,在大语言AI模型时代,只要你有想法,你就有结果!只要你愿意去学习,你就能卷动的过别人!

现在,你需要的只是一份清晰的转型计划和一群志同道合的伙伴。作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。

第一阶段(10天):初阶应用

该阶段让大家对大模型 AI有一个最前沿的认识,对大模型 AI 的理解超过 95% 的人,可以在相关讨论时发表高级、不跟风、又接地气的见解,别人只会和 AI 聊天,而你能调教 AI,并能用代码将大模型和业务衔接。

- 大模型 AI 能干什么?

- 大模型是怎样获得「智能」的?

- 用好 AI 的核心心法

- 大模型应用业务架构

- 大模型应用技术架构

- 代码示例:向 GPT-3.5 灌入新知识

- 提示工程的意义和核心思想

- Prompt 典型构成

- 指令调优方法论

- 思维链和思维树

- Prompt 攻击和防范

- …

第二阶段(30天):高阶应用

该阶段我们正式进入大模型 AI 进阶实战学习,学会构造私有知识库,扩展 AI 的能力。快速开发一个完整的基于 agent 对话机器人。掌握功能最强的大模型开发框架,抓住最新的技术进展,适合 Python 和 JavaScript 程序员。

- 为什么要做 RAG

- 搭建一个简单的 ChatPDF

- 检索的基础概念

- 什么是向量表示(Embeddings)

- 向量数据库与向量检索

- 基于向量检索的 RAG

- 搭建 RAG 系统的扩展知识

- 混合检索与 RAG-Fusion 简介

- 向量模型本地部署

- …

第三阶段(30天):模型训练

恭喜你,如果学到这里,你基本可以找到一份大模型 AI相关的工作,自己也能训练 GPT 了!通过微调,训练自己的垂直大模型,能独立训练开源多模态大模型,掌握更多技术方案。

到此为止,大概2个月的时间。你已经成为了一名“AI小子”。那么你还想往下探索吗?

- 为什么要做 RAG

- 什么是模型

- 什么是模型训练

- 求解器 & 损失函数简介

- 小实验2:手写一个简单的神经网络并训练它

- 什么是训练/预训练/微调/轻量化微调

- Transformer结构简介

- 轻量化微调

- 实验数据集的构建

- …

第四阶段(20天):商业闭环

对全球大模型从性能、吞吐量、成本等方面有一定的认知,可以在云端和本地等多种环境下部署大模型,找到适合自己的项目/创业方向,做一名被 AI 武装的产品经理。

- 硬件选型

- 带你了解全球大模型

- 使用国产大模型服务

- 搭建 OpenAI 代理

- 热身:基于阿里云 PAI 部署 Stable Diffusion

- 在本地计算机运行大模型

- 大模型的私有化部署

- 基于 vLLM 部署大模型

- 案例:如何优雅地在阿里云私有部署开源大模型

- 部署一套开源 LLM 项目

- 内容安全

- 互联网信息服务算法备案

- …

学习是一个过程,只要学习就会有挑战。天道酬勤,你越努力,就会成为越优秀的自己。

如果你能在15天内完成所有的任务,那你堪称天才。然而,如果你能完成 60-70% 的内容,你就已经开始具备成为一名大模型 AI 的正确特征了。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献515条内容

已为社区贡献515条内容

所有评论(0)