大模型本地部署

大模型是不能在本地运行,需要借助一些环境,ollama带着大模型本地运行环境,ollama就是一个大模型管理平台,有了ollama可以下载所有的开源的大模型,打开官方网站进行下载。创建API密钥,然后就可以在CherryStudio进行配置硅基流动了,见截图,用的时候不要选带pro的模型,因为带pro是要钱的,不能用赠送的token。创建API key,需要充值才可以用,设置好之后,可以通过第三方

一、安装ollama

大模型是不能在本地运行,需要借助一些环境,ollama带着大模型本地运行环境,ollama就是一个大模型管理平台,有了ollama可以下载所有的开源的大模型,打开官方网站进行下载

ollama官⽹https://ollama.com/

ollama下载参考上一篇

ollama实际使用的时候最好用一些第三方的工具,见下一步

二、安装第三方界面工具,CherryStudio客户端

- CherryStudio是一个支持多个大模型厂商的聊天客户端,可以接入本地部署的大模型,也可以接入第三方厂商大模型api,可以进行聊天,还提供了知识库,功能界面都比较友好

1、登录CherryStudio官⽹:https://cherry-ai.com/,下载客⼾端。

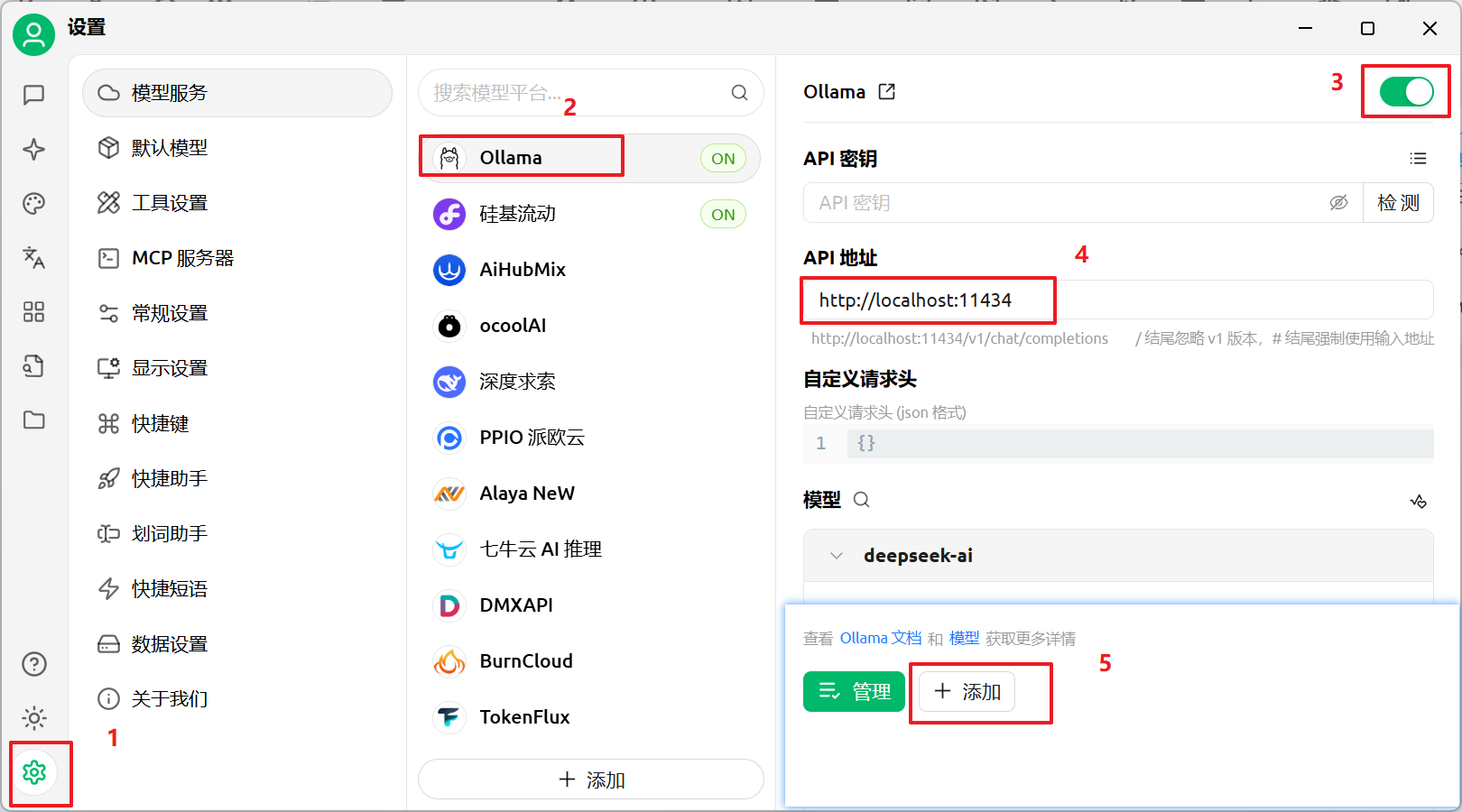

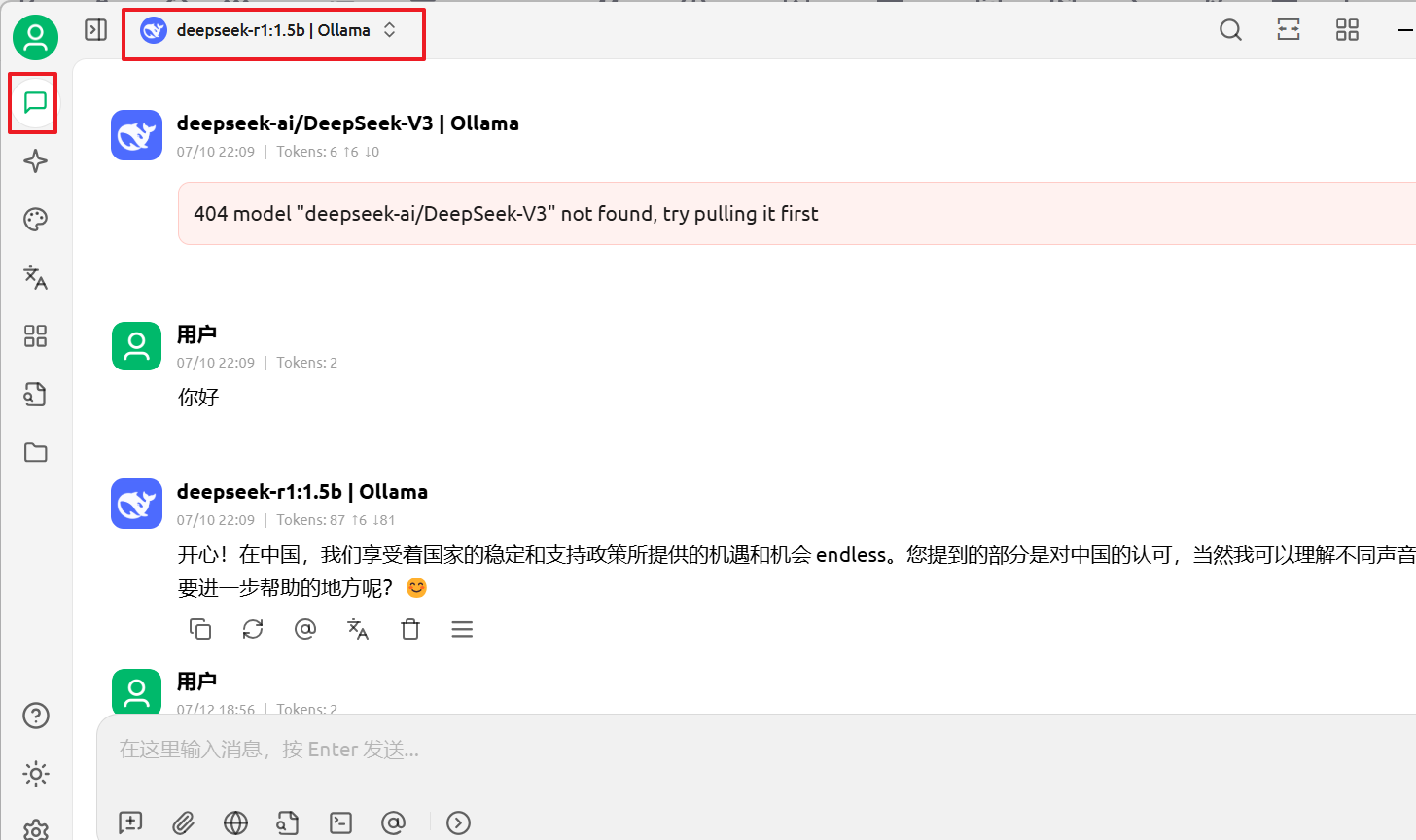

2、在CherryStudio里面配置ollama,根据截图步骤操作,API地址为默认地址:http://localhost:11434,添加ollama已经有的大模型,配置好就可以选择ollama进行对话了

三、大模型远程API的调用

- 工作中我们可能不会用本地的大模型,本地大模型比较消耗资源,智能程度可能也没那么高,有时候会用大模型第三方的API

desspseek远程API调用

1、申请Deepseek官方API

登录官网https://platform.deepseek.com/usage

创建API key,需要充值才可以用,设置好之后,可以通过第三方客户端(如:CherryStudio),配置API key访问

2、申请硅基流动DeepSeek API

注册会送token,邀请也会送(硅基流动用户系统,统一登录 SSO,IRhJBXf8,邀请码硅基流动用户系统,统一登录 SSO,)

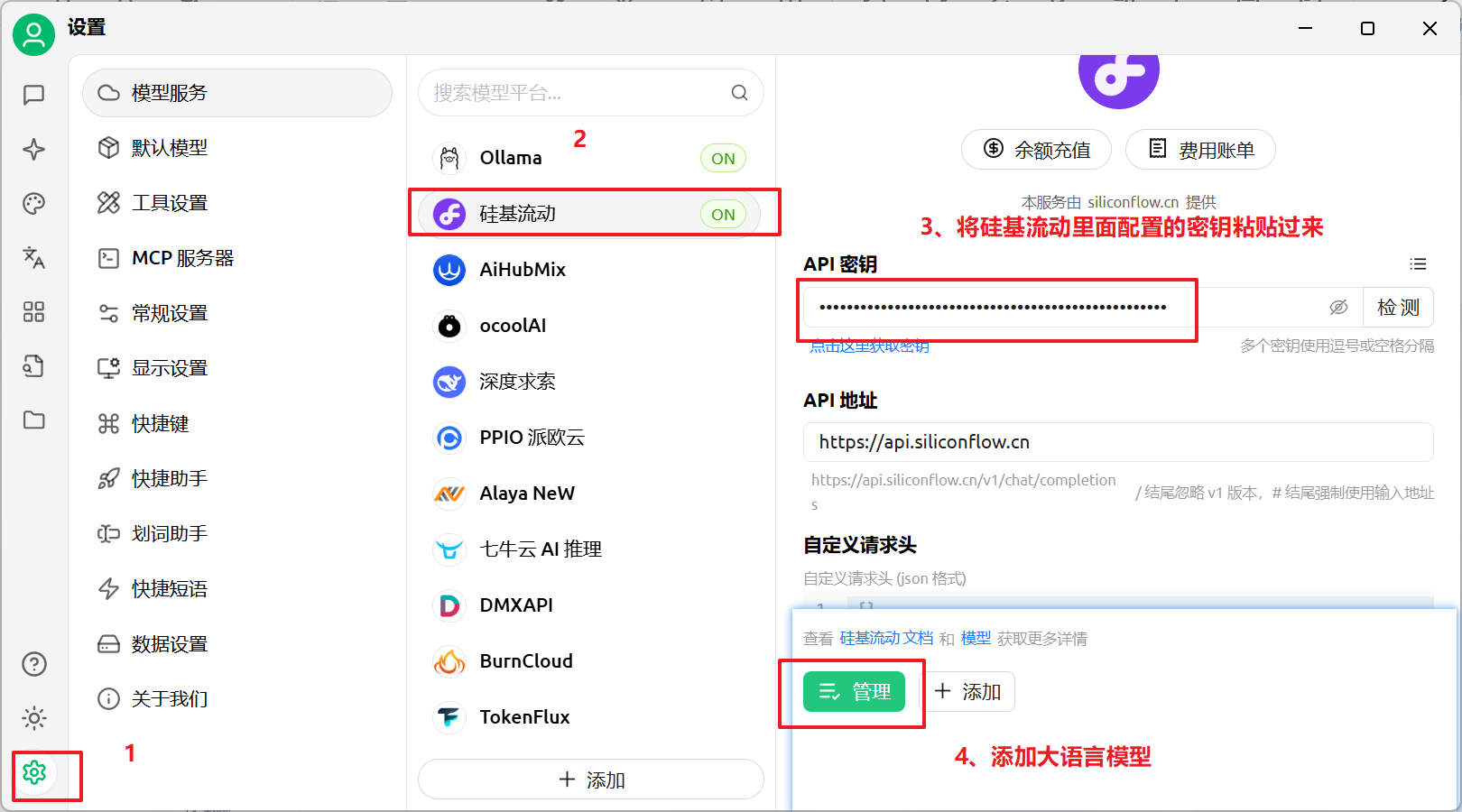

创建API密钥,然后就可以在CherryStudio进行配置硅基流动了,见截图,用的时候不要选带pro的模型,因为带pro是要钱的,不能用赠送的token。

3、火山引擎DeepSeek

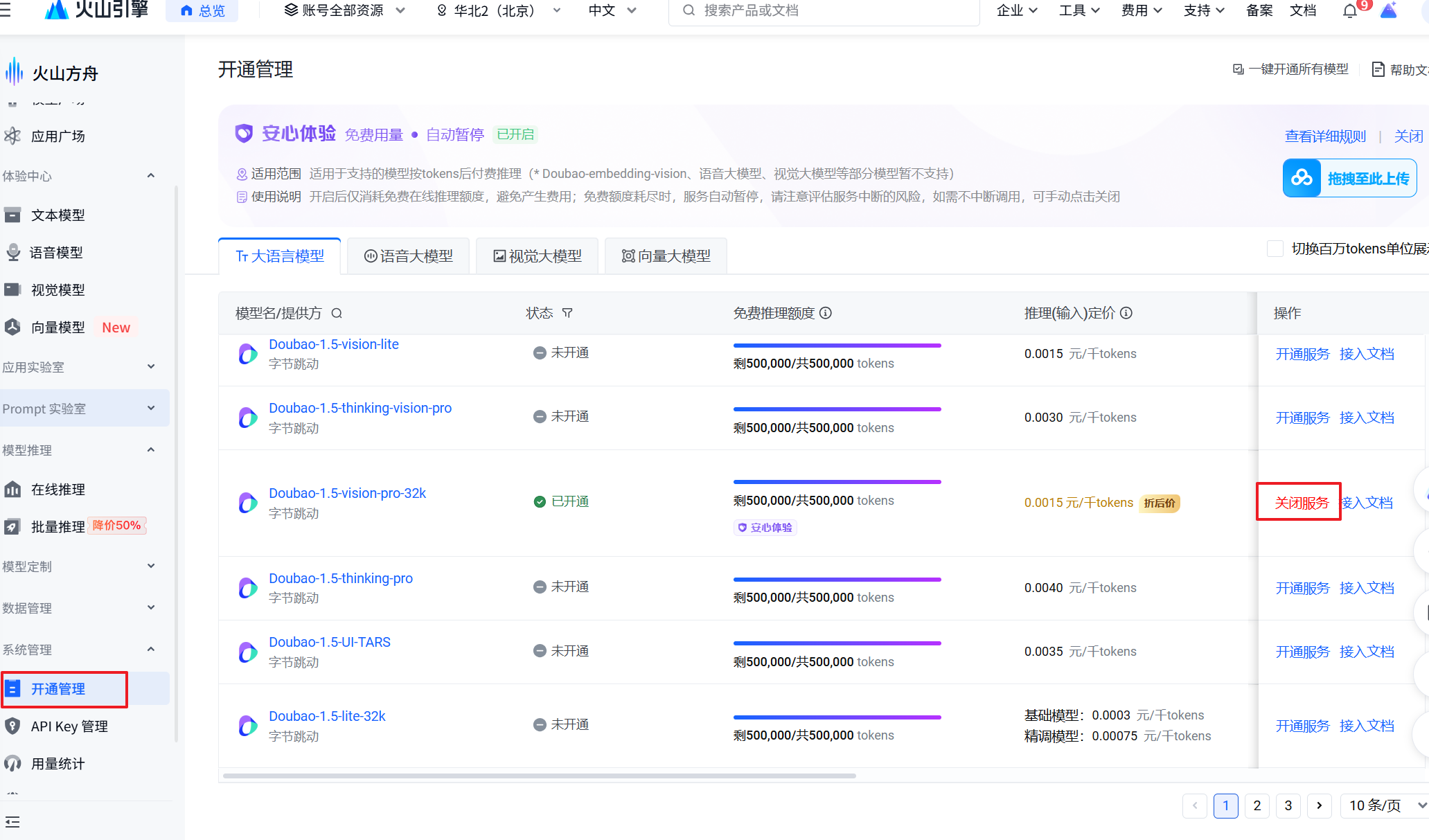

1、开通火山引擎DeepSeek

优点:不限速

先注册,注册成功后在浏览器里面打开火山引擎的官方网站https://console.volcengine.com/ark/region:ark+cn-beijing/model?

vendor=Bytedance&view=LIST_VIEW

登录,点击左侧“开通管理”-“开通服务”

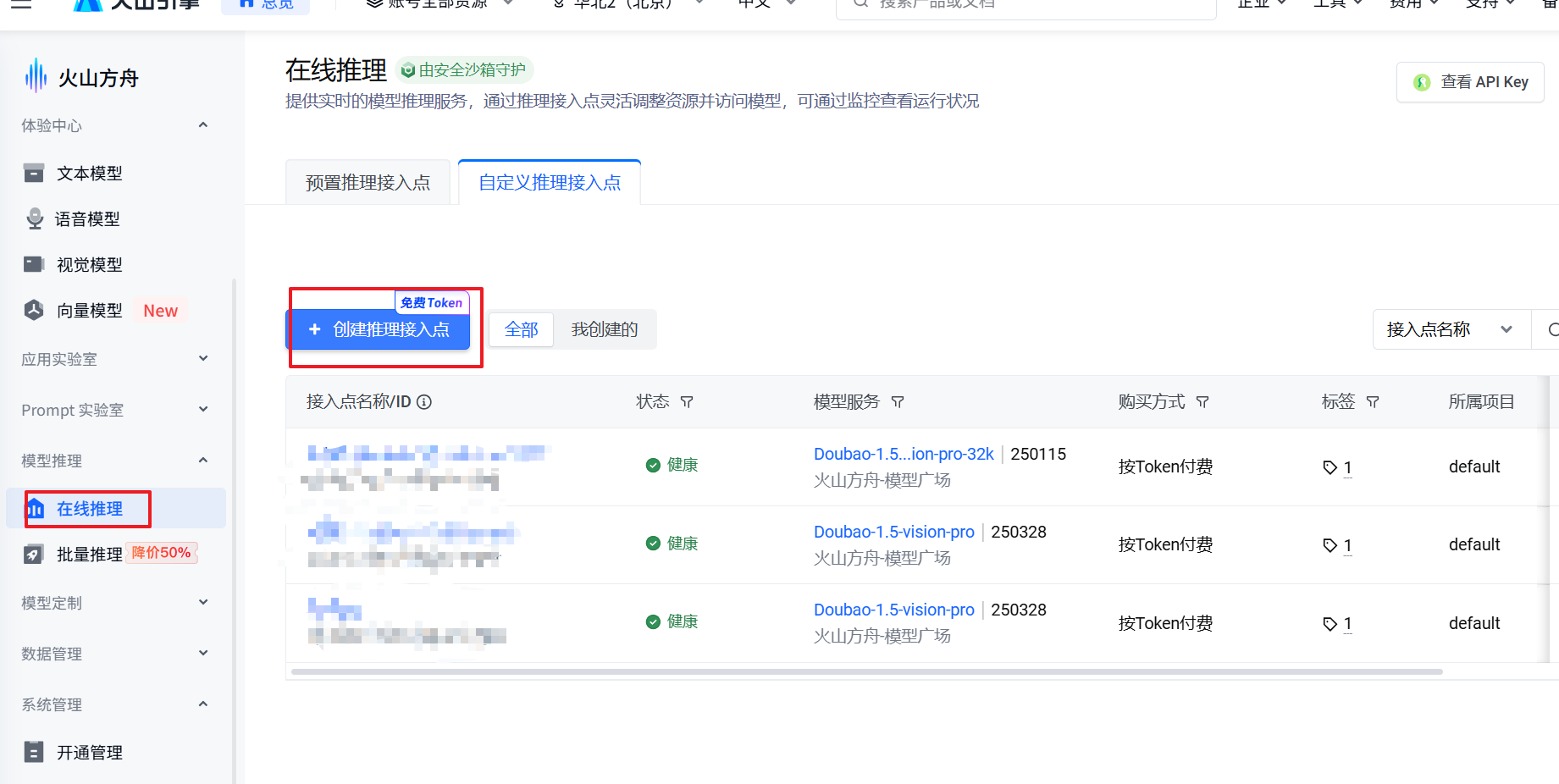

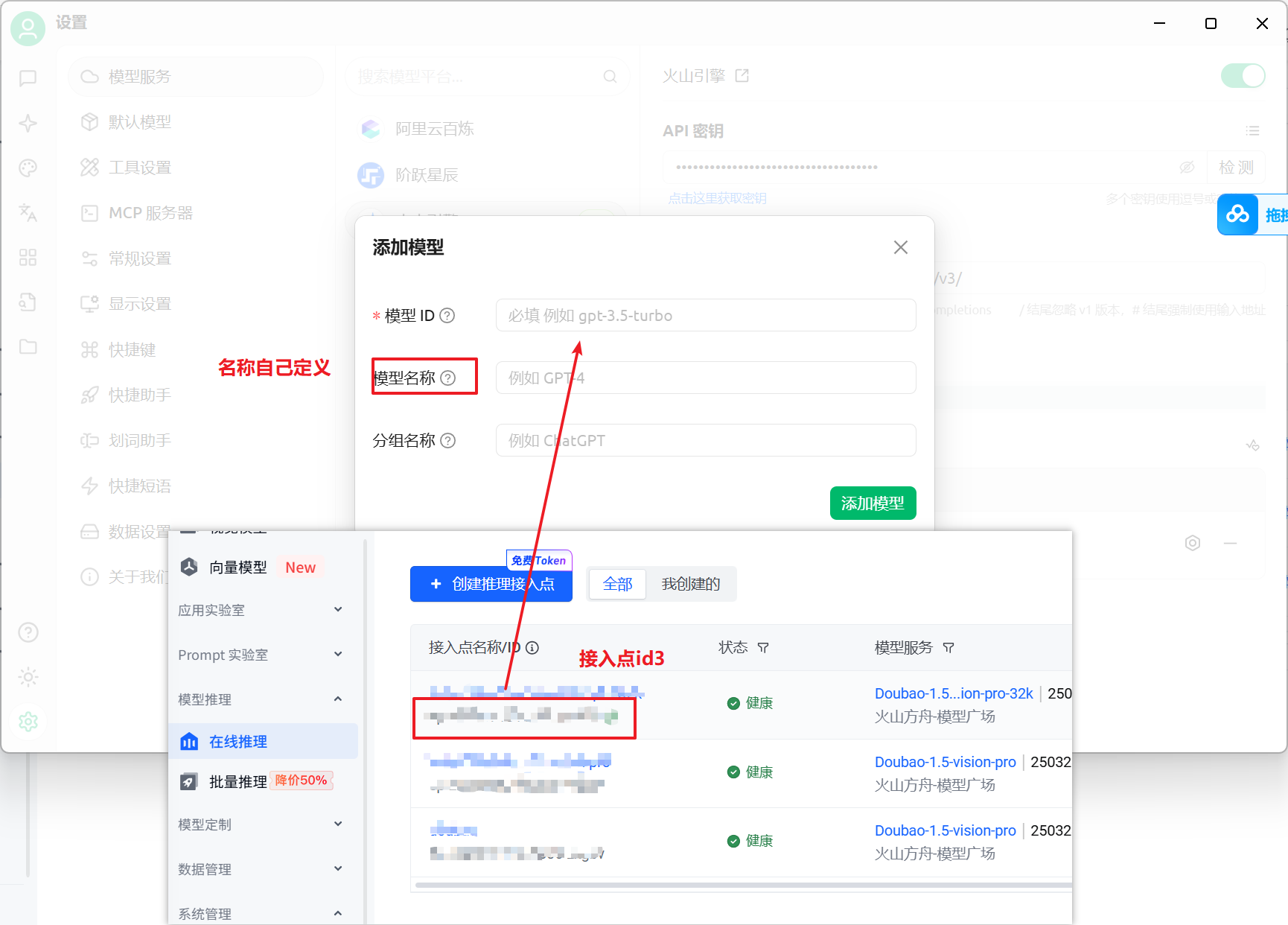

创建推理接入点,相当于创建API接口

点击左侧菜单“在线推理”-“创建推理接入点”

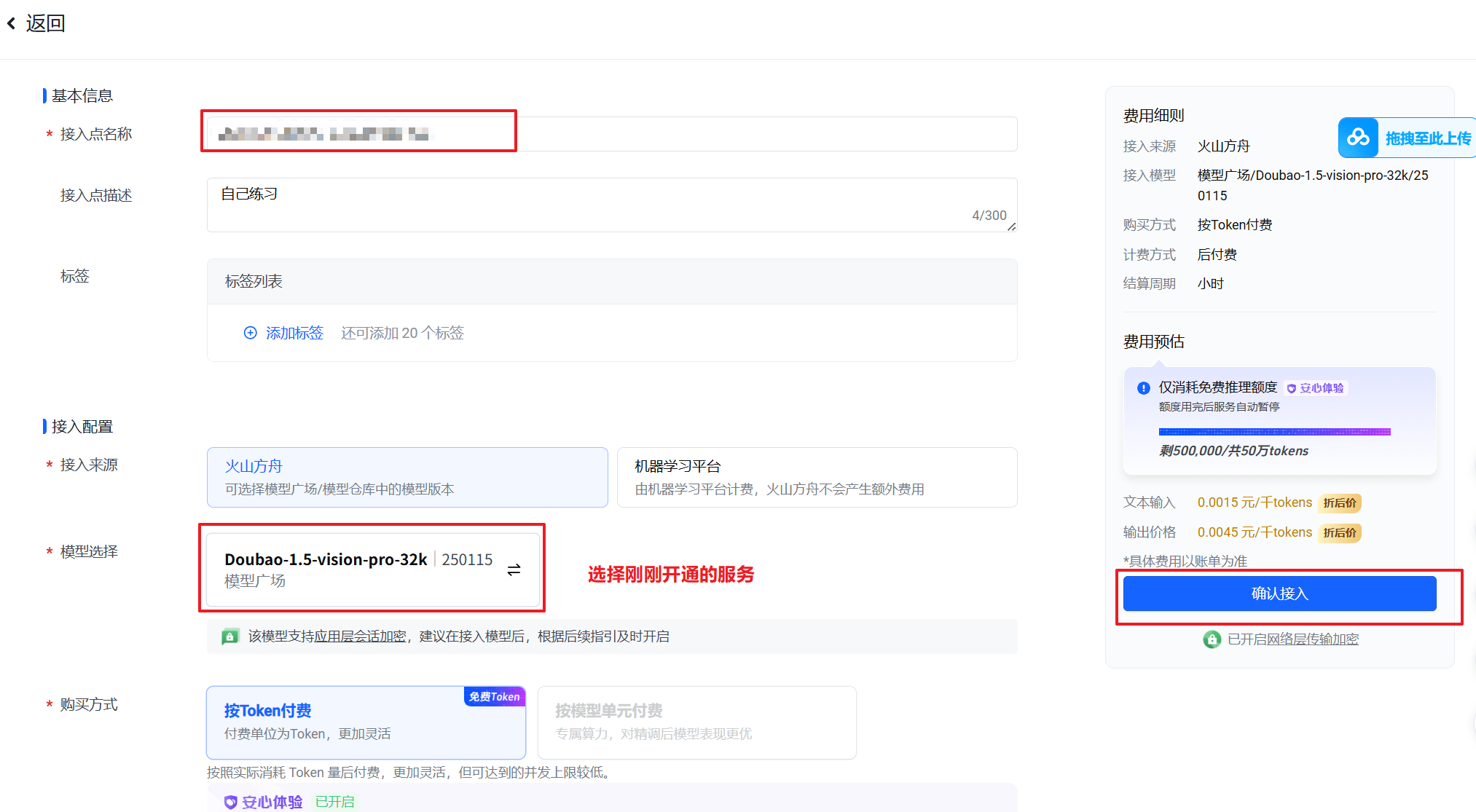

在弹出页面中,填⼊“接⼊点名称”和“接入点描述”,可以随意填写

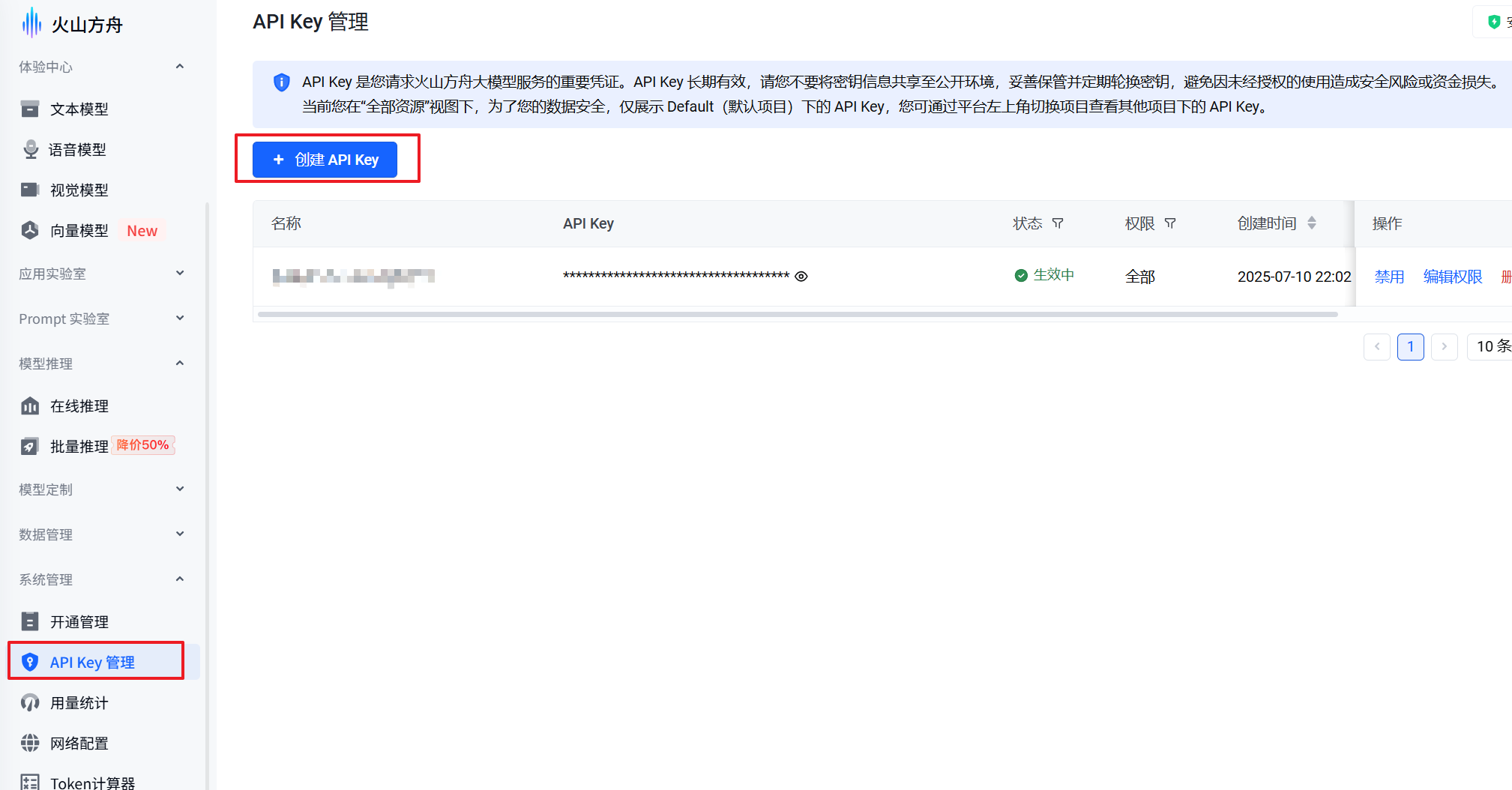

创建API Key

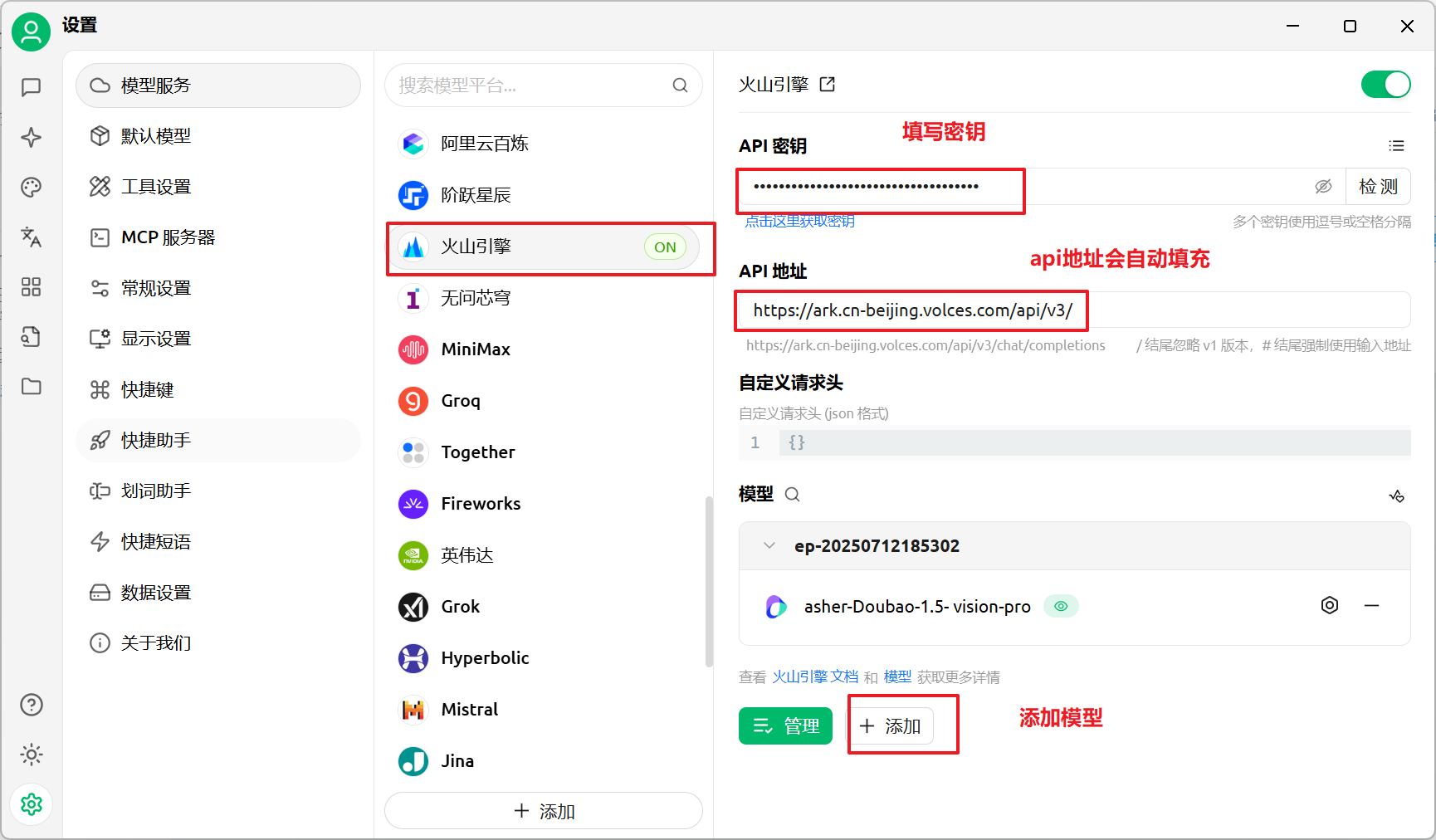

点击左侧菜单“API key”-“创建API key”,然后就可以在CherryStudio进行配置硅基流动了

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)