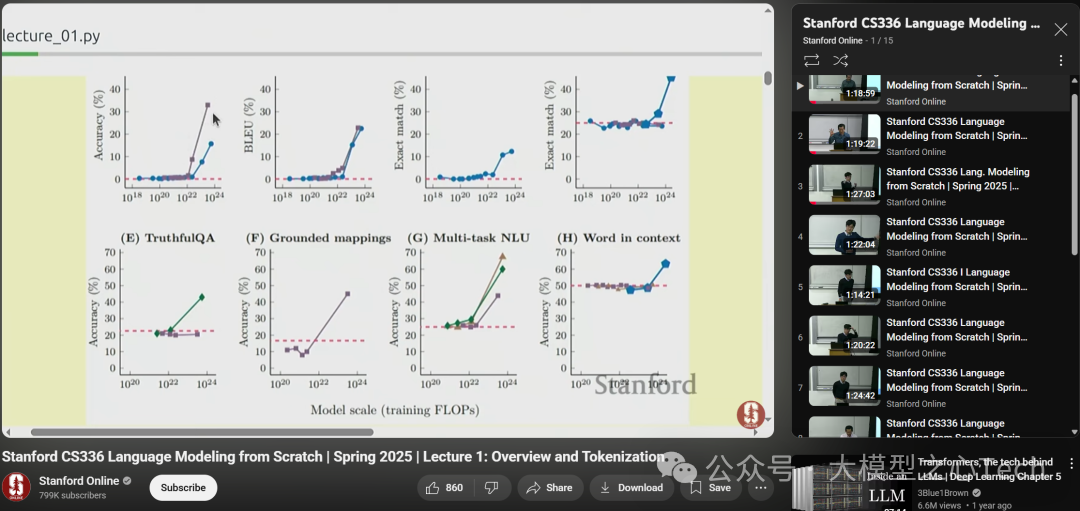

大佬面对面!斯坦福2025 CS336课程全公开:从零开始搓大模型~

从事大模型方向的小伙伴有福利了!斯坦福大学 2025 年春季的 CS336 课程「从头开始创造语言模型(Language Models from Scratch)」相关课程和材料现已在网上全面发布!

从事大模型方向的小伙伴有福利了!斯坦福大学 2025 年春季的 CS336 课程「从头开始创造语言模型(Language Models from Scratch)」相关课程和材料现已在网上全面发布!

-

课程视频:https://www.youtube.com/watch?v=SQ3fZ1sAqXI&list=PLoROMvodv4rOY23Y0BoGoBGgQ1zmU_MT_

-

课程主页:https://stanford-cs336.github.io/spring2025/

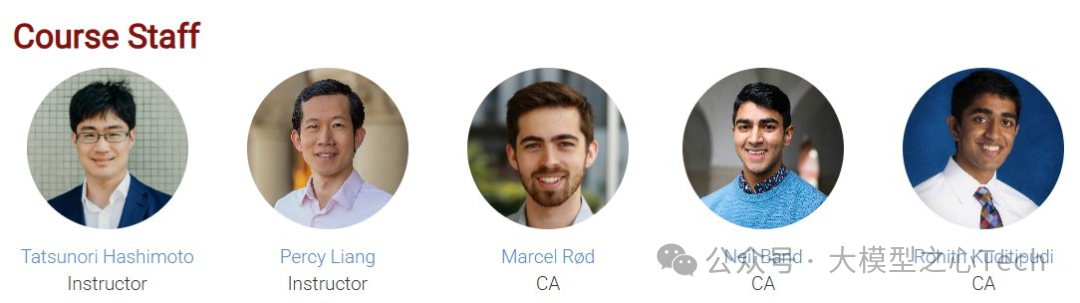

该课程教职工团队,阵容十分豪华~

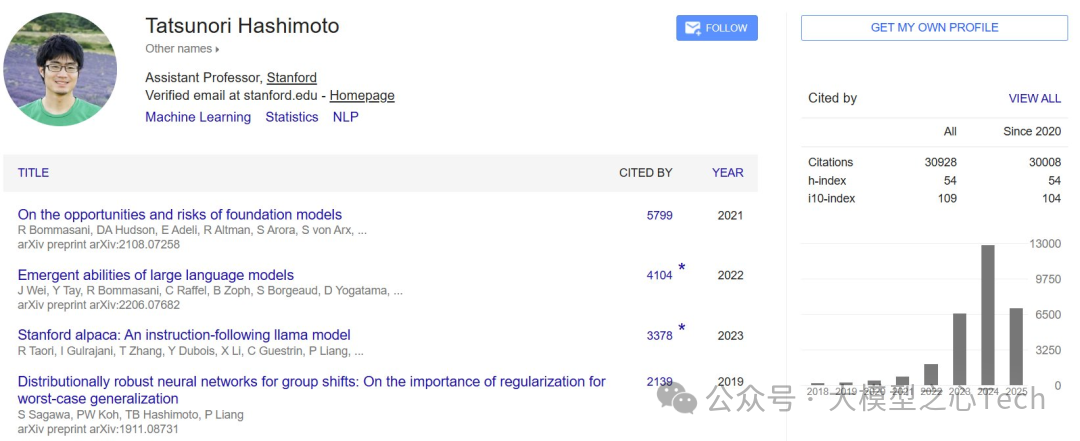

讲师Tatsunori Hashimoto:现为斯坦福大学计算机科学系助理教授。其为斯坦福大学 John C. Duchi 和 Percy Liang 的博士后,研究机器学习模型平均性能和最差性能之间的权衡。此前在麻省理工学院攻读研究生,导师是 Tommi Jaakkola 和 David Gifford。本科就读于哈佛大学学习统计学和数学,导师是 Edoardo Airoldi。并且该讲师的研究成果已总计获得了超 3 万引用。

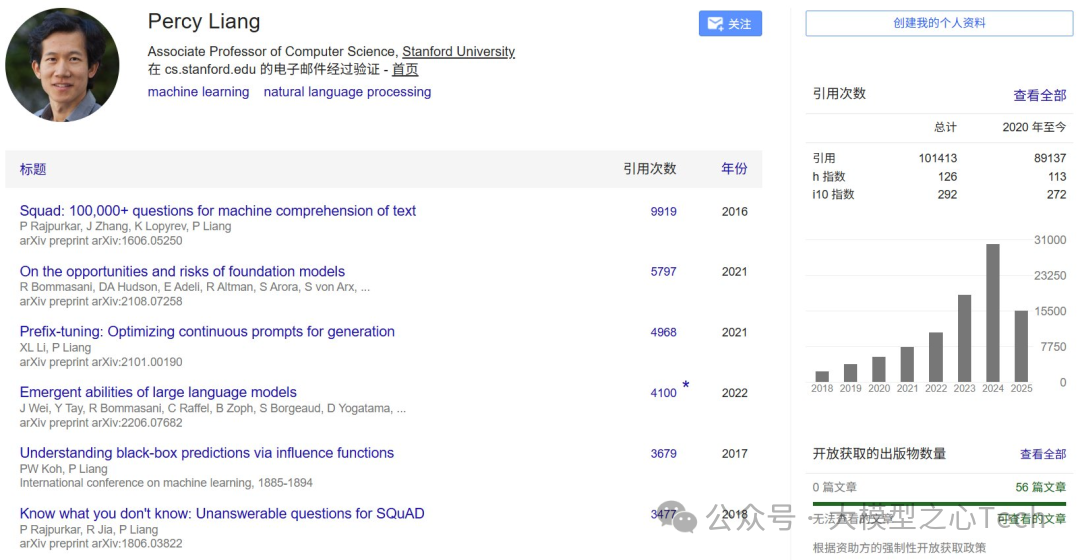

讲师 Percy Liang:斯坦福大学计算机科学系副教授,兼任也是基础模型研究中心(CRFM)主任,同时参与以人类为中心的人工智能(HAI)、人工智能实验室、自然语言处理研究组和机器学习研究组等的研究工作。本科毕业于 MIT,之后在该校获得工程学硕士学位,导师是 Michael Collins;并在伯克利获得博士学位,导师是 Michael Jordan 和 Dan Klein;毕业后进入谷歌进行博士后研究。Percy Liang 是一位引用量超过 10 万的研究大牛。

其他三位是课程助教~

CS336 课程介绍

语言模型是现代自然语言处理(NLP)应用程序的基石,并开辟了一种新的范式,即让一个通用系统解决一系列下游任务。随着人工智能(AI)、机器学习(ML)和NLP领域的不断发展,对语言模型的深入理解对科学家和工程师来说都是至关重要的。本课程旨在通过引导学生完成开发自己的语言模型的整个过程,让他们全面了解语言模型。旨在从头开始创建整个操作系统的操作系统课程中汲取灵感,课程将带领学生完成语言模型创建的各个方面,包括预训练的数据收集和清理、Transformer模型构建、模型训练和部署前的评测。

课程要求能力:

-

熟练掌握 Python:大部分课程作业将使用 Python 完成。与大多数其他 AI 课程不同,本课程只会给学生提供极少的脚手架。你编写的代码量将至少比其他课程多一个数量级。因此,熟练掌握 Python 和软件工程至关重要。

-

有深度学习和系统优化经验:本课程的很大一部分内容是关于如何使神经语言模型在多台机器的 GPU 上快速高效地运行。我们希望学生能够熟练掌握 PyTorch,并了解内存层次结构等基本系统概念。

-

大学微积分、线性代数(例如 MATH 51、CME 100):你应该能够轻松理解矩阵 / 向量符号和运算。

-

基础概率与统计(例如 CS 109 或同等课程):你应该了解概率、高斯分布、均值、标准差等基础知识。

-

机器学习(例如 CS221、CS229、CS230、CS124、CS224N):你应该熟悉机器学习和深度学习的基础知识。

该课程设计了五个大模块,分别是基础、系统、扩展、数据、对齐和推理强化学习。该课程也非常注重实践操作,因此也需要相当多的学习和开发时间。Percy Liang 也在推特上简单分享了学生需要实践的内容,包括:

-

作业 1(使基本流程正常运行):实现 BPE 分词器、Transformer 架构、Adam 优化器,并在 TinyStories 和 OpenWebText 上训练模型。只允许使用 PyTorch 原语(不能直接调用 torch. nn. Transformer 或 torch. nn. Linear)。

-

作业 2(让 GPU 运行起来):在 Triton 中实现 Flash Attention 2、分布式数据并行 + 优化器分片。

-

作业 3(Scaling Law):使用 IsoFLOP 拟合 Scaling Law。为了模拟训练运行的高风险,学生会获得一个训练 API [超参数→损失] 和一个固定的计算预算,并且必须选择提交哪些运行来收集数据点。在后台,训练 API 是通过在一系列预先计算的运行之间进行插值来支持的。

-

作业 4(数据):将 Common Crawl HTML 转换为文本,过滤(质量、有害内容、PII),删除重复数据。这是一项苦差事,却没有得到足够的重视。

-

作业 5(对齐):实现监督微调、专家迭代、GRPO 和变体,在 Qwen 2.5 Math 1.5B 上运行 RL 以提升在 MATH 上的指标。我们也曾考虑过让学生自己实现推理(inference),但决定(可能是明智的)让人们使用 vllm。

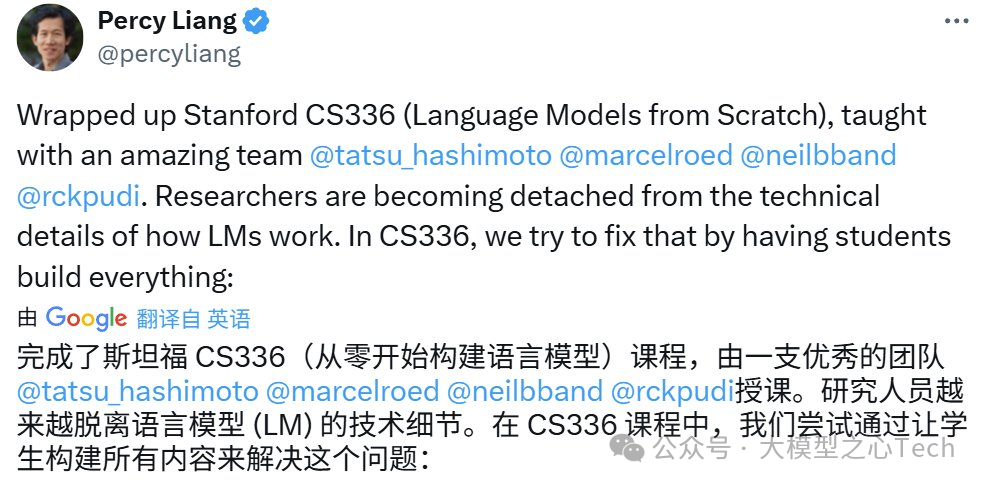

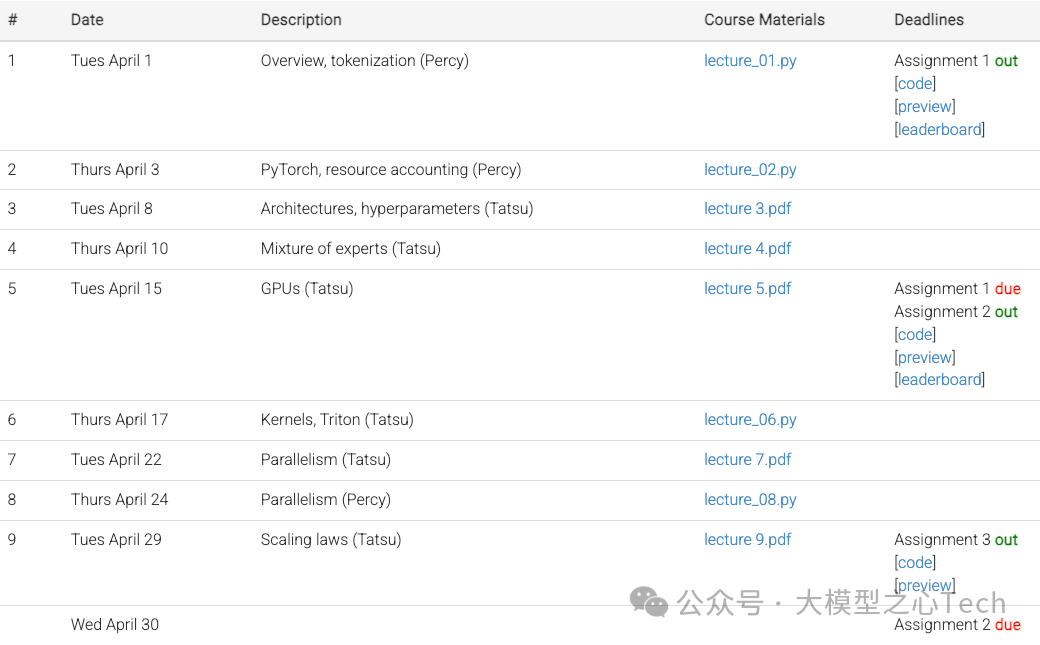

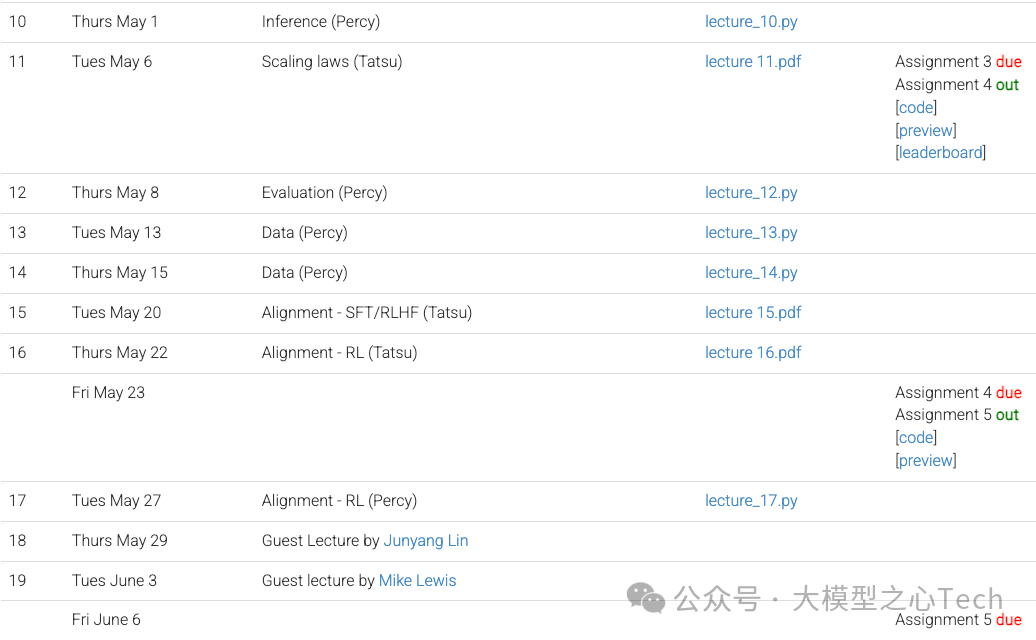

课表一览:

如何系统的去学习大模型LLM ?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

事实上,抢你饭碗的不是AI,而是会利用AI的人。

继科大讯飞、阿里、华为等巨头公司发布AI产品后,很多中小企业也陆续进场!超高年薪,挖掘AI大模型人才! 如今大厂老板们,也更倾向于会AI的人,普通程序员,还有应对的机会吗?

与其焦虑……

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高。

基于此,我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近70次后,终于把整个AI大模型的学习门槛,降到了最低!

在这个版本当中:

第一您不需要具备任何算法和数学的基础

第二不要求准备高配置的电脑

第三不必懂Python等任何编程语言

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型教程已经给大家整理并打包,现在将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、LLM大模型经典书籍

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套LLM大模型报告合集

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、LLM大模型系列视频教程

四、LLM大模型开源教程(LLaLA/Meta/chatglm/chatgpt)

五、AI产品经理大模型教程

LLM大模型学习路线 ↓

阶段1:AI大模型时代的基础理解

-

目标:了解AI大模型的基本概念、发展历程和核心原理。

-

内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践

- L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

-

目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

-

内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例

- L2.2 Prompt框架

- L2.3 流水线工程

- L2.4 总结与展望

阶段3:AI大模型应用架构实践

-

目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

-

内容:

- L3.1 Agent模型框架

- L3.2 MetaGPT

- L3.3 ChatGLM

- L3.4 LLAMA

- L3.5 其他大模型介绍

阶段4:AI大模型私有化部署

-

目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

-

内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

这份 LLM大模型资料 包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

更多推荐

已为社区贡献563条内容

已为社区贡献563条内容

所有评论(0)