使用ragflow搭建本地知识库

本文介绍了在本地部署RAGFlow的完整流程。首先需要安装ollama并部署DeepSeek模型,以及安装Docker环境。具体步骤包括:下载RAGFlow源码、配置.env文件、通过Docker命令启动服务、访问localhost页面完成注册登录。重点说明了如何添加本地AI模型、创建知识库、上传文件进行解析,最后通过聊天功能实现交互。文章还提示了可能遇到的报错情况及解决方法,确保用户能顺利完成整

一、前提准备条件(在我的文章中都可找到)

1、安装ollama并本地部署了deepseek模型或其他AI模型(DeepSeek本地部署)

2、安装docker(deepseek本地部署后,open WebUI安装)

二、部署运行ragflow

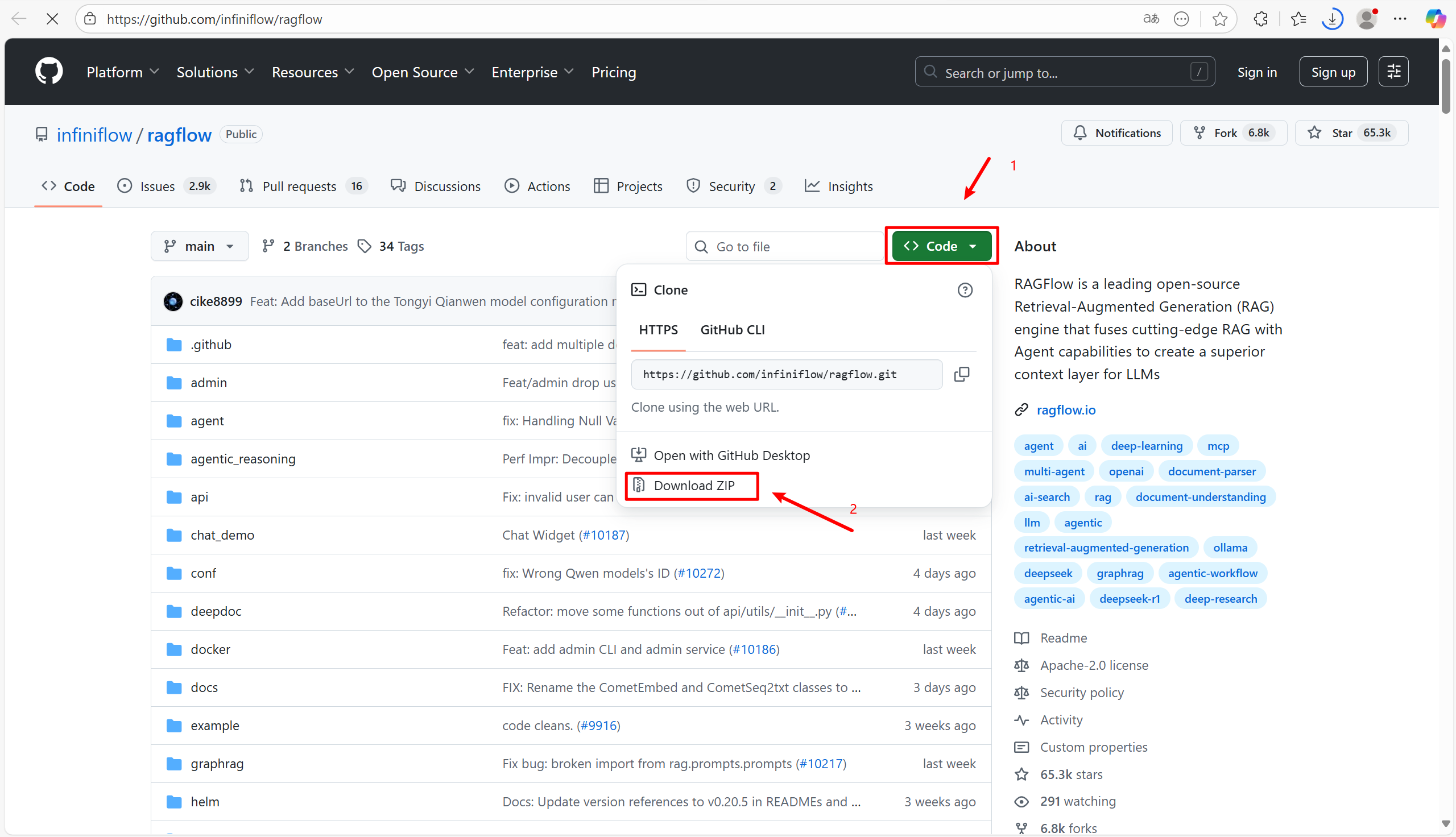

1、下载ragflow的源码(https://github.com/infiniflow/ragflow)

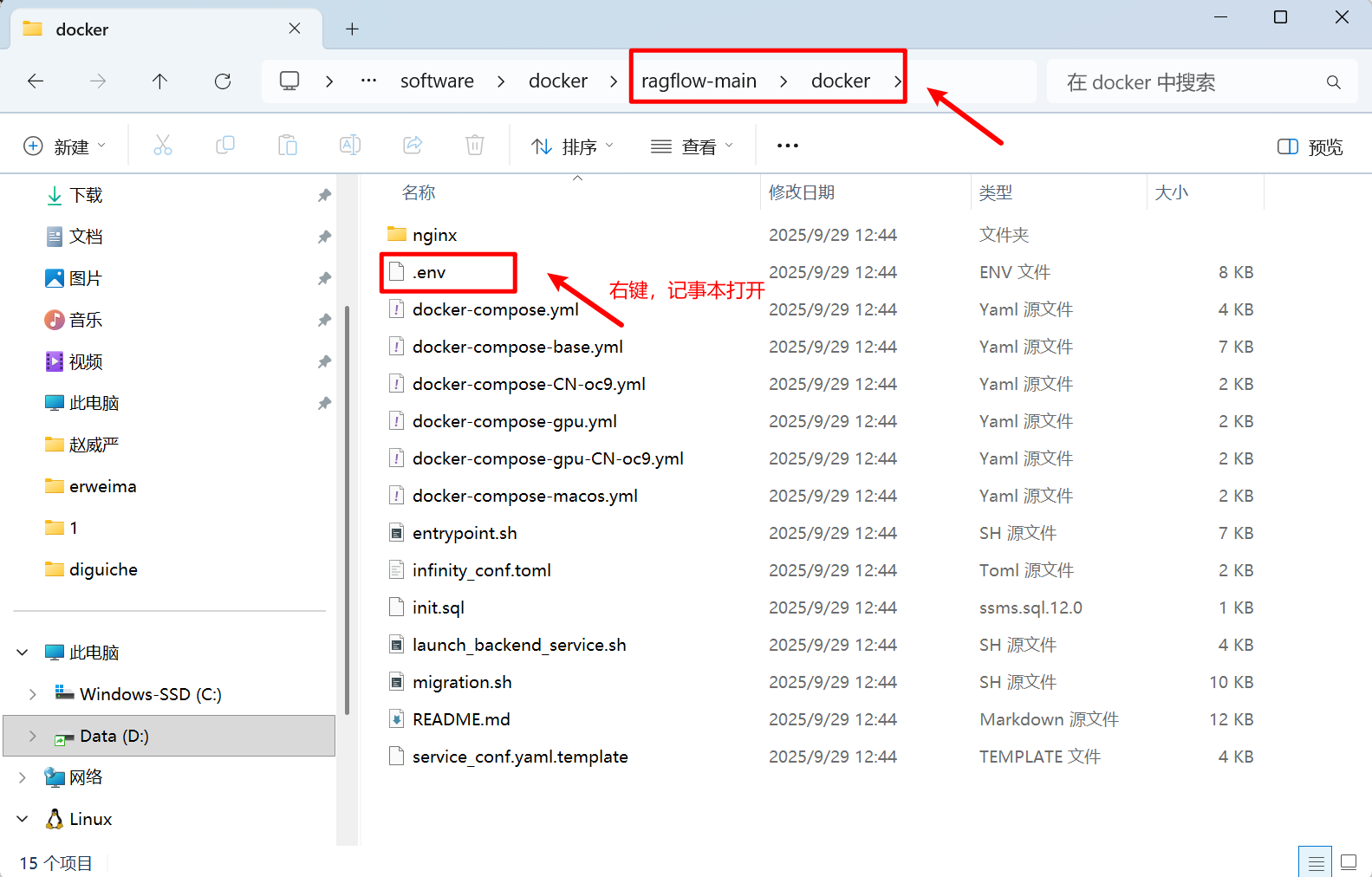

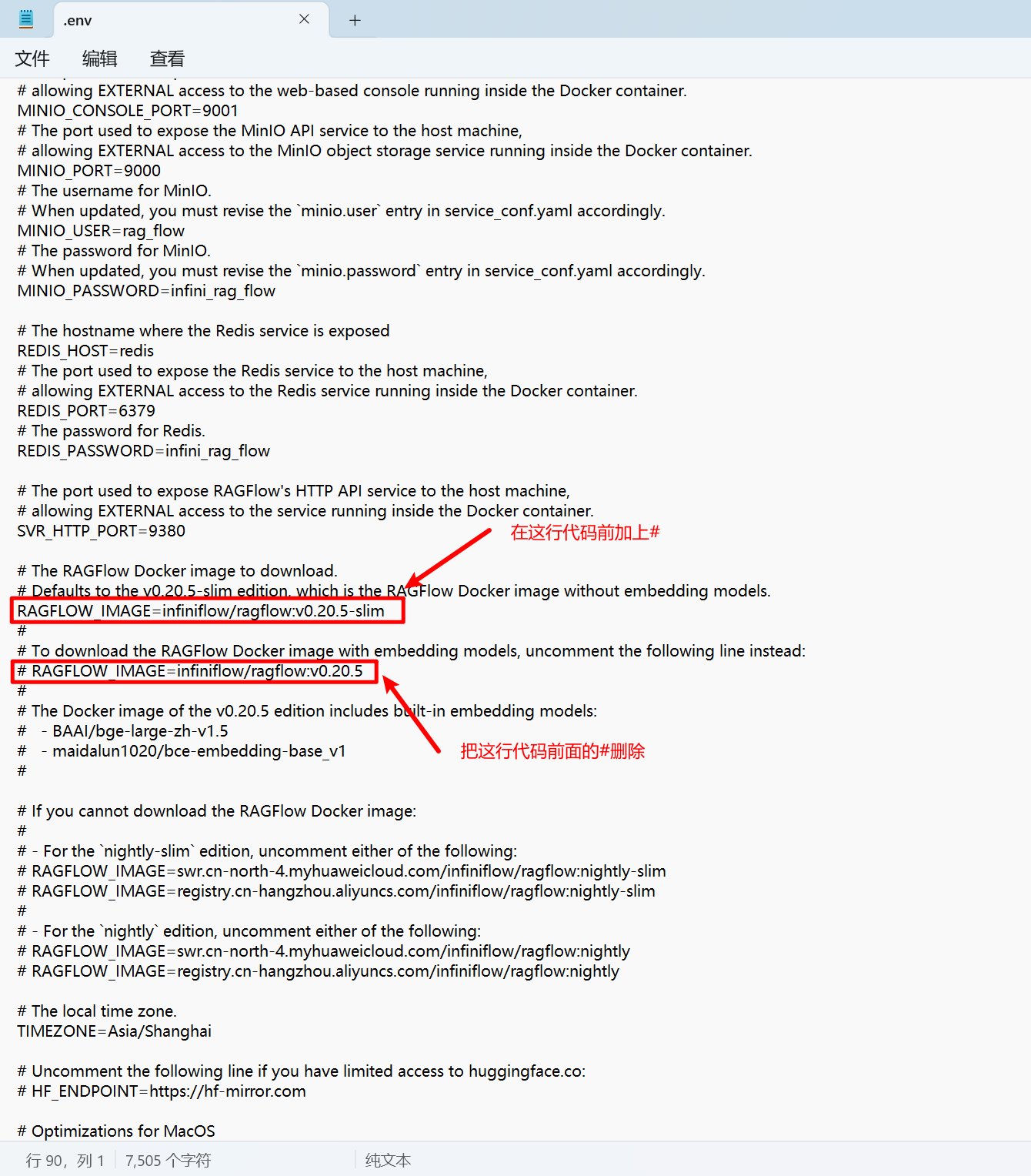

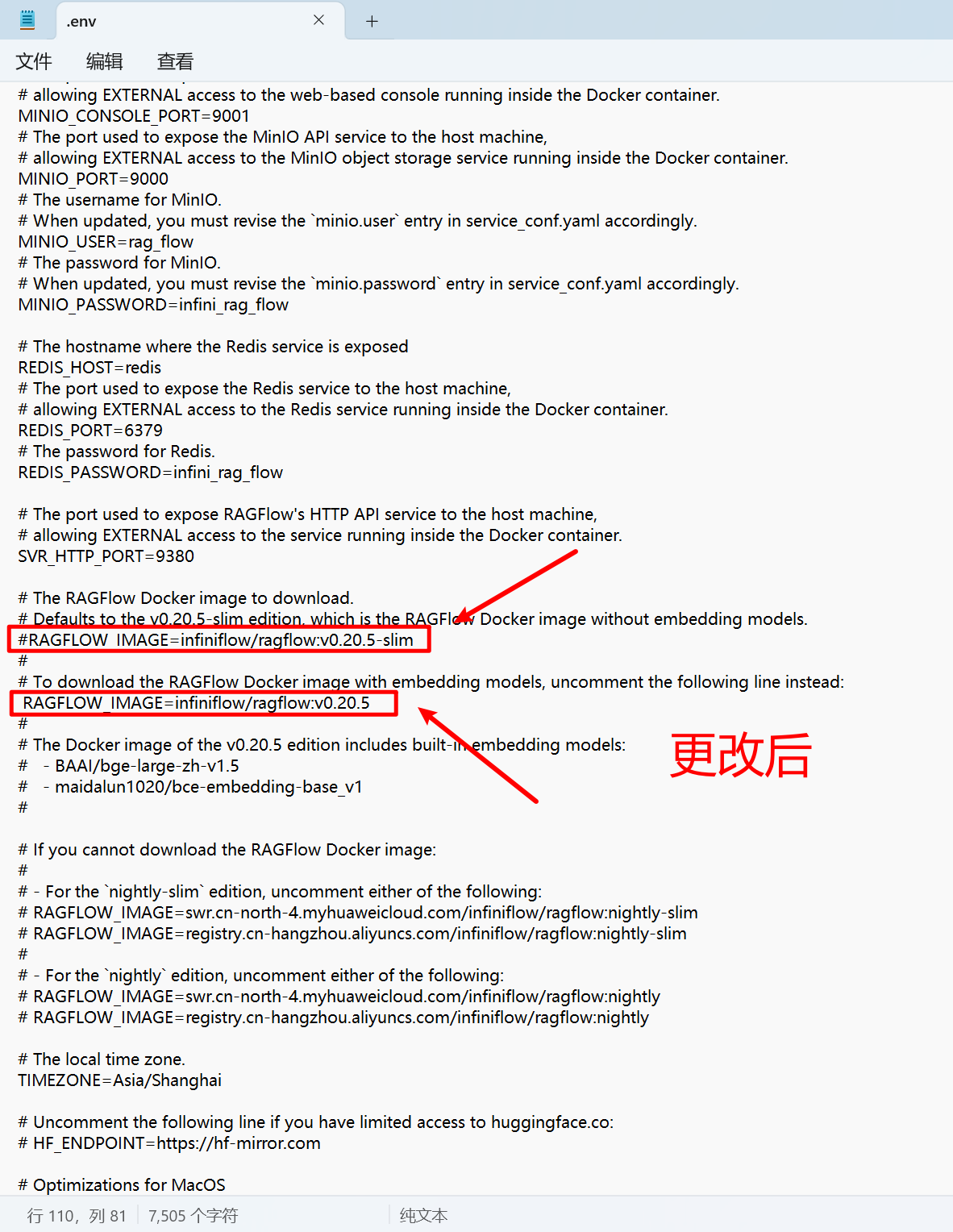

2、解压缩文件,并找到ragflow-main\docker文件夹下的.env文件,右键记事本打开

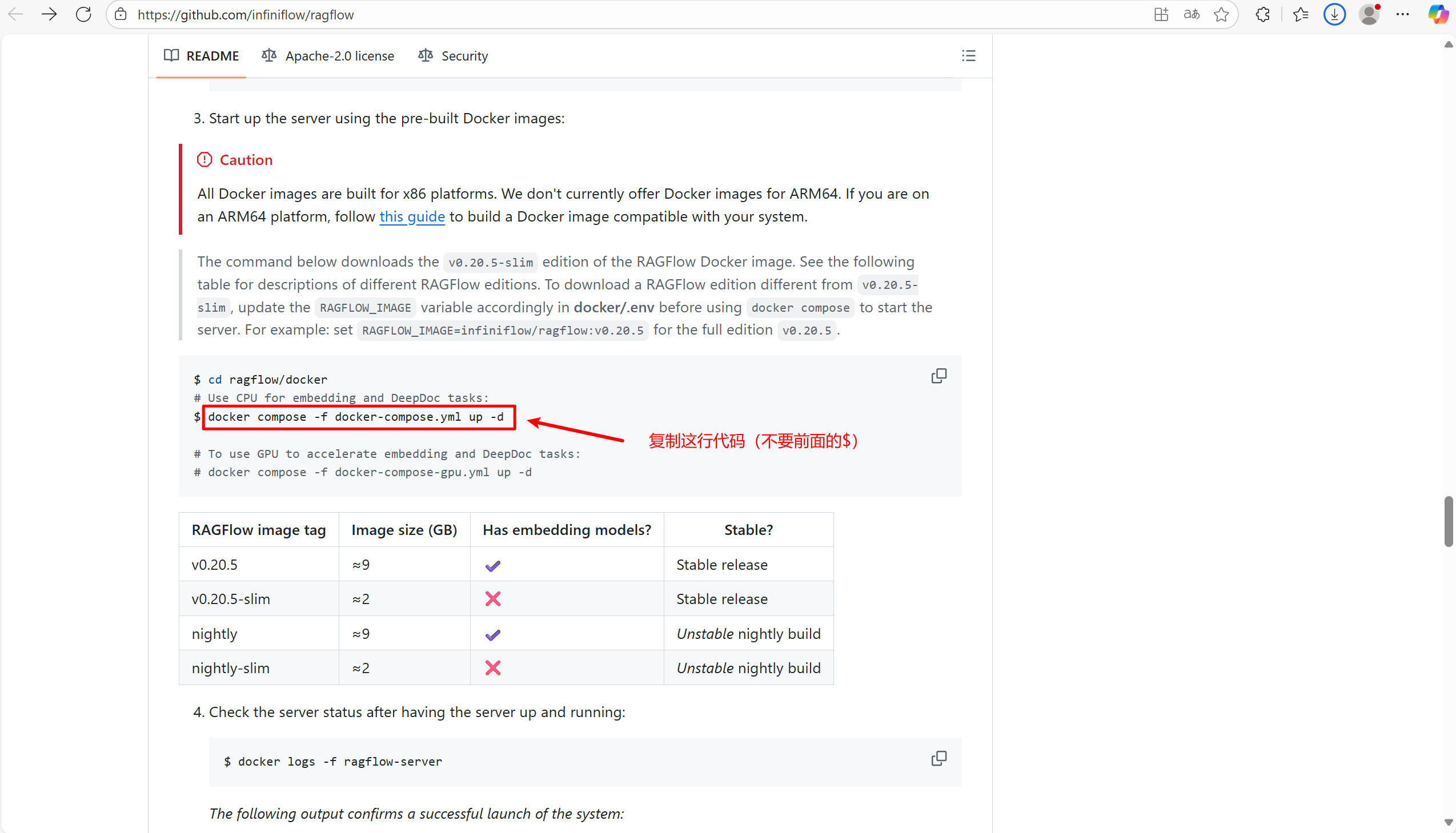

3、回到下载源码的那个界面,往下拉,找到一行代码,复制

docker compose -f docker-compose.yml up -d

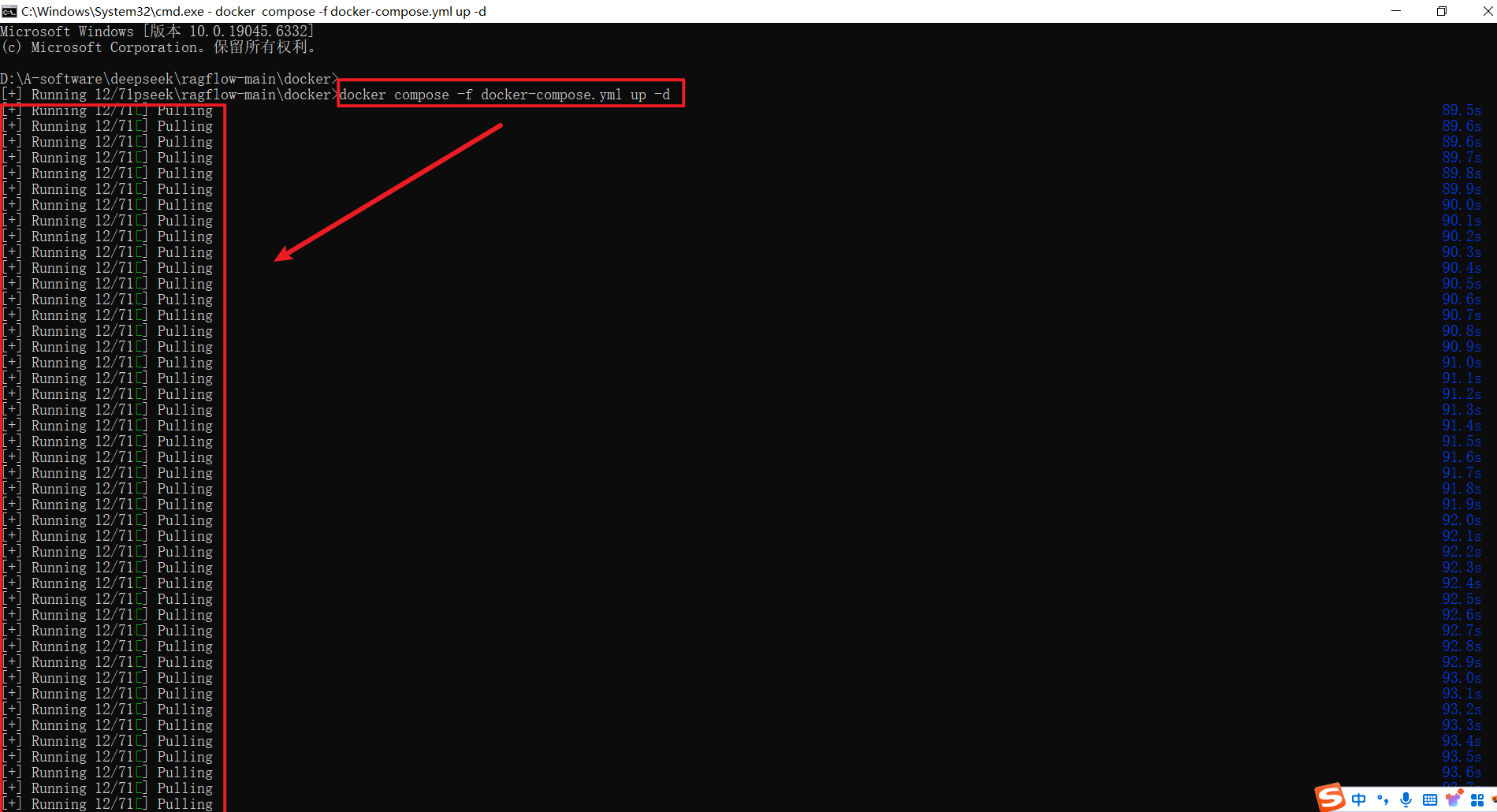

4、回到ragflow-main\docker的文件夹下,输入cmd(注意:需要先打开docker才行)

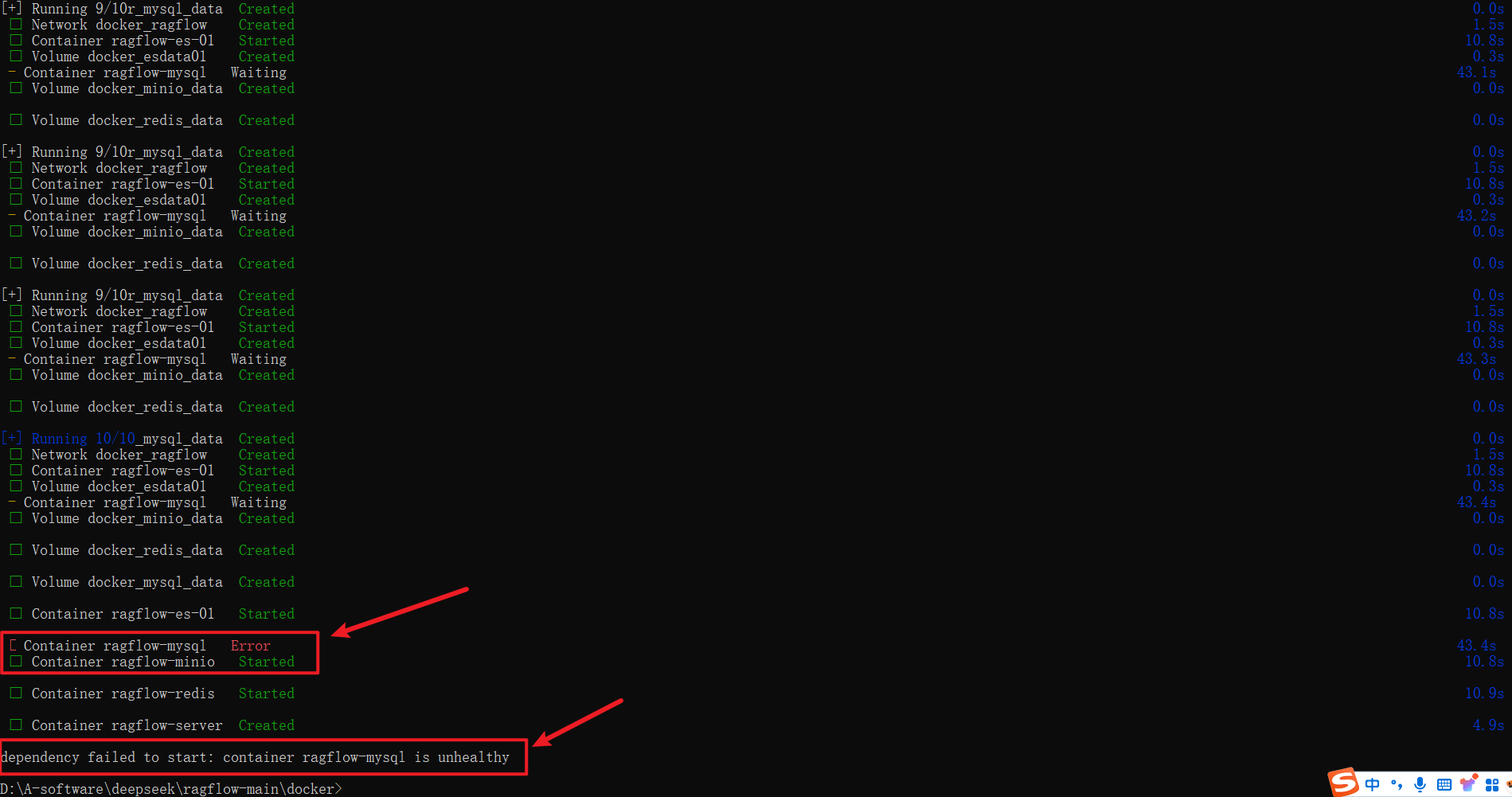

5、如果出现以下报错情况

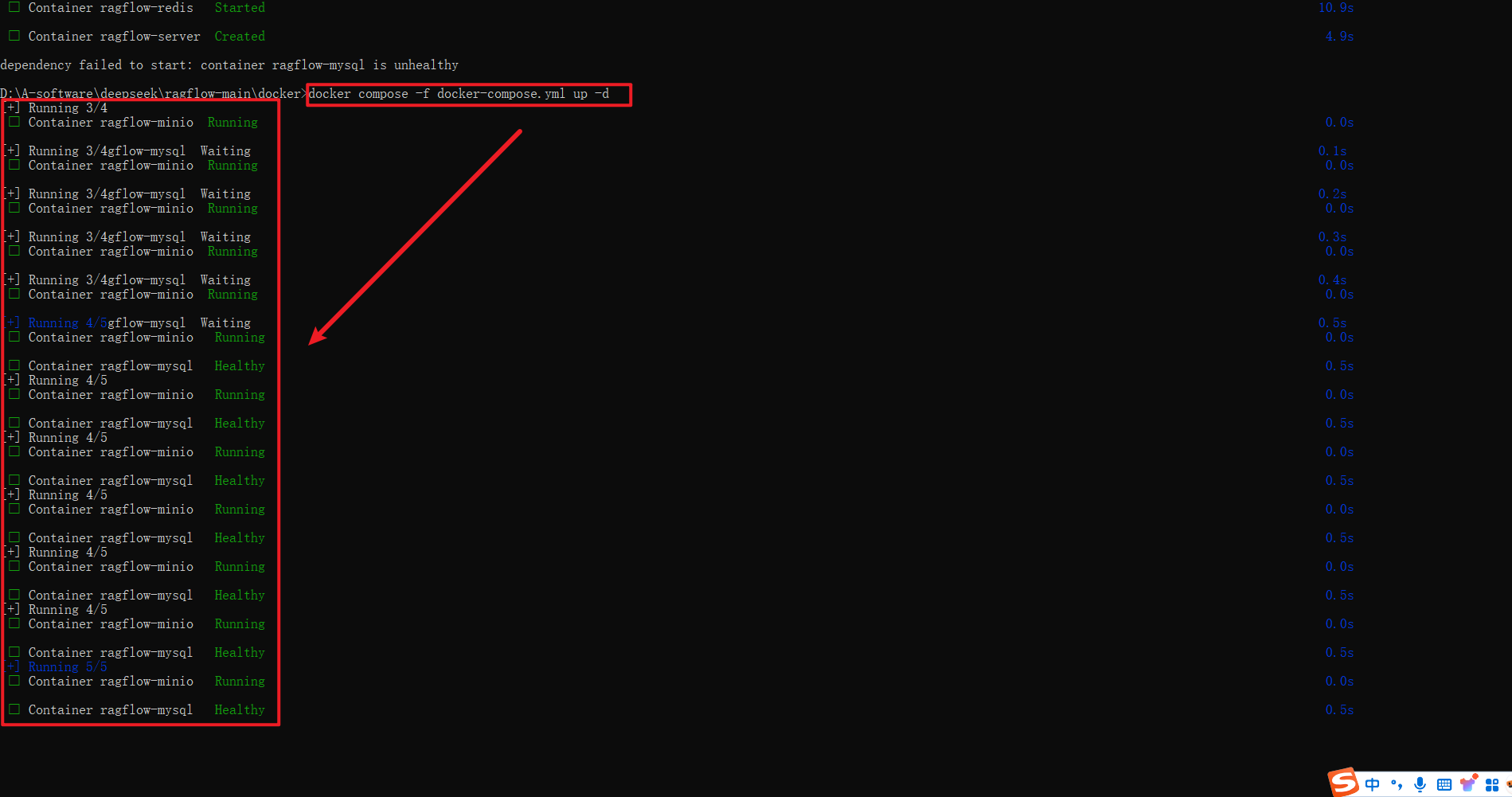

6、重新输入一遍docker compose -f docker-compose.yml up -d即可正常启动!

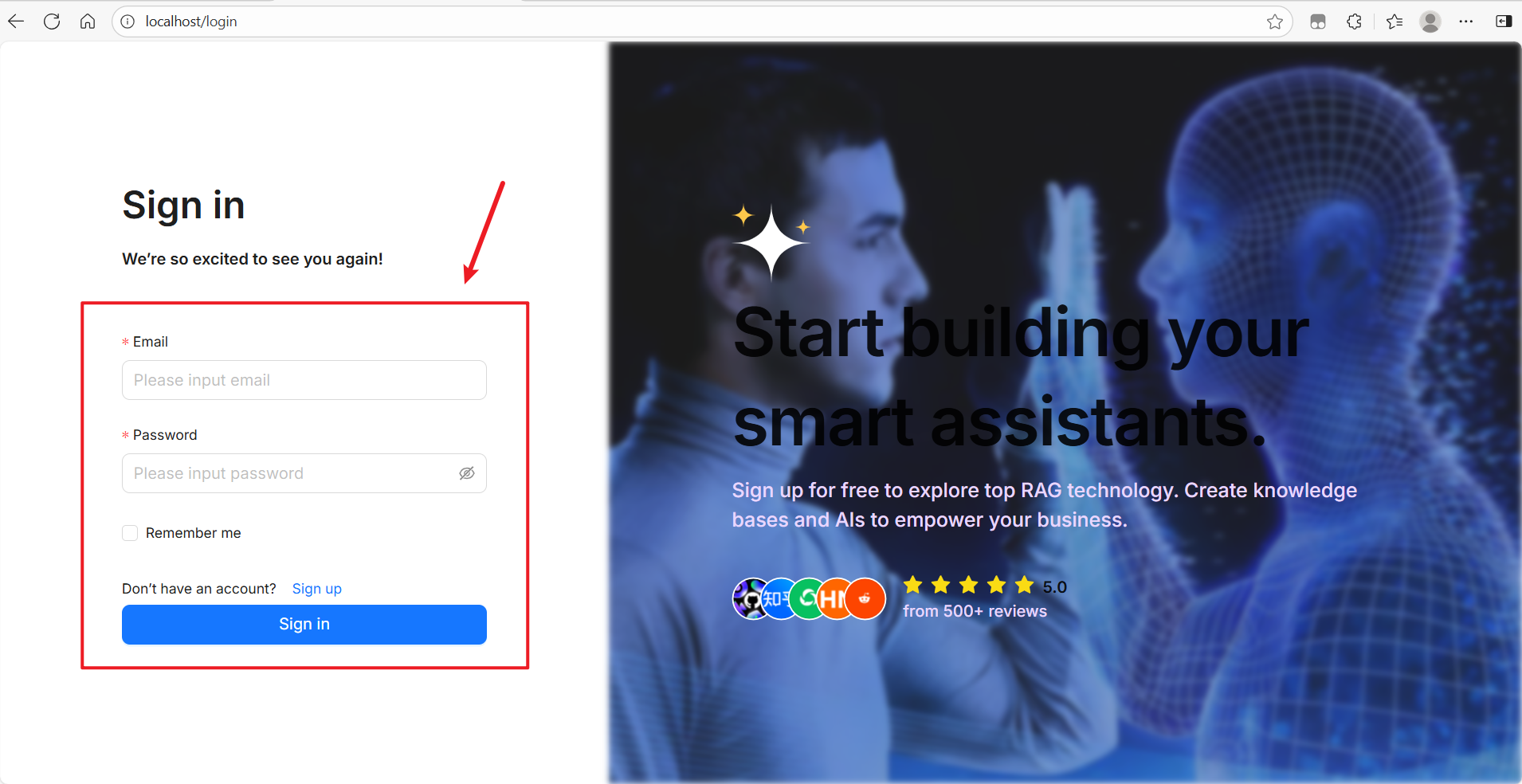

7、在网页窗口输入localhost或者localhost:80,回车即可跳转到RAGFlow的页面(注册登录即可)

8、进入页面,点击右上角那个图标

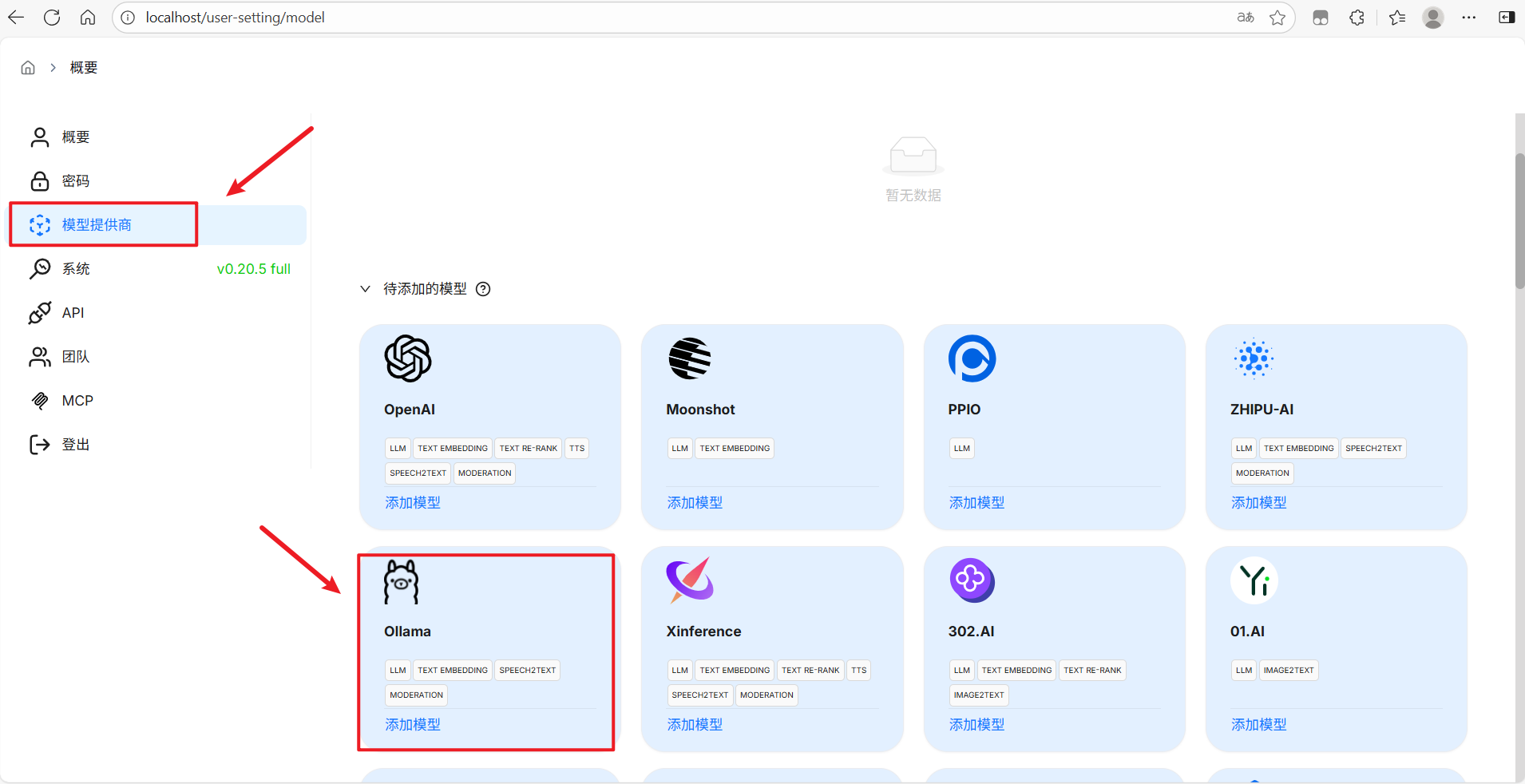

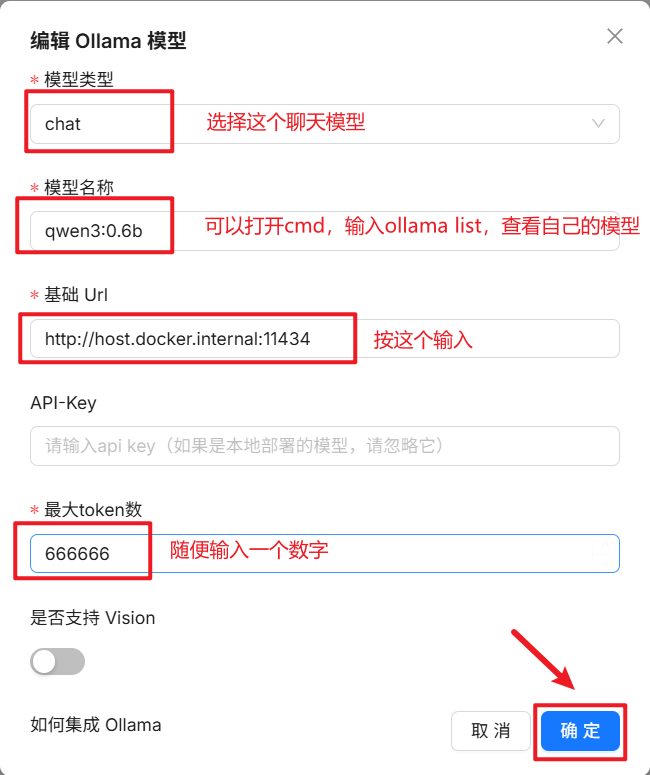

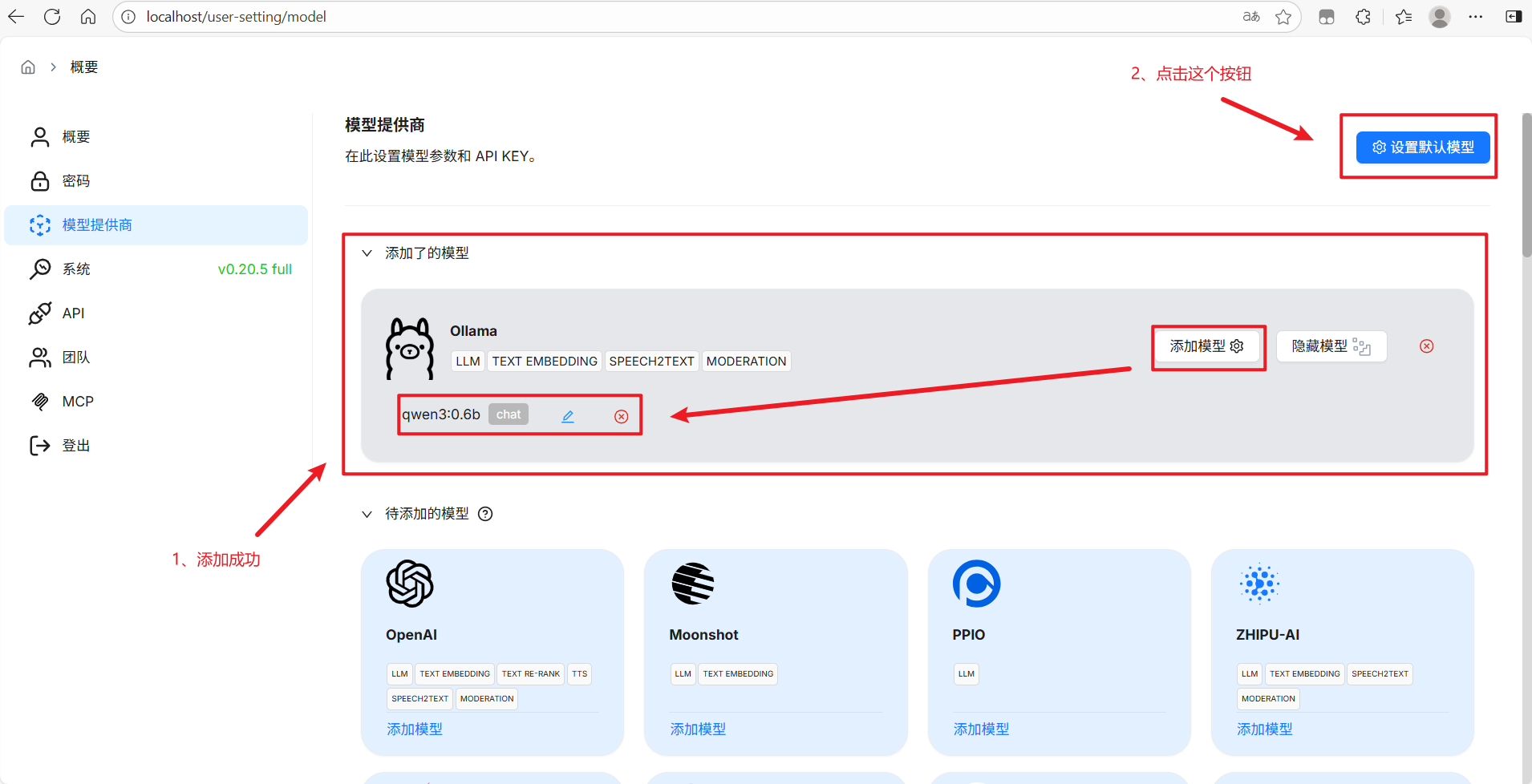

9、添加模型

10、按照下面内容添加模型

http://host.docker.internal:11434

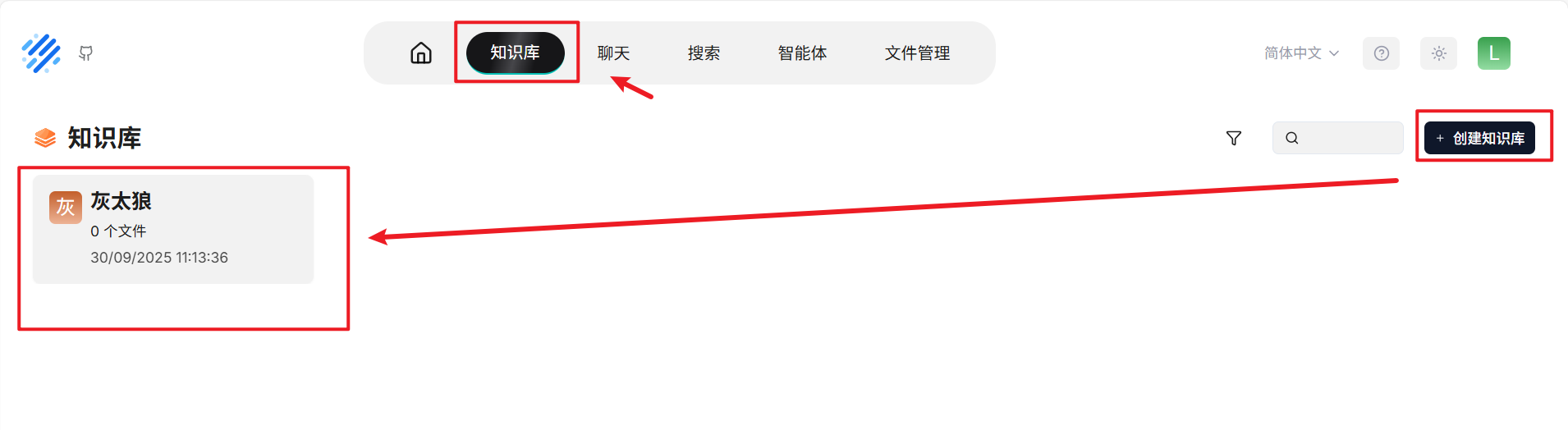

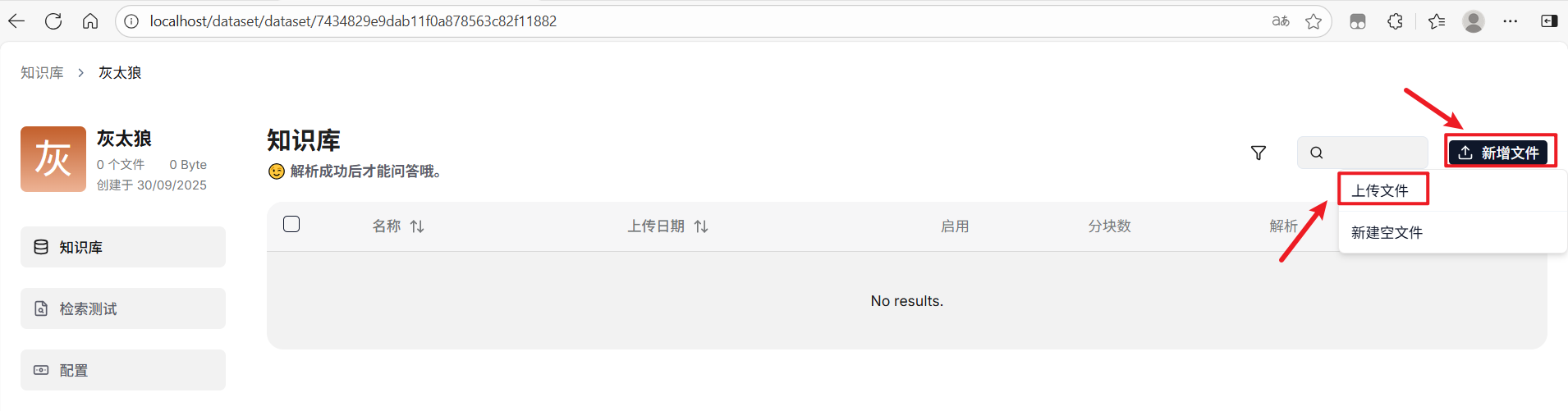

11、返回首页,创建知识库

12、上传文件,待文件解析完成

13、解析完成后,返回首页,点击“聊天”,即可开始对话

三、拓展补充:修改RAGFlow的80端口号为其他端口号

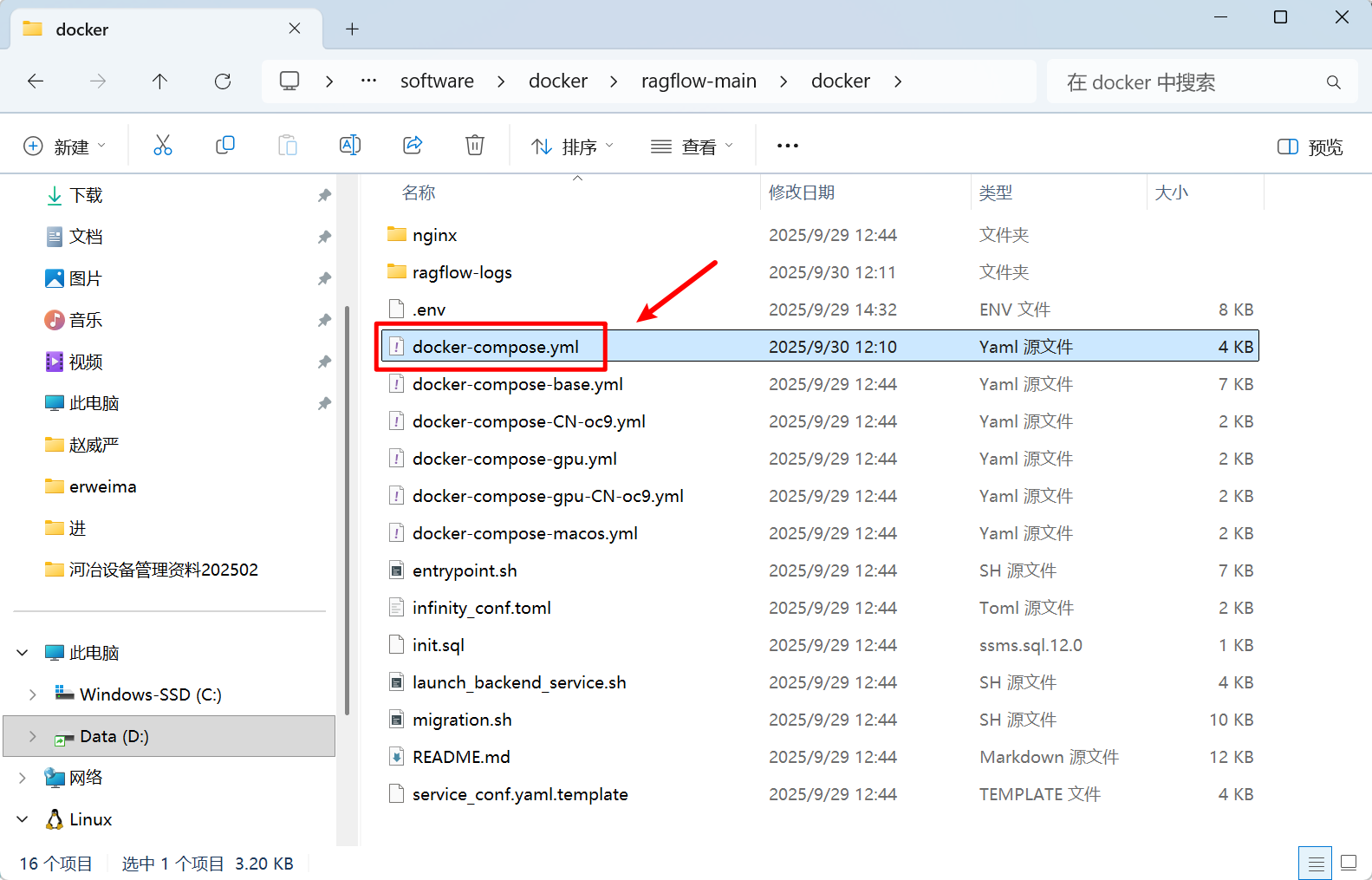

※ 简单来说,就是下面的这个文件,右键文本编辑,找到80端口号,修改为其他数字

然后在D:\software\docker\ragflow-main\docker这个路径下,打开cmd,输入下面代码:

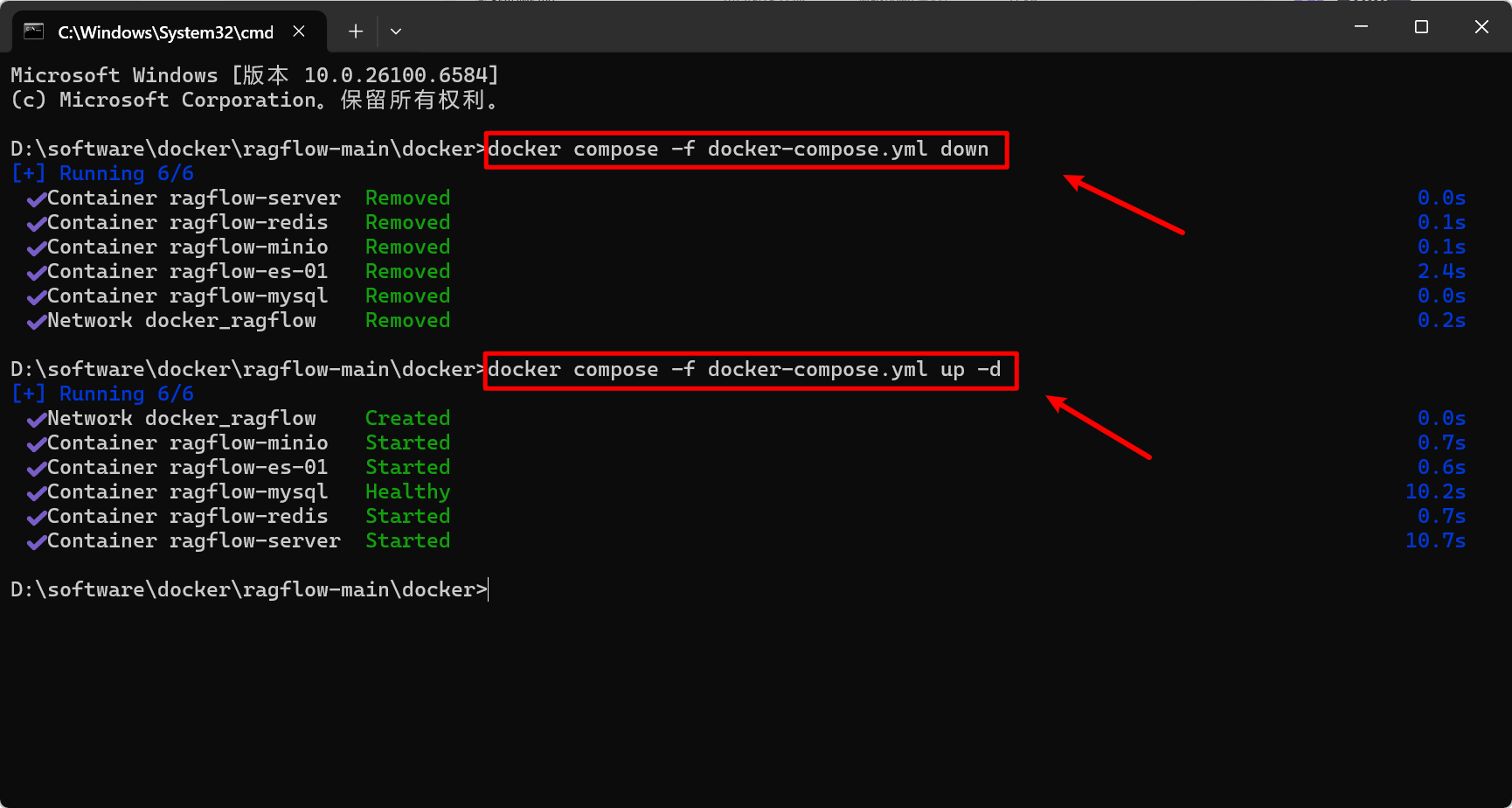

停止当前运行的容器:

docker compose -f docker-compose.yml down重新启动服务:

docker compose -f docker-compose.yml up -d

四、拓展补充:解决打开docker后,关闭镜像自动启动的问题

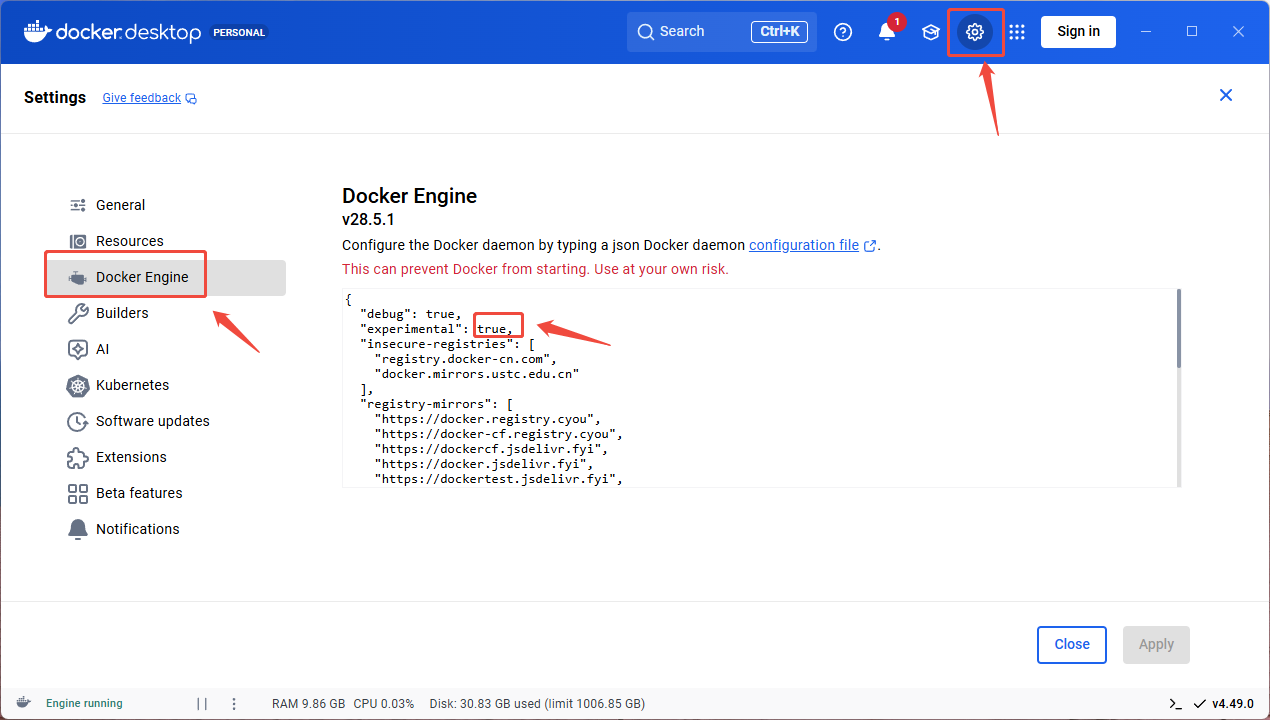

1、第一步:打开docker中的设置

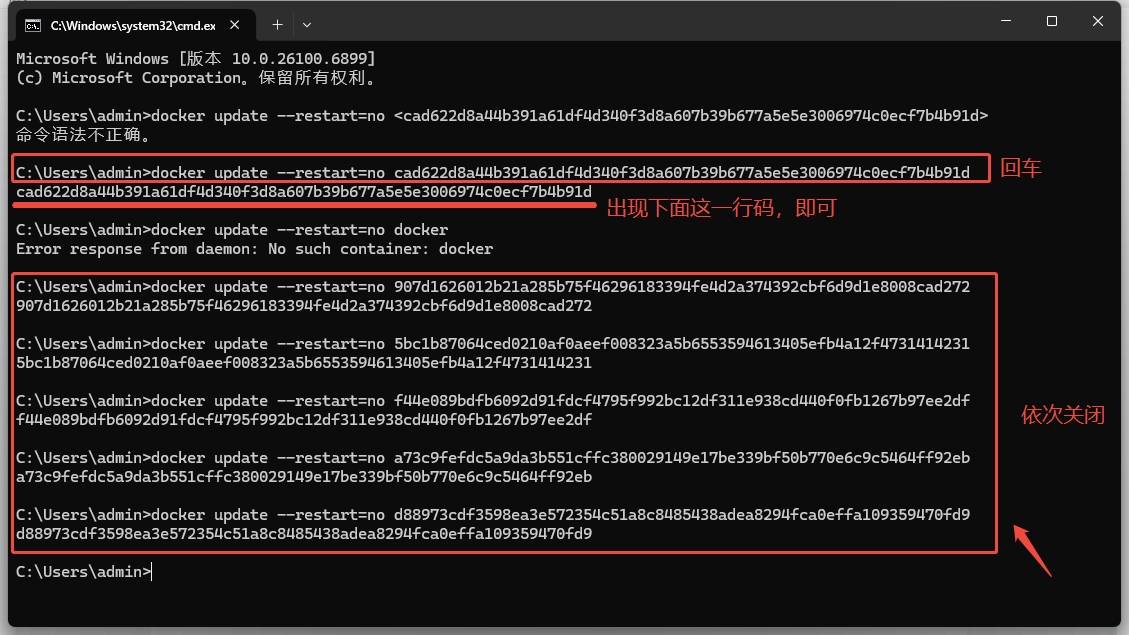

2、第二步:打开cmd命令提示窗口

docker update --restart=no 容器名或ID

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)