DeepSeek-V3.2震撼发布:DSA技术彻底解决长文本处理难题,程序员必看!

DeepSeek-V3.2-Exp引入了DeepSeek Sparse Attention (DSA)技术,通过Lightning Indexer和细粒度token选择机制,将长文本注意力计算复杂度从O(L²)降低到O(L*k)。该技术采用两阶段训练方法,在保持模型性能的同时,显著提升了长上下文处理效率。实验证明,在处理超长文本时,DSA使推理时间和GPU占用大幅降低,而输出质量几乎不变,为解决大

在 2025 年 9 月 29 号,大家开始准备为祖国妈妈庆生的时候,DeepSeek 又发了一个重磅炸弹,虽然没有 R1 和 V3 那种划时代的创新,但这次量化把大模型长文本上的坑给堵上了,并且给出的数据,让人不可相信。几乎对标 V3.1 版本,小编暂时还猜不到核心技术,看官方介绍叫 DeepSeek Sparse Attention (DSA)。

关于长文本优化方案的论文其实不多,以前小编只看过 MiniMax 方案和 Gemma 的,这里也给大家科普下,前者是用了一种 Lightning Attention 算法调整注意力,后者是 MatFormer 累积套娃 transform FNN 架构调整。

本文重点:

- 科普 DSA 技术

- 科普 V3.2 架构 & 实现

- 科普 AI 知识

DeepSeek-V3.2-Exp

DeepSeek-V3.2-Exp是通过持续训练 DeepSeek-V3.1-Terminus,然后注入了 DeepSeek 稀疏注意力 (DSA) 得来的。而 DSA 是一种由闪电索引器驱动的细粒度稀疏注意力机制,DeepSeek-V3.2-Exp 在训练和推理方面均实现了显著的效率提升,尤其是在长上下文场景中。

架构 & 背后实现

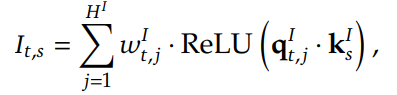

先说 DSA,DSA 原型主要由两个组件组成:lightning 索引器和细粒度的 token 选择机制。前者是查询标记 h(t) ∈ R 和前一个标记 h(s) ∈ R,从而确定查询标记应选择哪些标记:

其中 H 表示索引器头的数量,q ∈ R 和 w ∈ R 源自查询标记 H;k ∈ R 源自前一个标记 H。出于吞吐量考虑,选择 ReLU 作为激活函数。

然后给定每个查询标记 H 的索引得分 {𝐼}。接着后者细粒度标记选择机制仅检索与前 k 个索引得分对应的键值条目 {c(s)}。然后,通过在查询标记 h(t) 和稀疏选择的键值条目 {c(s)} 之间应用注意力机制来计算注意力输出 u(t):

上述论文讲解有点隐晦,需要理解和数学模型知识,DSA 目的就是为了在保持性能的同时,大幅降低长上下文时的计算复杂度,从 O(L²) 降为 O(L \* k)。

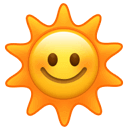

小编通过下面架构图和白话讲下理解,下图中 DSA 在 MLA 下实例化( 多头潜在注意力,是一种用于优化推理效率和内存使用的注意力变体,通过共享一个潜在的键值状态来实现。)。也就是绿色部分展示了 DSA 如何根据索引器选择前 k 个键值对条目。

MLA

MLA 的核心思想是预先计算并缓存一个“潜在”的键(Key)和值(Value)状态,这个状态在多个查询(Query)头之间共享。

- 标准 MHA:每个注意力头都有自己独立的 Key、Value 和 Query。计算注意力时,每个头的 Query 只与同头的 Key 和 Value 交互。

- MLA:首先,将所有头的 Key 和 Value 投影到一个共享的、低维的潜在空间中,形成一个潜在的 K 和 V。然后,每个头的 Query 都与这个共享的潜在 K 和 V 进行计算,最后再通过一个投影恢复到头特有的维度。

(图片来自附录)

从下到上,我们看下全流程输出,从隐藏输入层开始,每个输入 token 的隐藏向量记作 hₜ,模型会从中生成三类子向量,分别是 qₜ,ᵢᴬ:主注意力查询向量(attention query)、qₜ,ⱼᴵ:索引器查询向量(indexer query)、wₜ,ⱼᴵ:索引器权重向量(indexer weight)。然后绿色部分 DSA 索引器,通过前面计算公式利用激活函数 ReLU,索引器计算每个 query token 对所有历史 token 的重要性分数 I。

通过前面的索引器的分数 I,这里绿色部分就可以继续挑选 top k,选择中得分最高的 k 个位置,组成稀疏 key-value 集合,这样每个 query 只与这 k 个 token 计算注意力,大大减少计算量。(这里符合 MLA 潜在计算方式,MLA 理论计算在前面已有解释)

最终通过映射位置旋转编码 RoPE 到 MQA(Core Attention)每个 latent(key-value 对)可被多个 query 共享,提升硬件利用率。通过前面公式计算得出 u(t)

| 模块 | 作用 | 特点 |

|---|---|---|

| Lightning Indexer | 为每个 query 计算候选 token 的重要性 | 轻量、FP8 计算 |

| Top-k Selector | 选出最相关的 k 个 token | 稀疏化注意力计算 |

| Core Attention (MQA) | 在稀疏集合上做注意力 | 高效且兼容原 MLA |

| RoPE | 保留位置信息 | 支持长上下文 |

| Output | 输出聚合结果 | 用于下一步推理 |

训练

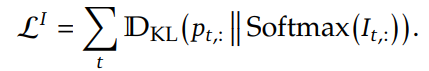

DeepSeek-V3.2-Exp 的预训练是基于 V3.1 基础版本来的,包含两个训练阶段。在第一个阶段使用一个简短的预热阶段来初始化闪电索引器。在此阶段,保持密集注意力机制,并冻结除闪电索引器之外的所有模型参数。为了使索引器输出与主注意力分布一致,对于第 t 个查询标记,对所有注意力头求和来汇总主注意力得分。然后,将该和沿序列维度进行 L1 正则化,以生成目标分布 P : ∈ R。基于 P,将 KL 散度损失设置为索引器的训练目标:

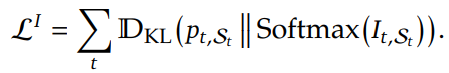

为了进行预热,团队使用 10^−3 的学习率。但是仅训练索引器 1000 步,不到一个 epoch,每步包含 16 个 128K 个 token 的序列,总共 21 亿个 token。接着就搞稀疏训练了,因为基座模型已有了,模型也适应了单纯 DSA 形式训练方式,在稀疏训练阶段。引入细粒度的 token选择机制,并优化所有模型参数,使模型适应 DSA 的稀疏模式。在此阶段,团队还会持续将索引器输出与主注意力分布对齐,但仅考虑所选的 top k 集合:

在这个稀疏训练阶段,团队使用 7.3 × 10−6 的学习率,并为每个查询标记选择 2048 个键值标记。训练主模型和索引器,共计 15000 步,每步包含 480 个 128K 标记的序列,最终共计 943.7 亿个标记。

关于微调阶段,DeepSeek-V3.2-Exp 的后训练也采用了与稀疏持续预训练阶段相同的方式的稀疏注意力机制。为了严格评估引入 DSA 的影响,对于 DeepSeek-V3.2-Exp,团队保留了与 DeepSeek-V3.1-Terminus 相同的后训练流程、算法和数据。

对于每个任务,首先开发一个专门针对该特定领域的专用模型,所有专家模型都基于相同的预训练 DeepSeek-V3.2 基础检查点进行微调理解上可以认为 MOE,MOE 最重要的是挑选专家而不是专家回答。除了写作任务和一般问答之外,框架还涵盖五个专业领域:数学、竞技编程、通用逻辑推理、代理编码和代理搜索。每位专家模型都经过大规模强化学习 (RL) 计算训练。

此外,团队采用不同的模型为长链思维推理(思维模式)和直接响应生成(非思维模式)生成训练数据。

对于 DeepSeek-V3.2-Exp,团队仍然采用组相对策略优化 (GRPO) 作为强化学习训练算法。与之前使用多阶段强化学习训练的 DeepSeek 模型不同,团队将推理、代理和人类对齐训练合并到一个强化学习阶段。这种方法有效地平衡了不同领域的表现,同时避免了多阶段训练范式中常见的灾难性遗忘问题。

-

对于推理和代理任务,采用基于规则的结果奖励、长度惩罚和语言一致性奖励。

-

对于一般任务,采用生成式奖励模型,其中每个提示都有各自的评估标准。

奖励设计仔细平衡了两个关键的权衡:(1) 长度与准确性;(2) 语言一致性与准确性。

总结 & 评估

说了这么多,怎么证明这玩意在长文本推理训练中是有效果,并且性能变快的呢?这里论文从理论复杂度、实验对比、推理消耗,三个方面进行分析。

关于理论上:在普通 Transformer 中,注意力计算是全连接的,也就是说每个 token 都要和前面所有 token 计算一次相似度,复杂度是 O(L²)(L 是序列长度)。而 DSA 的核心是,先用一个轻量的 Lightning Indexer(闪电索引器) 计算哪些过去的 token 可能重要,然后只选出最相关的 Top-k 个 token 来算注意力。这样,主注意力部分的复杂度就变成:O(L * k)(这里 k 远小于 L)

白话就是,假设如果你有 128K 长度的上下文,以前要算 1.6 亿(128k * 128k)次注意力匹配,而 DSA 只挑 2K 个关键 token,那么只要算 2.6 亿次索引 + 2.6 亿次稀疏注意力(128k * 2k),总体速度快了十几倍以上,尤其在推理阶段收益特别明显。

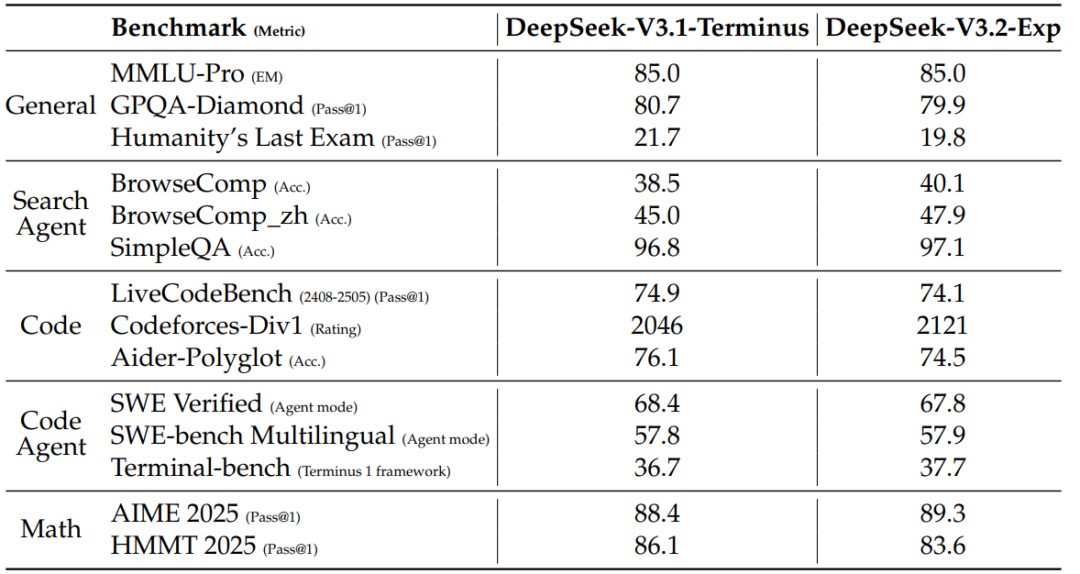

关于实验验证正确性上:DSA 的稀疏机制确实保留了关键信息,没有破坏模型的理解和推理能力。

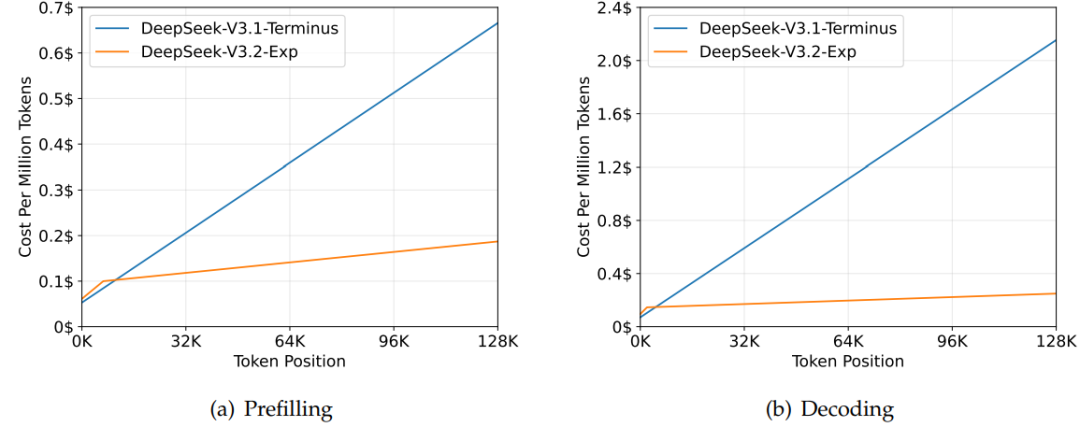

关于推理消耗:下图展示了 DeepSeek-V3.1-Terminus 和 DeepSeek-V3.2-Exp 的令牌成本如何随令牌在序列中的位置而变化。这些成本是通过对部署在 H800 GPU 上的实际服务进行基准测试估算出来的。横轴表示token 在序列中的位置(从开头到 128K)。纵轴表示推理每百万 token 的成本(美元)

(图片来自附录)

结论就是,性能提升明显,并且在处理超长上下文(比如十几万 token)时,推理时间和 GPU 占用显著降低,而模型输出质量几乎不变!

如何学习AI大模型?

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

这份完整版的大模型 AI 学习和面试资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

这是一份大模型从零基础到进阶的学习路线大纲全览,小伙伴们记得点个收藏!

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

100套AI大模型商业化落地方案

大模型全套视频教程

200本大模型PDF书籍

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

LLM面试题合集

大模型产品经理资源合集

大模型项目实战合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献775条内容

已为社区贡献775条内容

所有评论(0)