Dify+Ollama搭建本地知识库

现在企业内部信息管理太难了,数据到处都是,检索效率低得可怜,还缺乏智能化支持。尤其是面对海量非结构化数据,企业很难快速提取有价值的信息,决策效率低得不行。要是能有个工具解决这些问题,那可太棒了!

目录

一、前言

前面我们安装好了Dify和Ollama之后,现在我们可以开始搭建自己的本地知识库了。没安装的可以看博主前面的文章:Dify+Ollama实现本地化部署DeepSeek-CSDN博客

二、使用Ollama安装文本嵌入模型

1.什么是文本嵌入模型

文本嵌入是一种将文本转换成固定长度的数值向量的技术。这种表示方式有助于机器学习算法更好地理解和处理人类语言。文本嵌入的目标是将相似意义的词或句子映射到接近的空间位置上,以便于计算它们之间的相似度或其他关系。

2.文本嵌入模型的作用

语义搜索:通过比较查询与文档的嵌入向量,找到最相关的文档。

推荐系统:根据用户兴趣的嵌入向量推荐产品或内容。

情感分析:通过分析文本嵌入向量中的模式识别正面、负面或中立的情感倾向。

问答系统:帮助理解问题并从大量文本中找到最合适的答案。

文本分类:自动对文本进行分类,如新闻文章的主题分类等。

3.如何高效选择RAG的Embedding模型

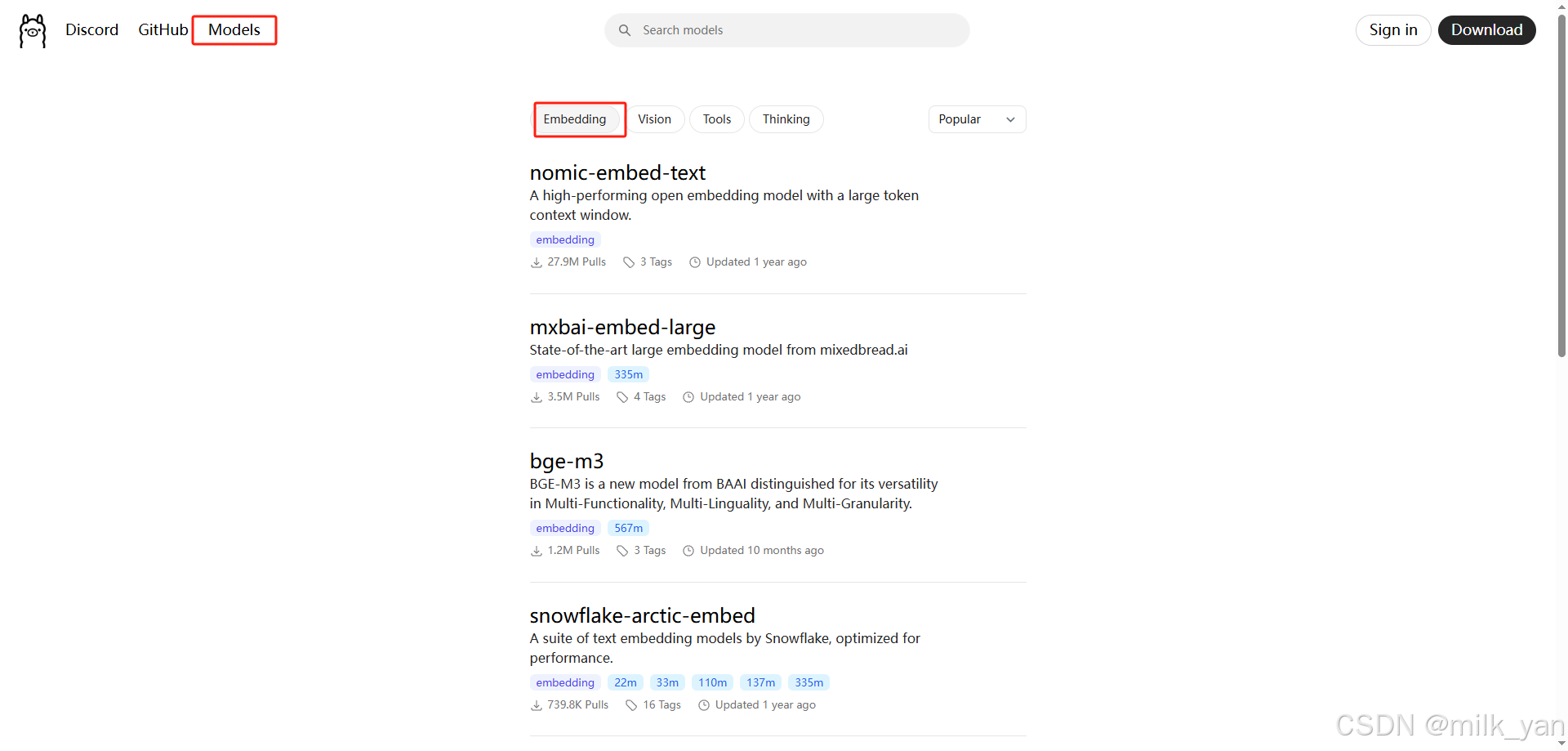

打开Ollama官网:Ollama,点击上方的Models,选择Embedding

- nomic-embed-text高精度检索,适合简短问题,

- mxbai-embed-large快速处理大规模数据

- snowflake-arctic-embed实用且平衡的选择

根据自己的硬件配置选择一个合适的模型,这里我选择mxbai-embed-large来做演示。

4.部署mxbai-embed-large本地模型

点击mxbai-embed-large,直接复制命令到终端执行,等待下载完成即可。

ollama pull mxbai-embed-large

三、搭建本地知识库

三、搭建本地知识库

模型类型选择“Text Embedding”,模型名称填写“nomic-embed-large”,基础URL与添加deepseek模型的地址一样,然后点击保存即可。

点击创建空白应用

点击创建空白应用

选择聊天助手,输入应用名称,点击创建

选择聊天助手,输入应用名称,点击创建

点击上方工具栏中的知识库,然后点击创建知识库

选择准备好的知识库文件,支持多种格式,点击下一步,我这里简单的写了一点测试文本。

选择准备好的知识库文件,支持多种格式,点击下一步,我这里简单的写了一点测试文本。

等待嵌入完成后,点击上方工具栏中的工作室,选择之前创建好的聊天助手,在上下文配置处点击添加按钮,选择上一步上传的知识库,点击添加即可。

等待嵌入完成后,点击上方工具栏中的工作室,选择之前创建好的聊天助手,在上下文配置处点击添加按钮,选择上一步上传的知识库,点击添加即可。

现在按照我们上传的知识库中的内容,向deepseek本地模型发起提问,可以看到模型已完成了对知识库的学习,并准确的回答出了问题。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)