ASR语音转写技术全景解析:从原理到实战

随着Whisper等开源模型的崛起,ASR技术民主化进程加速。领域数据的积累与清洗计算资源的优化利用交互体验的持续打磨"语音将成为最重要的人机接口,而ASR是这背后的基石技术。" —— 微软首席语音科学家Xuedong Huang你在ASR项目中遇到过哪些棘手问题?是如何解决的?欢迎分享你的实战经验!

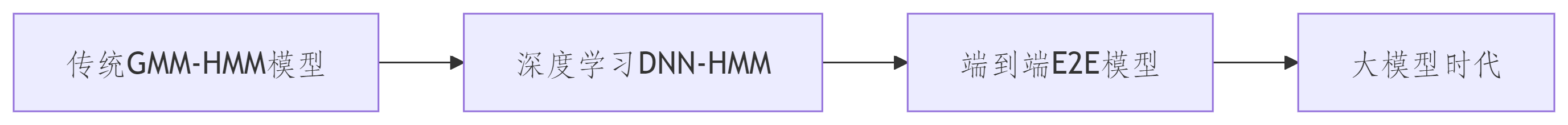

ASR技术已从传统的GMM-HMM模型发展到如今的端到端深度学习架构,Whisper等开源框架大大降低了技术应用门槛。本文系统剖析了ASR核心技术原理,对比了主流开源方案,并提供了从基础转写到工业级优化的完整代码示例。尽管技术进步显著,但在方言识别、低质量音频处理等场景仍存在挑战。未来,多模态融合、边缘计算和个性化建模将成为发展方向。ASR技术的民主化正在加速,但要实现真正自然的人机交互,仍需在数据质量、计算效率和场景适配等方面持续突破。期待与开发者们共同探索语音技术的无限可能!

一、ASR技术演进与核心原理

1. 技术发展三阶段

2. 现代ASR系统架构

# 典型ASR处理流水线(概念代码)

class ASRPipeline:

def __init__(self):

self.preprocessor = AudioPreprocessor()

self.acoustic_model = AcousticModel()

self.language_model = LanguageModel()

self.decoder = BeamSearchDecoder()

def transcribe(self, audio):

features = self.preprocessor.extract(audio)

phoneme_probs = self.acoustic_model(features)

text = self.decoder.decode(phoneme_probs, self.language_model)

return text二、主流开源框架实战对比

1. 三大框架特性对比

| 框架 | 语言 | 预训练模型 | 实时性 | 中文支持 |

|---|---|---|---|---|

| Kaldi | C++ | 丰富 | 优 | 良好 |

| ESPnet | Python | 丰富 | 良 | 优秀 |

| Whisper | Python | 多语言 | 中 | 优秀 |

2. Whisper快速入门

import whisper

# 加载基础模型

model = whisper.load_model("base")

# 音频转写

result = model.transcribe("audio.mp3")

print(result["text"])

# 带参数的高级用法

result = model.transcribe(

"audio.wav",

language="zh",

temperature=0.2,

beam_size=5

)三、工业级优化方案

1. 语音增强预处理

import librosa

import noisereduce as nr

def enhance_audio(input_path, output_path):

# 加载音频

audio, sr = librosa.load(input_path, sr=16000)

# 降噪处理

reduced_noise = nr.reduce_noise(

y=audio,

sr=sr,

stationary=True

)

# 保存增强后的音频

sf.write(output_path, reduced_noise, sr)2. 热词增强技术

// 使用Kaldi进行热词增强配置示例

public class HotwordBoost {

private static final String CONFIG =

"--max-active=7000 " +

"--beam=15.0 " +

"--lattice-beam=6.0 " +

"--word-symbol-table=words.txt " +

"--acoustic-scale=1.0 " +

"--hotwords='{\"腾讯\":10.0,\"阿里巴巴\":8.5}'";

public static void main(String[] args) {

KaldiRecognizer recognizer = new KaldiRecognizer(

MODEL_PATH,

CONFIG

);

}

}四、典型问题与调优策略

1. 常见错误类型分析

# 错误分析工具类

class ErrorAnalyzer:

@staticmethod

def wer(reference, hypothesis):

"""计算词错误率(WER)"""

ref_words = reference.split()

hyp_words = hypothesis.split()

return levenshtein(ref_words, hyp_words) / len(ref_words)

@staticmethod

def analyze_errors(reference, hypothesis):

errors = {

"insertions": 0,

"deletions": 0,

"substitutions": 0

}

# 实现细节省略...

return errors2. 领域自适应方案

# 领域自适应训练示例

from transformers import WhisperForConditionalGeneration

# 加载基础模型

model = WhisperForConditionalGeneration.from_pretrained("openai/whisper-medium")

# 准备领域数据

train_dataset = load_custom_dataset("medical_audio/")

# 微调训练

training_args = TrainingArguments(

output_dir="./results",

per_device_train_batch_size=8,

learning_rate=5e-5,

num_train_epochs=3

)

trainer = Trainer(

model=model,

args=training_args,

train_dataset=train_dataset

)

trainer.train()五、前沿趋势与挑战

1. 2023年技术风向标

-

多模态ASR:结合视觉信息的语音识别

-

个性化建模:用户自适应的语音模型

-

边缘计算:端侧实时ASR部署

-

代码切换:混合语言识别优化

2. 仍待解决的难题

# 语音识别挑战模拟器

class ASRChallenges:

@staticmethod

def process(audio):

challenges = []

if has_heavy_accent(audio):

challenges.append("方言口音")

if is_low_quality(audio):

challenges.append("低信噪比")

if contains_overlapping_speech(audio):

challenges.append("重叠语音")

return challenges结语:语音技术的未来之路

随着Whisper等开源模型的崛起,ASR技术民主化进程加速。但要在特定场景达到商用级精度,仍需在以下方面深耕:

-

领域数据的积累与清洗

-

计算资源的优化利用

-

交互体验的持续打磨

"语音将成为最重要的人机接口,而ASR是这背后的基石技术。" —— 微软首席语音科学家Xuedong Huang

互动话题:

你在ASR项目中遇到过哪些棘手问题?是如何解决的?欢迎分享你的实战经验!

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)