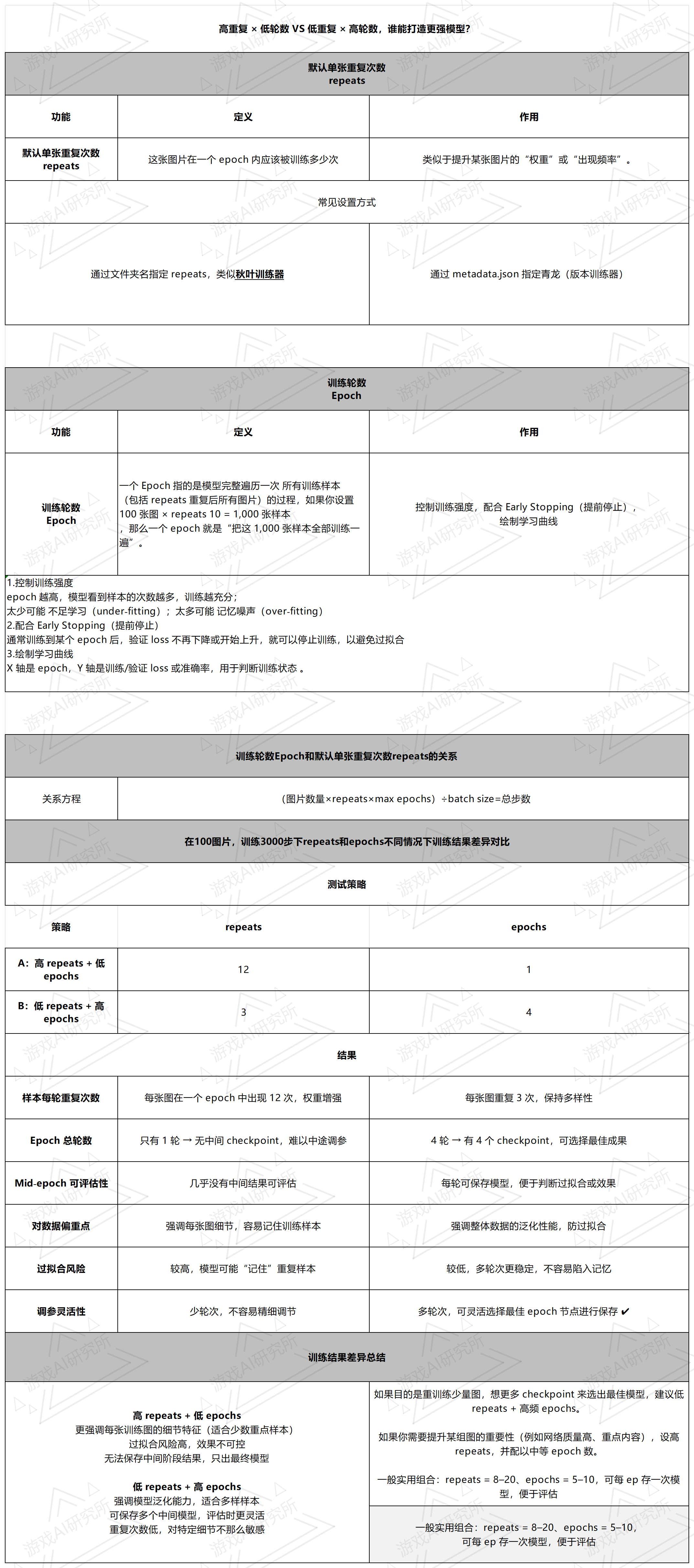

SD框架下 LoRA 训练教程5-高重复 × 低轮数 VS 低重复 × 高轮数,谁能打造更强模型?

在 LoRA(例如使用 Kohya‑ss)训练中,epochs 和 repeats 分别控制了模型“看”数据的轮数和每张图在一个epoch中出现的频次,两者共同决定训练强度和步骤总数

·

在 LoRA(例如使用 Kohya‑ss)训练中,epochs 和 repeats 分别控制了模型“看”数据的轮数和每张图在一个epoch中出现的频次,两者共同决定训练强度和步骤总数

基本关系

• repeats:每张训练图像在每个 epoch中被重复使用的次数。例如,repeats = 10 意味着每张图被看 10 次。

• epoch:模型完整遍历 (图片数量 × repeats) 次训练样本的次数。

• 总步骤 = 图片数量 × repeats × epoch ÷ batch_size(但是通常 batch_size 只是影响 step 多少次更新)。

例如:100 张图 × repeats 10 × epoch 5 = 5000 次训练样本的使用(步数除以 batch size)

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)