掌握LM算法:使用OpenCV进行非线性优化

Levenberg-Marquardt (LM) 算法,是数值计算领域中用于解决非线性最小二乘问题的一种有效优化方法。此算法特别适用于需要解决大规模问题的领域,如图像处理和计算机视觉。LM算法结合了梯度下降法和高斯-牛顿法的优点,在局部收敛性方面表现出色。该算法利用了二阶导数(海森矩阵)的近似,通过调整阻尼因子,兼顾了快速收敛与避免陷入局部极小点的问题。LM算法尤其在处理具有复杂结构的非线性问题时

简介:LM算法,即Levenberg-Marquardt算法,是一种用于解决非线性最小二乘问题的迭代方法,广泛应用于计算机视觉和图像处理领域。在”lm.rar”压缩包中包含的OpenCV库实现,允许开发者在求解非线性优化问题,如相机标定、物体识别、运动估计等任务中找到最佳参数。LM算法结合了高斯-牛顿法和阻尼因子来控制步长,提高全局收敛性。学习和应用这一算法能够提升模型拟合精度和系统性能。

1. Levenberg-Marquardt算法简介

Levenberg-Marquardt (LM) 算法,是数值计算领域中用于解决非线性最小二乘问题的一种有效优化方法。此算法特别适用于需要解决大规模问题的领域,如图像处理和计算机视觉。LM算法结合了梯度下降法和高斯-牛顿法的优点,在局部收敛性方面表现出色。

该算法利用了二阶导数(海森矩阵)的近似,通过调整阻尼因子,兼顾了快速收敛与避免陷入局部极小点的问题。LM算法尤其在处理具有复杂结构的非线性问题时,其迭代过程易于实现,且相较于其他算法,往往能够在较短的时间内找到满意的解。

在详细介绍LM算法在OpenCV中的实现之前,让我们首先了解该算法的基本概念与数学原理,为后续章节中关于算法具体应用和优化的讨论打下坚实的基础。

2. OpenCV中的LM算法实现与应用

2.1 Levenberg-Marquardt算法在OpenCV中的实现

2.1.1 OpenCV库概述及其安装

OpenCV(Open Source Computer Vision Library)是一个开源的计算机视觉和机器学习软件库。它由一系列的C函数和C++类构成,提供了各种图像处理、计算机视觉以及机器学习的算法。OpenCV的易用性、效率以及开放源码使其成为计算机视觉研究和应用的首选工具库。

安装OpenCV的步骤较为简单,可以根据不同的操作系统选择合适的安装方法。在多数情况下,可以使用包管理器或者直接下载预编译的二进制文件来安装。以下是在Ubuntu系统中使用包管理器安装OpenCV的示例步骤:

# 更新包列表

sudo apt-get update

# 安装OpenCV的预编译库

sudo apt-get install libopencv-dev

安装完成后,可以通过编写简单的程序代码来验证OpenCV库是否正确安装。

2.1.2 LM算法在OpenCV中的接口和函数使用

OpenCV实现了Levenberg-Marquardt算法,并提供了相应的接口函数。通常,这些函数用于进行图像校正、相机标定以及特征点匹配等操作。在OpenCV中,使用LM算法需要调用 cv::TermCriteria 来指定优化过程的终止条件,以及 cv::solvePnP 等函数来求解非线性最小二乘问题。

以下是一个使用LM算法进行相机标定的代码示例:

#include <opencv2/opencv.hpp>

#include <iostream>

int main() {

// 准备数据集,这里简化处理,仅作为示例

std::vector<cv::Point2f> image_points;

std::vector<cv::Point3f> object_points;

// 标定板上的点在实际空间中的坐标(简化为z=0平面)

object_points.push_back(cv::Point3f(0,0,0));

object_points.push_back(cv::Point3f(1,0,0));

object_points.push_back(cv::Point3f(1,1,0));

// ...其他点

// 图像上标定板的角点坐标

image_points.push_back(cv::Point2f(382.403f, 317.217f));

image_points.push_back(cv::Point2f(448.795f, 315.074f));

image_points.push_back(cv::Point2f(448.243f, 376.849f));

// ...其他点

cv::Mat cameraMatrix = cv::Mat::eye(3, 3, CV_64F);

cv::Mat distCoeffs;

std::vector<cv::Mat> rvecs, tvecs;

cv::TermCriteria criteria = cv::TermCriteria(cv::TermCriteria::COUNT + cv::TermCriteria::EPS, 100, 1e-6);

// 执行LM算法进行相机标定

cv::calibrateCamera(object_points, image_points, cv::Size(752, 582), cameraMatrix, distCoeffs, rvecs, tvecs, false, criteria);

return 0;

}

在上述代码中, cv::calibrateCamera 函数的参数包括标定对象的3D点和2D图像点,图像的尺寸,初始相机内参矩阵 cameraMatrix 、畸变系数 distCoeffs 、旋转向量 rvecs 和平移向量 tvecs 。函数执行后返回相机标定结果。

2.2 LM算法在计算机视觉中的应用

2.2.1 计算机视觉简介及重要性

计算机视觉是人工智能领域的一个分支,它使机器能够通过摄像头或视频等输入源识别、处理和解释图片和视频中的信息。计算机视觉的目标是使机器能够像人一样理解视觉信息,这在自动驾驶、医疗诊断、监控系统、机器人导航等众多领域都有广泛的应用。

计算机视觉系统通常需要处理大量复杂的数据,并从中提取有用的信息。为了实现这一点,常常需要对模型进行训练或校正,而LM算法在这里扮演着重要角色。利用LM算法对相机内参和外参进行标定,可以极大地提高后续视觉任务的精度。

2.2.2 LM算法在特征点匹配中的应用案例

特征点匹配是计算机视觉中的另一个常见任务。通过匹配不同视角下的同一对象的特征点,可以进行对象识别、三维重建等。LM算法在优化匹配过程中的几何变换时有着重要作用,例如在使用随机抽样一致性(RANSAC)算法进行鲁棒性匹配时。

以下是一个使用LM算法优化特征点匹配的简要示例:

// 假设已经计算出特征点匹配对 srcPoints 和 dstPoints

std::vector<cv::DMatch> matches;

// ... 匹配算法,如FLANN、BFMatcher等

// 使用LM算法求解最佳几何变换矩阵

cv::Mat inliers;

cv::Mat essentialMatrix;

cv::Mat fundamentalMatrix;

// 从匹配点对中筛选出最佳的内点集

std::vector<cv::Point2f> srcPoints;

std::vector<cv::Point2f> dstPoints;

for (const auto& m : matches) {

srcPoints.push_back(srcKP[m.queryIdx].pt);

dstPoints.push_back(dstKP[m.trainIdx].pt);

}

// 使用findEssentialMat和recoverPose提取本质矩阵和基础矩阵

cv::findEssentialMat(srcPoints, dstPoints, cameraMatrix, distCoeffs, cv::RANSAC, 0.999, 1.0, inliers, essentialMatrix);

// 根据本质矩阵和相机内参矩阵计算基础矩阵

cv::recoverPose(essentialMatrix, srcPoints, dstPoints, cameraMatrix, distCoeffs, rvecs, tvecs, inliers);

// 输出内点和外点

std::cout << "Inliers: " << inliers.size() << std::endl;

std::cout << "Outliers: " << matches.size() - inliers.size() << std::endl;

在上述代码中, cv::findEssentialMat 和 cv::recoverPose 函数利用LM算法来优化计算过程,通过内点集来估计相机的运动,从而对特征点进行精确匹配。

2.3 实际应用案例分析

2.3.1 非线性优化问题的定义和背景

非线性优化问题是在给定的约束条件下,寻找一组参数来最小化或最大化一个非线性目标函数。这类问题在机器学习、统计学、经济管理以及计算机科学等领域都极为常见。在计算机视觉中,非线性优化问题的典型应用包括相机标定、三维重建和图像配准等。

2.3.2 LM算法在实际问题中的应用实例

在实际应用中,LM算法用于求解非线性优化问题时,能够有效地结合梯度下降法和高斯-牛顿法的优点。LM算法特别适合于处理具有大量数据和复杂约束条件的问题。

例如,在相机标定中,我们可能会面对多种不同视角和条件下的图像,需要校正相机的内参和畸变参数以获得更准确的三维重建结果。在这种情况下,通过LM算法可以有效地迭代优化这些参数,实现高精度的标定过程。

通过使用LM算法,计算机视觉系统可以显著提高处理速度和准确性,这对于增强现实、机器人视觉导航等应用是至关重要的。

3. 非线性最小二乘问题求解

3.1 非线性最小二乘问题的基本概念

3.1.1 问题定义和数学模型

非线性最小二乘问题是一类广泛存在于科学研究和工程实践中的优化问题。其核心目标是找到一组参数,使得非线性函数的平方和最小化。这类问题可以用以下数学模型表示:

假设有一组观测数据点 ({ (x_i, y_i) | i = 1, 2, …, m }),我们想要找到参数向量 (\mathbf{p}),使得预测值 (\mathbf{f}(x_i, \mathbf{p})) 与实际观测值 (y_i) 的差的平方和最小,即最小化目标函数 (S(\mathbf{p})):

[ S(\mathbf{p}) = \sum_{i=1}^{m} \left(y_i - \mathbf{f}(x_i, \mathbf{p})\right)^2 ]

这里 (\mathbf{f}) 是非线性函数,依赖于独立变量 (x_i) 和参数向量 (\mathbf{p})。在实际应用中,函数 (\mathbf{f}) 通常非常复杂,解析求解是不可行的,因此需要采用迭代优化方法。

3.1.2 求解非线性最小二乘问题的常用方法

求解非线性最小二乘问题的常用方法包括牛顿法、高斯-牛顿法和Levenberg-Marquardt算法。牛顿法直接对目标函数求导,并利用泰勒展开近似求解,但在很多实际情况下不收敛或者收敛速度慢。

高斯-牛顿法对牛顿法进行改进,通过忽略二阶导数项以减少计算量,但在目标函数具有强非线性时,可能无法保证算法的收敛性。Levenberg-Marquardt算法结合了牛顿法和梯度下降法的优势,通过引入一个阻尼因子在牛顿法和梯度下降法之间做平衡,是解决非线性最小二乘问题最有效的方法之一。

3.2 LM算法求解过程详析

3.2.1 LM算法的迭代过程和关键步骤

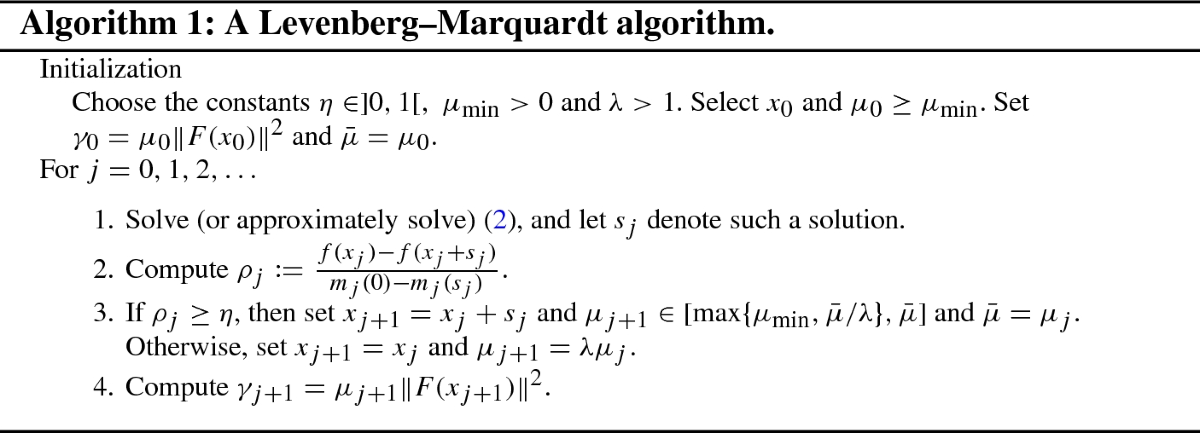

Levenberg-Marquardt算法的迭代过程如下:

- 初始化参数向量 (\mathbf{p}_0) 和阻尼因子 (\lambda_0)。

- 对于每次迭代,解决线性化后的近似问题,得到参数更新 (\Delta\mathbf{p})。

- 判断新的参数 (\mathbf{p}_{\text{new}} = \mathbf{p} + \Delta\mathbf{p}) 是否改善了目标函数值。

- 如果改善了,减少阻尼因子 (\lambda);否则,增加阻尼因子 (\lambda)。

- 重复步骤2至4,直到满足收敛条件。

LM算法的每次迭代可以分为两个关键步骤:

- 计算雅可比矩阵 :雅可比矩阵包含了目标函数关于参数向量的导数信息,对每个数据点 (x_i),雅可比矩阵的一个列向量表示为 (\frac{\partial \mathbf{f}(x_i, \mathbf{p})}{\partial \mathbf{p}})。计算雅可比矩阵是迭代过程中的关键步骤,因为它决定了参数更新的方向。

- 求解线性最小二乘问题 :使用计算出的雅可比矩阵 (J) 和残差向量 (r),求解线性方程组 (J^TJ\Delta\mathbf{p} = J^Tr) 来获取参数更新向量 (\Delta\mathbf{p})。这里 (J^TJ) 称为Hessian矩阵。

3.2.2 算法收敛性的理论分析

LM算法的收敛性是基于迭代过程中的参数更新是否能够有效降低目标函数的值。从理论上讲,LM算法通过适当选择阻尼因子 (\lambda),能够保证每次迭代都会使目标函数值下降,从而保证算法的收敛性。

在每次迭代中,LM算法都会尝试找到一个合适的 (\lambda),使得:

- 当 (\lambda) 较小时,算法的行为类似于高斯-牛顿法,如果当前的线性近似合理,可以快速得到接近真实值的参数解。

- 当 (\lambda) 较大时,算法行为接近梯度下降法,增加的阻尼可以避免目标函数值的增加,确保算法稳定。

LM算法的收敛速度通常取决于参数选择和问题本身的复杂度。在实践中,为了避免过早收敛到局部最小值,可能会采用更复杂的策略,如动态调整阻尼因子或者结合全局优化策略。

import numpy as np

def levenberg_marquardt(f, df, p, lambda_, epsilon):

"""

Levenberg-Marquardt 算法的简单实现。

:param f: 目标函数

:param df: 雅可比矩阵函数

:param p: 初始参数向量

:param lambda_: 初始阻尼因子

:param epsilon: 收敛阈值

:return: 最小化后的参数向量

"""

while True:

J = df(p) # 计算雅可比矩阵

# 求解线性最小二乘问题得到参数更新

delta_p, _, _, _ = np.linalg.lstsq(J.T @ J + lambda_ * np.eye(J.shape[1]), J.T @ (f(p)), rcond=None)

p_new = p + delta_p # 更新参数

# 判断收敛性

if np.linalg.norm(f(p_new)) < epsilon:

break

# 根据目标函数值的改变调整阻尼因子

if np.linalg.norm(f(p_new)) < np.linalg.norm(f(p)):

lambda_ *= 0.5 # 如果改善则减小阻尼因子

else:

lambda_ *= 10.0 # 如果未改善则增大阻尼因子

p = p_new

return p_new

# 示例目标函数和雅可比矩阵函数

def example_function(p):

# 示例非线性函数

pass

def example_jacobian(p):

# 示例雅可比矩阵计算

pass

# 运行LM算法

p_initial = np.array([...]) # 初始参数

lambda_initial = 1.0 # 初始阻尼因子

epsilon = 1e-6 # 收敛阈值

p_optimized = levenberg_marquardt(example_function, example_jacobian, p_initial, lambda_initial, epsilon)

以上代码是LM算法的一个简单实现,目标函数 f 和雅可比矩阵 df 函数需要根据实际问题进行定义。这个示例展示了LM算法的关键步骤:计算雅可比矩阵、求解线性方程组和参数更新。代码逻辑清晰地展示了算法的迭代过程,包括在每次迭代中阻尼因子的调整以及收敛性的判断。

4. 高斯-牛顿法与阻尼因子的结合原理

4.1 高斯-牛顿法的基本原理

4.1.1 高斯-牛顿法的数学背景和推导

高斯-牛顿法是数值优化中的一种迭代算法,用于求解非线性最小二乘问题。它基于线性最小二乘问题的高斯消元法进行改进,采用牛顿法的迭代格式,但避免了计算二阶导数,从而减少了计算量。高斯-牛顿法的优化目标是找到一组参数,使得误差的平方和最小化。数学上,这可以通过下面的函数来表述:

[

\min_{\mathbf{x}} \frac{1}{2} \sum_{i=1}^{m} r_i(\mathbf{x})^2

]

其中,(r_i(\mathbf{x})) 表示第 (i) 个测量值和模型预测值之间的残差,(\mathbf{x}) 是要估计的参数向量。高斯-牛顿法通过迭代的方式逐步改善 (\mathbf{x}),直至找到一个使得残差平方和最小的参数集。

4.1.2 高斯-牛顿法在优化问题中的应用

高斯-牛顿法在诸如计算机视觉中的位姿估计、图像配准、机器人路径规划等领域的非线性优化问题中有着广泛的应用。它特别适用于残差接近线性的情况,或者当误差函数的二阶导数很难计算或者计算代价很高时。由于这种方法的高效性,它常被用作初始估计,随后可以结合LM算法进一步细化解。

4.2 LM算法中的阻尼因子作用

4.2.1 阻尼因子的引入和作用机制

Levenberg-Marquardt算法引入了一个阻尼因子 (\lambda),用于控制算法的迭代步长。在高斯-牛顿法中,由于忽略了二阶导数项,当残差曲面的形状不利于优化时(例如,接近一个锐角或者在高度非线性区域),算法可能会发散。阻尼因子可以看作是一个自适应项,它通过加权残差曲面的近似来改进收敛性。

阻尼因子的引入机制可以简单描述如下:

[

\mathbf{x}_{k+1} = \mathbf{x}_k + (\mathbf{J}(\mathbf{x}_k)^T \mathbf{J}(\mathbf{x}_k) + \lambda \mathbf{I})^{-1} \mathbf{J}(\mathbf{x}_k)^T \mathbf{r}(\mathbf{x}_k)

]

其中,(\mathbf{J}) 是雅可比矩阵,(\mathbf{r}) 是残差向量,(\mathbf{I}) 是单位矩阵,(\lambda) 是阻尼因子。

4.2.2 阻尼因子调整策略的实现细节

阻尼因子的调整是LM算法的核心,它涉及到如何根据每次迭代的结果来调整 (\lambda) 的大小。一个简单的策略是,如果当前迭代使得目标函数值减小,那么减少阻尼因子,这样可以增加步长;反之,则增加阻尼因子以减小步长,从而保证算法的稳定性和收敛性。

通常,阻尼因子的调整可以分为以下几种情况:

- 如果 (\mathbf{x}_{k+1}) 较好地改善了目标函数,那么减小 (\lambda);

- 如果 (\mathbf{x}_{k+1}) 并未明显改善目标函数,那么保持 (\lambda) 不变;

- 如果 (\mathbf{x}_{k+1}) 导致目标函数变差,那么增大 (\lambda)。

阻尼因子的调整策略必须精心设计,以便在快速收敛和保持稳定性之间取得平衡。以下是LM算法中阻尼因子调整的伪代码表示:

lambda = initial_lambda

while (not converged) {

x_new = compute_new_x(x_old, lambda)

if (function_value(x_new) < function_value(x_old)) {

x_old = x_new

lambda = decrease_lambda(lambda)

} else {

lambda = increase_lambda(lambda)

}

}

在这个过程中, compute_new_x 、 decrease_lambda 和 increase_lambda 都是根据特定策略实现的函数,它们共同确保了算法能够有效地在复杂优化问题中找到最优解。

至此,本章已经深入探讨了高斯-牛顿法的基本原理以及LM算法中阻尼因子的作用和调整策略。接下来的章节将重点讲解LM算法的全局收敛性优势,展示其在与其它优化算法比较中的独特优势。

5. LM算法的全局收敛性优势

在优化问题的解决过程中,算法的收敛性是一个至关重要的属性。收敛性可以分为局部收敛性和全局收敛性。局部收敛性指的是算法在一定条件下仅能保证从特定的初始点出发能找到局部最优解,而全局收敛性则表明算法能够从任意初始点出发,并最终找到全局最优解。Levenberg-Marquardt (LM)算法正是由于其出色的全局收敛性而受到青睐。

5.1 全局收敛性的数学定义和意义

5.1.1 全局收敛性与局部收敛性的对比

局部收敛性意味着算法可能会陷入局部最优解,并且其性能严重依赖于初始点的选择。例如,梯度下降法就是一种典型的局部收敛算法。对于非凸问题,梯度下降法可能无法找到全局最优解,因为一旦陷入局部最优,它无法跨越障碍到达全局最优。

与此相反,全局收敛性意味着算法不依赖于初始点的选择,理论上可以从任何合理的起点出发最终逼近全局最优解。全局收敛算法通常结合了梯度信息和函数的二阶导数信息,从而能够提供一种更加全面的搜索策略。

5.1.2 LM算法的全局收敛性证明

LM算法通过引入阻尼因子来平衡梯度下降和高斯-牛顿法各自的优缺点。算法在每一步迭代时都会调整这个阻尼因子,以确保每次更新都能够朝着减小目标函数的方向进行。当目标函数足够平滑时,LM算法的更新可以保证沿着目标函数的下降方向进行,且由于阻尼因子的引入,算法不会像纯高斯-牛顿法那样对雅可比矩阵的奇异性过于敏感。因此,LM算法能够在多种情况下保持算法的稳定性和收敛性,从而证明了其全局收敛性。

5.2 LM算法与其它优化算法比较

5.2.1 与梯度下降法的比较

梯度下降法是最基础的优化算法之一,它通过计算目标函数关于参数的梯度,并沿着负梯度方向更新参数来逼近最优解。这种更新策略简单但容易受梯度消失或梯度爆炸问题的影响,且容易陷入局部最小值。LM算法则结合了梯度下降法的思想和近似的二阶优化策略,有效地改善了收敛速度和解的质量,特别是对于非线性问题和局部最小值问题。

5.2.2 与其他二阶优化方法的对比分析

与LM算法类似的二阶优化算法包括牛顿法和拟牛顿法等。牛顿法直接使用目标函数的二阶导数(海森矩阵)来计算更新方向,但由于需要计算和存储海森矩阵,计算成本较高,尤其对于高维问题更是如此。拟牛顿法通过迭代近似海森矩阵或其逆矩阵来降低计算负担,但仍然需要对近似矩阵进行更新和存储。

LM算法在设计上克服了传统牛顿法的某些局限性。它使用雅可比矩阵(即一阶导数或梯度)和近似的海森矩阵(由阻尼因子调整)来计算每次迭代的步长。这种方法不需要存储整个海森矩阵,大大减少了内存需求。同时,由于阻尼因子的存在,LM算法对于病态问题(即海森矩阵接近奇异)也显示出更强的鲁棒性。

在实际应用中,LM算法能够提供一种可靠且有效的优化策略,尤其适用于非线性最小二乘问题和需要全局收敛性的场景。

5.2.3 LM算法的实践优势

在处理具体问题时,LM算法的全局收敛性优势使其成为许多场景下的首选算法。为了展示这一点,我们可以通过一个实际的优化问题来比较LM算法和其他方法的性能。下面,我们考虑一个典型的非线性优化问题,并对比LM算法与其他算法的求解过程和结果。

假设我们有一个目标函数f(x),我们试图找到一组参数x,使得f(x)达到最小值。下面是使用不同的优化方法求解该问题的步骤:

- 梯度下降法 :需要选择合适的学习率,并可能需要多次迭代。容易受梯度消失或爆炸问题的影响,并且容易陷入局部最小值。

- 牛顿法 :在每一步迭代中都计算海森矩阵,然后利用该矩阵求解步长。计算成本高,且对初始点敏感。

- 拟牛顿法 :通过迭代更新近似的海森矩阵或其逆矩阵,降低计算成本,但仍需存储矩阵。

- LM算法 :采用阻尼因子调整的近似海森矩阵和雅可比矩阵,计算更新步长。不需要存储海森矩阵,对病态问题具有鲁棒性。

为了进行对比,我们可以在Python中使用 scipy.optimize 库中的相关函数,比如 scipy.optimize.least_squares (基于LM算法)、 scipy.optimize.minimize (支持多种优化算法,包括梯度下降、牛顿法和拟牛顿法等)来求解上述问题,并记录每种方法的迭代次数、收敛速度和解的稳定性。

通过实际案例的分析,我们不仅可以了解不同优化算法的理论差异,还能直观地感受到LM算法在解决实际问题时的实用性和优势。这也验证了LM算法作为全局收敛优化算法的重要性,并且展示了为何它在计算机视觉、机器学习和其他工程领域中被广泛采用。

6. OpenCV中LM算法的使用方法

6.1 目标函数和雅可比矩阵的计算

6.1.1 目标函数的定义和实现

在非线性优化问题中,目标函数通常是需要最小化的函数,它代表了模型预测值和实际观测值之间的差异。在使用OpenCV中的Levenberg-Marquardt(LM)算法时,首先需要定义一个目标函数,该函数接受一组参数和观测数据作为输入,返回一个与误差相关的数值。

目标函数的定义通常遵循如下形式:

def objective_function(params, *data):

# params: 待优化的参数列表

# data: 包含额外数据(如观测数据、模型参数等)的元组

# 计算模型预测值与观测值之间的差异

predictions = model(params, data)

errors = predictions - data[0] # 假设观测数据在data的第一个位置

# 计算并返回误差的平方和,作为优化的目标

return np.sum(errors**2)

在这个例子中, model 是一个根据参数和数据计算预测值的函数。 params 是需要优化的参数,而 data 包含了其他必要的数据。通常,我们会使用误差的平方和作为目标函数,因为LM算法的实现基于最小化这种平方和。

6.1.2 雅可比矩阵的概念及其计算方法

雅可比矩阵是一个函数相对于其参数的一阶偏导数矩阵。对于目标函数而言,雅可比矩阵的每一行对应于一个数据点的误差相对于所有参数的偏导数。在LM算法中,雅可比矩阵用于计算残差关于参数的梯度,是算法高效收敛的关键因素。

计算雅可比矩阵可以使用数值方法,如有限差分法,但更高效的方法是直接从目标函数的数学表达式中推导出来。

在实现中,可以使用以下方式计算雅可比矩阵:

def jacobian(params, *data):

# 计算雅可比矩阵

num_params = len(params)

num_data = len(data[0]) # 假设data[0]是观测数据

# 初始化雅可比矩阵

J = np.zeros((num_data, num_params))

# 对每个参数进行微分

for i in range(num_params):

param_copy = params.copy()

h = 1e-5

param_copy[i] += h

J[:, i] = (objective_function(param_copy, *data) - objective_function(params, *data)) / h

return J

在这个简化的例子中,我们通过增加每个参数 h 的微小值来近似偏导数,即使用了中心差分法。实际应用中可能需要更复杂的雅可比矩阵计算方法,特别是在参数和数据维度较高时。

6.2 LM算法的函数接口详解

6.2.1 OpenCV中LM算法相关函数参数解析

OpenCV中的LM算法通过 cv2.optimizeLM 函数实现,其参数包括:

params, retval, ier, msg, operation_time = cv2.optimizeLM(

objective_function,

initial_params,

data=None,

LM=...,

param1=...,

param2=...,

...

)

objective_function: 目标函数,如前面定义的objective_function。initial_params: 一组初始参数,这是优化开始的起点。data: 目标函数中使用的额外数据。LM: LM算法的控制参数,调整算法的阻尼因子。param1,param2, …: 其他可选参数,如迭代次数、收敛阈值等。

6.2.2 函数接口使用中的注意事项

在使用 cv2.optimizeLM 函数时,有几个重要的注意事项:

- 初始参数的选取 :初始参数应该基于问题先验知识选取,好的初始参数可以加快收敛速度,并避免陷入局部最小值。

- 参数

LM的调整 :参数LM用于控制阻尼因子的更新,是决定算法性能的关键。较小的LM值倾向于进行更细致的搜索,而较大的LM值则使得每次迭代步长更大,但可能导致收敛速度变慢。 - 终止条件 :可以设置迭代次数和目标函数改进的阈值来终止优化过程,确保算法在合理的时间内完成。

- 性能监控 :监测算法的迭代次数、执行时间和目标函数值的改进,可以帮助评估算法的性能和调整参数。

在实际应用中,可能需要多次试验调整这些参数,以获得最佳优化结果。由于非线性优化问题的复杂性,通常很难预先确定最合适的参数设置,实验和调试是这一过程不可或缺的环节。

7. 非线性优化问题的实际应用案例

在前面的章节中,我们讨论了Levenberg-Marquardt(LM)算法的理论基础、在OpenCV中的实现,以及与高斯-牛顿法的结合原理。本章将通过一个具体的非线性优化问题的实际应用案例,展示如何将LM算法应用到实际问题中,并进行详细的实操及结果分析。

7.1 应用案例的选择和背景介绍

7.1.1 案例选取的标准和范围

选取应用案例的标准需要考虑以下几个因素:

- 问题的代表性 :案例应涵盖常见的非线性优化问题类型。

- 数据的可获得性 :需要有充足和准确的数据供模型训练和验证。

- 解决的可行性 :问题应该是在当前技术下有可能解决的。

- 教学意义 :案例应便于理解,并能深入展示LM算法的应用细节。

7.1.2 案例背景及问题设定

我们的案例是关于机器人路径规划问题。在这个问题中,机器人需要在一个充满障碍物的环境中,从起点移动到终点,同时最小化其行驶路径的总长度。路径规划属于典型的非线性优化问题,且常应用在移动机器人、自动驾驶车辆等领域。

问题设定如下:

- 起点:(x0, y0)

- 终点:(x1, y1)

- 障碍物位置:集合 {O1, O2, …, On}

- 机器人运动模型:假设机器人在任意两点之间的运动遵循直线运动,且运动过程中需要避免与障碍物的碰撞。

接下来,我们将用LM算法来求解这个问题。

7.2 案例实操及结果分析

7.2.1 非线性优化问题解决步骤演示

使用LM算法解决非线性优化问题,通常需要以下步骤:

-

建立目标函数 :目标函数需要能够表征机器人从起点到终点的路径长度。假设路径由一系列的直线段组成,那么目标函数可以是所有直线段长度的和。

-

设定约束条件 :约束条件确保机器人路径不会穿过障碍物。

-

选择合适的LM算法参数 :包括初始雅可比矩阵、误差容忍度、阻尼因子等。

-

编写代码实现LM算法 :具体代码实现将在本章后续部分给出。

7.2.2 结果分析与评价标准

通过LM算法求解得到路径规划后,我们需要对结果进行分析:

- 路径长度 :优化后路径的总长度是否满足问题设定中的需求。

- 计算效率 :LM算法在求解过程中的迭代次数以及计算时间。

- 路径可行性 :优化后的路径是否成功避开了所有障碍物。

最终的评价标准可以通过以下指标进行:

- 总路径长度 :路径规划的主要优化目标。

- 计算时间 :衡量算法实际应用中的性能。

- 路径安全性 :路径是否满足安全约束,即不穿过障碍物。

接下来,我们将展示使用Python语言结合OpenCV库实现LM算法解决此路径规划问题的代码示例。

简介:LM算法,即Levenberg-Marquardt算法,是一种用于解决非线性最小二乘问题的迭代方法,广泛应用于计算机视觉和图像处理领域。在”lm.rar”压缩包中包含的OpenCV库实现,允许开发者在求解非线性优化问题,如相机标定、物体识别、运动估计等任务中找到最佳参数。LM算法结合了高斯-牛顿法和阻尼因子来控制步长,提高全局收敛性。学习和应用这一算法能够提升模型拟合精度和系统性能。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献27条内容

已为社区贡献27条内容

所有评论(0)