Ollama+DeepSeek本地大模型部署

MaxKB = Max Knowledge Base,是一款基于大语言模型和 RAG 的开源知识库问答系统,广泛应用于智能客服、企业内部知识库、学术研究与教育等场景。可以快速在本地部署和管理各种大语言模型,操作命令和dokcer类似。Maxkb接入Ollama。

·

1、Ollama

Ollama可以干什么? 他是一个大模型本地化部署的工具,可以在本地快速部署和管理各种大语言模型,基于命令行方式操作。

mac安装ollama:

# 安装ollama

brew install ollama

# 启动ollama服务(默认11434端口,模型文件在 ~/.ollama)

ollama serve

windows安装ollama:

Ollama常用命令:

- 启动Ollama服务:

ollama serve - 从模型文件创建模型:

ollama create - 显示模型信息:

ollama show 模型名称 - 运行模型:

ollama run 模型名称 - 拉取模型:

ollama pull 模型名称 - 将模型推送到私服:

ollama push - 列出本地模型:

ollama list - 复制模型:

ollama cp - 删除模型:

ollama rm 模型名称 - 获取有关Ollama任何命令的帮助信息:

ollama help

2、DeepSeek R1

打开一个新的命令行窗口,使用ollama安装DeepSeek R1模型:

ollama run deepseek-r1:1.7b

测试命令行方式对话:

3、Ollama相关配置

也就是环境变量相关配置。

- 模型下载位置:(ollama默认下载位置是C盘)

- 变量名:OLLAMA_MODELS

- 变量值:F:\ollama\models

- 配置跨域:

- 变量名1:OLLAMA_HOST

- 变量值1:0.0.0.0

- 变量名2:OLLAMA_ORIGINS

- 变量值2:*

- ollama监听端口配置:

- 变量名:OLLAMA_PORT

- 变量值:11434

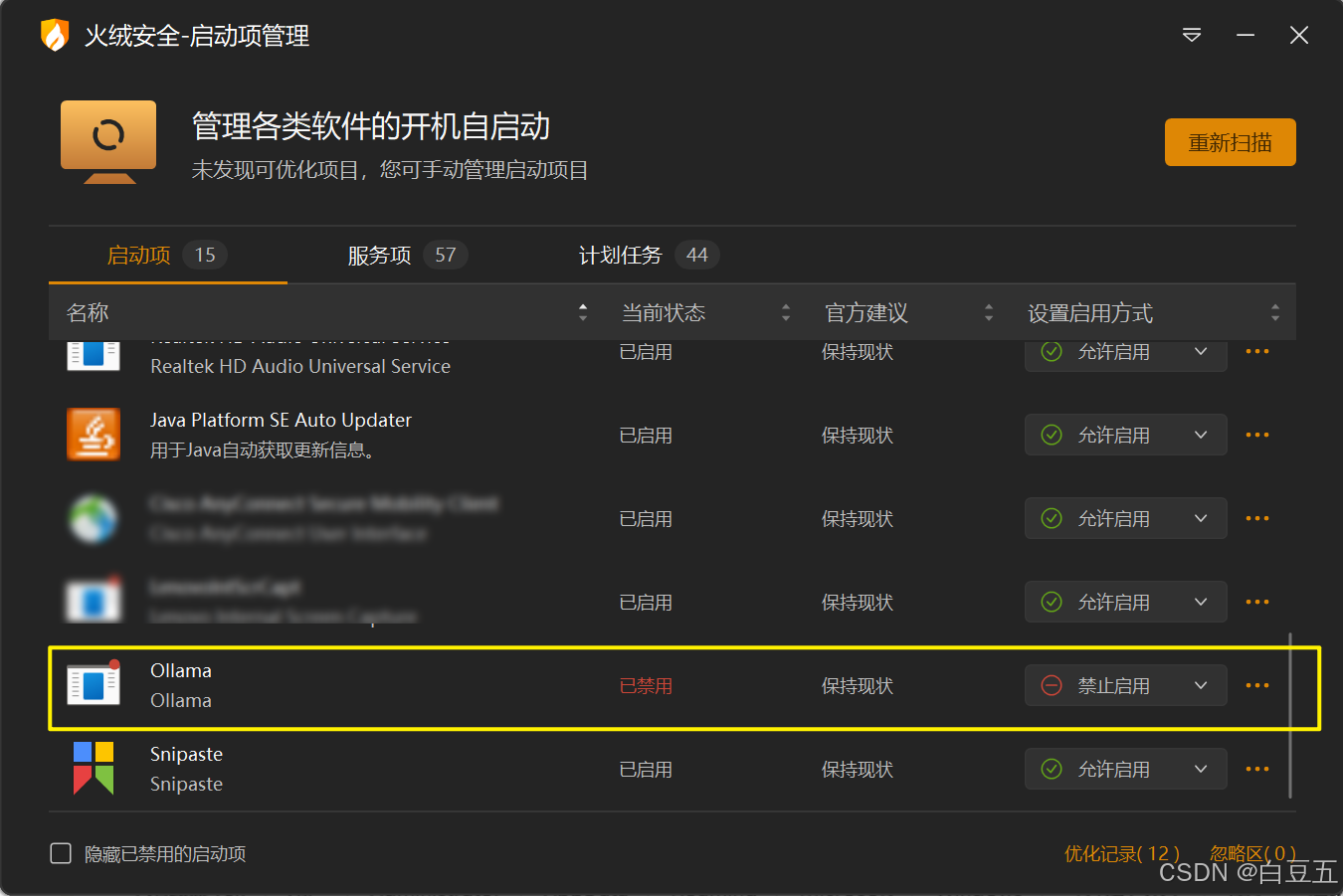

- 关闭ollama开机自启:

mac上配置局域网可访问,在环境变量添加如下配置:

#ollama局域网访问配置

export OLLAMA_HOST="0.0.0.0:11434"

# 启动服务

ollama serve

# 调用ollama接口

curl http://ip地址:11434/api/chat -d '{

"model": "qwen2.5-coder:7b",

"messages": [

{"role": "user", "content": "随机生成励志句子"}

],

"stream": false

}'

{"model":"qwen2.5-coder:7b","created_at":"2026-04-20T00:46:55.268588Z","message":{"role":"assistant","content":"坚持才能创造奇迹。"},"done":true,"done_reason":"stop","total_duration":1321955834,"load_duration":879460042,"prompt_eval_count":33,"prompt_eval_duration":255282958,"eval_count":6,"eval_duration":181104418}%

4、使用Cherry Studio接入本地Ollama

Cherry Studio的下载地址:https://cherry-ai.com/

Cherry Studio 可以本地配置知识库。

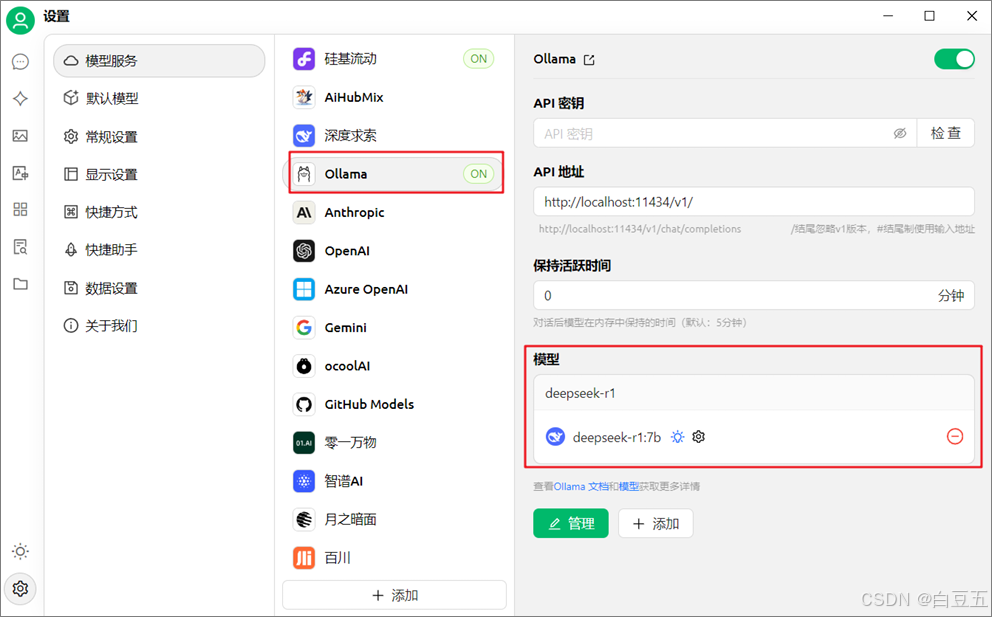

1、在CherryStudio中配置ollama

如果这里列表没刷出模型,则是模型没有装好。

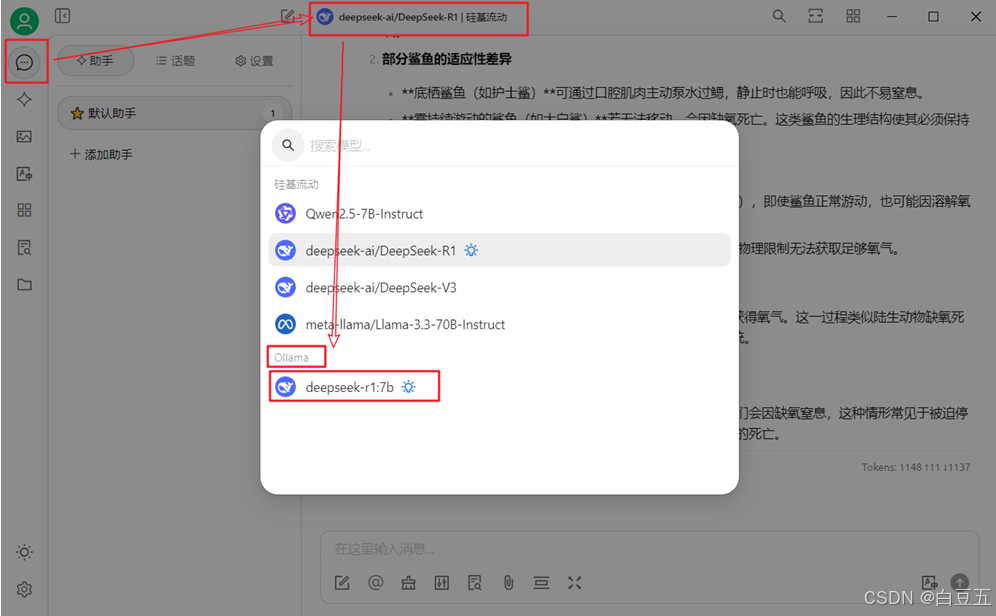

2、在对话中切换要使用的模型:

注:使用CherryStudio时要确保ollama客户端已启动。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)