基于 ollama 和 Qwen 让模型进行角色扮演和模型破限,大模型入门到精通,收藏这篇就足够了!

我将在本文介绍如何通过 unsloth 框架以 LoRA 的方法微调 Qwen3-14B 模型。

我将在本文介绍如何通过 unsloth 框架以 LoRA 的方法微调 Qwen3-14B 模型。

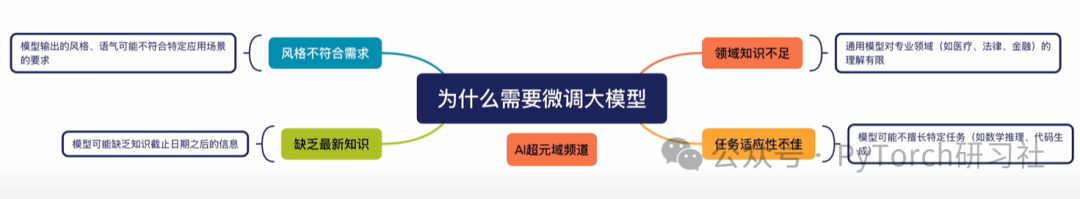

到目前还有很多小伙伴还不明白什么时候应该微调?那么请看下图:

接下来我们再看一下本文使用的 LoRA 微调方法的优势:

LoRA(Low-Rank Adaptation of Large Language Models,大型语言模型的低秩自适应)是一种流行的轻量级训练技术,可以显著减少可训练参数的数量。它的工作原理是将少量的新权重插入模型中,并且只训练这些权重。这使得使用 LoRA 进行训练的速度更快、内存效率更高,并且生成的模型权重更小(只有几百 MB),更易于存储和共享。LoRA 还可以与 DreamBooth 等其他训练技术结合使用,以加速训练。

我们将在本文介绍如何微调使模型成为一个"双重人格"的助手,既能进行普通闲聊,又能在需要时切换到更严谨的思考模式来解决复杂问题,特别是数学问题。简而言之,微调后的模型获得的能力:

- 双模式操作能力:

- 普通对话模式: 适用于日常聊天场景。

- 思考模式( Thinking Mode ): 用于解决需要推理的问题。

-

数学推理能力: 能够解决数学问题并展示详细的推理过程,如示例中的"解方程(x + 2)^2 = 0"。

-

对话能力保持: 同时保持了自然对话的能力,能够进行流畅的多轮对话。

首先我们在谷歌 Colab 上选择算力,推荐使用 T4 GPU 或者 A100 GPU:

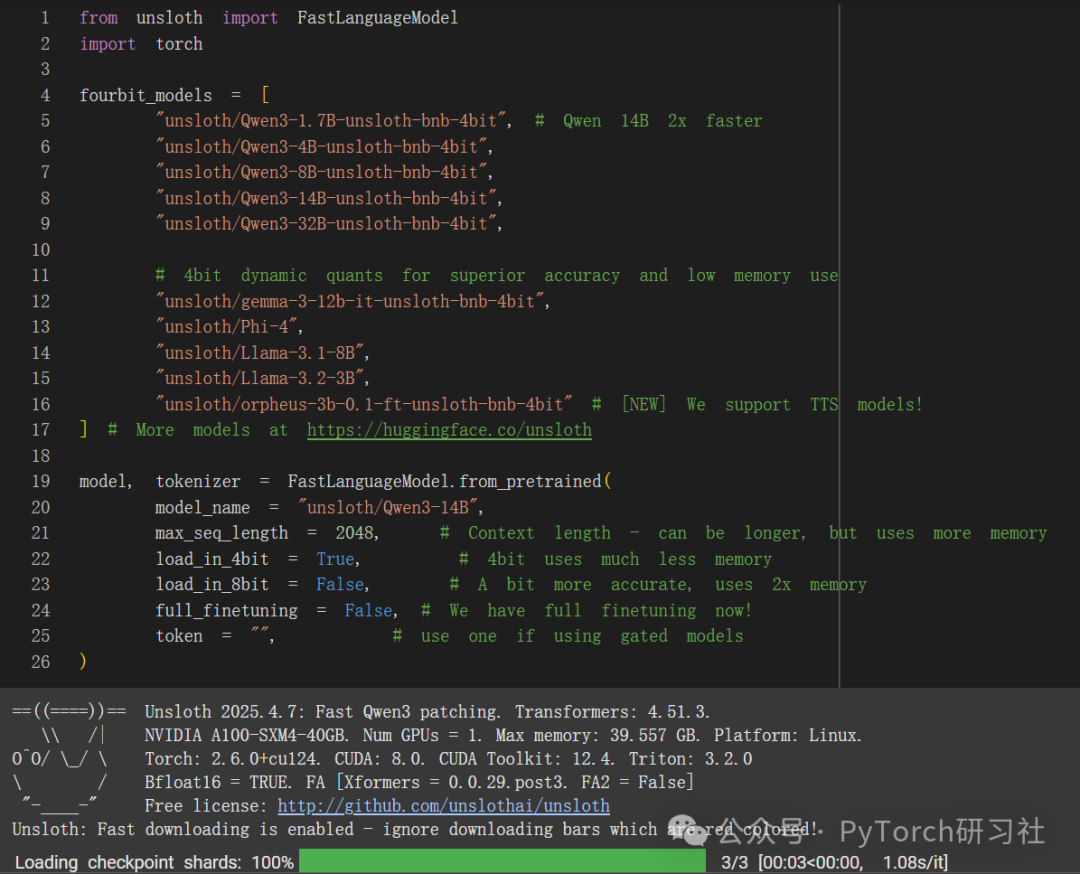

现在我们可以加载 14 B模型:

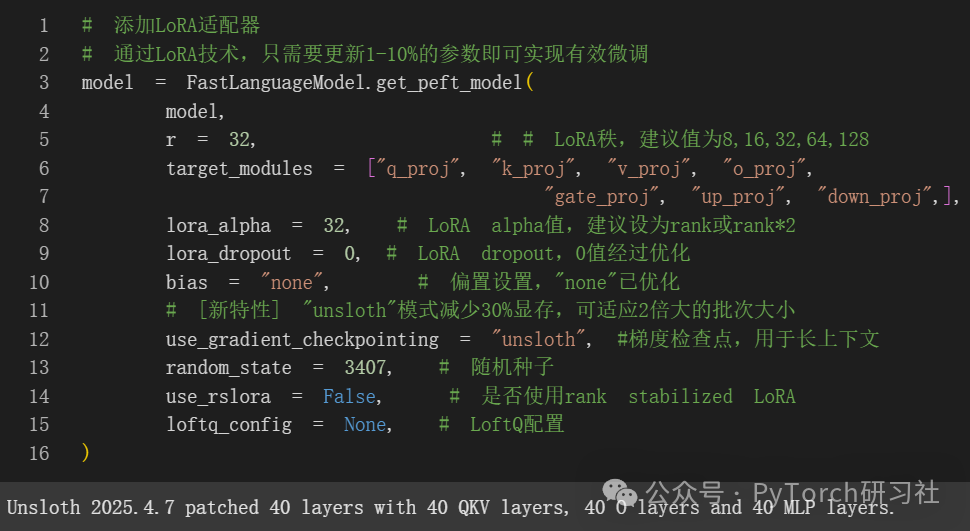

我们现在添加 LoRA 适配器,因此我们只需要更新 1% 到 10% 的参数!

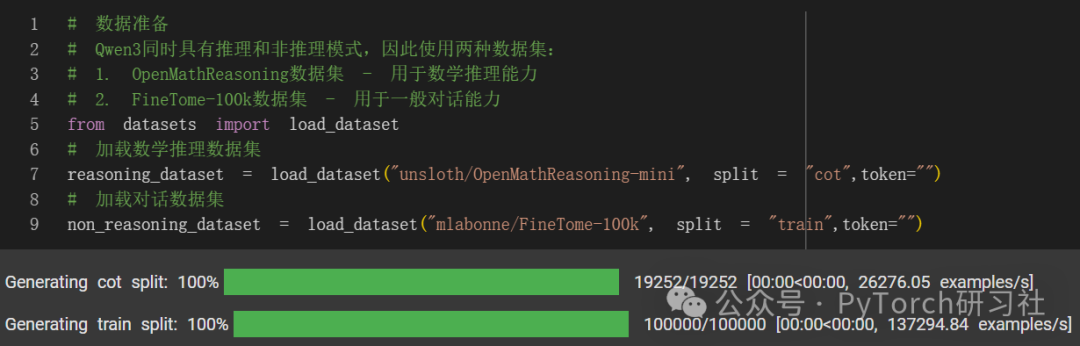

准备数据

Qwen3 既有推理模式,也有非推理模式。因此,我们应该使用两个数据集:

- Open Math Reasoning 数据集,该数据集曾用于赢得 AIMO(AI Mathematical Olympiad,AI 数学奥林匹克 - 进步奖 2)挑战赛!我们从使用 DeepSeek R1 的可验证推理轨迹中抽取了 10%,其准确率超过 95%。

- 我们还利用了 Maxime Labonne 的 FineTome-100k 数据集(ShareGPT 格式)。但我们还需要将其转换为 HuggingFace 的常规多轮对话格式。

我们现在将推理数据集转换为对话格式:

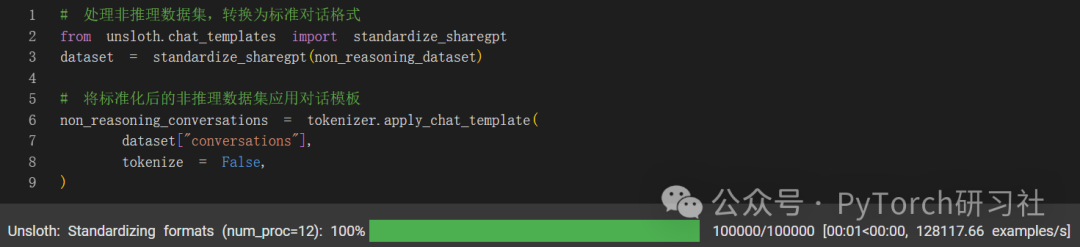

接下来,我们将非推理数据集也转换为对话格式。

首先,我们必须使用 Unsloth 的 standardize_sharegpt 函数来修复数据集的格式。

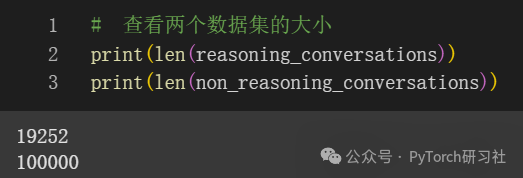

非推理数据集要长得多。假设我们希望模型保留一些推理能力,但我们特别想要一个聊天模型。

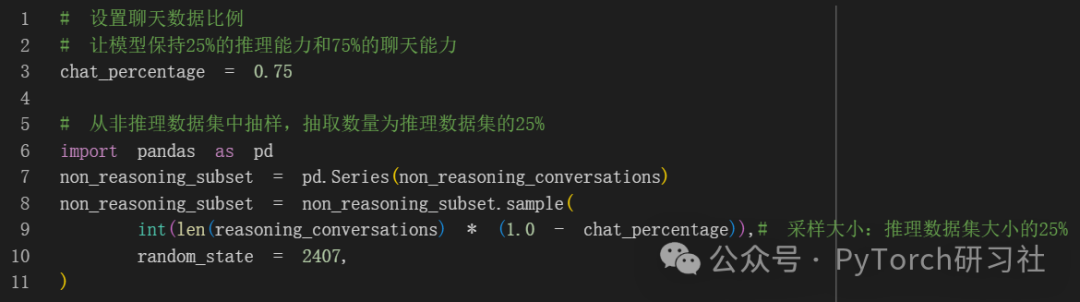

让我们定义一个纯聊天数据的比例。目标是定义两种数据集的某种混合。让我们选择 25% 的推理数据和 75% 的聊天数据:

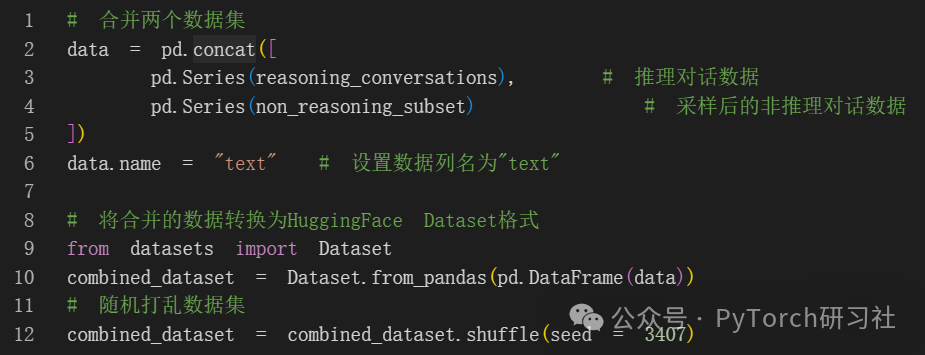

最后合并数据集:

训练模型

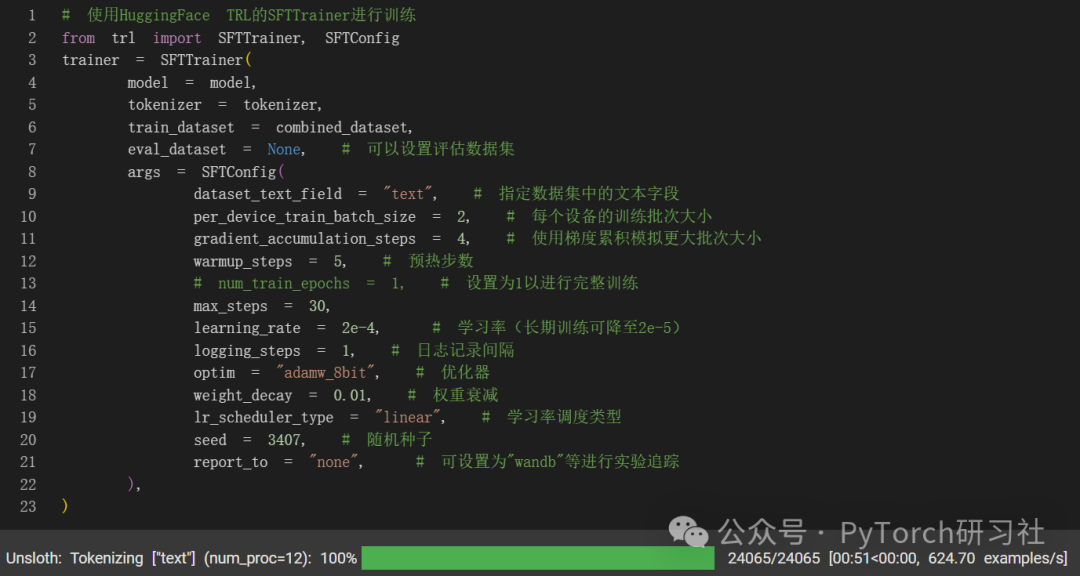

现在让我们使用 Huggingface TRL 的 SFTTrainer!我们执行 60 步来加快速度,但你可以设置 num_train_epochs=1 进行完整运行,并关闭 max_steps=None。

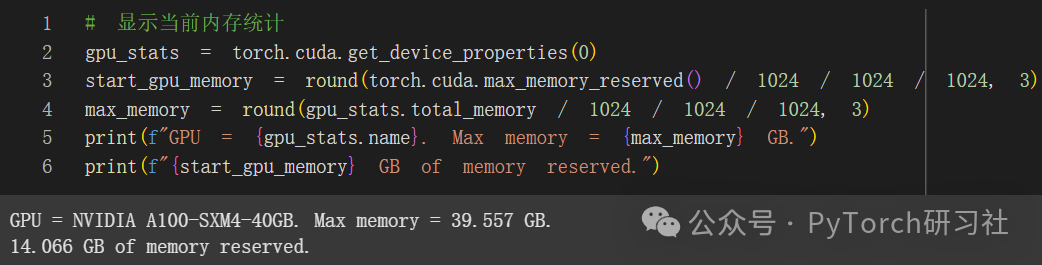

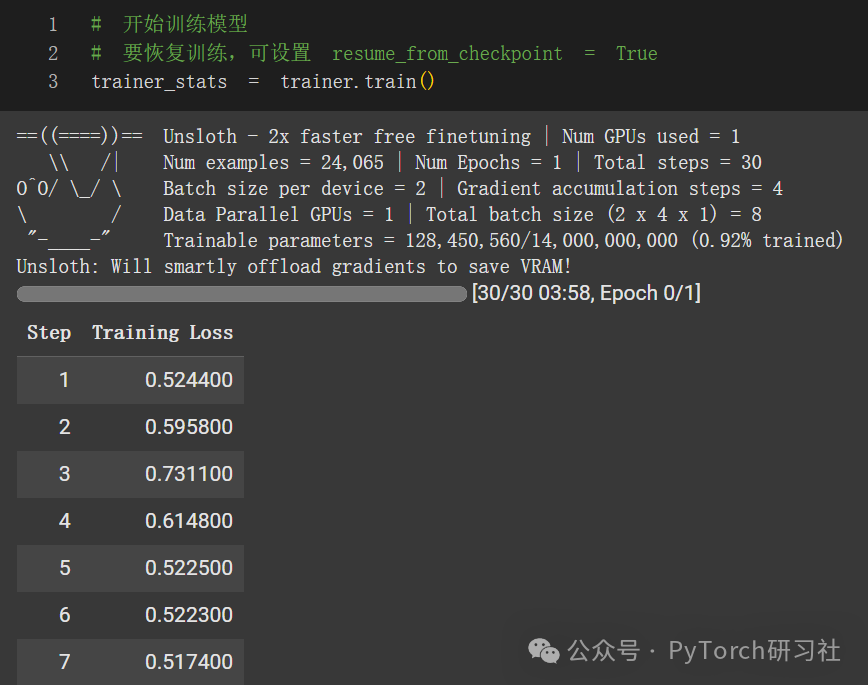

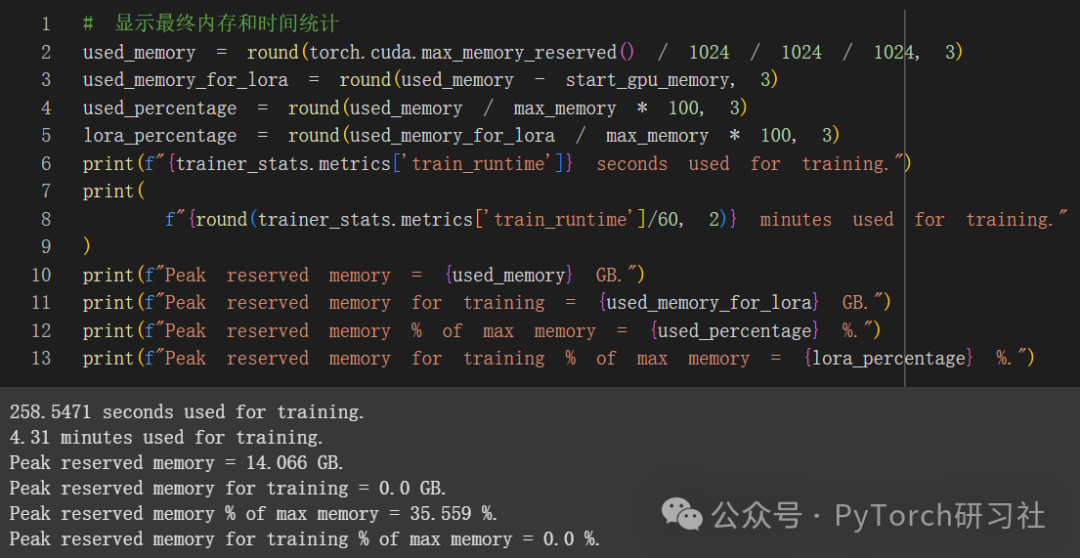

让我们开始训练模型吧!要恢复训练,请设置 trainer.train(resume_from_checkpoint = True)

推理

让我们通过 Unsloth 原生推理来运行模型!根据 Qwen-3 团队的说法,

- 推理的推荐设置是:temperature = 0.6、top_p = 0.95、top_k = 20。

- 对于基于普通聊天的推理,temperature = 0.7、top_p = 0.8、top_k = 20。

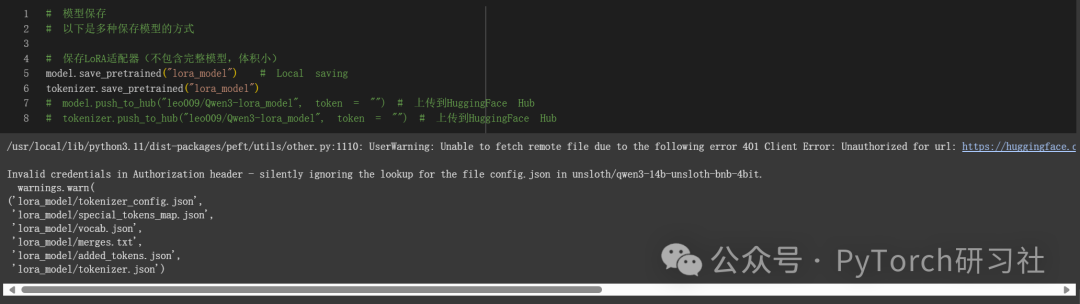

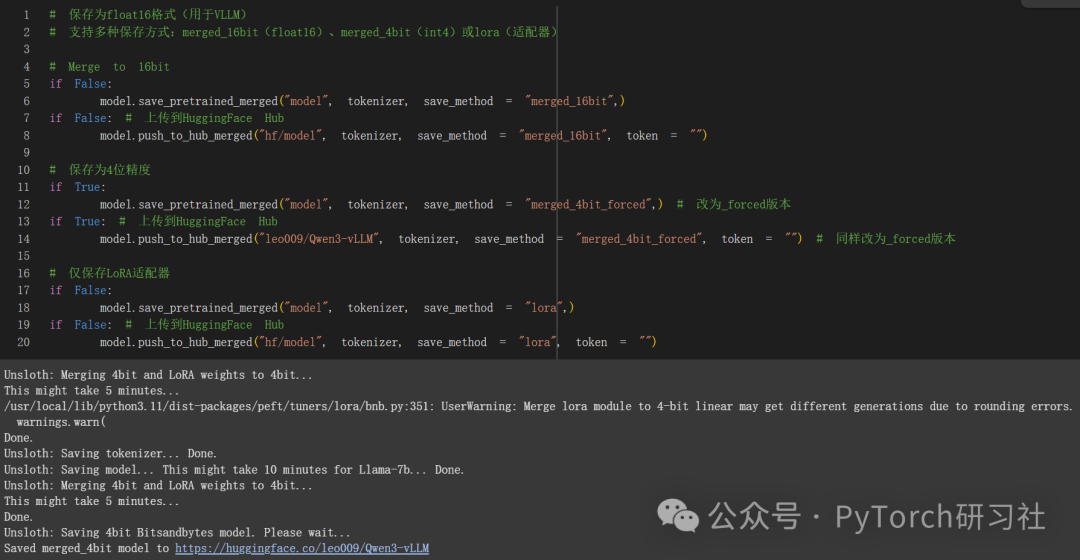

保存、加载微调模型

要将最终模型保存为 LoRA 适配器,请使用 Huggingface 的 push_to_hub 进行在线保存,或使用 save_pretrained 进行本地保存。

[注意] 这仅保存 LoRA 适配器,而不是完整模型。后面我来介绍如何保存为 16 位或 GGUF 格式。

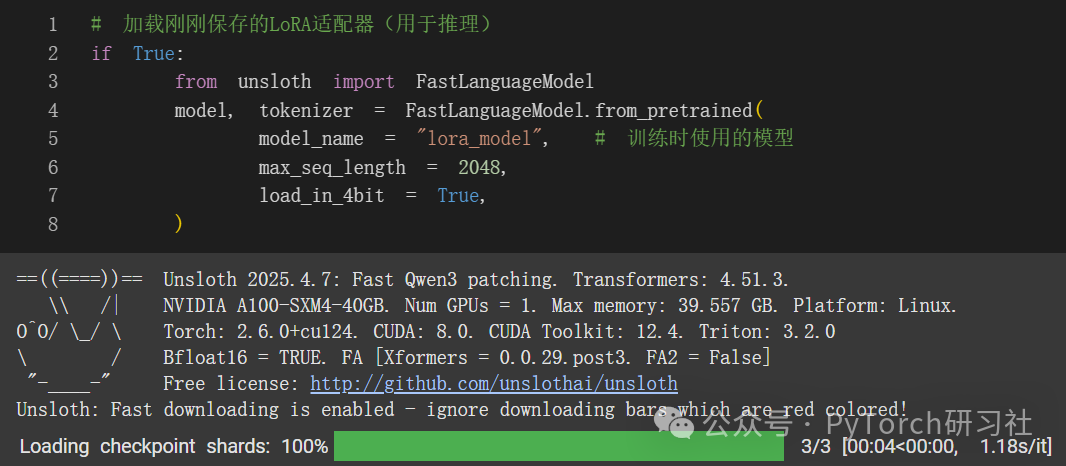

现在,如果你想加载我们刚刚保存用于推理的 LoRA 适配器,请将 False 设置为 True:

保存为 VLLM 的 float16

选择 merged_16bit 保存 float16,或选择 merged_4bit 保存 int4。使用 push_to_hub_merged 上传到你个人的 Hugging Face 账户!

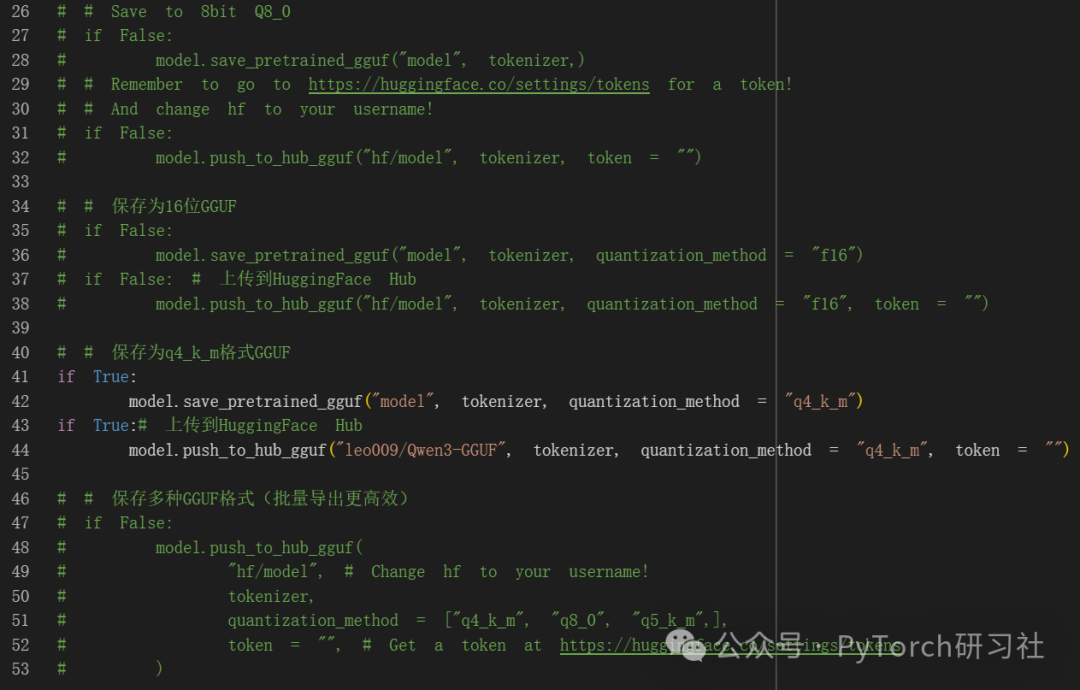

GGUF / llama.cpp 转换

使用 save_pretrained_gguf 进行本地保存,使用 push_to_hub_gguf 上传到 HF。

- q8_0 - 快速转换。资源占用较高,但通常可以接受。

- q4_k_m - 推荐。使用 Q6_K 处理 attention.wv 和 feed_forward.w2 张量的一半,否则使用 Q4_K。

- q5_k_m - 推荐。使用 Q6_K 处理 attention.wv 和 feed_forward.w2 张量的一半,否则使用 Q5_K。

本地部署

接下来就是将 GGUF 文件下载到本地,以便本地部署运行。

**大模型**算是目前当之无愧最火的一个方向了,算是**新时代的风口**!有小伙伴觉得,作为`新领域、新方向`人才需求必然相当大,与之相应的人才缺乏、人才竞争自然也会更少,**那转行去做大模型是不是一个更好的选择呢?**是不是`更好就业`呢?是不是就暂时能**抵抗35岁中年危机**呢?

答案当然是这样,**大模型必然是新风口!**

## **那如何学习大模型 ?**

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。但是具体到个人,只能说是:

最先掌握AI的人,将会比较晚掌握AI的人有竞争优势。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

但现在很多**想入行大模型**的人苦于现在网上的大模型`老课程老教材`,学也不是不学也不是,基于此我用做产品的心态来打磨这份`大模型教程`,深挖痛点并持续修改了近`100余次`后,终于把整个AI大模型的学习路线完善出来!

#### 在这个版本当中:

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型路线+学习教程已经给大家`整理并打包分享出来`, 😝有需要的小伙伴,可以 `扫描下方二维码领取`🆓↓↓↓

> 👉[<font color="#FF0000">CSDN大礼包</font>🎁:全网最全《LLM大模型学习资源包》免费分享<b><font

> color="#177f3e">(安全咨料,放心领取)</font></b>]()👈

<img src="https://i-blog.csdnimg.cn/blog_migrate/35a667356d00b606992c228becf1f3a8.png" style="margin: auto" />

## 一、大模型经典书籍(免费分享)

AI大模型已经成为了当今科技领域的一大热点,那以下**这些大模型书籍就是非常不错的学习资源**。

## 二、640套大模型报告(免费分享)

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

## 三、大模型系列视频教程(免费分享)

## 四、2025最新大模型学习路线(免费分享)

### 我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

#### **L1阶段:启航篇丨极速破界AI新时代**

> L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

##### L2阶段:攻坚篇丨RAG开发实战工坊

> L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

##### L3阶段:跃迁篇丨Agent智能体架构设计

> L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

##### L4阶段:精进篇丨模型微调与私有化部署

> L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

##### L5阶段:专题集丨特训篇 【录播课】

全套的`AI大模型学习资源`已经整理打包,有需要的小伙伴可以`微信扫描下方二维码`,**免费领取**

> 👉[<font color="#FF0000">CSDN大礼包</font>🎁:全网最全《LLM大模型学习资源包》免费分享<b><font

> color="#177f3e">(安全资料,放心领取)</font></b>]()👈

<img src="https://i-blog.csdnimg.cn/blog_migrate/35a667356d00b606992c228becf1f3a8.png" style="margin: auto" />

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献563条内容

已为社区贡献563条内容

所有评论(0)