AI 大模型 本地部署 (详细)(小白可用)

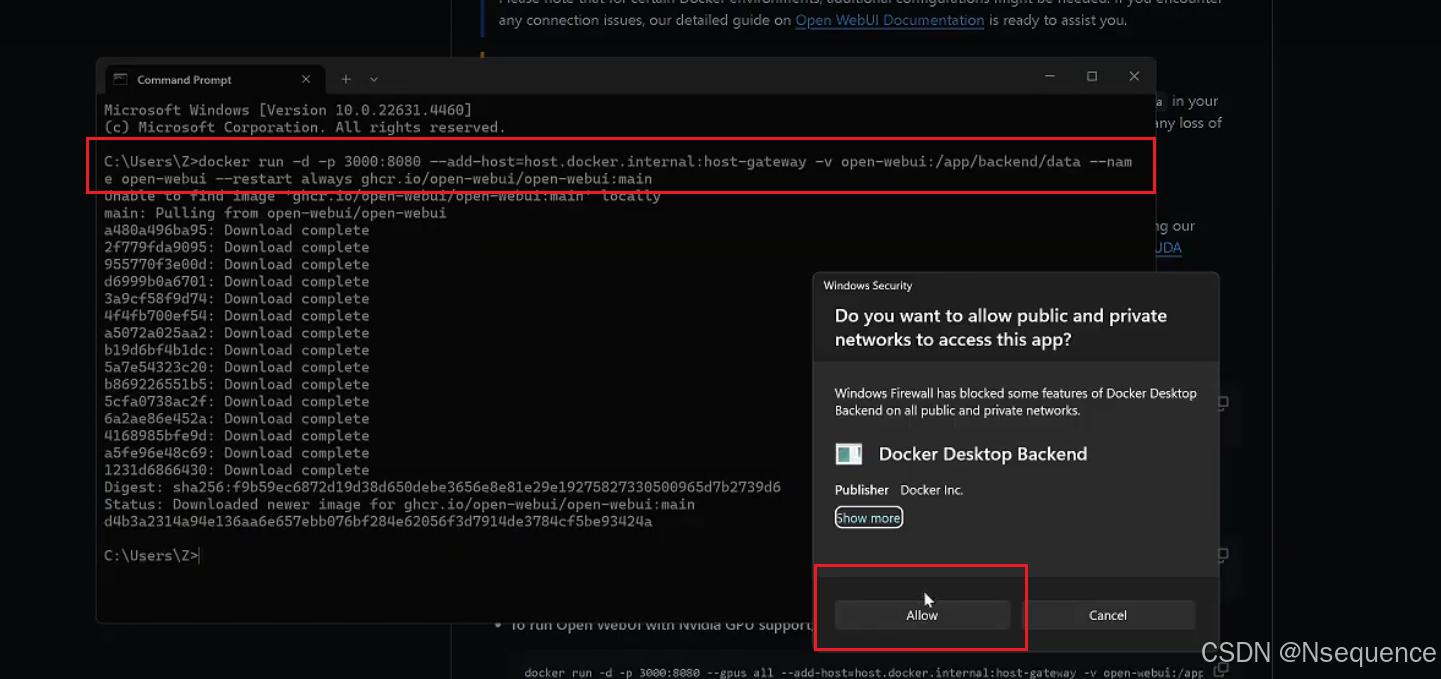

复制 红框中的 命令 3000:8080 (3000是映射你电脑的本地端口,8080这是虚拟空间的端口)【3000可以改 但是要改成未被占用的 】然后打开 命令提示符 输入ollama run <ollama中复制的 模型 代码>先输入命令 【回车】 然后 会 出现弹框 不用想 {允许【Allow】} -->注册账号,这是你自己WebUI界面的账号 保存在 你自己的电脑上。下载完成后,双击安装 然

首先,安装必要的几个软件

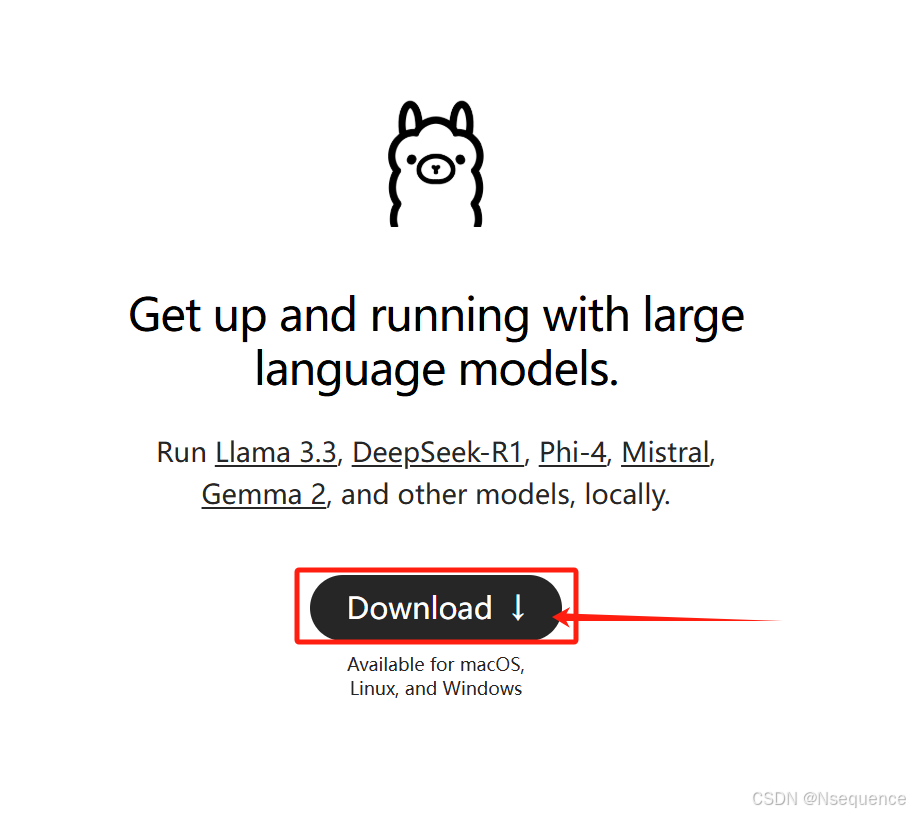

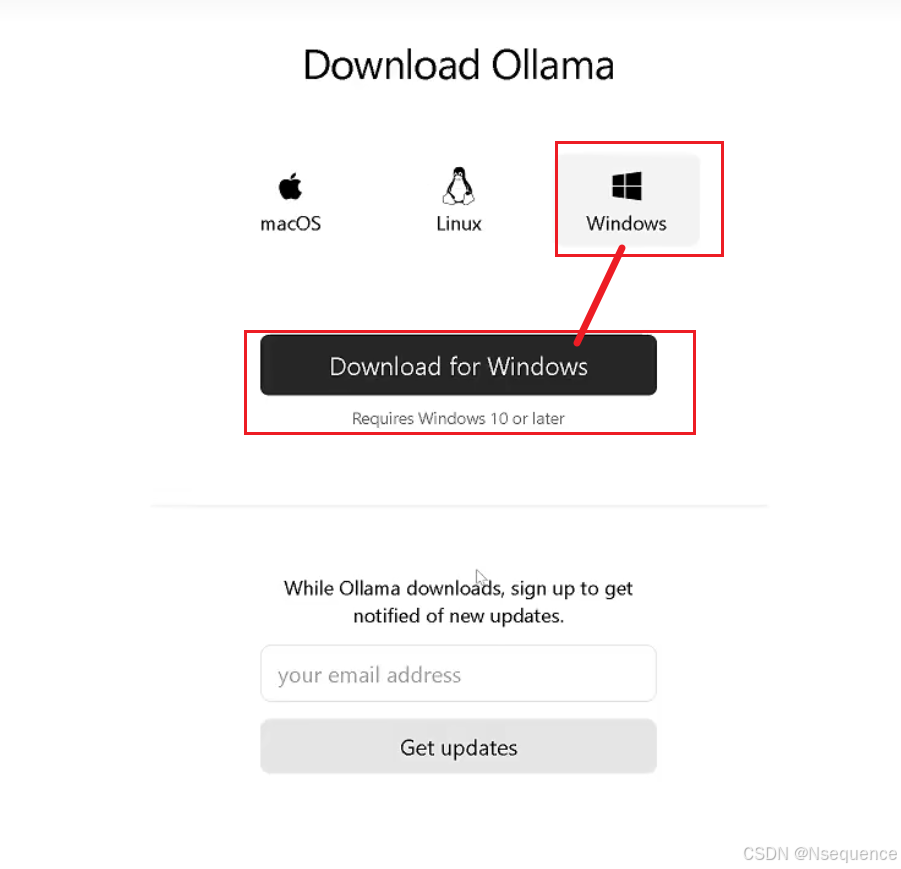

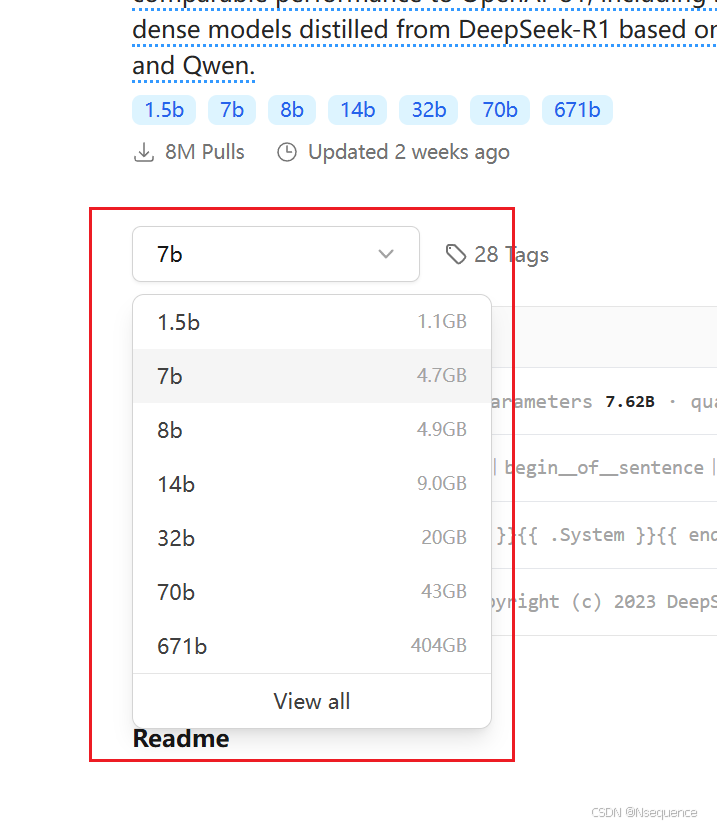

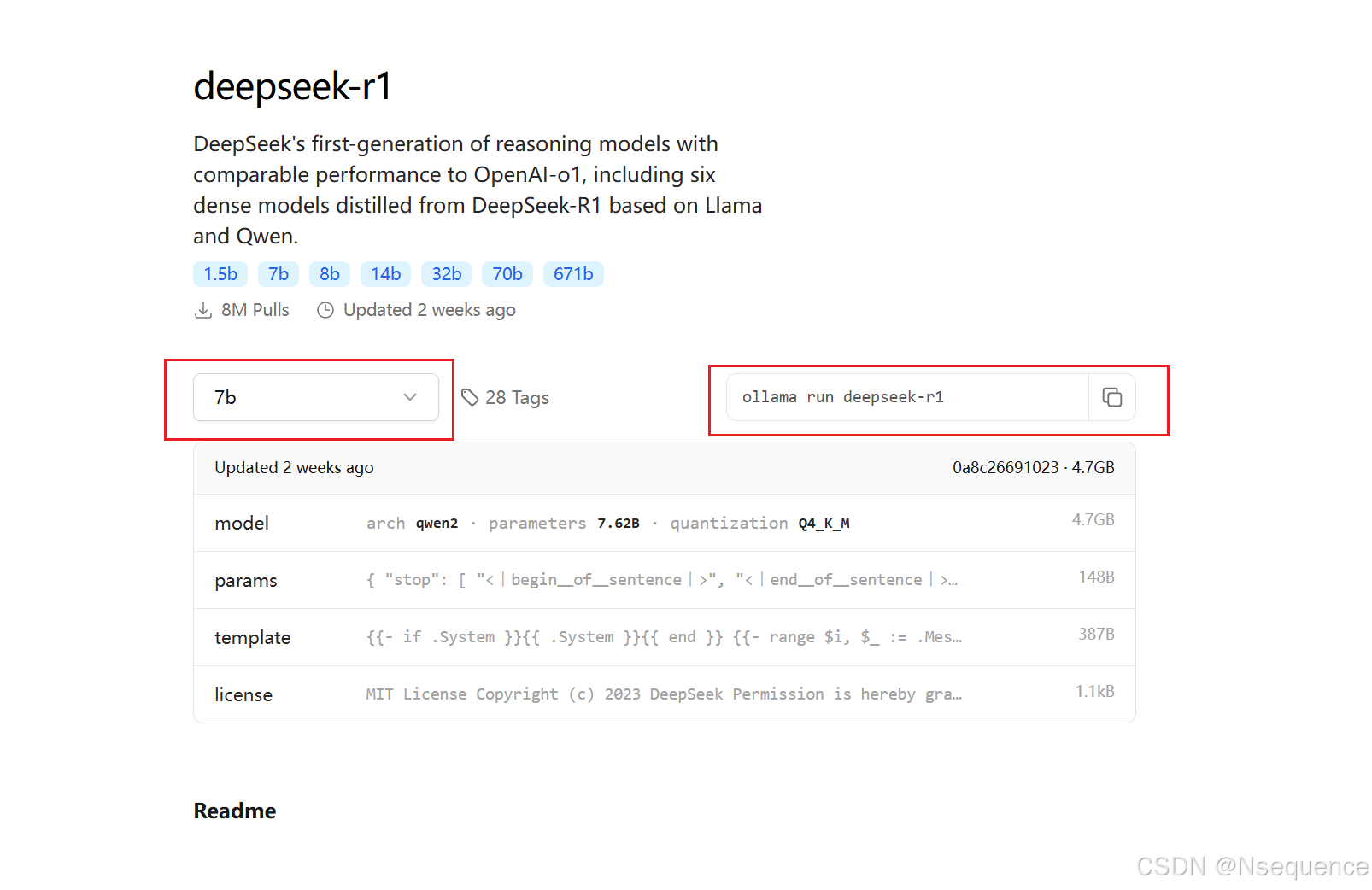

ollama -> Ollama (官网)

下载后是一个 exe 应用程序 双击安装

安装完成后 运行 右下角 会出现 ollama 图标 (如果没有可能被隐藏了)

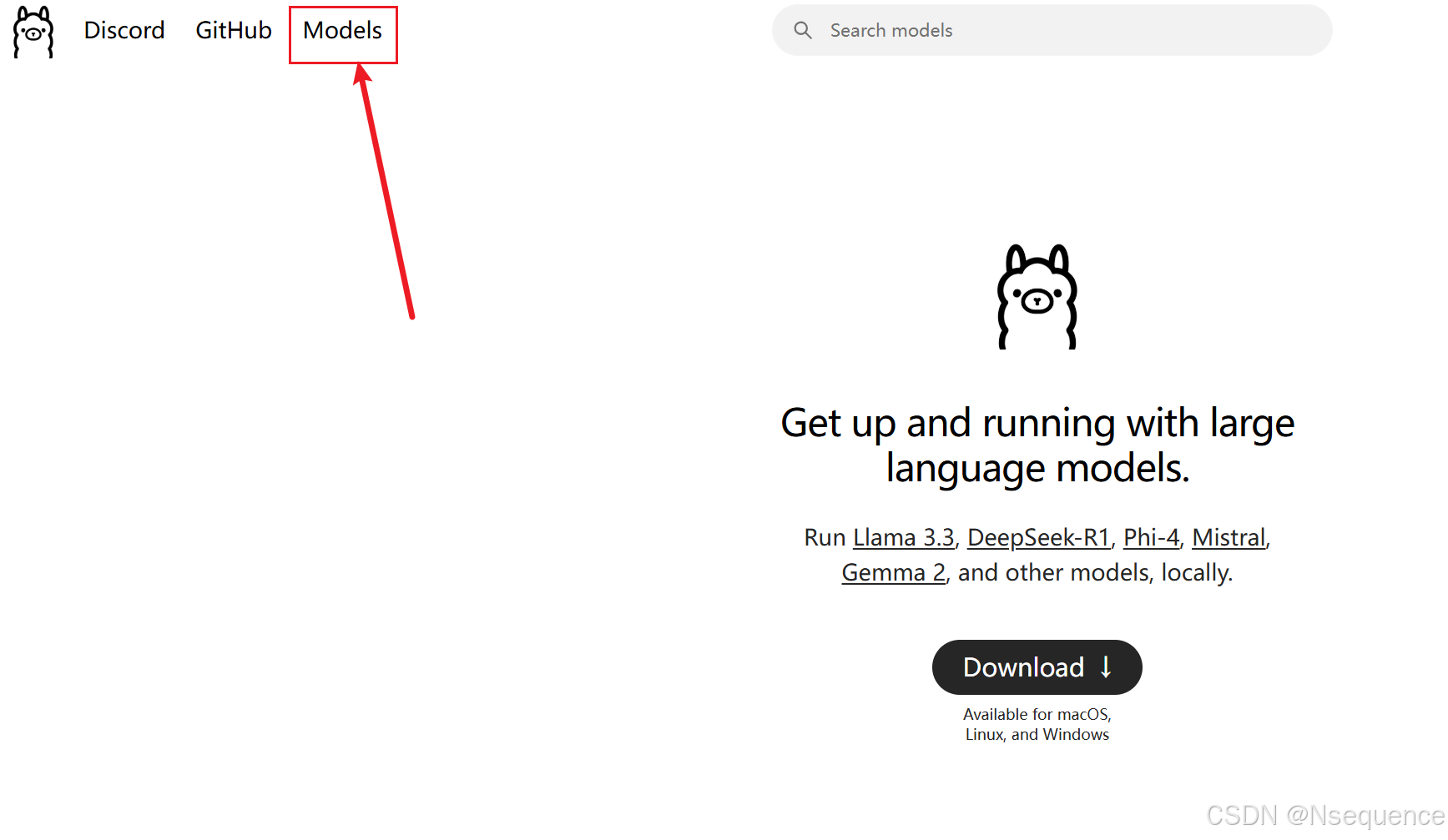

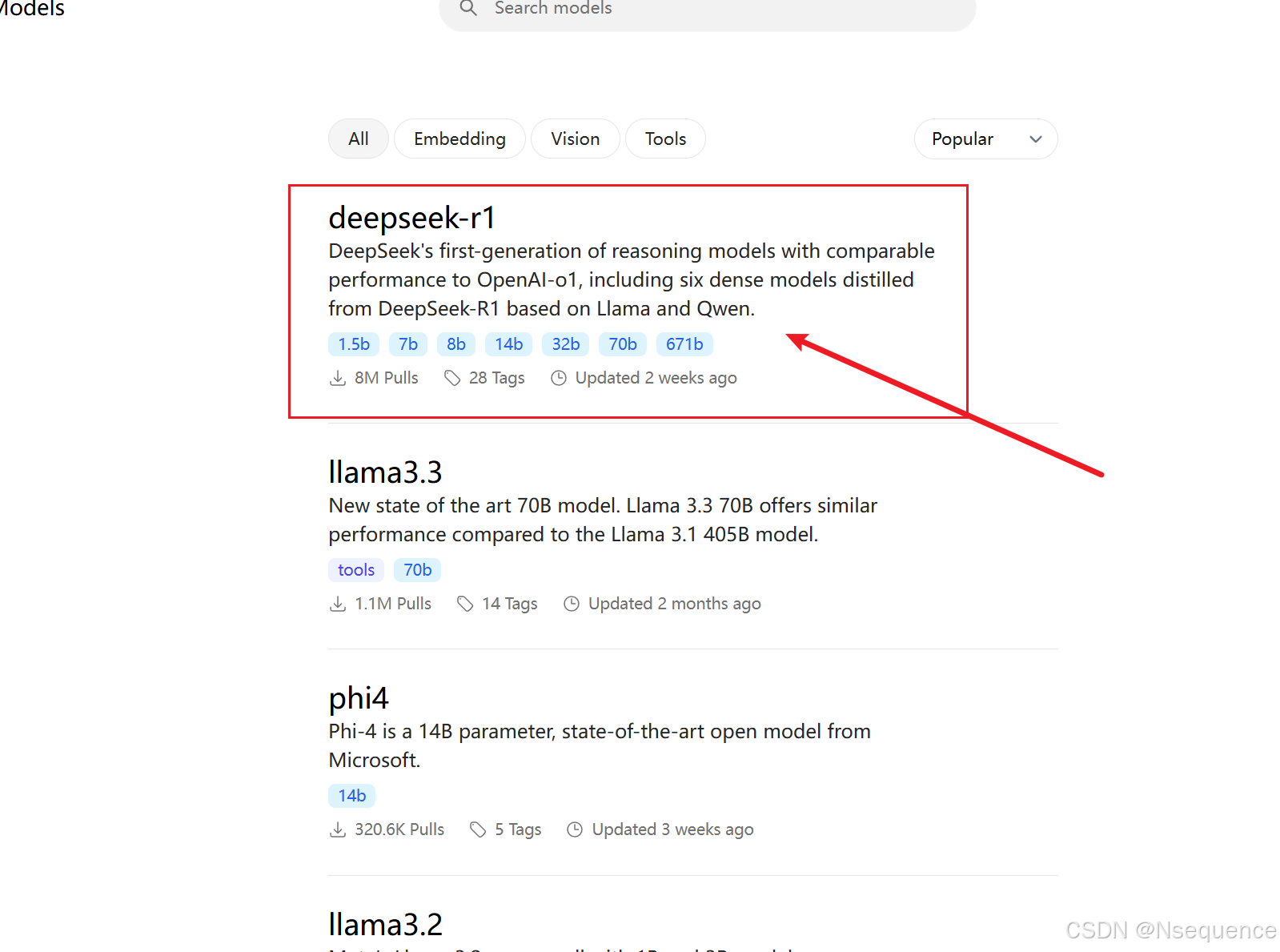

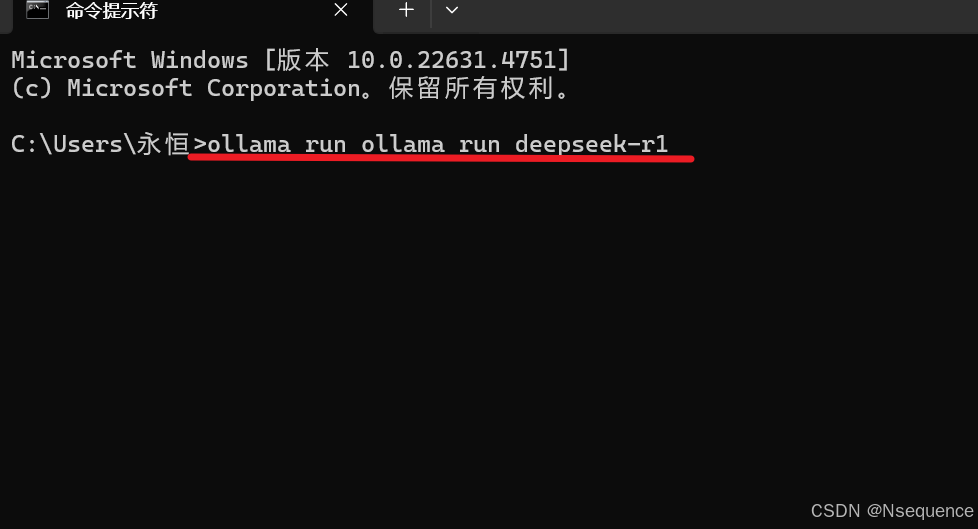

然后打开 命令提示符 输入 ollama run <ollama中复制的 模型 代码>

例如:ollama run ollama run deepseek-r1

等下载完成后就可以关了-----

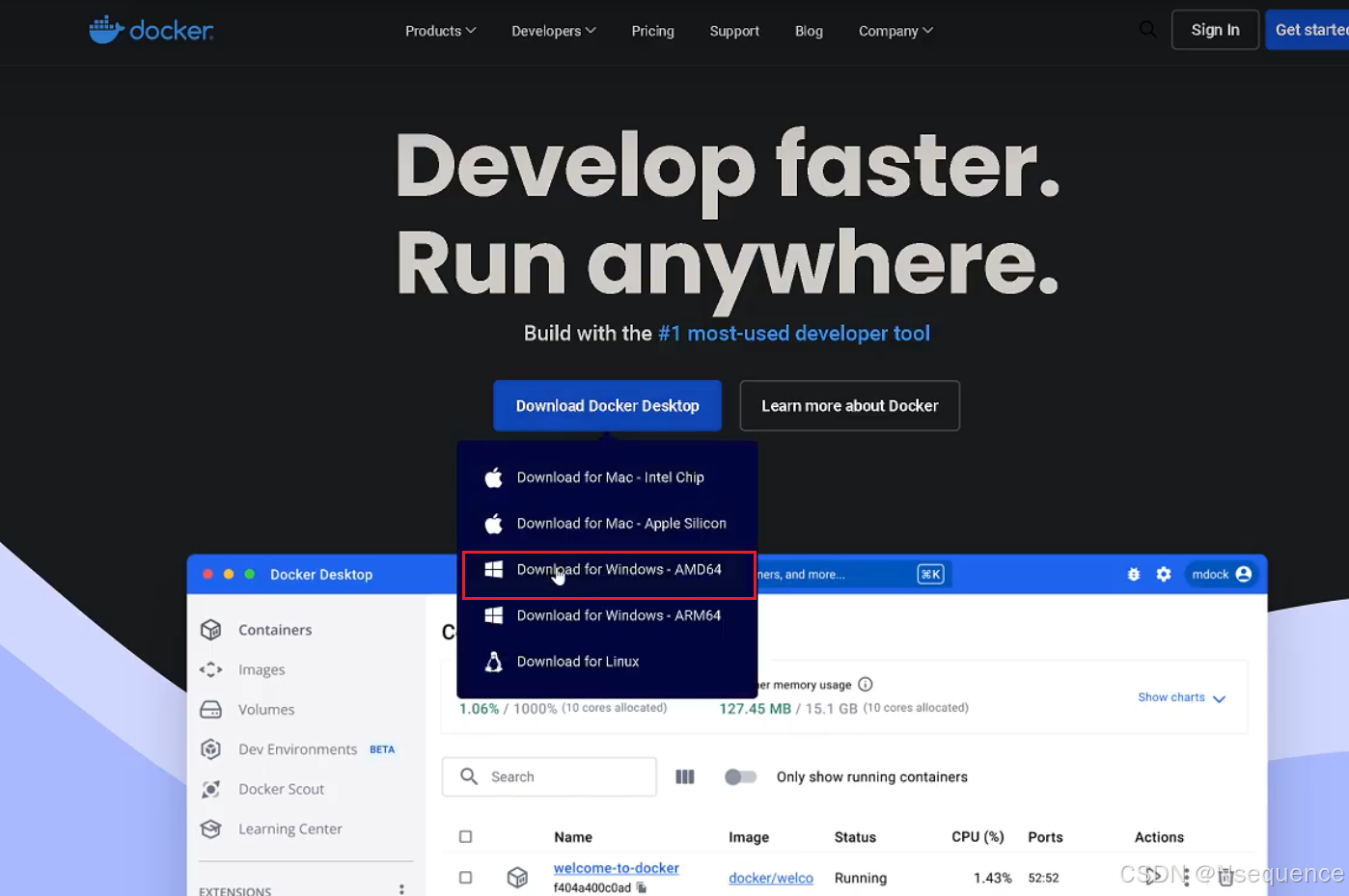

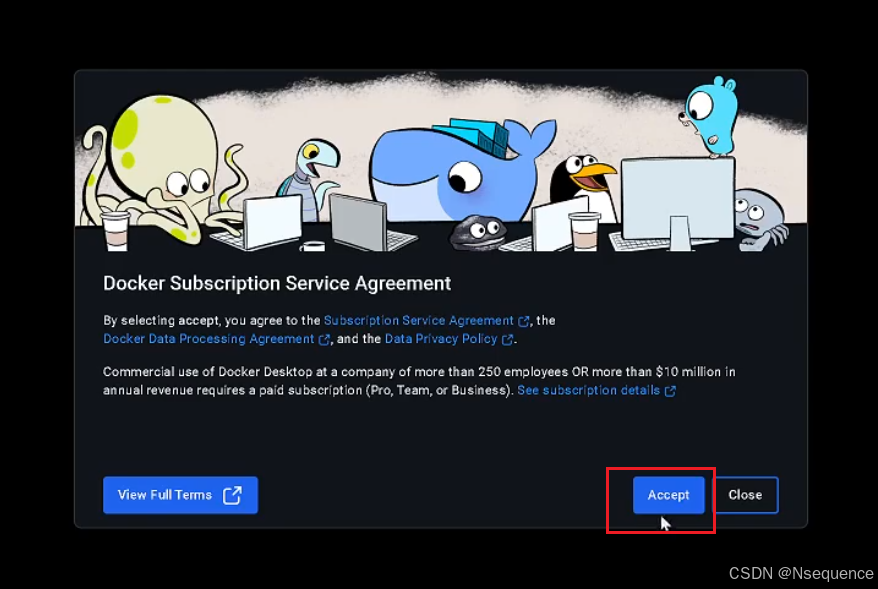

进入下个软件的安装--> Docker Docker: Accelerated Container Application Development (官方)

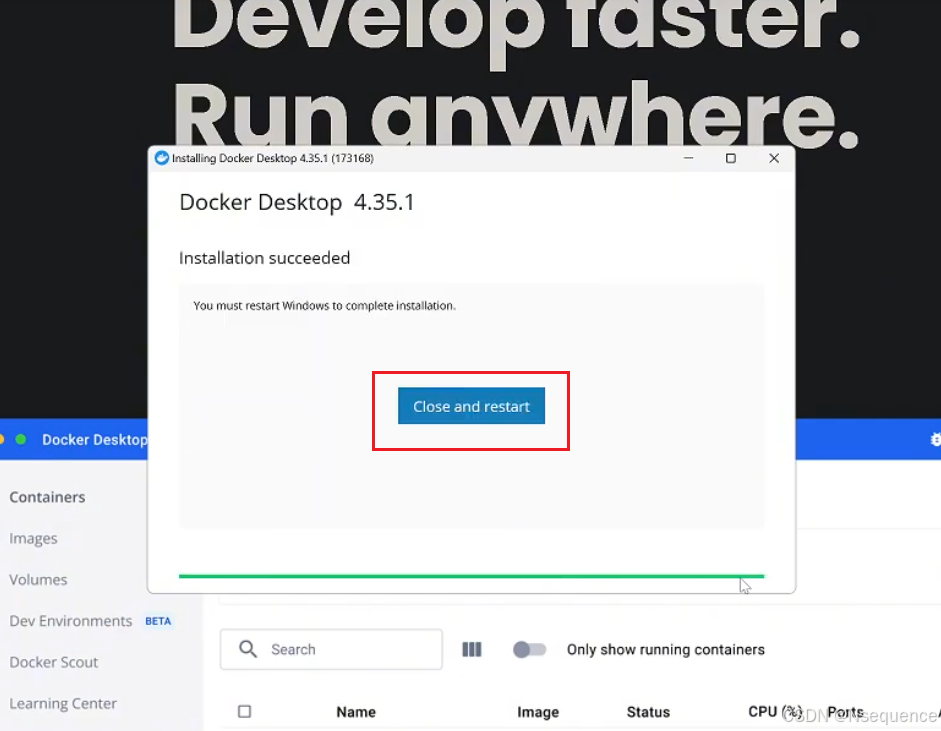

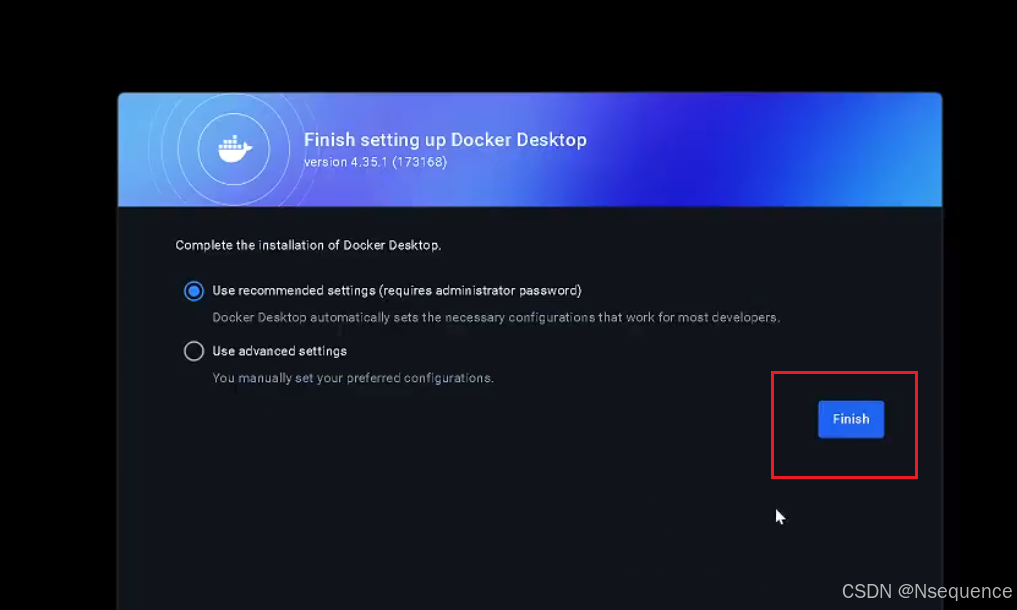

下载完成后,双击安装 然后 能 (勾选的V) 全选上

首次安装 会 重启

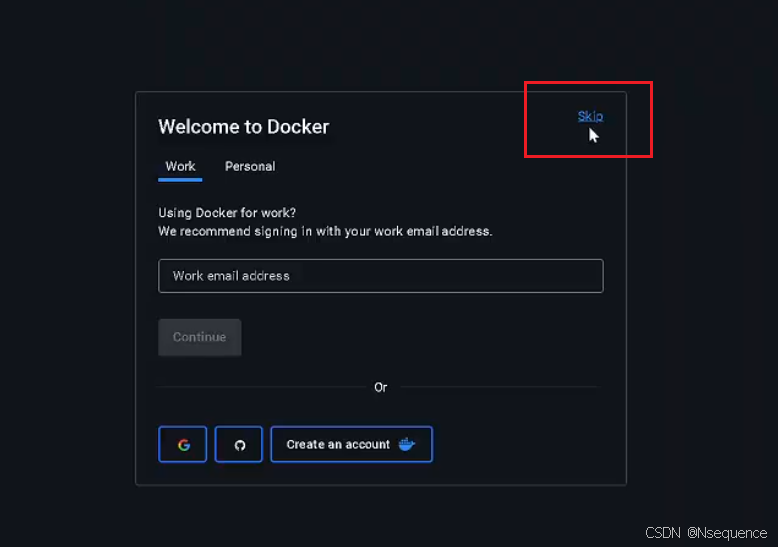

然后就暂时 不用 管它了

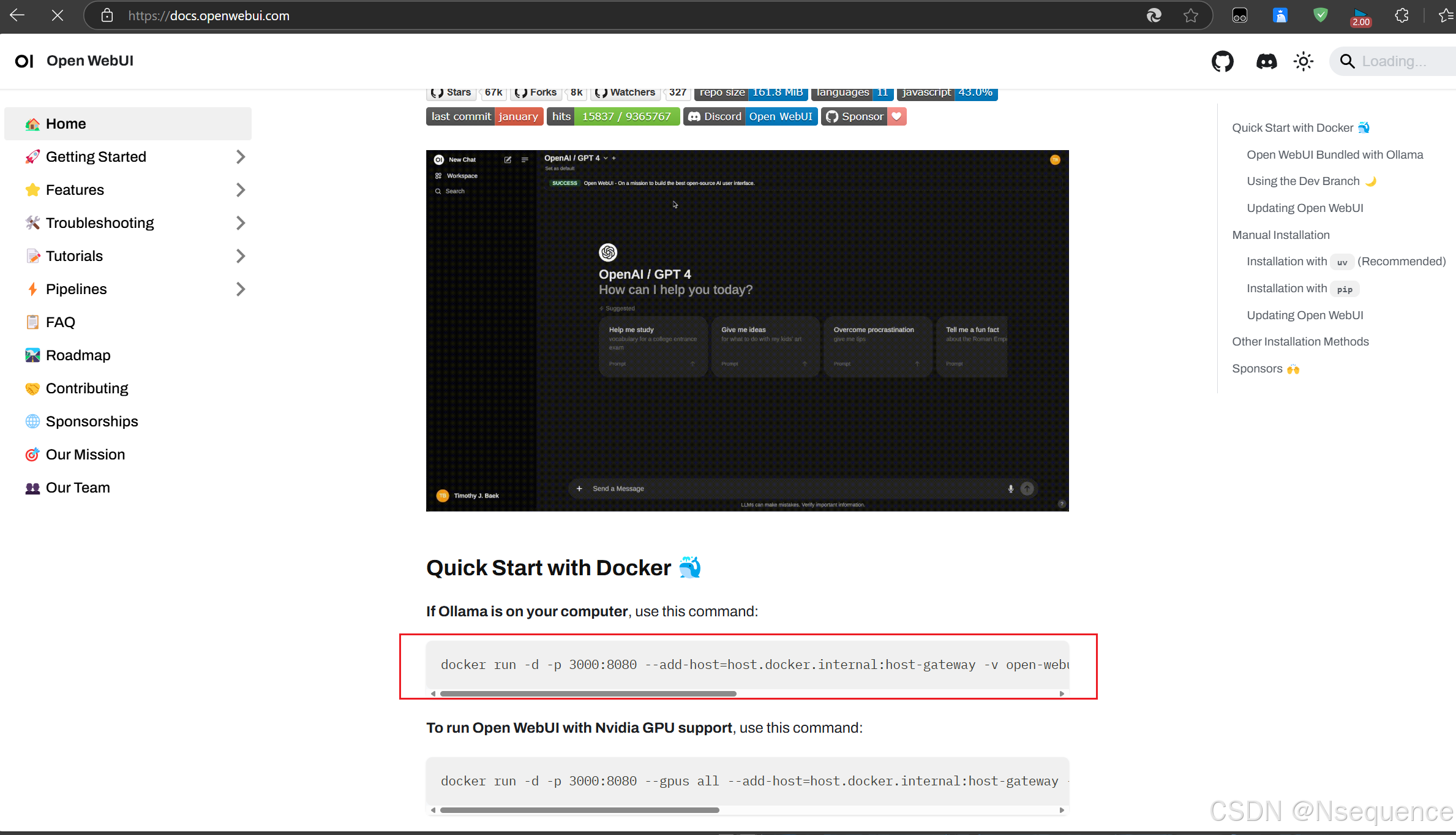

接下来 Web UI --> 🏡 Home | Open WebUI

复制 红框中的 命令 3000:8080 (3000是映射你电脑的本地端口,8080这是虚拟空间的端口)【3000可以改 但是要改成未被占用的 】

先输入命令 【回车】 然后 会 出现弹框 不用想 {允许【Allow】} --> Ollama Docker 要全程开着

先输入命令 【回车】 然后 会 出现弹框 不用想 {允许【Allow】} --> Ollama Docker 要全程开着

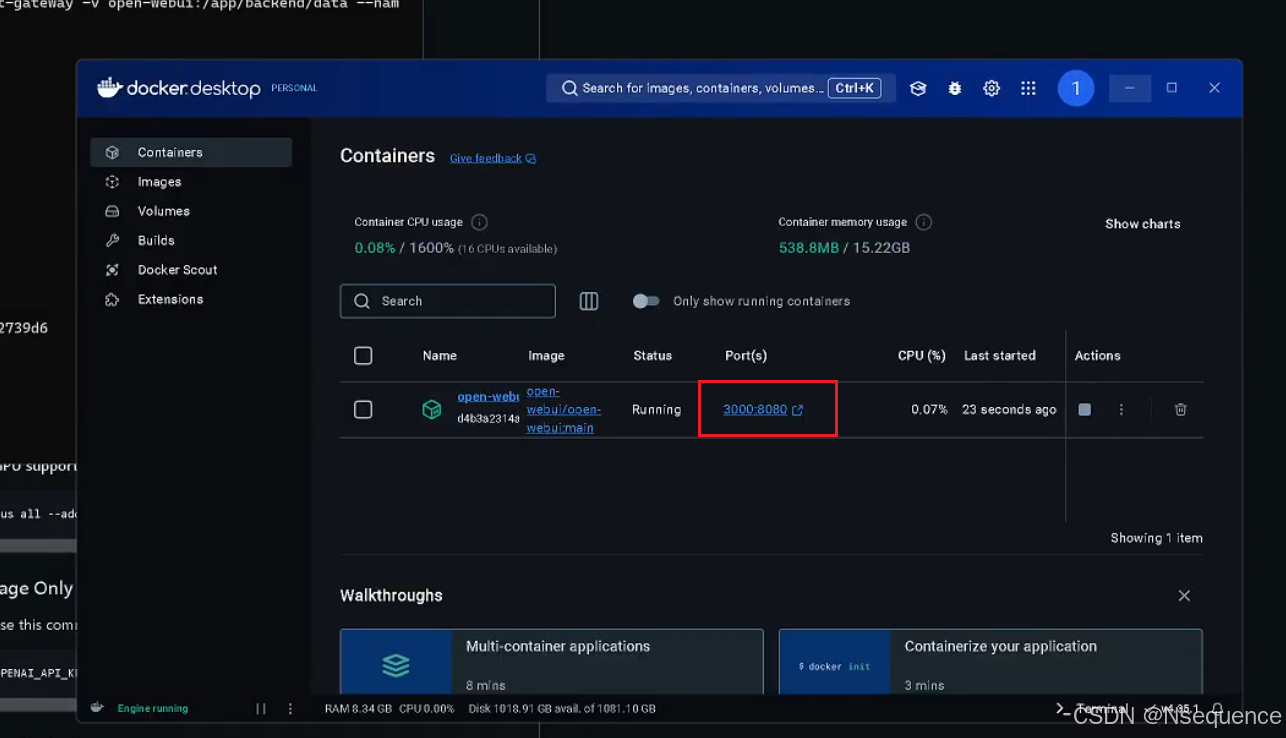

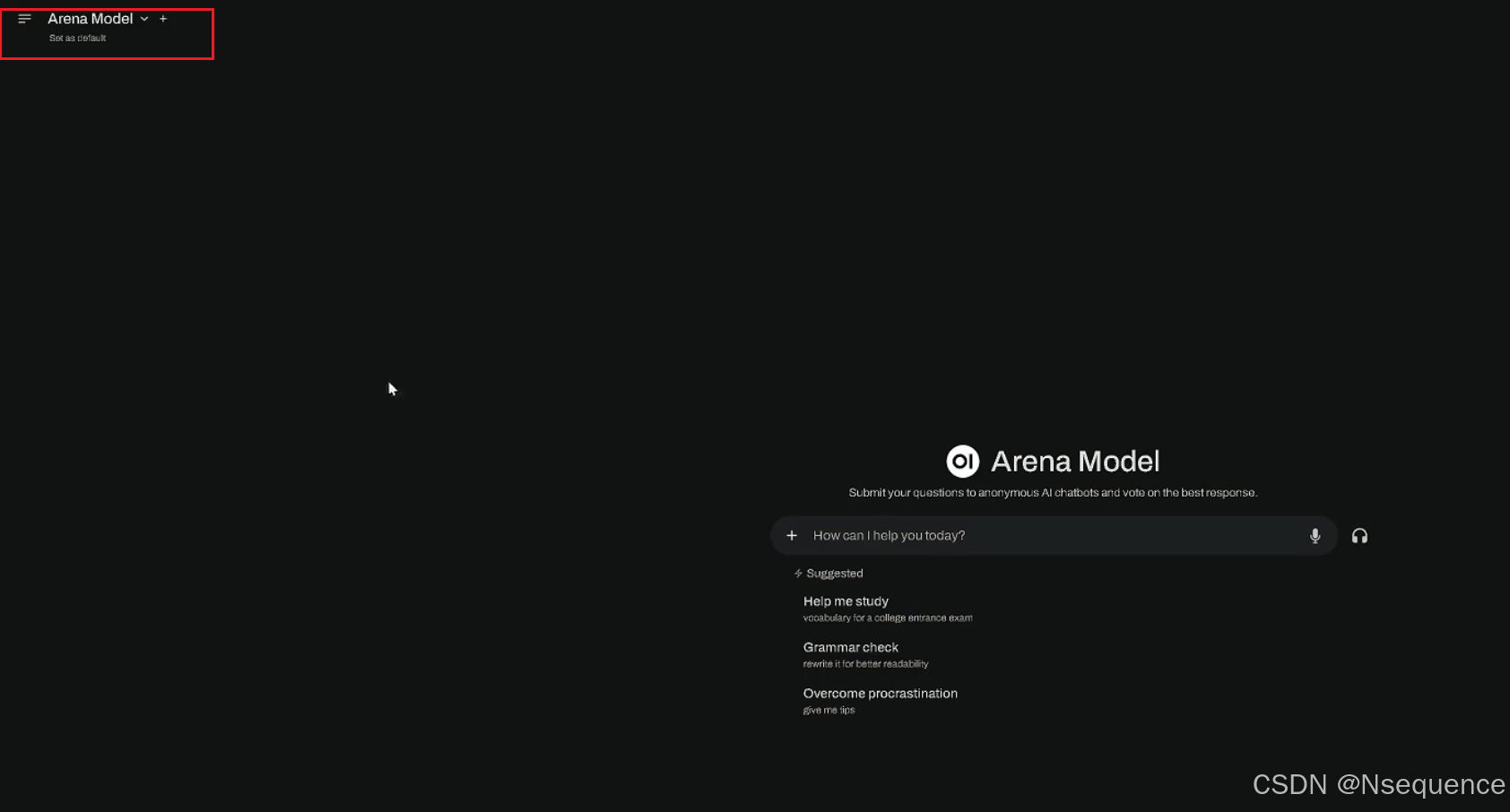

然后 点击红框框 就能进入 你的 Web UI 界面

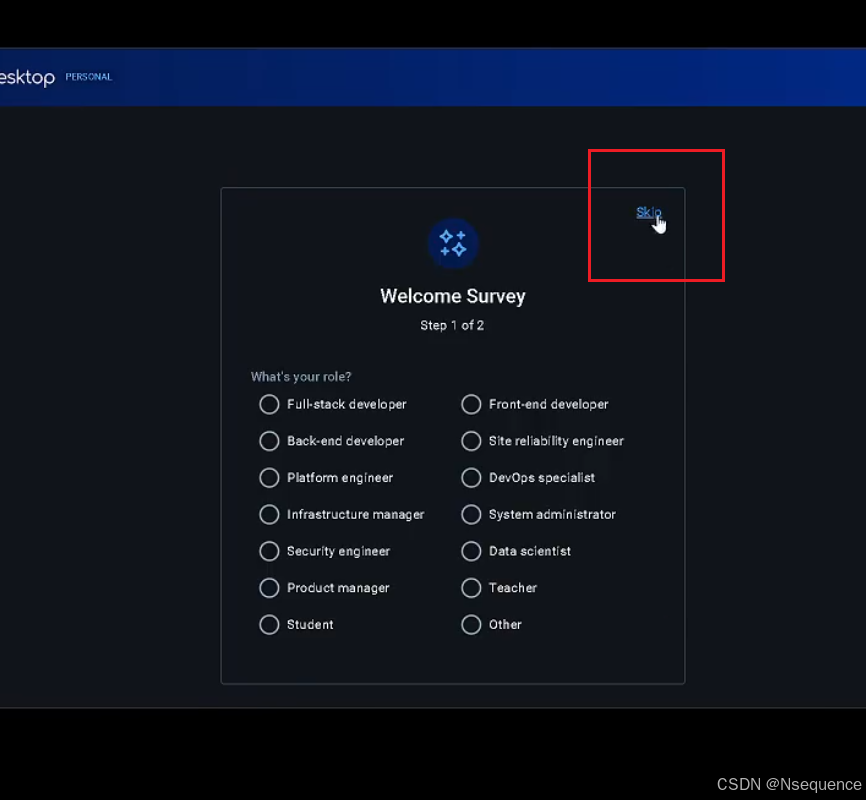

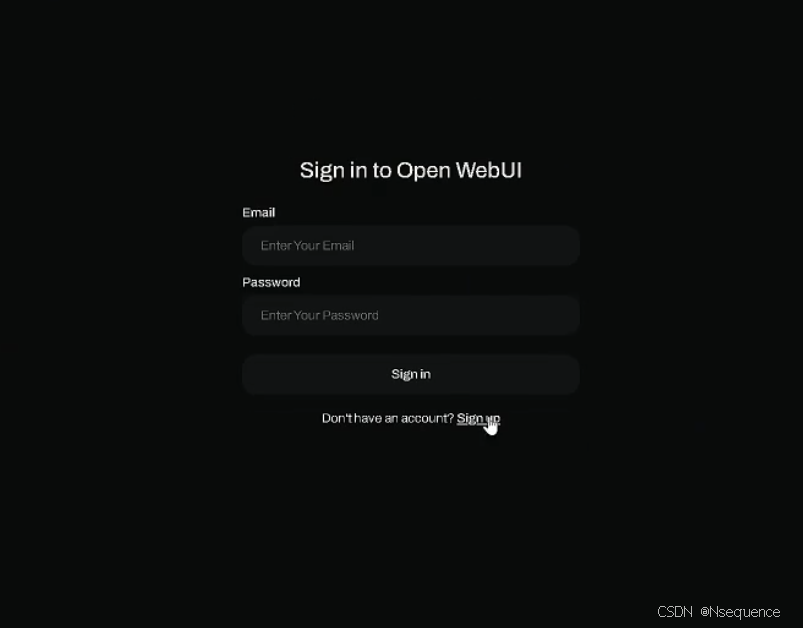

注册账号,这是你自己WebUI界面的账号 保存在 你自己的电脑上

选择模型;

然后就可以正常使用了

PS;因为ollama默认 C盘安装 需要 迁移 模型的话 D

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)