MTSC(2025)-AI 质量新范式专场

之前还蛮少关注MTSC 的会议内容的,因为好像看起来没有特别多的创新点,还是传统行业测试的各种质量保障手段,但是还蛮想看下今年的MTSC 的内容的,年初deepseek 的出现就开始让部门的测试工作重点有了质的变化,一切能用AI 赋能的测试手段都鼓励尝试,但是因为很多都是处于初步尝试的阶段,实际上没有见到有取到比较好的实践落地效果的,然后就还蛮好奇其他公司有没有比较好的AI 应用落地效果的。

之前还蛮少关注MTSC 的会议内容的,因为好像看起来没有特别多的创新点,还是传统行业测试的各种质量保障手段,但是还蛮想看下今年的MTSC 的内容的,年初deepseek 的出现就开始让部门的测试工作重点有了质的变化,一切能用AI 赋能的测试手段都鼓励尝试,但是因为很多都是处于初步尝试的阶段,实际上没有见到有取到比较好的实践落地效果的,然后就还蛮好奇其他公司有没有比较好的AI 应用落地效果的。

看了下会议的五大专场主题 ,还蛮具有概括性,两大方向:如何用AI 来提效或者应用于日常的质量保障流程,另一个就是如何测试AI技术相关的应用 ,由于官方视频没有发布,也买不起门票,花了9块9买了会议的PPT ,(懒得网上找资料了,估计过段时间官方也会发布供大家免费下载了),看了一下~

看完了AI 质量范式专场的ppt ,感觉还是很有收获的,以前看MTSC 的分享都没有这种感觉,大概是由于AI 在测试领域最开始的实践落地,大家总结了有效果的落地场景,还分享了其中的一些之前都用不到的测试方法论,因为新颖,所以有一种涨知识的感觉~

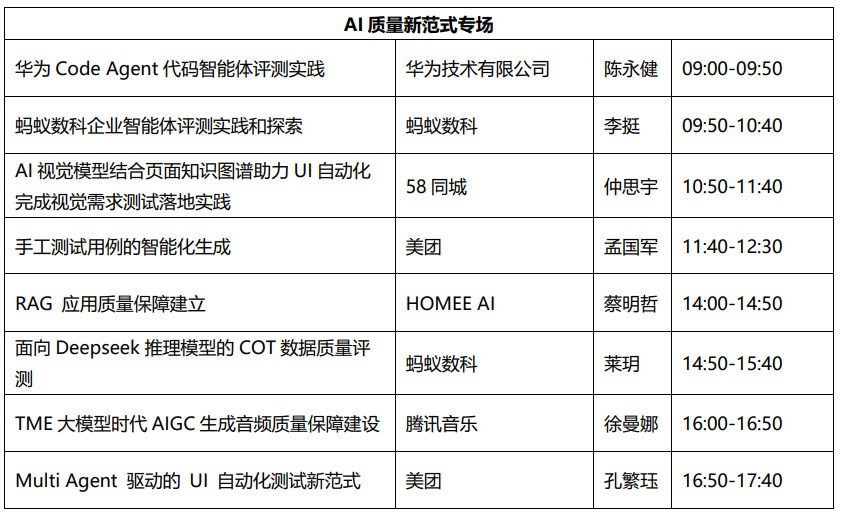

AI 质量新范式专场

看标题列表主要有AI 在UI 自动化,用例生成方面的应用,还有就是关于智能体 评测的内容,

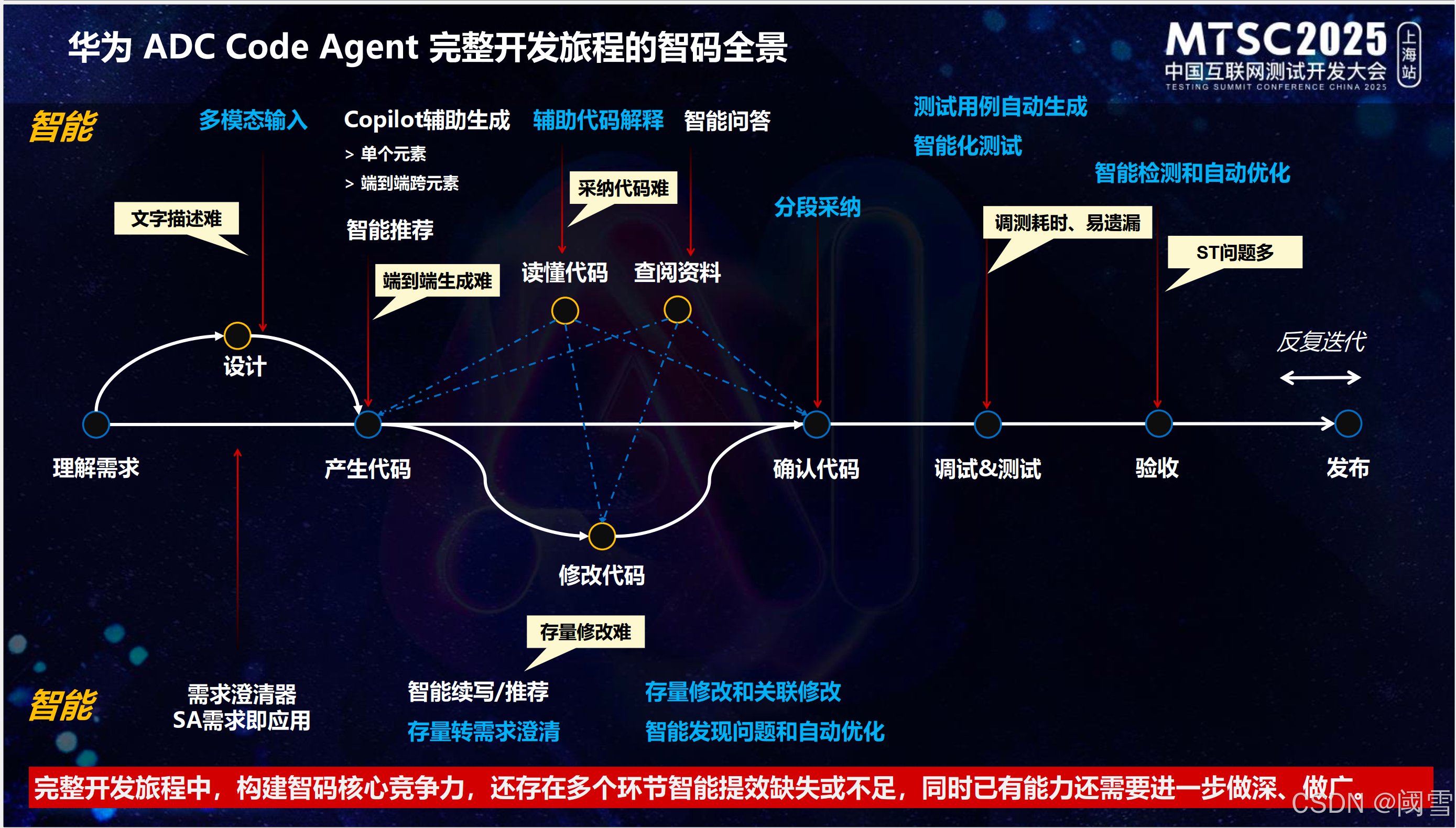

1.华为:Code Agent 代码智能体评测实践

一款一站式的开发平台,感觉有点类似阿里的aone , 从需求分析到代码开发到测试验证,感觉里面涉及内容比较多 ,文章主要是介绍ADC 这个平台几大应用场景的评测方法,然后这些统一集成到一个平台进行自动化的评测。

1.平台是做什么的 ?

2.测试在其中解决什么问题?

3.解决方案

让deepseek 总结了一下ppt 的内容:

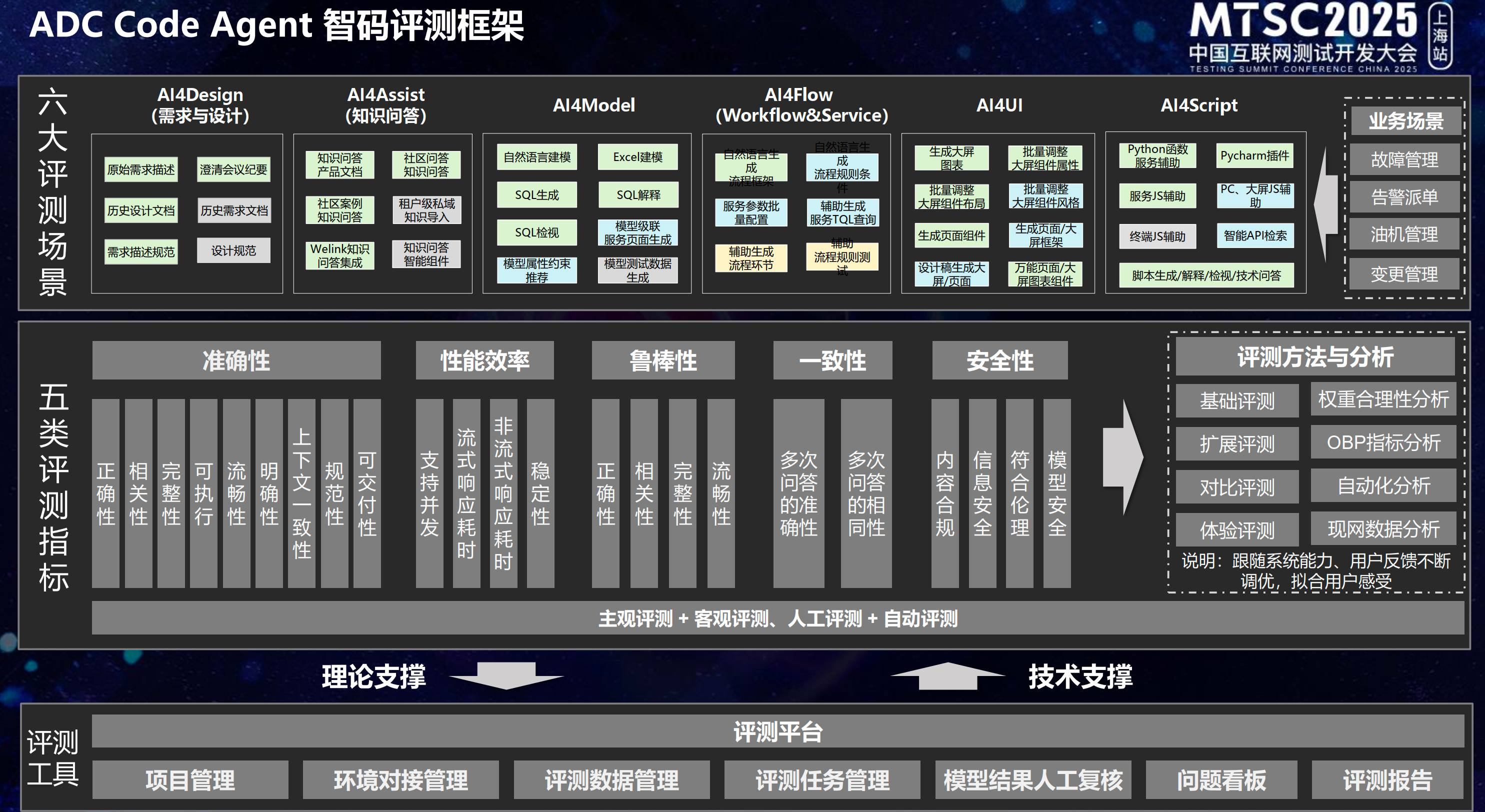

ppt针对六大智能化场景制定评测标准:

|

场景 |

评测重点 |

评估方法 |

|

知识问答 |

相关性、正确性、完整性 |

语义相似度 + 加权评分(P≥3.5为合格) |

|

数据模型生成 |

字段匹配度、约束合理性 |

参考答案对比 + 可执行性验证 |

|

SQL/TQL生成 |

语法正确性、业务逻辑安全 |

静态检查 + 执行验证 |

|

领域脚本生成 |

代码合规性、可维护性 |

静态规则检查 + Pass@K通过率 |

|

UI编排 |

组件属性/布局一致性 |

视觉对比 + DSL语法校验 |

|

流程编排 |

BPMN逻辑正确性、可执行性 |

XML解析验证 + 端到端流程测试 |

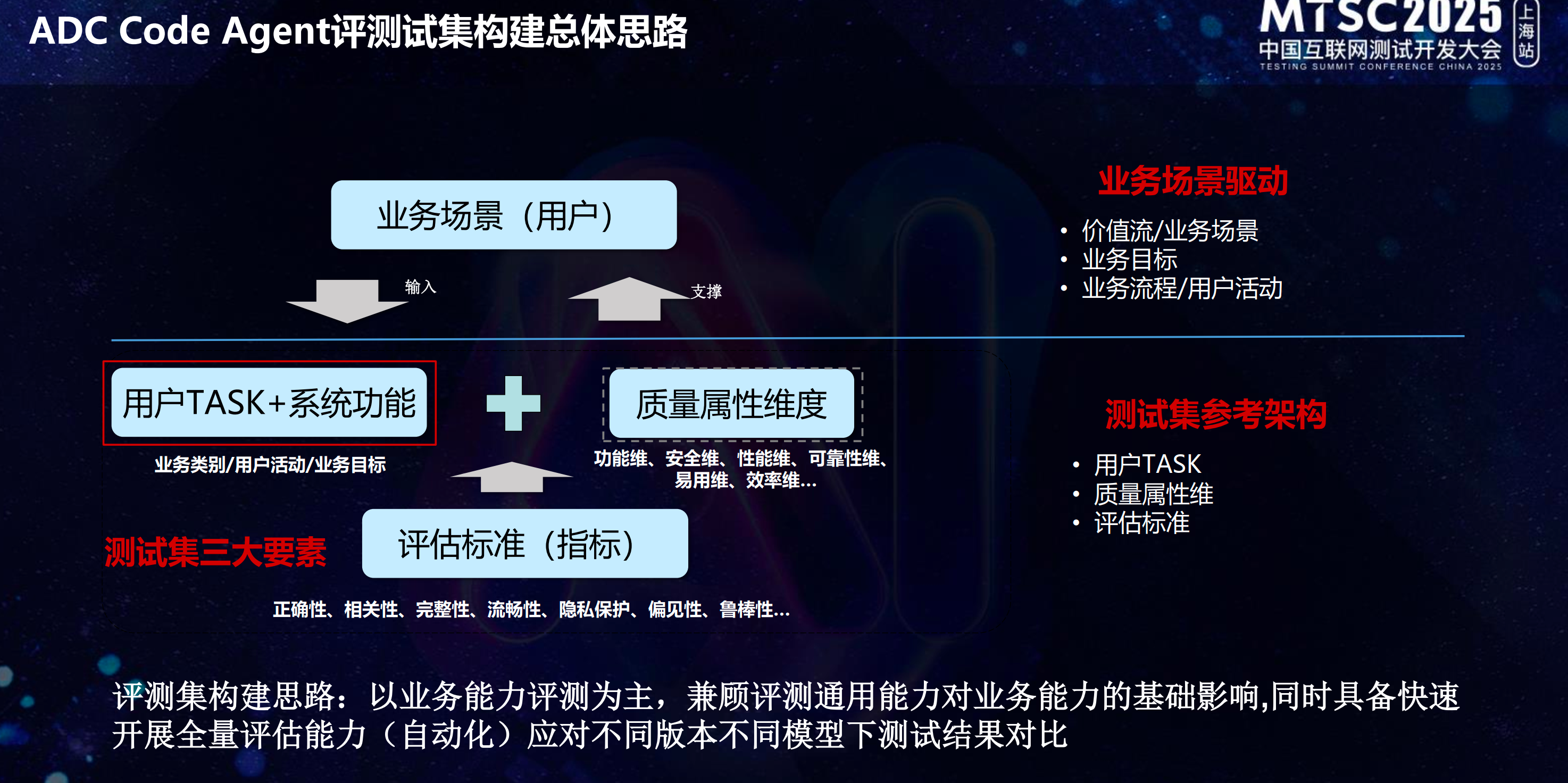

评测集构建思路: 以业务能力评测为主,兼顾评测通用能力对业务能力的基础影响,同时具备快速开展全量评估能力(自动化)应对不同版本不同模型下测试结果对比。

评测框架

评测模块: 好的评测标准是评测结果和用户体验一致

自动化评测系统实现:

这个借助裁判模型来进行打分的技术点感觉还蛮新颖的 ,用AI 来评估AI 的效果,俄罗斯套娃

技术实现

感想:

涉及模块太多,不仅需要测试平台的功能,还要测试AI 输出相关内容是否准确且满足用户真实诉求,工作量非常大。

2.58同城:视觉模型在UI 自动化的运用

思路:

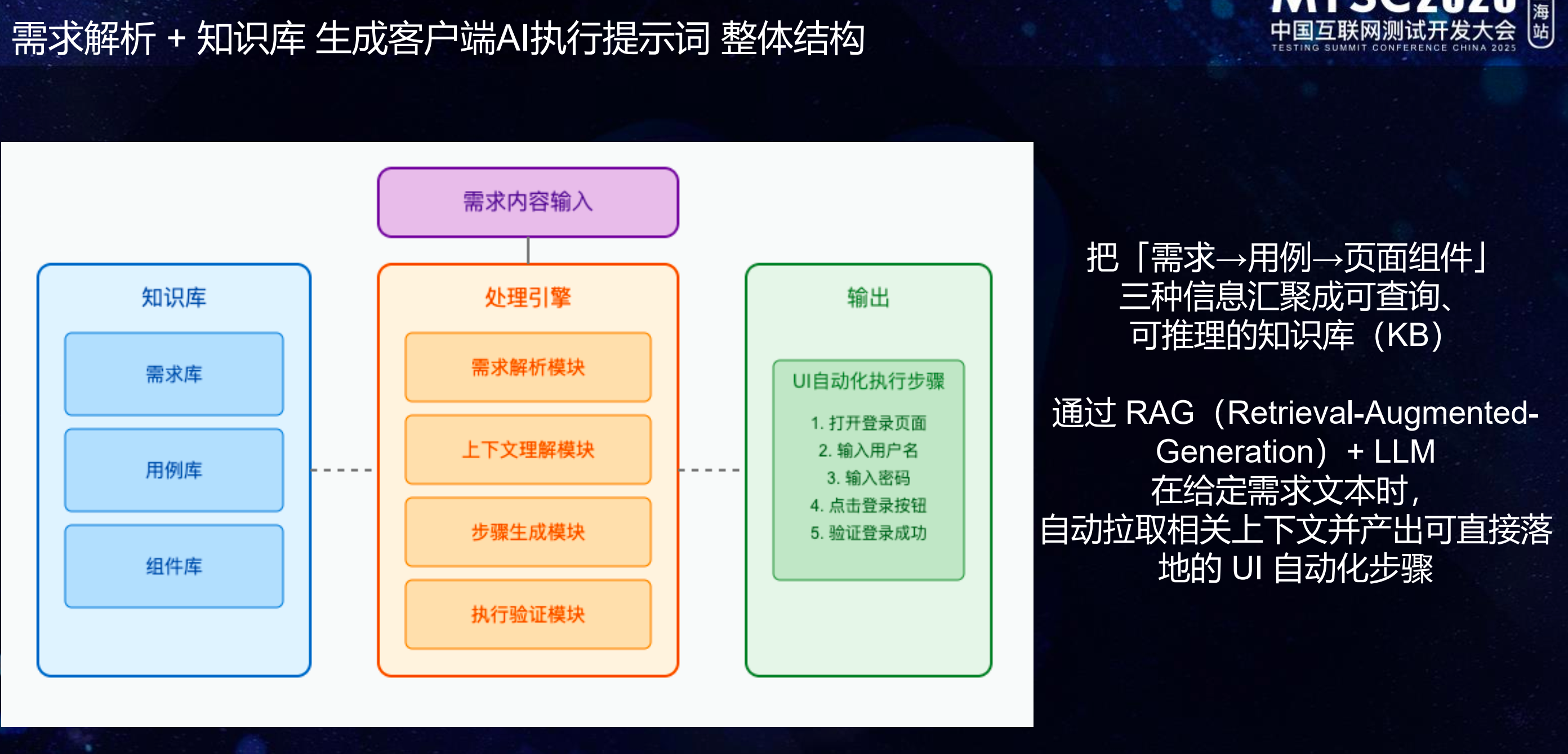

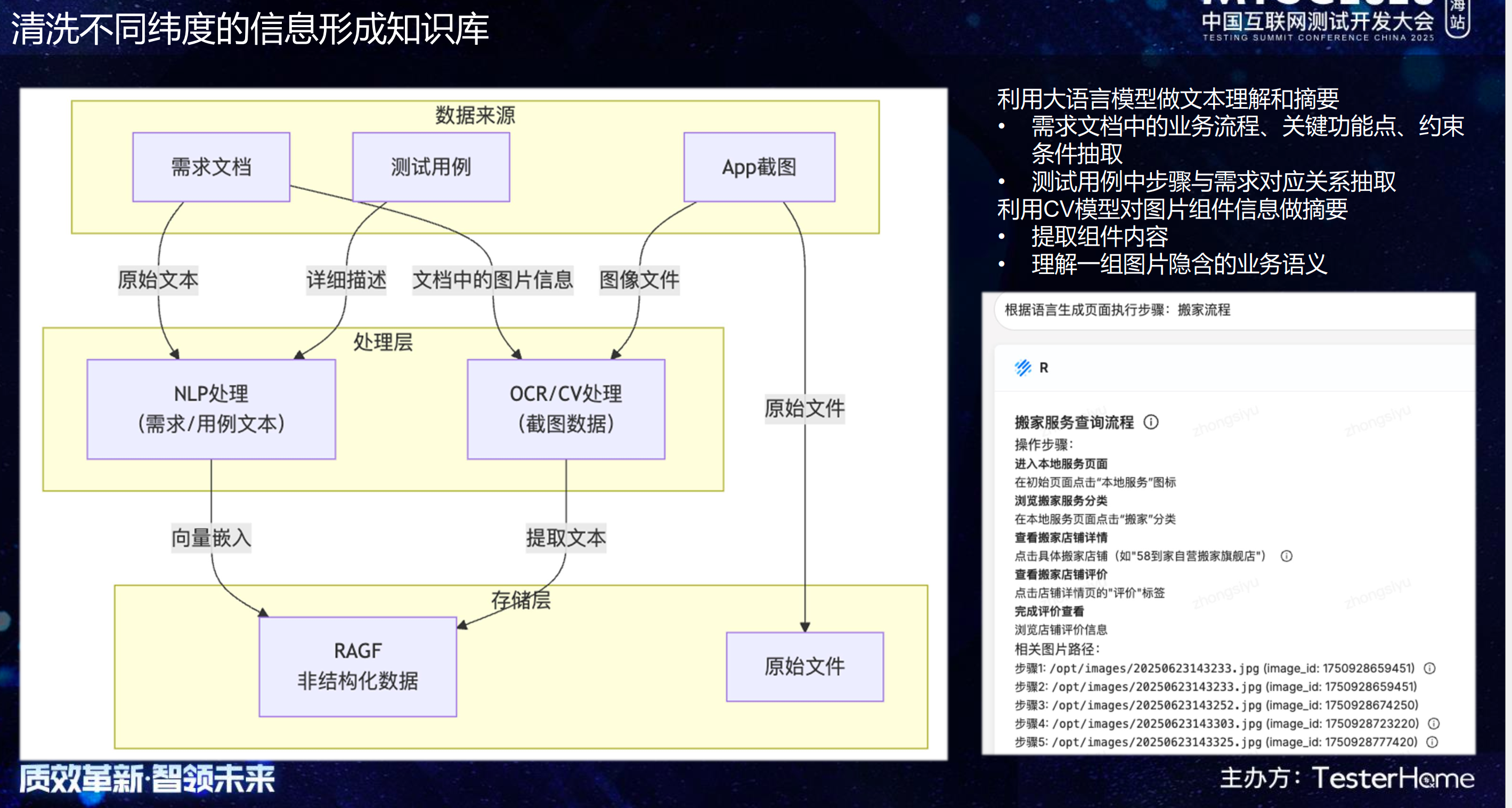

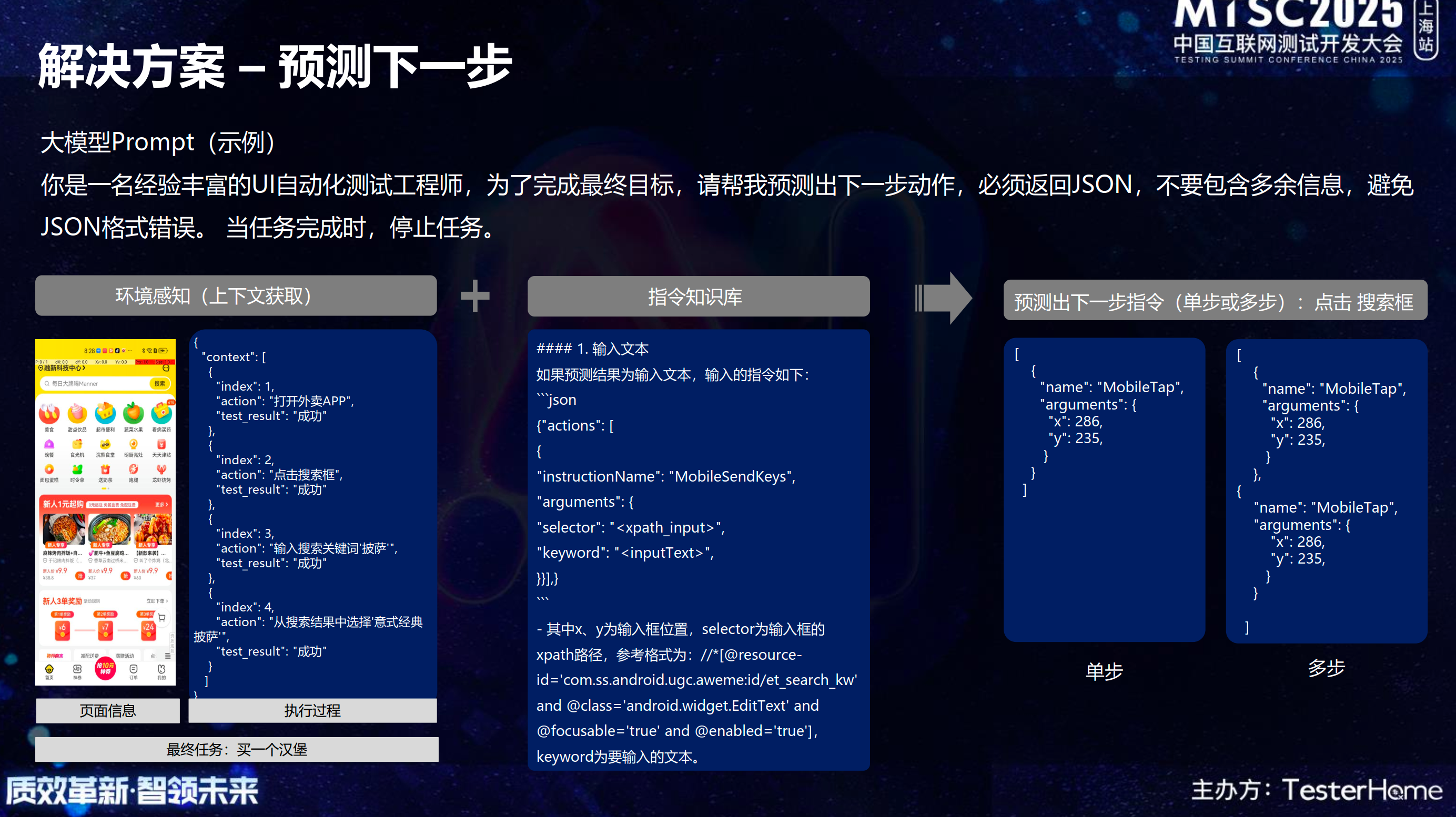

从需求文档,测试用例,app 的截图训练数据来生成可执行路径,然后自动化执行,后续也可以自动更新知识图谱内容,降低维护成本。

感想:

AI 在UI 自动化的运用,这个可谓是测试工作的一大提效点,UI 自动化脚本稳定高效编写能够减少各种重复性的回归工作。

此时又想起了部门的UI 自动化中AI 的实践,实现方案是 通过:输入提示词--> ai 分解步骤执行(内部平台可识别的自动化脚本,包含了各按钮组件的操作)- > 保存截图--> 拿到上一步的截图进行断言 ,方案较上面的会简单一些,当然落地实践还是限于比较简单的UI 交互。

方案和后面美团分享的UI 自动化实现类似。【主题:Multi Agent 驱动的 UI 自动化测试新范式】

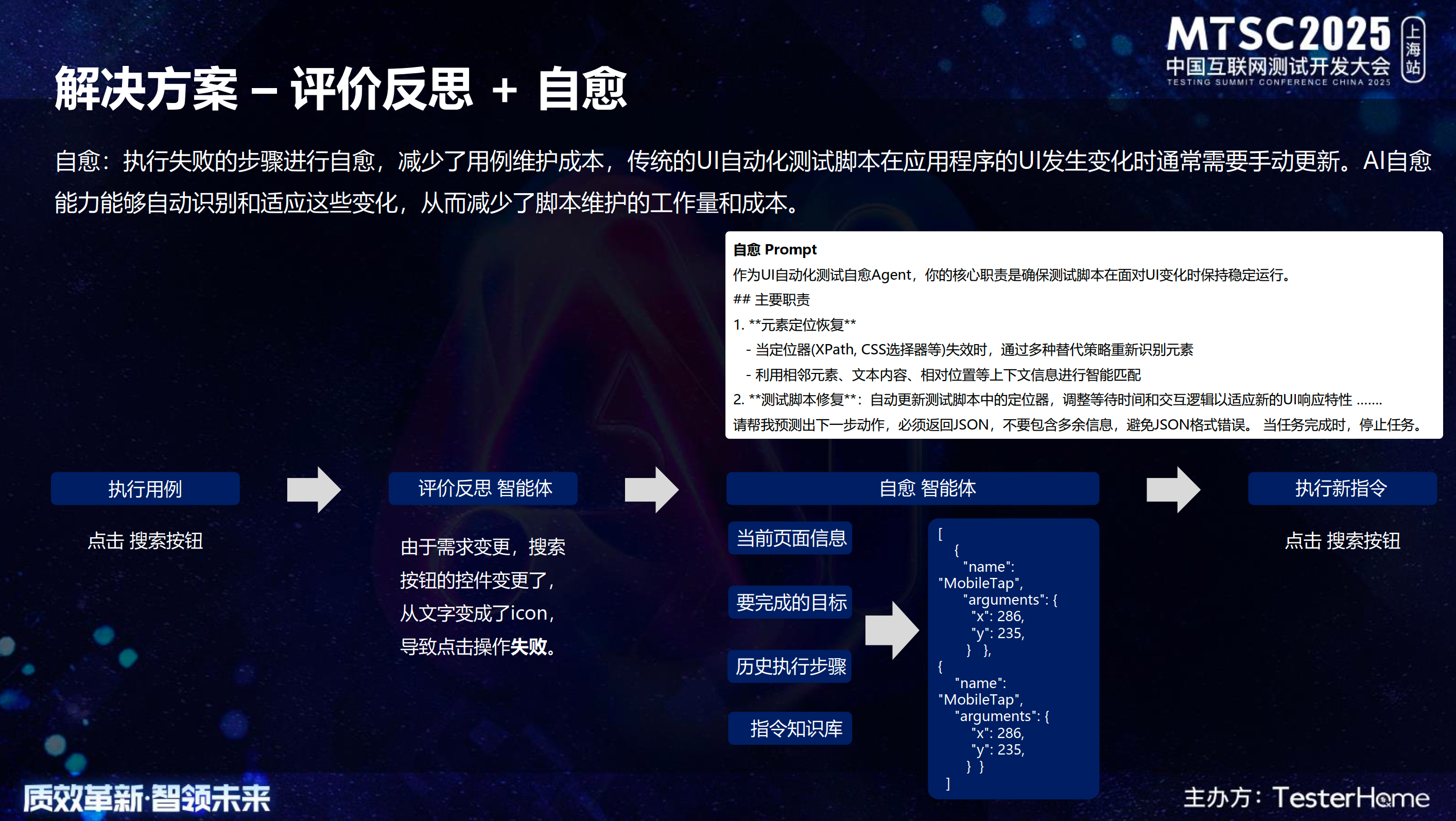

这个自愈提示词有点意思:

3.美团:AI 生成用例

技术实现

业务知识图谱

两大指标:召回率和精确率, 高召回率可以减少关键校验点的遗漏。

感想:

AI 生成测试用例也许是测试人员脑海里面关于AI 应用想到的第一个应用场景,好像这个输入一些用例,prd 等训练预料,就可以很快生成大量的测试用例,但是其中测试用例是否实际可用,不遗漏关键验证点,不重复测试等等,做好这个事情需要反复对模型进行微调,多方数据清洗以及知识库内容更新迭代确保完整性和时效性。

看了几个PPT,发现大家分享的PPT 做的是真好,有一种回到了看阿里内网 ATA 的感觉~

4.HOMEE AI:RAG 应用的质量保障

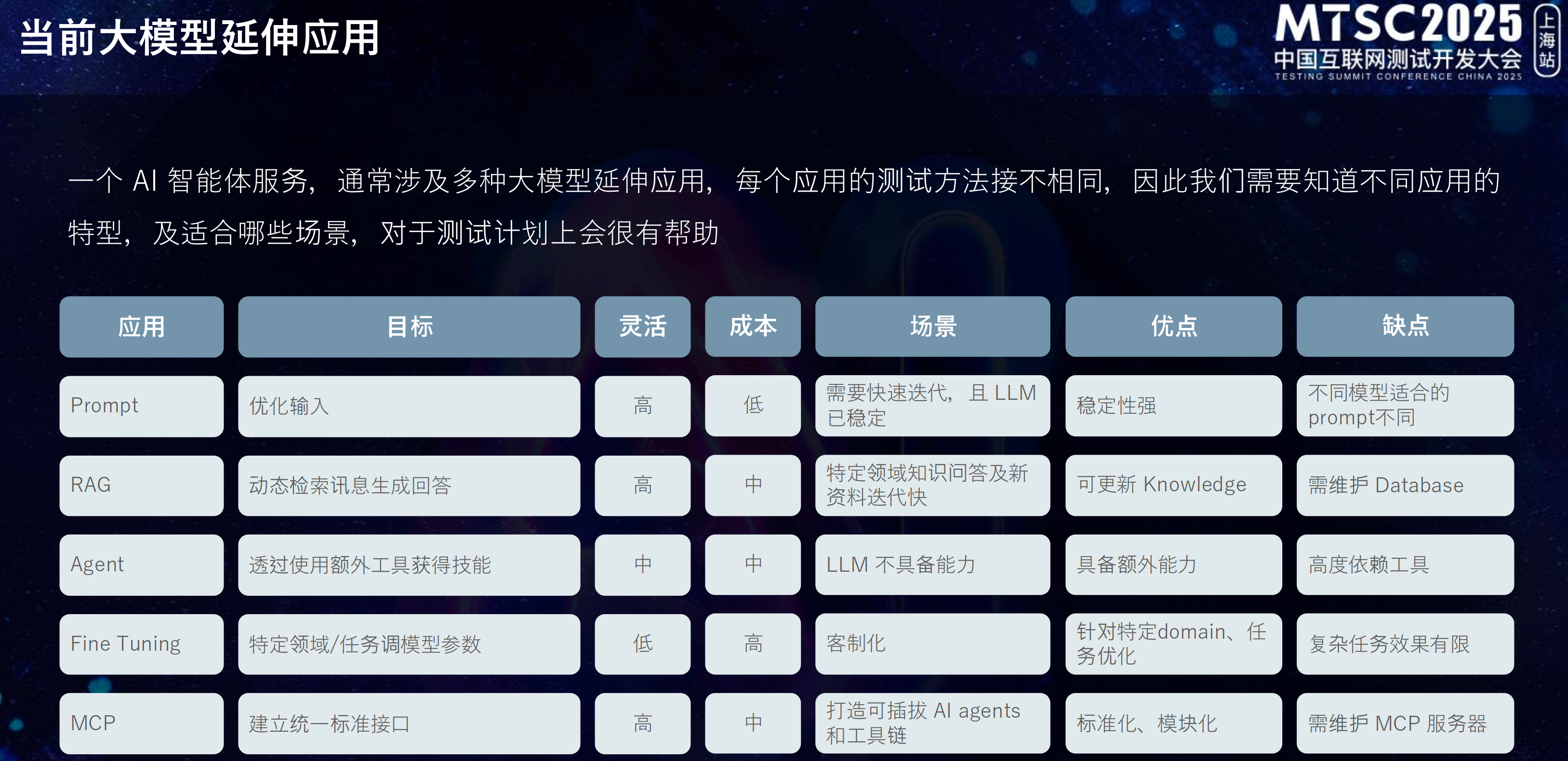

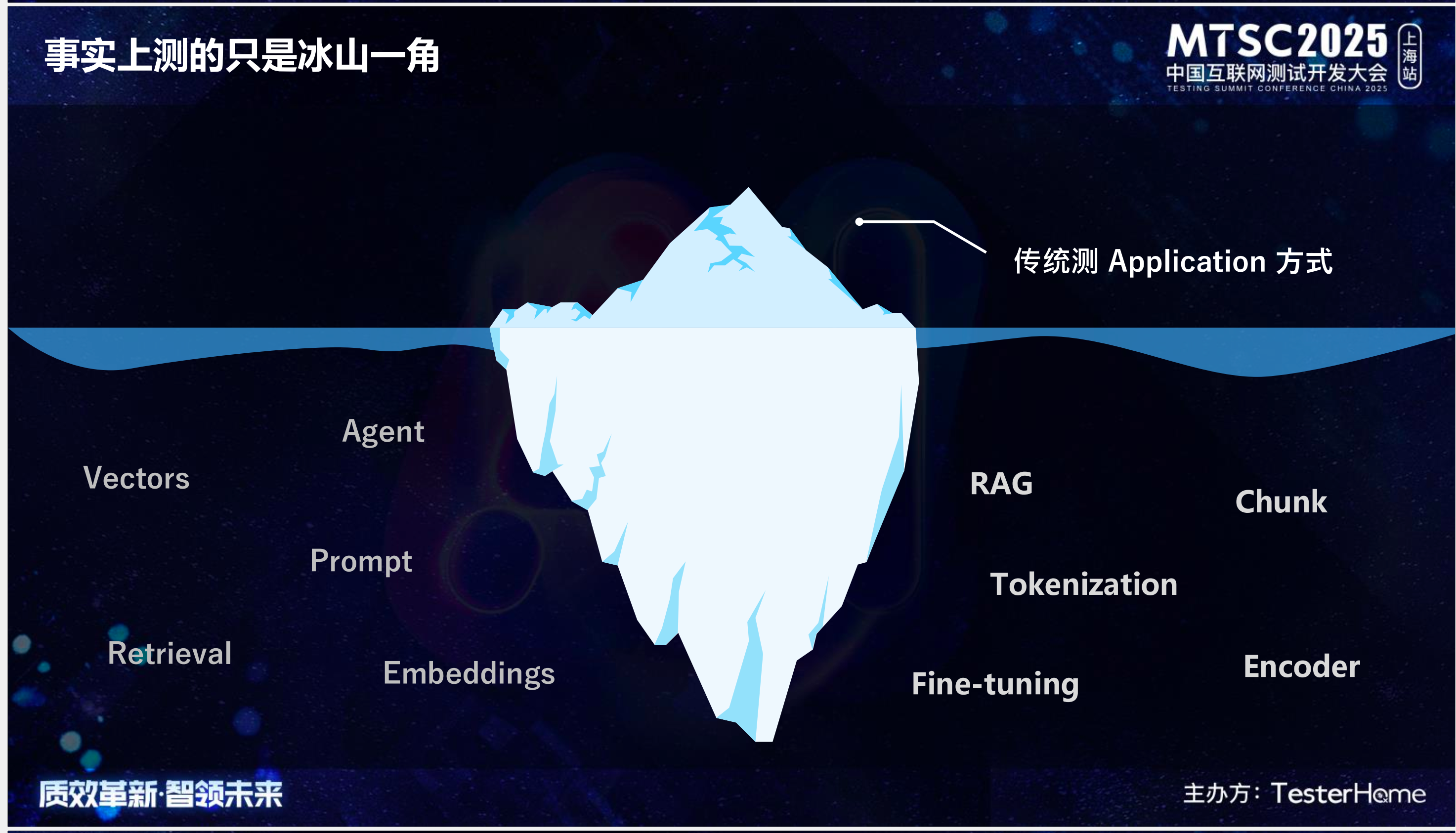

各类AI Agent 如何测试,一个比较新的测试主题。

这个图不错

测试策略:

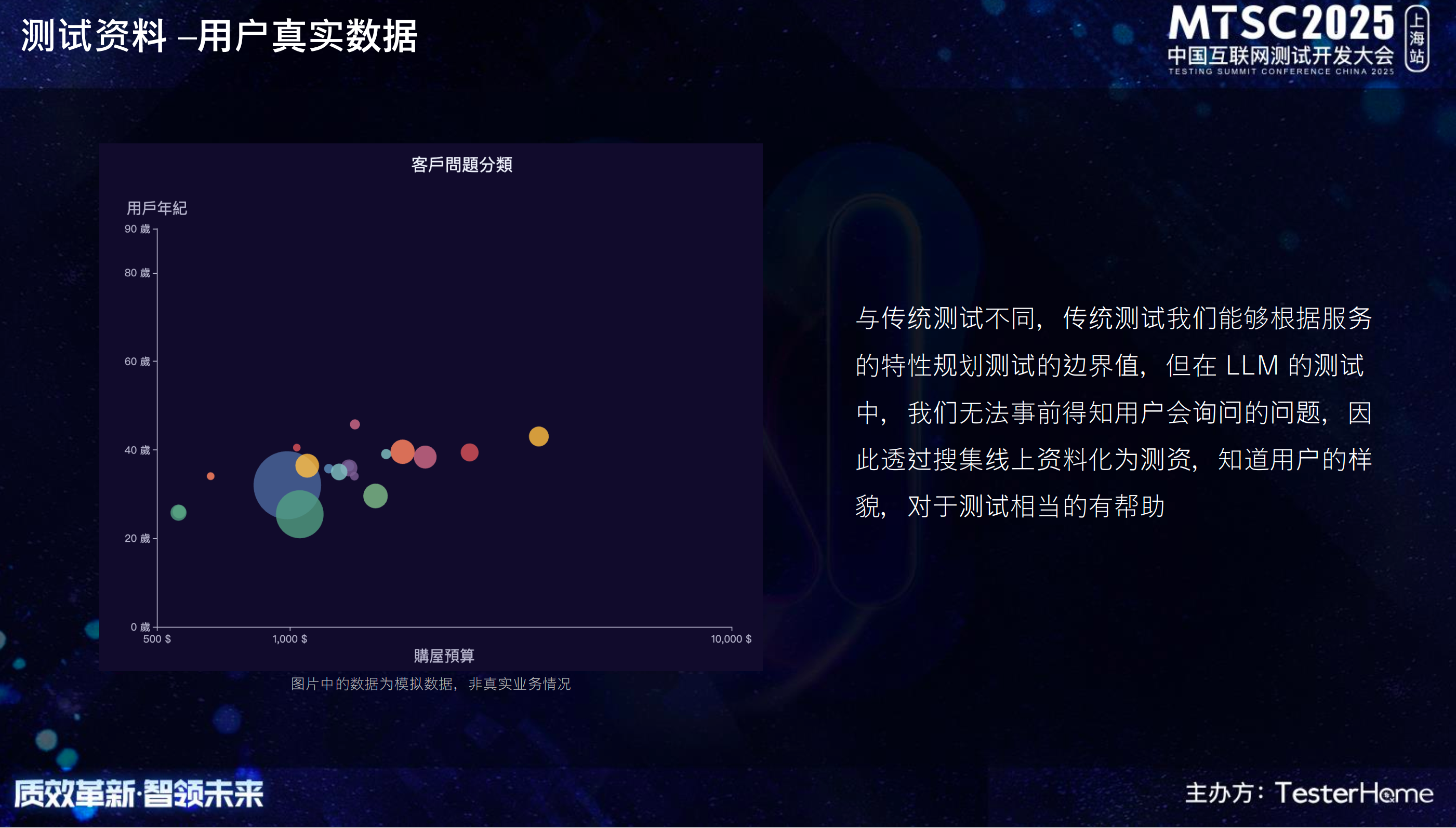

用户真实数据用于测试。

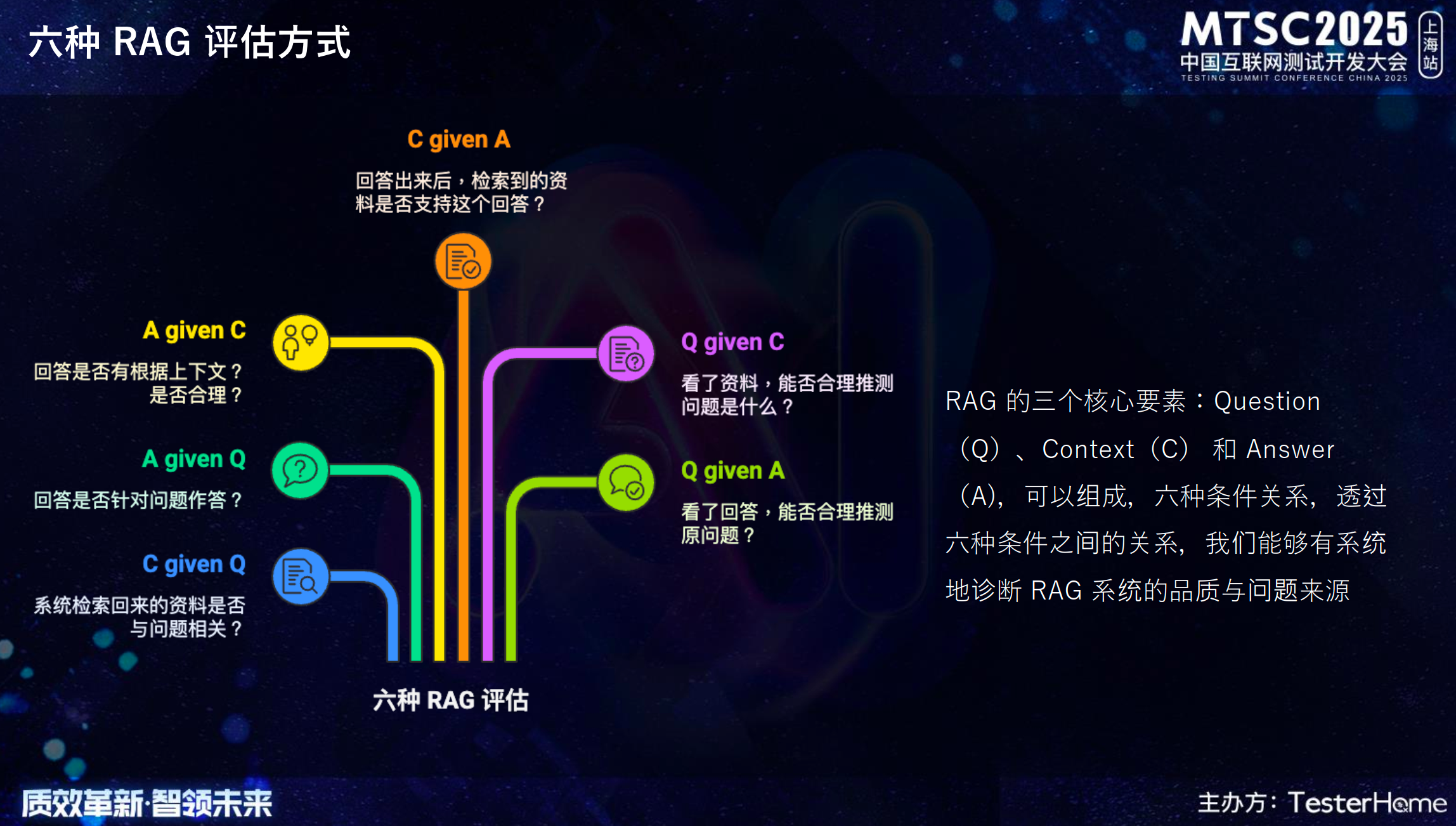

RAG 评估方式:

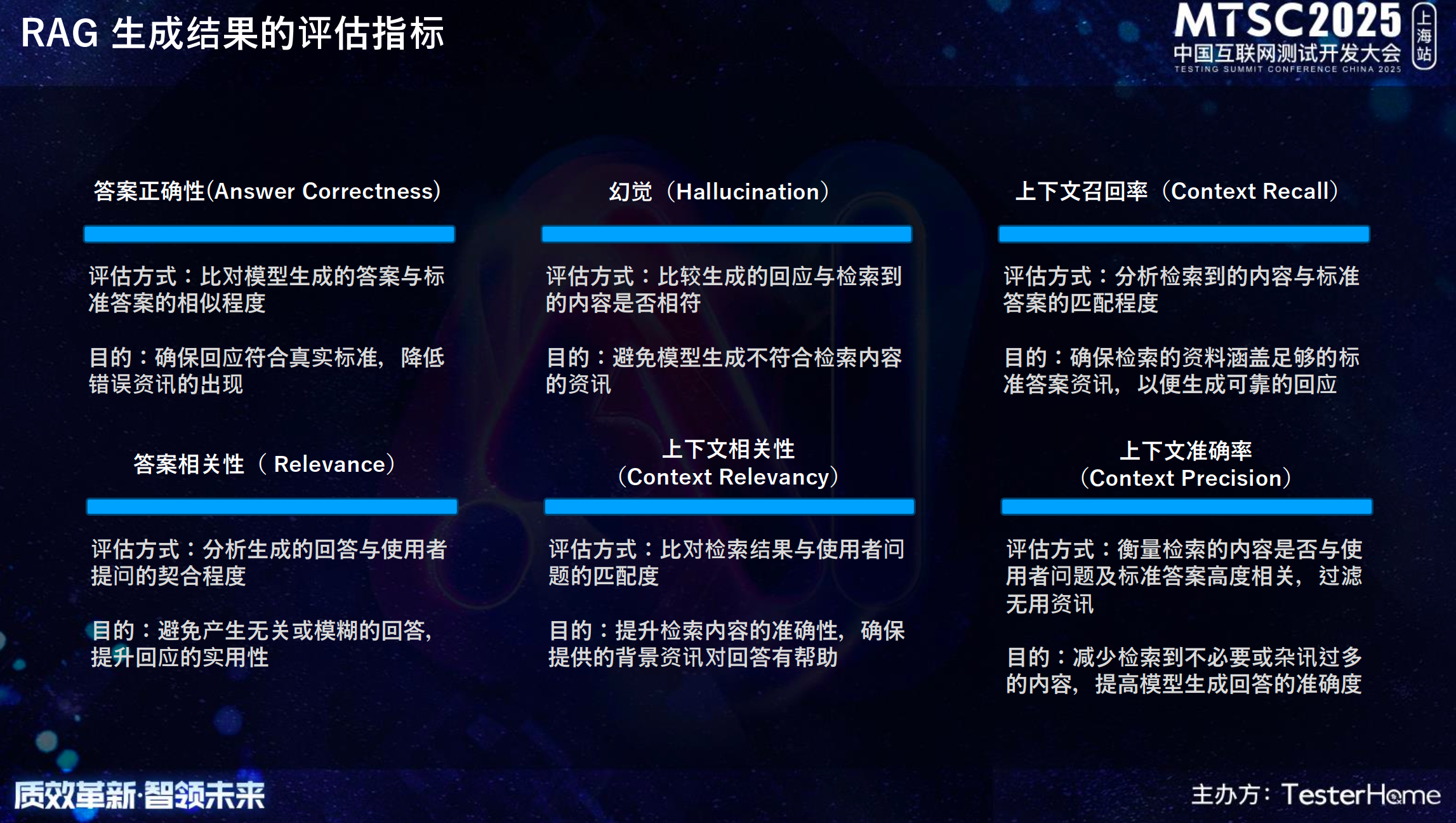

RAG 评估指标:

- 答案正确性

- 答案相关性

- 幻觉

- 上下文召回率

- 上下文相关性

- 上下文准确率

一个蛮新的概念, 评估驱动开发: 先建立评估机制子再进行开发

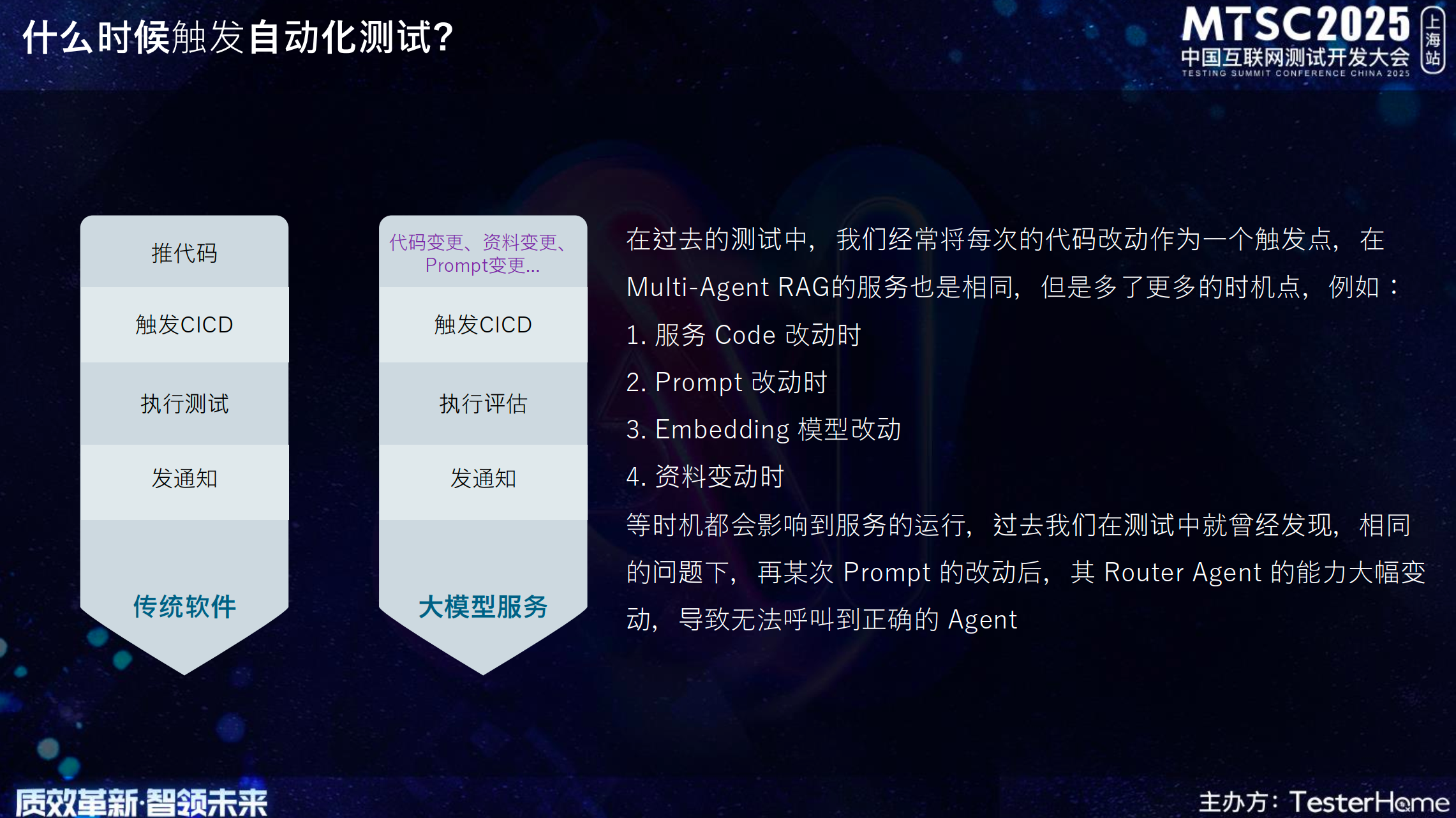

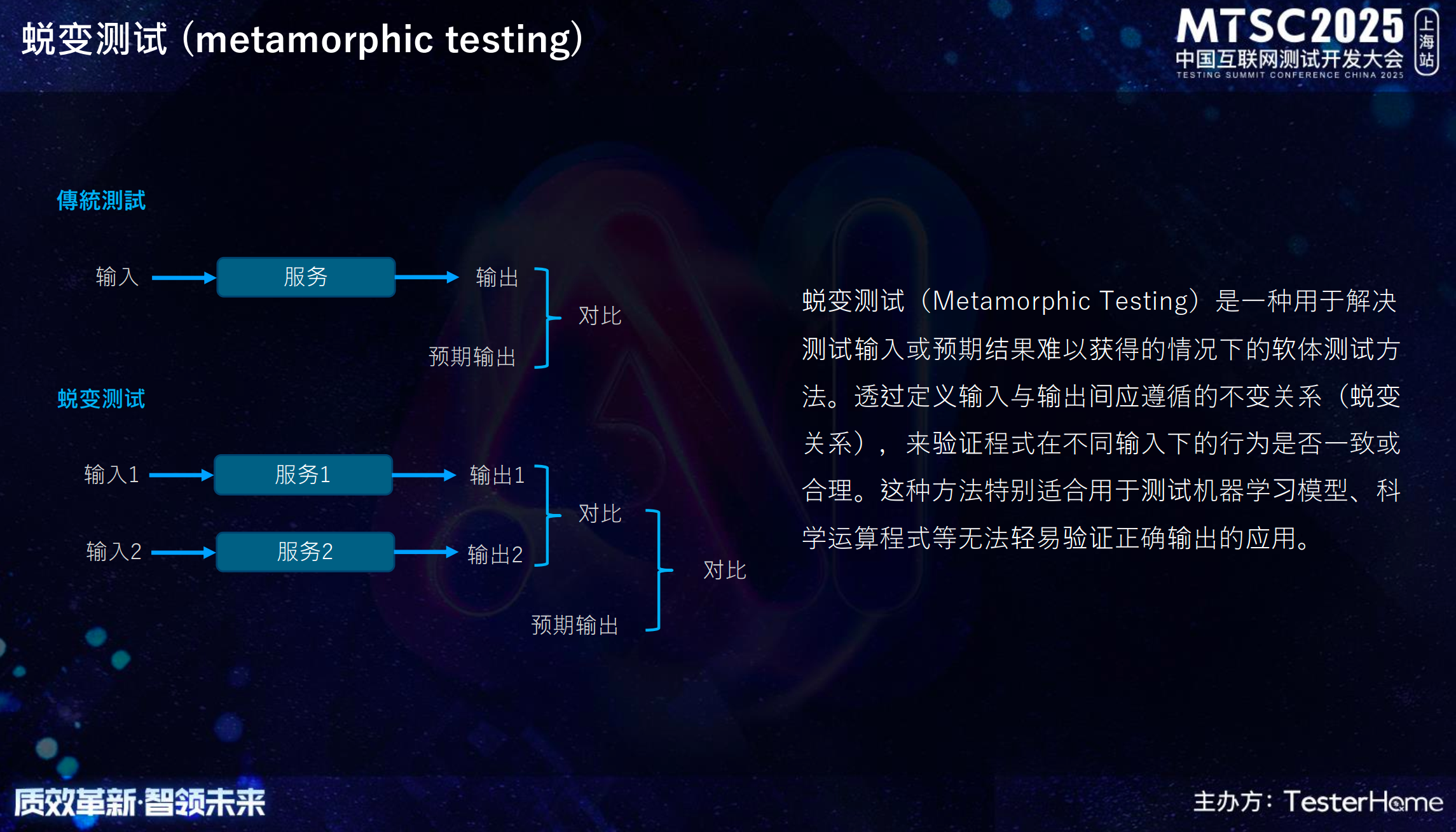

蜕变测试:解决软件测试输入或者预期结果难以获得的情况下的软件测试方法

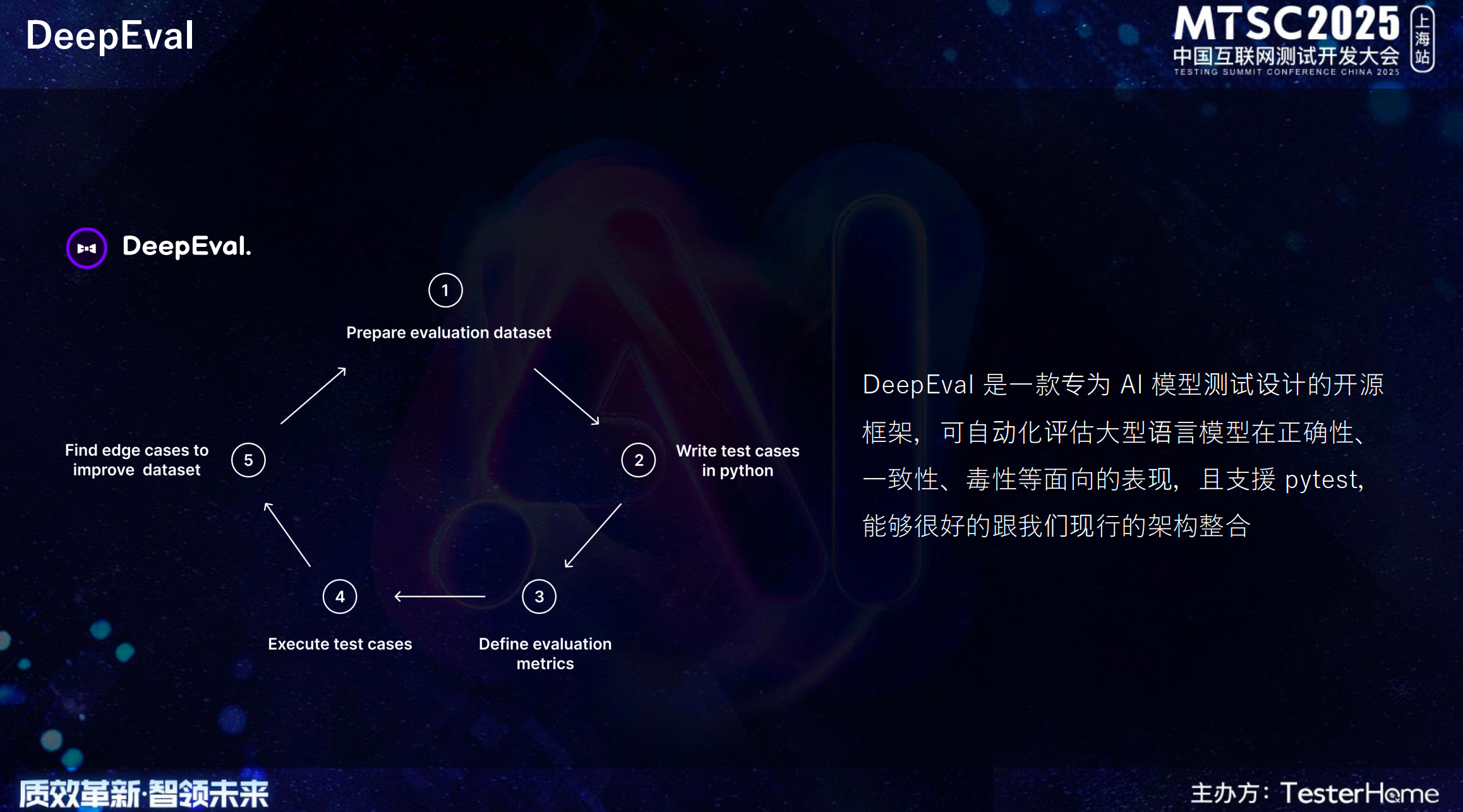

DeepEval 开源框架

感想:

AI 智能体的测试由之前传统的确定的输入输出变成了不确定的内容,如何评估这些生成的内容是否准确在我们习惯了传统的输入到确定性输出的测试验证方式之后,会很容易忽略应该要测试的模块,这个主题的分享了蛮多新的AI 测试方法论,还不错,有收获。

2025_ MTSC(上海站) PPT 下载 :

链接: 百度网盘 请输入提取码 提取码: 8t4f

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)