昇腾300I npu部署bge-m3 embedding模型

摘要:本文介绍了使用mis-tei镜像部署bge-m3模型的步骤。首先需申请并下载昇腾镜像仓库的mis-tei镜像,然后通过docker命令启动容器,配置环境变量、挂载目录等参数,指定entrypoint脚本。最后进行API测试,通过curl发送请求验证服务是否正常运行。部署过程需注意镜像版本、设备ID等配置参数的正确设置。全文提供了详细的命令行操作示例,便于开发者参考实施。(150字)

·

本次任务将使用mis-tei镜像部署bge-m3模型

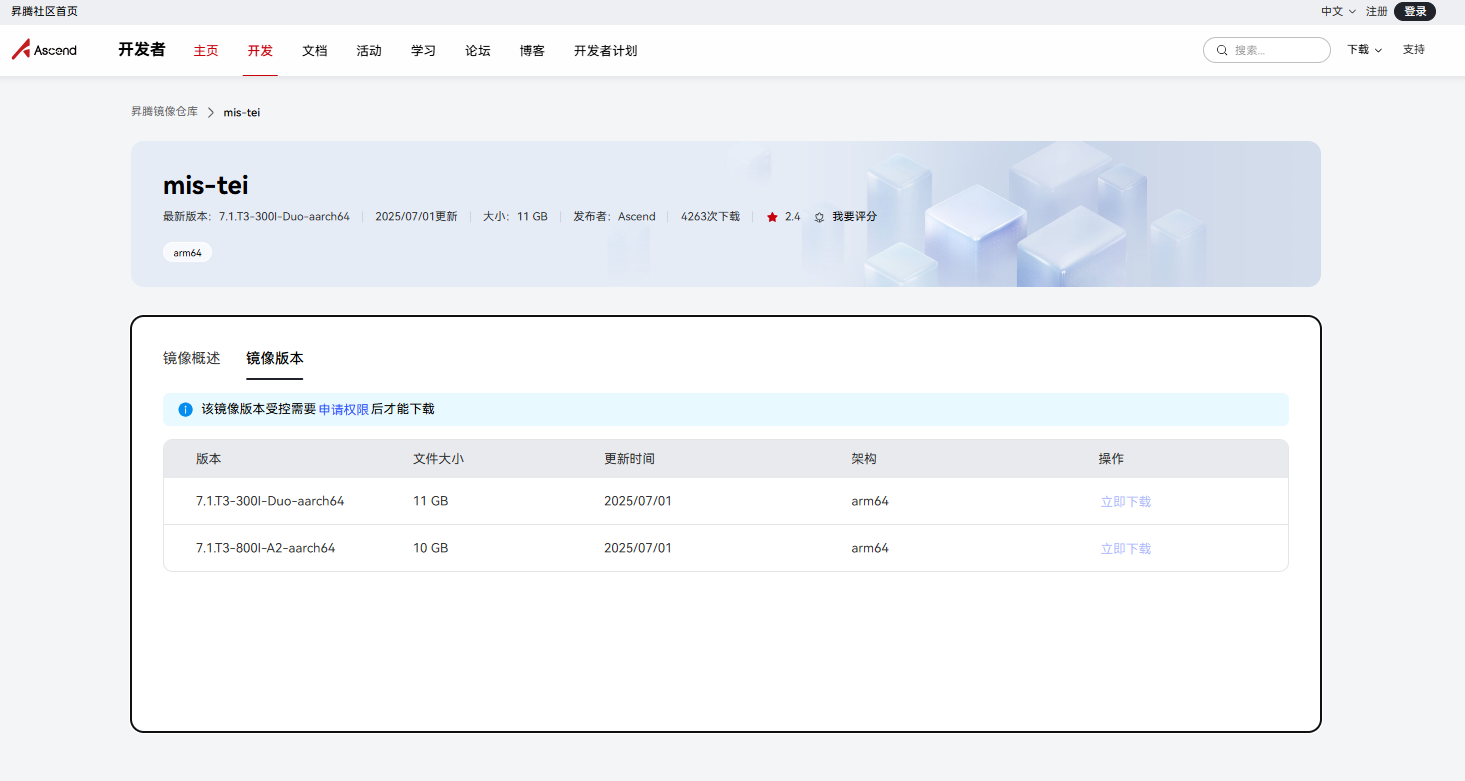

一、下载mis-tei镜像,该镜像下载需提前申请。

二、使用docker启动镜像

docker run -u root -e ASCEND_VISIBLE_DEVICES=4 -itd --name=bge-m3 --net=host \

-e HOME=/home/HwHiAiUser \

--privileged=true \

-v /home/BAAI/:/home/HwHiAiUser/model \ #把整个模型目录放在/home/BAAI目录里

-v /usr/local/bin/npu-smi:/usr/local/bin/npu-smi \

-v /usr/local/Ascend/driver:/usr/local/Ascend/driver \

--entrypoint /home/HwHiAiUser/start.sh \

mis-tei:6.0.0-300I-Duo-aarch64 \

BAAI/bge-m3 127.0.0.1 8086 #可以改为本机ip,外部才可请求

https://www.hikunpeng.com/doc_center/source/zh/kunpengrag/bestpractice/kunpengrag_21_0014.html

三、请求测试

curl http://127.0.0.1:8086/v1/embeddings \

-H "Content-Type: application/json" \

-d '{

"input": "test text",

"model": "bge-m3"

}'如有疏漏,敬请指正

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)