在国内稳定用Claude Code的三种姿势!

本文介绍了三种在国内稳定使用ClaudeCode的方法:1)通过API中转服务,修改环境变量即可快速接入;2)改用兼容的国产大模型(如Kimi、通义千问等),保留原有功能同时提升速度;3)本地部署大模型,适合对安全和隐私要求高的用户。作者分析了每种方案的优缺点,并提供了详细配置指南,帮助开发者根据需求选择最适合的方案,实现高效编程。

大家好,我是羊仔,专注AI编程、智能体、AI工具。

今天这篇文章,想聊一个很多人都问羊仔的问题:

“Claude Code 在国内怎么稳定用?”

是的,羊仔也踩过不少坑,尝尽各种波折。

最终总结出三种非常靠谱的方式,让 Claude Code 在国内稳定运行,不卡顿、不断线。

这篇文章,羊仔就把这三个方案分享给你。

(建议先收藏,可能会救你一命。)

方案一:API 中转,最稳的捷径

这是羊仔长期使用下来最无痛的方案。

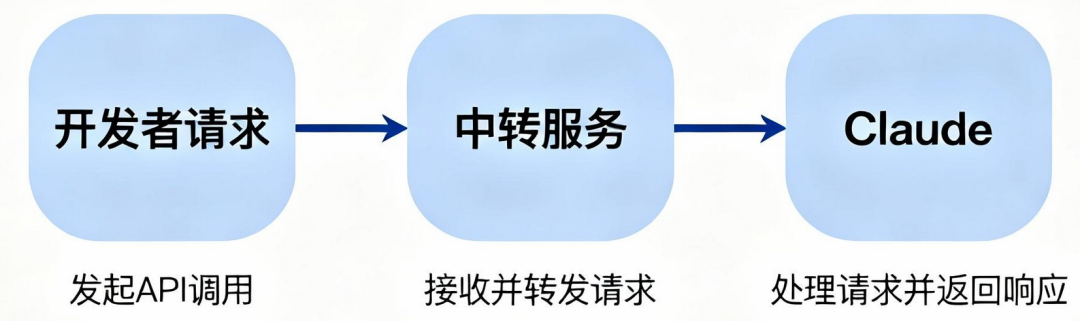

市面上已经有不少可信赖的Claude API 国内中转服务,它的原理其实很简单:

你 → 中转服务器 → Claude 官方 → 把结果传回

整个过程对 Claude 来说没变化,对你来说也秒响应。

在配置的时候,只需要改两个环境变量:

export ANTHROPIC_BASE_URL=中转服务的URLexport ANTHROPIC_AUTH_TOKEN=你的token

然后运行 claude 测试一下,如果能顺利回应,说明中转已经OK。

羊仔建议:

-

选中转服务时优先考虑能提供 SLA(稳定性保证)的。

-

避免来历不明、临时搭的服务,防止 Key 被泄露。

方案二:改用国产大模型,又快又好

很多人不知道,其实 Claude Code 并不强制绑定 Claude 家的模型,只要模型API 兼容 Anthropic 的结构,照样可以用!

也就是说,用国产大模型 API 替换 Claude,也能照常跑!

羊仔亲测几个表现不错的:

-

Kimi K2:上下文长,适合做复杂代码项目;

-

通义千问:响应速度快,性价比高;

-

DeepSeek Coder:专门针对编程优化,更理解程序员。

配置同样简单:

export ANTHROPIC_BASE_URL=模型的API地址export ANTHROPIC_AUTH_TOKEN=你的API Key

如果是用插件,再改一下 ~/.claude/settings.json 中环境变量部分:

"ANTHROPIC_BASE_URL":"模型的API地址","ANTHROPIC_AUTH_TOKEN":"你的Token","ANTHROPIC_DEFAULT_HAIKU_MODEL":"你的模型","ANTHROPIC_DEFAULT_SONNET_MODEL":"你的模型","ANTHROPIC_DEFAULT_OPUS_MODEL":"你的模型"

这样 VS Code 的 Claude Code 插件就能直接和国产大模型通信。

羊仔现在的工作流,就是一开始用 Claude 开发项目主体,之后换成 DeepSeek改bug,两开花。

方案三:本地自部署,极客最爱

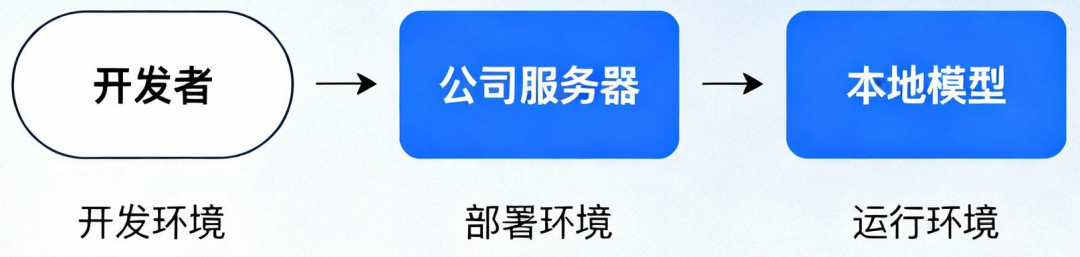

如果公司内网封得死,禁止出网,或者你对隐私和数据安全要求极高,那羊仔首推本地部署大模型。

可以选择的工具主要有两种:

-

Ollama:轻量部署神器,十分钟启动一个模型;

-

vLLM:性能强悍,支持多并发,一般适合团队部署。

部署兼容 Anthropic 格式的接口之后,Claude Code 插件可以无缝使用:

export ANTHROPIC_BASE_URL=http://localhost:8000/v1export ANTHROPIC_AUTH_TOKEN=local-key

羊仔曾经帮一个创业团队在内网部署过 Qwen-1.5 模型,效果非常稳,响应速度比官方还快一点。

最重要的是:敏感代码全在自己服务器,不怕泄露。

总结一下,三套方案各有千秋

|

方案 |

适合人群 |

优势 |

缺点 |

|

API中转 |

想省事、保持原版Claude体验 |

稳定简单 |

依赖第三方服务 |

|

国产大模型 |

想要低延迟、节省成本 |

快、省、合法合规 |

模型差异略大 |

|

本地部署 |

对隐私和内网环境有要求 |

安全、可控 |

配置复杂 |

羊仔说

不论是 Claude、GLM 还是 DeepSeek,最终目标都不是哪家更强,而是让你写代码、做创意、搭原型更高效。

希望这篇能让你重新打开 Claude 的大门。

共勉!

欢迎关注羊仔,一起探索AI,成为超级个体!

如果你喜欢这篇文章,不妨点赞,在看,转发。

你的每一次互动,对羊仔来说都是莫大的鼓励。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献43条内容

已为社区贡献43条内容

所有评论(0)