Android摄像头中心点取色实战开发

Android 权限分为两类:普通权限(Normal Permissions):系统自动授予,如网络访问。危险权限(Dangerous Permissions):需要用户授权,如摄像头、位置、麦克风等。摄像头权限为,属于危险权限。本章深入探讨了图像处理中的关键技术,包括JNI调用C/C++代码实现高效处理、颜色提取算法的设计与优化,以及OpenCV在Android平台上的集成与应用。

简介:在Android平台上实现摄像头取色功能,主要是通过 camera2 API获取实时图像,并在底层使用C/C++语言进行高效处理,提升性能与响应速度。本实战教程涵盖权限申请、摄像头初始化、图像帧捕获、像素解析、颜色提取与格式转换等核心步骤,帮助开发者掌握如何在Android应用中实现对摄像头画面中心点的颜色识别。内容还涉及JNI调用、资源释放与兼容性处理,适用于图像识别、调色工具等应用场景。

1. Android摄像头开发基础与核心概念

Android摄像头开发是构建高质量影像类应用(如相机、视频通话、AR应用等)的核心技术之一。它涉及系统级API的调用、硬件资源的管理以及图像数据的处理流程。本章将从基础架构入手,深入讲解Android摄像头的工作原理、软硬件交互机制以及常见的开发术语,帮助开发者建立系统化的认知框架。

核心概念包括: Camera HAL(硬件抽象层) 、 Camera Service 、 Camera API(如Camera1与Camera2) ,以及 图像数据流(Preview、ImageReader) 等。这些组件共同构成了Android设备上摄像头功能的运行体系。理解这些内容是掌握摄像头开发的关键第一步。

2. Camera2 API详解与权限管理

Android从5.0(API 21)开始引入了全新的 Camera2 API ,旨在替代老旧的 Camera 类,提供更细粒度的控制和更高的灵活性。本章将深入解析 Camera2 API 的核心组件、权限管理流程,以及摄像头设备的创建与管理机制。通过本章内容,开发者将能够掌握如何高效、安全地使用 Camera2 API 实现摄像头功能。

2.1 Camera2 API架构与核心组件

Camera2 API 的设计基于“客户端-服务端”架构,由多个关键组件协同工作,实现对摄像头硬件的控制和图像采集。其核心组件包括 CameraManager 、 CameraDevice 和 CaptureRequest 。

2.1.1 CameraManager与摄像头设备管理

CameraManager 是 Camera2 API 的入口点,负责管理设备上的所有摄像头。通过它,开发者可以获取摄像头列表、查询摄像头特性、打开特定摄像头等。

CameraManager cameraManager = (CameraManager) getSystemService(Context.CAMERA_SERVICE);

参数说明:

Context.CAMERA_SERVICE:系统服务标识,用于获取摄像头管理器实例。

核心功能:

- 获取摄像头 ID 列表:

cameraManager.getCameraIdList() - 查询摄像头特性:

cameraManager.getCameraCharacteristics(String cameraId) - 打开摄像头:

cameraManager.openCamera(String cameraId, CameraDevice.StateCallback callback, Handler handler)

代码逻辑分析:

getCameraIdList()返回当前设备支持的所有摄像头 ID,通常包括前后摄像头。getCameraCharacteristics()可以获取摄像头的详细参数,如传感器方向、支持的分辨率、是否为广角等。openCamera()用于异步打开指定摄像头,打开成功后将通过回调函数返回CameraDevice实例。

示例:获取摄像头信息

try {

for (String cameraId : cameraManager.getCameraIdList()) {

CameraCharacteristics characteristics = cameraManager.getCameraCharacteristics(cameraId);

Integer facing = characteristics.get(CameraCharacteristics.LENS_FACING);

if (facing != null && facing == CameraCharacteristics.LENS_FACING_BACK) {

Log.d("CameraInfo", "Found back camera: " + cameraId);

}

}

} catch (CameraAccessException e) {

e.printStackTrace();

}

逻辑分析:

- 遍历所有摄像头 ID。

- 获取每个摄像头的特性,判断是否为后置摄像头(

LENS_FACING_BACK)。 - 异常处理使用

CameraAccessException捕获可能的访问错误。

2.1.2 CameraDevice与摄像头连接

CameraDevice 是与摄像头硬件建立连接的接口,代表一个打开的摄像头实例。它是图像采集的起点。

创建方式:

cameraManager.openCamera(cameraId, new CameraDevice.StateCallback() {

@Override

public void onOpened(@NonNull CameraDevice camera) {

// 摄像头打开成功

mCameraDevice = camera;

createCameraPreviewSession();

}

@Override

public void onDisconnected(@NonNull CameraDevice camera) {

camera.close();

}

@Override

public void onError(@NonNull CameraDevice camera, int error) {

camera.close();

}

}, null);

参数说明:

cameraId:摄像头设备的唯一标识符。StateCallback:摄像头状态回调接口,包含打开、断开、错误等回调方法。Handler:可选参数,用于指定回调执行的线程,若为null则使用主线程。

核心方法:

createCaptureSession(List<Surface> outputs, CameraCaptureSession.StateCallback callback, Handler handler):创建图像采集会话。createCaptureRequest(int templateType):创建图像采集请求。

2.1.3 CaptureRequest与图像采集控制

CaptureRequest 是用于配置图像采集参数的类,包括曝光时间、对焦模式、帧率控制等。它通过 CameraDevice 创建,并在 CameraCaptureSession 中提交执行。

创建与配置示例:

CaptureRequest.Builder captureRequestBuilder = mCameraDevice.createCaptureRequest(CameraDevice.TEMPLATE_PREVIEW);

Surface previewSurface = new Surface(textureView.getSurfaceTexture());

captureRequestBuilder.addTarget(previewSurface);

// 设置对焦模式

captureRequestBuilder.set(CaptureRequest.CONTROL_AF_MODE, CameraMetadata.CONTROL_AF_MODE_CONTINUOUS_PICTURE);

// 设置曝光补偿

captureRequestBuilder.set(CaptureRequest.CONTROL_AE_EXPOSURE_COMPENSATION, 1);

CaptureRequest captureRequest = captureRequestBuilder.build();

参数说明:

TEMPLATE_PREVIEW:预览模式的请求模板,适用于实时预览。addTarget(Surface):设置图像输出目标,如 TextureView 或 ImageReader。CONTROL_AF_MODE:自动对焦模式,CONTINUOUS_PICTURE表示持续对焦。CONTROL_AE_EXPOSURE_COMPENSATION:曝光补偿参数,值越大图像越亮。

流程图:Camera2 API 核心流程

graph TD

A[CameraManager] --> B[获取摄像头列表]

B --> C[打开摄像头]

C --> D[CameraDevice]

D --> E[创建CaptureSession]

E --> F[创建CaptureRequest]

F --> G[提交请求采集图像]

2.2 权限申请与配置流程

Android 6.0(API 23)引入了运行时权限机制,摄像头权限属于危险权限,必须在运行时动态申请。

2.2.1 Android权限系统概述

Android 权限分为两类:

- 普通权限(Normal Permissions) :系统自动授予,如网络访问。

- 危险权限(Dangerous Permissions) :需要用户授权,如摄像头、位置、麦克风等。

摄像头权限为 Manifest.permission.CAMERA ,属于危险权限。

2.2.2 摄像头权限声明与运行时申请

在 AndroidManifest.xml 中声明权限:

<uses-permission android:name="android.permission.CAMERA" />

在代码中请求权限:

if (ContextCompat.checkSelfPermission(this, Manifest.permission.CAMERA) != PackageManager.PERMISSION_GRANTED) {

ActivityCompat.requestPermissions(this, new String[]{Manifest.permission.CAMERA}, REQUEST_CAMERA_PERMISSION);

}

回调处理:

@Override

public void onRequestPermissionsResult(int requestCode, @NonNull String[] permissions, @NonNull int[] grantResults) {

if (requestCode == REQUEST_CAMERA_PERMISSION) {

if (grantResults.length > 0 && grantResults[0] == PackageManager.PERMISSION_GRANTED) {

// 权限授予,可以打开摄像头

openCamera();

} else {

Toast.makeText(this, "Camera permission denied", Toast.LENGTH_SHORT).show();

}

}

}

参数说明:

checkSelfPermission():检查当前应用是否已获得指定权限。requestPermissions():发起权限请求,用户可在弹窗中选择“允许”或“拒绝”。onRequestPermissionsResult():权限请求结果回调。

2.2.3 配置清单文件与设备支持检测

支持的摄像头特性声明(可选):

<uses-feature android:name="android.hardware.camera" android:required="true" />

<uses-feature android:name="android.hardware.camera.front" android:required="false" />

检测设备是否支持摄像头:

PackageManager pm = getPackageManager();

boolean hasCamera = pm.hasSystemFeature(PackageManager.FEATURE_CAMERA_ANY);

if (!hasCamera) {

Toast.makeText(this, "No camera found", Toast.LENGTH_SHORT).show();

}

参数说明:

hasSystemFeature():检测设备是否支持指定功能。FEATURE_CAMERA_ANY:表示设备至少有一个摄像头。FEATURE_CAMERA_FRONT:表示设备有前置摄像头。

2.3 摄像头设备的创建与管理

摄像头设备的创建与管理是 Camera2 API 中的核心流程之一,涉及打开设备、状态监听、异常处理和多摄像头切换。

2.3.1 打开摄像头设备的流程

摄像头打开流程如下:

- 获取

CameraManager实例。 - 获取摄像头 ID 列表。

- 根据摄像头 ID 打开设备。

- 创建图像采集会话。

- 构建并提交图像采集请求。

示例代码:

private void openCamera() {

CameraManager cameraManager = (CameraManager) getSystemService(Context.CAMERA_SERVICE);

try {

String cameraId = cameraManager.getCameraIdList()[0]; // 获取第一个摄像头

cameraManager.openCamera(cameraId, new CameraDevice.StateCallback() {

@Override

public void onOpened(@NonNull CameraDevice camera) {

mCameraDevice = camera;

createCameraPreviewSession();

}

@Override

public void onDisconnected(@NonNull CameraDevice camera) {

camera.close();

}

@Override

public void onError(@NonNull CameraDevice camera, int error) {

camera.close();

}

}, null);

} catch (CameraAccessException e) {

e.printStackTrace();

}

}

2.3.2 设备状态监听与异常处理

摄像头设备的状态变化通过 CameraDevice.StateCallback 接口监听:

| 方法名 | 描述 |

|---|---|

onOpened() |

摄像头成功打开 |

onDisconnected() |

摄像头被断开连接 |

onError() |

摄像头发生错误 |

异常处理建议:

- 捕获

CameraAccessException,防止崩溃。 - 使用

Handler指定回调线程,避免主线程阻塞。 - 在

onError()中关闭摄像头设备,释放资源。

2.3.3 多摄像头设备的识别与切换

Android 支持多摄像头设备,如双摄、广角、长焦等。开发者需要根据摄像头特性进行识别与切换。

获取摄像头特性:

CameraCharacteristics characteristics = cameraManager.getCameraCharacteristics(cameraId);

Integer lensFacing = characteristics.get(CameraCharacteristics.LENS_FACING);

Integer sensorOrientation = characteristics.get(CameraCharacteristics.SENSOR_ORIENTATION);

切换摄像头示例:

private void switchCamera() {

closeCamera(); // 关闭当前摄像头

mCurrentCameraId = (mCurrentCameraId.equals("0")) ? "1" : "0"; // 切换摄像头ID

openCamera(); // 重新打开

}

参数说明:

LENS_FACING:镜头方向,可取值为LENS_FACING_BACK(后置)或LENS_FACING_FRONT(前置)。SENSOR_ORIENTATION:传感器旋转角度,用于图像旋转适配。

本章详细解析了 Camera2 API 的核心组件、权限管理流程以及摄像头设备的创建与管理机制。通过本章内容,开发者应具备使用 Camera2 API 开发摄像头应用的能力,并理解多摄像头识别与切换的基本方法。下一章将深入讲解图像预览与帧捕获技术,敬请期待。

3. 图像预览与帧捕获技术

在Android摄像头开发中,图像预览与帧捕获是实现摄像头功能的核心环节。本章将深入讲解如何构建预览界面、捕获图像帧并进行基础处理,重点分析SurfaceView与TextureView的差异、ImageReader的使用方式,以及YUV图像格式的解析逻辑。通过本章内容,开发者可以掌握如何高效地在应用中展示摄像头画面,并对图像数据进行实时访问和处理。

3.1 预览界面的构建与显示

在Android中,图像预览通常通过SurfaceView或TextureView来实现。两者各有优势,开发者需根据具体场景进行选择。此外,预览画面的尺寸设置、旋转适配等也是开发中常见的关键点。

3.1.1 SurfaceView与TextureView的对比

SurfaceView 和 TextureView 是 Android 中用于渲染视频和摄像头预览的两种主要控件。它们的主要区别如下:

| 特性 | SurfaceView | TextureView |

|---|---|---|

| 绘制机制 | 独立的Surface,由系统合成 | 基于View的渲染,使用GPU |

| 动画支持 | 不支持 | 支持(如旋转、缩放) |

| 层级关系 | 独立层级,不参与View层级绘制 | 属于View层级,可与其他View交互 |

| 性能 | 更高效,适合长时间预览 | 有一定性能开销,适合交互性场景 |

| 可截图性 | 不可直接截图 | 可通过Bitmap获取内容 |

代码示例:

// 使用SurfaceView作为预览控件

SurfaceView surfaceView = findViewById(R.id.surface_view);

SurfaceHolder holder = surfaceView.getHolder();

holder.addCallback(new SurfaceHolder.Callback() {

@Override

public void surfaceCreated(SurfaceHolder surfaceHolder) {

// 预览Surface创建完成,可以开始预览

startPreview(surfaceHolder.getSurface());

}

@Override

public void surfaceChanged(SurfaceHolder surfaceHolder, int format, int width, int height) {

// 预览尺寸变化时处理

}

@Override

public void surfaceDestroyed(SurfaceHolder surfaceHolder) {

// 预览Surface销毁时释放资源

}

});

逐行分析:

SurfaceView是通过SurfaceHolder管理底层的 Surface,适用于摄像头预览。surfaceCreated回调中,调用startPreview()方法启动摄像头预览流程。surfaceChanged用于处理尺寸变化事件,通常用于适配不同的预览尺寸。

使用TextureView的示例:

TextureView textureView = findViewById(R.id.texture_view);

textureView.setSurfaceTextureListener(new TextureView.SurfaceTextureListener() {

@Override

public void onSurfaceTextureAvailable(SurfaceTexture surfaceTexture, int width, int height) {

// 创建Surface

Surface surface = new Surface(surfaceTexture);

startPreview(surface);

}

@Override

public void onSurfaceTextureSizeChanged(SurfaceTexture surfaceTexture, int width, int height) {

// 尺寸变化处理

}

@Override

public boolean onSurfaceTextureDestroyed(SurfaceTexture surfaceTexture) {

// 释放Surface资源

return false;

}

@Override

public void onSurfaceTextureUpdated(SurfaceTexture surfaceTexture) {

// 每帧更新时触发

}

});

逻辑分析:

TextureView使用SurfaceTexture接口,允许通过GPU渲染,适合需要动画或截图的场景。onSurfaceTextureAvailable回调中创建Surface并启动预览。onSurfaceTextureUpdated可用于每帧更新后执行操作,如截图或图像分析。

3.1.2 设置预览输出格式与尺寸

摄像头设备支持多种预览分辨率和格式。开发者需根据设备支持情况选择合适的预览尺寸和图像格式。

CameraManager manager = (CameraManager) getSystemService(Context.CAMERA_SERVICE);

String cameraId = manager.getCameraIdList()[0];

CameraCharacteristics characteristics = manager.getCameraCharacteristics(cameraId);

StreamConfigurationMap map = characteristics.get(CameraCharacteristics.SCALER_STREAM_CONFIGURATION_MAP);

Size[] previewSizes = map.getOutputSizes(SurfaceTexture.class);

参数说明:

CameraManager用于获取摄像头设备列表和特性。CameraCharacteristics包含摄像头的配置信息。SCALER_STREAM_CONFIGURATION_MAP提供摄像头支持的流配置信息。getOutputSizes()返回指定目标类型(如SurfaceTexture.class)所支持的尺寸列表。

选择最佳预览尺寸的逻辑:

private Size chooseOptimalSize(Size[] choices, int width, int height) {

List<Size> bigEnough = new ArrayList<>();

for (Size option : choices) {

if (option.getHeight() == (option.getWidth() * height / width)) {

bigEnough.add(option);

}

}

if (!bigEnough.isEmpty()) {

return Collections.min(bigEnough, new CompareSizesByArea());

} else {

return choices[0];

}

}

private static class CompareSizesByArea implements Comparator<Size> {

@Override

public int compare(Size lhs, Size rhs) {

return Long.signum((long) lhs.getWidth() * lhs.getHeight() -

(long) rhs.getWidth() * rhs.getHeight());

}

}

逻辑分析:

- 上述代码选择与目标宽高比一致且面积最小的尺寸,以减少资源消耗。

- 如果没有合适的尺寸,则返回第一个可选尺寸。

3.1.3 实现摄像头预览画面的旋转与适配

不同设备摄像头的传感器方向不同,预览画面可能需要旋转。此外,应用的显示方向(如竖屏或横屏)也会影响画面适配。

int rotation = getWindowManager().getDefaultDisplay().getRotation();

int sensorOrientation = characteristics.get(CameraCharacteristics.SENSOR_ORIENTATION);

int displayRotation = getDisplayRotation(rotation, sensorOrientation);

private int getDisplayRotation(int rotation, int sensorOrientation) {

switch (rotation) {

case Surface.ROTATION_0:

return (sensorOrientation + 0) % 360;

case Surface.ROTATION_90:

return (sensorOrientation + 270) % 360;

case Surface.ROTATION_180:

return (sensorOrientation + 180) % 360;

case Surface.ROTATION_270:

return (sensorOrientation + 90) % 360;

default:

return 0;

}

}

参数说明:

rotation是当前显示方向(如竖屏为ROTATION_0)。sensorOrientation是摄像头传感器的原始方向。- 通过

getDisplayRotation计算出最终需要旋转的角度。

设置旋转的代码:

cameraDevice.createCaptureSession(Arrays.asList(surface), new CameraCaptureSession.StateCallback() {

@Override

public void onConfigured(CameraCaptureSession cameraCaptureSession) {

CaptureRequest.Builder builder = cameraDevice.createCaptureRequest(CameraDevice.TEMPLATE_PREVIEW);

builder.addTarget(surface);

builder.set(CaptureRequest.JPEG_ORIENTATION, displayRotation); // 设置图像旋转角度

cameraCaptureSession.setRepeatingRequest(builder.build(), null, null);

}

@Override

public void onConfigureFailed(CameraCaptureSession cameraCaptureSession) {

// 失败处理

}

}, null);

逻辑分析:

JPEG_ORIENTATION控制图像在捕获时的旋转角度,确保图像方向正确。setRepeatingRequest启动连续预览请求。

3.2 图像帧的捕获与处理

图像帧的捕获是实现图像分析、人脸识别、图像处理等功能的基础。Android 提供了 ImageReader 类来获取摄像头输出的图像帧,并对其进行访问和处理。

3.2.1 ImageReader的作用与使用方法

ImageReader 是用于接收来自摄像头设备的图像帧的类,支持多种图像格式,如 ImageFormat.YUV_420_888 、 ImageFormat.JPEG 等。

ImageReader imageReader = ImageReader.newInstance(width, height, ImageFormat.YUV_420_888, 2);

imageReader.setOnImageAvailableListener(new ImageReader.OnImageAvailableListener() {

@Override

public void onImageAvailable(ImageReader reader) {

Image image = reader.acquireNextImage();

// 获取图像数据

processImage(image);

image.close();

}

}, null);

逻辑分析:

newInstance创建一个 ImageReader 实例,参数为宽、高、图像格式和最大图像数。setOnImageAvailableListener设置图像帧到达时的回调。acquireNextImage()获取最新的图像帧。

3.2.2 获取图像帧并解析原始数据

以 YUV_420_888 格式为例,图像数据通常由三个平面组成:Y、U、V。

private void processImage(Image image) {

Image.Plane[] planes = image.getPlanes();

ByteBuffer yBuffer = planes[0].getBuffer();

ByteBuffer uBuffer = planes[1].getBuffer();

ByteBuffer vBuffer = planes[2].getBuffer();

int ySize = yBuffer.remaining();

int uSize = uBuffer.remaining();

int vSize = vBuffer.remaining();

byte[] yData = new byte[ySize];

byte[] uData = new byte[uSize];

byte[] vData = new byte[vSize];

yBuffer.get(yData);

uBuffer.get(uData);

vBuffer.get(vData);

// 进一步处理 yData, uData, vData ...

}

逻辑分析:

- 每个图像帧包含多个

Plane,分别对应 Y、U、V 数据。 - 通过

getBuffer()获取每个 Plane 的字节数据。 - 将数据复制到

byte[]中以便后续处理。

3.2.3 图像帧的格式与数据结构解析

YUV_420_888 是一种灵活的图像格式,常用于图像处理。它支持子采样,通常为 4:2:0 格式,即 Y 通道全分辨率,U/V 通道为 1/4 分辨率。

graph TD

A[Y Plane] --> B[Width x Height]

C[U Plane] --> D[Width/2 x Height/2]

E[V Plane] --> F[Width/2 x Height/2]

说明:

- Y 平面存储亮度信息,U/V 平面存储色度信息。

- 由于 U/V 平面分辨率较低,因此总数据量为

Width * Height * 1.5字节。

3.3 YUV图像格式解析与操作

YUV 格式在图像处理中具有重要地位,尤其在摄像头图像处理和视频编码中广泛使用。理解其结构与操作方式,是实现图像处理功能的基础。

3.3.1 YUV与RGB的区别及优势

YUV 和 RGB 是两种常见的颜色表示方式:

| 对比项 | YUV | RGB |

|---|---|---|

| 表示方式 | 亮度 + 色度 | 红绿蓝三原色 |

| 存储效率 | 更高效(适合压缩) | 占用空间大 |

| 视觉感知 | 更符合人眼感知特性 | 直观但冗余度高 |

| 用途 | 视频编码、摄像头图像处理 | 显示、图像编辑 |

优势说明:

- YUV 允许对亮度和色度分别处理,便于压缩和降噪。

- 在摄像头数据传输中,YUV 格式更节省带宽。

3.3.2 常见YUV格式(NV21、YUV_420_888等)

Android 支持多种 YUV 格式,其中最常见的是:

| 格式 | 描述 | 数据排列 |

|---|---|---|

| NV21 | Android 摄像头默认格式 | YYYYYYYY VUVU |

| YUV_420_888 | 通用 YUV 格式 | YYYYYYYY UUU VVV |

| YV12 | 与 NV21 类似,但 U/V 顺序不同 | YYYYYYYY UU VV |

代码解析 NV21 格式:

public void processNV21(byte[] data, int width, int height) {

int ySize = width * height;

byte[] y = new byte[ySize];

byte[] vu = new byte[data.length - ySize];

System.arraycopy(data, 0, y, 0, ySize);

System.arraycopy(data, ySize, vu, 0, vu.length);

// 处理 Y 和 VU 数据

}

逻辑分析:

- NV21 格式中,Y 数据在前,VU 交错排列在后。

- 可以将数据拆分为 Y 和 VU 两个部分进行处理。

3.3.3 YUV数据的提取与内存操作

YUV 数据通常较大,频繁创建和释放内存可能影响性能。使用 ByteBuffer 或 DirectBuffer 可以提高效率。

ByteBuffer buffer = ByteBuffer.allocateDirect(ySize + uvSize);

buffer.put(yData);

buffer.put(uvData);

buffer.flip(); // 准备读取

// 使用 buffer.array() 获取底层字节数组

逻辑分析:

allocateDirect创建直接缓冲区,减少内存拷贝。flip()方法用于切换读写模式。- 可用于图像处理算法中,如灰度化、边缘检测等。

本章内容从预览控件的选择、预览尺寸的设置与适配,到图像帧的捕获与处理,再到YUV格式的解析与操作,层层递进地展示了Android摄像头图像预览与帧捕获的核心技术点。下一章将深入讲解图像处理的具体算法与颜色提取技术。

4. 图像处理与颜色提取技术

在现代Android应用中,图像处理是摄像头开发的核心能力之一。随着移动设备性能的提升,开发者不仅可以进行实时预览和帧捕获,还能对图像进行深度处理,例如颜色提取、滤镜应用、人脸识别等。本章将深入讲解如何利用JNI调用C/C++代码进行图像处理,实现颜色提取算法,并通过OpenCV进行图像增强与颜色空间转换。

4.1 JNI调用C/C++进行图像处理

JNI(Java Native Interface)是Java与本地代码(C/C++)交互的桥梁。在图像处理中,C/C++具有更高的执行效率,尤其是在处理像素级操作时,相比Java语言具有显著优势。

4.1.1 NDK环境搭建与JNI接口设计

要在Android项目中使用JNI,首先需要配置NDK开发环境。

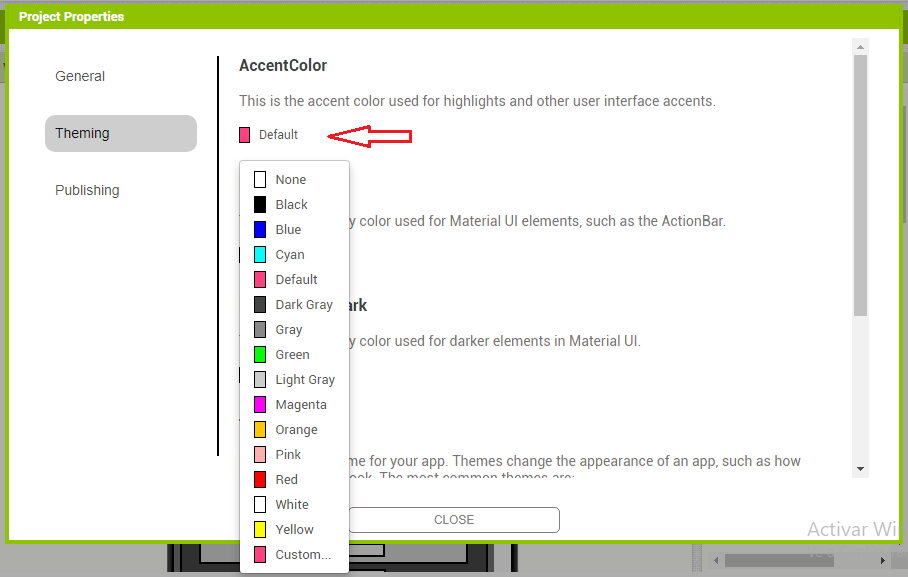

配置NDK环境:

- 打开Android Studio,进入 File > Settings > Appearance & Behavior > System Settings ,勾选 Show advanced settings 。

- 在 Android SDK > SDK Tools 中安装 NDK (Side by side) 。

- 在

build.gradle文件中启用JNI支持:

android {

...

defaultConfig {

...

externalNativeBuild {

cmake {

cppFlags ""

}

}

ndk {

abiFilters 'armeabi-v7a', 'x86_64', 'arm64-v8a', 'x86'

}

}

externalNativeBuild {

cmake {

path "CMakeLists.txt"

version "3.10.2"

}

}

}

JNI接口设计:

创建一个Java类用于调用本地方法:

public class NativeImageProcessor {

static {

System.loadLibrary("native-lib");

}

public native int[] extractCenterColor(byte[] yuvData, int width, int height);

}

在C/C++中声明对应函数:

extern "C" JNIEXPORT jintArray JNICALL

Java_com_example_NativeImageProcessor_extractCenterColor(JNIEnv *env, jobject /* this */,

jbyteArray yuvData, jint width,

jint height) {

// 实现颜色提取逻辑

}

4.1.2 在C/C++中处理图像数据

图像处理通常需要访问原始像素数据。以YUV格式为例,YUV_420_888是最常见的图像格式之一。

示例:从YUV数据中提取中心点颜色

jintArray Java_com_example_NativeImageProcessor_extractCenterColor(JNIEnv *env, jobject /* this */,

jbyteArray yuvData, jint width,

jint height) {

jbyte *data = env->GetByteArrayElements(yuvData, NULL);

int center_x = width / 2;

int center_y = height / 2;

// YUV to RGB 转换

int index = center_y * width + center_x;

int Y = data[index] & 0xFF;

int U = data[width * height + (center_y / 2) * (width / 2) + center_x / 2] & 0xFF;

int V = data[width * height + (width / 2) * (height / 2) + (center_y / 2) * (width / 2) + center_x / 2] & 0xFF;

int R = Y + 1.402 * (V - 128);

int G = Y - 0.344 * (U - 128) - 0.714 * (V - 128);

int B = Y + 1.772 * (U - 128);

R = std::min(std::max(R, 0), 255);

G = std::min(std::max(G, 0), 255);

B = std::min(std::max(B, 0), 255);

jintArray result = env->NewIntArray(3);

jint rgb[3] = { R, G, B };

env->SetIntArrayRegion(result, 0, 3, rgb);

env->ReleaseByteArrayElements(yuvData, data, 0);

return result;

}

代码逻辑分析:

- 从Java传入的YUV数据中提取中心点像素。

- 使用YUV转RGB公式进行颜色转换。

- 将RGB值封装为int数组返回给Java层。

4.1.3 调试与优化本地代码性能

在实际开发中,调试JNI代码非常关键。可以通过以下方式提升性能与调试效率:

- 使用Android Studio的 Native Debug 功能进行断点调试。

- 利用

Log.d()或__android_log_print()在C/C++层输出调试信息。 - 使用

perf工具进行性能分析。 - 减少Java与C++之间的数据拷贝次数,使用

DirectBuffer或MemoryFile提高效率。

4.2 颜色提取算法实现

颜色提取是图像处理中的基础任务之一,广泛应用于取色器、UI主题识别、图像分析等领域。

4.2.1 中心点颜色提取原理

中心点颜色提取是最基础的取色方式,即获取图像中心位置的像素颜色值。

示例:在Java中调用本地方法获取中心颜色

NativeImageProcessor processor = new NativeImageProcessor();

int[] rgb = processor.extractCenterColor(yuvData, width, height);

String hexColor = String.format("#%02X%02X%02X", rgb[0], rgb[1], rgb[2]);

优点与局限:

- 优点:简单快速,适合小范围取色。

- 缺点:无法反映整体颜色分布,受噪点影响大。

4.2.2 平均颜色与加权颜色计算方法

为了获得更准确的颜色代表值,可以使用平均颜色或加权平均颜色。

平均颜色算法:

int totalR = 0, totalG = 0, totalB = 0;

int count = 0;

for (int y = 0; y < height; y += 4) {

for (int x = 0; x < width; x += 4) {

int index = y * width + x;

// YUV转RGB

...

totalR += R;

totalG += G;

totalB += B;

count++;

}

}

int avgR = totalR / count;

int avgG = totalG / count;

int avgB = totalB / count;

加权颜色算法(中心加权):

int weightSum = 0;

for (int y = 0; y < height; y++) {

for (int x = 0; x < width; x++) {

int weight = calculateWeight(x, y, width, height); // 距离中心越近权重越高

...

totalR += R * weight;

totalG += G * weight;

totalB += B * weight;

weightSum += weight;

}

}

4.2.3 实时取色的性能优化策略

实时取色要求高帧率和低延迟,优化策略包括:

| 优化策略 | 说明 |

|---|---|

| 降采样 | 每隔N个像素取一个点,减少计算量 |

| GPU加速 | 使用OpenGL ES进行颜色处理 |

| 多线程 | 将颜色提取任务放入子线程 |

| 数据复用 | 复用YUV数据,避免重复拷贝 |

4.3 颜色空间转换与OpenCV应用

OpenCV是图像处理领域的强大工具,支持多种颜色空间转换与图像增强操作。

4.3.1 YUV转RGB的算法实现

在Android中,摄像头输出的图像通常为YUV_420_888格式,需要转换为RGB才能进行后续处理。

使用OpenCV进行转换:

extern "C" JNIEXPORT void JNICALL

Java_com_example_NativeImageProcessor_YUV2RGB(JNIEnv *env, jobject /* this */,

jbyteArray yuvData, jint width, jint height,

jintArray outRgbData) {

jbyte *yuv = env->GetByteArrayElements(yuvData, NULL);

jint *rgb = env->GetIntArrayElements(outRgbData, NULL);

cv::Mat yuvMat(height + height / 2, width, CV_8UC1, yuv);

cv::Mat rgbMat;

cv::cvtColor(yuvMat, rgbMat, cv::COLOR_YUV2BGR_I420);

memcpy(rgb, rgbMat.data, width * height * 4);

env->ReleaseByteArrayElements(yuvData, yuv, 0);

env->ReleaseIntArrayElements(outRgbData, rgb, 0);

}

转换逻辑说明:

- 将YUV数据封装为OpenCV的Mat对象。

- 使用

cvtColor函数进行颜色空间转换。 - 将结果拷贝到Java层的RGB数组中。

4.3.2 使用OpenCV进行图像增强

OpenCV支持多种图像增强技术,如直方图均衡化、锐化、对比度增强等。

示例:对比度增强

cv::Mat inputMat(...);

cv::Mat outputMat;

double alpha = 1.5; // 对比度增强系数

double beta = 30; // 亮度增强系数

inputMat.convertTo(outputMat, -1, alpha, beta);

示例:边缘锐化

cv::Mat kernel = (cv::Mat_<float>(3, 3) <<

0, -1, 0,

-1, 5, -1,

0, -1, 0);

cv::filter2D(inputMat, sharpenedMat, inputMat.depth(), kernel);

4.3.3 OpenCV在Android中的集成与调用

OpenCV在Android中的集成方式主要有两种:

| 方法 | 说明 |

|---|---|

| 使用OpenCV Manager | 通过Google Play服务加载OpenCV库 |

| 静态集成 | 将OpenCV库打包进APK中,适合离线环境 |

集成步骤:

- 下载OpenCV Android SDK( 官网链接 )。

- 解压后将

opencv-android-sdk/sdk/native/jni目录下的库文件复制到项目jniLibs目录。 - 在Java中加载OpenCV库:

if (!OpenCVLoader.initDebug()) {

Log.e("OpenCV", "Initialization failed");

} else {

Log.d("OpenCV", "Initialized");

}

示例:使用OpenCV进行人脸检测

CascadeClassifier faceDetector = new CascadeClassifier("haarcascade_frontalface_alt.xml");

Mat imageMat = new Mat();

Utils.bitmapToMat(bitmap, imageMat);

MatOfRect faceDetections = new MatOfRect();

faceDetector.detectMultiScale(imageMat, faceDetections);

总结

本章深入探讨了图像处理中的关键技术,包括JNI调用C/C++代码实现高效处理、颜色提取算法的设计与优化,以及OpenCV在Android平台上的集成与应用。通过这些内容,开发者可以掌握从图像采集到处理、再到颜色分析的完整流程,为构建高性能图像处理应用打下坚实基础。后续章节将继续深入探讨摄像头资源管理与性能优化策略。

5. 摄像头资源管理与性能优化

在Android摄像头开发中,资源管理和性能优化是决定应用稳定性和用户体验的关键环节。不当的资源管理可能导致内存泄漏、应用崩溃,而性能不佳则会直接影响帧率、预览流畅度和图像处理效率。本章将深入探讨摄像头资源的释放策略、线程控制机制、内存优化技巧以及设备兼容性适配方法,帮助开发者构建高性能、稳定可靠的摄像头应用。

5.1 摄像头资源的释放与回收

Android摄像头开发中涉及多个关键资源对象,如 CameraDevice 、 ImageReader 、 CaptureSession 和 Surface 。这些对象占用系统资源较多,若未及时释放,将导致内存泄漏和资源耗尽。

5.1.1 释放CameraDevice与CaptureSession

在使用完摄像头后,必须关闭 CameraDevice 和 CameraCaptureSession :

if (cameraDevice != null) {

cameraDevice.close();

cameraDevice = null;

}

if (captureSession != null) {

captureSession.close();

captureSession = null;

}

说明:

- cameraDevice.close() 会断开与物理摄像头的连接。

- captureSession.close() 会释放会话资源,防止后续图像采集。

5.1.2 关闭ImageReader与Surface

ImageReader 是用于接收图像帧的关键对象,其内部维护图像缓冲区:

if (imageReader != null) {

imageReader.setOnImageAvailableListener(null, null);

imageReader.close();

imageReader = null;

}

同时,若使用了 SurfaceTexture 或 SurfaceView ,也应手动释放:

if (surfaceTexture != null) {

surfaceTexture.release();

surfaceTexture = null;

}

5.1.3 避免资源泄露与内存溢出

建议在 onPause() 或 onDestroy() 中统一释放资源,并使用 Android Studio 的 Memory Profiler 检测内存泄漏情况。

5.2 线程安全与并发控制

摄像头操作通常涉及主线程和后台线程的协作,线程管理不当容易引发同步问题或UI卡顿。

5.2.1 Android中的多线程模型

Android主线程负责UI渲染,不能执行耗时操作。图像采集、处理应放在后台线程中处理。

5.2.2 使用HandlerThread与CameraHandler

通过 HandlerThread 创建专用线程处理摄像头操作:

HandlerThread handlerThread = new HandlerThread("CameraBackground");

handlerThread.start();

Handler cameraHandler = new Handler(handlerThread.getLooper());

该 cameraHandler 可用于异步执行打开摄像头、图像处理等任务。

5.2.3 同步机制与线程间通信

可使用 synchronized 或 ReentrantLock 保证多线程访问共享资源的线程安全。例如:

private final Object lock = new Object();

private boolean isProcessing = false;

public void processImage(Image image) {

synchronized (lock) {

if (isProcessing) return;

isProcessing = true;

// 图像处理逻辑

isProcessing = false;

}

}

5.3 内存管理与性能优化

图像数据量大,频繁创建与销毁对象会增加GC压力,影响性能。

5.3.1 图像数据的内存分配与释放

使用 ImageReader 接收图像帧时,应确保及时关闭 Image 对象:

imageReader.setOnImageAvailableListener(new ImageReader.OnImageAvailableListener() {

@Override

public void onImageAvailable(ImageReader reader) {

Image image = reader.acquireNextImage();

// 处理图像数据

image.close(); // 必须调用,否则内存泄漏

}

}, cameraHandler);

5.3.2 减少GC压力与内存复用策略

避免在图像处理中频繁创建对象。例如,使用 ByteBuffer 缓存或复用 Bitmap :

private Bitmap reuseBitmap = Bitmap.createBitmap(width, height, Bitmap.Config.ARGB_8888);

public void updateBitmap(byte[] data) {

// 将YUV数据转换为RGB并写入reuseBitmap

reuseBitmap.copyPixelsFromBuffer(ByteBuffer.wrap(data));

}

5.3.3 摄像头性能调优与帧率控制

可通过设置 CaptureRequest 控制帧率:

CaptureRequest.Builder captureBuilder = cameraDevice.createCaptureRequest(CameraDevice.TEMPLATE_PREVIEW);

captureBuilder.set(CaptureRequest.CONTROL_AE_TARGET_FPS_RANGE, new Range<>(30, 30));

这将限制帧率为30FPS,避免设备过热或耗电过快。

5.4 设备兼容性与适配策略

不同设备的摄像头硬件和系统实现存在差异,需动态检测并适配。

5.4.1 不同设备摄像头特性差异

不同设备支持的摄像头功能、分辨率、帧率、格式等可能不同。可通过 CameraCharacteristics 查询:

CameraCharacteristics characteristics = cameraManager.getCameraCharacteristics(cameraId);

StreamConfigurationMap map = characteristics.get(CameraCharacteristics.SCALER_STREAM_CONFIGURATION_MAP);

Size[] previewSizes = map.getOutputSizes(SurfaceTexture.class);

5.4.2 检测设备特性并动态适配

根据设备能力动态选择合适的预览尺寸和帧率:

List<Size> supportedSizes = Arrays.asList(previewSizes);

Size optimalSize = supportedSizes.stream()

.filter(size -> size.getWidth() == 1280 && size.getHeight() == 720)

.findFirst()

.orElse(previewSizes[0]);

5.4.3 兼容旧版API与厂商定制系统

对于低于Android 6.0的设备,需回退到Camera1 API。可使用反射判断API级别:

if (Build.VERSION.SDK_INT >= Build.VERSION_CODES.LOLLIPOP) {

// 使用Camera2 API

} else {

// 回退至Camera1 API

}

部分厂商(如华为、小米)可能对Camera API有定制优化,建议在真实设备上进行兼容性测试。

简介:在Android平台上实现摄像头取色功能,主要是通过 camera2 API获取实时图像,并在底层使用C/C++语言进行高效处理,提升性能与响应速度。本实战教程涵盖权限申请、摄像头初始化、图像帧捕获、像素解析、颜色提取与格式转换等核心步骤,帮助开发者掌握如何在Android应用中实现对摄像头画面中心点的颜色识别。内容还涉及JNI调用、资源释放与兼容性处理,适用于图像识别、调色工具等应用场景。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)