python电商评论情感分析平台 Flask框架 NLP情感分析+LDA主题分析+Bayes Echarts可视化 源码✅

python电商评论情感分析平台 Flask框架 NLP情感分析+LDA主题分析+Bayes Echarts可视化 源码✅

博主介绍:✌全网粉丝50W+,前互联网大厂软件研发、集结硕博英豪成立软件开发工作室,专注于计算机相关专业项目实战6年之久,累计开发项目作品上万套。凭借丰富的经验与专业实力,已帮助成千上万的学生顺利毕业,选择我们,就是选择放心、选择安心毕业✌

> 🍅想要获取完整文章或者源码,或者代做,拉到文章底部即可与我联系了。🍅🍅感兴趣的可以先收藏起来,点赞、关注不迷路,大家在毕设选题,项目以及论文编写等相关问题都可以给我留言咨询,希望帮助同学们顺利毕业 。🍅

1、毕业设计:2026年计算机专业毕业设计选题汇总(建议收藏)✅

1、项目介绍

技术栈:python语言、Flask框架、MySQL数据库、Echarts可视化、HTML、评论多维度分析、NLP情感分析、LDA主题分析、Bayes评论分类

意义:用“爬虫+NLP+可视化”轻量级组合打通“采评论-做情感-挖主题-看图表”闭环,一键洞察商品口碑,适合毕设、电商运营或品牌舆情监控。

研究背景:电商评论数据爆炸,商家需手动逐条翻看,效率低且易遗漏关键信息;消费者也缺少直观、可视的口碑参考。

研究意义:系统开源、部署简单,高校可作文本挖掘课程案例,商家可嵌入客服后台,个人可挂云服务器练手,实现学术与商业双重落地。

2、项目界面

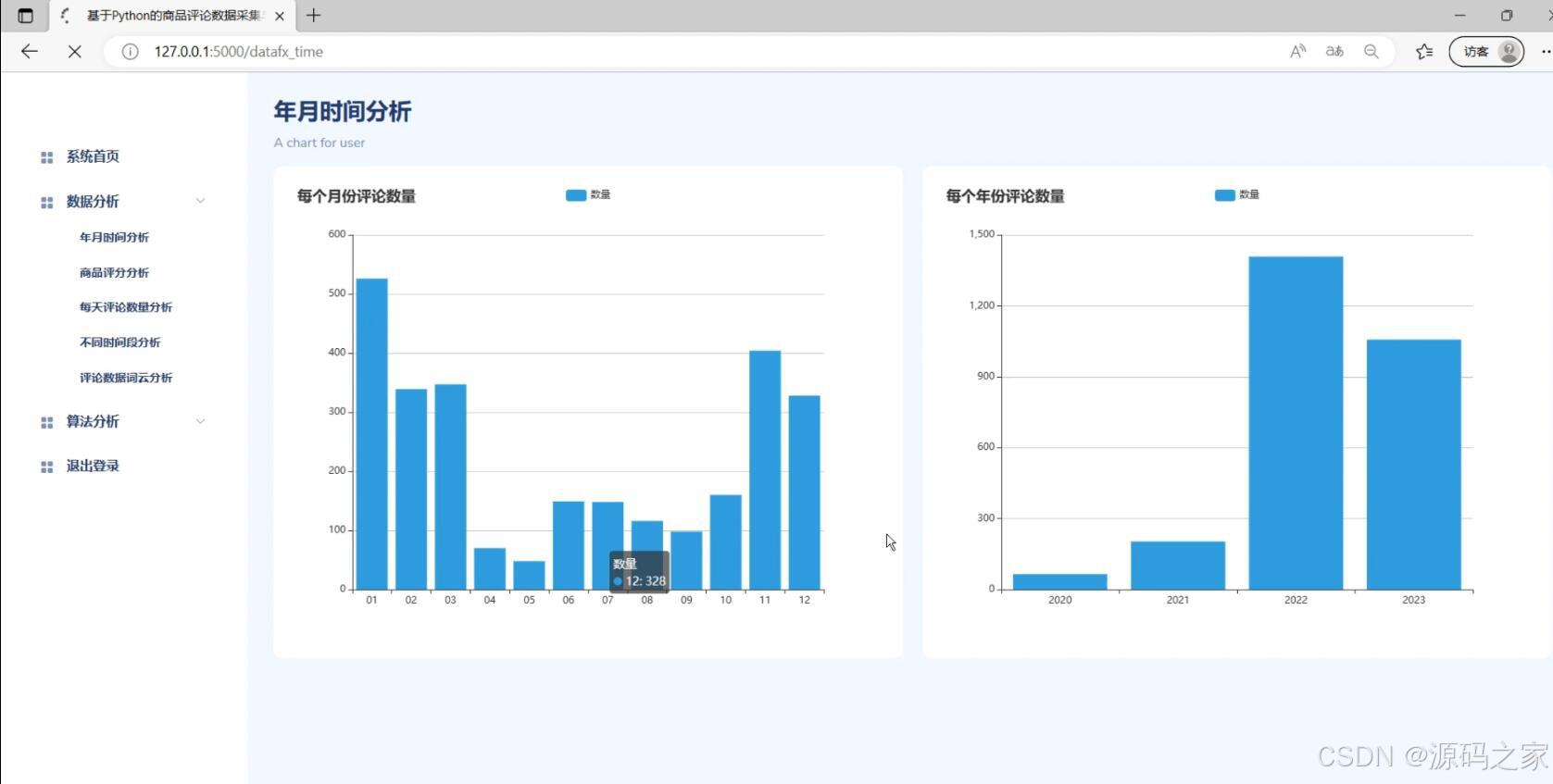

(1)评论数据时间分析

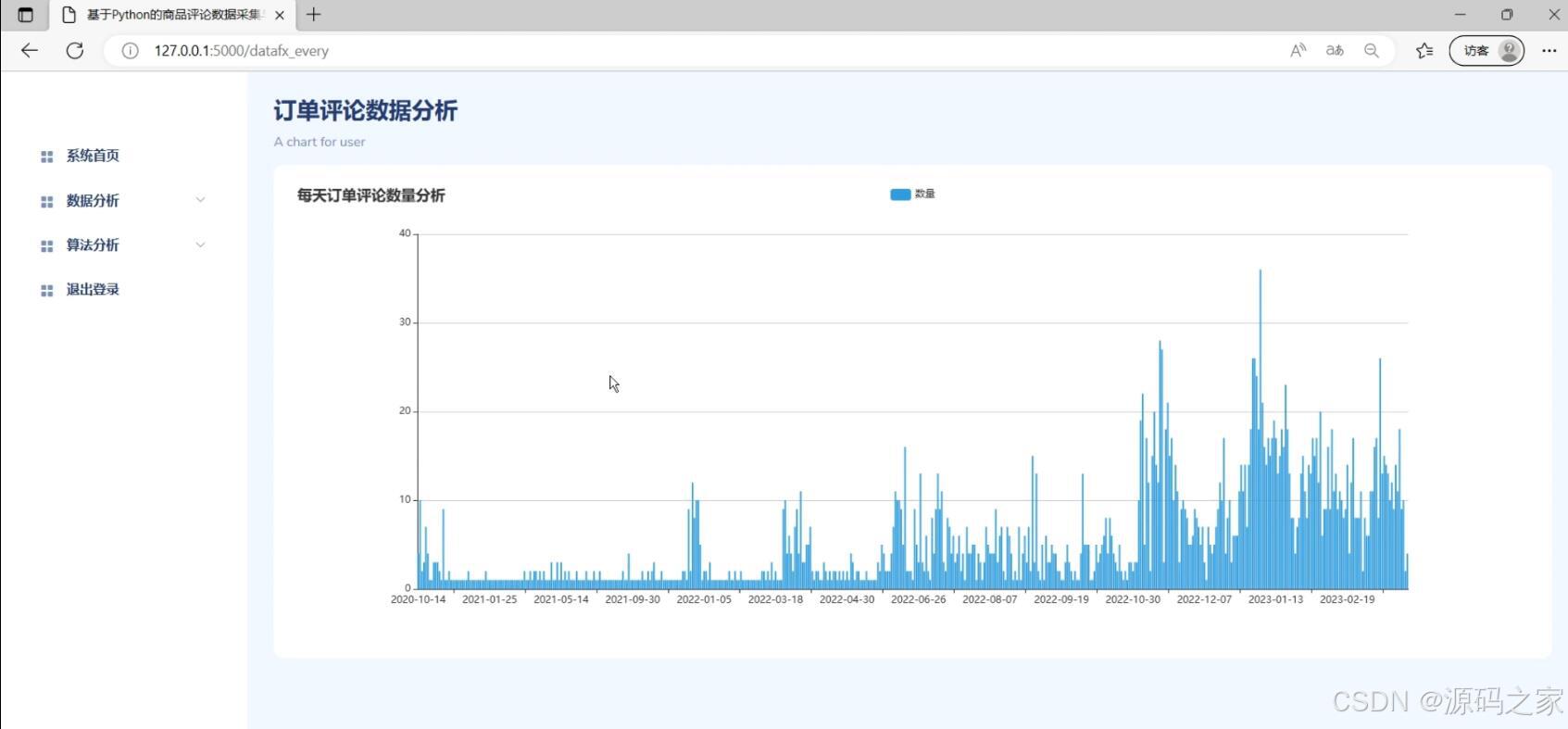

(2)订单评论数据分析

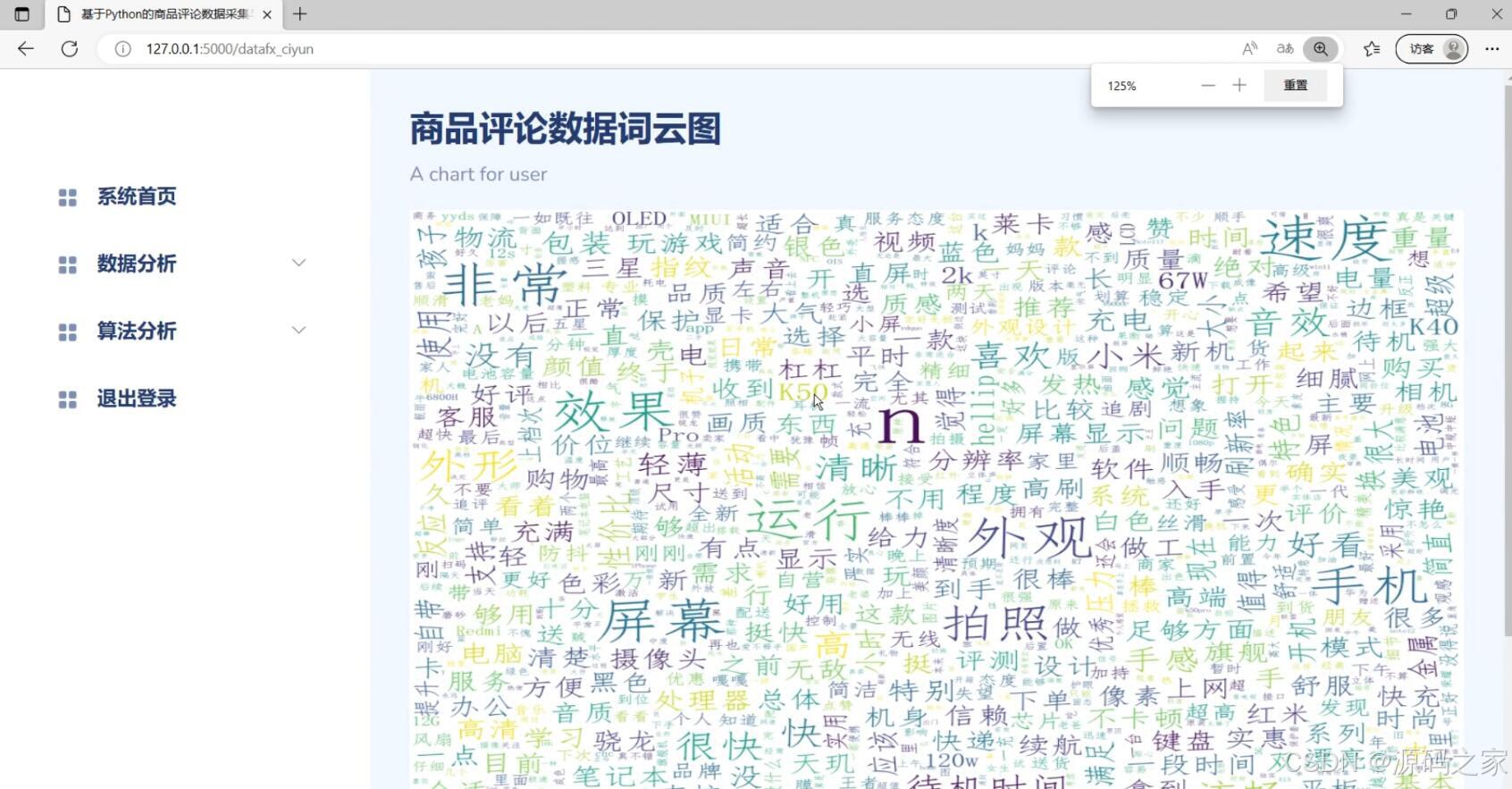

(3)商品评论数据词云图分析

(4)商品评论数据

(5)NLP评论情感分析

(6)LDA评论数据主题分析

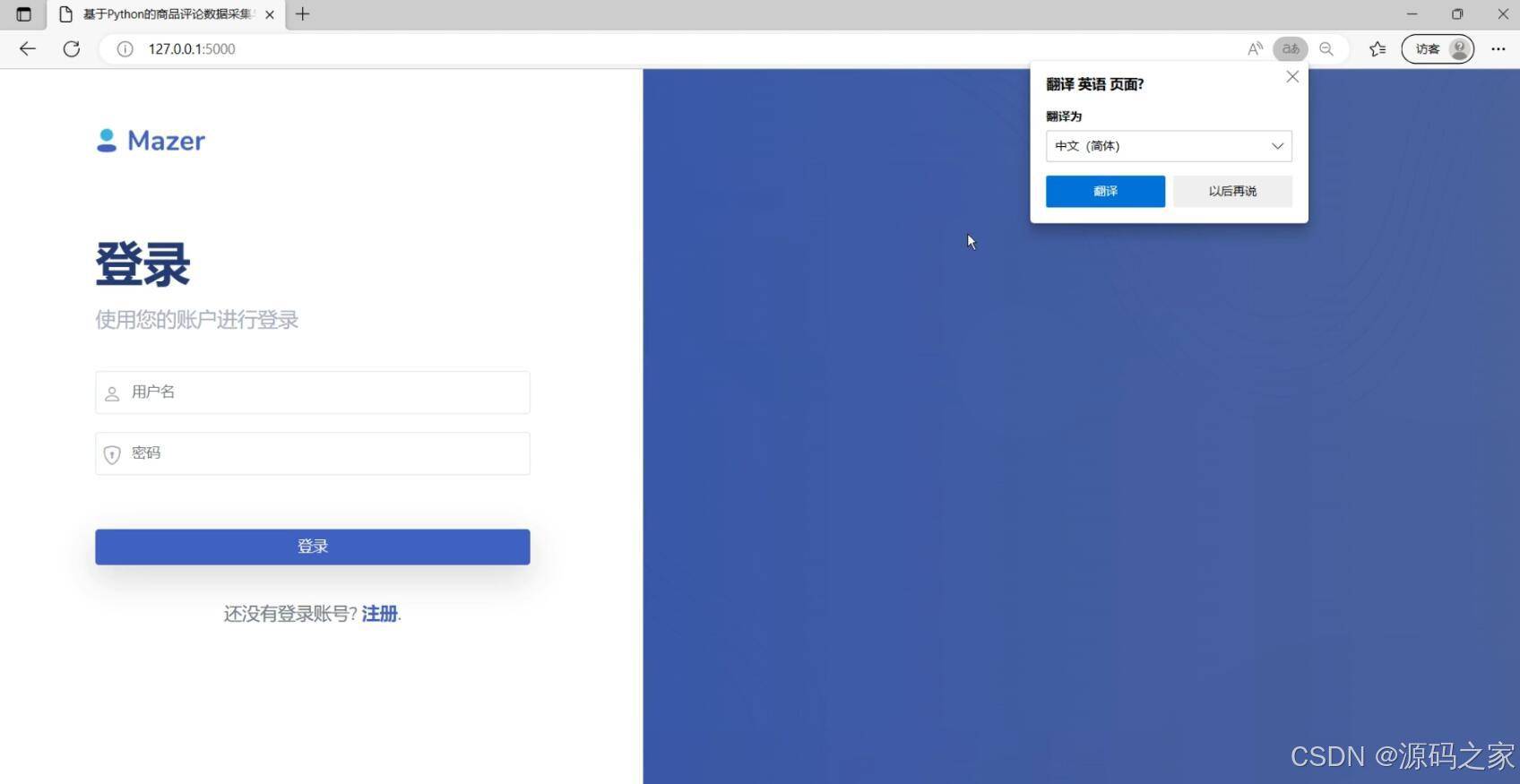

(7)注册登录界面

3、项目说明

关键词:评论爬虫、情感分析、LDA主题、Bayes分类、Echarts大屏、Flask全栈、毕业设计源码

系统采用Flask MVC架构,requests定时抓取京东/淘宝商品评论,自动去重后存入MySQL;NLTK+SnowNLP完成情感极性打分,LDA挖掘隐含主题,Bayes实现正/中/负三分类,结果写回数据库。前端纯HTML+JS与ECharts联动,实时渲染评论趋势、情感占比、主题词云、Bayes分布等大屏,支持按商品、时间、星级自由筛选,一键导出PNG与CSV。后台基于Flask-Admin可人工校正评论标签、重跑模型,保证数据合规与模型时效。注册登录模块保存个人查询与收藏,支持回测与分享。整套代码完全开源、注释详尽,Dockerfile已提供,5分钟可上线云服务器,是文本挖掘、软件工程、电商运营等专业毕业设计的优质蓝本,也可扩展为品牌舆情战情室、客服差评预警、直播弹幕情感监控等商业场景。

4、核心代码

import pandas as pd

import jieba

import pymysql

import re

sql = 'select id,nickname, score, content, productColor, creationTime from data '

con = pymysql.connect(host='127.0.0.1', user='root', passwd='123456', port=3306, db='comment', charset='utf8mb4')

df = pd.read_sql(sql, con)

postive = pd.read_sql(sql, con)

postive = postive[postive['score'] == 5].drop_duplicates()

print(postive)

negtive = pd.read_sql(sql, con)

negtive = negtive[negtive['score'] == 1].drop_duplicates()

print(negtive)

# 文本去重(文本去重主要是一些系统自动默认好评的那些评论 )

# 文本分词

mycut = lambda s: ' '.join(jieba.cut(s)) # 自定义分词函数

po = postive.content.apply(mycut)

ne = negtive.content.apply(mycut)

# 停用词过滤(停用词文本可以自己写,一行一个或者用别人整理好的,我这是用别人的)

with open(r'stopwords.txt', encoding='utf-8') as f: #这里的文件路径最好改成自己的本地绝对路径

stop = f.read()

stop = [' ', ''] + list(stop[0:]) # 因为读进来的数据缺少空格,我们自己添加进去

po['1'] = po[0:].apply(lambda s: s.split(' ')) # 将分词后的文本以空格切割

po['2'] = po['1'].apply(lambda x: [i for i in x if i not in stop]) # 过滤停用词

# 在这里我们也可以用到之前的词云图分析

# post = []

# for word in po:

# if len(word)>1 and word not in stop:

# post.append(word)

# print(post)

# wc = wordcloud.WordCloud(width=1000, font_path='simfang.ttf',height=800)#设定词云画的大小字体,一定要设定字体,否则中文显示不出来

# wc.generate(' '.join(post))

# wc.to_file(r'..\yun.png')

ne['1'] = ne[0:].apply(lambda s: s.split(' '))

ne['2'] = ne['1'].apply(lambda x: [i for i in x if i not in stop])

from gensim import corpora, models

# 负面主题分析

neg_dict = corpora.Dictionary(ne['2'])

neg_corpus = [neg_dict.doc2bow(i) for i in ne['2']]

neg_lda = models.LdaModel(neg_corpus, num_topics=3, id2word=neg_dict)

# 正面主题分析

pos_dict = corpora.Dictionary(po['2'])

pos_corpus = [pos_dict.doc2bow(i) for i in po['2']]

pos_lda = models.LdaModel(pos_corpus, num_topics=3, id2word=pos_dict)

pos_theme = pos_lda.show_topics()

# 展示主题

pos_theme = pos_lda.show_topics()

# 取出高频词

pattern = re.compile(r'[\u4e00-\u9fa5]+')

pattern.findall(pos_theme[0][1])

pos_key_words = []

for i in range(3):

pos_key_words.append(pattern.findall(pos_theme[i][1]))

pos_key_words = pd.DataFrame(data=pos_key_words, index=['主题1', '主题2', '主题3'])

pos_key_words.to_csv('lda.csv')

🍅✌感兴趣的可以先收藏起来,点赞关注不迷路,想学习更多项目可以查看主页,大家在毕设选题,项目编程以及论文编写等相关问题都可以给我留言咨询,希望可以帮助同学们顺利毕业!🍅✌

5、源码获取方式

🍅由于篇幅限制,获取完整文章或源码、代做项目的,拉到文章底部即可看到个人联系方式。🍅

点赞、收藏、关注,不迷路,下方查看👇🏻获取联系方式👇🏻

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)