小白必看!大模型入门指南:一篇文章让你彻底搞懂大模型本质

小白必看!大模型入门指南:一篇文章让你彻底搞懂大模型本质

1、大模型,究竟是什么?

它本质上是一个超大号的“智能大脑”。想象一下,它吸收了整个互联网上海量的文字、图片、代码、知识… 通过极其复杂的计算(涉及数千亿甚至数万亿个参数,这些参数可以简单理解为人类大脑中神经元的数量级),最终学会理解人类语言、识别万物、甚至创造内容。

2、大模型的定义

大模型是指具有大规模参数和复杂计算结构的机器学习模型。这些模型通常由深度神经网络构建而成,拥有数十亿甚至上万亿个参数。

大模型具有参数量大、训练数据大、计算资源大等特点,拥有解决通用任务、遵循人类指令、进行复杂推理等能力。其设计目的是为了提高模型的表达能力和预测性能,能够处理更加复杂的任务和数据。

大模型 vs.小模型:核心区别

| 维度 | 大模型 | 小模型 |

|---|---|---|

| 参数规模 | 十亿到万亿级(如GPT-3:175B) | 百万到十亿级(如BERT±base:110M) |

| 训练数据 | 海量数据(TB级文本、图像等) | 较小规模(GB级) |

| 计算资源 | 需要分布式GPU/TPU集群训练耗时数周至数月 | 单卡或少量GPU即可训练耗时短 |

| 应用场景 | 通用任务(文本生成、复杂推理、多模态交互) | 专用任务(分类、实体识别、轻量级部署) |

| 部署成本 | 高昂(需云端算力支持,推理延迟高) | 低成本(可嵌入手机、IoT设备) |

| 能力特点 | 涌现能力(如零样本学习、上下文理解) | 依赖任务微调,泛化能力有限 |

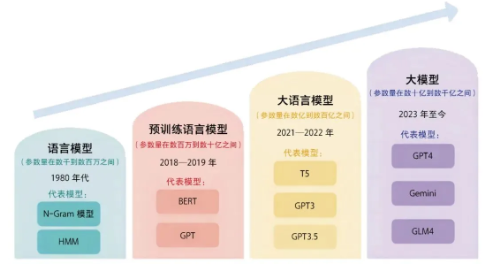

3、大模型的发展历史

大模型起源于语言模型。

萌芽期(1950-2005):以 CNN 为代表的传统神经网络模型阶段。

探索沉淀期(2006-2019):以 Transformer 为代表的全新神经网络模型阶段。

迅猛发展期(2020-至今):以 GPT 为代表的预训练大模型阶段。

4、大模型的特点

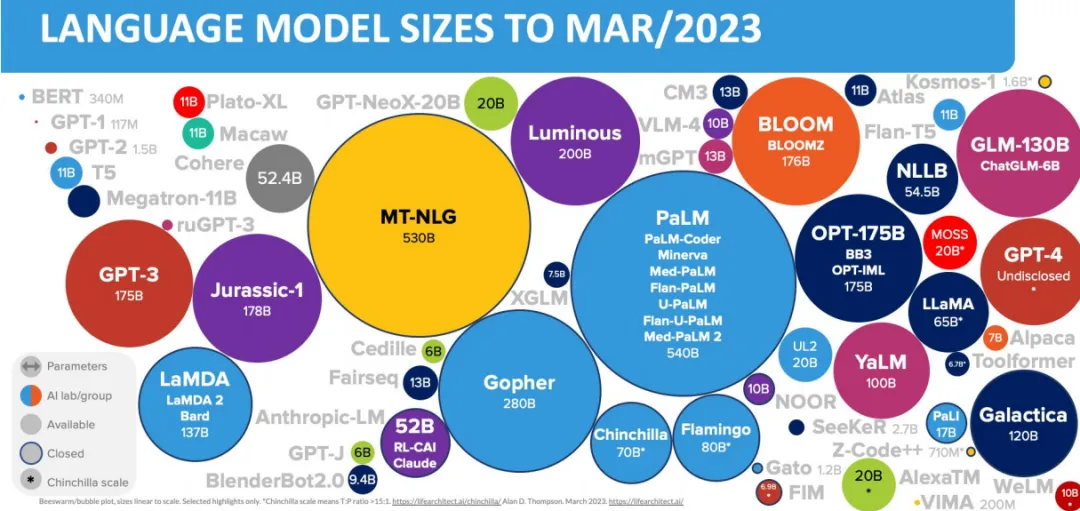

参数规模超大,参数量从十亿(B)到万亿(T)级别,例如GPT-3(175B)、PaLM-2(340B)。

训练数据海量,通常使用TB级文本、图像等多模态数据(如GPT-3训练数据约45TB)。覆盖多语言、多领域(网页、书籍、代码等),降低模型对特定任务的过拟合风险。

计算资源密集,训练成本需数千张GPU/TPU并行训练数周,如GPT-3训练成本约460万美元。单次训练碳排放可达数百吨(如Bloom模型训练排放25吨CO₂)。

通用任务泛化,无需微调即可完成新任务(如GPT-4直接生成代码)。同一模型处理文本生成、翻译、问答等多种任务(如PaLM-2)。

涌现能力(Emergent Abilities),模型在达到一定规模后突现出设计时未明确编程的能力。

5、大模型能干什么?

聊天对答如流: 像ChatGPT,能陪你谈天说地、答疑解惑,如同一位博学好友。

内容信手拈来: 写文章、编剧本、起标题、生成营销文案、创作诗歌小说… 许多文字工作它都能胜任。

代码生成助手: 描述需求,自动生成程序代码片段,程序员效率倍增。

知识百事通: 基于所学知识回答问题、总结信息、翻译语言。

识图辨万物: 能看懂图片内容,描述场景、识别物体、甚至分析图表数据。

专业领域赋能: 辅助法律文书、医学文献分析、金融报告撰写等,潜力巨大。

6、总结

大模型并非科幻中的魔法书,而是人类智慧与工程奇迹的结晶。

它也真的不是神,大模型本质还是基于概率统计的超级模仿者,正因为此,有时会出现幻觉,一本正经的胡说不道;另外它缺乏真正的认知和情感,更像一个高级的“语言概率游戏大师”;输出内容的好坏很大程度依赖训练数据的质量。

它不会取代人类,但会深刻重塑我们工作与生活的面貌。理解它、善用它、审慎地发展它——面对这位新晋的“超级大脑”,我们正站在一个新时代的门槛上,既充满机遇,也需肩负责任。

那么,如何系统的去学习大模型LLM?

作为一名从业五年的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

由于篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套大模型资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献290条内容

已为社区贡献290条内容

所有评论(0)