AI幻觉终结指南!GCR框架保姆级教程,从原理到实战,收藏这篇就够了!

本文提出一种名为图约束推理(GCR)的新框架,**旨在解决大型语言模型(LLMs)在知识图谱(KGs)推理中存在的知识缺口和幻觉问题**。GCR通过构建KG-Trie索引将KG结构融入LLM解码过程,约束生成忠实于KG的推理路径,并结合轻量级KG专用LLM生成推理路径与假设答案,再利用通用LLM进行归纳推理,最终实现零幻觉、高精度的KG推理,且在未见KG上具有零样本迁移能力。

一、基本信息

- 标题:Graph-constrained Reasoning: Faithful Reasoning on Knowledge Graphs with Large Language Models

- 作者:Linhao Luo, Zicheng Zhao, Gholamreza Haffari, Yuan-Fang Li, Chen Gong, Shirui Pan

- 关键词:Large language models (LLMs), Knowledge graphs (KGs), Faithful reasoning, Graph-constrained decoding, KG-Trie

二、文章概述

本文提出一种名为图约束推理(GCR)的新框架,旨在解决大型语言模型(LLMs)在知识图谱(KGs)推理中存在的知识缺口和幻觉问题。GCR通过构建KG-Trie索引将KG结构融入LLM解码过程,约束生成忠实于KG的推理路径,并结合轻量级KG专用LLM生成推理路径与假设答案,再利用通用LLM进行归纳推理,最终实现零幻觉、高精度的KG推理,且在未见KG上具有零样本迁移能力。

三、研究背景

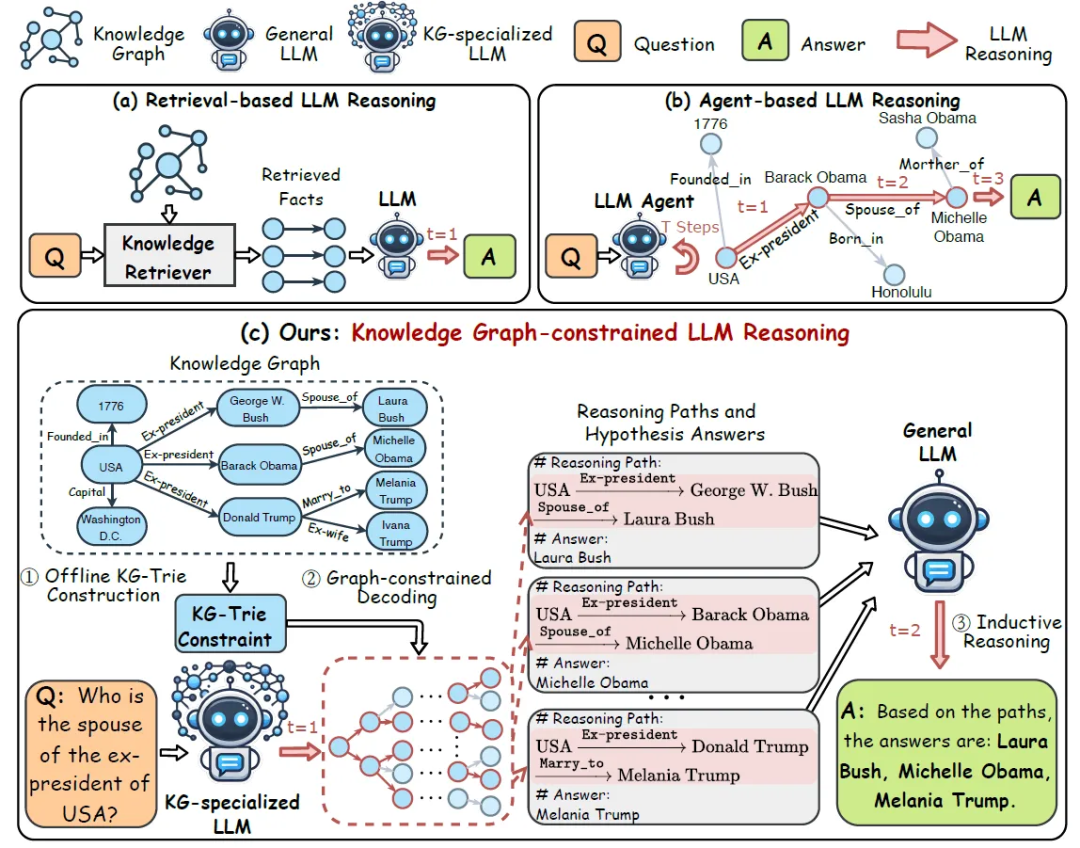

LLMs虽具备强大推理能力,但因知识缺口和幻觉问题导致推理不可靠。知识图谱(KGs)作为结构化知识源被用于增强LLM推理,现有方法分为检索式和智能体式两类:检索式依赖外部检索器,泛化性差;智能体式需多轮交互,计算成本高。两类方法均存在幻觉问题,例如RoG模型推理中仍有33%的幻觉错误。因此,亟需一种能将KG结构与LLM推理深度融合、消除幻觉且高效的推理范式。

四、研究思路

- 提出研究问题:如何通过融合KG结构与LLM解码过程,消除推理幻觉并提升KG推理效率与准确性?

- 构建研究框架:设计GCR框架,包含KG-Trie构建(编码KG推理路径)、图约束解码(生成忠实路径)、归纳推理(整合多路径得出答案)三模块。

- 选择研究方法:采用KG-Trie索引约束LLM解码,结合轻量级KG专用LLM与通用LLM分工协作,通过beam search生成多路径,基于FiD框架归纳推理。

- 分析数据:在WebQSP、CWQ等KGQA数据集上评估性能,对比现有方法,分析效率、幻觉消除率及零样本迁移能力。

- 得出结论:GCR实现SOTA性能,零推理幻觉,高效且可零样本迁移至新KG。

五、研究结果

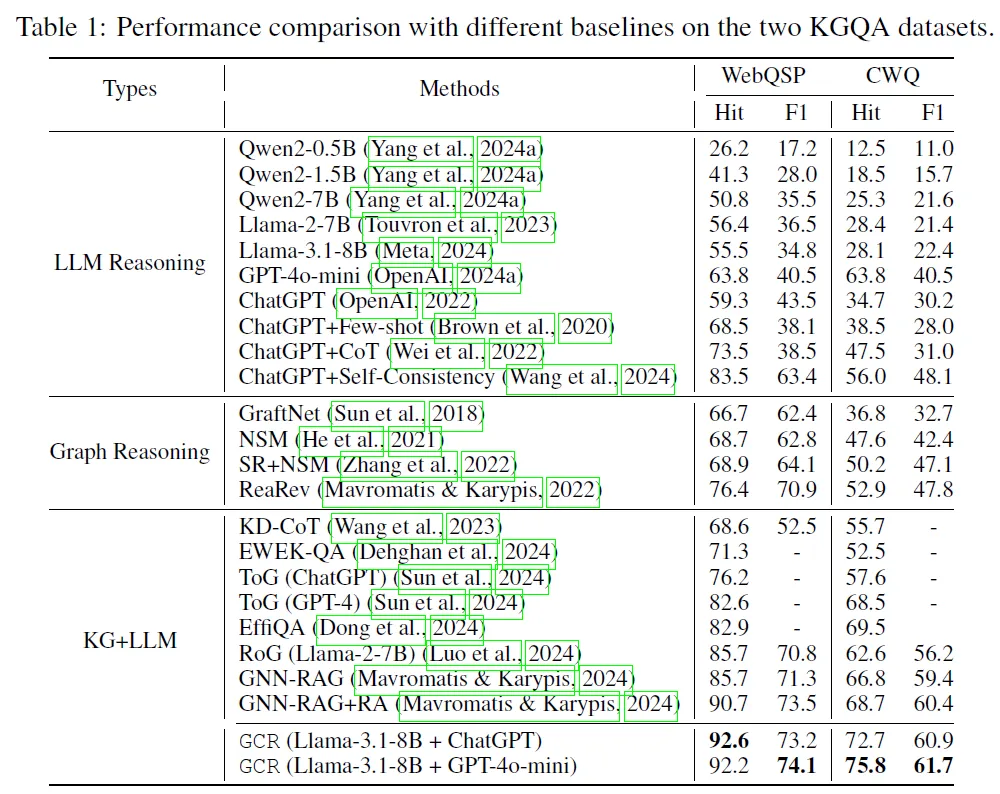

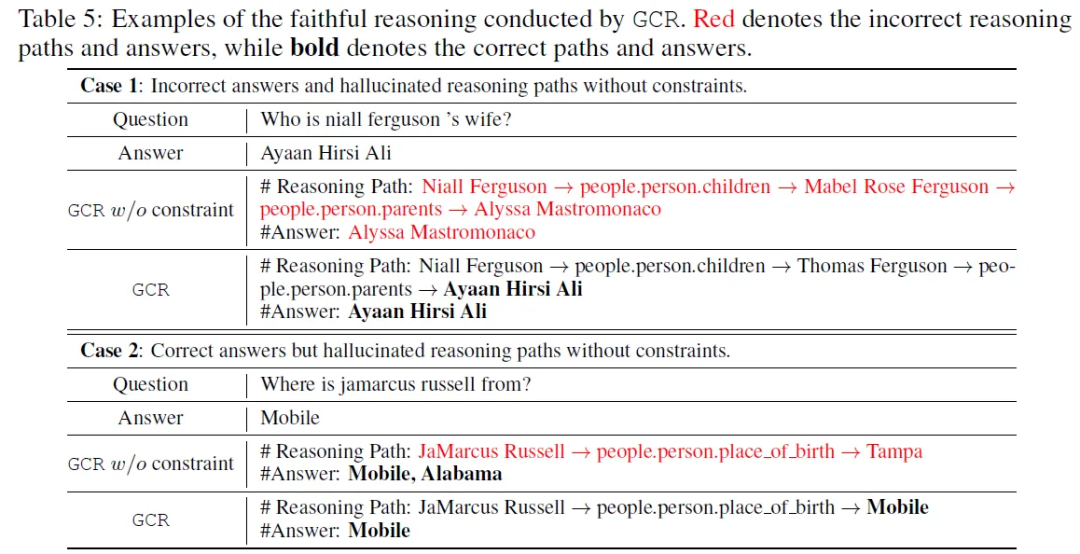

- 在WebQSP和CWQ数据集上,GCR(Llama-3.1-8B + GPT-4o-mini)的Hit指标分别达92.2%和75.8%,F1达74.1%和61.7%,超越现有KG增强LLM推理方法。

- 图约束解码确保100%推理路径忠实于KG,完全消除幻觉;移除约束后,WebQSP忠实推理率降至62.4%,CWQ降至48.1%。

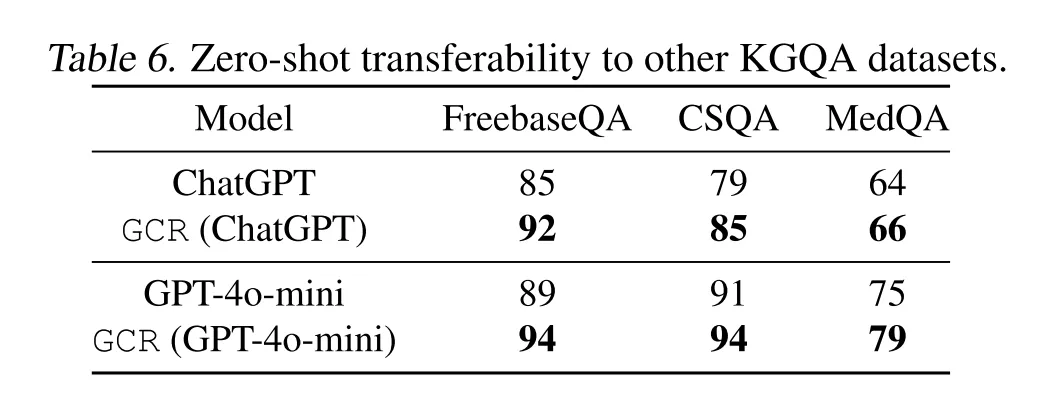

- GCR在FreebaseQA、CSQA、MedQA等未见KG数据集上实现零样本迁移,准确率较纯LLM提升5%-8%。

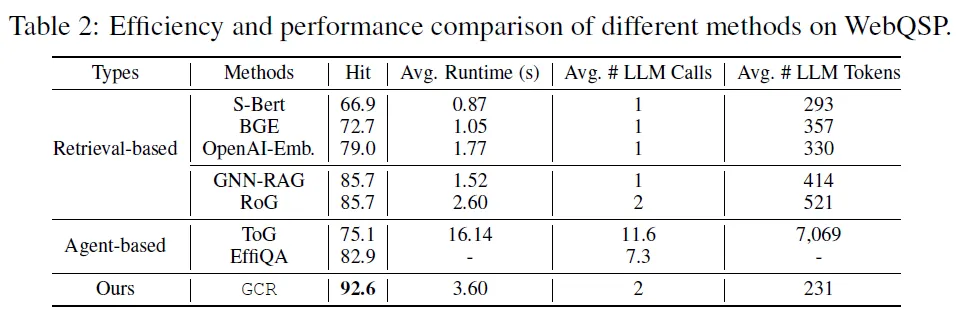

- 效率优于智能体式方法(如ToG平均耗时16.14秒/问),单LLM调用即可生成多路径,平均推理时间3.6秒/问,输入 tokens 数量显著减少。

六、研究结论、不足与展望

- 研究结论:GCR通过KG-Trie约束LLM解码过程,结合KG专用LLM与通用LLM的互补优势,实现了零幻觉、高精度的KG推理,在标准KGQA数据集上性能超越现有方法,并能零样本迁移至新KG,验证了其有效性与泛化性。

- 研究的创新性:1. 提出KG-Trie索引,将KG推理路径编码为前缀树,首次实现LLM解码过程的KG结构约束;2. 设计轻量级KG专用LLM与通用LLM协作范式,兼顾推理忠实性与归纳能力。

- 研究的不足之处:1. 零幻觉定义依赖KG自身正确性,若KG存在错误或缺失,会导致推理偏差;2. 复杂问题需长路径推理时,KG-Trie构建时间与空间成本增加;3. KG专用LLM可能生成无关路径,影响最终答案准确性。

- 研究展望:1. 融合多知识源(如Web数据、文档)交叉验证KG事实,提升推理鲁棒性;2. 结合规划方法分解复杂问题,降低长路径KG-Trie构建成本;3. 优化KG专用LLM路径生成相关性,引入路径质量评估机制;4. 扩展至动态KG与多模态知识融合场景。

- 研究意义:提出了一种结构化知识与LLM推理深度融合的新范式,为解决LLM幻觉问题提供有效途径,推动KG增强LLM推理在高精度、高可靠场景(如医疗、法律)的应用,同时为零样本知识迁移研究提供参考。

现有的大语言模型存在什么问题?

they still struggle with faithful reasoning due to knowl- edge gaps and hallucinations

现有的模型推理还是存在知识缺口和幻觉问题

大模型(LLMs)主要存在以下核心问题:

- **知识缺口与幻觉:**模型训练数据存在时效性和覆盖范围限制,导致对新兴知识或长尾领域的理解不足;推理过程中易生成看似合理但不符合事实的内容(“幻觉”),尤其在知识密集型任务中表现突出。

- **推理忠实性不足:**尽管具备链式推理能力,但推理过程常偏离事实依据,如生成未经验证的关联或虚构证据链,影响决策可靠性。

- **结构化知识利用困难:**难以直接整合知识图谱(KG)等结构化数据,现有检索增强或智能体交互方法存在检索准确性低、图谱遍历效率差等问题。

- **计算成本与效率瓶颈:**复杂推理任务需多轮交互或大规模检索,导致高延迟和资源消耗,难以满足实时应用需求。

这些问题在医疗、法律等对可靠性要求极高的领域尤为关键,推动了GCR等结合结构化知识约束的推理框架研究。

什么是KG-Trie?图约束推理(GCR)?

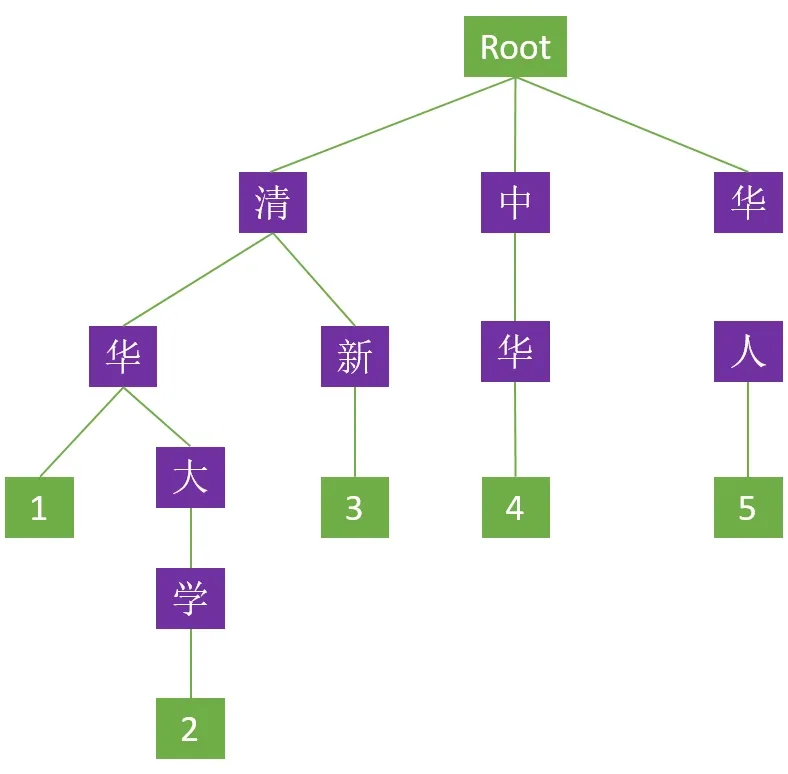

KG-Trie(字典树)

KG-Trie, a trie-based index that encodes KG reasoning paths

KG-Trie是一种基于前缀树(Trie)的数据结构,一种基于字典树的索引,用于将知识图谱(KG)中的推理路径编码为结构化索引。极大程度上压缩了字符串的存储效率,通过编码成Token字典树来压缩Token的消耗,并允许大型语言模型直接在图上进行推理,并生成基于知识图谱的忠实推理路径。

它通过以下步骤构建:

- 首先使用**广度优先搜索(BFS)**从问题实体出发检索L跳内的推理路径

- 将这些路径格式化为字符串并通过LLM的分词器转换为token序列

- 最终构建为前缀树结构。

KG-Trie的核心作用是在LLM解码过程中施加约束,仅允许生成符合KG中有效路径前缀的token序列,从而确保推理路径忠实于知识图谱结构,消除幻觉推理。

该结构支持LLM在常数时间内高效遍历图路径,并可通过预构建或动态生成平衡预处理开销与推理效率,是GCR框架实现零幻觉推理的关键组件。

GCR(Graph-Constrained Reasoning,图约束推理)

graph- constrained reasoning (GCR), a novel framework that bridges structured knowledge in KGs with un- structured reasoning in LLMs.

GCR(Graph-Constrained Reasoning,图约束推理)是一种将知识图谱(KG)的结构化知识与大语言模型(LLM)的非结构化推理能力相结合的新型框架,从而实现准确推理,且无推理幻觉。

其核心创新在于通过 **KG-Trie(一种基于前缀树的索引结构)**将KG的推理路径编码为约束条件,直接集成到LLM的解码过程中,使LLM能够在生成推理路径时严格遵循KG的结构,从而生成忠实于KG的推理路径。

GCR的主要组件包括:

- KG-Trie构建:将KG中的推理路径转换为前缀树结构,作为LLM解码的约束索引,实现高效的图遍历。

- **图约束解码:**使用轻量级KG专用LLM,在KG-Trie约束下生成多条KG接地的推理路径和假设答案,确保推理路径的有效性。

- **图归纳推理:**将生成的多条推理路径输入到强大的通用LLM中,利用其归纳推理能力综合多条路径的证据,输出最终答案。 该框架通过结合KG专用LLM的图推理能力与通用LLM的归纳能力,实现了零推理幻觉、高精度推理,且在未见过的KG上具有零样本泛化能力。

GCR的实现原理

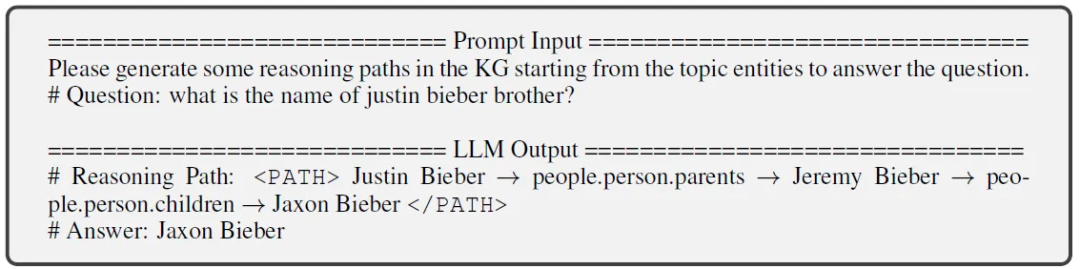

如上图c部分所示,GCR通过将知识图谱(KG)结构融入大语言模型(LLM)的解码过程,实现忠实推理。其核心步骤分为三部分:

- 知识图谱Trie(KG-Trie)构建

- 路径检索:针对输入问题中的实体,通过广度优先搜索(BFS)从KG中提取最多L跳的推理路径(如e0 →r1 →e1 →r2 →e2)。【其中:e代表实体,r代表关系】

- **路径格式化与编码:**将检索到的路径转换为结构化字符串(如 Justin Bieber →people.person.parents →Jeremy Bieber ),并通过LLM的分词器转换为 tokens。

- **Trie索引构建:**使用Trie(前缀树)数据结构存储这些tokens,形成KG-Trie索引,用于约束LLM的解码过程。

- 图约束解码(Graph-Constrained Decoding)

- 轻量级KG专用LLM微调:训练一个轻量级LLM(如Llama-3.1-8B),使其能在KG-Trie约束下生成忠实于KG的推理路径。

- **解码约束:**在LLM生成推理路径时,通过KG-Trie检查每一步生成的token是否为有效路径前缀,仅允许生成KG中存在的路径。

- **假设答案生成:**路径生成完成后,切换至常规解码模式,基于路径生成假设答案。

- 图归纳推理(Graph Inductive Reasoning)

- **多路径生成:**通过束搜索(beam search)并行生成K条推理路径及假设答案(如K=10)。

- **通用LLM归纳推理:**将多路径和假设答案输入强通用LLM(如GPT-4o-mini),利用其归纳能力综合多条路径,输出最终答案。

Incorporating diverse reasoning paths would be beneficial for deliberate thinking and reasoning.

整合不同的推理路径将有助于审慎思考和推理

to take advantage of the GPU parallel computation. Thus, given a question, we adopt graph- constrained decoding to simultaneously generate K reason- ing paths and hypothesis answers with beam search in a single LLM call.

**为了利用GPU并行计算,**因此,给定一个问题,我们采用图约束解码,在单次LLM调用中通过束搜索同时生成K条推理路径和假设答案。

GCR的优势

- 消除推理幻觉,确保忠实性通过KG-Trie直接约束LLM解码过程,确保生成的推理路径完全基于KG事实,实现“零推理幻觉”(实验中忠实推理率达100%)。

- **高效推理与低延迟****KG-Trie索引:**将KG路径压缩为Trie结构,支持常数时间复杂度(O(|Wz|))的路径检索,避免传统方法的多次KG遍历或检索开销。**并行路径生成:**通过GPU并行计算,一次LLM调用即可生成多条路径,无需多轮交互(如Agent-based方法),平均推理时间仅3.6秒(WebQSP数据集)。

- **强泛化能力****零样本迁移至新KG:**KG-Trie可动态适配新KG(如ConceptNet、医疗KG),无需额外训练即可在 unseen KGs 上推理(如MedQA数据集准确率提升4%)。

- **结合专用与通用LLM优势****轻量级KG专用LLM:**专注于KG路径搜索,减少噪声路径;通用LLM:通过归纳多路径提升答案准确性(如GPT-4o-mini综合10条路径后F1值达74.1%)。

- 性能超越现有方法在WebQSP和CWQ等KGQA基准上,GCR的Hit@1指标分别达92.6%和75.8%,超越GNN-RAG、RoG等SOTA方法。

**总结:**GCR通过KG-Trie约束解码与双LLM协作,实现了忠实性、高效性与泛化性的统一,为LLM结合结构化知识推理提供了新范式。

为什么具有推理能力的LLM还是必要的?

通用LLM在GCR框架中承担关键的归纳推理角色。具体表现为:

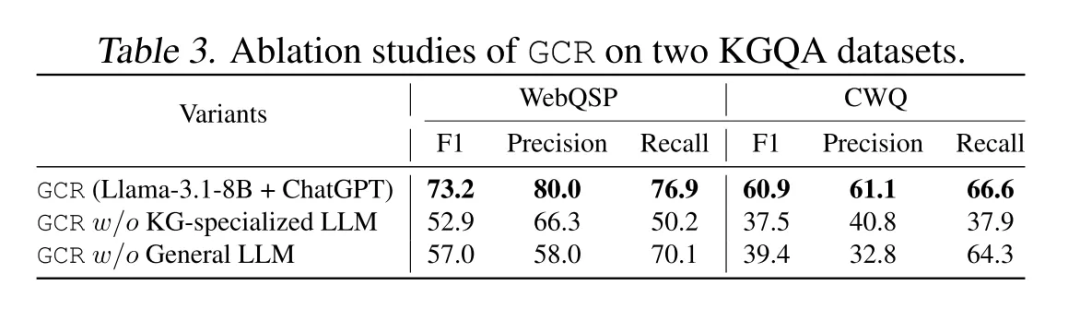

- **多路径整合能力:**KG-specialized LLM生成的多条推理路径可能包含噪声或冗余信息,通用LLM通过归纳推理整合这些路径,提升答案准确性。例如在WebQSP数据集上,移除通用LLM会导致F1分数从73.2降至57.0, precision显著下降(表3)。

- **复杂语义理解:**通用LLM凭借强大的自然语言理解能力,能处理KG-Trie索引未覆盖的复杂问题。如在CWQ数据集上,仅使用KG-specialized LLM的假设答案会因路径语义歧义导致precision仅32.8(表3)。

- **零样本泛化支持:**在跨KG迁移实验中(如从Freebase到ConceptNet),通用LLM无需额外训练即可适配新领域知识,使GCR在CSQA数据集上准确率 提升7.6% (表6)。

需要强调的是,GCR通过 “轻量级KG-specialized LLM路径生成+通用LLM归纳推理” 的双模型架构。既解决了LLM的事实幻觉问题,又保留了其复杂推理优势,实现零推理幻觉与高精度的平衡。

实验结论

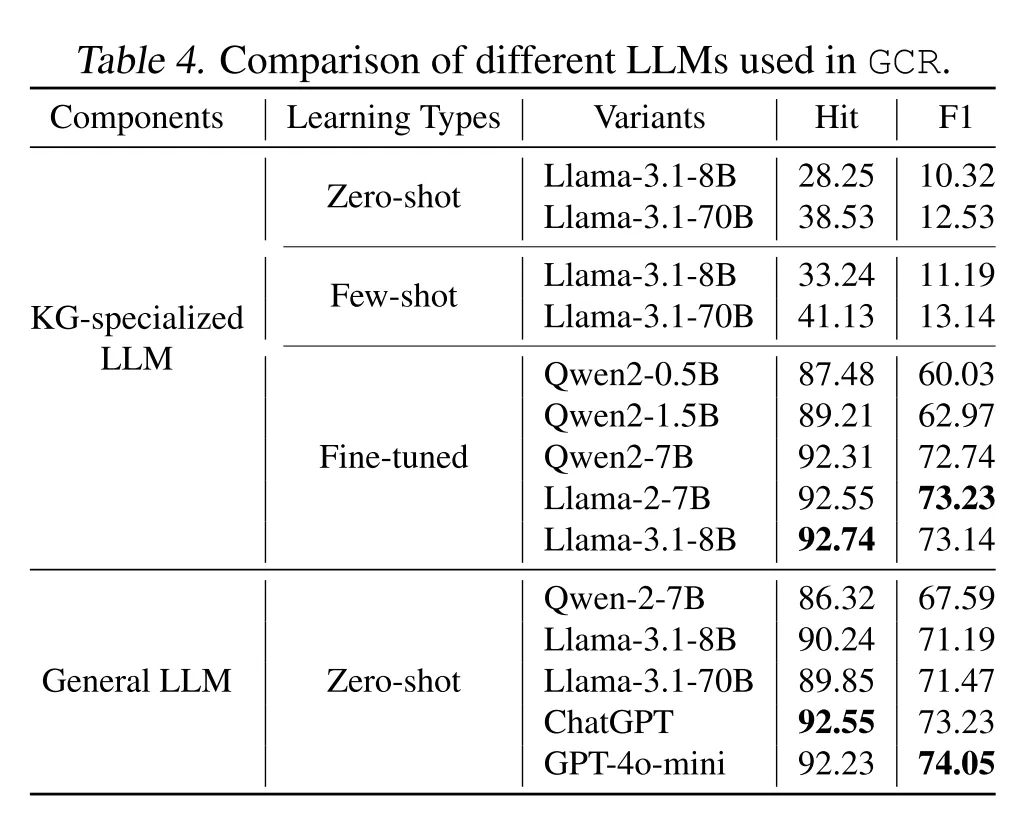

表4的结果表明,轻量级大型语言模型**(0.5B)在微调后性能可以超过大型语言模型(70B)**,这说明微调在增强大型语言模型能力并使其专门用于知识图谱推理方面是有效的。

因此将强大的通用大型语言模型(LLMs)与轻量级知识图谱专用大型语言模型相结合,就可以实现由两者共同驱动的更好推理模型。并且GCR能够很好平衡推理能力和效率问题,通过施加约束,不仅可以消除推理中的幻觉,还能降低推理复杂度,从而实现更高效、更准确的推理。

具体的对比主流推理模型的得分情况如下图所示:

如何安装使用GCR

https://github.com/RManLuo/graph-constrained-reasoning

简要步骤如下:

- 拉仓库

git clone https://github.com/RManLuo/graph-constrained-reasoning.git

- 安装依赖

安装Flash-attention进行快速解码

pip install flash-attn --no-build-isolation

- 构建图索引

建立用于训练的图形索引:scripts/build_graph_index.sh

图形索引将保存在:data/graph_index。

DATA_PATH="RoG-webqsp RoG-cwq"SPLIT=testN_PROCESS=8HOP=2 # 3for DATA_PATH in ${DATA_PATH}; do python workflow/build_graph_index.py --d ${DATA_PATH} --split ${SPLIT} --n ${N_PROCESS} --K ${HOP}done

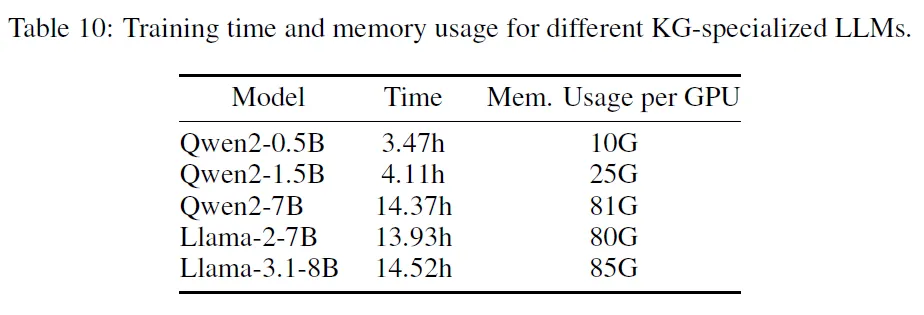

- 训练轻量级KG专业LLM

在脚本中,我们提供了以下模型配置:Qwen2-0.5B/1.5B/7B、Llama-2-7B和Llama-3.1-8B。但它可以轻松扩展到其他LLM。

取消注释相应的“模型配置块”(默认为Llama-3.1-8B)并运行脚本:scripts/train_kg_specialized_llm.sh。

模型将保存在:save_models/${SAVE_NAME}。

各模型配置的训练资源及时间如下:

- 推理

运行脚本:scripts/graph_constrained_decoding.sh

MODEL_PATH=rmanluo/GCR-Meta-Llama-3.1-8B-InstructMODEL_NAME=$(basename "$MODEL_PATH")python workflow/predict_paths_and_answers.py \ --data_path rmanluo \ --d {RoG-webqsp,RoG-cwq} \ --split test \ --index_path_length 2 \ --model_name ${MODEL_NAME} \ --model_path ${MODEL_PATH} \ --k 10 \ --prompt_mode zero-shot \ --generation_mode group-beam \ --attn_implementation flash_attention_2

生成的推理路径和假设答案将保存在:results/GenPaths/{dataset}/{model_name}/{split}。

- 归纳推理图

我们使用通用的 LLM 对多个推理路径和假设答案进行推理,以产生最终答案,而无需额外的训练。 运行:scripts/graph_inductive_reasoning.sh

python workflow/predict_final_answer.py \ --data_path rmanluo \ --d {RoG-webqsp,RoG-cwq} \ --split test \ --model_name {gpt-3.5-turbo, gpt-4o-mini} \ --reasoning_path {REASONING_PATH} \ --add_path True \ -n 10

如何学习大模型 AI ?

我国在AI大模型领域面临人才短缺,数量与质量均落后于发达国家。2023年,人才缺口已超百万,凸显培养不足。随着Al技术飞速发展,预计到2025年,这一缺口将急剧扩大至400万,严重制约我国Al产业的创新步伐。加强人才培养,优化教育体系,国际合作并进,是破解困局、推动AI发展的关键。

但是具体到个人,只能说是:

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

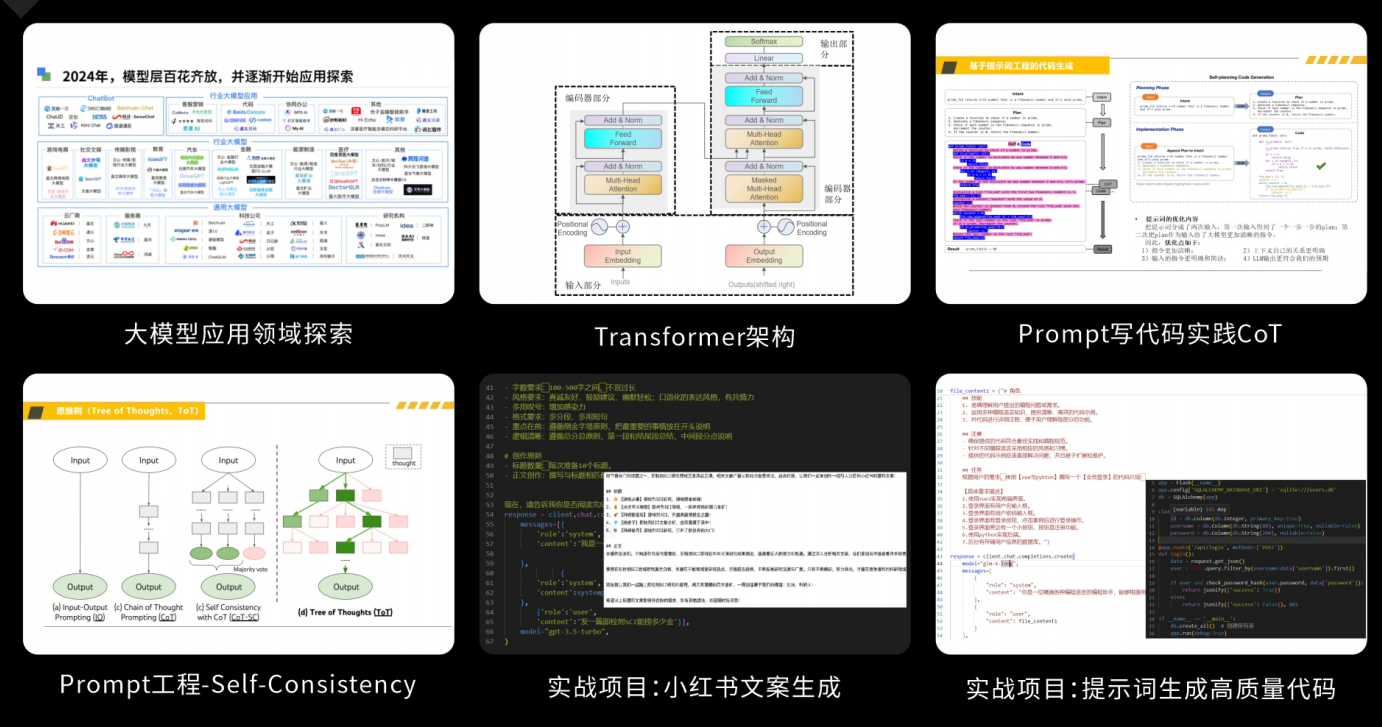

2025最新大模型学习路线

明确的学习路线至关重要。它能指引新人起点、规划学习顺序、明确核心知识点。大模型领域涉及的知识点非常广泛,没有明确的学习路线可能会导致新人感到迷茫,不知道应该专注于哪些内容。

对于从来没有接触过AI大模型的同学,我帮大家准备了从零基础到精通学习成长路线图以及学习规划。可以说是最科学最系统的学习路线。

针对以上大模型的学习路线我们也整理了对应的学习视频教程,和配套的学习资料。

大模型经典PDF书籍

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路!

配套大模型项目实战

所有视频教程所涉及的实战项目和项目源码等

博主介绍+AI项目案例集锦

MoPaaS专注于Al技术能力建设与应用场景开发,与智学优课联合孵化,培养适合未来发展需求的技术性人才和应用型领袖。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

为什么要学习大模型?

2025人工智能大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

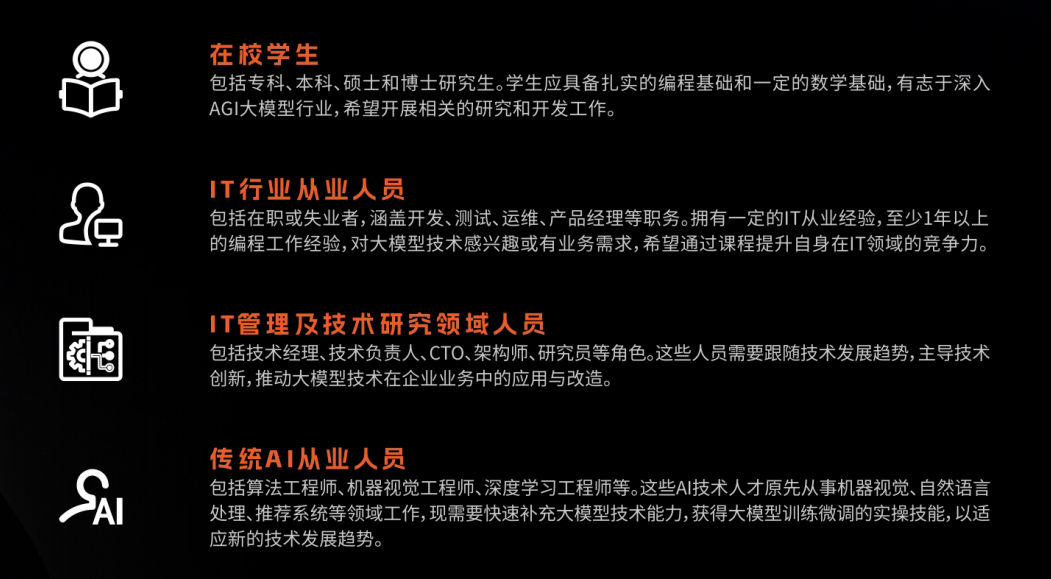

适合人群

- 在校学生:包括专科、本科、硕士和博士研究生。学生应具备扎实的编程基础和一定的数学基础,有志于深入AGI大模型行业,希望开展相关的研究和开发工作。

- IT行业从业人员:包括在职或失业者,涵盖开发、测试、运维、产品经理等职务。拥有一定的IT从业经验,至少1年以上的编程工作经验,对大模型技术感兴趣或有业务需求,希望通过课程提升自身在IT领域的竞争力。

- IT管理及技术研究领域人员:包括技术经理、技术负责人、CTO、架构师、研究员等角色。这些人员需要跟随技术发展趋势,主导技术创新,推动大模型技术在企业业务中的应用与改造。

- 传统AI从业人员:包括算法工程师、机器视觉工程师、深度学习工程师等。这些AI技术人才原先从事机器视觉、自然语言处理、推荐系统等领域工作,现需要快速补充大模型技术能力,获得大模型训练微调的实操技能,以适应新的技术发展趋势。

课程精彩瞬间

大模型核心原理与Prompt:掌握大语言模型的核心知识,了解行业应用与趋势;熟练Python编程,提升提示工程技能,为Al应用开发打下坚实基础。

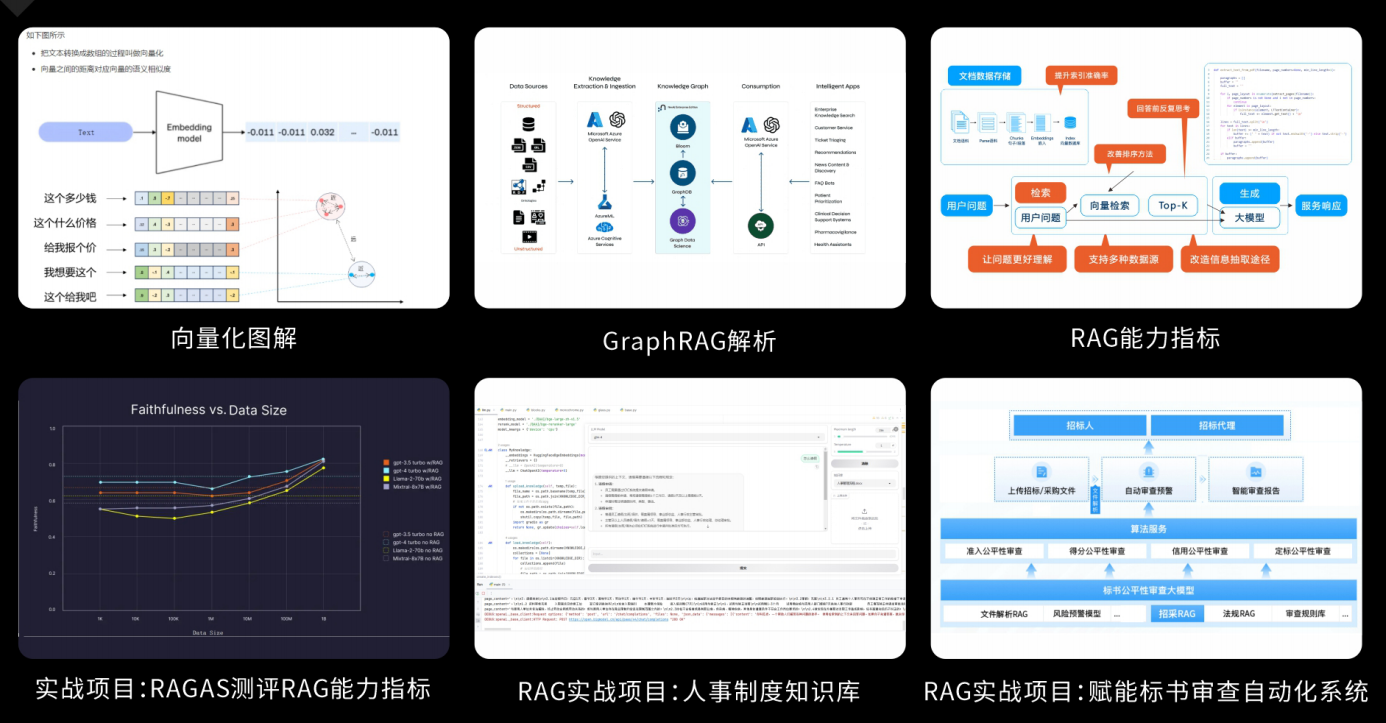

RAG应用开发工程:掌握RAG应用开发全流程,理解前沿技术,提升商业化分析与优化能力,通过实战项目加深理解与应用。

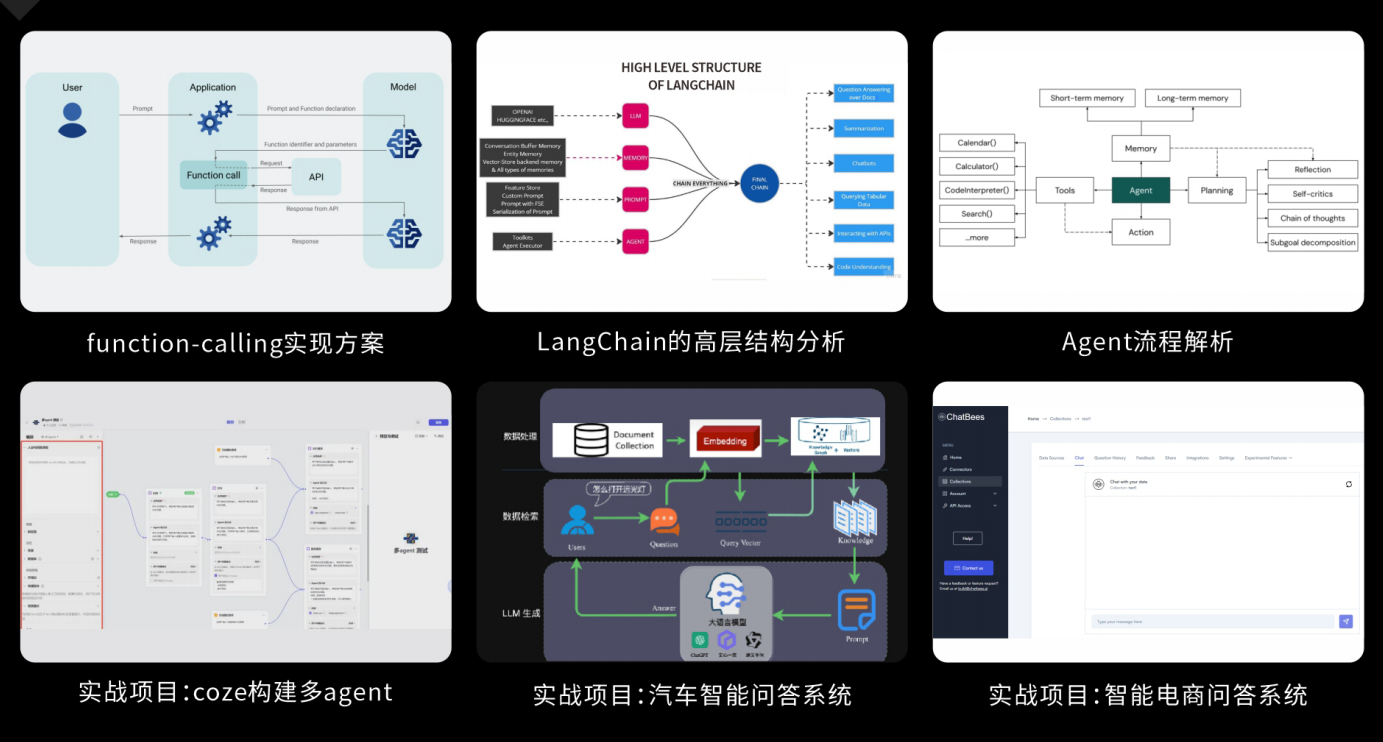

Agent应用架构进阶实践:掌握大模型Agent技术的核心原理与实践应用,能够独立完成Agent系统的设计与开发,提升多智能体协同与复杂任务处理的能力,为AI产品的创新与优化提供有力支持。

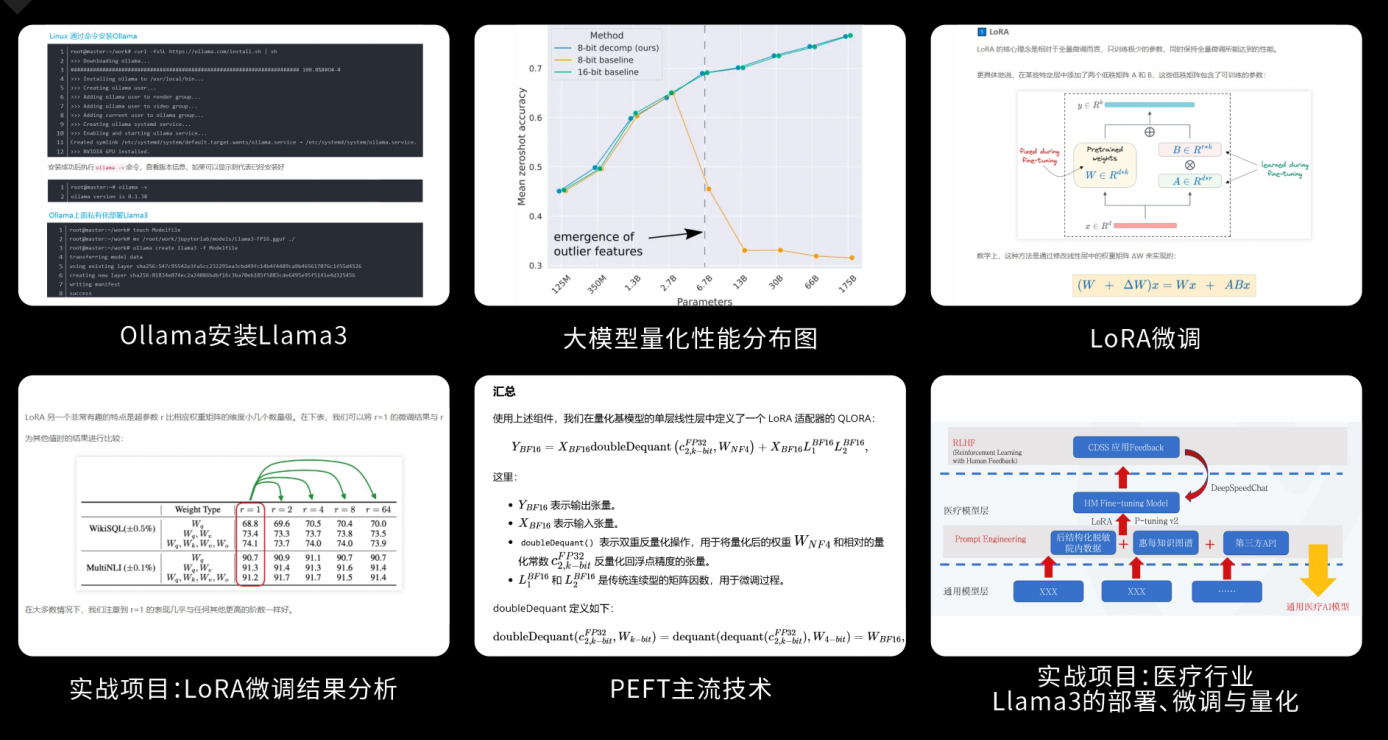

模型微调与私有化大模型:掌握大模型微调与私有化部署技能,提升模型优化与部署能力,为大模型项目落地打下坚实基础。

顶尖师资,深耕AI大模型前沿技术

实战专家亲授,让你少走弯路

一对一学习规划,职业生涯指导

- 真实商业项目实训

- 大厂绿色直通车

人才库优秀学员参与真实商业项目实训

以商业交付标准作为学习标准,具备真实大模型项目实践操作经验可写入简历,支持项目背调

大厂绿色直通车,冲击行业高薪岗位

文中涉及到的完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献502条内容

已为社区贡献502条内容

所有评论(0)