【大模型学习 】一文读懂大规模AI模型:原理、应用与实战

本文探讨了大规模AI模型的核心特点与应用实践。大模型是指基于深度神经网络、拥有数十亿甚至上百亿参数的学习系统,具有海量参数、高计算需求和多模态支持等特性,在NLP、计算机视觉和推荐系统等领域表现卓越。文章通过BART模型文本摘要、ResNet18图像分类和MLP推荐系统等代码示例,展示了具体应用场景。同时指出大模型面临的训练挑战,包括资源消耗大、数据处理复杂等问题,并提供了基于PyTorch分布式

前言

大规模AI模型(常称为“大模型”)正迅速成为人工智能领域的核心驱动力。这类模型拥有数十亿甚至上百亿的参数,能够胜任诸如自然语言生成、图像识别和智能推荐等高复杂度任务。本文将深入探讨大模型的定义、技术特征、典型应用及训练挑战,并辅以实用代码示例,为开发者、研究者和AI爱好者提供实战指南。

什么是大规模AI模型?

大规模AI模型是基于深度神经网络的学习系统,其特点是包含海量参数(通常为十亿级以上),通过大规模数据训练以实现高度抽象和泛化能力。与传统机器学习模型相比,大模型在模式识别、复杂推理和多模态任务中具有明显优势。

核心特性

- 海量参数:如 Grok 3 或 LLaMA 等现代大模型,参数规模可达数十亿,具备更强的学习能力。

- 极高计算需求:训练通常依赖多个 GPU 或 TPU 节点组成的集群,资源成本较高。

- 多模态支持:能够同时处理文本、图像、语音等多种数据类型,支持跨模态理解和生成。

应用场景与代码实战

1. 自然语言处理(NLP)

大模型广泛应用于文本生成、自动摘要、翻译和对话系统。以下是一个使用 BART 模型进行文本摘要的示例:

from transformers import BartForConditionalGeneration, BartTokenizerimport torch# 加载 BART 模型和分词器model_name = "facebook/bart-base"tokenizer = BartTokenizer.from_pretrained(model_name)model = BartForConditionalGeneration.from_pretrained(model_name).to("cuda" if torch.cuda.is_available() else "cpu")# 输入文本text = "人工智能通过自动化和数据分析,正在改变医疗、教育和交通等领域。"inputs = tokenizer(text, return_tensors="pt", max_length=512, truncation=True).to(model.device)# 生成摘要summary_ids = model.generate(inputs["input_ids"], max_length=30, num_beams=4)summary = tokenizer.decode(summary_ids[0], skip_special_tokens=True)print("摘要:", summary)

输出示例:

人工智能通过自动驾驶和智能助手等技术改变生活方式。

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

2. 计算机视觉

在图像分类、目标检测和图像生成等任务中,大模型同样表现卓越。以下代码展示了使用 ResNet18 进行图像分类的过程:

import torchfrom torchvision.models import resnet18, ResNet18_Weightsimport torchvision.transforms as transformsfrom PIL import Image# 确定设备device = torch.device("cuda" if torch.cuda.is_available() else "cpu")# 加载预训练模型model = resnet18(weights=ResNet18_Weights.DEFAULT).eval().to(device)# 获取模型预处理转换方式transform = ResNet18_Weights.DEFAULT.transforms()# 加载图像image = Image.open("C:\\Users\\Administrator\\PyCharmMiscProject\\picture\\images.jpg")input_tensor = transform(image).unsqueeze(0).to(device)# 执行预测with torch.no_grad(): output = model(input_tensor) predicted_class = torch.argmax(output, dim=1).item()print("预测类别ID:", predicted_class)

3. 推荐系统

在个性化内容推荐方面,大模型通过建模用户偏好来提升服务质量。以下为基于简单 MLP 的推荐模型示例:

import torchimport torch.nn as nnfrom torch.utils.data import DataLoaderfrom torchvision.datasets import MNISTfrom torchvision import transforms# 定义推荐模型class Recommender(nn.Module): def __init__(self): super(Recommender, self).__init__() self.network = nn.Sequential( nn.Linear(784, 256), nn.ReLU(), nn.Linear(256, 10), ) def forward(self, x): return self.network(x.view(-1, 784))# 加载 MNIST 数据集dataset = MNIST(root='.', train=True, download=True, transform=transforms.ToTensor())loader = DataLoader(dataset, batch_size=64, shuffle=True)# 训练模型model = Recommender()optimizer = torch.optim.SGD(model.parameters(), lr=0.01)criterion = nn.CrossEntropyLoss()for epoch in range(5): total_loss = 0 for images, labels in loader: outputs = model(images) loss = criterion(outputs, labels) optimizer.zero_grad() loss.backward() optimizer.step() total_loss += loss.item() avg_loss = total_loss / len(loader) print(f"Epoch {epoch + 1}, Average Loss: {avg_loss:.4f}")

训练挑战与技术应对

尽管大模型功能强大,其训练过程却面临以下挑战:

- 资源密集型:训练需要庞大的计算资源与显存。

- 数据处理复杂:高质量大规模数据的收集、清洗与标注成本高昂。

- 优化难度高:大模型参数众多,训练容易陷入局部最优或不稳定状态。

- 部署代价大:模型文件庞大,推理速度慢,部署成本高。

应对策略:分布式训练

分布式训练是解决资源瓶颈和加速训练的重要技术。以下是基于 PyTorch 的分布式数据并行(DDP)训练示例:

import osimport torchimport torch.nn as nnimport torch.distributed as distfrom torch.nn.parallel import DistributedDataParallel as DDPfrom torch.utils.data import DataLoader, Dataset, DistributedSampler# 设置通信环境变量os.environ['MASTER_ADDR'] = 'localhost'os.environ['MASTER_PORT'] = '12345'os.environ['RANK'] = '0'os.environ['WORLD_SIZE'] = '1'# 初始化分布式训练dist.init_process_group(backend='gloo')rank = dist.get_rank()world_size = dist.get_world_size()# 指定设备device = torch.device("cuda" if torch.cuda.is_available() else "cpu")# 自定义简单数据集class RandomDataset(Dataset): def __len__(self): return 100 def __getitem__(self, idx): x = torch.randn(10) y = torch.randint(0, 5, (1,)).item() return x, y# 构建数据加载器dataset = RandomDataset()sampler = DistributedSampler(dataset, num_replicas=world_size, rank=rank, shuffle=True)dataloader = DataLoader(dataset, batch_size=32, sampler=sampler, num_workers=0)# 定义模型class SimpleModel(nn.Module): def __init__(self): super(SimpleModel, self).__init__() self.fc = nn.Linear(10, 5) def forward(self, x): return self.fc(x)# 包装为分布式模型model = SimpleModel().to(device)model = DDP(model, device_ids=[rank] if torch.cuda.is_available() else None)# 定义损失函数和优化器criterion = nn.CrossEntropyLoss()optimizer = torch.optim.SGD(model.parameters(), lr=0.001)# 执行训练循环for epoch in range(5): dataloader.sampler.set_epoch(epoch) for data, target in dataloader: data, target = data.to(device), target.to(device) output = model(data) loss = criterion(output, target) optimizer.zero_grad() loss.backward() optimizer.step() print(f"Epoch {epoch + 1} completed on rank {rank}")# 清理通信资源dist.destroy_process_group()

📦模型压缩与部署优化

由于大模型在参数规模和计算量方面远超传统模型,其部署往往面临推理速度慢、显存需求高等问题。为此,模型压缩技术成为关键解决方案。

常用压缩技术

- 量化(Quantization):将浮点参数压缩为低比特精度(如 INT8),显著减少模型大小和推理时间。

- 剪枝(Pruning):移除冗余参数连接,减少计算量和内存占用。

- 蒸馏(Knowledge Distillation):使用大模型(教师)指导小模型(学生)训练,实现性能传递。

例如使用 torch.quantization 模块可对模型进行动态量化(简略代码):

import torch.quantization# 对模型执行动态量化(以线性层为例)quantized_model = torch.quantization.quantize_dynamic( model, {torch.nn.Linear}, dtype=torch.qint8)

这种方式适用于部署前优化推理效率,尤其适合资源受限的边缘设备或移动端应用。

🌐多模态大模型:跨模态智能的未来

随着 AI 任务复杂度不断提升,单一模态模型已难以满足需求。多模态大模型可同时处理文本、图像、音频等多种数据类型,实现更丰富的理解与生成能力。

应用代表

- CLIP(OpenAI):将图像和文本投影到同一语义空间,实现图文检索与理解。

- Flamingo(DeepMind):支持图像-文本混合输入的问答与生成。

- Grok-Vision:集成视觉和语言能力,支持图像描述、文图问答等任务。

这种模型正推动 AI 向更强的通用智能迈进。以下是典型应用场景:

- 图文内容生成(电商、社交平台)

- 多模态检索(医疗影像+文本病例)

- 智能问答(图像+语言输入)

🔌第三方大模型API接入:快速上手,灵活扩展

对于开发者而言,训练和部署完整的大模型成本高昂,而通过调用第三方 API 即可轻松使用先进能力。这里推荐一个支持多家主流模型的中文聚合平台 —— POLOAPI。

💡 POLOAPI:一个面向开发者的多模型智能接口平台

- 集成 GPT-4、Claude、ERNIE、百川、通义千问、讯飞星火等数十种模型

- 提供统一 RESTful 接口,支持上下文连续、多轮对话、图文混输等复杂任务

- 提供免费试用额度与 Key 管理控制台

- 适用于对接聊天机器人、问答系统、内容生成、智能搜索等业务

例如使用 POLOAPI 接口发送文本生成请求:

import requestsAPI_KEY = "sk-xxx" #复制的令牌填写进去# 修正后的URL(假设使用/v1/chat/completions路径)url = "https://poloai.top/v1/chat/completions"headers = { "Authorization": f"Bearer {API_KEY}", "Content-Type": "application/json"}payload = { "model": "claude-3-5-haiku-20241022", "messages": [ {"role": "user", "content": "请简要总结大规模AI模型的训练难点和优化策略。"} ], "temperature": 0.7, "max_tokens": 300}response = requests.post(url, headers=headers, json=payload)if response.status_code == 200: result = response.json() # 根据实际返回格式调整 reply = result.get("choices", [{}])[0].get("message", {}).get("content", "") print("模型回复:\n", reply)else: print(f"请求失败,状态码:{response.status_code}\n响应内容:{response.text}")

这里的令牌获取,进入第三方大模型API集成平台POLOAPI,点击API令牌,点击添加令牌,填写自定义名称(最好填写模型名称之类的,方便更快的分辨清楚),选择对应的分组,提交,点击刚才提交成功的信息条对应的“复制”按钮,之后把这里得到的令牌填写到上面的API_KEY上,之后对其进行测试,比如,运行以上代码,得到回复则证明接入成功。如图下所示:

你可以根据不同模型选择对应接口路径,参数设置也非常灵活。

通过 POLOAPI,开发者无需部署大模型,即可快速构建各类 AI 应用,极大降低研发门槛,特别适合小型团队或原型项目开发。

✅ 总结

大规模AI模型推动了人工智能从“窄智能”走向“通用智能”。通过掌握其训练流程、优化技巧与应用接口,开发者可快速构建强大的AI系统,满足从科研到产品的多种需求。

好啦,以上就是本期**「大模型高能玩法」的全部内容!想获取更多大模型的独家深度资料?🔥 快关注 我**,一键解锁前沿技术解析、实战案例和进阶秘籍📚!

从零入门大模型:最全学习路线、实战案例与资源汇总(2025最新版)

人工智能大模型(如ChatGPT、DeepSeek等)正驱动着技术变革,掌握相关技术已成为提升竞争力的关键。然而,大模型技术涉及领域广泛,学习曲线陡峭。为了帮助大家系统性地学习和掌握大模型技术,我们整理了一份资源包,旨在提供从理论基础到实践应用的全面支持。

这份资源包包含以下内容:

大模型学习路线与阶段规划: 提供清晰的学习路径,帮助学习者了解不同阶段的学习目标和所需技能。

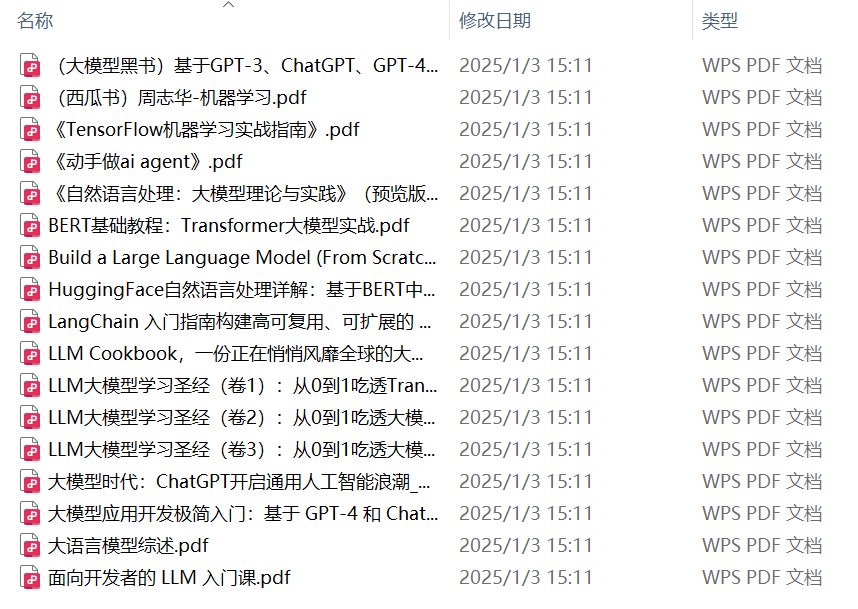

人工智能论文PDF合集: 收录了重要的大模型相关论文,涵盖Transformer架构、预训练模型、微调技术等关键领域,方便深入研究。

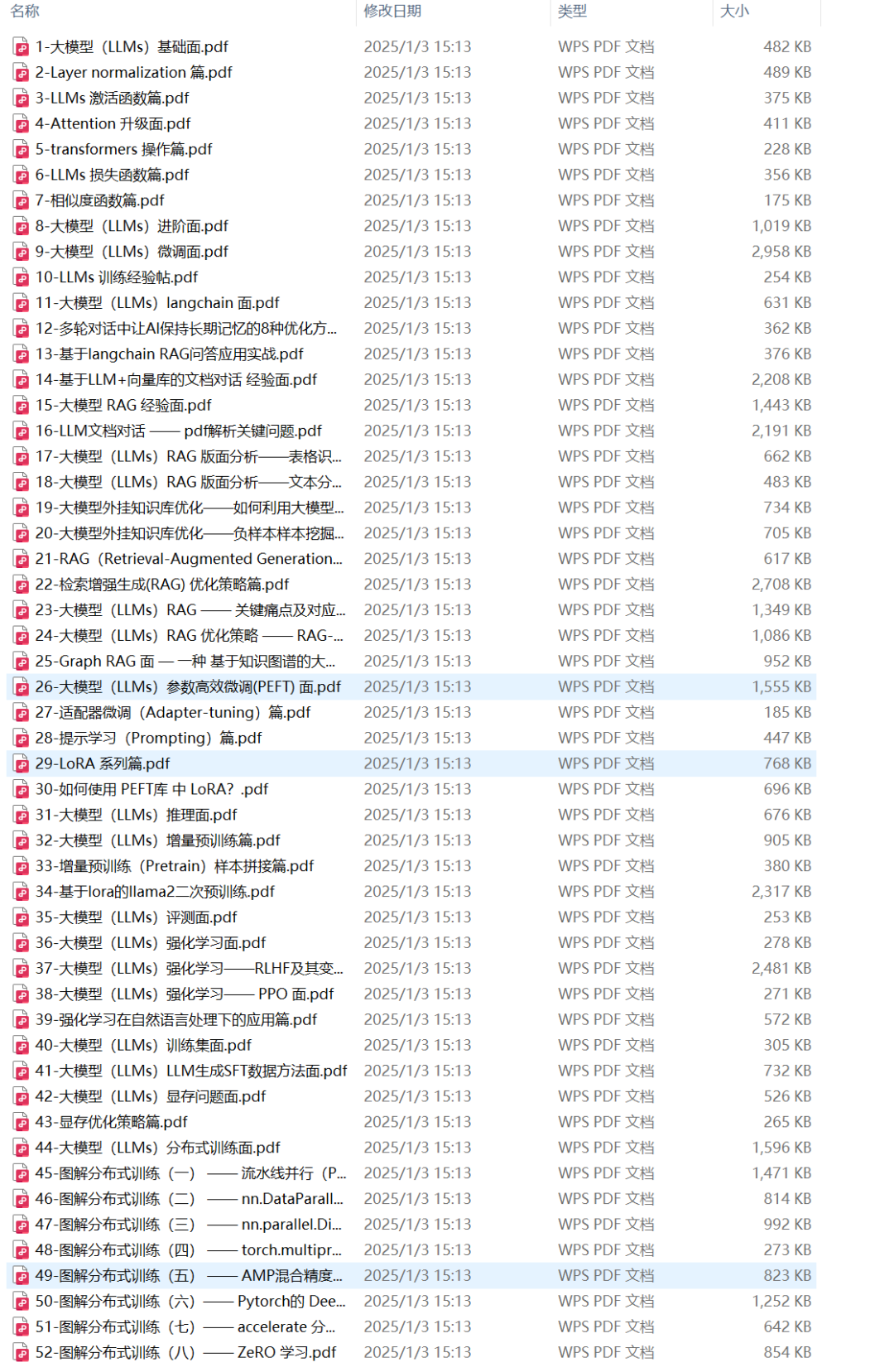

52个大模型落地案例合集: 汇集了不同行业的大模型应用案例,展示了如何将大模型技术应用于实际问题,并提供参考实现思路。

100+本数据科学必读经典书: 涵盖机器学习、深度学习、自然语言处理等领域的基础理论和算法,为理解大模型技术奠定基础。

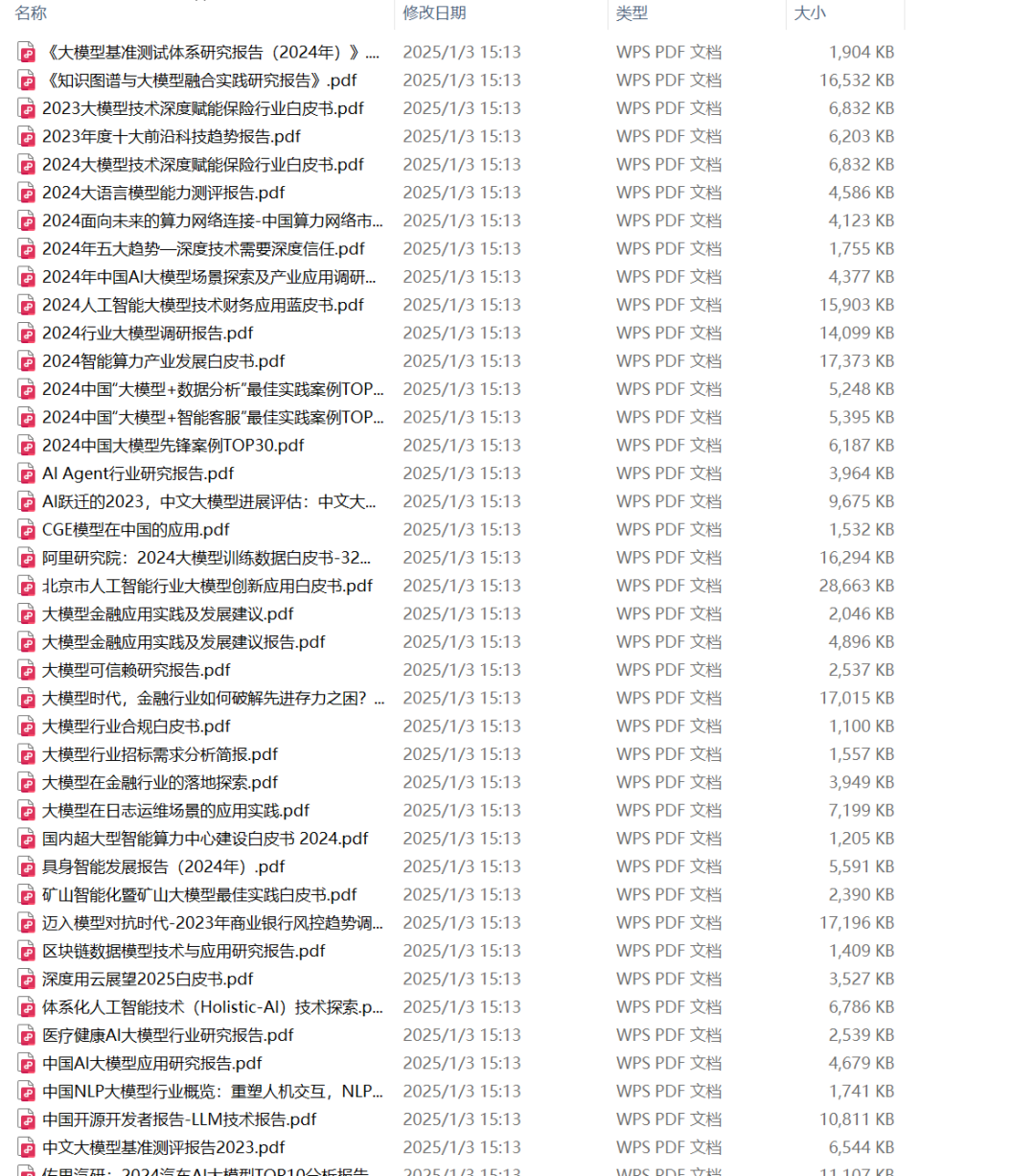

600+套大模型行业研究报告: 提供市场分析、技术趋势、竞争格局等信息,帮助了解大模型技术的行业应用和发展前景。

这份资源包对于想要系统学习大模型技术的人来说,无疑是一份极具价值的指南。首先,要充分利用其中的“大模型学习路线与阶段规划”,这相当于你的学习地图,这份指南出自于我们体系教程《NLP大模型人才培养计划》。

务必仔细研读,了解每个阶段的目标、所需技能和学习内容,并根据自身情况进行调整,制定个性化的学习计划。可以将大的学习路线分解为更小的、可实现的目标,并设定完成时间,这有助于保持学习动力和跟踪进度。

添加👇方联系方式领取【保证100%免费】

咨询大模型人才培养计划 &免费领取本文资源

大模型学习路线与阶段规划

本路线旨在帮助学员掌握大模型相关技术栈,以及大模型在行业场景中的应用,包含企业级大模型项目实战。

各阶段详细学习内容:

阶段一:自然语言处理(NLP)与AI基础

-

目标: 掌握NLP与深度学习AI的基础知识,为后续大模型学习打下坚实基础。

-

学习内容:

-

- 自注意力机制(self-attention)

- 如何让模型学习到文本中不同语段的上下文联系?

- 巧用位置编码,传递语句前后顺序关系

- 核心计算流程:编码(Encoder)和解码(Decoder)

- 实践任务一: 使用Pytorch手撸Transformer

- 实践任务二: 全能的Transformer,解决时序预测问题

-

- 循环神经网络结构拆解

- 如何解决长序列的知识遗忘问题?—长短期记忆神经网络

- 基于PyTorch实现RNN代码架构

- 如何赋予模型双向学习能力?

- 在不同任务中的RNN的用法区别:分类、序列标注等

- 实践任务: 基于RNN的分词任务实战

-

- 卷积神经网络结构拆解

- 基于PyTorch实现CNN代码架构

- 卷积网络中的经典层(Layer)及其实现方法

- 卷积网络中的经典模块(Module)及其实现方法

- 使用卷积网络建模的经典模型介绍

- 实践任务: 使用CNN搭建文本分类模型

-

- 实践任务二: 深度学习开发环境搭建

-

- 实践任务一: 从0实现逻辑回归模型

-

- 人工智能的发展路径

- 机器学习优化方法和应用

- 深度学习的发展和应用范式的演变

- 卷积神经网络(CNN)

- 循环神经网络(RNN)

- Transformer架构

阶段二:自然语言处理实战

-

目标: 结合实际场景,掌握NLP技术栈中的任务分类及相关技术。

-

学习内容:

-

- BERT的模型结构解析

- BERT预训练方法

- Mask掩码机制:让模型自己做「完形填空」

- 长段落上下文信息增强,预测下一句(NSP训练策略)

-

- 数据准备: 准备训练数据、基础文本预处理

- 最简单的编码方法:One-Hot

- 词袋表示(N-Grams词袋)

- 基于词频统计的表示方法(TF-IDF)

- 词嵌入(Word2vec、Glove、FastText)

- 可视化词向量

- 实践任务: 手写Word2vec

-

- 问题定义

- 数据获取方法

- 数据探索(EDA)&数据整理(Wrangling)&预处理(Initial Preprocessing)

- 如何将数据转化成机器可识别的语言?— 特征工程

- 算法的高级艺术:抽象方法和建模策略

- 如何衡量算法模型的好坏?—评估方法及其重要性

- 将自然语言处理算法部署成应用能力

- 实践任务: 数据分析和预处理实战

-

- 第一个自然语言处理流程

- 文本表示方法

- 预训练模型 - BERT

阶段三:多模态大模型与知识图谱自动化构建

-

目标: 掌握多模态大模型架构,以及如何利用大模型自动化构建知识图谱。

-

学习内容:

-

- 知识图谱Schema建设方案

- 基于大模型的实体识别和关系构建方法

- 基于大模型的输入存储和图谱查询方法

- 自动化迭代策略

- 实践内容:

-

- 学习如何使用大模型根据行业数据特点帮助简历并完善知识图谱schema

- 学习如何在Prompt中通过ICL增强大模型对任务的理解

- 学习如何通过微调大模型,优化实体识别和关系关系构建效果

- 学习如何让大模型理解知识图谱的总体架构,从而让大模型能够根据用户输入去自动生成数据存储和查询知识图谱的指令

- 如何驱动大模型周期性得评估知识图谱结构的优劣,自动生成优化方案

-

- 学习如何构建指令模板

- 学习如何微调训练多模态大模型

- 搭建图像要素自动识别和多模态问答demo系统

-

- 多模态大模型

- 基于大模型的知识图谱自动化构建项目实战

阶段四:企业级大模型应用落地方案 - RAG实战

-

目标: 从0-1搭建通用性RAG应用框架,并应用于多个行业场景。

-

学习内容:

-

- 企业级应用框架设计与实现

- 三个标准流程的抽象与搭建方法(RAG.Chain)

- 灵活的功能组件实现策略(RAG.Module)

- 自定义文档加载器:PDF图文信息增强识别

- 自定义开发文档分割组件:中文段落切分优化方案

- 依赖服务的接入方法:向量数据库、大模型推理服务、embedding、重排序模型

- RAG评估流程搭建

- 基于LangSmith和langfuse搭建RAG流程监控系统

- RAG场景化进阶:基于知识图谱的增强策略(接入现有图谱数据、GraphRAG)

-

- RAG任务介绍 & 技术发展历程

- RAG依赖哪些组件和能力?(向量数据库、大模型推理服务)

- 模块化RAG系统架构设计 — 从理论到实战

- 主流的(开源)RAG应用开发框架

- RAG生态工具和能力

- 实践内容:

阶段五:Agent项目实战

-

目标: 掌握Agent技术,应对系统状态变化不可控的复杂场景。

-

学习内容:

-

- 学习如何通过Prompt引导Agent进行推理

- 学习Agent推理和验证流程的实现方法

- 学习如何让Agent在合适任务上调用外部能力来增强效果

- 学习如何搭建多Agent系统

- 学习如何解决多跳问题:ReAct的实现方法

- 「人人都是AI开发专家」实践一:基于ModelScope Agent搭建一个应用开发助手

- 「人人都是AI开发专家」实践二:基于Coze搭建一个知识问答机器人

-

- Agent通用架构介绍

- Agent中的规划(Planning)和推理(Reasoning)能力

- Agent的文本输出和工具调用

- 经典AI Agent案例分析

- ModelScope-Agent项目拆解

- 实践内容:

阶段六:大模型应用算法工程师面试辅导

-

目标: 提升面试技巧,成功斩获大模型应用算法工程师职位。

-

学习内容:

-

- 在企业中的发展路径

- 职业规划:如何快速升职加薪

- 技术层面如何持续性的自我提升

-

- 优秀简历模板讲解

- 典型简历抽样点评

- 大模型面试知识点整理和分享(八股文)

- 一线互联网大厂的面试流程及侧重点

- 面试技巧分享

- 面试时的几大忌讳

-

- 面试攻略及指导

- 大模型应用算法工程师的职业规划

人工智能论文PDF合集

切忌贪多嚼不烂。建议从综述性论文入手,了解特定领域的整体情况和关键研究方向。同时,关注奠定大模型基础的经典论文,例如 Transformer 架构的论文。阅读时,精读与泛读结合,对于重要的论文仔细阅读并理解细节,对于其他论文则快速浏览以了解主要思想。务必做好笔记,记录论文的关键信息、创新点和实验结果,方便以后回顾。

52个大模型落地案例合集

52个大模型落地案例合集”是理论联系实际的绝佳素材。通过案例分析,了解大模型是如何应用于实际问题的,并思考这些案例是否可以应用于你感兴趣的领域。学习案例中的成功经验和遇到的挑战,并尝试复现一些简单的案例,加深理解。

100+本数据科学必读经典书

“100+本数据科学必读经典书”是夯实基础的基石。将书籍按照主题进行分类,例如机器学习、深度学习、自然语言处理、统计学、编程等,并根据自身背景和学习目标,选择合适的书籍。

从入门书籍开始,逐步深入。阅读时,参考其他读者的评论和推荐,选择高质量的书籍,并避免贪多嚼不烂,一次只读几本书,确保理解并掌握内容。

600+套大模型行研报告

“600+套大模型行研报告”是了解行业趋势的重要窗口。通过阅读行研报告,了解大模型技术的最新发展趋

部分资源内容展示

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)