LangChain初体验(一)环境搭建及创建Deepseek聊天机器人

使用LangChain结合Deepseek模型,构建最简单的聊天机器人demo

·

1、环境准备

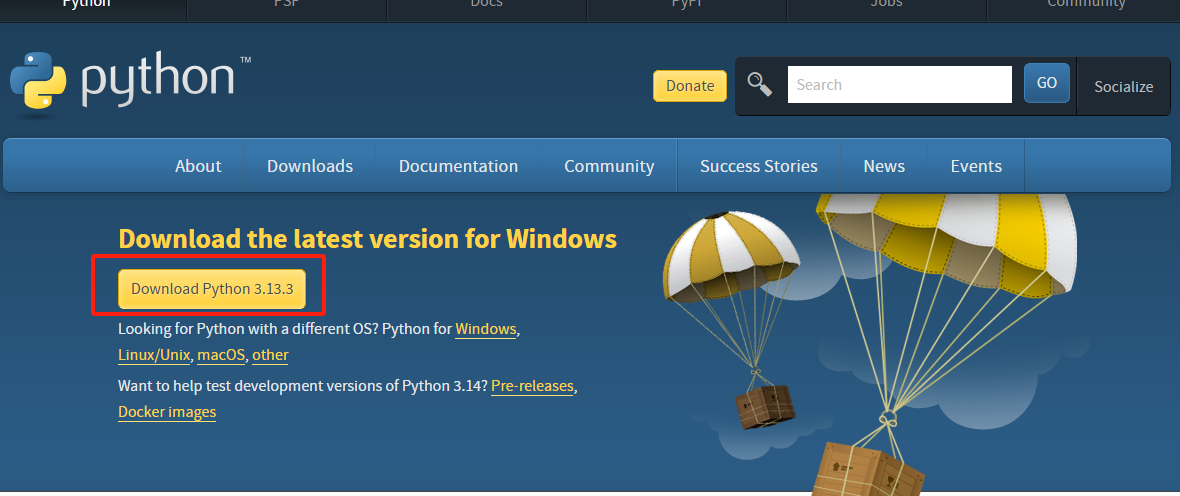

1.1 安装python

下载后,一键式安装。

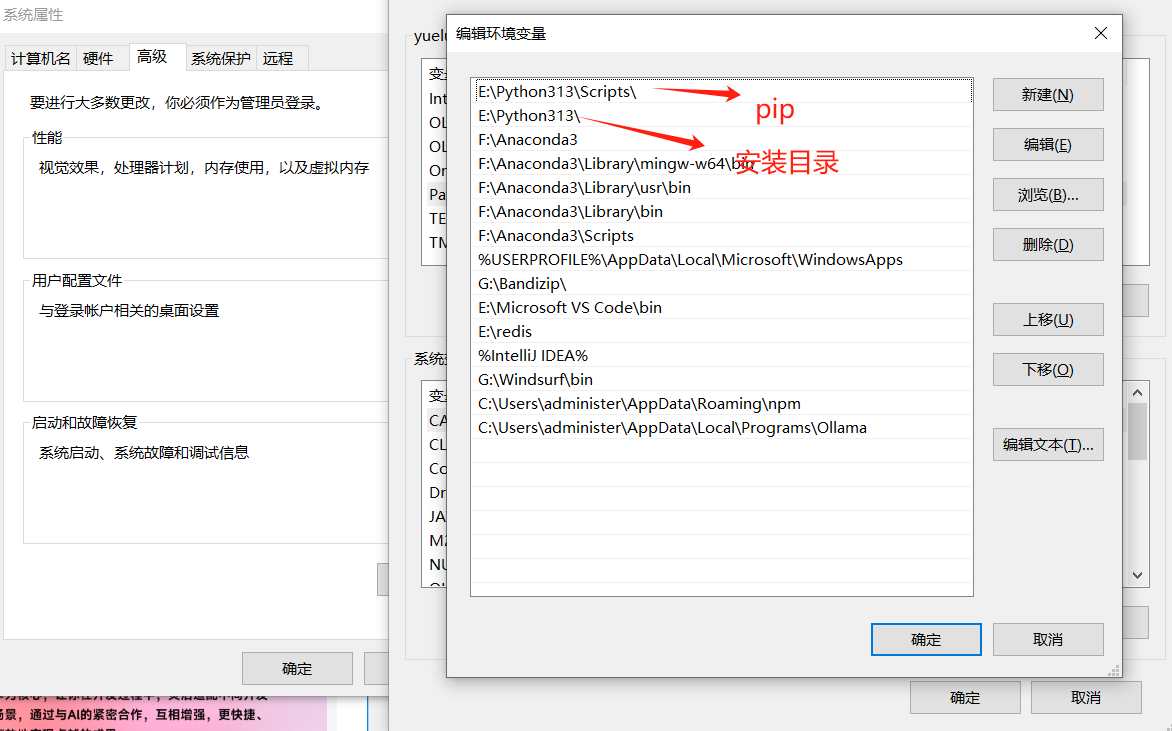

需要设置环境变量:

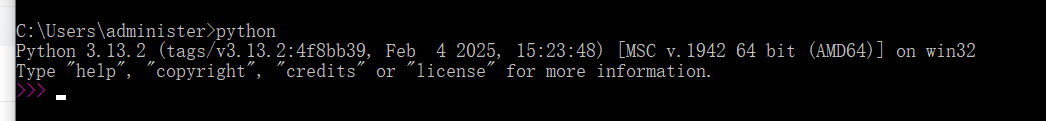

CMD运行出现如下效果,说明安装成功。

1.2、安装LangChain

pip install langchain1.3、安装LangChain集成的DeepSeek模型

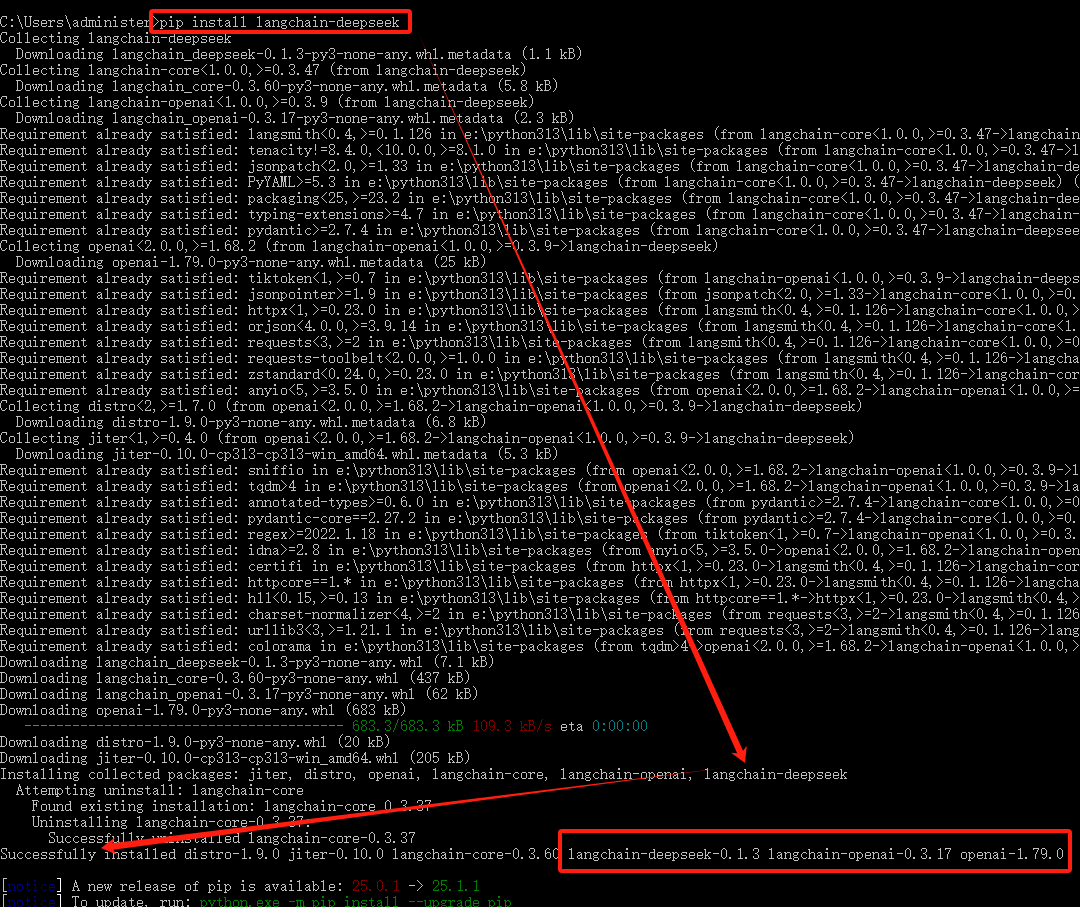

pip install langchain-deepseek

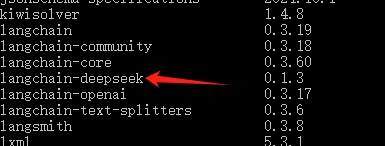

执行完命令可以看到对应的模型依赖已经下载,也可以通过如下命令进行查看安装列表是否存在:

pip list

2、代码实践

# 导入 lanchain集成的 DeepSeek 聊天模型

from langchain_deepseek import ChatDeepSeek

from urllib3 import response

llm = ChatDeepSeek(model="deepseek-chat", # 模型名称,deepseek-chat: 大模型

temperature=0.5, # 控制输出随机性的参数,0.0-1.0之间,

api_key="api key")

messages = [

{"role": "system", "content": "你是一个有帮助的AI助手。"}, # 系统设置

{"role": "user", "content": "畅享一下未来AI的发展前景"} # 你的问题

]

response = llm.invoke(messages)

print(response.content)程序输出如下:

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)