转行大模型,真的得感谢开源

《从CURD工程师到大模型架构师的转型之路》分享了作者三年多的AI领域转行经验。2023年接触智能客服等项目积累实战经验,2024年技术深耕并发表论文,2025年成功转型为大模型架构师。文章总结了四大核心心得:可视化理解算法、夯实经典理论基础、重视动手实践(如复现ReAct Agent)、善用开源资源(如LangChain)。特别介绍了"分层记忆大脑"项目,通过短期/长期记忆机

从CURD工程师到大模型架构师:我的转行之路与心得

开源项目地址:github.com/adongwanai/AgentGuide

作为曾经的CURD boy,我在2022年底接触GPT后,便坚定了转行大模型领域的决心。从后端开发到大模型架构师,这三年多的转型之路,充满挑战却也收获满满。

转行历程:一步一个脚印的进阶

2023年,我正式踏入大模型应用领域,开始承接智能客服、数字人相关项目,同时为企业提供模型微调服务,在实践中积累核心技术经验;2024年聚焦技术深耕,不仅发表了相关论文,年底更是开启高强度的项目攻坚与面试准备,凭借丰富的实践经历,面试时轻车熟路,期间也一直担任面试官,深入理解行业招聘需求;2025年,成功转型为大模型架构师,目前主要负责Agentic RAG、强化学习(RL)等核心方向的研发。

回顾这段历程,支撑我坚持下来的,除了对技术迭代的危机感和发自内心的兴趣,开源生态的助力至关重要!正是借助开源资源,复杂的算法得以通过可视化流程图变得清晰,晦涩的论文也能在社区讨论与代码复现中被逐一攻克。

转行核心心得:从理论到实践的落地指南

1. 别怕复杂,先把算法“画”出来

强烈推荐《100+ LLM/RL算法原理图》!当Transformer、DPO等复杂算法被拆解成一张张清晰的流程图时,那种豁然开朗的感觉至今难忘。对着流程图去“手撕”代码,能精准定位核心逻辑,效率远高于埋头啃论文。可视化的呈现方式,能帮我们快速建立对算法的整体认知,降低入门门槛。

2. 从经典出发,夯实核心基础

入门阶段不必追求前沿,经典论文是最好的导师。ReAct论文是我的入门起点,它让我彻底理解了Agent“思考-行动”的核心循环逻辑;而Self-RAG则带我摸清了Agentic RAG的精髓——如何让检索增强生成具备自我修正和迭代的能力。从经典理论切入,逐步搭建知识体系,后续学习前沿技术时会更得心应手。

3. 动手实操:理论落地的唯一路径

理论学得再扎实,不动手就是空中楼阁。转型期间,我逼着自己完成三项核心实操任务,彻底打通“理论-实践”链路:

-

手撕Multi-Head Attention模块,吃透Transformer的底层运行逻辑;

-

复现简易版ReAct Agent,实现从代码到可运行模型的突破;

-

独立开发完整的Agentic RAG项目,该项目后来成为简历中的核心亮点,面试时几乎每位面试官都会深入追问。

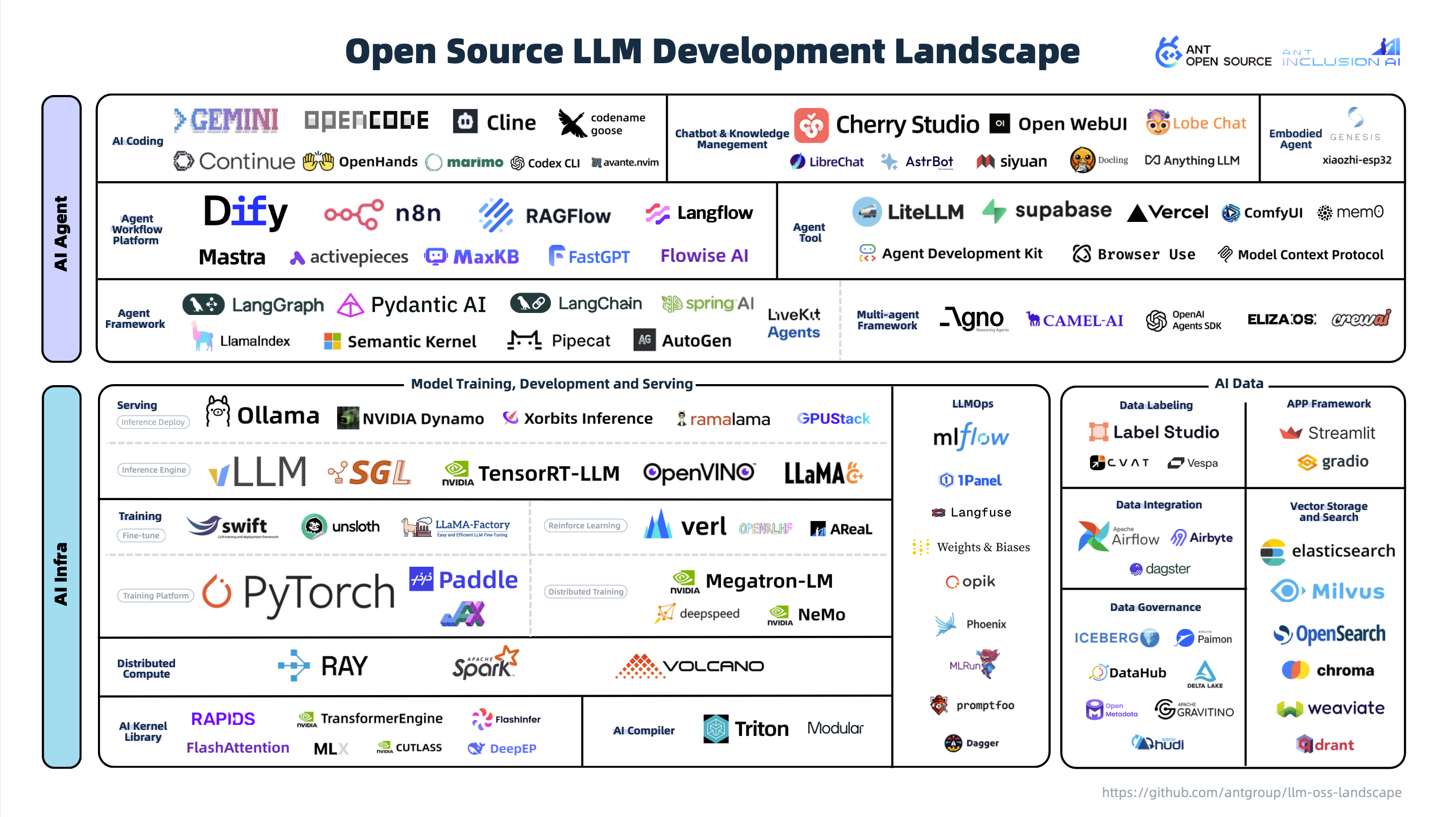

4. 借力开源:站在巨人的肩膀上成长

开源社区是转型路上的“加速器”:LangChain的源码让我学到了大模型工程化的优秀实践;AutoGen框架带我领略了多智能体协作的魅力;OpenRLHF则是我入门强化学习训练的绝佳引路人。善用开源资源,能少走90%的弯路。

实战项目:Agent“分层记忆大脑”设计

分享一个让我在面试中脱颖而出的核心项目,希望能给大家带来启发:

项目灵感

借鉴人类记忆机制,将Agent的记忆分为短期记忆(Working Memory)和长期记忆(Event Memory),解决传统Agent记忆存取效率低、冗余信息多的问题。

核心实现

设计分层记忆架构,通过自动总结、重要性评分和时间衰减三大核心机制,实现Agent对信息的高效存取与智能遗忘。

实际效果

信息有效保留率提升至92%,同时检索速度提升3倍,大幅优化Agent的交互响应效率。

写在最后

经常有同学问我“转行大模型难不难”,我的答案是:只要找对方法、坚持实操,就没有跨不过的门槛。目前我正将自己转型以来的所有积累——学习路线、踩坑笔记、论文解读、项目源码等全部开源,希望能为更多转行路上的同学提供助力。

开源项目地址:github.com/adongwanai/AgentGuide

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)