PYTHON通过VOSK实现离线听写支持WINDOWS&Linux_X86架构

本文介绍了基于Python的离线语音识别系统实现方案,使用Vosk和PyAudio库构建无需网络连接的语音转文字功能。该系统采用Vosk开源引擎(支持多语言、预训练模型)和PyAudio音频处理库,通过设置16kHz采样率的音频输入流,实时处理语音数据。文章详细解析了音频输入配置、Vosk模型加载、语音识别核心逻辑等关键技术实现,并探讨了实时音频流处理、识别状态管理等要点。该系统适用于智能家居、车

在当今人工智能快速发展的时代,语音识别技术已经成为人机交互的重要方式之一。本文将介绍如何使用Python结合Vosk和PyAudio库实现一个离线语音识别系统,无需依赖网络连接即可完成语音转文字的功能。

技术栈概述

1. Vosk语音识别引擎

Vosk是一个开源的语音识别工具包,支持多种语言,具有以下特点:

-

离线工作,不需要网络连接

-

轻量级,适合嵌入式设备

-

支持多种编程语言接口

-

提供预训练模型,开箱即用

2. PyAudio音频处理库

PyAudio是Python的音频处理库,提供跨平台的音频输入输出功能:

-

支持实时音频流处理

-

简单易用的API

-

跨平台支持(Windows, Linux, Mac)

代码实现解析

1. 环境准备与依赖安装

首先需要安装必要的Python库:

bash

复制

下载

pip install vosk pyaudio

2. 音频输入设置

python

复制

下载

import pyaudio

# 初始化音频输入流

p1 = pyaudio.PyAudio()

IVW_ASR_TARGET_DATA_LINE = p1.open(format=pyaudio.paInt16,

channels=1,

rate=16000,

input=True,

frames_per_buffer=6400)

这里我们设置了:

-

音频格式为16位整数(paInt16)

-

单声道(channels=1)

-

采样率16kHz(rate=16000)

-

每帧6400字节的缓冲区

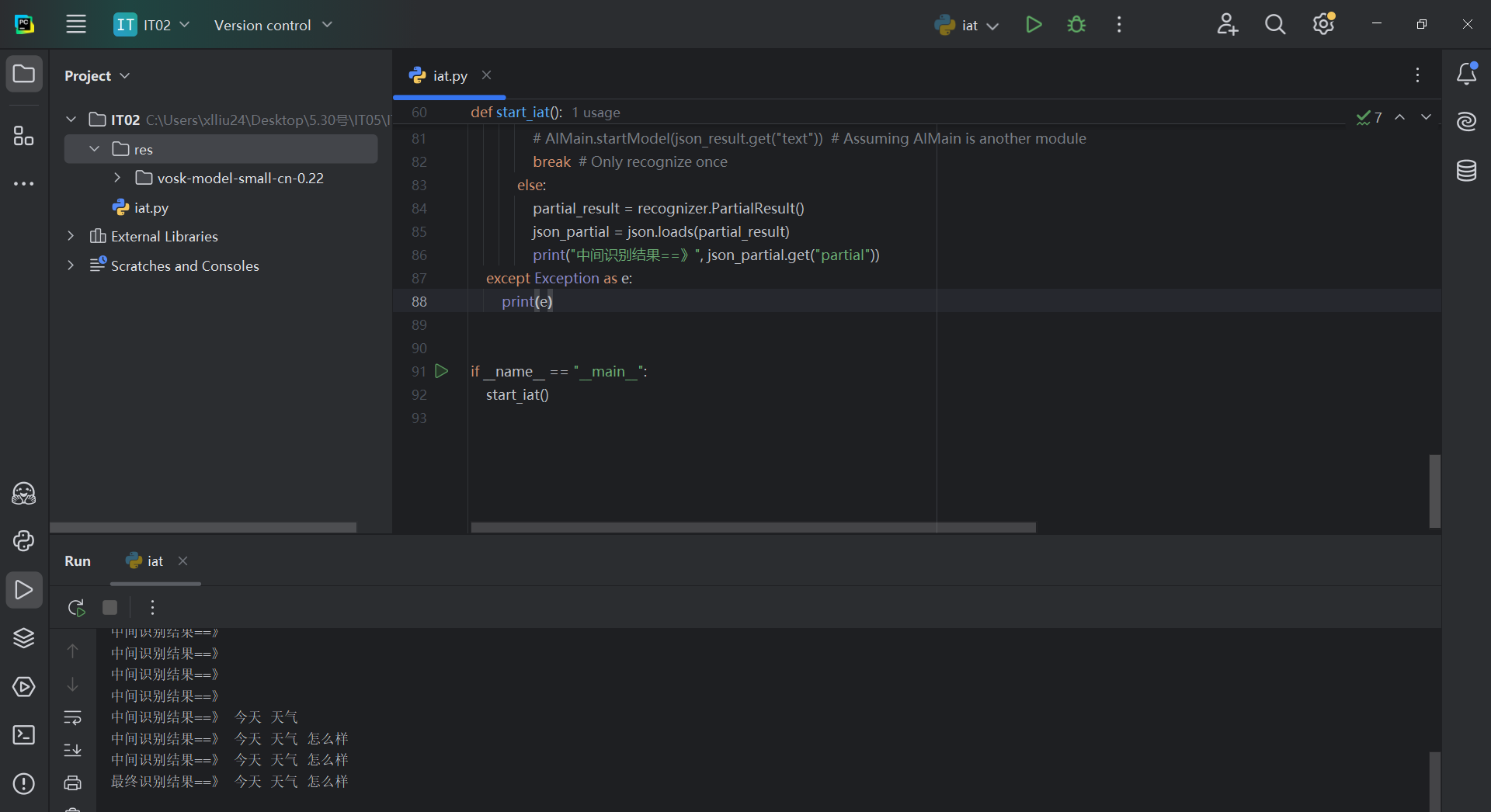

3. Vosk语音识别核心代码

python

复制

下载

from vosk import Model, KaldiRecognizer

def start_iat():

# 加载中文语音模型

model = Model("res/vosk-model-small-cn-0.22")

recognizer = KaldiRecognizer(model, 16000)

try:

while True:

# 读取音频数据

buffer = IVW_ASR_TARGET_DATA_LINE.read(6400)

if len(buffer) == 0:

break

# 处理语音识别

if recognizer.AcceptWaveform(buffer):

# 获取最终识别结果

result = recognizer.Result()

json_result = json.loads(result)

print("最终识别结果==》", json_result.get("text"))

break

else:

# 获取中间识别结果

partial_result = recognizer.PartialResult()

json_partial = json.loads(partial_result)

print("中间识别结果==》", json_partial.get("partial"))

except Exception as e:

print(e)

4. 模型文件准备

Vosk需要下载对应的语音模型文件,中文小模型可以从Vosk官网下载,解压后放在res/vosk-model-small-cn-0.22目录下。

关键技术点解析

1. 实时音频流处理

使用PyAudio的open()方法创建音频输入流,通过循环读取音频数据实现实时处理:

python

复制

下载

while True:

buffer = IVW_ASR_TARGET_DATA_LINE.read(6400)

# 处理buffer...

2. 语音识别状态处理

Vosk识别器提供两种结果获取方式:

-

AcceptWaveform(): 当检测到语音结束时返回True,可通过Result()获取最终结果 -

PartialResult(): 实时返回中间识别结果

3. 多线程处理考虑

在实际应用中,可能需要将音频采集和语音识别放在不同线程中处理,以避免阻塞主线程。

应用场景扩展

-

智能家居控制:通过语音指令控制家电

-

车载语音助手:离线环境下的语音导航和控制

-

工业设备语音控制:嘈杂环境下的语音指令识别

-

语音笔记应用:快速记录会议内容或灵感

性能优化建议

-

模型选择:根据需求平衡精度和速度,小模型速度快但精度略低

-

音频预处理:添加噪声抑制、回声消除等处理提高识别率

-

关键词检测:结合唤醒词检测降低系统功耗

-

结果后处理:添加语法检查提高识别文本质量

常见问题解决

-

模型加载失败:检查模型路径是否正确,文件是否完整

-

音频无法输入:检查麦克风权限和硬件连接

-

识别率低:尝试调整音频采样参数或更换更大模型

-

延迟问题:优化缓冲区大小,或使用更高效的硬件

结语

本文介绍了使用Python+Vosk+PyAudio实现离线语音识别的基本方法。这种方案特别适合需要隐私保护或网络条件受限的场景。通过简单的代码修改,读者可以将其集成到各种应用中,实现语音交互功能。

完整的项目代码已在上文展示,读者可以根据实际需求进行调整和扩展。语音识别技术正在快速发展,期待未来有更多更强大的开源工具出现。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)