新书推荐:《图解大模型》轻松上手 LLM!

《图解大模型:生成式AI原理与实战》是一本面向经济学研究者的LLM入门指南,由NLP专家Jay Alammar和BERTopic开发者Maarten Grootendorst合著。该书通过图解和代码实战(GitHub开源)的方式,系统讲解LLM核心概念(如Token、Embedding)、模型类型(编码器/解码器)及其在文本分析中的应用。特别适合需要处理非结构化数据的经济学者,书中还新增了Deep

温馨提示:若页面不能正常显示数学公式和代码,请阅读原文获得更好的阅读体验。

作者: 陈云菲(复旦大学)

邮箱: cyfreya17863928515@163.com

- Title: 新书推荐:《图解大模型》轻松上手 LLM!

- Keywords: 大型语言模型 (LLM), 文本分析, 聚类与主题建模, Python代码实战, Prompt Engineering

1. 简介

理解并灵活运用大型语言模型(LLMs),正逐渐成为经济学研究者的新型“基本功”。今天推荐的这本书——《Hands-On Large Language Models》,由 Jay Alammar 和 Maarten Grootendorst 联合撰写,O’Reilly Media 出版,用 LLM 做研究,这本书是最好的起点。

- Jay Alammar 是 NLP 界的“图解大师”,擅长将复杂的模型原理通过图解和类比方式讲得清清楚楚,被誉为“最懂普通人学习语言模型痛点的人”。

- Maarten Grootendorst 是知名的开源项目作者,开发了在经济学中极具实用价值的 BERTopic,被广泛用于文本挖掘、社交媒体等主题建模中。

该书的中文版也于今年上线,译名为《图解大模型:生成式AI原理与实战》,还特别增加了 DeepSeek-R1 模型的工作机制讲解,十分贴心。

2. 为什么经济学研究者值得读这本书?

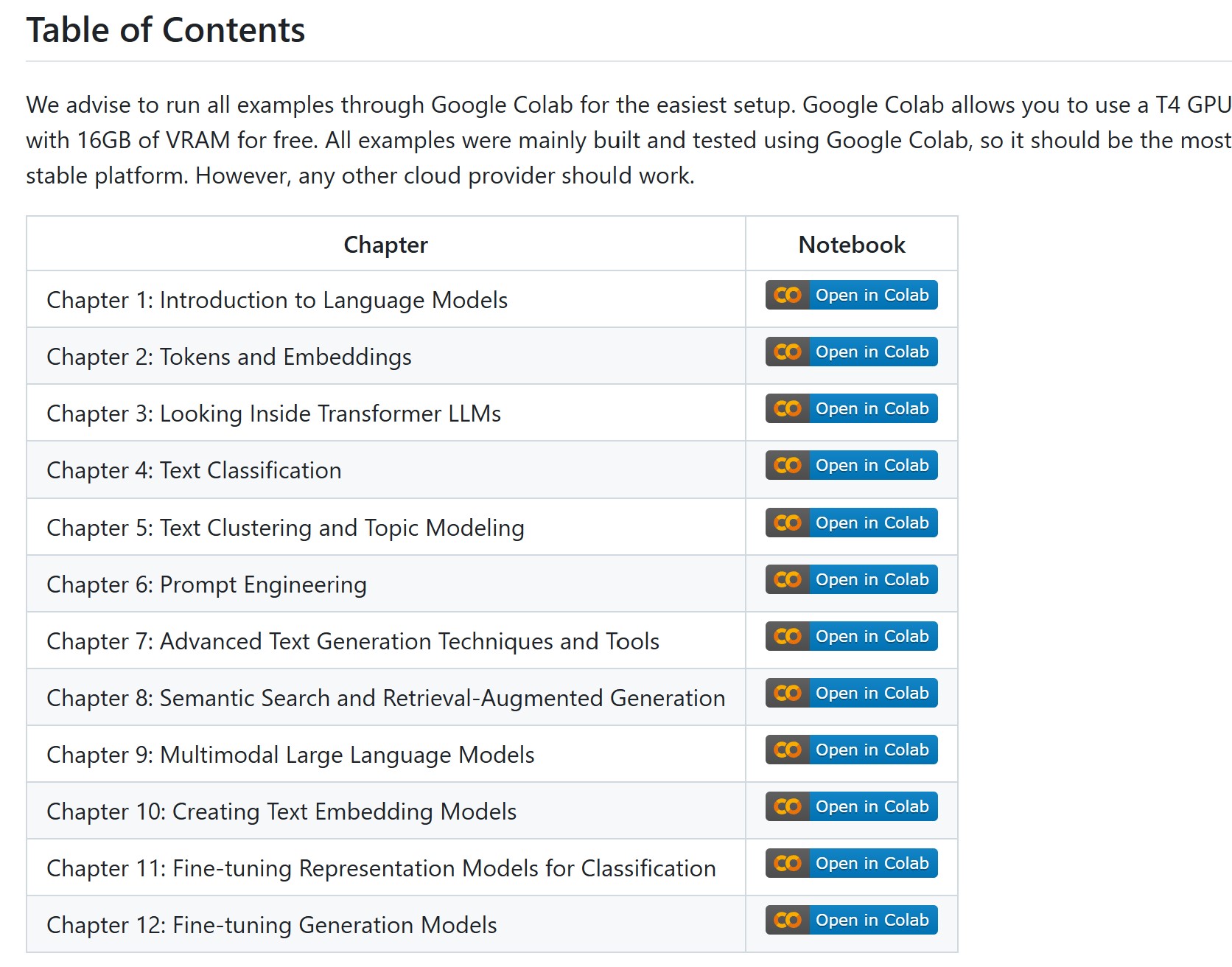

《Hands-On Large Language Models》是一本有代码、能实战、跑得通的 LLM 入门与进阶指南,每个章节都有相应开源代码,代码全部托管于 GitHub 平台,方便读者随时获取,也支持在 Google Colab 平台上直接运行。

搭配 GitHub 源码:边学边练

Hands-On Large Language Models

https://github.com/HandsOnLLM/Hands-On-Large-Language-Models

本文将以经济学研究者的视角出发,系统梳理这本书中最不容错过的几个实用亮点:

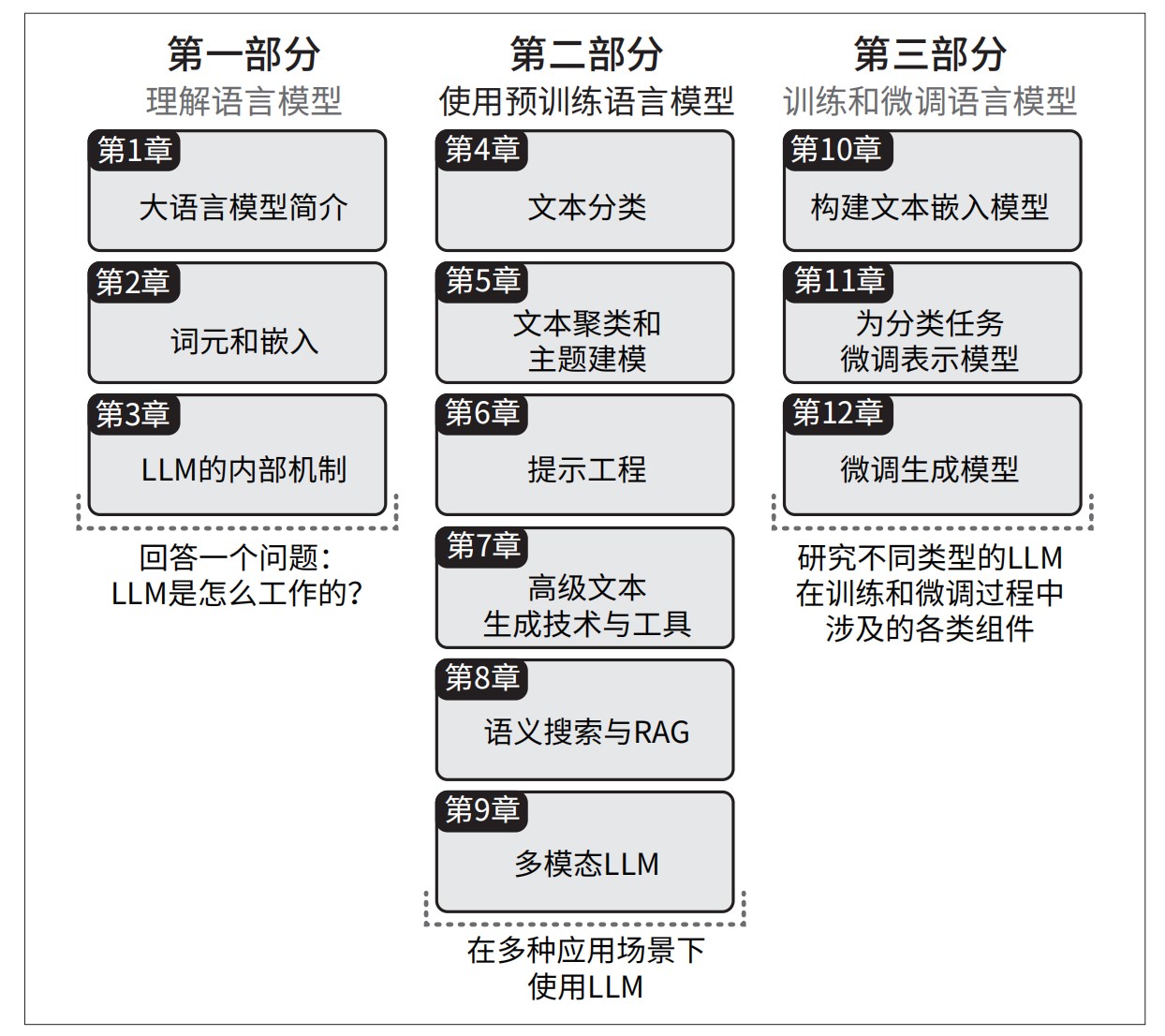

3. Part 1:LLM的基础概念及底层逻辑

对于非计算机专业背景的学者来说,理解 LLM 的运作机制常常是一个认知门槛。这本书前三章通过类比图示+实用案例+代码的方式,讲透了以下几个关键概念:

- Token(词元)是如何被切分与处理的?

- Embedding(嵌入):文本转向量的核心技术

- 将新闻报道、社交评论等非结构化数据转化为向量,是后续聚类、回归、因果分析等任务的前提

- 理解嵌入的演化过程(Bag-of-Words → Word2Vec → Transformer),解释为什么传统方法难以捕捉语义、而LLM 则可以

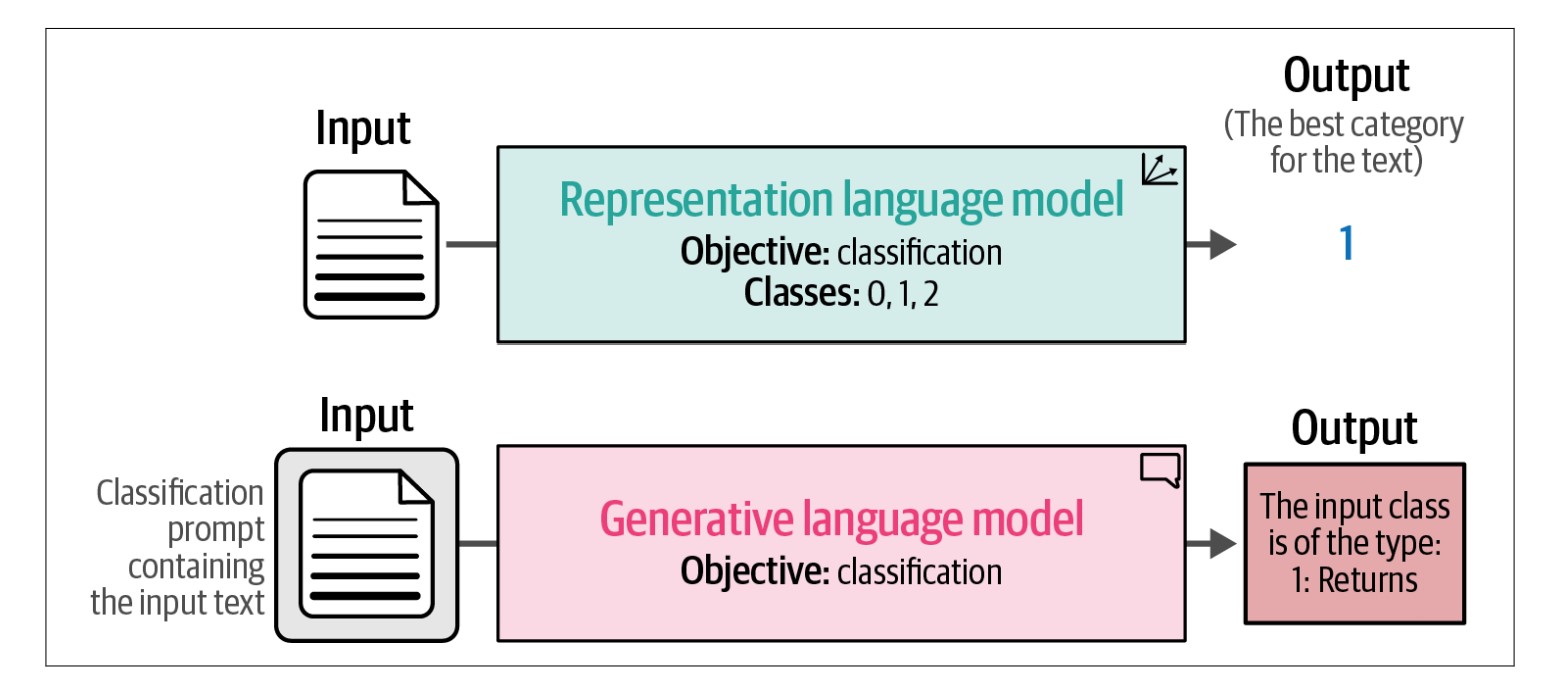

- LLM 模型梳理: Representation vs. Generative

- Representation Models(编码器): 如 BERT,擅长捕捉上下文语义,适用于文本分类、实体识别等任务

- Generative Models(解码器): 如GPT系列,擅长生成连贯文本,可用于模拟经济情景等

温馨提示:若页面不能正常显示数学公式和代码,请阅读原文获得更好的阅读体验。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)